Инструментите за контрол на използването на изкуствен интелект (ИИ) осигуряват критичния слой на управление, от който предприятията се нуждаят, за да внедрят безопасно генеративния ИИ. Тези решения наблюдават взаимодействията на служителите, прилагат политики за данни в реално време и предотвратяват изтичането на чувствителна информация към публични модели като ChatGPT и Gemini.

Какво представляват инструментите за контрол на използването на изкуствен интелект и защо са важни

Инструментите за контрол на използването на изкуствен интелект (AIUC) са специализирани платформи за сигурност, които управляват взаимодействието между корпоративните потребители и приложенията за генеративен изкуствен интелект. За разлика от традиционните DLP или защитни стени, които се фокусират върху прехвърлянето на файлове и мрежовите периметри, AIUC решенията проверяват съдържанието на подканите и отговорите в реално време. Те позволяват на организациите да дефинират политики, базирани на намерения, като например да разрешат на маркетинговите екипи да използват изкуствен интелект за генериране на копия, като същевременно блокират инженерните екипи да поставят собствен код в същия инструмент.

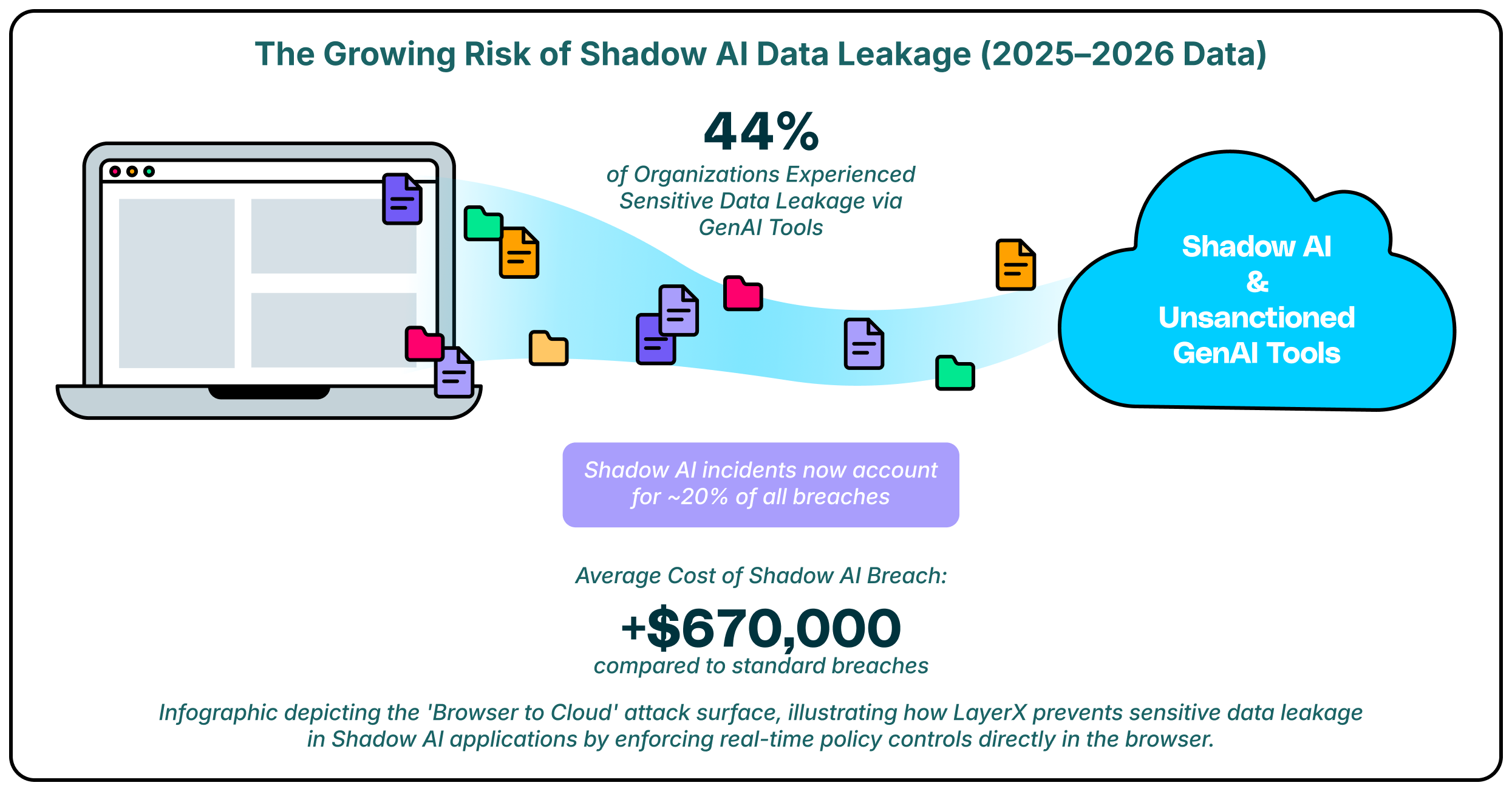

Тази категория стана от съществено значение с разширяването на повърхността за атаки „от браузър към облак“. Служителите все по-често заобикалят корпоративните мрежи, за да имат достъп до инструменти с изкуствен интелект директно чрез уеб браузъри, създавайки слепи зони за наследените системи за сигурност. Чрез прилагане на сигурност на ниво браузър и самоличност, тези инструменти смекчават рисковете, свързани със сенчестия изкуствен интелект, враждебното подканване и неоторизираното споделяне на данни, без да се изисква обща забрана, която задушава иновациите.

Ключови тенденции в контрола на използването на изкуствен интелект, които да наблюдаваме през 2026 г.

Основна промяна през 2026 г. е преминаването към управление, ориентирано към идентичността. Лидерите в областта на сигурността осъзнават, че блокирането на URL адреси, базирани на изкуствен интелект, е неефективно и че контекстът е по-важен от обикновения контрол на достъпа. Водещите стратегии сега се фокусират върху разбирането „кой“ взаимодейства с „какви“ данни, което позволява на организациите да прилагат подробни политики, които се адаптират въз основа на ролята на потребителя. Това гарантира, че финансовият директор и разработчикът на софтуер се сблъскват с различни, подходящи предпазни мерки, когато използват един и същ инструмент с изкуствен интелект.

Друга доминираща тенденция е консолидирането на контроли в рамките на корпоративния браузър. Тъй като по-голямата част от взаимодействието с изкуствен интелект се осъществява чрез уеб интерфейси, браузърът се е превърнал в най-ефективната точка за прилагане на „последната миля“. Инструменти, които могат да проверяват обектния модел на документа (DOM) в реално време, заместват мрежово базираните прокси сървъри, тъй като предлагат по-задълбочена видимост върху действителното съдържание, което се поставя или генерира. Това позволява откриването на динамични рискове, като атаки с бързо инжектиране, които мрежовите инспектори често пропускат поради криптиране или обфускация.

Тези платформи предлагат разнообразни подходи за осигуряване на внедряването на изкуствен интелект, от разширения, базирани на браузър, до управленски слоеве, управлявани от API.

| Решение | Ключови възможности | Най - доброто за |

| LayerX | Прилагане, базирано на браузър, откриване чрез скрит изкуствен интелект | DLP „последна миля“ и сигурен достъп |

| Исландия | Подмяна на корпоративен браузър, Самозащита | Контролирани, управлявани среди |

| Пало Алто Мрежи | SASE интеграция, прецизен изкуствен интелект | Съществуващи клиенти на Пало Алто |

| Хармонична сигурност | Защита на данните „Zero Touch“, Shadow AI | Екипи, фокусирани върху иновациите |

| Бърза сигурност | Бърза защита от инжектиране, видимост от скрит изкуствен интелект | Защита на входовете/изходите на изкуствения интелект |

| AIM Security | GenAI инвентаризация, AI-SPM | CISO се нуждаят от широка видимост |

| Ласо сигурност | Контекстно-базиран контрол на достъпа, RAG сигурност | Рамки за LLM и RAG |

| Изкуствен интелект на нощта | DLP, задвижван от изкуствен интелект, корекция в реално време | Маскиране и отстраняване на проблеми с данни |

| Свидетелски изкуствен интелект | Анализ на регулаторния риск, Вътрешна заплаха | Сектори с високо ниво на съответствие |

| Менло Секюрити | Сигурен облачен браузър, контрол на копирането и поставянето | Потребители на отдалечена изолация на браузъра (RBI) |

| Серафична сигурност | Предотвратяване на експлойти, DLP в браузъра | Спиране на експлойтите на браузъра |

1. СлойX

LayerX предлага ориентиран към браузъра подход към контрола на използването на изкуствен интелект, като поставя задълбочени възможности за видимост и прилагане директно там, където потребителите взаимодействат с инструменти на изкуствен интелект. Той функционира като разширение за корпоративен браузър, което следи всяко събитие в рамките на сесията, позволявайки му да прави разлика между безопасни заявки и рискови действия, като например поставяне на изходен код или качване на чувствителни файлове. Този подробен контрол позволява на организациите да санкционират инструменти за повишаване на производителността, като същевременно строго забраняват изтичането на данни.

Освен простото блокиране, LayerX предоставя цялостно откриване на използването на скрит изкуствен интелект (Shadow AI) в цялата работна сила. Той идентифицира всяко приложение с изкуствен интелект, до което е осъществен достъп, независимо дали е корпоративен инструмент или личен акаунт, и налага последователни политики за сигурност във всички тях. Тази възможност гарантира, че защитата на данните пътува с потребителя, като ефективно запълва разликата между строгите вътрешни стандарти за съответствие и гъвкавия характер на внедряването на уеб-базиран изкуствен интелект.

2. Остров

Island преосмисля самия браузър като основна контролна точка за сигурност, предлагайки специален „корпоративен браузър“, който замества стандартните потребителски браузъри като Chrome или Edge. Тази контролирана среда позволява на ИТ екипите да вграждат политики за сигурност директно в процеса на сърфиране, включително ограничения за копиране и поставяне на данни в AI чатботове. Той предоставя високо сигурен контейнер за чувствителна работа, гарантирайки, че никакви данни не могат да напуснат управляваната среда без разрешение.

За употреба с изкуствен интелект, Island предлага вградени функции за предотвратяване на загуба на данни, които могат да редактират чувствителна информация, преди тя да достигне до външен модел. Архитектурата на браузъра му дава пълна видимост върху действията на потребителите, позволявайки одитни следи, които подробно описват какво точно е било споделено с платформите с изкуствен интелект. Това ниво на контрол е идеално за организации, които могат да наложат специфичен браузър за цялата корпоративна работа.

3. Palo Alto Networks (браузър Prisma Access)

Браузърът Prisma Access на Palo Alto Networks интегрира защитеното сърфиране директно в по-широката си SASE архитектура. Той използва „Precision AI“, за да открива и блокира заплахи в реално време, възползвайки се от огромния набор от данни за заплахи на компанията. За използване на AI предлага контролни политики, които могат да идентифицират и блокират прехвърлянето на чувствителни данни към приложения на GenAI, като гарантират, че потребителите остават в съответствие с корпоративните стандарти за данни.

Това решение е проектирано да работи безпроблемно със съществуващата инфраструктура за сигурност в Пало Алто, предоставяйки унифициран поглед върху заплахите в мрежата и браузъра. То опростява управлението на политиките за екипи, които вече използват Prisma Access, позволявайки им да разширят съществуващите си правила за защита на данните, за да обхванат новите рискове, въведени от уеб-базираните инструменти с изкуствен интелект. Браузърът действа като точка за прилагане на правилата, която е в крак с бързите промени в пейзажа на изкуствения интелект.

4. Хармонична сигурност

Harmonic Security набляга на подхода „Zero Touch“ към защитата на данните, целящ да осигури приемането на ИИ без прекалено сложно конфигуриране. Платформата се фокусира върху класифицирането на ИИ приложения въз основа на риск и стойност, помагайки на организациите да разграничат безобидните инструменти за производителност от опасните изтичания на данни. Целта ѝ е да осигури безопасното приемане на ИИ, а не просто да го блокира.

Инструментът осигурява задълбочена видимост върху данните, потокът към доставчиците на изкуствен интелект, позволявайки на екипите да забелязват тенденции в приемането на „висококачествени“ инструменти. Harmonic използва предварително изградени модели на риск, за да автоматизира процеса на одобрение на нови инструменти, намалявайки тежестта върху анализаторите по сигурността. Тази стратегия е привлекателна за компании, които искат да насърчат иновациите, като същевременно поддържат предпазна мрежа за критични данни.

5. Бърза охрана

Prompt Security се фокусира основно върху защитата на входовете и изходите на системите с генеративен изкуствен интелект, за да предотврати изтичане и манипулиране на данни. Тяхната платформа проверява подканите в реално време, за да открие опити за джейлбрейк или инжектиране на подкани, като гарантира, че моделите с изкуствен интелект функционират по предназначение. Тя осигурява критичен слой защита за служителите, използващи инструменти като ChatGPT, като премахва чувствителна лична информация от заявките, преди да бъдат изпратени в облака.

Решението предлага и видимост върху Shadow AI чрез наблюдение на взаимодействията на служителите с външни инструменти. То дава възможност на организациите да наложат „дезинфекцирано“ използване, при което служителите могат да се възползват от помощта на AI, без да излагат интелектуалната собственост на компанията. Защитата на потока от данни на ниво бързина помага на организациите да запазят поверителността, без да е необходимо да изграждат сложна персонализирана инфраструктура.

6. Сигурност на AIM

AIM Security предоставя специализирана платформа, предназначена да помогне на CISO да създадат цялостен инвентар на цялото използване на GenAI в предприятието. Тя се фокусира върху „Управление на състоянието на сигурността на AI“ (AI-SPM), предлагайки ясна представа за това кои инструменти се използват и потенциалните рискове, свързани с тях. Тази видимост е от съществено значение за организациите, които се затрудняват да определят количествено обхвата на проблема си със сенчестия AI.

Платформата използва подход „AI-Firewall“ за управление на взаимодействията както с публични, така и с частни модели. Тя може да открива и блокира атаки с незабавно инжектиране и да предотвратява изпращането на чувствителни данни към неоторизирани модели. Фокусът на AIM върху специфичните уязвимости на LLM-овете го прави силен избор за екипи по сигурността, които се нуждаят от задълбочени, специализирани познания за своя генеративен AI стек.

7. Ласо сигурност

Lasso Security въвежда контекстно-базиран контрол на достъпа (CBAC) в управлението на изкуствения интелект, като е насочен специално към нуждите на внедряванията на LLM и RAG (Retrieval-Augmented Generation). Този метод динамично оценява заявките за достъп въз основа на идентичността, поведението и типа данни на потребителя, като гарантира, че взаимодействията са безопасни и съвместими. Той е особено ефективен за организации, които изграждат свои собствени вътрешни приложения с изкуствен интелект, които изискват строги граници на данните.

Решението се интегрира с различни среди на GenAI, за да наблюдава трансфера на данни и да открива аномалии в реално време. Lasso предпазва от нови заплахи като манипулиране на модели и отравяне на данни, които стават все по-актуални, тъй като предприятията усъвършенстват собствените си модели. Акцентът върху контекста позволява по-гъвкаво и точно прилагане на политики, отколкото простото блокиране с ключови думи.

8. Nightfall AI

Nightfall AI използва установените си предимства в предотвратяването на загуба на данни (DLP), за да се справи с контрола на използването на AI. Платформата му използва детектори за машинно обучение, обучени върху 125 милиона параметъра, за да идентифицира PII, PCI и секрети с висока точност. За използване с AI, Nightfall осигурява отстраняване на проблеми в реално време, като автоматично маскира чувствителни данни в подкани (като ChatGPT), преди да напуснат браузъра или API.

Този подход „предимно редактиране“ позволява на служителите да продължат да използват инструменти с изкуствен интелект без прекъсване, тъй като се премахват само чувствителните данни, докато останалата част от подканата остава функционална. Фокусът на Nightfall върху „контекстуалното“ откриване помага за намаляване на фалшивите положителни резултати, което е често срещан проблем в традиционните DLP системи, прилагани към разговорен изкуствен интелект.

9. Свидетелски изкуствен интелект

Witness AI е насочен към спазването на изискванията и регулаторните аспекти на използването на ИИ, което го прави подходящ за силно регулирани индустрии като финанси и здравеопазване. Платформата предоставя анализи на поведенческия риск и регулаторната експозиция, помагайки на организациите да съпоставят използването на ИИ с вътрешните политики. Тя е проектирана да открива вътрешни заплахи чрез анализ на моделите на разговори във времето.

Решението създава специализирана одитна следа за взаимодействията с изкуствен интелект, което е от съществено значение за доказване на съответствие по време на одити. Като се фокусира върху осигуряването на „безопасна употреба“, Witness AI помага на организациите да се ориентират в сложния пресечен пункт между бързото внедряване на технологии и строгите вътрешни изисквания. То осигурява необходимия надзор, за да се гарантира, че стратегиите с изкуствен интелект не нарушават правилата за управление на данните.

10. Менло Секюрити

Menlo Security използва своята технология за отдалечена изолация на браузъра (RBI), за да създаде защитен буфер между потребителите и приложенията на GenAI. Тяхното решение „Menlo for GenAI“ предлага подробни контроли за копиране и поставяне, гарантиращи, че потребителите не могат да въвеждат чувствителен код или лична информация в интерфейсите на чатботове. Този подход по същество третира приложението с изкуствен интелект като ненадеждна дестинация, изолирайки взаимодействието, за да предотврати загуба на данни.

Освен изолацията, Menlo предоставя анализи на сърфирането, за да регистрира точно какви данни се споделят с AI платформи. Тази видимост помага на екипите по сигурността да одитират моделите на употреба и да налагат съответствие, без да е необходимо да разполагат агенти на всяка крайна точка. Това е подходящо за организации, които вече разчитат на изолация за уеб сигурност.

11. Серафична сигурност

Seraphic Security предоставя корпоративна платформа за сигурност на браузъра, която работи във всеки стандартен браузър, фокусирайки се върху предотвратяване на експлойти и защита по време на изпълнение. Нейните възможности за „In-Browser DLP“ наблюдават взаимодействията на потребителите с инструменти с изкуствен интелект, блокирайки споделянето на чувствителни данни в реално време. Технологията на Seraphic инжектира защитен слой в сесията на браузъра, за да контролира изпълнението на JavaScript, което помага за предотвратяване на напреднали атаки, насочени към самия браузър.

Решението предлага задълбочена видимост върху това как служителите използват изкуствен интелект, регистрира подкани и отговори, за да гарантира спазването на политиките за управление на данните. Чрез спиране на атаките на ниво браузърен енджин, Seraphic защитава от сложни заплахи, които биха могли да се опитат да заобиколят традиционните методи за откриване. То е проектирано да бъде леко и съвместимо със съществуващите корпоративни работни процеси.

Как да изберем най-добрия доставчик на контрол на използването на изкуствен интелект

- Оценете дали решението предлага видимост на ниво браузър, за да улови използването на Shadow AI, което мрежовите прокси сървъри биха могли да пропуснат поради криптиране.

- Търсете политики, съобразени с идентичността, които ви позволяват да променяте правилата за достъп въз основа на ролята на потребителя и специфичния контекст на данните.

- Оценете модела на внедряване, за да се уверите, че е подходящ за вашата инфраструктура, независимо дали става въпрос за леко разширение за браузър или за пълна подмяна на браузъра.

- Проверете дали инструментът може да открива и блокира враждебни заплахи, като например незабавно инжектиране и джейлбрейк в реално време.

- Проверете за възможности за интеграция със съществуващите си SIEM и IdP системи, за да осигурите унифициран работен процес за сигурност.

Въпроси и Отговори

Каква е разликата между контрола на използването на AI и традиционния DLP?

Традиционната DLP защита често е проектирана за защита, базирана на файлове, и ѝ липсва контекстът, за да разбере диалоговите подкани на изкуствения интелект. Инструментите за контрол на използването на изкуствен интелект са специално създадени, за да анализират намерението и съдържанието на взаимодействията с LLM, което им позволява да блокират специфични рискови действия, като например поставяне на код, без да блокират цялото приложение.

Могат ли тези инструменти да откриват приложения за „Shadow AI“?

Да, повечето платформи за контрол на използването на изкуствен интелект включват възможности за откриване, които регистрират всички приложения с изкуствен интелект, до които служителите имат достъп. Те предоставят табла за управление, които показват кои инструменти се използват, колко често и от кого, което позволява на екипите по сигурността да идентифицират неоторизирани приложения, които могат да представляват риск.

Необходим ли ми е специален браузър, за да използвам тези инструменти?

Не е задължително. Докато някои решения като Island и Palo Alto Networks изискват специален корпоративен браузър, други като LayerX и Reco работят като разширения или API интеграции, които работят със съществуващите ви стандартни браузъри (Chrome, Edge) и SaaS среди.

Как тези инструменти обработват криптиран трафик?

Решения, базирани на браузър, като LayerX и Island, могат да проверяват данните в браузъра, преди те да бъдат криптирани и изпратени по мрежата. Това им позволява да видят пълното съдържание на подканите и отговорите, осигурявайки видимост, която често липсва на мрежовите инструменти.

Необходими ли са тези решения, ако имаме политика „без изкуствен интелект“?

Да, защото политиката „без изкуствен интелект“ е трудна за прилагане без технически контрол. Служителите често използват лични устройства или намират заобиколни решения за достъп до полезни инструменти с изкуствен интелект. Контролът на използването на изкуствен интелект осигурява видимост за проверка на съответствието и технически средства за ефективно прилагане на политиката.