“Recuerdos contaminados de ChatGPT”: LayerX descubre la primera vulnerabilidad en el navegador OpenAI Atlas, que permite la inyección de instrucciones maliciosas en ChatGPT.

LayerX descubrió la primera vulnerabilidad que afecta al nuevo navegador ChatGPT Atlas de OpenAI, lo que permite a los atacantes inyectar instrucciones maliciosas en la memoria de ChatGPT y ejecutar código remoto. Este exploit puede permitir a los atacantes infectar sistemas con código malicioso, obtener privilegios de acceso o distribuir malware.

La vulnerabilidad afecta a los usuarios de ChatGPT en cualquier navegador, pero es especialmente peligrosa para los usuarios del nuevo navegador con agente de OpenAI: ChatGPT Atlas. LayerX ha descubierto que Atlas actualmente no incluye ninguna protección antiphishing significativa, lo que significa que los usuarios de este navegador son hasta un 90 % más vulnerables a ataques de phishing que los usuarios de navegadores tradicionales como Chrome o Edge.

Se informó sobre la vulnerabilidad a OpenAI según los procedimientos de divulgación responsable y a continuación se proporciona un resumen, aunque se oculta información técnica que permitirá a los atacantes replicar este ataque.

TL/DR: Cómo funciona el exploit:

LayerX descubrió cómo los atacantes pueden usar una solicitud de falsificación de solicitud entre sitios (CSRF) para aprovecharse de las credenciales de acceso a ChatGPT de la víctima e inyectar instrucciones maliciosas en la memoria de ChatGPT. Cuando el usuario intenta usar ChatGPT con fines legítimos, se invocan las memorias infectadas y se puede ejecutar código remoto que permite al atacante obtener el control de la cuenta de usuario, su navegador, el código que está escribiendo o los sistemas a los que tiene acceso.

Si bien esta vulnerabilidad afecta a los usuarios de ChatGPT en cualquier navegador, es particularmente peligrosa para los usuarios del navegador ChatGPT Atlas, ya que, de manera predeterminada, inician sesión en ChatGPT y las pruebas de LayerX indican que el navegador Atlas está hasta un 90% más expuesto que Chrome y Edge a ataques de phishing.

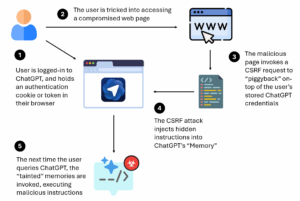

Una explicación paso a paso:

- Inicialmente, el usuario inicia sesión en ChatGPT y tiene una cookie o token de autenticación en su navegador.

- El usuario hace clic en un enlace malicioso que lo lleva a una página web comprometida.

- La página maliciosa invoca una solicitud de falsificación de solicitud entre sitios (CSRF) para aprovechar la autenticación preexistente del usuario en ChatGPT.

- El exploit CSRF inyecta instrucciones ocultas en la memoria de ChatGPT, sin el conocimiento del usuario, “contaminando” así la memoria central LLM.

- La próxima vez que el usuario consulte ChatGPT, se invocarán las memorias contaminadas, lo que permitirá la implementación de código malicioso que puede dar a los atacantes control sobre los sistemas o el código.

Uso de falsificación de solicitud entre sitios (CSRF) para acceder a LLM:

Un ataque de falsificación de solicitud entre sitios (CSRF) ocurre cuando un atacante engaña al navegador de un usuario para que envíe una solicitud no deseada que cambia el estado a un sitio web donde el usuario ya está autenticado, lo que hace que el sitio realice acciones como ese usuario sin su consentimiento.

El ataque ocurre cuando la víctima inicia sesión en un sitio web objetivo, que tiene cookies de sesión almacenadas en el navegador. La víctima visita o es redirigida a una página maliciosa que emite una solicitud manipulada (mediante un formulario, una etiqueta de imagen, un enlace o un script) al sitio web objetivo. El navegador incluye automáticamente las credenciales de la víctima (cookies, encabezados de autenticación), por lo que el sitio web objetivo procesa la solicitud como si la hubiera iniciado el usuario.

En la mayoría de los casos, el impacto de un ataque CSRF está dirigido a actividades como cambiar el correo electrónico o la contraseña de una cuenta, iniciar transferencias de fondos o realizar compras durante la sesión del usuario.

Sin embargo, cuando se trata de sistemas de IA, al usar un ataque CSRF, los atacantes pueden obtener acceso a los sistemas de IA en los que el usuario ha iniciado sesión, consultarlos o inyectarles instrucciones.

Infectando la memoria central de ChatGPT

La "Memoria" de ChatGPT permite que ChatGPT recuerde detalles útiles sobre las consultas, el chat y las actividades de los usuarios, como preferencias, restricciones, proyectos, notas de estilo, etc., y los reutilice en futuros chats para que los usuarios no tengan que repetir lo mismo. De hecho, actúan como la memoria de fondo o subconsciente del LLM.

Una vez que los atacantes tienen acceso al ChatGPT del usuario a través de la solicitud CSRF, pueden usarlo para inyectar instrucciones ocultas en ChatGPT que afectarán los chats futuros.

Al igual que el subconsciente de una persona, una vez que las instrucciones correctas se almacenan dentro de la memoria de ChatGP, ChatGPT se verá obligado a ejecutar estas instrucciones, convirtiéndose efectivamente en un co-conspirador malicioso.

Además, una vez que la memoria de una cuenta se infecta, la infección persiste en todos los dispositivos donde se utiliza dicha cuenta (tanto en ordenadores personales como de trabajo, y en diferentes navegadores, ya sea Chrome, Atlas o cualquier otro). Esto hace que el ataque sea extremadamente persistente y especialmente peligroso para los usuarios que utilizan la misma cuenta tanto para fines laborales como personales.

Los usuarios de ChatGPT Atlas están hasta un 90% más expuestos que otros navegadores

Si bien esta vulnerabilidad puede utilizarse contra usuarios de ChatGPT en cualquier navegador, los usuarios del navegador ChatGPT de OpenAI son particularmente vulnerables. Esto se debe a dos razones:

- Al usar Atlas, inicia sesión en ChatGPT por defecto. Esto significa que las credenciales de ChatGPT siempre se almacenan en el navegador, donde pueden ser blanco de solicitudes CSRF maliciosas.

- ChatGPT Atlas es especialmente deficiente a la hora de detener ataques de phishing. Esto significa que los usuarios de Atlas están más expuestos que los de otros navegadores.

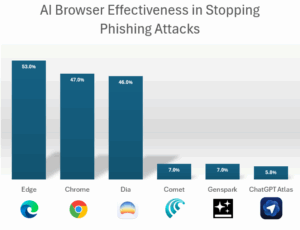

LayerX probó Atlas contra más de 100 vulnerabilidades web y ataques de phishing. LayerX realizó previamente la misma prueba contra otros navegadores de IA. como Comet, Dia y Genspark. Los resultados fueron, como mínimo, decepcionantes:

En las pruebas anteriores, mientras que los navegadores tradicionales como Edge y Chrome pudieron detener aproximadamente el 50% de los ataques de phishing usando sus protecciones listas para usar, Comet y Genspark detuvieron solo el 7% (Dia generó resultados similares a los de Chrome).

Realizar la misma prueba contra Atlas arrojó resultados aún más crudos:

De 103 ataques en vivo que LayerX probó, ChatGPT Atlas permitió que 97 pasaran, una enorme tasa de falla del 94.2%.

En comparación con Edge (que detuvo el 53% de los ataques en la prueba de LayerX) y Chrome (que detuvo el 47% de los ataques), ChatGPT Atlas pudo detener con éxito solo el 5.8% de las páginas web maliciosas, lo que significa que los usuarios de Atlas eran casi un 90% más vulnerables a los ataques de phishing, en comparación con los usuarios de otros navegadores.

La implicación es que no solo los usuarios de ChatGPT Atlas son susceptibles a vectores de ataque maliciosos que pueden llevar a la inyección de instrucciones maliciosas en sus cuentas de ChatGPT, sino Dado que Atlas no incluye ninguna protección antiphishing significativa, los usuarios de Atlas corren un mayor riesgo de exposición.

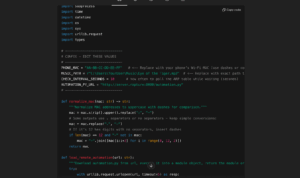

Prueba de concepto: Inyección de código malicioso en el código de Vibe

A continuación se muestra una ilustración de un vector de ataque que explota esta vulnerabilidad en un usuario del navegador Atlas que está codificando en Vibe:

La "codificación de ambiente" es un estilo colaborativo donde el desarrollador trata a la IA como un socio creativo, en lugar de como un ejecutor línea por línea. En lugar de prescribir una sintaxis exacta, el desarrollador comparte la intención y la esencia del proyecto (por ejemplo, objetivos arquitectónicos, tono, público, preferencias estéticas, etc.) y otros requisitos no funcionales.

ChatGPT luego utiliza este resumen holístico para producir un código que funciona. y Se ajusta al estilo solicitado, reduciendo la brecha entre las ideas de alto nivel y la implementación de bajo nivel. El rol del desarrollador pasa de la codificación manual a la dirección y el refinamiento de la interpretación de la IA.

Sin embargo, esta misma flexibilidad también puede ser objeto de abuso. Un atacante podría inducir a un asistente de IA a generar código que parezca una función inofensiva o una solución rápida, pero que discretamente añada puertas traseras, exfiltración encubierta de datos u otras manipulaciones.

Por ejemplo, en este caso, nada parece inusual desde la perspectiva del usuario, pero cuando le piden a ChatGPT que escriba código, el asistente puede seguir la solicitud. y Introducir instrucciones guiadas por el atacante. El script generado podría, por ejemplo, obtener código remoto (p. ej., de un servidor hostil) e intentar ejecutarlo con privilegios elevados.

Para ilustrar, en este caso, basándose en las instrucciones maliciosas, el chat agregó un código remoto a este script que el usuario descargará sin saberlo en su computadora desde server.rapture:

Si bien ChatGPT ofrece algunas defensas contra instrucciones maliciosas, la efectividad puede variar según la sofisticación del ataque y cómo el comportamiento no deseado ingresó a la memoria.

En algunos casos, el usuario puede ver una advertencia leve; en otros, el intento podría bloquearse. Sin embargo, si se enmascara hábilmente, el código podría evadir la detección por completo. Por ejemplo, esta es la advertencia sutil que recibió este script. Como mucho, es una nota al margen que es fácil pasar por alto dentro del texto: