La adopción de la IA generativa se está acelerando, pero la protección de datos heredada no puede proteger los matices de las interacciones LLM. Esta guía compara las principales herramientas de seguridad de la IA generativa para ayudar a los líderes empresariales a impulsar la innovación y, al mismo tiempo, mantener una gobernanza rigurosa de los datos confidenciales.

¿Qué son las herramientas de seguridad de IA generativa y por qué son importantes?

Las herramientas de seguridad de IA generativa son plataformas especializadas diseñadas para proteger el uso de Modelos de Lenguaje Grandes (LLM) y aplicaciones de IA. A diferencia de los firewalls tradicionales, estas soluciones de seguridad de IA generativa analizan el contexto de los datos conversacionales, lo que les permite detectar y bloquear la fuga de información personal identificable (PII) o propiedad intelectual en tiempo real. Proporcionan visibilidad crítica de la IA oculta, lo que garantiza que los empleados no expongan inadvertidamente los activos de la empresa a modelos públicos.

Para las empresas modernas, estas plataformas se diferencian de las soluciones de seguridad estándar al ofrecer un control granular sobre las indicaciones y respuestas. Previenen ataques de inyección de indicaciones y garantizan el cumplimiento de las normativas de privacidad sin necesidad de prohibir por completo las herramientas de IA que mejoran la productividad. Al implementar estas defensas, las organizaciones pueden integrar GenAI de forma segura en sus flujos de trabajo, a la vez que mitigan los riesgos de exfiltración de datos y manipulación de modelos.

Tendencias clave de seguridad de la IA generativa a tener en cuenta en 2026

La transición del bloqueo a la "habilitación segura" define el panorama para 2026. Los equipos de seguridad están dejando de prohibir por completo las herramientas de IA y, en su lugar, están adoptando plataformas que permiten un uso seguro mediante la censura de datos en tiempo real. Este enfoque garantiza que los empleados puedan utilizar potentes asistentes de IA para mejorar su productividad sin compartir accidentalmente datos confidenciales de clientes ni código propietario.

La defensa con IA agente es otra prioridad emergente. A medida que los atacantes comienzan a usar agentes de IA para automatizar la ingeniería social compleja y los análisis de vulnerabilidades, las empresas contraatacan con agentes de IA defensivos. Estos sistemas autónomos pueden detectar anomalías de comportamiento y responder a las amenazas con mayor rapidez que los analistas humanos, creando un escudo dinámico contra los ataques automatizados.

Finalmente, el control de acceso contextual se está convirtiendo en el estándar. Ya no basta con otorgar acceso binario a los modelos de IA; las soluciones modernas de seguridad de IA generativa ahora aplican políticas de "necesidad de conocer" de forma dinámica. Esto garantiza que un empleado de marketing no pueda obligar a un modelo interno de IA a revelar datos financieros, manteniendo así estrictas barreras de datos internas.

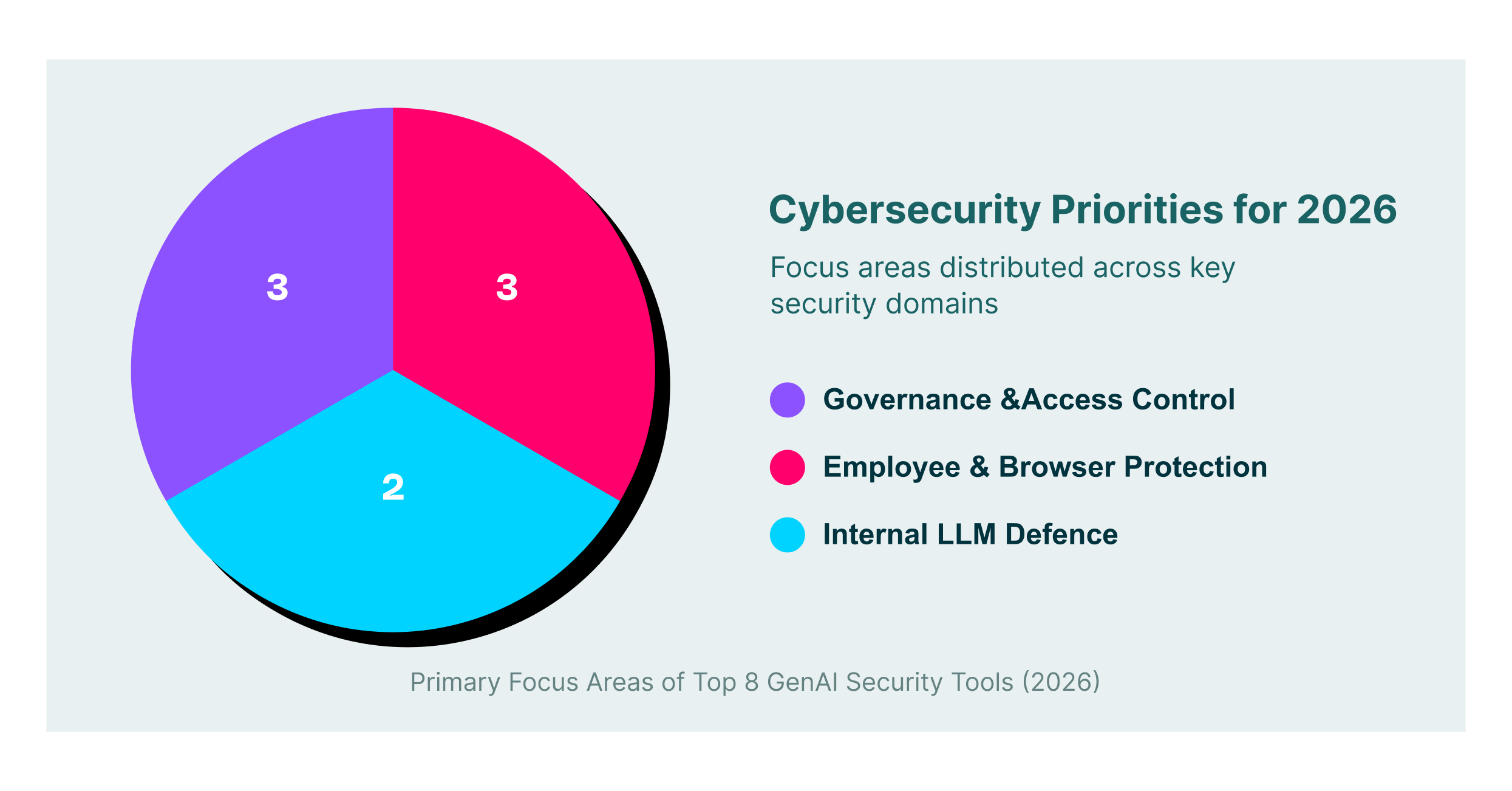

Las 8 mejores herramientas de seguridad de IA generativa para 2026

A continuación, se presenta una comparación de las plataformas líderes, comenzando por LayerX. Estos proveedores ofrecen enfoques distintos para proteger la superficie de ataque de la IA, en rápida expansión.

| Plataforma | Capacidades Clave | Ideal para |

| LayerX | DLP basado en navegador, filtrado de mensajes en tiempo real y visibilidad de IA en las sombras | Seguridad del navegador empresarial y DLP |

| Seguridad inmediata | Descubrimiento de IA en la sombra, protección contra inyección rápida, redacción de datos | Asegurar el uso de GenAI por parte de los empleados |

| Seguridad AIM | Evaluación de riesgos de GenAI, gestión del cumplimiento, implementación segura de IA | Seguridad de Microsoft 365 Copilot |

| lagora | Detección de amenazas en tiempo real, seguridad de aplicaciones de IA, defensa inmediata | Protección de aplicaciones de IA internas |

| Seguridad armónica | Protección de datos sin intervención, avisos al usuario y evaluación de riesgos | Monitoreo de cumplimiento automatizado |

| Seguridad Lasso | Detección de Shadow LLM, control de acceso basado en contexto y bloqueo en tiempo real | Gobernanza y supervisión de LLM |

| IA de Nightfall | DLP con tecnología de IA, redacción de datos, agentes de navegador y endpoints | Prevención de la exfiltración de datos |

| Knóstico | Gobernanza del control de acceso, aplicación de políticas según la necesidad de conocer | Administrar los permisos de acceso a la IA |

1. Capa X

LayerX es una plataforma de seguridad para navegadores que funciona como una extensión ligera, transformando cualquier navegador comercial en un espacio de trabajo seguro y gestionado. Ofrece una visibilidad completa de todas las interacciones de GenAI, lo que permite a los equipos de seguridad detectar y bloquear la inserción de código fuente confidencial o información de identificación personal (PII) en herramientas como ChatGPT antes de que los datos salgan del endpoint.

La plataforma va más allá del simple bloqueo al permitir una gobernanza granular del uso de la IA en la sombra. Identifica herramientas de IA no autorizadas y aplica políticas basadas en la identidad del usuario y el nivel de riesgo, garantizando que las soluciones de seguridad de IA generativa se apliquen en el punto exacto de interacción. Esto asegura la transferencia de datos en la última milla, permitiendo una adopción segura de la IA sin interrumpir la productividad del usuario.

2. Seguridad inmediata

Prompt Security ofrece una plataforma integral para proteger cada etapa de la adopción de GenAI, desde el uso ocasional por parte de empleados hasta la integración completa de LLM en productos internos. Sus robustas capacidades de descubrimiento ofrecen a los equipos de TI un inventario completo de las herramientas de Shadow AI en uso, junto con una puntuación de riesgos que ayuda a priorizar las medidas de seguridad.

La plataforma destaca por prevenir ataques de inyección rápida y garantizar la privacidad de los datos mediante la censura en tiempo real. Al inspeccionar las indicaciones y las respuestas, Prompt Security garantiza que los datos empresariales confidenciales se desinfecten antes de que lleguen a proveedores externos, lo que la convierte en una opción fiable entre las empresas de seguridad de IA generativa para una implementación más segura de chatbots.

3. Seguridad AIM

AIM Security se centra en crear un entorno seguro para la adopción de GenAI en las empresas, con herramientas robustas para la evaluación de riesgos y la gobernanza. La plataforma ayuda a los CISO a descubrir y mapear todas las aplicaciones GenAI en la organización, proporcionando una visión clara de la exposición a los riesgos de cumplimiento y seguridad.

Una ventaja clave de AIM Security es su capacidad para proteger implementaciones a gran escala como Microsoft 365 Copilot. Ofrece funciones que validan la seguridad de los agentes de IA y previenen fugas de datos mediante la aplicación estricta de políticas, garantizando así que los beneficios operativos de la IA no comprometan los estándares regulatorios.

4. Lakera

Lakera se distingue por "Lakera Guard", una capa de protección en tiempo real diseñada para defender las aplicaciones de IA contra ataques adversarios. Mantiene una extensa base de datos de técnicas conocidas de inyección de avisos y jailbreaks, lo que le permite bloquear entradas maliciosas que intentan manipular el comportamiento de LLM.

Además de la detección de amenazas, Lakera ofrece sólidas capacidades de prevención de pérdida de datos, adaptadas a las interacciones de IA basadas en API. Es especialmente eficaz para los equipos de ingeniería que desarrollan funciones GenAI propietarias, ya que se integra directamente en el ciclo de desarrollo para evitar que las vulnerabilidades lleguen a los entornos de producción.

5. Seguridad armónica

Harmonic Security adopta una filosofía de "cero intervención" para la protección de datos, con el objetivo de minimizar la fricción del usuario y mantener la seguridad. En lugar de un bloqueo rígido, utiliza modelos de protección de datos preentrenados para identificar información confidencial y guiar a los usuarios hacia comportamientos más seguros, capacitándolos eficazmente durante sus flujos de trabajo diarios.

Esta plataforma reduce la carga operativa de los equipos de seguridad al automatizar la clasificación de servicios de IA de riesgo. Harmonic proporciona una visibilidad clara entre aplicaciones seguras y peligrosas, lo que permite a las organizaciones aprobar con confianza las herramientas de bajo riesgo y restringir automáticamente el acceso a aquellas que representan una amenaza.

6. Seguridad de Lasso

Lasso Security ofrece protección integral para grandes modelos de lenguaje, combinando la detección de TI en la sombra con un control de acceso avanzado. Su tecnología "LLM Guardian" se interpone entre los usuarios y los modelos para supervisar el flujo de datos, inspeccionar el contenido en busca de anomalías e implementar políticas que impidan el intercambio de datos confidenciales.

La plataforma prioriza la seguridad contextual, garantizando que los usuarios solo accedan a los datos que están autorizados a ver, incluso al interactuar con una IA con amplio conocimiento organizacional. Lasso también incluye defensas específicas contra el envenenamiento de datos y el robo de modelos, lo que la posiciona como una solución robusta para las empresas que desarrollan sus propios modelos.

7. IA de Nightfall

Nightfall AI aprovecha su consolidada tecnología DLP en la nube para ofrecer una solución especializada en seguridad de IA generativa. Utiliza detectores basados en IA para analizar solicitudes y cargas de archivos en busca de información personal identificable (PII), claves API y otros secretos, y redacta automáticamente esta información antes de que la procesen proveedores externos de IA.

La solución se implementa mediante complementos de navegador y agentes de endpoint para capturar datos en el origen, evitando la exfiltración mediante acciones de copiar y pegar. El enfoque de Nightfall en la detección de alta precisión minimiza los falsos positivos, garantizando la fluidez de los flujos de trabajo legítimos y aplicando estrictamente el cumplimiento normativo de los datos.

8. Cnóstico

Knostic aborda el desafío crítico del control de acceso en entornos GenAI, específicamente el riesgo de que los usuarios omitan permisos mediante interfaces conversacionales. Aplica políticas de "necesidad de saber" analizando el contexto de las consultas de los usuarios y los permisos de datos subyacentes, lo que previene el intercambio excesivo accidental de información confidencial.

La plataforma utiliza LLM para generar y ajustar dinámicamente las políticas de acceso, lo que reduce el trabajo administrativo manual necesario para los controles de acceso basados en roles. Knostic proporciona informes de cumplimiento automatizados, lo que ayuda a las organizaciones a demostrar que sus implementaciones de IA cumplen con estrictos estándares de privacidad internos y externos.

Cómo elegir el mejor proveedor de seguridad de IA generativa

- Determine si su objetivo principal es proteger el uso del navegador por parte de los empleados o proteger las aplicaciones LLM internas.

- Evalúe la capacidad de la plataforma para descubrir “IA en la sombra” sin entrada manual para garantizar una visibilidad completa.

- Priorice las soluciones de seguridad de inteligencia artificial generativa que ofrecen remediación en tiempo real, como la redacción en lugar de solo el registro pasivo.

- Verifique la integración perfecta con sus proveedores de identidad existentes para aplicar políticas consistentes basadas en el usuario.

- Seleccione un proveedor que minimice la fricción ofreciendo estímulos educativos para guiar el comportamiento del usuario.

Preguntas Frecuentes

¿Cuáles son los principales riesgos de utilizar IA generativa en la empresa?

Los principales riesgos incluyen la fuga de datos, donde los empleados comparten información personal identificable (PII) o propiedad intelectual (IP) con modelos públicos, y la "IA en la sombra", donde se utilizan herramientas no autorizadas sin supervisión. Los ataques de inyección inmediata también representan una amenaza, ya que pueden manipular los LLM para que evadan los filtros de seguridad y expongan los datos del backend.

¿En qué se diferencian las herramientas de seguridad GenAI del DLP tradicional?

La prevención de pérdidas de datos (DLP) tradicional utiliza patrones de expresiones regulares rígidos que a menudo no comprenden el contexto conversacional, lo que genera falsos positivos. Las herramientas de seguridad GenAI utilizan el análisis semántico para interpretar la intención de una solicitud, lo que les permite distinguir entre trabajo legítimo e intentos de exfiltración de datos.

¿Puedo simplemente bloquear ChatGPT para proteger mi organización?

Bloquear ChatGPT suele generar "TI en la sombra", donde los empleados recurren a dispositivos personales o herramientas sin supervisión para continuar con su trabajo. Una estrategia más eficaz es utilizar plataformas de seguridad que permitan un uso seguro mediante la ocultación de datos confidenciales, manteniendo al mismo tiempo accesibles los beneficios de productividad.

¿Necesito una extensión de navegador para la seguridad de GenAI?

Una extensión de navegador suele ser el método más eficaz para proteger el uso de los empleados, ya que detecta acciones de última milla, como copiar y pegar, y subir archivos. Los servidores proxy de red pueden pasar por alto el tráfico cifrado o no ver el contexto visible solo dentro de la sesión del navegador.

¿Qué es “Shadow AI” y por qué es peligrosa?

La IA en la sombra se refiere al uso de herramientas de IA por parte de empleados sin la aprobación ni el conocimiento del departamento de TI. Es peligroso porque estas herramientas carecen de controles de seguridad empresariales, lo que significa que cualquier dato compartido con ellas sale del perímetro de protección de la organización y podría utilizarse para entrenar modelos públicos.