Les modèles d'apprentissage automatique ne sont plus de simples outils d'analyse. Ils sont les moteurs de la prise de décision dans l'entreprise moderne. Cette dépendance a engendré une menace sophistiquée : les attaques par IA adverse. Il ne s'agit pas d'exploits logiciels classiques ciblant des vulnérabilités telles que les dépassements de tampon, mais d'illusions d'optique pour les algorithmes.

Anatomie d'une attaque : comment les modèles sont trompés

Les attaquants utilisent des informations subtiles pour tromper les systèmes d'IA et les amener à effectuer des classifications erronées ou à révéler des données d'entraînement sensibles. Pour les responsables de la sécurité en 2025, les enjeux ont changé. Nous assistons à une transition de la recherche théorique à une mise en œuvre concrète. Les attaquants exploitent ces techniques pour contourner la détection des fraudes et manipuler les algorithmes financiers.

Ils exfiltrent également des données confidentielles via les outils mêmes que les employés utilisent quotidiennement. Le navigateur est devenu le principal vecteur de ces intrusions. C'est par lui que les employés collent du code sensible dans les modules LLM et que des extensions malveillantes peuvent injecter discrètement des messages toxiques. Comprendre les mécanismes des attaques adverses contre l'IA est la première étape pour sécuriser la surface d'attaque entre le navigateur et le cloud.

Pour un observateur humain, les entrées adverses ressemblent souvent à du bruit, mais sont interprétées comme des signaux distincts par un réseau neuronal. Cette différence permet aux attaquants de manipuler les résultats sans déclencher d'alertes de sécurité classiques. Les méthodes utilisées pour exécuter des attaques adverses par IA se répartissent généralement en trois catégories distinctes.

Empoisonnement des données : corrompre le puits

Les attaques par empoisonnement surviennent lors de la phase d'entraînement ou de réglage fin. En injectant des exemples malveillants dans l'ensemble de données, un attaquant peut créer une porte dérobée cachée dans le modèle. Il peut par exemple modifier subtilement un ensemble de courriels d'hameçonnage dans un corpus d'entraînement. Le filtre anti-spam ainsi créé apprend alors à classer certains schémas malveillants comme étant bénins.

Dans le contexte de l'IA générale, cela est particulièrement dangereux. Si une entreprise affine un assistant de codage sur des référentiels internes subtilement altérés, les conséquences sont graves. Le modèle peut suggérer aux développeurs des extraits de code non sécurisés, automatisant ainsi l'introduction de vulnérabilités.

Évasion de modèles : la supercherie numérique

Les attaques par évasion se produisent lors de l'inférence. L'attaquant modifie les données d'entrée pour induire le modèle en erreur. Il s'agit de la forme la plus courante d'attaques adverses contre l'IA actuellement rencontrée. Un exemple classique consiste à modifier quelques pixels sur l'image d'un panneau stop.

Le véhicule autonome commet une erreur de classification dangereuse et l'identifie comme un panneau de limitation de vitesse. En entreprise, des techniques d'évasion sont utilisées pour contourner les systèmes de détection de logiciels malveillants. Cela permet à des fichiers infectés de passer inaperçus des solutions antivirus de nouvelle génération.

Extraction et vol de modèles

Le vol de modèles consiste pour un attaquant à sonder un système d'IA « boîte noire » à l'aide de nombreuses requêtes. Son objectif est de reconstruire le modèle sous-jacent ou d'extraire les données privées ayant servi à son entraînement. En analysant les résultats, il peut construire un modèle de substitution qui imite le comportement propriétaire de la cible.

Cela constitue un vol de propriété intellectuelle. Cela offre également un environnement isolé permettant à l'attaquant de tester hors ligne de futures attaques d'évasion. Il peut ainsi s'assurer que ses méthodes fonctionneront sur le système de production sans alerter la victime.

L'augmentation des menaces automatisées en 2025

Les barrières à l'entrée pour mener ces attaques ont considérablement diminué. Des outils automatisés permettent désormais même à des acteurs peu expérimentés de lancer des campagnes sophistiquées. Le nombre d'incidents augmente de façon alarmante. Les équipes de sécurité doivent repenser leur stratégie de défense.

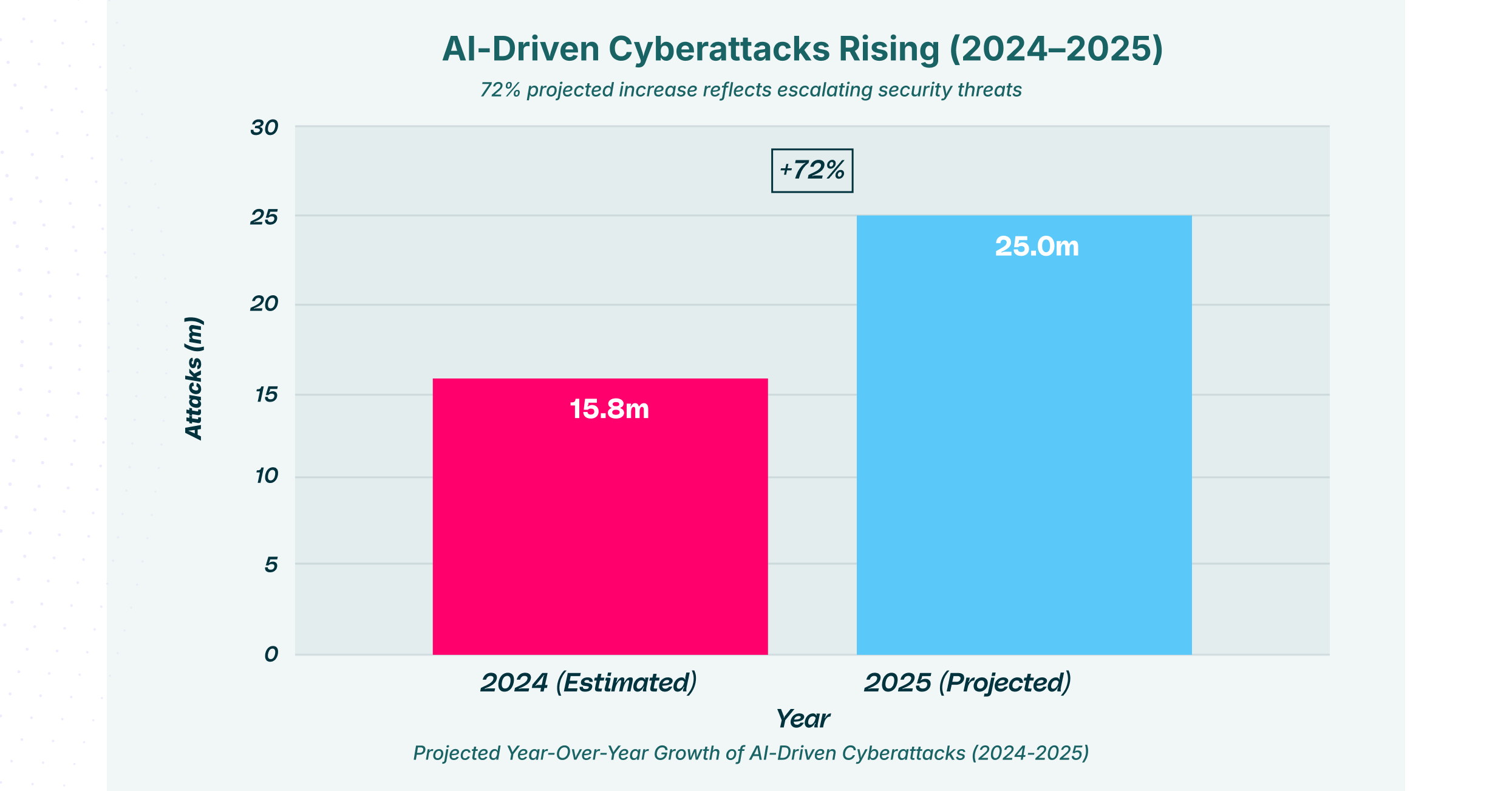

Ce graphique illustre la hausse prévue de 72 % en un an des cyberincidents à l'échelle mondiale. Avec le déploiement croissant de modèles par les organisations, le volume des attaques adverses utilisant l'IA devrait atteindre des niveaux sans précédent, avec 28 millions d'incidents projetés pour 2025. Cette croissance exponentielle souligne comment les outils automatisés facilitent l'accès aux cyberattaques adverses à grande échelle.

Cette recrudescence n'est pas le fruit du hasard. Elle est alimentée par l'adoption généralisée d'outils d'IA open source pouvant être détournés à des fins offensives. Les attaquants utilisent l'IA générique pour automatiser la découverte des vulnérabilités d'autres systèmes d'IA. Il en résulte une boucle d'optimisation adverse plus rapide que la capacité des équipes de défense humaines à corriger les failles.

L'IA à des fins malveillantes : l'épidémie de phishing

L'IA générative a fondamentalement bouleversé les techniques d'ingénierie sociale. Les attaques adverses en IA générative ne consistent plus seulement à tromper un modèle ; elles consistent à utiliser ce modèle pour duper les humains. Les attaquants déploient désormais des modèles de langage complexes (LLM) pour concevoir des courriels d'hameçonnage contextuels et grammaticalement irréprochables.

Ces courriels imitent le ton et le style des cadres supérieurs. L'efficacité de ces campagnes pilotées par l'IA est alarmante comparée aux méthodes traditionnelles.

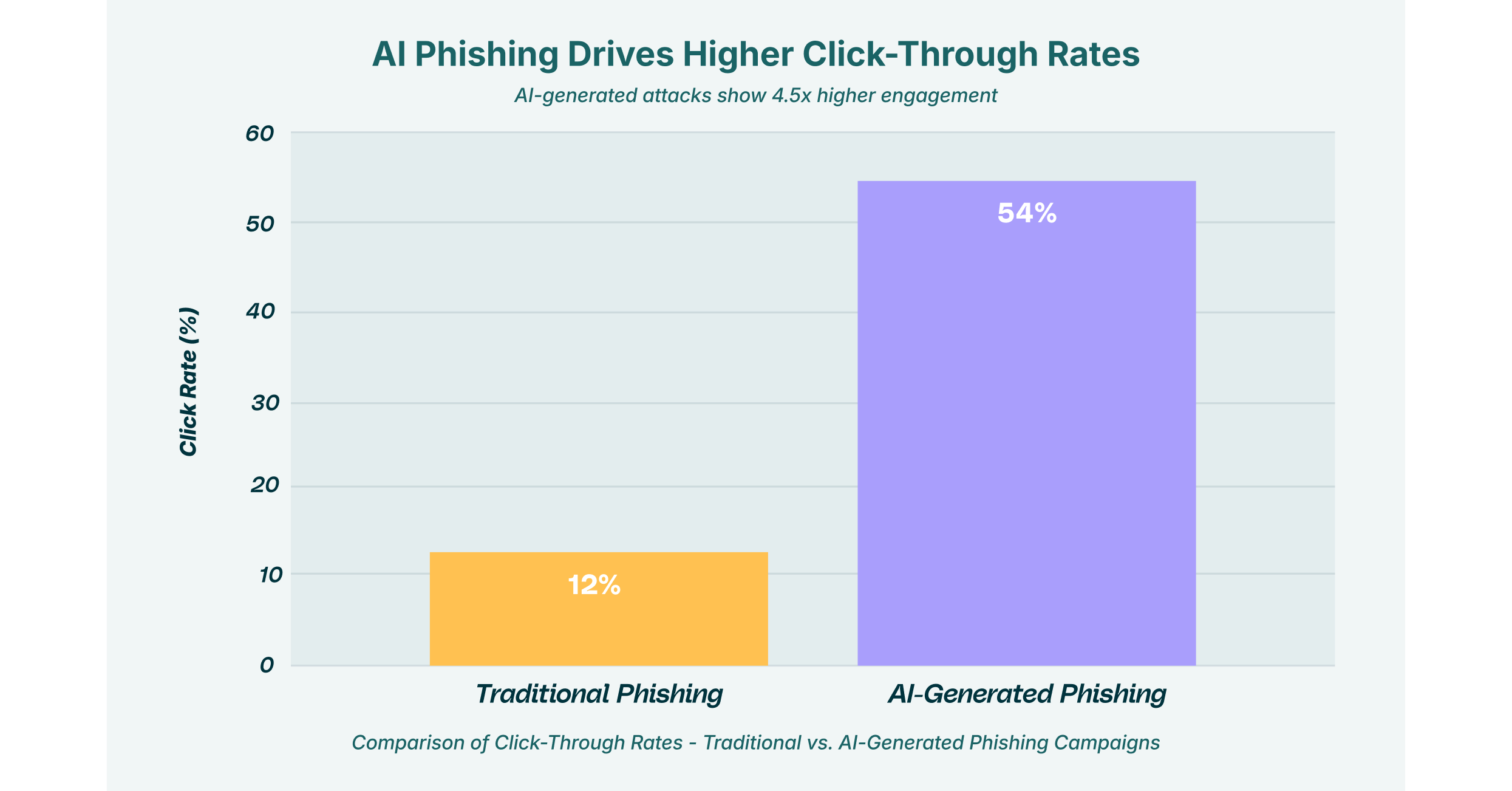

Une comparaison des taux de clics révèle l'efficacité redoutable des attaques adverses dans l'IA générative. Alors que les campagnes de phishing traditionnelles peinent à atteindre un taux de réussite de 12 %, les leurres générés par l'IA, conçus pour imiter des communications internes fiables, atteignent un taux de clic stupéfiant de 54 %. Ces données soulignent l'impérieuse nécessité d'une sécurité des navigateurs spécialisée pour détecter les anomalies linguistiques et structurelles subtiles de l'ingénierie sociale basée sur l'IA générative.

Les solutions de sécurité des navigateurs doivent désormais aller au-delà du simple filtrage des URL. Elles doivent analyser l'intention et le contexte du contenu affiché. Lorsqu'un employé interagit avec un chatbot GenAI ou reçoit un courriel suspect, l'extension de navigateur constitue un point de contrôle essentiel. Elle peut signaler les anomalies suggérant que le contenu a été généré artificiellement à des fins trompeuses.

Injection par invite : l’« injection SQL » de l’ère de l’IA

L'une des formes les plus répandues d'attaques adverses en intelligence artificielle générative est l'injection de prompts. Cette technique consiste à créer un texte d'entrée qui remplace les instructions originales du modèle, forçant ainsi le système à exécuter des actions non autorisées.

Mécanismes d'injection

Le risque ne se limite pas aux messages malveillants saisis par les utilisateurs dans une fenêtre de chat. Le véritable danger réside dans l'injection indirecte de requêtes, ou attaques de type « homme du milieu ». Dans ce cas, un programme malveillant pourrait traiter une page web ou un document contenant des instructions malveillantes dissimulées.

LayerX Labs a identifié des vecteurs d'attaque par lesquels des extensions de navigateur malveillantes injectent ces messages toxiques dans les systèmes d'apprentissage automatique d'entreprise. Ceci se produit sans le consentement de l'utilisateur. Les attaquants peuvent ainsi manipuler les résultats d'outils d'IA pourtant considérés comme fiables, transformant un assistant utile en une menace interne.

Taxonomie des risques liés à l'injection rapide

| Type d'attaque | Mécanisme | Niveau de risque |

| Injection directe | L'attaquant saisit manuellement des messages malveillants pour contourner les filtres de sécurité (jailbreak). | Haute |

| Injection indirecte | Des instructions malveillantes sont dissimulées dans des données externes (par exemple, des pages web) utilisées par l'IA. | Critical |

| Empoisonnement du contexte | Manipuler l'historique des conversations pour influencer les réponses futures du modèle. | Moyenne |

Ce tableau catégorise les principaux vecteurs d'injection indirecte, un sous-ensemble spécifique d'attaques par IA adverse. L'injection indirecte représente un risque critique car elle se produit à l'insu de l'utilisateur. Elle survient souvent par le biais d'une attaque de type « homme du milieu » (Man-in-the-Prompt), où une extension de navigateur lit une page web compromise et injecte une instruction malveillante dans le système LLM de l'entreprise.

Le dilemme des deepfakes et l'assurance d'identité

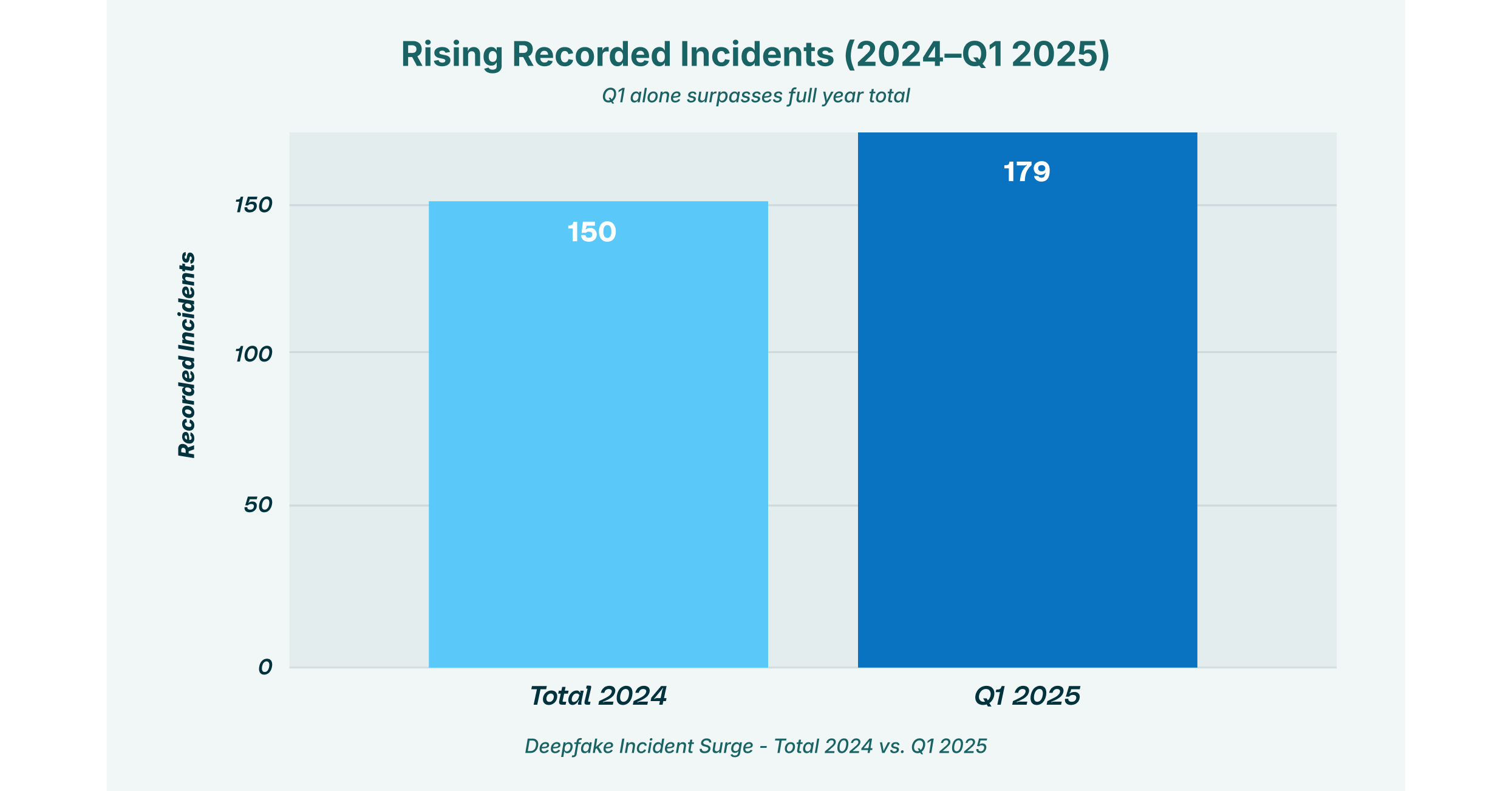

La même technologie utilisée pour créer des avatars utiles est désormais détournée pour contourner les systèmes de vérification d'identité. Les deepfakes, autrefois simples curiosités d'Internet, sont devenus de véritables menaces pour la sécurité des entreprises.

Ces attaques se manifestent souvent sur les plateformes de visioconférence ou lors des processus d'intégration à distance. Un attaquant utilise un deepfake en temps réel pour usurper l'identité d'un PDG ou d'un directeur financier. Il autorise des virements frauduleux ou demande des identifiants sensibles. Les organisations doivent déployer des systèmes de défense capables de détecter les traces numériques de ces attaques.

Le navigateur : principale surface d’attaque

Pourquoi le navigateur est-il au cœur de cette discussion ? Parce qu’il constitue l’interface par laquelle les employés accèdent aux outils d’IA générale tels que ChatGPT ou Claude. Il représente la porte d’entrée par laquelle les attaques adverses basées sur l’IA atteignent le terminal.

Les outils de sécurité réseau traditionnels sont inefficaces pour détecter le trafic chiffré entre le navigateur d'un utilisateur et un service d'IA. Ils ne peuvent pas voir si un employé colle des informations personnelles dans un chatbot, ni si une extension « Shadow SaaS » collecte discrètement ces données. Les recherches de LayerX sur l'IA « Shadow » révèlent qu'un pourcentage important des fuites de données d'entreprise se produit via des extensions de navigateur non gérées.

Lorsqu'il s'agit de prévenir les attaques adverses contre l'IA, il est essentiel de considérer le navigateur comme point de contrôle. C'est le seul endroit où l'on peut observer simultanément les données saisies par l'utilisateur, les résultats du modèle et le contexte de la session web. Cette visibilité permet de masquer les données sensibles en temps réel.

Stratégies défensives pour l'ère de l'IA générale

Se prémunir contre ces menaces sophistiquées exige une approche multicouche. Il ne suffit pas de se fier aux filtres de sécurité intégrés aux modèles par les fournisseurs. Les entreprises doivent impérativement intégrer ces modèles à leurs propres contrôles de sécurité.

Red Teaming et Fuzzing

Les organisations devraient mettre en place des tests de résistance proactifs pour leurs déploiements d'IA. Les tests d'intrusion (Red Teaming) consistent pour des hackers éthiques à tenter de contourner les systèmes d'IA. Ils exécutent des attaques adverses contre l'IA afin d'identifier les failles.

Cette méthode est souvent associée au fuzzing. Le fuzzing est une technique automatisée qui consiste à soumettre le modèle à des milliers d'entrées aléatoires ou semi-aléatoires. L'objectif est de déterminer si certaines d'entre elles provoquent un plantage ou révèlent des données d'entraînement.

Détection et réponse du navigateur (BDR)

Une solution BDR complète fait office de pare-feu pour la session web de l'utilisateur. Elle peut empêcher l'installation d'extensions malveillantes facilitant l'empoisonnement des données ou le vol de modèles.

De plus, elle permet aux organisations de mettre en place des politiques de contrôle de l'utilisation de l'IA générative. Cela garantit que les employés ne participent pas involontairement à une attaque et empêche l'organisation de s'exposer à des attaques adverses liées à l'IA générative par le biais de comportements à risque.

Assurer l'avenir du renseignement

Le jeu du chat et de la souris entre attaquants et défenseurs est entré dans une nouvelle phase. Les attaques adverses représentent un défi fondamental pour l'intégrité des systèmes que nous construisons pour notre avenir.

En comprenant les subtilités des attaques adverses contre l'IA, les responsables de la sécurité peuvent concevoir des architectures résilientes. L'avenir ne passe pas par l'abandon de l'IA, mais par la sécurisation de l'écosystème dans lequel elle évolue.

Cela signifie reconnaître que le navigateur n'est plus un simple visualiseur de documents. Il constitue la première ligne de défense contre les attaques adverses en intelligence artificielle générative. Grâce à des tests rigoureux et une surveillance en temps réel, les entreprises peuvent évoluer sereinement dans cet environnement complexe.