L'adozione dell'IA generativa sta rimodellando l'azienda. Questi potenti modelli offrono incrementi di produttività senza precedenti, ma questa nuova funzionalità comporta un compromesso significativo: una nuova e complessa superficie di attacco. Le organizzazioni stanno scoprendo che consentire ai dipendenti di utilizzare strumenti di IA generativa senza un'adeguata supervisione li espone a rischi critici, tra cui l'esfiltrazione di dati personali sensibili, la fuga di dati di proprietà intellettuale e le violazioni della conformità. Condurre una valutazione approfondita dei rischi dell'IA è il passo fondamentale per qualsiasi organizzazione che desideri sfruttare la potenza dell'IA in modo sicuro.

Molti responsabili della sicurezza si trovano in una posizione difficile. Come quantificare i rischi derivanti dall'inserimento di codice proprietario da parte di un dipendente in un LLM pubblico? Qual è il reale impatto di un team che si affida a uno strumento di "intelligenza artificiale ombra" non ancora verificato? Questo articolo fornisce un approccio strutturato per rispondere a queste domande. Esploreremo un framework pratico per la valutazione del rischio dell'intelligenza artificiale, offriremo un modello pratico, esamineremo le tipologie di strumenti necessari per l'applicazione delle normative e delineeremo le migliori pratiche per la creazione di un programma di governance dell'intelligenza artificiale sostenibile. Una valutazione proattiva del rischio dell'intelligenza artificiale generativa non è più facoltativa; è essenziale per un'innovazione sicura.

Perché una valutazione specializzata del rischio di sicurezza dell'IA non è negoziabile

I framework tradizionali di gestione del rischio non sono stati progettati per le sfide specifiche poste dall'IA generativa. La natura interattiva e "black-box" dei Large Language Model (LLM) introduce vettori di minaccia dinamici che le soluzioni di sicurezza legacy faticano ad affrontare. Una valutazione specializzata del rischio di sicurezza dell'IA è fondamentale perché i rischi sono fondamentalmente diversi e più fluidi rispetto a quelli associati al software convenzionale.

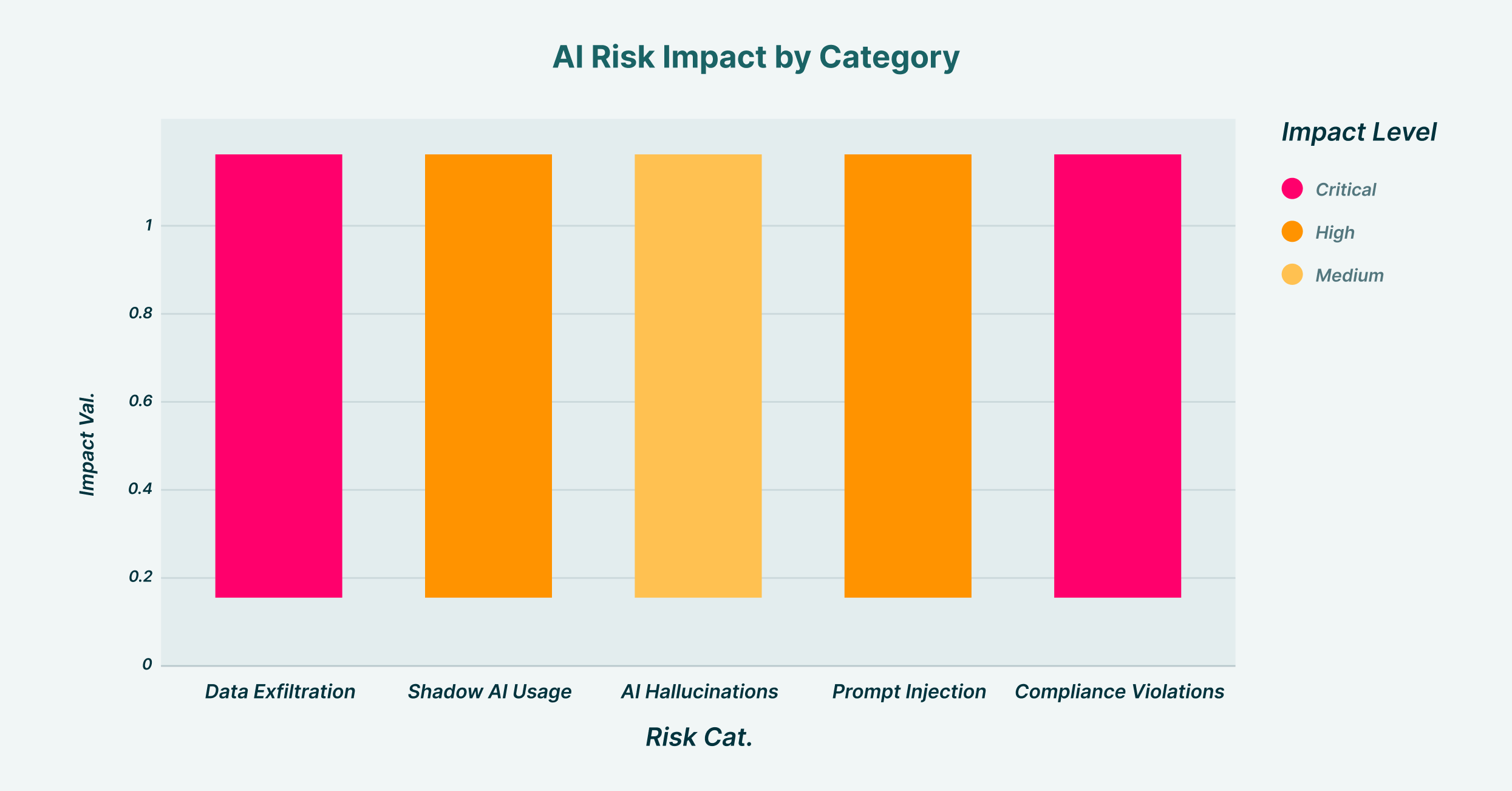

Categorie di rischio dell'IA in base alla valutazione del livello di impatto

Le principali sfide che richiedono una valutazione dedicata includono:

- Privacy dei dati ed esfiltrazione: questo è probabilmente il rischio più immediato e significativo. Senza controlli adeguati, i dipendenti possono facilmente copiare e incollare dati aziendali sensibili su piattaforme GenAI pubbliche. Ciò potrebbe includere elenchi di clienti, proiezioni finanziarie, codice sorgente non ancora rilasciato o documenti strategici di fusioni e acquisizioni. Una volta inviati tali dati a un LLM pubblico, l'organizzazione ne perde il controllo e potrebbero essere utilizzati per addestrare versioni future del modello.

- Intelligenza Artificiale Ombra e Utilizzo Non Autorizzato: L'accessibilità degli strumenti di intelligenza artificiale basati su browser implica che qualsiasi dipendente possa iniziare a utilizzare una nuova applicazione senza la conoscenza o l'approvazione del reparto IT. Questo fenomeno di "Shadow SaaS" crea enormi punti ciechi in termini di sicurezza. Un'efficace strategia di valutazione del rischio per l'intelligenza artificiale deve iniziare con l'individuazione e la mappatura di tutto l'utilizzo dell'intelligenza artificiale all'interno dell'organizzazione, non solo degli strumenti ufficialmente autorizzati.

- Risultati imprecisi e "allucinazioni": i modelli di GenAI possono produrre informazioni affidabili ma completamente errate. Se un dipendente utilizza un codice generato dall'IA che contiene un difetto sottile o basa una decisione strategica su un punto dati fabbricato, le conseguenze possono essere gravi. Questo vettore di rischio compromette l'integrità operativa e la continuità aziendale.

- Iniezione tempestiva e uso dannoso: gli autori delle minacce stanno esplorando attivamente modi per manipolare GenAI. Attraverso prompt accuratamente elaborati, un aggressore potrebbe ingannare uno strumento di intelligenza artificiale inducendolo a generare sofisticate e-mail di phishing, malware o disinformazione. Immagina uno scenario in cui un account dipendente compromesso viene utilizzato per interagire con un assistente di intelligenza artificiale interno, istruendolo a esfiltrare dati camuffandoli da report di routine.

- Rischi di conformità e proprietà intellettuale (PI): orientarsi nel panorama legale dell'IA è complesso. L'utilizzo di uno strumento GenAI addestrato su materiale protetto da copyright potrebbe esporre l'organizzazione a rivendicazioni di violazione della proprietà intellettuale. Inoltre, l'inserimento dei dati dei clienti in un LLM senza il consenso o le misure di sicurezza adeguate può comportare gravi sanzioni ai sensi di normative come il GDPR e il CCPA.

Creazione del framework di valutazione del rischio dell'IA

Un approccio casuale alla sicurezza dell'IA è destinato a fallire. Un framework di valutazione del rischio dell'IA fornisce un processo sistematico e ripetibile per identificare, analizzare e mitigare le minacce legate alla GenAI. Questo approccio strutturato garantisce che tutti i potenziali rischi vengano considerati e che i controlli siano applicati in modo coerente in tutta l'organizzazione.

Un quadro completo dovrebbe essere costruito attorno a cinque fasi principali:

- Inventario e individuazione: il primo principio della sicurezza è la visibilità. Non si può proteggere ciò che non si vede. Il primo passo è creare un inventario completo di tutte le applicazioni e piattaforme GenAI utilizzate dai dipendenti. Questo include sia gli strumenti approvati dall'azienda sia i servizi di intelligenza artificiale shadow accessibili direttamente tramite browser. Questa fase è fondamentale per comprendere la reale portata dell'impatto dell'intelligenza artificiale sulla propria organizzazione.

- Identificazione e analisi dei rischi: una volta stilato l'inventario, il passo successivo è analizzare ogni applicazione per identificare potenziali minacce. Per ogni strumento, considerate i tipi di dati a cui può accedere e i modi in cui potrebbe essere utilizzato in modo improprio. Ad esempio, un assistente di programmazione basato sull'intelligenza artificiale ha un profilo di rischio diverso da un generatore di immagini basato sull'intelligenza artificiale. Questa analisi dovrebbe essere contestuale, collegando lo strumento a specifici processi aziendali e sensibilità dei dati.

- Valutazione dell'impatto: dopo aver identificato i rischi, è necessario quantificarne il potenziale impatto aziendale. Ciò comporta la valutazione dello scenario peggiore per ciascun rischio, considerando diversi vettori: finanziari (ad esempio, sanzioni normative, costi di risposta agli incidenti), reputazionali (ad esempio, perdita di fiducia dei clienti), operativi (ad esempio, interruzione dell'attività) e legali (ad esempio, contenziosi, violazione della proprietà intellettuale). L'assegnazione di un punteggio di impatto (ad esempio, Alto, Medio, Basso) aiuta a stabilire le priorità dei rischi da affrontare per primi.

- Progettazione e implementazione dei controlli: è qui che la valutazione del rischio si traduce in azione. Sulla base dell'analisi del rischio e della valutazione dell'impatto, progetterai e implementerai specifici controlli di sicurezza. Non si tratta di semplici policy su uno scaffale, ma di barriere tecniche applicate dalla tecnologia. Per GenAI, i controlli potrebbero includere:

- Blocco dell'accesso a siti web di intelligenza artificiale ad alto rischio e non verificati.

- Impedire l'inserimento di modelli di dati sensibili (come chiavi API, PII o nomi in codice di progetti interni) in qualsiasi prompt GenAI.

- Limitare il caricamento dei file sulle piattaforme di intelligenza artificiale.

- Applicazione di autorizzazioni di sola lettura per impedire l'invio di dati.

- Visualizzazione di messaggi di avviso in tempo reale per informare gli utenti sulle azioni rischiose.

- Monitoraggio e revisione continua: l'ecosistema GenAI si evolve a un ritmo sorprendente. Nuovi strumenti e nuove minacce emergono ogni settimana. Una valutazione del rischio dell'IA non è un progetto una tantum, ma un ciclo di vita continuo. Il framework deve includere disposizioni per il monitoraggio continuo dell'utilizzo dell'IA e revisioni periodiche delle valutazioni del rischio e dei controlli per garantirne l'efficacia.

Il tuo modello di valutazione del rischio dell'IA praticabile

Per tradurre la teoria in pratica, un modello standardizzato di valutazione del rischio di IA è una risorsa inestimabile. Garantisce che le valutazioni vengano eseguite in modo coerente in tutti i reparti e in tutte le applicazioni. Sebbene un semplice foglio di calcolo possa essere un punto di partenza, l'obiettivo è creare un documento dinamico che informi il vostro livello di sicurezza.

Ecco un modello di esempio che il tuo team di governance dell'IA interfunzionale può adattare e utilizzare.

| Applicazione AI | Caso d'uso aziendale | Sensibilità dei dati | Rischio/i identificato/i | Probabilità | Impact | Punteggio di rischio | Controlli di mitigazione | Rischio residuo |

| Chat pubblica GPT-4 | Creazione di contenuti generali, riepilogo | Pubblico, Interno (Non sensibile) | Esfiltrazione di dati, output imprecisi | Alto | Medio | Alto | Blocco incollaggio di modelli di dati sensibili (ad esempio, PII, 'Progetto Phoenix'), formazione degli utenti | Basso |

| Analizzatore PDF non autorizzato | Riepilogo dei report esterni | Sconosciuto, potenzialmente riservato | Shadow AI, rischio malware, perdita di dati | Medio | Alto | Alto | Bloccare completamente l'accesso all'applicazione | N/A |

| Copilota GitHub | Generazione e assistenza del codice | Codice sorgente proprietario | Perdita di IP, suggerimenti di codice non sicuro | Alto | Alto | critico | Monitorare l'attività, impedire il caricamento dei file del repository chiave, scansione del codice | Medio |

| LLM interno sanzionato | Query della knowledge base interna | Interno, riservato | Iniezione immediata, minaccia interna | Basso | Medio | Basso | Controllo degli accessi basato sui ruoli (RBAC), registri di controllo | Basso |

Questo modello funge da punto di partenza per qualsiasi valutazione del rischio dell'intelligenza artificiale generativa, costringendo i team a riflettere sul contesto specifico di come viene utilizzato ogni strumento e su quali controlli specifici sono necessari per ridurre il rischio a un livello accettabile.

Dai fogli di calcolo manuali a uno strumento dedicato di valutazione del rischio basato sull'intelligenza artificiale

Sebbene un modello manuale di valutazione del rischio basato sull'intelligenza artificiale sia un ottimo primo passo, presenta dei limiti. I fogli di calcolo sono statici, difficili da gestire su larga scala e non dispongono di funzionalità di applicazione in tempo reale. Con l'avanzare dell'uso dell'intelligenza artificiale nella vostra organizzazione, avrete bisogno di uno strumento dedicato di valutazione del rischio basato sull'intelligenza artificiale per passare da una strategia di sicurezza reattiva a una proattiva. Il mercato degli strumenti di valutazione del rischio basati sull'intelligenza artificiale è in espansione, ma non tutti sono uguali.

Quando si valuta uno strumento di valutazione del rischio dell'IA, bisogna considerare queste categorie:

- SaaS Security Posture Management (SSPM): questi strumenti sono efficaci nell'individuare applicazioni SaaS sanzionate e nell'identificare configurazioni errate. Tuttavia, spesso non offrono visibilità sull'utilizzo della "shadow AI" basata sul browser e non sono in grado di controllare le interazioni degli utenti all'interno dell'applicazione stessa.

- Prevenzione della perdita di dati (DLP): le soluzioni DLP tradizionali possono essere configurate per bloccare modelli di dati sensibili, ma spesso non hanno la comprensione contestuale delle moderne applicazioni web. Potrebbero avere difficoltà a distinguere tra un'interazione legittima e una rischiosa all'interno di un'interfaccia di chat GenAI, causando falsi positivi che interrompono i flussi di lavoro o minacce non rilevate.

- Estensioni del browser aziendale: questa categoria emergente rappresenta un approccio più efficace. Un'estensione del browser incentrata sulla sicurezza, come quella offerta da LayerX, opera direttamente all'interno del browser. Ciò fornisce visibilità e controllo granulari sull'attività degli utenti su qualsiasi sito web, incluse le piattaforme GenAI. Questa soluzione consente ai team di sicurezza di monitorare tutte le interazioni degli utenti, come incollamenti, invii di moduli e caricamenti, e di applicare policy in tempo reale. Ad esempio, una policy potrebbe impedire a un dipendente di incollare testo identificato come "codice sorgente" in un LLM pubblico, mitigando efficacemente il rischio di perdita di IP senza bloccare completamente lo strumento. Questo rende l'estensione del browser uno strumento potente per implementare i controlli definiti nella valutazione del rischio per la sicurezza dell'IA.

In definitiva, la strategia più efficace spesso prevede l'utilizzo dell'intelligenza artificiale per la valutazione del rischio in senso più ampio, sfruttando strumenti intelligenti per automatizzare la scoperta e il monitoraggio, utilizzando al contempo una soluzione come LayerX per applicare policy granulari e consapevoli del contesto nel punto di rischio: il browser.

Migliori pratiche per un programma di valutazione del rischio dell'intelligenza artificiale sostenibile

Una strategia di sicurezza GenAI di successo va oltre framework e strumenti; richiede un cambiamento culturale e un impegno per il miglioramento continuo. Le seguenti best practice possono contribuire a garantire che il programma di valutazione del rischio dell'IA sia efficace e sostenibile.

- Istituire un comitato interfunzionale per la governance dell'IA: il rischio legato all'IA non è solo un problema di sicurezza; è un problema aziendale. Il team di governance dovrebbe includere rappresentanti di sicurezza, IT, legale, conformità e delle principali unità aziendali. Ciò garantisce che le decisioni in materia di rischio siano bilanciate con gli obiettivi aziendali e che le policy siano pratiche da implementare.

- Sviluppare una chiara Politica di Utilizzo Accettabile (AUP): i dipendenti necessitano di linee guida chiare. La AUP dovrebbe indicare esplicitamente quali strumenti di intelligenza artificiale sono autorizzati, i tipi di dati che è consentito utilizzare con essi e le responsabilità dell'utente per un utilizzo sicuro. Questa politica dovrebbe essere un risultato diretto del processo di valutazione del rischio.

- Dare priorità alla formazione continua degli utenti: i dipendenti sono la prima linea di difesa. La formazione dovrebbe andare oltre i moduli annuali di conformità e concentrarsi su scenari reali. Utilizzare "momenti di apprendimento" in tempo reale, ad esempio un avviso pop-up quando un utente tenta di incollare dati sensibili, per rafforzare i comportamenti sicuri.

- Adottare un approccio granulare basato sul rischio: invece di bloccare completamente l'IA, il che può soffocare l'innovazione, utilizzare la valutazione del rischio per applicare controlli granulari. Consentire casi d'uso a basso rischio, applicando al contempo controlli rigorosi sulle attività ad alto rischio. Ad esempio, consentire l'uso di uno strumento GenAI pubblico per i testi di marketing, ma bloccarne l'uso per l'analisi dei dati finanziari. Questo approccio sfumato è possibile solo con uno strumento che offra una visibilità approfondita sulle azioni degli utenti.

- Integrare la tecnologia per l'applicazione in tempo reale: policy e formazione sono essenziali, ma da sole non sono sufficienti. La tecnologia è necessaria per far rispettare le regole. Un'estensione del browser aziendale fornisce la struttura tecnica per la tua AUP, traducendo le policy scritte in prevenzione in tempo reale e trasformando la tua valutazione del rischio di intelligenza artificiale in un meccanismo di difesa attivo piuttosto che in un documento passivo.

Proteggi il tuo futuro basato sull'intelligenza artificiale con una gestione proattiva del rischio

L'intelligenza artificiale generativa offre un potenziale trasformativo, ma per realizzarne i benefici in modo sicuro è necessario un approccio proattivo e strutturato alla gestione dei rischi. Implementando un solido framework di valutazione del rischio legato all'intelligenza artificiale, utilizzando un modello pratico e implementando gli strumenti di applicazione più adeguati, le organizzazioni possono costruire un ponte sicuro verso un futuro basato sull'intelligenza artificiale.

Il percorso inizia con la visibilità e prosegue con il controllo. Capire dove e come viene utilizzata la GenAI è il primo passo. LayerX fornisce la visibilità critica e il controllo granulare necessari per trasformare la valutazione del rischio dell'IA da una semplice checklist a un sistema di difesa dinamico, consentendo alla vostra organizzazione di innovare con sicurezza e affidabilità.