Etter hvert som organisasjoner haster med å ta i bruk GenAI, har implementering av effektiv ChatGPT-sikkerhet blitt topprioritet for IT-sjefer i 2026. Denne veiledningen gjennomgår de ledende løsningene som forhindrer datalekkasje, blokkerer umiddelbare injeksjoner og styrer bruk av skygge-AI uten å bremse arbeidsstyrkens produktivitet.

Hva er ChatGPT-sikkerhetsverktøy og hvorfor de er viktige

ChatGPT-sikkerhetsverktøy er spesialiserte løsninger utviklet for å overvåke, styre og sikre samhandlingen mellom bedriftsbrukere og generative AI-plattformer. I motsetning til tradisjonelle brannmurer eller eldre DLP-systemer, ligger disse verktøyene direkte i brukerens arbeidsflyt, ofte i nettleseren, for å inspisere forespørsler og svar i sanntid. De forhindrer ansatte i å ved et uhell lime inn sensitiv PII eller IP i offentlige modeller, samtidig som de blokkerer ondsinnede utvidelser som prøver å kapre økter.

For ledere innen bedriftssikkerhet er disse verktøyene den eneste forsvarslinjen mot angrepsflaten «fra nettleser til sky». Ettersom ChatGPT blir det faktiske operativsystemet for mange roller, har risikoen for skygge-SaaS eksplodert. Dedikerte sikkerhetsverktøy gir den nødvendige oversikten for å se hvilke AI-applikasjoner som faktisk kjører, og sikrer at bedriftsdata forblir isolert fra offentlige opplæringsmodeller og at all bruk er i samsvar med nye regelverk fra 2026.

Viktige sikkerhetstrender for ChatGPT å følge med på i 2026

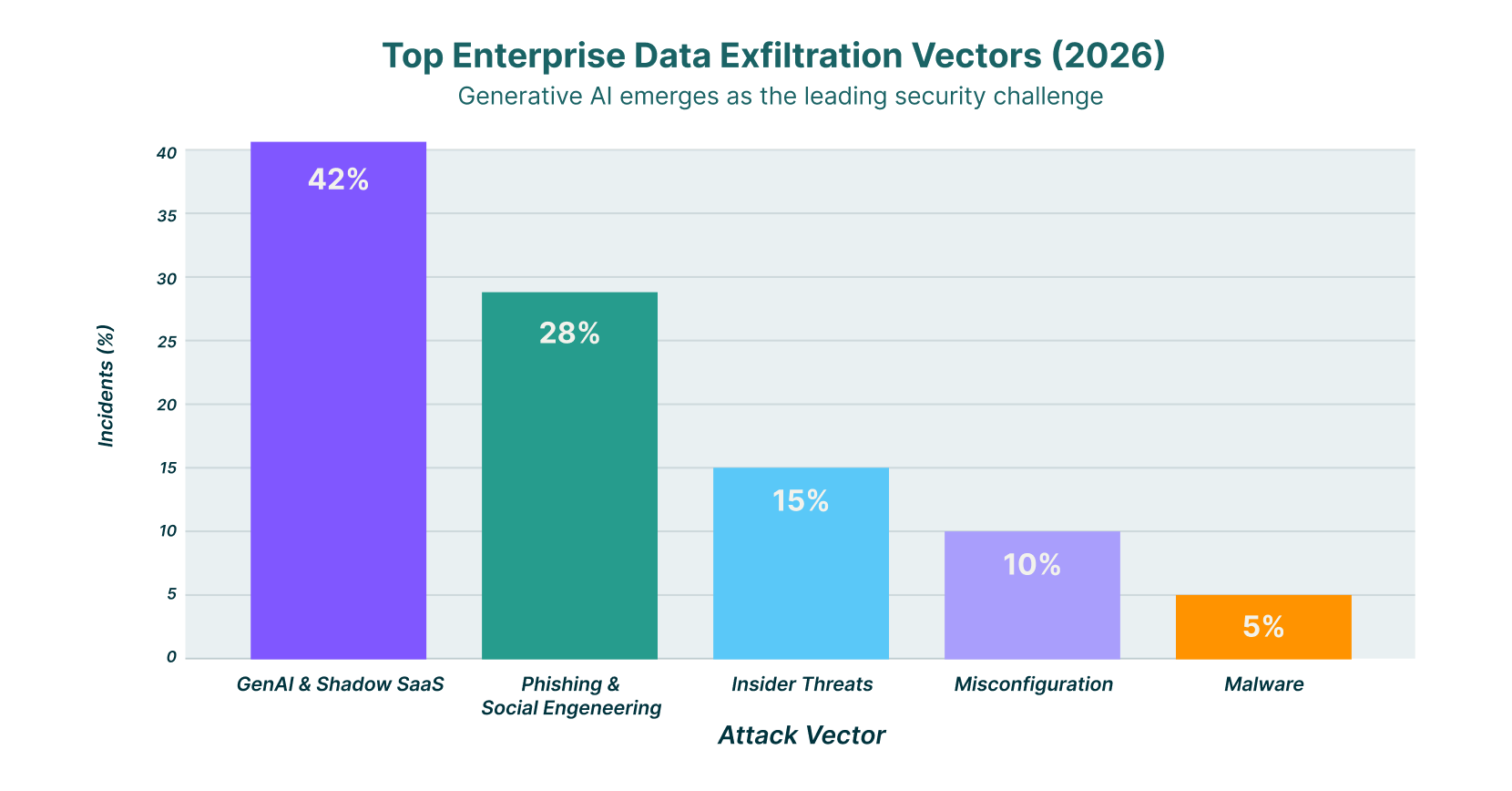

I 2026 har AI offisielt overtatt phishing som den viktigste vektoren for datautvinning i bedrifter. Angripere prøver ikke lenger bare å stjele legitimasjon; de manipulerer AI-modellene selv. Ny forskning har avdekket sårbarheter som «ZombieAgent» og «HackedGPT», der angripere bruker indirekte prompt injection for å gjøre en ansatts egen AI-assistent om til et verktøy for å utnytte privat minne og chathistorikk.

Fremveksten av «Agentic AI», der AI-systemer kan utføre handlinger autonomt, har introdusert betydelige nye risikoer. Nettlesere som integrerer disse agentene, som for eksempel ChatGPT Atlas, har vist seg å inneholde sårbarheter som gjør at ondsinnede utvidelser kan omgå standard sikkerhetsgrenser. Dette skiftet betyr at sikkerhetsteam ikke lenger bare kan blokkere URL-er; de må overvåke den faktiske intensjonen og utførelseslogikken til AI-agenter som kjører i nettleserøkten.

Kommersialisert AI-nettkriminalitet omformer også trussellandskapet. «Jailbreak-as-a-Service»-plattformer selges nå på det mørke nettet, noe som lar selv lavt kvalifiserte angripere omgå sikkerhetsrekkverket til bedriftsjurister. Som svar tvinger regulatorisk press organisasjoner til å bevise at de har «human-in-the-loop»-tilsyn og detaljert datastyring for hver AI-interaksjon, noe som flytter samsvar fra en avkrysningsboksøvelse til et kontinuerlig driftskrav.

8 beste ChatGPT-sikkerhetsverktøy for 2026

Følgende liste fremhever de beste løsningene for å sikre GenAI-bruk, alt fra nettleserbaserte plattformer til dedikerte GenAI-brannmurer.

| Oppløsning | Nøkkelegenskaper | Best for |

| LayerX | DLP i nettleseren i sanntid, full samtalesporing og blokkering av skygge-AI | Universell beskyttelse på tvers av alle nettlesere |

| Island | Komplett nettlesermiljø for bedrifter, integrert DLP, isolerte økter | Team som erstatter standard nettlesere |

| Harmonisk sikkerhet | «Zero touch»-databeskyttelse, oversikt over samsvar og skygge-AI-overvåking | Datastyring uten friksjon |

| SquareX | Deteksjon av skadelige utvidelser, filisolering, nettleserbasert beskyttelse | Stoppe klientsideangrep |

| Menlo Sikkerhet | Ekstern nettleserisolering (RBI), limebeskyttelse og kontroller for filopplasting | Isolering av høyrisikobrukere |

| Koi-sikkerhet | Skygge-IT-oppdagelse, risikovurdering av utvidelser og forebygging av datasalg | Håndtering av risikoer for nettleserutvidelser |

| Rask sikkerhet | Rask injeksjonsbeskyttelse, skygge-IT-deteksjon og innholdsmoderering | Forebygging av promptbaserte angrep |

| Serafisk sikkerhet | Forebygging av utnyttelse, anti-phishing, finjusterte datakontroller | Forhindre nettleserutnyttelser |

1. LayerX

LayerX er en nettleserbasert sikkerhetsplattform som gir sanntidsbeskyttelse mot ChatGPT-datalekkasjer og nettbaserte trusler. Den leveres som en lettvektsutvidelse, og forvandler enhver kommersiell nettleser til et sikkert arbeidsområde uten å kreve en ny nettleserinfrastruktur. LayerX tilbyr dyp innsikt i brukerinteraksjoner, og fanger opp full samtalekontekst, både spørsmål og svar, for å oppdage når sensitive data som PII eller kildekode deles.

Utover overvåking håndhever LayerX aktivt detaljerte retningslinjer for å blokkere risikable handlinger før de skjer. Den kan deaktivere «lim inn»-funksjonen for spesifikke datatyper, blokkere uautoriserte nettleserutvidelser som prøver å lese ChatGPT-økter, og eliminere skygge-AI ved å begrense tilgangen til ikke-godkjente verktøy. Evnen til å handle på øktnivå sikrer at sikkerheten følger brukeren, enten de er på en administrert enhet eller et BYOD-endepunkt.

2. Øya

Island har en annen tilnærming ved å erstatte standardnettleseren for forbrukere med en dedikert «bedriftsnettleser». Dette gir IT-team full kontroll over hele nettlesermiljøet, inkludert muligheten til å bygge inn sikkerhetskontroller direkte i brukergrensesnittet. Islands integrerte DLP-motor kan forhindre at sensitive data limes inn i ChatGPT, begrense filopplastinger og til og med blokkere skjermbilder av sensitive økter.

For 2026 har Island integrerte funksjoner som «Island AI Assistant», som lar brukere få tilgang til ChatGPT-funksjoner i en styrt sidefelt som overvåkes fullt ut av bedriftspolicyen. Dette sikrer at ansatte har tilgang til produktivitetsverktøy, samtidig som organisasjonen opprettholder strenge grenser rundt dataflyt. Det er en kraftig løsning for organisasjoner som er villige til å migrere arbeidsstyrken sin til et nytt nettlesergrensesnitt.

3. Harmonisk sikkerhet

Harmonic Security benytter en «null berørings»-filosofi for databeskyttelse, med mål om å stoppe datalekkasjer uten å kvele innovasjon eller frustrere ansatte. Plattformen fokuserer på synlighet og identifiserer bruk av «skygge-AI», slik at sikkerhetsteam kan se nøyaktig hvilke verktøy som blir åpnet og hvilke data som flyter til dem. Den bruker forhåndsbygde databeskyttelsesmodeller for å identifisere sensitiv informasjon uten kompleks manuell konfigurasjon.

Løsningen er utviklet for å hjelpe organisasjoner med å «svare ja» til bruk av kunstig intelligens ved å tilby nødvendige samsvarstiltak. Harmonic overvåker data både i ro og under overføring, og sikrer at ansattes bruk av verktøy som ChatGPT overholder personvernreglene. Den lavfriksjonstilnærmingen er ideell for kulturer som prioriterer smidighet og ønsker å unngå strenge blokkeringsregler.

4. SquareX

SquareX fokuserer på å nøytralisere klientsidetrusler som er rettet mot nettleseren, inkludert ondsinnede utvidelser og filbaserte angrep. Plattformen deres er spesielt effektiv til å oppdage «Shadow IT»-utvidelser som brukere kan installere for å forbedre ChatGPT-opplevelsen, men som faktisk samler inn sensitive chatlogger. SquareX isolerer disse risikoene i sanntid og forhindrer at uautorisert kode kjøres i nettleserøkten.

I 2026 utvidet SquareX sine muligheter for å beskytte mot «AI Sidebar Spoofing», en teknikk der angripere etterligner AI-assistenter for å lure brukere til å avsløre legitimasjon. Ved å overvåke DOM for mistenkelige modifikasjoner, sikrer SquareX at ChatGPT-grensesnittet brukerne samhandler med er ekte og sikkert. Dette gjør det til et kritisk verktøy for organisasjoner som er bekymret for sofistikert nettleserbasert sosial manipulering.

5. Menlo Sikkerhet

Menlo Security bruker sin kjerneteknologi for fjernnettleserisolering (RBI) for å opprette en sikker buffer mellom brukeren og GenAI-plattformene. Ved å kjøre nettleserøkten i en ekstern container, sikrer Menlo at ingen skadelig kode fra et kompromittert AI-verktøy kan nå endepunktet. For databeskyttelse bruker de strenge kopier-lim-kontroller, som forhindrer brukere i å flytte sensitive data fra sitt lokale utklippstavle til den eksterne ChatGPT-økten.

Plattformen inspiserer også filopplastinger til GenAI-verktøy, fjerner metadata og skanner etter skjulte trusler før filer behandles. Denne isolasjonsmetoden er svært effektiv for høyrisikobrukere eller avdelinger som ofte samhandler med upålitelig eksternt innhold. Den lar organisasjoner omfavne ChatGPTs produktivitetsfordeler samtidig som de opprettholder en «null tillit»-holdning overfor nettinnhold.

6. Koi-sikkerhet

Koi Security spesialiserer seg på å håndtere risikoene knyttet til nettleserutvidelser, en viktig vektor for datalekkasjer i GenAI-miljøer. Plattformen deres lager en oversikt over alle installerte utvidelser og scorer dem basert på deres datainnsamlingspraksis, og flagger de som er kjent for å selge brukerdata eller lese nettleserhistorikk. Denne synligheten hjelper IT-team med å identifisere «gratis» AI-skriveassistenter som faktisk tjener penger på bedriftens immaterielle rettigheter.

Ved å blokkere høyrisikoutvidelser forhindrer Koi tredjepartsverktøy fra å skrape teksten i ChatGPT-vinduer. Dette sikrer at sensitive samtaler forblir private og ikke stille blir filtrert ut av en bakgrunnsprosess. For organisasjoner med en stor, desentralisert arbeidsstyrke som bruker Chrome eller Edge, gir Koi et nødvendig styringslag over økosystemet for nettleserutvidelser.

7. Rask sikkerhet

Prompt Security fokuserer på å sikre hele livssyklusen til generativ AI-adopsjon, fra ansattes bruk av offentlige verktøy til utvikling av interne LLM-applikasjoner. Plattformen deres inspiserer alle prompt- og modellresponser for å forhindre dataeksponering og blokkere promptinjeksjonsangrep. Den inkluderer spesifikke moduler for «Shadow AI»-deteksjon, som hjelper IT-team med å avdekke og kategorisere alle GenAI-verktøy som er i bruk på tvers av nettverket.

Verktøyet utmerker seg på innholdsmoderering og -rensing. Det kan automatisk redigere sensitiv informasjon fra forespørsler i sanntid, noe som sikrer at personlig identifiserende informasjon aldri forlater organisasjonens grenser. For selskaper som bygger sine egne AI-agenter, tilbyr Prompt Security beskyttelse mot jailbreaking-forsøk og giftig utdata, noe som gjør det til et sterkt valg for ingeniørteam som distribuerer kunderettet AI.

8. Serafisk sikkerhet

Seraphic Security forvandler enhver standard nettleser til en sikker bedriftsnettleser gjennom en lettvektsagent, som tilbyr beskyttelse mot utnyttelser og datatap. «Exploit Prevention»-motoren bruker kaosutviklingsprinsipper for å gjøre nettlesermiljøet uforutsigbart for angripere, og stopper nulldagsangrep som kan være rettet mot sårbarheter i den underliggende nettlesermotoren eller GenAI-grensesnittene.

For ChatGPT-sikkerhet håndhever Seraphic detaljerte retningslinjer som kontrollerer hvilke data som kan deles. Den kan deaktivere spesifikke nettleserfunksjoner, som skjermbilder eller utviklerverktøy, mens en bruker er på OpenAI-domenet, noe som reduserer risikoen for datatyveri. Denne tilnærmingen gir dyptgående sikkerhetskontroller uten det tunge infrastrukturløftet som VDI eller full nettleserutskifting medfører.

Hvordan velge det beste ChatGPT-sikkerhetsverktøyet

- Vurder om du trenger en nettleser-agnostisk utvidelse som LayerX, eller om du er villig til å erstatte hele nettleseren din med en løsning som Island.

- Prioriter verktøy som tilbyr sanntids «lime-blocking» og dataredigering for å stoppe lekkasjer før de forlater endepunktet.

- Se etter «Shadow AI»-oppdagelsesfunksjoner som kan identifisere uautoriserte GenAI-apper som kjører utenfor SSO-miljøet ditt.

- Sørg for at løsningen kan inspisere kryptert trafikk og forstå konteksten til samtalen, ikke bare enkel URL-filtrering.

- Velg en leverandør som tilbyr detaljerte revisjonslogger av både forespørsler og svar for å oppfylle nye samsvarskrav i 2026.

Spørsmål og svar

1. Er ChatGPT sikkert for bedriftsbruk i 2026?

ChatGPT Enterprise tilbyr sterk kryptering og SOC 2-samsvar, men den primære risikoen er fortsatt brukeratferd og kontokonfigurasjon. Selv om OpenAI beskytter infrastrukturen, kan den ikke hindre en ansatt i å frivillig lime inn en kundedatabase i en ledetekst. Sikker bruk krever et ekstra lag med nettleserstyring for å kontrollere hvilke data som legges inn i modellen.

2. Hvordan hindrer jeg ansatte i å lime inn sensitive data i ChatGPT?

Den mest effektive metoden er å bruke en sikkerhetsplattform eller utvidelse for nettlesere som inspiserer tekstfelt i sanntid. Verktøy som LayerX og Nightfall AI kan oppdage når en bruker prøver å lime inn PII eller IP i ChatGPT-vinduet og blokkere handlingen umiddelbart, og vise en advarsel til brukeren som forklarer bruddet på retningslinjene.

3. Hva er forskjellen mellom en sikker bedriftsnettleser og en nettleserutvidelse?

En sikker bedriftsnettleser, som Island, er et frittstående program som erstatter Chrome eller Edge fullstendig, og tilbyr full kontroll over miljøet, men krever en endring i brukeratferd. En nettleserutvidelse, som LayerX, installeres oppå eksisterende nettlesere og legger til sikkerhets- og overvåkingsfunksjoner uten å tvinge brukere til å bytte til et nytt grensesnitt eller miste sine personlige innstillinger.

4. Kan eldre DLP-verktøy beskytte mot GenAI-datalekkasjer?

Eldre DLP-verktøy sliter ofte med GenAI fordi de vanligvis opererer på nettverks- eller filnivå, og mangler konteksten til data som limes inn i et nettskjema. De kan blokkere et helt nettsted, men kan ikke filtrere spesifikke tekststrenger granulært i en chat-økt. Moderne nettleserbaserte sikkerhetsverktøy er spesielt utviklet for å forstå interaksjoner på DOM-nivå og gi den nødvendige granulariteten.

5. Hva er risikoer knyttet til «Agentisk AI»?

Agentisk AI refererer til AI-systemer som kan utføre oppgaver autonomt, for eksempel å surfe på nettet eller sende e-post på vegne av en bruker. Risikoen er at hvis disse agentene blir kompromittert (f.eks. via umiddelbar injeksjon), kan de manipuleres til å utføre ondsinnede handlinger som å utpresse data eller installere skadelig programvare uten brukerens eksplisitte samtykke. Sikkerhetsverktøy må nå overvåke handlingene til disse agentene, ikke bare teksten de genererer.