A Inteligência Artificial Generativa (GenAI) passou rapidamente de uma tecnologia inovadora a um componente essencial das operações empresariais. Da aceleração do desenvolvimento de código à revolução do engajamento do cliente, suas aplicações estão se expandindo a uma velocidade sem precedentes. No entanto, essa poderosa onda de inovação carrega consigo um risco significativo. Os mesmos modelos que geram textos perspicazes e semelhantes aos humanos também podem produzir conteúdo prejudicial, tendencioso e tóxico, introduzindo desafios substanciais nas áreas jurídica, ética e comercial. A questão da toxicidade da GenAI não é uma preocupação marginal; é um obstáculo central para a adoção segura e escalável da IA.

Para analistas de segurança, CISOs e líderes de TI, compreender e mitigar esse risco é fundamental. Não basta simplesmente aproveitar os benefícios de produtividade da IA GenAI; as organizações também devem construir defesas robustas contra seu potencial de causar danos. Isso exige uma análise minuciosa das origens dessa toxicidade, dos riscos tangíveis que ela representa e dos controles essenciais para uma governança eficaz.

Entendendo a toxicidade do GenAI: Mais do que apenas palavras desagradáveis

Entendendo a toxicidade do GenAI: Mais do que apenas palavras desagradáveis

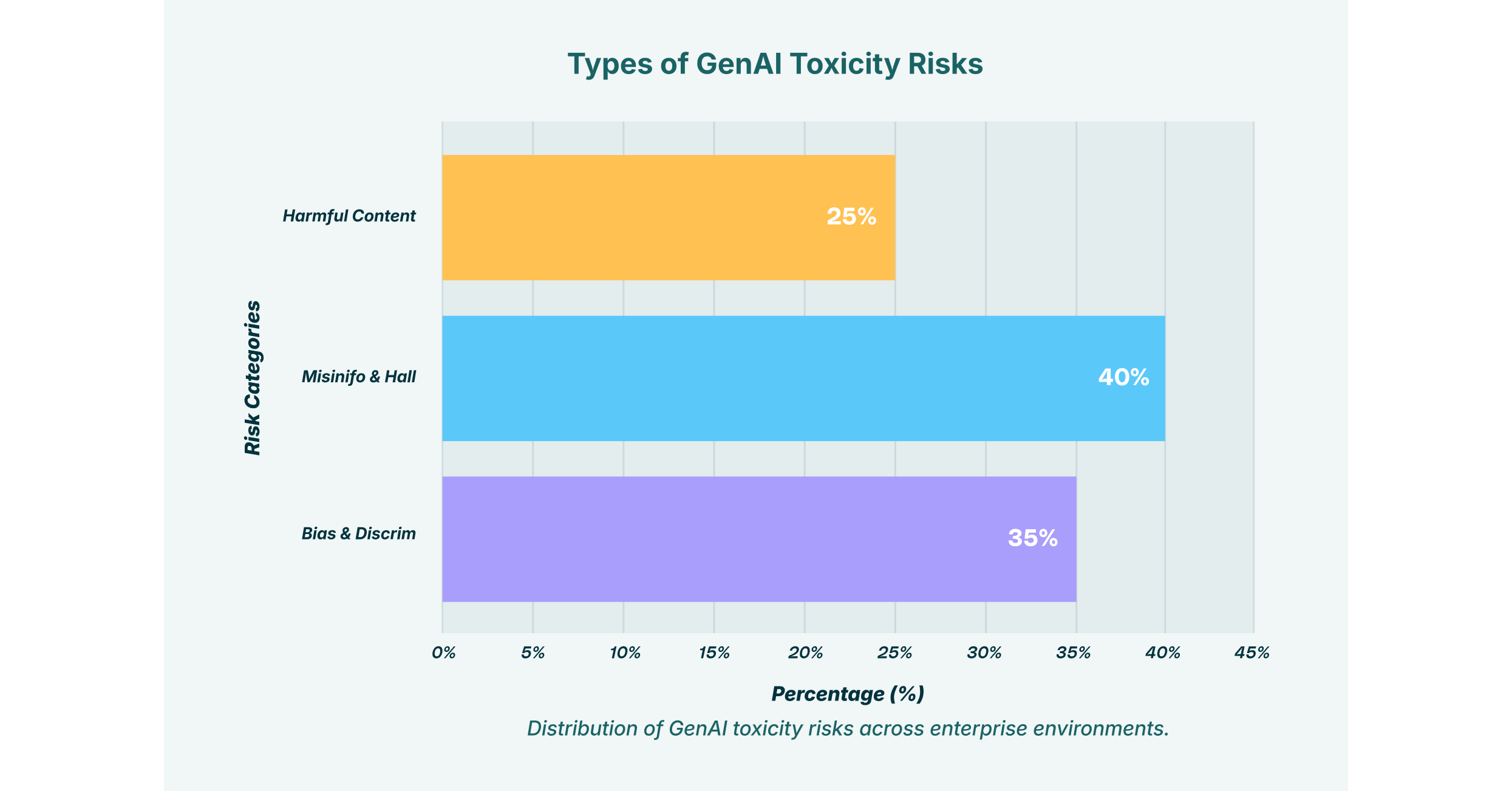

O termo toxicidade da IA GenAI vai muito além de simples palavrões ou discurso de ódio. Abrange um amplo espectro de conteúdo prejudicial, incluindo vieses sutis, porém danosos, a propagação de desinformação e a geração de conteúdo inadequado que pode violar políticas corporativas e normas sociais. As origens dessa toxicidade são tão complexas quanto os próprios modelos.

Em sua essência, o problema geralmente começa com os dados de treinamento. Grandes Modelos de Linguagem (LLMs, na sigla em inglês) são treinados em imensos conjuntos de dados coletados da internet, um reflexo digital da humanidade que inclui seu melhor conhecimento e seus piores preconceitos. Se os dados de treinamento forem tendenciosos, o modelo inevitavelmente aprenderá e replicará esses vieses, levando a resultados injustos ou discriminatórios. Isso pode se manifestar como uma ferramenta de recrutamento que favorece um gênero em detrimento de outro ou um chatbot de aconselhamento financeiro que oferece diferentes condições de empréstimo com base na etnia.

Para agravar esse problema, muitos sistemas de IA GenAI são caracterizados por sua natureza de "caixa preta". As intrincadas redes neurais de múltiplas camadas que alimentam esses modelos tornam extremamente difícil rastrear uma saída específica até sua causa. Essa falta de transparência representa um obstáculo significativo para a governança da IA GenAI, visto que auditar um modelo quanto à imparcialidade e segurança constitui um desafio técnico considerável. Além disso, agentes maliciosos podem explorar esses sistemas por meio de ataques adversários, como "injeção de prompts" ou "jailbreaking", nos quais entradas habilmente elaboradas são usadas para burlar os filtros de segurança integrados do modelo e forçá-lo a gerar conteúdo prejudicial.

Os riscos tangíveis dos resultados tóxicos da LLM

Quando um modelo de IA genômica produz conteúdo tóxico, as consequências estão longe de ser teóricas. Para uma empresa, o dano pode ser imediato e grave, afetando tudo, desde a reputação da marca até a estabilidade operacional.

- Danos à marca e à reputação: A confiança pública é frágil. Um incidente envolvendo uma IA tóxica pode destruí-la num instante. Por exemplo, quando se descobriu que a ferramenta GenAI da Figma estava plagiando designs protegidos por direitos autorais da Apple, isso causou um constrangimento significativo à marca, que exigiu uma retratação pública. Em outro caso, uma companhia aérea canadense foi responsabilizada legalmente por informações enganosas fornecidas por seu chatbot de atendimento ao cliente, demonstrando que as organizações são responsáveis pelos erros de suas IAs.

- Violações Legais e de Conformidade: Trabalhos de mestrado em Direito (LLM) tóxicos ou tendenciosos podem acarretar sérios problemas legais. Trabalhos discriminatórios podem violar leis de igualdade de oportunidades de emprego, enquanto aqueles que vazam ou utilizam indevidamente dados pessoais podem infringir regulamentações como o GDPR ou o HIPAA. Em setores altamente regulamentados, como o financeiro e o da saúde, os riscos de conformidade são excepcionalmente altos.

- Interrupção nos Negócios e Operações: O impacto de resultados falhos do LLM não é apenas externo. Internamente, a dependência de informações imprecisas ou tendenciosas geradas pela GenAI pode interromper fluxos de trabalho, corromper processos de tomada de decisão e disseminar desinformação por toda a organização. Imagine uma equipe de marketing agindo com base em análises de mercado falhas provenientes de uma ferramenta GenAI ou um desenvolvedor implementando código inseguro sugerido por um assistente de IA. As consequências operacionais poderiam ser imensas.

- Ameaças de segurança intensificadas: além de gerar conteúdo tóxico, a GenAI pode ser usada como arma para criar ameaças de segurança sofisticadas. Os atacantes podem induzir os modelos a escrever e-mails de phishing altamente convincentes, gerar malware polimórfico que burla a detecção tradicional ou criar scripts para ataques de engenharia social. Isso representa uma nova fronteira de exfiltração e orquestração de ataques impulsionada pela GenAI, que as equipes de segurança devem estar preparadas para enfrentar.

Detecção: Identificando Viés e Toxicidade

Para controlar a toxicidade da IA GenAI, primeiro é preciso ser capaz de detectá-la. A detecção de conteúdo prejudicial e vieses subjacentes em Modelos de Aprendizagem Baseados em Aprendizagem (LLMs) é uma disciplina complexa e multifacetada que combina análise estatística, testes comportamentais e supervisão humana. As organizações não podem se dar ao luxo de tratar seus modelos como infalíveis; elas devem implementar um processo contínuo e rigoroso para a detecção de vieses em LLMs.

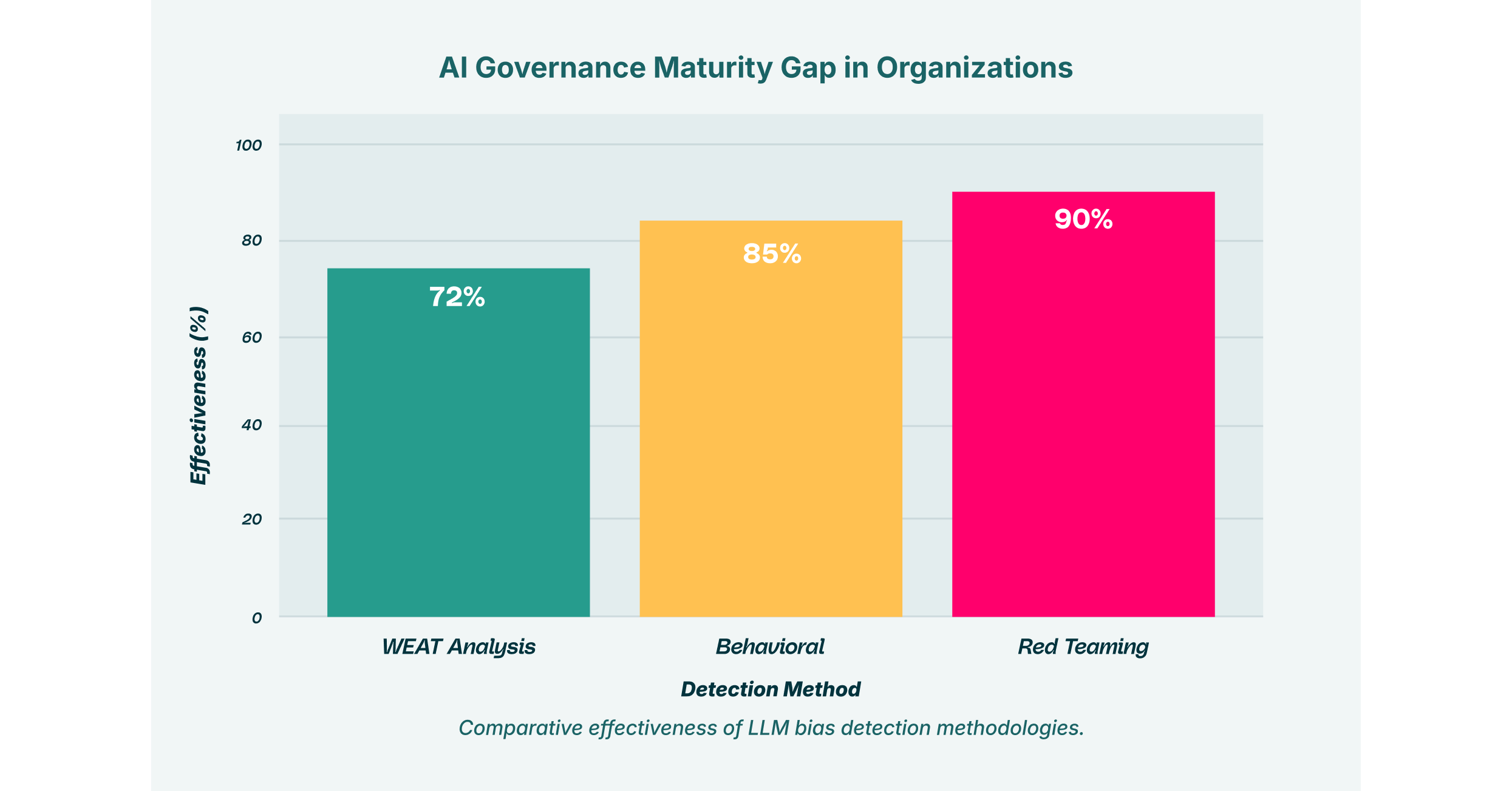

Uma das abordagens mais técnicas envolve testes estatísticos e baseados em incorporação de dados. Técnicas como o Word Embedding Association Test (WEAT) analisam as representações internas do modelo para medir a força da associação entre diferentes conceitos, por exemplo, a proximidade de palavras relacionadas a certas profissões com gêneros específicos. Ao usar métricas como a similaridade de cosseno, os cientistas de dados podem quantificar estatisticamente vieses que podem não ser aparentes à primeira vista.

Outro método crucial é o teste comportamental, ou "sondagem". Isso envolve o uso de parâmetros estruturados e perguntas cuidadosamente elaboradas para questionar sistematicamente o modelo em busca de respostas tendenciosas em uma série de categorias sensíveis, incluindo idade, religião, deficiência e nacionalidade. Técnicas emergentes como a Quantificação da Incerteza (UQ) e a Inteligência Artificial Explicável (XAI) também se mostram promissoras para ajudar a revelar vieses não previstos, analisando os níveis de confiança e os processos de tomada de decisão de um modelo.

No entanto, as ferramentas automatizadas por si só são insuficientes. O "red teaming", um processo no qual especialistas em segurança tentam ativamente enganar um modelo para que ele produza conteúdo malicioso, é essencial para descobrir vulnerabilidades que os testes automatizados podem não detectar. Essa abordagem adversária é complementada pelo estabelecimento de robustos mecanismos de feedback, nos quais avaliadores humanos e usuários finais podem relatar conteúdo tendencioso ou inadequado, fornecendo os dados necessários para o aprimoramento e o retreinamento contínuos do modelo.

Moderação de conteúdo por IA: a primeira linha de defesa

Enquanto a detecção de viés em modelos de aprendizado de máquina (LLM) se concentra na análise do próprio modelo, a moderação de conteúdo por IA é a aplicação prática e em tempo real dessas informações para filtrar entradas e saídas. Ela serve como a primeira linha de defesa, impedindo que conteúdo prejudicial chegue aos usuários finais ou seja processado pelo modelo.

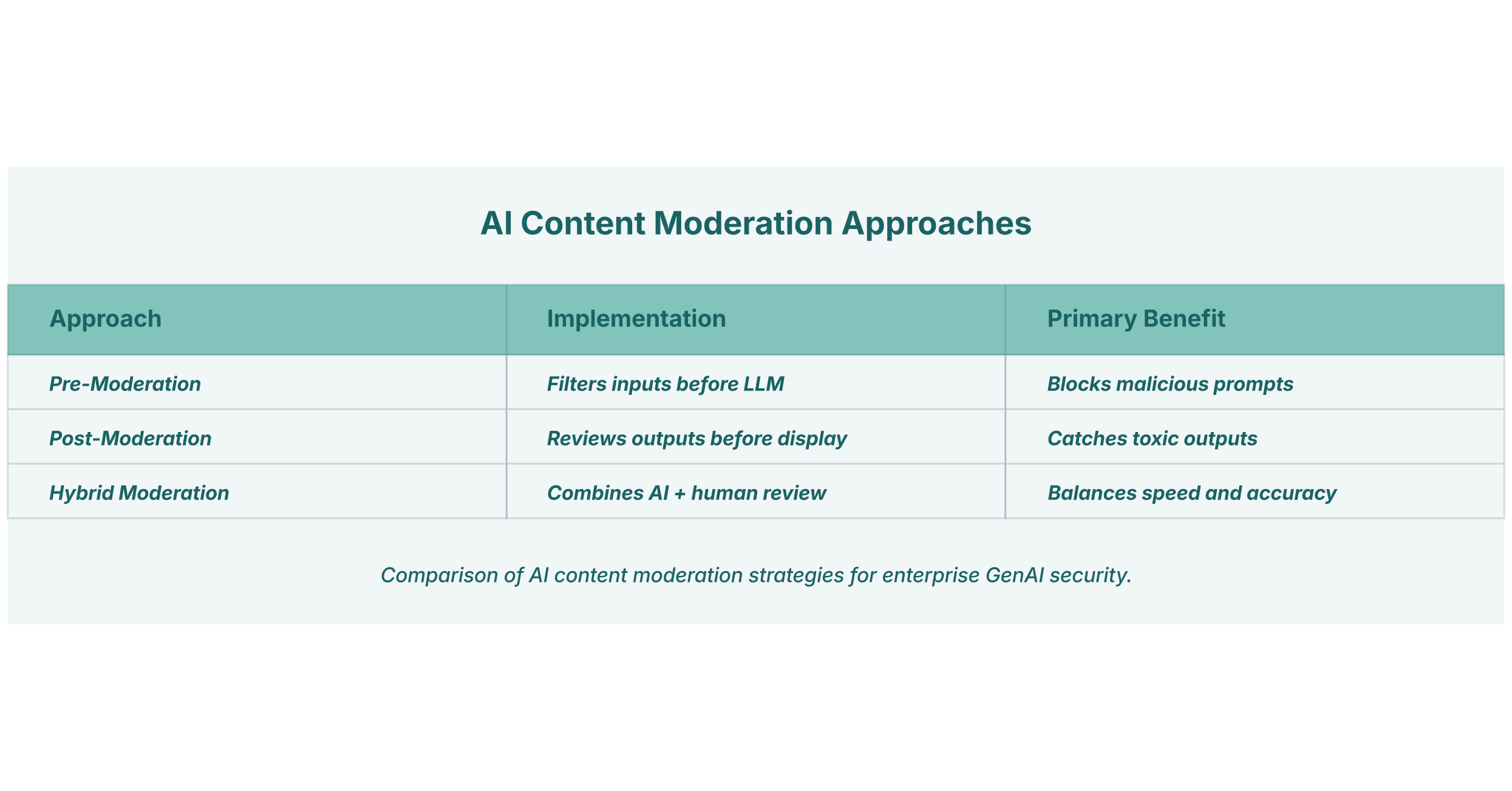

Estratégias eficazes de moderação de conteúdo por IA normalmente envolvem várias camadas:

- Pré-moderação: Esta técnica envolve a análise das entradas do usuário. antes Elas são enviadas para o LLM. Ao usar o Processamento de Linguagem Natural (PLN) para verificar palavras-chave, linguagem ameaçadora ou padrões associados a ataques de injeção de prompts, as organizações podem bloquear consultas maliciosas ou inadequadas na origem.

- Pós-moderação: Tão importante quanto a revisão dos resultados do LLM é a análise dos resultados obtidos. depois de eles são gerados, mas antes Eles são exibidos ao usuário. Esta etapa funciona como uma verificação de segurança final para detectar qualquer conteúdo prejudicial, tendencioso ou tóxico que o modelo possa ter produzido, apesar de outras medidas de segurança.

- Moderação Híbrida: A abordagem mais eficaz e amplamente adotada é a moderação híbrida, que combina a velocidade e a escala dos filtros automatizados de IA com a sensibilidade e a compreensão contextual dos moderadores humanos. A IA lida com o grande volume de casos claros, enquanto o conteúdo ambíguo ou sensível é encaminhado para revisão humana. Isso garante eficiência e alta precisão.

Algumas plataformas também estão caminhando em direção à moderação proativa, onde sistemas sofisticados de IA são projetados para identificar e conter a disseminação de conteúdo prejudicial antes que ele ganhe visibilidade, criando um ambiente digital mais seguro desde o início.

Implementando controles: uma abordagem orientada pela governança

Implementando controles: uma abordagem orientada pela governança

Detectar toxicidade e moderar conteúdo são medidas reativas cruciais, mas uma estratégia verdadeiramente eficaz é proativa e fundamentada em uma governança sólida. Para CISOs e líderes de TI, o objetivo é criar uma estrutura de políticas e controles técnicos que permita o uso seguro da IA GenAI em toda a empresa.

Tudo começa com um plano abrangente de governança de IA GenAI. Isso requer o estabelecimento de uma política clara de uso de IA que defina o que é permitido, o que é restrito e os procedimentos específicos para o uso de IA com dados sensíveis ou proprietários. Essa política deve ser construída sobre os pilares da transparência, da responsabilidade e do uso ético, garantindo que todas as atividades de IA estejam alinhadas aos valores e às obrigações legais da organização.

Com a política definida, o próximo passo é implementar as salvaguardas da GenAI, os controles técnicos que garantem o cumprimento dessas regras na prática. Essas salvaguardas incluem sistemas de filtragem de entrada e saída que utilizam moderação de conteúdo por IA para bloquear conteúdo tóxico, bem como controles de acesso rigorosos que limitam o uso de ferramentas poderosas da GenAI a pessoal autorizado.

É aqui que a segurança em nível de navegador se torna indispensável. Muitos dos riscos mais significativos da Inteligência Artificial Geral (IAG) surgem do ecossistema "SaaS paralelo", onde os funcionários usam aplicativos públicos de IAG em seus navegadores de forma independente, sem supervisão ou autorização oficial. Uma extensão de navegador corporativa segura fornece a visibilidade e o controle essenciais para gerenciar esse risco. Imagine um cenário em que um funcionário tenta colar dados confidenciais de clientes em um chatbot público. Uma solução de segurança em nível de navegador, como a oferecida pela LayerX, pode analisar os dados e o contexto do site de destino e bloquear a ação imediatamente ou exibir um aviso ao usuário. Essa capacidade é crucial para evitar a exfiltração de informações pessoais identificáveis (PII) e propriedade intelectual sensíveis, aplicando as políticas de segurança do SaaS diretamente no ponto de interação do usuário.

Por fim, a GenAI não é uma tecnologia do tipo "configure e esqueça". Os modelos evoluem, novas ameaças surgem e os padrões de uso mudam. O monitoramento contínuo do comportamento do modelo é essencial para detectar desvios de desempenho e identificar novas vulnerabilidades. Isso deve ser acompanhado de mecanismos de feedback claros que capacitem a equipe de segurança e os usuários finais a relatarem conteúdo inadequado ou outros problemas, garantindo que as defesas da organização se adaptem tão rapidamente quanto a própria tecnologia.

A Inteligência Artificial Geral (GenAI) oferece imensas oportunidades, mas também apresenta um conjunto complexo e dinâmico de riscos. O desafio da toxicidade da GenAI, em todas as suas formas, não é insuperável, mas exige uma defesa estratégica e multifacetada. Combinando técnicas avançadas de detecção de viés em LLM (Language-Level Management), moderação de conteúdo eficaz por IA e uma estrutura de governança robusta, reforçada por controles técnicos, as organizações podem navegar neste novo ecossistema. O objetivo não é bloquear a inovação, mas sim viabilizá-la com segurança. Soluções que proporcionam visibilidade e controle no nível do navegador são uma peça fundamental deste quebra-cabeça, oferecendo uma maneira prática de gerenciar a natureza imprevisível dos resultados de LLM e garantir a próxima onda de produtividade empresarial.