Эффективная безопасность сегодня требует от нас контроля не только над самими моделями, но и над тем, как сотрудники взаимодействуют с генеративными моделями. Топ-10 практик управления ИИ на 2026 год сосредоточены на обеспечении безопасности «последнего этапа» внедрения пользователями, когда данные покидают предприятие и попадают в браузер.

Что представляют собой практики управления ИИ и почему они важны?

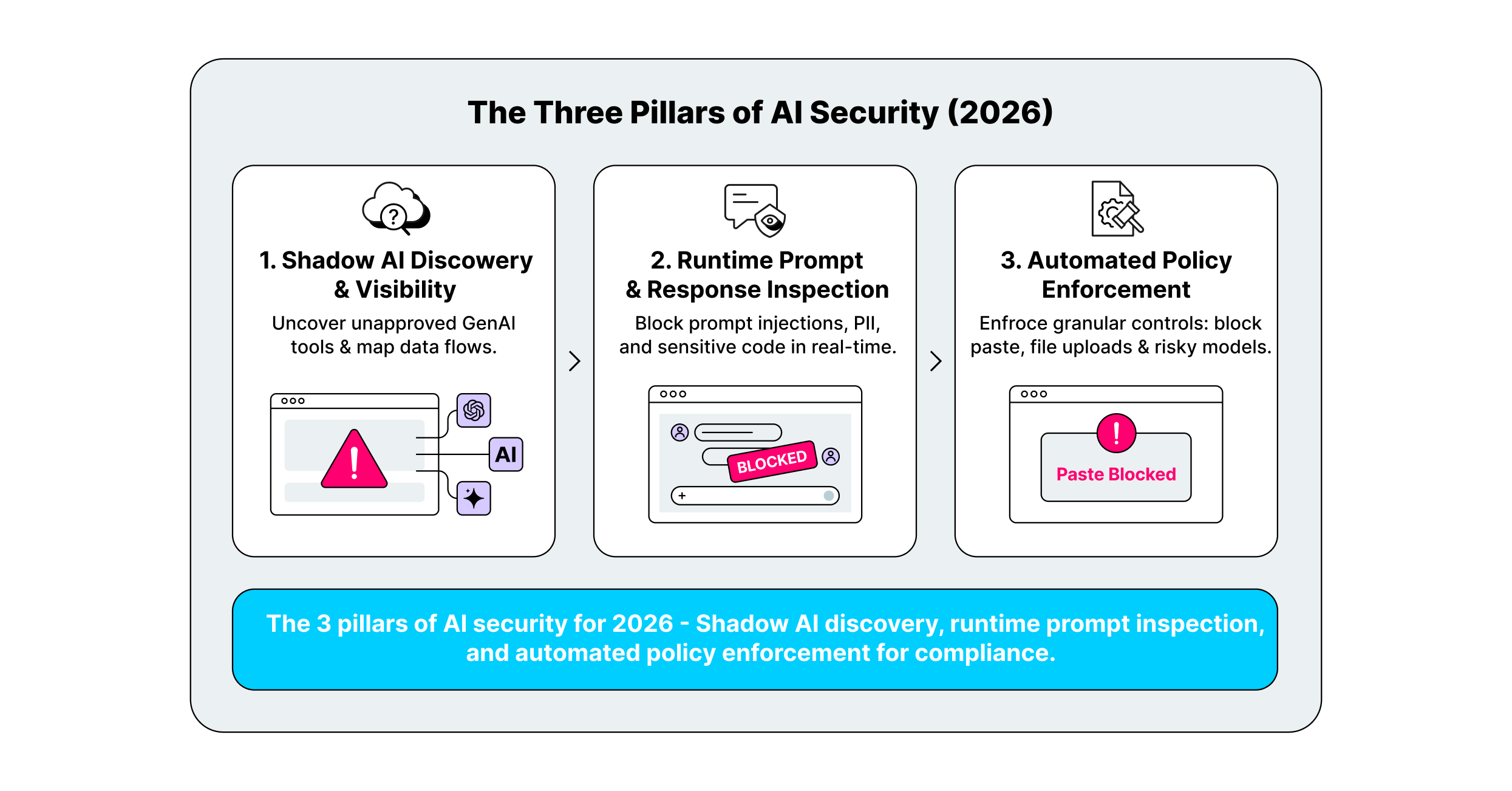

Управление ИИ перестало быть теоретической основой; это активный процесс обеспечения безопасности, предназначенный для управления рисками, связанными с использованием генеративного ИИ. Эти методы смещают акцент с проверки весов моделей на контроль «точки использования». Теперь командам безопасности необходимо контролировать тот самый момент, когда сотрудник вставляет данные клиента в чат-бот или устанавливает расширение для браузера на основе ИИ.

Наиболее существенный пробел в современном управлении — это «последняя миля»: браузерный интерфейс, где пользователи взаимодействуют с инструментами SaaS и GenAI. Традиционные средства защиты сети не могут отслеживать зашифрованный трафик внутри чата, а API-ориентированные средства контроля часто реагируют слишком поздно. Эффективное управление требует видимости и контроля в режиме реального времени непосредственно в рабочем пространстве сотрудника для предотвращения утечки данных и блокировки вредоносных входных данных до их обработки.

Ключевые тенденции в управлении ИИ, за которыми следует следить в 2026 году.

Переход к встроенным в браузер средствам контроля безопасности является доминирующей тенденцией 2026 года. Лидеры в области безопасности отказываются от громоздких сетевых прокси, которые ухудшают пользовательский опыт, и переходят к легковесным расширениям для браузеров. Эти инструменты интегрируются непосредственно в рабочий процесс, позволяя организациям отслеживать контекст запросов, проверять разрешения расширений и скрывать конфиденциальные данные без перенаправления трафика.

Еще одним важным направлением является развитие управления автономными агентами ИИ с учетом их идентификационных данных. Поскольку «агентный ИИ» начинает действовать от имени пользователей, бронируя встречи, создавая код или выполняя запросы к базам данных, статические списки разрешенных действий перестают работать. Стратегии управления развиваются в направлении внедрения ролевого контроля доступа (RBAC), который ограничивает действия агента ИИ в зависимости от конкретных привилегий пользователя и конфиденциальности данных.

10 лучших инструментов управления ИИ на 2026 год

Ниже представлены лучшие решения, обеспечивающие безопасное внедрение ИИ посредством контроля, прозрачности и управления рисками.

| Практика | Ключевой фокус | Лучше всего |

| Layerx | Применение мер на основе браузера | Устранение пробела в обеспечении безопасности на «последней миле». |

| Гармоническая безопасность | Открытие теневого ИИ | Получение полной информации о внедрении ИИ. |

| Быстрая безопасность | Защита от быстрого введения инъекции | Защита взаимодействия с GenAI от неправомерного использования |

| Лассо Безопасность | Ролевое управление доступом | Применение политики с учетом контекста |

| Ночной AI | Предотвращение потери данных (DLP) | Предотвращение утечки персональных данных/интеллектуальной собственности в режиме реального времени. |

| AIM Security | Инвентаризация активов ИИ | Централизованное отслеживание всех инструментов ИИ. |

| ИИ-свидетель | Автоматизированная оценка риска | Упрощение процедуры утверждения безопасных инструментов искусственного интеллекта. |

| Кностик | Ведение журналов аудита и соответствия требованиям | Соблюдение нормативных требований |

| Polymer | Обучение и осведомленность сотрудников | Создание культуры, ориентированной на безопасность |

| Лакера | Непрерывный мониторинг | Выявление аномалий и отклонений в политике |

1. СлойX

LayerX — это платформа безопасности браузера, работающая как легковесное расширение, размещающее средства управления непосредственно там, где пользователи взаимодействуют с ИИ. Она решает проблему «последней мили», отслеживая каждое нажатие клавиши, действие вставки и загрузку файла в режиме реального времени. Это позволяет командам безопасности применять детальные политики, например, блокировать вставку исходного кода в ChatGPT или предотвращать установку расширений ИИ с высоким риском, не нарушая рабочий процесс пользователя и не требуя специального корпоративного браузера.

Платформа превосходно обеспечивает глубокий анализ как санкционированного, так и «теневого» использования ИИ на управляемых устройствах и устройствах BYOD. LayerX анализирует контекст взаимодействия в браузере, чтобы различать безопасные задачи и рискованное поведение, гарантируя, что конфиденциальные корпоративные данные никогда не покинут браузерную среду без защиты. Ее подход позволяет организациям безопасно внедрять инструменты GenAI, снижая риски, такие как утечка данных и захват учетных записей, на уровне источника.

2. Гармоническая безопасность

Компания Harmonic Security сосредоточена на решении проблемы теневого ИИ путем идентификации и классификации каждого инструмента ИИ, используемого сотрудниками, независимо от того, был ли он официально одобрен. Вместо использования статических списков блокировки, Harmonic применяет специализированные небольшие языковые модели для анализа намерений и содержания передаваемых данных. Это позволяет различать безобидные запросы и рискованную загрузку регулируемых данных, обеспечивая «безопасность по умолчанию», которая дает сотрудникам возможность использовать новые инструменты, не подвергая организацию риску.

Платформа создает всеобъемлющую карту внедрения ИИ в масштабах всего предприятия, предоставляя руководителям служб безопасности четкое представление о том, какие подразделения используют какие инструменты. Понимая бизнес-контекст использования ИИ, Harmonic помогает командам разрабатывать политики, поддерживающие инновации, автоматически помечая или блокируя приложения высокого риска, не соответствующие стандартам безопасности.

3. Быстрая безопасность

Компания Prompt Security специализируется на защите от атак с внедрением вредоносного кода (prompt injection attacks) — критической уязвимости, при которой вредоносные входные данные манипулируют поведением GenAI. Их решение отслеживает объектную модель документа (DOM) и пользовательский ввод, чтобы обнаруживать попытки взлома моделей или утечки данных с помощью скрытых команд. Эта специализация делает их важным уровнем защиты для организаций, разрабатывающих или развертывающих общедоступные приложения GenAI, где пользовательскому вводу нельзя полностью доверять.

Помимо защиты от внедрения вредоносного кода, Prompt Security предоставляет инструменты для очистки входных данных и проверки выходных данных, гарантируя, что LLM-ы непреднамеренно не будут генерировать вредоносный контент или раскрывать системные инструкции. Их технология интегрируется в конвейер разработки, помогая инженерным группам защитить свои функции ИИ до того, как они поступят в производство.

4. Lasso Security

Lasso Security предоставляет контекстное управление доступом на основе ролей (RBAC) для GenAI, гарантируя, что пользователи могут получать доступ только к тем моделям и данным, которые соответствуют их конкретным должностным обязанностям. Их платформа выходит за рамки простых журналов доступа, обеспечивая соблюдение политик на основе личности пользователя, конфиденциальности данных и предполагаемого сценария использования. Такой детальный контроль предотвращает «расширение доступа», когда сотрудники сохраняют доступ к мощным инструментам ИИ, которые им больше не нужны.

Решение также отслеживает аномалии в режиме реального времени, например, когда сотрудник отдела маркетинга внезапно запрашивает у помощника программиста учетные данные для доступа к базе данных. Сопоставляя идентификационные данные пользователя с моделями поведения, Lasso помогает организациям выявлять и предотвращать внутреннее неправомерное использование инструментов ИИ до того, как это приведет к утечке данных.

5. Искусственный интеллект «Ночной закат»

Компания Nightfall AI внедряет передовые технологии предотвращения потери данных (DLP) в эпоху искусственного интеллекта, используя детекторы машинного обучения, обученные на миллионах образцов, для высокоточной идентификации конфиденциальных данных. Их решение сканирует данные в движении и в состоянии покоя, обнаруживая персональные данные, медицинские записи и секретную информацию, такую как ключи API, прежде чем они будут загружены на платформы GenAI. Детекторы Nightfall настроены на понимание контекста, что значительно снижает количество ложных срабатываний по сравнению с традиционными инструментами DLP на основе регулярных выражений.

В целях управления ИИ Nightfall интегрируется с рабочими процессами браузера и облака, позволяя в режиме реального времени редактировать или блокировать конфиденциальную информацию. Эта возможность дает сотрудникам возможность использовать инструменты повышения производительности, такие как чат-боты, обеспечивая при этом строгое соблюдение требований GDPR и HIPAA, даже в неструктурированных запросах.

6. AIM Security

Компания AIM Security специализируется на создании полного реестра активов ИИ, фактически выступая в качестве «спецификации компонентов ИИ» для предприятия. Их платформа сканирует ИТ-среду, чтобы обнаружить все развернутые модели, обучающие наборы данных и интегрированные с ИИ приложения. Этот централизованный обзор позволяет группам безопасности отслеживать жизненный цикл каждого актива ИИ, от приобретения до вывода из эксплуатации, гарантируя, что ни одна «зомби-модель» не останется работающей без контроля.

Поддерживая инвентаризацию в режиме реального времени, AIM Security помогает организациям выявлять зависимости и потенциальные риски в цепочке поставок. Если обнаруживается уязвимость в конкретной модели с открытым исходным кодом, администраторы могут мгновенно найти каждый экземпляр этой модели в своей инфраструктуре и применить необходимые исправления или меры по устранению уязвимостей.

7. Станьте свидетелем искусственного интеллекта

Witness AI предоставляет автоматизированную оценку рисков для упрощения процесса оценки и утверждения новых инструментов искусственного интеллекта. Их платформа присваивает приложениям динамический балл риска на основе их условий обслуживания, методов обработки данных и сертификатов соответствия. Это позволяет группам безопасности быстро проверять запросы на новое программное обеспечение, заменяя длительные ручные проверки решениями, основанными на данных.

Платформа также постоянно отслеживает уровень риска, связанный с утвержденными инструментами, и оповещает администраторов, если поставщик меняет свою политику конфиденциальности или сталкивается с инцидентом безопасности. Эта постоянная оценка гарантирует, что список утвержденного программного обеспечения организации остается точным и безопасным с течением времени.

8. Кностик

Knostic решает проблему аудита и авторизации, точно регистрируя, кто и к каким данным получает доступ в системах искусственного интеллекта организации. Их решение отвечает на вопрос «необходимости знать», гарантируя, что инструменты GenAI не обходят существующие разрешения на доступ к файлам и не предоставляют доступ к конфиденциальным документам неавторизованным пользователям. Knostic генерирует подробные журналы аудита, которые сопоставляют запросы с конкретными документами, использованными для получения ответа.

Такой уровень прозрачности жизненно важен для регулируемых отраслей, которые должны демонстрировать строгий контроль над потоком информации. Система авторизации Knostic предотвращает «утечку знаний», когда магистр права непреднамеренно раскрывает конфиденциальные стратегические решения или данные отдела кадров сотрудникам, которые не должны иметь доступа к этой информации.

9. Полимер

Polymer применяет человекоцентричный подход к управлению, используя «подсказки» и обучение в реальном времени для формирования культуры, ориентированной на безопасность. Вместо того чтобы просто блокировать рискованное действие, система Polymer вмешивается, выдавая всплывающее окно с объяснением. почему Предложенное действие рискованно и предполагает более безопасную альтернативу. Такое обучение «в режиме реального времени» помогает снизить усталость от оповещений и побуждает сотрудников активно участвовать в процессе обеспечения безопасности.

Их платформа особенно эффективна для организаций, стремящихся снизить нагрузку на свои команды SOC. Предоставляя пользователям возможность самостоятельно исправлять ошибки низкого риска, Polymer позволяет аналитикам безопасности сосредоточиться на реальных угрозах, одновременно постоянно улучшая общие навыки обработки данных в организации.

10. Лакера

Компания Lakera специализируется на непрерывном мониторинге и «тестировании на проникновение» для приложений ИИ с целью обнаружения отклонений от правил и враждебных атак. Их платформа Lakera Guard выступает в качестве брандмауэра для моделей ИИ, располагаясь между пользователем и моделью и отфильтровывая внезапные внедрения, взломы и токсичные входные данные. Это непрерывное тестирование гарантирует, что модели ИИ остаются в соответствии с рекомендациями по безопасности, даже когда злоумышленники совершенствуют свои методы.

Компания Lakera также предоставляет базу данных известных запросов и векторов атак, позволяя организациям оценивать эффективность своей защиты от новейших угроз. Такой проактивный подход помогает разработчикам выявлять слабые места в своих приложениях на основе ИИ до их развертывания в производственной среде, снижая риск сбоя в системе общественной безопасности.

Как выбрать лучшего поставщика услуг по управлению ИИ

- Уделите первостепенное внимание изучению «теневого ИИ», чтобы понять весь спектр неуправляемых инструментов, которые уже используют ваши сотрудники.

- Выберите решение с функцией принудительного применения защиты непосредственно в браузере, чтобы защитить данные в точке ввода без перенаправления трафика через сложные прокси-серверы.

- Убедитесь, что инструмент предлагает детальные средства управления на основе идентификации пользователей, позволяющие устанавливать различные уровни доступа для разработчиков, отдела кадров и отдела маркетинга.

- Ищите возможности автоматического устранения неполадок, позволяющие редактировать конфиденциальные данные в режиме реального времени, а не просто блокировать всё приложение.

- Убедитесь, что поставщик поддерживает непрерывный аудит соответствия нормативным стандартам, таким как ISO 42001 и Закон ЕС об искусственном интеллекте.

Часто задаваемые вопросы (FAQ)

Что такое управление ИИ с точки зрения практической безопасности?

На практике управление ИИ представляет собой набор технических средств контроля и политик, определяющих, как сотрудники и приложения взаимодействуют с генеративным ИИ. Оно включает в себя мониторинг запросов на предоставление конфиденциальных данных, проверку уровня безопасности поставщиков ИИ и обеспечение точности и безопасности результатов, генерируемых ИИ.

Чем управление ИИ отличается от обеспечения безопасности моделей ИИ?

Безопасность моделей ИИ сосредоточена на защите весов, параметров и инфраструктуры самой модели от кражи или несанкционированного изменения. Управление ИИ имеет более широкий охват и фокусируется на пользования модели; обеспечение соответствия данных, поступающих в нее, авторизации пользователей, получающих к ней доступ, и управления бизнес-рисками, связанными с ее внедрением.

Что следует контролировать в первую очередь: подсказки, файлы или доступ к инструментам?

В первую очередь следует контролировать видимость и доступ к инструментам. Вы не можете управлять тем, чего не видите, поэтому определение используемых инструментов (теневой ИИ) является основополагающим шагом. После того, как видимость будет установлена, можно внедрить механизмы контроля для подсказок и загрузки файлов, чтобы предотвратить утечку данных.

Нужен ли нам специальный корпоративный браузер для управления ИИ?

Нет, вам не нужен специальный корпоративный браузер. Современные платформы безопасности для браузеров, такие как LayerX, функционируют как расширения, которые устанавливаются поверх стандартных браузеров, таких как Chrome и Edge. Это позволяет применять средства управления и безопасности корпоративного уровня, не заставляя пользователей переходить на новый, незнакомый интерфейс браузера.

Как измерить эффективность управления ИИ?

Эффективность оценивается по сокращению числа инцидентов с использованием «теневого ИИ», скорости утверждения новых безопасных инструментов и количеству предотвращенных утечек данных. Успешность управления также следует отслеживать по показателям внедрения пользователями; если сотрудники обходят средства контроля для выполнения своих обязанностей, стратегию управления необходимо скорректировать.