Интегрирането на генеративния изкуствен интелект (GenAI) в корпоративните работни процеси представлява монументален скок в производителността. Инструменти като Gemini на Google са начело на тази трансформация, предлагайки разширени възможности за създаване на съдържание, анализ на данни и решаване на сложни проблеми. Тази мощ обаче въвежда нови и значителни предизвикателства пред сигурността. Потенциалът за нарушение на данните чрез Gemini е основна грижа за анализаторите по сигурността и CISO, които сега са натоварени със задачата да защитават корпоративните активи в разширена дигитална екосистема. Разбирането на механизмите на това как може да се случи подобно нарушение е първата стъпка към изграждането на устойчива защита.

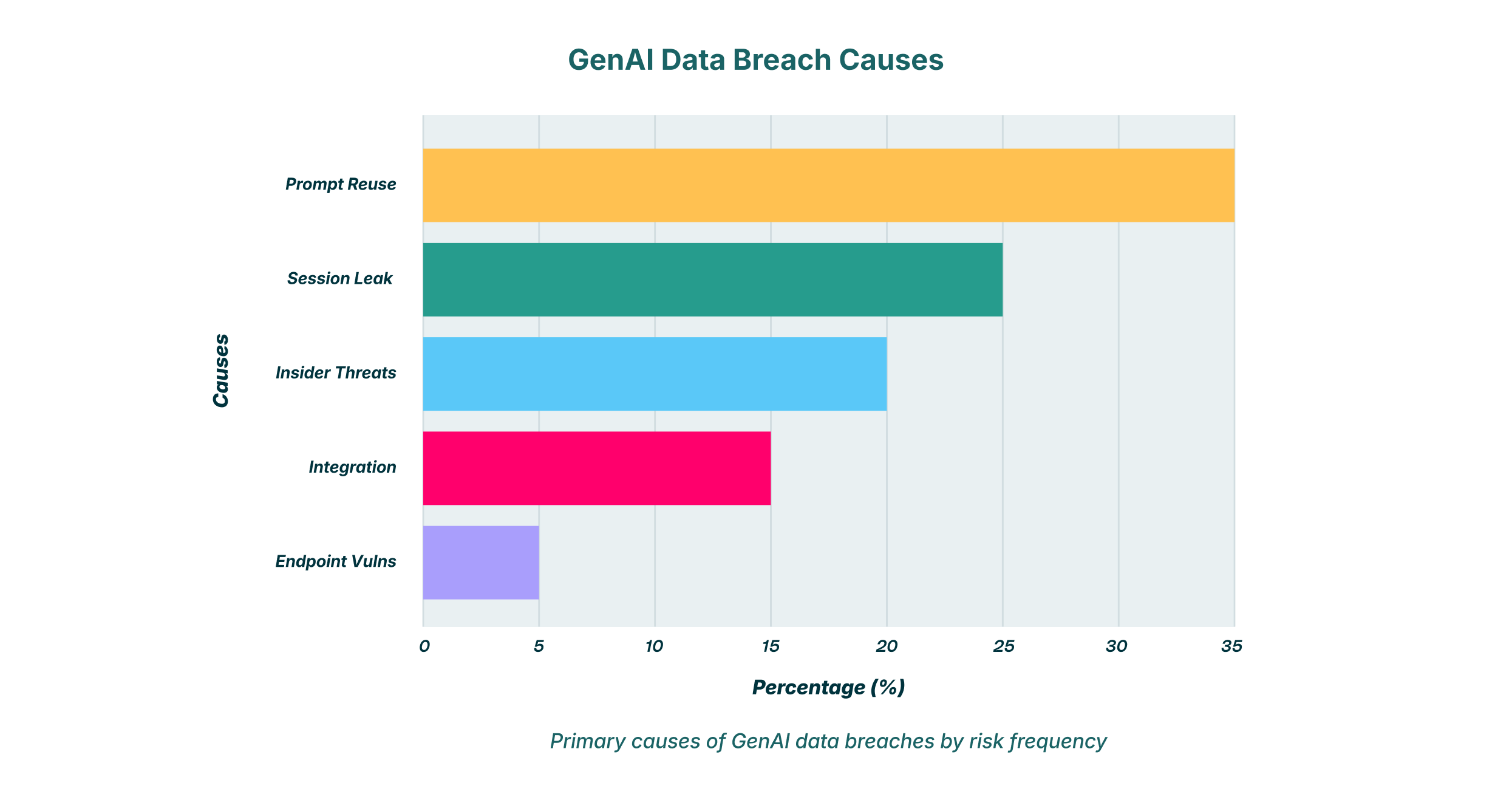

Тази статия изследва инцидентите и уязвимостите, свързани с употребата на Gemini в предприятията, като се фокусира върху причини като уязвимости за бързо повторно използване и изтичане на сесии. Ще анализираме потенциалното въздействие на нарушение на AI и ще очертаем критичните поуки за организациите, които се стремят да се възползват от предимствата на GenAI, без да се поддават на рисковете. Централният въпрос, който изследваме, не е само дали може да се случи изтичане на данни от Gemini, но и какви проактивни мерки, включително надежден DLP и контрол на достъпа, могат да бъдат приложени, за да се предотврати това.

Анатомията на нарушението на сигурността на Gemini

Пробивът в сигурността на Gemini не е задължително да бъде катастрофално събитие, организирано от сложен външен хакер. По-често това е тихо, бавно изтичане на чувствителна информация, произтичащо от легитимно, макар и рисковано, потребителско поведение. Основният вектор на заплахата е взаимодействието между служител и самата платформа GenAI. Всяко въведено подкани и всеки качен файл е потенциална точка на излагане на данни.

Представете си маркетинг мениджър, който използва Gemini, за да обобщи бележки от поверителна среща за стратегия за сливания и придобивания. Той поставя целия препис от срещата в подканата, като моли изкуствения интелект да обобщи ключовите действия. В този момент чувствителни подробности за финанси, персонал и корпоративна стратегия се прехвърлят в облачна среда на трета страна. Без подходящ контрол тези данни биха могли да бъдат използвани за обучение на модела, да бъдат запазени в дневници на разговори или потенциално да бъдат изложени на риск чрез уязвимост в платформата.

Няколко ключови уязвимости могат да доведат до значително изтичане на данни, когато служителите използват инструменти на GenAI като Gemini.

Бърза повторна употреба и обучение на модели

Един от най-обсъжданите рискове е бързото повторно използване, при което данните, предоставени от потребителите, се включват в набора от данни за обучение на LLM. Докато големи доставчици като Google имат политики срещу използването на данни, предоставени от API, за обучение на своите публични модели, политиките за публичните, потребителски версии на тези инструменти могат да бъдат различни. Служител, използващ личен акаунт в Gemini на корпоративно устройство, може неволно да предостави чувствителна информация към базата знания на модела. Тази информация теоретично може да се появи в заявка на друг потребител, което да доведе до непредсказуемо и необратимо изтичане на данни от Gemini.

Изтичане на сесия и отвличане на данни

Изтичането на сесия е по-техническа, но също толкова опасна уязвимост. Ако сесията на служител с Gemini бъде компрометирана чрез злонамерено разширение на браузъра, несигурна Wi-Fi мрежа или фишинг атака, нападателят може да получи достъп до цялата история на разговорите. Тази история може да съдържа съкровищница от чувствителни данни, споделяни в продължение на седмици или месеци. Лекотата, с която съвременният зловреден софтуер може да извършва отвличане на сесии, прави това критичен вектор на заплаха за всяко уеб-базирано приложение, включително GenAI платформи.

Вътрешни заплахи и несанкционирана употреба

Рискът не винаги е външен. Недоволен служител може умишлено да измъкне данни, като ги въведе в Gemini и след това да получи достъп до тях от лично устройство. По-често заплахата е случайна. Добронамерен служител, несъзнаващ рисковете, може да използва Gemini за задачи, включващи лична информация (PII), интелектуална собственост или изходен код, създавайки скрит ИТ проблем, който традиционните инструменти за сигурност не могат да видят или контролират. Това несанкционирано използване на GenAI е основен двигател зад съвременния пробив в изкуствения интелект.

Критичният въпрос: Изтича ли данни от Gemini?

И така, изтича ли данни от Gemini? Отговорът е нюансиран. По дизайн Gemini има надеждни контроли за сигурност, а Google инвестира сериозно в защитата на своята инфраструктура. Самата платформа не е по своята същност „течаща“. Рискът от изтичане обаче е фундаментално обвързан с нейното използване. Без специално разработени защитни наслагвания, всеки мощен инструмент може да бъде използван неправилно. Основните канали за изтичане на данни са:

- Потребителски вход: Служители, които поставят чувствителен текст или качват поверителни документи.

- Рискове за интеграция: Несигурни връзки между Gemini API и други корпоративни приложения.

- Уязвимости на крайните точки: Компрометирани браузъри или устройства, които излагат потребителските сесии на атакуващи.

Следователно, отговорността за предотвратяване на изтичане на данни от Gemini е споделена. Докато доставчикът осигурява платформата, предприятието трябва да осигури как неговите служители и системи взаимодействат с нея.

Превенция и смекчаване: Модерен подход към сигурността на ИИ

Предотвратяването на пробив в сигурността на Gemini изисква преминаване отвъд традиционната мрежова сигурност и внедряване на решения, които осигуряват видимост и контрол директно в точката на взаимодействие: браузъра. Именно тук платформата за откриване и реагиране на браузъри (BDR), като например разширението Enterprise Browser Extension на LayerX, става от съществено значение.

Критична стъпка е внедряването на DLP решение, което разбира контекста на взаимодействията на GenAI. Остарелите DLP инструменти често имат проблеми с уеб трафика и API. Едно съвременно решение трябва да може да:

- Мониторинг на подканите: Анализиране на съдържанието на подканите в реално време за откриване и блокиране на подаването на чувствителни данни, като например лични данни, финансова информация или ключови думи от поверителен проект.

- Контролиране на качването на файлове: Предотвратяване на качването на чувствителни документи в Gemini от страна на служителите.

- Прилагане на политиката: Прилагане на предпазни мерки, базирани на риска, които могат например да позволяват общи заявки, но да блокират изпращането на съдържание, съответстващо на предварително дефиниран модел на данни.

Намаляване на рисковете, базирани на сесии

За да се справят със заплахата от изтичане на данни от сесия, екипите по сигурността се нуждаят от видимост върху активността на браузъра. Разширението за корпоративен браузър може да идентифицира и блокира злонамерени разширения, които се опитват да отвлекат сесии, да предупреждава за подозрителна активност на скриптове в раздела Gemini и да гарантира, че всички взаимодействия се извършват в наблюдавана и сигурна среда. Това осигурява ключов слой защита срещу атаки, базирани на крайни точки, насочени към инструментите на GenAI.

Открийте и защитете Shadow AI

Служителите неизбежно ще използват комбинация от санкционирани и несанкционирани инструменти за изкуствен интелект. Цялостната стратегия за сигурност трябва да включва откриването на това използване на „скрит изкуствен интелект“. Чрез наблюдение на цялата активност в браузъра, организациите могат да идентифицират кои служители използват Gemini (и други инструменти на GenAI), независимо дали използват корпоративни или лични акаунти и какъв риск представлява това използване. Тази видимост позволява на ИТ екипите и екипите по сигурност да прилагат последователни политики във всички приложения, санкционирани или не.

Поуки, извлечени за сигурно бъдеще на GenAI

Възходът на инструменти като Gemini не е задължително да е източник на безпокойство за сигурността. Чрез възприемане на модерна, ориентирана към потребителя стратегия за сигурност, организациите могат да насърчат иновациите, като същевременно защитават най-ценните си активи. Ключовите уроци са ясни:

- Приемете риск, обусловен от потребителя: Основната заплаха от събитие, свързано с излагане на данни, идва от действията на потребителя. Стратегиите за сигурност трябва да се фокусират върху наблюдението и контролирането на взаимодействието между потребителя и приложението.

- Контекстът е всичко: Инструментите за сигурност трябва да разбират разликата между доброкачествена заявка и подаване на данни с висок риск. Контекстно-осъзнатата DLP защита е неоспорима за защитата на GenAI.

- Браузърът е новата крайна точка: С преместването на приложенията в мрежата, браузърът се превърна в централна точка на риск и контрол. Защитата на браузъра е защита на предприятието.

Предотвратяването на нарушение на ИИ е свързано с това да се даде възможност на служителите да използват мощни инструменти безопасно. Това изисква стратегическа промяна от блокиране на достъпа към управление на употребата с интелигентни, подробни контроли. С правилния подход организациите могат уверено да прегърнат бъдещето на работата, задвижвано от GenAI и защитено от проактивна и адаптивна защита.