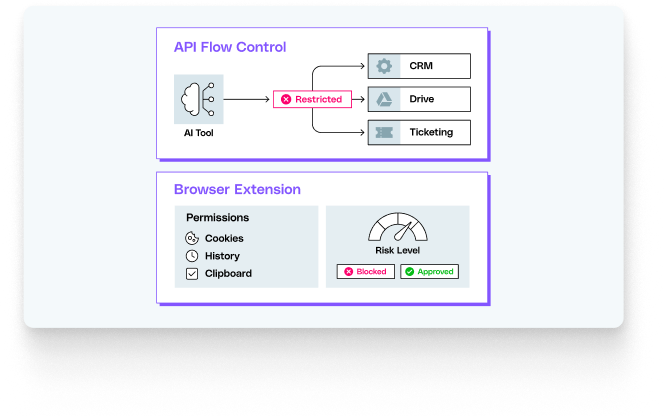

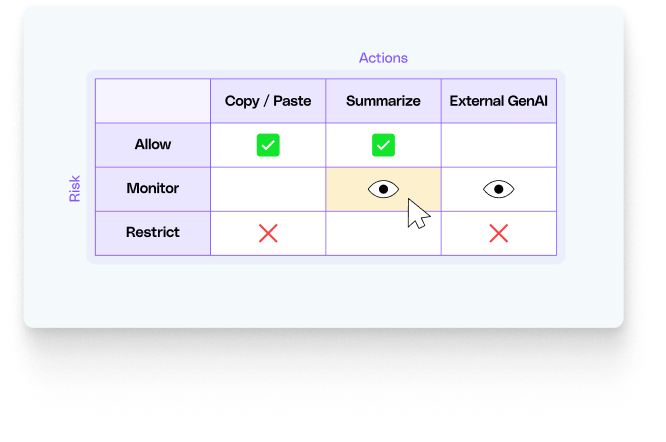

Pro implementaci tohoto druhu detailního, kontextově orientovaného zabezpečení se organizace stále častěji obracejí k řešením, jako je LayerX. Díky přímému provozu v prohlížeči poskytuje LayerX hluboký přehled a kontrolu v reálném čase potřebnou pro řízení moderních rizik umělé inteligence.

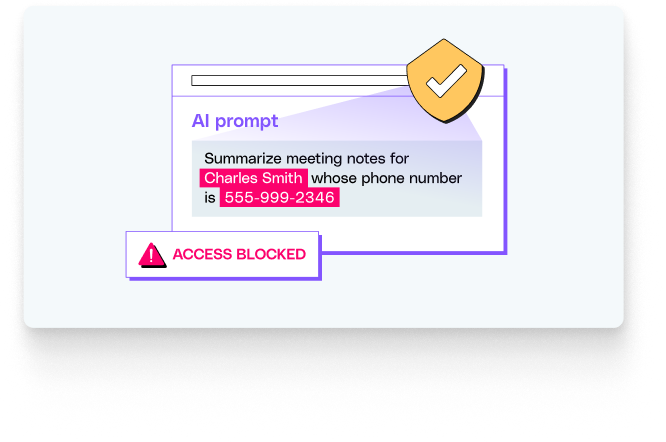

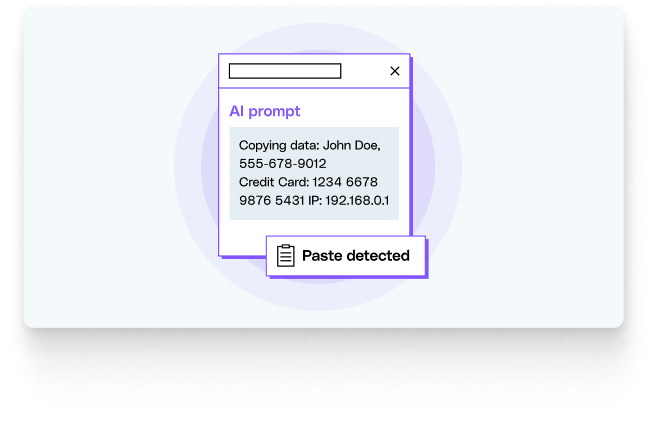

Představte si scénář, kdy marketingový pracovník používá neautorizovaný nástroj umělé inteligence k vytvoření tiskové zprávy. Pokusí se vložit dokument obsahující neohlášené finanční údaje a jména zákazníků. Tradiční bezpečnostní řešení by tuto akci pravděpodobně nedetekovalo. Řešení na úrovni prohlížeče, jako je LayerX, však dokáže: