Efektivní zabezpečení nyní vyžaduje, abychom kontrolovali, jak zaměstnanci interagují s generativními modely, nejen s modely samotnými. 10 nejlepších postupů správy umělé inteligence pro rok 2026 se zaměřuje na zabezpečení „poslední míle“ přijetí uživateli, kdy data opouštějí podnik a vstupují do prohlížeče.

Co jsou postupy správy umělé inteligence a proč jsou důležité

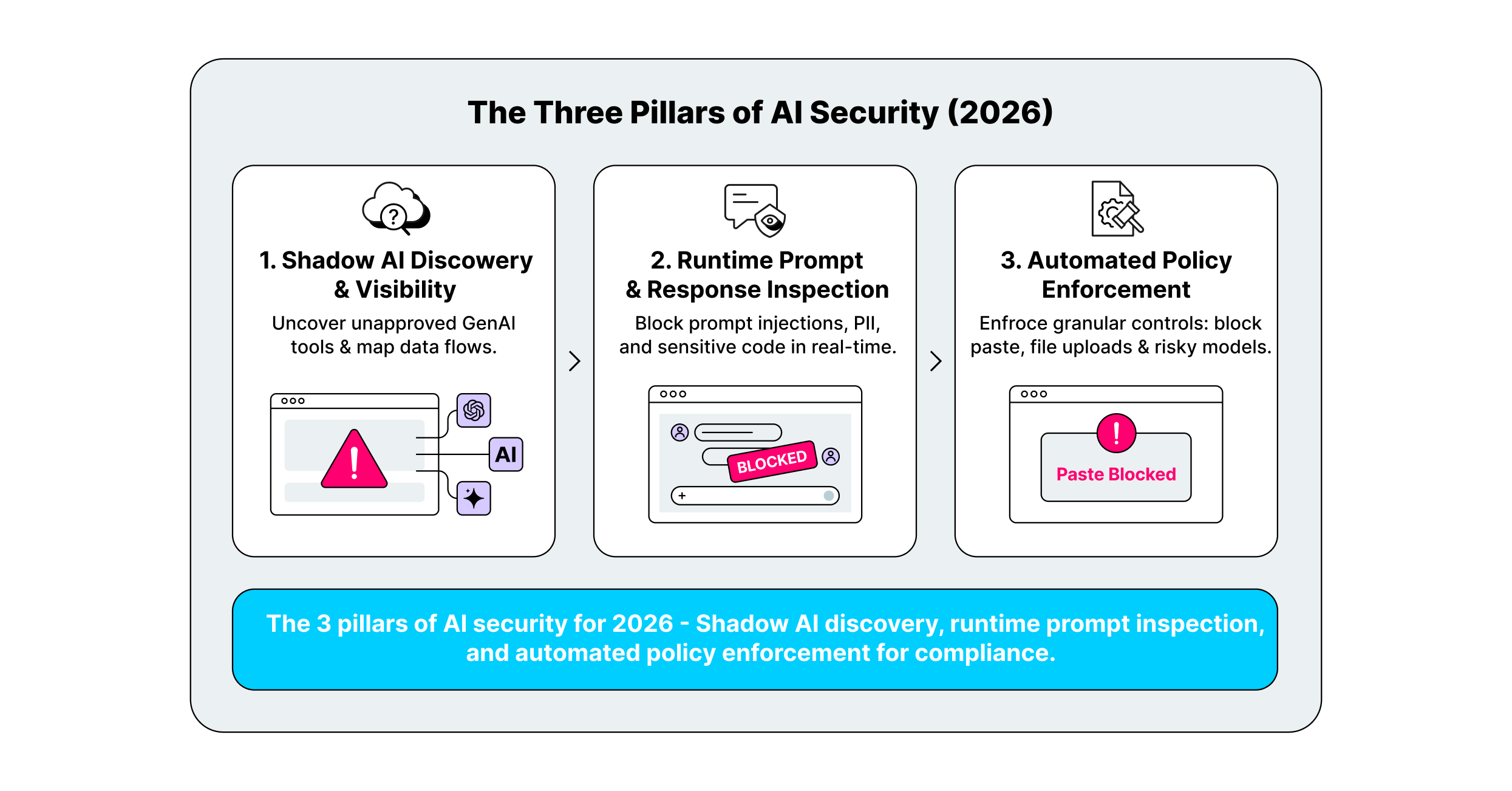

Řízení AI již není teoretickým rámcem; je to aktivní bezpečnostní pracovní postup určený k řízení rizik generativní spotřeby AI. Tyto postupy přesouvají pozornost z ověřování vah modelů na kontrolu „bodu použití“. Bezpečnostní týmy nyní musí řídit přesný okamžik, kdy zaměstnanec vloží zákaznická data do chatbota nebo nainstaluje rozšíření prohlížeče s využitím AI.

Nejkritičtější mezerou v moderní správě a řízení je „poslední míle“; rozhraní prohlížeče, kde uživatelé interagují s nástroji SaaS a GenAI. Tradiční síťová obrana nevidí šifrovaný provoz v rámci chatovací relace a ovládací prvky založené na API často reagují příliš pozdě. Efektivní správa a řízení vyžaduje viditelnost v reálném čase a vynucování přímo v pracovním prostoru zaměstnance, aby se zabránilo úniku dat a blokovaly se škodlivé vstupy před jejich zpracováním.

Klíčové trendy v oblasti správy umělé inteligence, které je třeba sledovat v roce 2026

Posun směrem k nativním bezpečnostním kontrolám prohlížeče je dominantním trendem pro rok 2026. Bezpečnostní lídři se odklánějí od neohrabaných síťových proxy serverů, které narušují uživatelský zážitek, a směřují k lehkým rozšířením prohlížeče. Tyto nástroje jsou integrovány přímo do pracovního postupu a umožňují organizacím sledovat kontext výzvy, kontrolovat oprávnění rozšíření a redigovat citlivá data bez přesměrování provozu.

Dalším významným vývojem je vzestup správy a řízení autonomních agentů s umělou inteligencí s ohledem na identitu. Vzhledem k tomu, že „agentská umělá inteligence“ začíná jednat jménem uživatelů, plánovat schůzky, psát kód nebo dotazovat databáze, statické seznamy povolených selhávají. Strategie správy a řízení se vyvíjejí s cílem vynutit řízení přístupu na základě rolí (RBAC), které omezuje, co může agent umělé inteligence dělat, na základě specifických oprávnění uživatele a citlivosti dat.

10 nejlepších nástrojů pro správu umělé inteligence pro rok 2026

Níže uvádíme nejlepší řešení umožňující bezpečné zavádění umělé inteligence prostřednictvím vynucování předpisů, viditelnosti a řízení rizik.

| Praxe | Klíčové zaměření | Nejlepší pro |

| LayerX | Vynucování v prohlížeči | Zamezení bezpečnostní mezery „poslední míle“ |

| Harmonická bezpečnost | Objevování stínové umělé inteligence | Získání plného přehledu o zavádění umělé inteligence |

| Okamžité zabezpečení | Obrana proti okamžité injekci | Zabezpečení interakcí GenAI před zneužitím |

| Lasso Security | Řízení přístupu na základě rolí | Vynucování zásad s ohledem na kontext |

| Soumrak AI | Prevence ztráty dat (DLP) | Prevence úniku PII/IP v reálném čase |

| Zabezpečení AIM | Inventář aktiv umělé inteligence | Centralizované sledování všech nástrojů umělé inteligence |

| Svědek AI | Automatizované hodnocení rizik | Zjednodušení schvalování bezpečných nástrojů umělé inteligence |

| Knostický | Protokolování auditu a dodržování předpisů | Splnění regulačních požadavků |

| Polymer | Školení a povědomí zaměstnanců | Budování kultury s uvědoměním si bezpečnosti |

| Lakera | Průběžné sledování | Detekce anomálií a odchylek od zásad |

1. VrstvaX

LayerX je platforma pro zabezpečení prohlížečů, která funguje jako odlehčené rozšíření a umisťuje ovládací prvky správy přímo tam, kde uživatelé interagují s umělou inteligencí. Řeší „poslední míli“ tím, že monitoruje každý stisk klávesy, akci vkládání a nahrávání souboru v reálném čase. To umožňuje bezpečnostním týmům vynucovat detailní zásady, jako je blokování vkládání zdrojového kódu do ChatGPT nebo zabránění instalaci vysoce rizikových rozšíření umělé inteligence, aniž by to narušilo pracovní postup uživatele nebo vyžadovalo specializovaný podnikový prohlížeč.

Platforma vyniká v poskytování hlubokého přehledu o používání schválené i „stínové umělé inteligence“ napříč spravovanými zařízeními a zařízeními BYOD. LayerX analyzuje kontext interakcí v prohlížeči, aby rozlišil mezi bezpečnými úkoly a rizikovým chováním, a zajišťuje tak, aby citlivá firemní data nikdy nenechala prostředí prohlížeče nechráněné. Její přístup umožňuje organizacím bezpečně zavádět nástroje GenAI tím, že zmírňuje rizika, jako je únik dat a převzetí kontroly nad účty u zdroje.

2. Harmonická bezpečnost

Společnost Harmonic Security se zaměřuje na řešení problému stínové umělé inteligence identifikací a kategorizací všech nástrojů umělé inteligence, které zaměstnanci používají, bez ohledu na to, zda byly formálně schváleny. Místo spoléhání se na statické seznamy blokovaných dat používá Harmonic specializované modely malých jazyků k analýze záměru a obsahu přenosů dat. To jí umožňuje rozlišovat mezi neškodným dotazem a riskantním nahráváním regulovaných dat, což umožňuje „bezpečný výchozí stav“, který zaměstnancům umožňuje používat nové nástroje, aniž by organizaci vystavovala riziku.

Platforma vytváří komplexní mapu zavádění umělé inteligence v celém podniku a poskytuje vedoucím pracovníkům v oblasti bezpečnosti jasný přehled o tom, která oddělení používají které nástroje. Díky pochopení obchodního kontextu používání umělé inteligence pomáhá Harmonic týmům navrhovat zásady, které podporují inovace, a zároveň automaticky označuje nebo blokuje vysoce rizikové aplikace, které nesplňují bezpečnostní standardy.

3. Okamžité zabezpečení

Společnost Prompt Security se specializuje na ochranu před útoky typu Prompt Injection, což je kritická zranitelnost, kdy škodlivé vstupy manipulují s chováním GenAI. Jejich řešení monitoruje model objektů dokumentů (DOM) a uživatelské vstupy, aby detekovalo pokusy o jailbreak modelů nebo únik dat pomocí skrytých příkazů. Toto zaměření z nich činí nezbytnou vrstvu obrany pro organizace, které vytvářejí nebo nasazují veřejně přístupné aplikace GenAI, kde nelze plně důvěřovat uživatelským vstupům.

Kromě ochrany proti vniknutí škodlivého obsahu poskytuje Prompt Security nástroje pro sanitizaci vstupů a ověřování výstupů, čímž zajišťuje, že LLM neúmyslně negenerují škodlivý obsah ani neodhalují systémové instrukce. Jejich technologie se integruje do vývojového procesu a pomáhá technickým týmům zabezpečit funkce umělé inteligence předtím, než se dostanou do produkčního prostředí.

4. Lasso Security

Lasso Security poskytuje kontextové řízení přístupu na základě rolí (RBAC) pro GenAI, které zajišťuje, že uživatelé mají přístup pouze k modelům a datům vhodným pro jejich konkrétní pracovní funkci. Jejich platforma jde nad rámec jednoduchých protokolů přístupu a vynucuje zásady založené na identitě uživatele, citlivosti dat a zamýšleném případu použití. Tato detailní kontrola zabraňuje „plížení přístupu“, kdy si zaměstnanci ponechávají přístup k výkonným nástrojům umělé inteligence, které již nepotřebují.

Řešení také monitoruje anomálie v reálném čase, například když se marketingový pracovník náhle dotáže asistenta kódování na přihlašovací údaje k databázi. Díky korelaci identity uživatele s behaviorálními vzorci pomáhá Lasso organizacím odhalit a zastavit interní zneužívání nástrojů umělé inteligence dříve, než povedou k úniku dat.

5. Soumrak AI

Nightfall AI přináší do éry umělé inteligence pokročilou prevenci ztráty dat (DLP) pomocí detektorů strojového učení trénovaných na milionech vzorků k identifikaci citlivých dat s vysokou přesností. Jejich řešení skenuje data v pohybu i v klidu a detekuje PII, zdravotní záznamy a tajné informace, jako jsou klíče API, než jsou nahrány na platformy GenAI. Detektory Nightfall jsou naladěny tak, aby rozuměly kontextu, což výrazně snižuje počet falešně pozitivních výsledků ve srovnání s tradičními nástroji DLP založenými na regulárních výrazech.

Pro správu umělé inteligence se Nightfall integruje s pracovními postupy v prohlížeči a cloudu, aby v reálném čase redigoval nebo blokoval citlivé informace. Tato funkce umožňuje zaměstnancům používat nástroje pro zvýšení produktivity, jako jsou chatboti, a zároveň zajišťuje, že jsou striktně dodržovány předpisy, jako je GDPR a HIPAA, a to i v nestrukturovaných pokynech.

6. Zabezpečení AIM

Společnost AIM Security se zaměřuje na vytváření kompletního inventáře aktiv umělé inteligence, který v podstatě slouží jako „kusovka materiálů umělé inteligence“ pro podnik. Jejich platforma prohledává IT prostředí a vyhledává všechny nasazené modely, trénovací datové sady a aplikace integrované s umělou inteligencí. Tento centralizovaný pohled umožňuje bezpečnostním týmům sledovat životní cyklus každého aktiva umělé inteligence, od pořízení až po vyřazení z provozu, a zajišťuje tak, aby žádné „zombie“ modely neběžely bez dohledu.

Udržováním inventáře v reálném čase pomáhá AIM Security organizacím identifikovat závislosti a potenciální rizika v dodavatelském řetězci. Pokud se zjistí, že konkrétní model s otevřeným zdrojovým kódem má zranitelnost, mohou administrátoři okamžitě najít každou instanci tohoto modelu ve své infrastruktuře a použít potřebné záplaty nebo zmírnění rizik.

7. Svědecká umělá inteligence

Společnost Witness AI poskytuje automatizované hodnocení rizik pro zefektivnění hodnocení a schvalování nových nástrojů umělé inteligence. Jejich platforma přiřazuje aplikacím dynamické skóre rizika na základě jejich podmínek služby, postupů nakládání s daty a certifikací shody s předpisy. To umožňuje bezpečnostním týmům rychle prověřovat požadavky na nový software a nahrazovat zdlouhavé manuální kontroly rozhodováním založeným na datech.

Platforma také průběžně monitoruje rizikovou situaci schválených nástrojů a upozorňuje administrátory, pokud dodavatel změní své zásady ochrany osobních údajů nebo dojde k bezpečnostnímu incidentu. Toto průběžné hodnocení zajišťuje, že seznam schváleného softwaru organizace zůstává v průběhu času přesný a bezpečný.

8. Knostic

Společnost Knostic řeší výzvu auditu a autorizace tím, že přesně zaznamenává, kdo k jakým znalostem v rámci systémů umělé inteligence organizace přistupuje. Jejich řešení odpovídá na otázku „potřeby vědět“ a zajišťuje, že nástroje GenAI neobcházejí stávající oprávnění k souborům a nezobrazují důvěrné dokumenty neoprávněným uživatelům. Knostic generuje podrobné auditní záznamy, které mapují výzvy ke konkrétním dokumentům použitým ke generování odpovědi.

Tato úroveň transparentnosti je zásadní pro regulovaná odvětví, která musí prokazovat přísnou kontrolu nad tokem informací. Autorizační kontroly společnosti Knostic zabraňují „úniku znalostí“, kdy LLM neúmyslně odhalí citlivá strategická rozhodnutí nebo HR data zaměstnancům, kteří by k těmto informacím neměli mít přístup.

9. Polymer

Společnost Polymer zaujímá v řízení systém zaměřený na člověka a využívá „postrčení“ a školení v reálném čase k budování kultury zaměřené na bezpečnost. Místo pouhého blokování riskantní akce systém Polymeru zasahuje pomocí vyskakovacího okna s vysvětlením. proč akce je riskantní a navrhuje bezpečnější alternativu. Toto „okamžité“ vzdělávání pomáhá snižovat únavu z bdělosti a povzbuzuje zaměstnance, aby se aktivně podíleli na bezpečnostním procesu.

Jejich platforma je obzvláště efektivní pro organizace, které chtějí snížit zátěž svých SOC týmů. Tím, že umožňuje uživatelům sami opravovat chyby s nízkým rizikem, umožňuje Polymer bezpečnostním analytikům soustředit se na skutečné hrozby a zároveň neustále zlepšovat celkové návyky organizace při nakládání s daty.

10. Lakera

Lakera se specializuje na nepřetržitý monitoring a „red teaming“ pro aplikace s umělou inteligencí za účelem detekce odchylek od zásad a útoků typu „adversarial“. Jejich platforma Lakera Guard funguje jako firewall pro LLM, který stojí mezi uživatelem a modelem a filtruje prompt injections, jailbreaky a toxické vstupy. Toto nepřetržité testování zajišťuje, že modely umělé inteligence zůstávají v souladu s bezpečnostními pokyny, i když útočníci vyvíjejí své techniky.

Lakera také poskytuje databázi známých výzev a vektorů útoků, což organizacím umožňuje porovnávat jejich obranu s nejnovějšími hrozbami. Tento proaktivní přístup pomáhá vývojářům identifikovat slabiny v jejich aplikacích umělé inteligence před jejich nasazením do produkčního prostředí, čímž snižuje riziko selhání veřejné bezpečnosti.

Jak vybrat nejlepšího poskytovatele správy umělé inteligence

- Upřednostněte přehled o „stínové umělé inteligenci“, abyste pochopili celý rozsah nespravovaných nástrojů, které vaši zaměstnanci již používají.

- Vyberte řešení s nativními prvky vynucování v prohlížeči pro zabezpečení dat v místě vstupu bez směrování provozu přes složité proxy servery.

- Ujistěte se, že nástroj nabízí podrobné ovládací prvky založené na identitě, abyste mohli povolit různé úrovně přístupu pro vývojáře, personální oddělení a marketing.

- Hledejte automatizované funkce pro nápravu, které dokáží v reálném čase odstranit citlivá data, a ne pouze zablokovat celou aplikaci.

- Ověřte, zda poskytovatel podporuje průběžné audity shody s předpisy, aby splňoval regulační standardy, jako je ISO 42001 a zákon EU o umělé inteligenci.

Nejčastější dotazy

Co je správa umělé inteligence (AI governance) z praktického hlediska bezpečnosti?

V praxi je správa umělé inteligence souborem technických kontrol a zásad, které určují, jak zaměstnanci a aplikace interagují s generativní umělou inteligencí. Zahrnuje monitorování výzev k zadávání citlivých dat, ověřování bezpečnostního stavu dodavatelů umělé inteligence a zajištění toho, aby výstupy generované umělou inteligencí byly přesné a bezpečné pro použití.

Jak se liší správa AI od zabezpečení modelu AI?

Zabezpečení modelu AI se zaměřuje na ochranu vah, parametrů a infrastruktury samotného modelu před krádeží nebo manipulací. Řízení AI je širší a zaměřuje se na používání modelu; zajištění toho, aby data do něj vstupující byla v souladu s předpisy, aby k němu přistupující uživatelé byli autorizováni a aby byla řízena obchodní rizika nasazení.

Co bychom měli ovládat nejdříve: výzvy, soubory nebo přístup k nástrojům?

Nejprve byste měli řídit viditelnost a přístup k nástrojům. Nemůžete řídit to, co nevidíte, takže základním krokem je identifikace používaných nástrojů (stínová umělá inteligence). Jakmile je viditelnost nastavena, můžete implementovat ovládací prvky pro výzvy a nahrávání souborů, abyste zabránili úniku dat.

Potřebujeme pro správu umělé inteligence specializovaný podnikový prohlížeč?

Ne, nepotřebujete specializovaný podnikový prohlížeč. Moderní platformy zabezpečení prohlížečů, jako je LayerX, fungují jako rozšíření, která jsou nadřazena standardním prohlížečům, jako jsou Chrome a Edge. To vám umožňuje používat ovládací prvky správy a zabezpečení na podnikové úrovni, aniž byste nutili uživatele přecházet na nové, neznámé rozhraní prohlížeče.

Jak měříte efektivitu správy a řízení umělé inteligence?

Efektivita se měří snížením počtu incidentů „stínové umělé inteligence“, rychlostí schvalování nových bezpečných nástrojů a počtem zabráněných úniků dat. Úspěšná správa a řízení by měla být sledována také mírou přijetí uživateli; pokud zaměstnanci obcházejí kontrolní mechanismy, aby mohli vykonávat svou práci, je třeba strategii správy a řízení upravit.