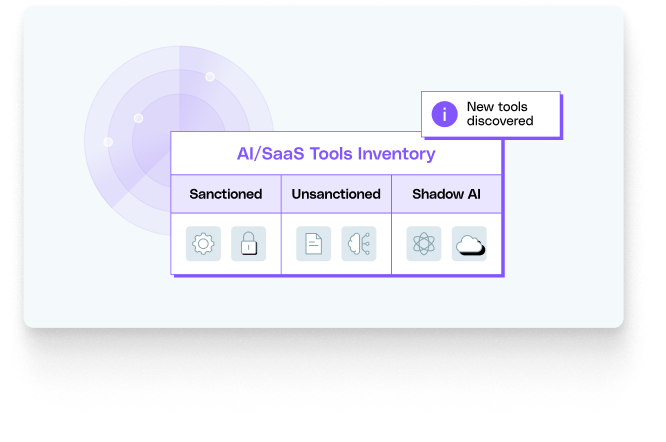

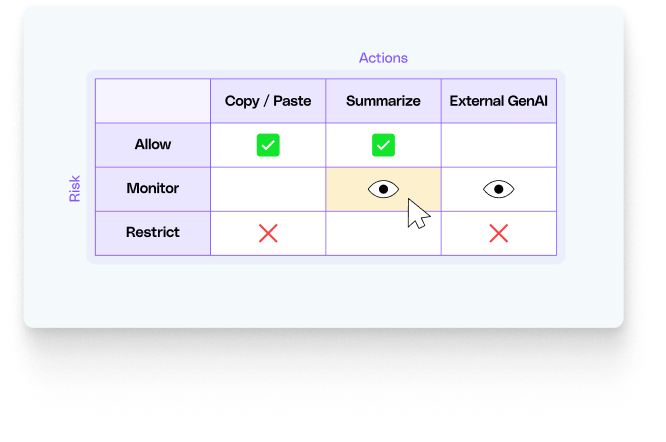

Kako bi implementirale ovu vrstu granularne, kontekstualno svjesne sigurnosti, organizacije se sve više okreću rješenjima poput LayerX-a. Radeći izravno unutar preglednika, LayerX pruža duboku vidljivost i kontrolu u stvarnom vremenu potrebnu za upravljanje modernim rizicima umjetne inteligencije.

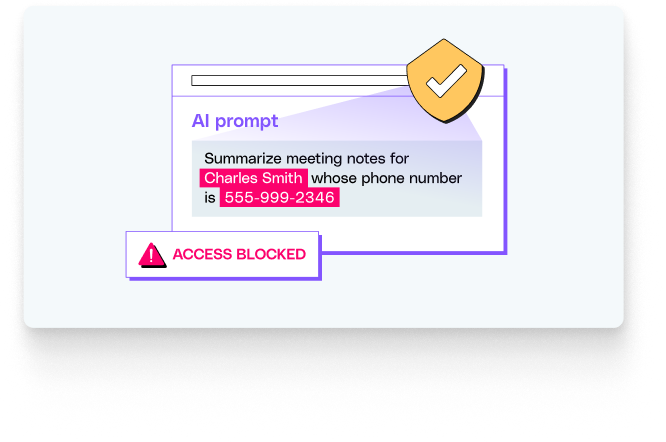

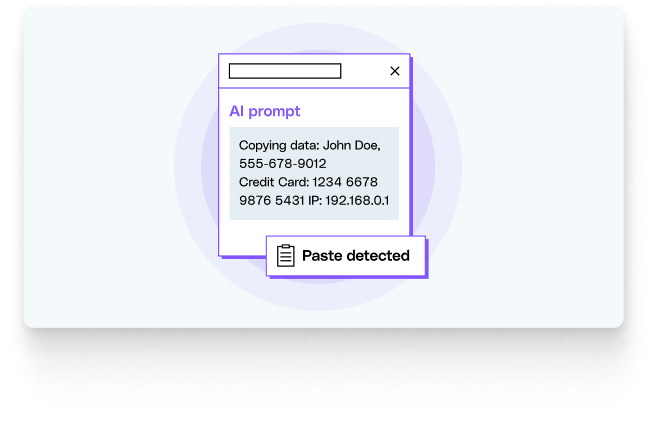

Zamislite scenarij u kojem zaposlenik marketinga koristi neovlašteni alat umjetne inteligencije kako bi pomogao u izradi priopćenja za medije. Pokušava zalijepiti dokument koji sadrži neobjavljene financijske podatke i imena kupaca. Tradicionalno sigurnosno rješenje vjerojatno ne bi primijetilo ovu radnju. Međutim, rješenje na razini preglednika poput LayerX-a može: