Usvajanje generativne umjetne inteligencije preoblikuje poduzeće. Ovi moćni modeli nude neviđeno povećanje produktivnosti, ali ova nova mogućnost dolazi sa značajnim kompromisom: novom i složenom površinom za napad. Organizacije otkrivaju da omogućavanje zaposlenicima da koriste GenAI alate bez odgovarajućeg nadzora izlaže ih kritičnim rizicima, uključujući krađu osjetljivih osobnih podataka, curenje intelektualnog vlasništva i kršenje usklađenosti. Provođenje temeljite procjene rizika umjetne inteligencije temeljni je korak za svaku organizaciju koja želi sigurno iskoristiti snagu umjetne inteligencije.

Mnogi sigurnosni lideri nalaze se u teškoj poziciji. Kako kvantificirati rizike zaposlenika koji lijepi vlasnički kod u javni LLM? Kakav je stvarni utjecaj tima koji se oslanja na alat "shadow AI" koji nije provjeren? Ovaj članak pruža strukturirani pristup odgovoru na ova pitanja. Istražit ćemo praktičan okvir za procjenu rizika umjetne inteligencije, ponuditi primjenjiv predložak, ispitati vrste alata potrebnih za provedbu i opisati najbolje prakse za stvaranje održivog programa upravljanja umjetnom inteligencijom. Proaktivna generativna procjena rizika umjetne inteligencije više nije opcionalna; ona je bitna za sigurne inovacije.

Zašto je specijalizirana procjena sigurnosnog rizika umjetne inteligencije neizbježna

Tradicionalni okviri za upravljanje rizicima nisu bili osmišljeni za jedinstvene izazove koje predstavlja generativna umjetna inteligencija. Interaktivna priroda modela velikih jezika (LLM) zasnovana na crnoj kutiji uvodi dinamične vektore prijetnji s kojima se naslijeđena sigurnosna rješenja teško nose. Specijalizirana procjena sigurnosnog rizika umjetne inteligencije ključna je jer su rizici fundamentalno drugačiji i fluidniji od onih povezanih s konvencionalnim softverom.

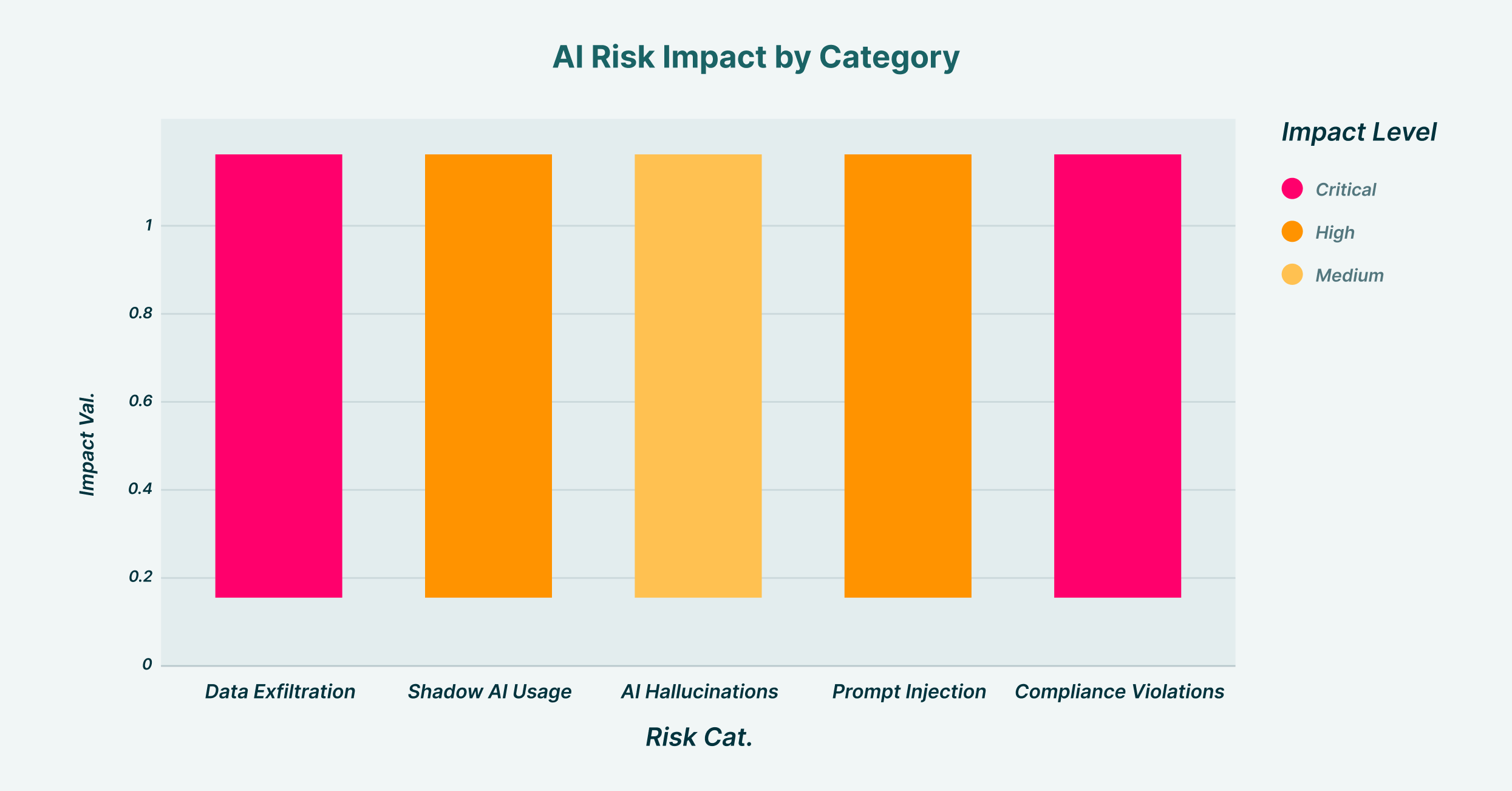

Kategorije rizika umjetne inteligencije prema procjeni razine utjecaja

Ključni izazovi koji zahtijevaju posebnu procjenu uključuju:

- Privatnost podataka i iznuđivanje podataka: Ovo je vjerojatno najneposredniji i najznačajniji rizik. Bez odgovarajućih kontrola, zaposlenici mogu lako kopirati i zalijepiti osjetljive korporativne podatke u javne GenAI platforme. To može uključivati popise kupaca, financijske projekcije, neobjavljeni izvorni kod ili dokumente o strategiji spajanja i preuzimanja. Nakon što se ti podaci dostave javnom LLM-u, organizacija gubi kontrolu nad njima i mogu se koristiti za obuku budućih verzija modela.

- Umjetna inteligencija u sjeni i nesankcionirana upotreba: Pristupačnost alata umjetne inteligencije temeljenih na pregledniku znači da bilo koji zaposlenik može početi koristiti novu aplikaciju bez znanja ili odobrenja IT odjela. Ovaj fenomen „SaaS-a u sjeni“ stvara ogromne sigurnosne slijepe točke. Učinkovita strategija procjene rizika umjetne inteligencije mora započeti otkrivanjem i mapiranjem sve upotrebe umjetne inteligencije u cijeloj organizaciji, a ne samo službeno odobrenih alata.

- Netočni izlazi i „halucinacije“: GenAI modeli mogu proizvesti pouzdane, ali potpuno netočne informacije. Ako zaposlenik koristi AI generirani kod koji sadrži suptilnu manu ili temelji stratešku odluku na izmišljenim podacima, posljedice mogu biti ozbiljne. Ovaj vektor rizika utječe na operativni integritet i kontinuitet poslovanja.

- Ubrizgavanje prompta i zlonamjerna upotreba: Akteri prijetnji aktivno istražuju načine manipuliranja GenAI-jem. Pomoću pažljivo izrađenih prompta, napadač bi mogao prevariti AI alat da generira sofisticirane phishing e-poruke, zlonamjerni softver ili dezinformacije. Zamislite scenarij u kojem se kompromitirani račun zaposlenika koristi za interakciju s internim AI asistentom, upućujući ga da izvuče podatke prikrivajući ih kao rutinsko izvješće.

- Rizici usklađenosti i intelektualnog vlasništva (IP): Snalaženje u pravnom krajoliku umjetne inteligencije je složeno. Korištenje GenAI alata obučenog za materijal zaštićen autorskim pravima moglo bi izložiti organizaciju tužbama za kršenje intelektualnog vlasništva. Nadalje, unošenje podataka o kupcima u LLM bez odgovarajućeg pristanka ili sigurnosnih mjera može dovesti do ozbiljnih kazni prema propisima poput GDPR-a i CCPA-a.

Izgradnja okvira za procjenu rizika umjetne inteligencije

Slučajan pristup sigurnosti umjetne inteligencije osuđen je na propast. Okvir za procjenu rizika umjetne inteligencije pruža sustavan, ponovljiv proces za identificiranje, analizu i ublažavanje prijetnji povezanih s GenAI-jem. Ovaj strukturirani pristup osigurava da se svi potencijalni rizici uzmu u obzir i da se kontrole dosljedno primjenjuju u cijeloj organizaciji.

Sveobuhvatan okvir trebao bi se graditi oko pet ključnih faza:

- Inventar i otkrivanje: Prvi princip sigurnosti je vidljivost. Ne možete zaštititi ono što ne možete vidjeti. Početni korak je stvaranje potpunog inventara svih GenAI aplikacija i platformi koje koriste zaposlenici. To uključuje i alate odobrene od strane tvrtke i shadow AI usluge kojima se pristupa izravno putem preglednika. Ova faza je ključna za razumijevanje pravog opsega AI otiska vaše organizacije.

- Identifikacija i analiza rizika: Nakon što imate popis, sljedeći korak je analiza svake aplikacije kako biste identificirali potencijalne prijetnje. Za svaki alat razmotrite vrste podataka kojima može pristupiti i načine na koje bi se mogli zloupotrijebiti. Na primjer, pomoćnik za kodiranje pokretan umjetnom inteligencijom ima drugačiji profil rizika od generatora slika umjetne inteligencije. Ova analiza trebala bi biti kontekstualna, povezujući alat sa specifičnim poslovnim procesima i osjetljivošću podataka.

- Procjena utjecaja: Nakon identificiranja rizika, morate kvantificirati njihov potencijalni utjecaj na poslovanje. To uključuje procjenu najgoreg scenarija za svaki rizik kroz nekoliko vektora: financijski (npr. regulatorne kazne, troškovi odgovora na incidente), reputacijski (npr. gubitak povjerenja kupaca), operativni (npr. poremećaj poslovanja) i pravni (npr. parnica, kršenje intelektualnog vlasništva). Dodjeljivanje ocjene utjecaja (npr. Visok, Srednji, Nizak) pomaže u određivanju prioriteta rizika koje treba prvo riješiti.

- Dizajn i provedba kontrola: Ovdje se procjena rizika pretvara u djelovanje. Na temelju analize rizika i procjene utjecaja, dizajnirat ćete i implementirati specifične sigurnosne kontrole. To nisu samo politike na polici; to su tehničke zaštitne ograde koje provodi tehnologija. Za GenAI, kontrole mogu uključivati:

- Blokiranje pristupa visokorizičnim, neprovjerenim web stranicama umjetne inteligencije.

- Sprječavanje lijepljenja osjetljivih obrazaca podataka (poput API ključeva, PII-ja ili internih kodnih naziva projekata) u bilo koji GenAI upit.

- Ograničavanje prijenosa datoteka na AI platforme.

- Provođenje dozvola samo za čitanje kako bi se spriječilo slanje podataka.

- Prikaz poruka upozorenja u stvarnom vremenu kako bi se korisnici educirali o rizičnim radnjama.

- Praćenje i kontinuirani pregled: Ekosustav GenAI razvija se nevjerojatnom brzinom. Novi alati i nove prijetnje pojavljuju se tjedno. Procjena rizika umjetne inteligencije nije jednokratni projekt, već kontinuirani životni ciklus. Vaš okvir mora uključivati odredbe za kontinuirano praćenje korištenja umjetne inteligencije i redovite preglede vaših procjena rizika i kontrola kako bi se osigurala njihova učinkovitost.

Vaš predložak za procjenu rizika umjetne inteligencije na temelju kojeg se može djelovati

Za prevođenje teorije u praksu, standardizirani predložak za procjenu rizika umjetne inteligencije neprocjenjiva je prednost. Osigurava da se procjene provode dosljedno u svim odjelima i aplikacijama. Iako jednostavna proračunska tablica može biti početna točka, cilj je stvoriti živi dokument koji informira vašu sigurnosnu poziciju.

Evo primjera predloška koji vaš međufunkcionalni tim za upravljanje umjetnom inteligencijom može prilagoditi i koristiti.

| AI aplikacija | Slučaj poslovne uporabe | Osjetljivost podataka | Identificirani rizik(i) | Vjerojatnost | Utjecaj | Ocjena rizika | Kontrole ublažavanja | Preostali rizik |

| Javni chatGPT-4 | Opće kreiranje sadržaja, sažimanje | Javno, interno (neosjetljivo) | Izbacivanje podataka, Netočni izlazi | visok | Srednji | visok | Blokiranje osjetljivih obrazaca podataka (npr. PII, 'Projekt Phoenix'), obuka korisnika | Nizak |

| Neodobreni PDF analizator | Sažimanje vanjskih izvješća | Nepoznato, potencijalno povjerljivo | Umjetna inteligencija u sjeni, rizik od zlonamjernog softvera, curenje podataka | Srednji | visok | visok | Potpuno blokirajte pristup aplikaciji | N / A |

| GitHub kopilot | Generiranje koda i pomoć | Vlasnički izvorni kod | Curenje IP-a, prijedlozi nesigurnog koda | visok | visok | Kritično | Praćenje aktivnosti, Sprječavanje prijenosa datoteka s ključnim repozitorijima, Skeniranje koda | Srednji |

| Sankcionirani interni LLM | Upiti interne baze znanja | Interno, Povjerljivo | Brza injekcija, prijetnja iznutra | Nizak | Srednji | Nizak | Kontrola pristupa temeljena na ulogama (RBAC), Zapisnici revizije | Nizak |

Ovaj predložak služi kao početna točka za bilo koju generativnu procjenu rizika umjetne inteligencije, prisiljavajući timove da razmisle o specifičnom kontekstu kako se svaki alat koristi i koje su specifične kontrole potrebne za smanjenje rizika na prihvatljivu razinu.

Od ručnih proračunskih tablica do namjenskog alata za procjenu rizika umjetne inteligencije

Iako je ručni predložak za procjenu rizika umjetne inteligencije odličan prvi korak, ima ograničenja. Proračunske tablice su statične, teško ih je održavati u velikim razmjerima i nedostaju im mogućnosti provedbe u stvarnom vremenu. Kako vaša organizacija bude sazrijevala, trebat će vam namjenski alat za procjenu rizika umjetne inteligencije kako biste prešli s reaktivnog na proaktivni sigurnosni stav. Tržište alata za procjenu rizika umjetne inteligencije širi se, ali nisu svi jednaki.

Prilikom procjene alata za procjenu rizika umjetne inteligencije, uzmite u obzir ove kategorije:

- Upravljanje sigurnosnim postavkama SaaS-a (SSPM): Ovi alati su učinkoviti u otkrivanju sankcioniranih SaaS aplikacija i identificiranju pogrešnih konfiguracija. Međutim, često im nedostaje uvid u korištenje "shadow AI" u pregledniku i ne mogu kontrolirati interakcije korisnika unutar same aplikacije.

- Sprječavanje gubitka podataka (DLP): Tradicionalna DLP rješenja mogu se konfigurirati za blokiranje osjetljivih obrazaca podataka, ali im često nedostaje kontekstualno razumijevanje modernih web aplikacija. Mogu imati poteškoća s razlikovanjem legitimne i rizične interakcije unutar GenAI sučelja za chat, što dovodi do lažno pozitivnih rezultata koji remete tijek rada ili propuštenih prijetnji.

- Proširenja preglednika za poduzeća: Ova nova kategorija predstavlja učinkovitiji pristup. Proširenje preglednika usmjereno na sigurnost, poput onog koje nudi LayerX, radi izravno unutar preglednika. To pruža granularnu vidljivost i kontrolu nad aktivnostima korisnika na bilo kojoj web stranici, uključujući GenAI platforme. Ovo rješenje omogućuje sigurnosnim timovima praćenje svih interakcija korisnika, kao što su lijepljenje, slanje obrazaca i prijenosi, te provođenje pravila u stvarnom vremenu. Na primjer, pravilo bi moglo spriječiti zaposlenika da zalijepi tekst identificiran kao "izvorni kod" u javni LLM, učinkovito smanjujući rizik od curenja IP-a bez potpunog blokiranja alata. To čini proširenje preglednika moćnim alatom za implementaciju kontrola definiranih u vašoj procjeni sigurnosnog rizika umjetne inteligencije.

U konačnici, najučinkovitija strategija često uključuje korištenje umjetne inteligencije za procjenu rizika u širem smislu, iskorištavanje inteligentnih alata za automatizaciju otkrivanja i praćenja, uz korištenje rješenja poput LayerX-a za provođenje detaljnih, kontekstualno svjesnih politika u trenutku rizika: pregledniku.

Najbolje prakse za održivi program procjene rizika umjetne inteligencije

Uspješna sigurnosna strategija GenAI-a nadilazi okvire i alate; zahtijeva kulturni pomak i predanost kontinuiranom poboljšanju. Sljedeće najbolje prakse mogu vam pomoći da osigurate da je vaš program procjene rizika umjetne inteligencije i učinkovit i održiv.

- Uspostavite međufunkcionalni odbor za upravljanje umjetnom inteligencijom: Rizik umjetne inteligencije nije samo sigurnosni problem; to je poslovni problem. Vaš tim za upravljanje trebao bi uključivati predstavnike odjela za sigurnost, IT, pravnog odjela, odjela za usklađenost i ključnih poslovnih jedinica. To osigurava da su odluke o rizicima uravnotežene s poslovnim ciljevima i da su politike praktične za provedbu.

- Razviti jasnu politiku prihvatljive upotrebe (PPU): Zaposlenicima su potrebne jasne smjernice. PPU treba izričito navesti koji su alati umjetne inteligencije odobreni, vrste podataka koje je dopušteno koristiti s njima i odgovornosti korisnika za sigurnu upotrebu. Ova politika trebala bi biti izravan rezultat vašeg procesa procjene rizika.

- Dajte prioritet kontinuiranoj edukaciji korisnika: Vaši zaposlenici su prva linija obrane. Obuka bi trebala ići dalje od godišnjih modula o usklađenosti i usredotočiti se na scenarije iz stvarnog svijeta. Koristite „trenutke poučavanja“ u stvarnom vremenu; na primjer, skočno upozorenje kada korisnik pokuša zalijepiti osjetljive podatke, kako biste pojačali sigurno ponašanje.

- Usvojite pristup temeljen na riziku i granularni pristup: Umjesto blokiranja sve umjetne inteligencije, što može ugušiti inovacije, koristite svoju procjenu rizika za primjenu granularnih kontrola. Dopustite slučajeve upotrebe niskog rizika, a istovremeno provodite stroge kontrole nad aktivnostima visokog rizika. Na primjer, dopustite korištenje javnog GenAI alata za marketinške tekstove, ali blokirajte njegovo korištenje za analizu financijskih podataka. Ovaj nijansirani pristup moguć je samo s alatom koji pruža dubok uvid u korisničke radnje.

- Integrirajte tehnologiju za provedbu u stvarnom vremenu: Politika i obuka su bitni, ali sami po sebi nedovoljni. Za provedbu pravila potrebna je tehnologija. Proširenje poslovnog preglednika pruža tehničku osnovu za vaš AUP, prevodeći pisanu politiku u prevenciju u stvarnom vremenu i čineći vašu procjenu rizika umjetne inteligencije aktivnim obrambenim mehanizmom, a ne pasivnim dokumentom.

Osigurajte svoju budućnost utemeljenu na umjetnoj inteligenciji proaktivnim upravljanjem rizicima

Generativna umjetna inteligencija nudi transformativni potencijal, ali sigurno ostvarivanje njezinih prednosti zahtijeva proaktivan i strukturiran pristup upravljanju rizicima. Implementacijom robusnog okvira za procjenu rizika umjetne inteligencije, korištenjem praktičnog predloška i primjenom pravih alata za provedbu, organizacije mogu izgraditi siguran most prema budućnosti potaknutoj umjetnom inteligencijom.

Putovanje počinje s vidljivošću i prelazi na kontrolu. Razumijevanje gdje i kako se GenAI koristi prvi je korak. LayerX pruža ključnu vidljivost i detaljnu kontrolu potrebnu za pretvaranje vaše procjene rizika umjetne inteligencije iz kontrolne liste u dinamičan obrambeni sustav, omogućujući vašoj organizaciji da inovira samouvjereno i sigurno.