Генеративный ИИ коренным образом изменил способы работы организаций. Команды во всех отделах внедряют инструменты, которые обещают ускорить программирование, создание контента и анализ данных. Это быстрое внедрение часто происходит без формального контроля. Сотрудники не ждут разрешения. Они регистрируются в сервисах, используя личные учетные данные, и вставляют конфиденциальные корпоративные данные в общедоступные модели. Это создает огромную, неконтролируемую экосистему «теневого ИИ», которую традиционные межсетевые экраны не могут увидеть или контролировать.

Перед руководителями служб безопасности стоит сложная задача. Полная блокировка ИИ часто нецелесообразна и подавляет инновации. Предоставление неограниченного доступа ведет к утечке данных и нарушениям нормативных требований. Решение заключается в хорошо структурированной корпоративной политике в отношении ИИ. Этот документ служит краеугольным камнем вашей стратегии управления. Он определяет правила взаимодействия. Он устанавливает четкие границы для того, какие данные могут быть переданы и какие инструменты допустимы. Без этой структуры ваша организация остается уязвимой для утечки данных, штрафов со стороны регулирующих органов и кражи интеллектуальной собственности.

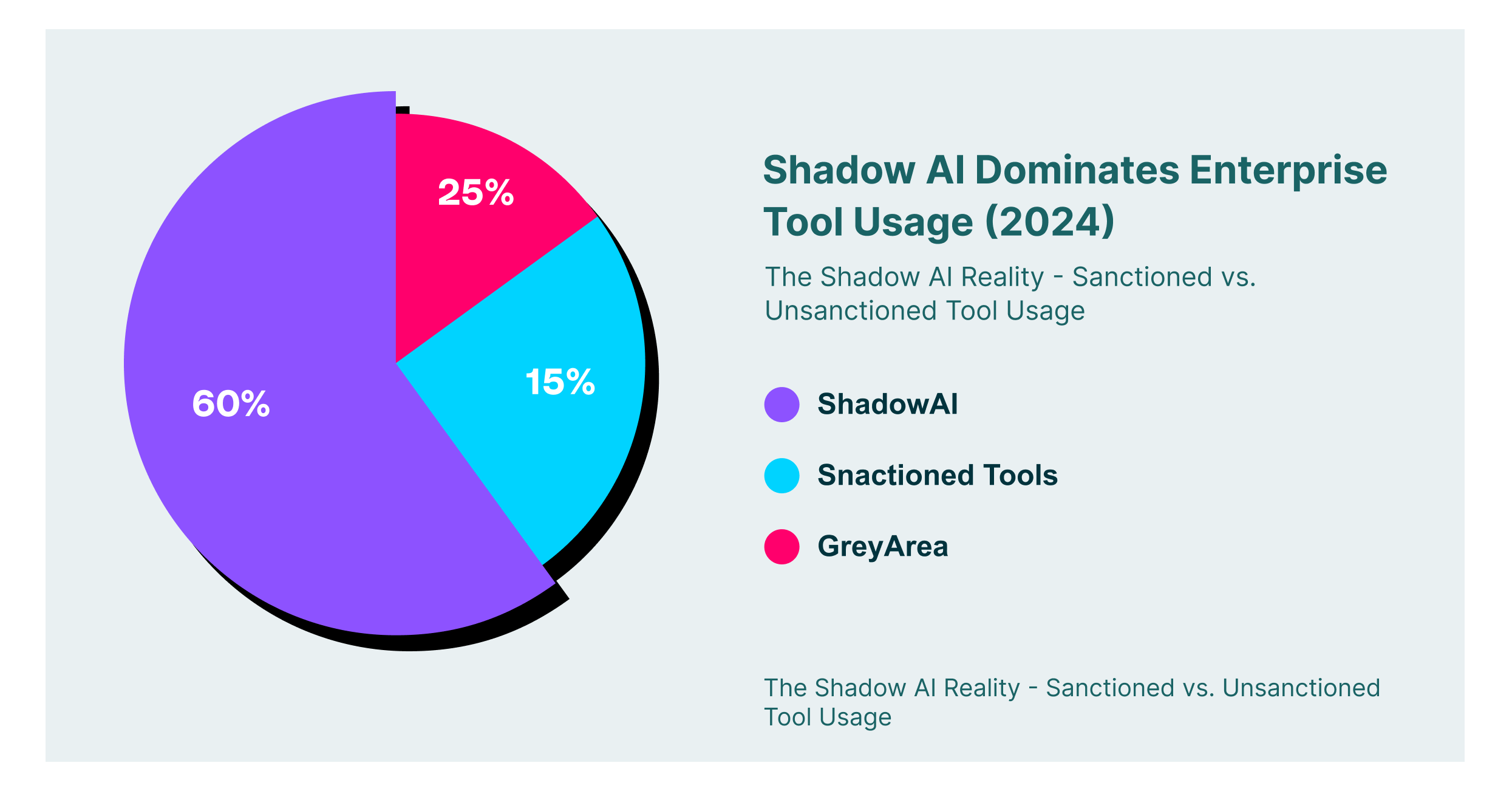

Масштаб проблемы теневого ИИ

Разрыв между тем, что одобряют ИТ-команды, и тем, что фактически используют сотрудники, постоянно растет. Большинство организаций считают, что контролируют свой программный инвентарь. В действительности же ситуация часто оказывается совсем иной. Расширения для браузеров и веб-приложения обходят сетевые ограничения. Это позволяет данным передаваться напрямую с экрана пользователя на серверы сторонних разработчиков.

Теневая реальность искусственного интеллекта: санкционированное и несанкционированное использование инструментов.

Группы специалистов по безопасности должны понимать, что «теневой ИИ» — это не просто помеха, а критическая уязвимость. Несанкционированные инструменты часто не обладают средствами защиты корпоративного уровня. Они могут заявлять о своем праве использовать ваши данные для обучения моделей. Комплексная политика безопасности ИИ — это первый шаг к восстановлению прозрачности и контроля над этой децентрализованной средой.

Основные принципы шаблона политики безопасности ИИ

Создание политики с нуля может быть сложной задачей. Полезно рассматривать документ как набор модульных компонентов. Каждый модуль отвечает за определенный аспект взаимодействия пользователя с ИИ. Надежный шаблон политики безопасности ИИ не должен быть статичным списком «чего не следует делать». Это должна быть динамическая структура, адаптирующаяся к новым инструментам и угрозам. Она должна в равной степени охватывать безопасность идентификации, данных и приложений.

Первый столп — это классификация данных. Вы не можете защитить то, что не определяете. Ваша политика должна четко указывать, какие категории данных допустимы для использования в ИИ. Публичные маркетинговые тексты могут быть безопасны. Персональные данные клиентов и невыпущенный исходный код — определенно нет. Политика не должна оставлять места для двусмысленности в этом вопросе. Пользователи должны точно знать, где проходит граница, прежде чем открывать окно с запросом.

Управление идентификацией и доступом

Второй аспект сосредоточен на том, кто использует инструменты. Анонимность — враг безопасности. Ваш шаблон политики безопасности ИИ должен предусматривать обязательное использование корпоративных учетных записей для всех задач, связанных с ИИ. Использование личных электронных почтовых ящиков в корпоративной работе должно быть строго запрещено. Это гарантирует, что после увольнения сотрудника доступ к его данным и истории взаимодействий останется за организацией. Это также позволяет интегрировать систему единого входа (SSO). SSO обеспечивает централизованный механизм аварийного отключения в случае компрометации учетной записи.

Проверка и утверждение заявок

Третий столп касается самих инструментов. Не все приложения ИИ одинаковы. Некоторые соответствуют строгим корпоративным стандартам безопасности. Другие представляют собой не более чем операции по сбору данных, обернутые в удобный интерфейс. Ваша политика должна предусматривать процесс проверки. Этот процесс должен оценивать методы обработки данных поставщиком. Он должен проверять, использует ли он данные клиентов для обучения. Он должен подтверждать соответствие таким стандартам, как SOC 2 или ISO 27001. Только инструменты, прошедшие эту проверку, должны получать «санкционированный» статус.

Установление стандартов допустимого использования ИИ

Раздел о допустимом использовании ИИ переводит основные принципы в повседневные действия. Это та часть политики, которую сотрудники будут читать чаще всего. Она должна быть ясной, краткой и не содержать юридического жаргона. Основное внимание следует уделить поведению. В ней должны быть описаны конкретные сценарии, с которыми пользователи сталкиваются в своей повседневной работе.

Например, разработчики часто используют ИИ для отладки кода. Политика допустимого использования ИИ может разрешать вставку фрагментов общей логики. При этом строго запрещается вставка проприетарных алгоритмов или жестко закодированных ключей API. Маркетинговые команды могут использовать ИИ для составления электронных писем. Политика разрешит это, но потребует проверки конечного результата человеком на точность и соответствие тону. Эти практические примеры помогают сотрудникам понять, как применять правила в их конкретном контексте.

Протокол «светофора»

Для упрощения процесса принятия решений многие организации внедряют систему светофора в рамках своих руководящих принципов допустимого использования ИИ.

- Зеленый (одобренный): Эти инструменты имеют корпоративные лицензии. Подписаны соглашения о защите данных. Сотрудники могут свободно использовать их для большинства типов данных, за исключением совершенно секретной информации.

- Желтый (допустимо): Это общедоступные инструменты, которые полезны, но не имеют корпоративного контроля. Использование разрешено только для задач, не связанных с конфиденциальной информацией. Вход в систему не требуется. Ввод внутренних данных запрещен.

- Красный (заблокировано): Эти инструменты представляют неприемлемые риски. Возможно, у них есть история нарушений безопасности или агрессивная политика сбора данных. Доступ технически заблокирован на уровне браузера или сети.

Управление рисками в области политики безопасности генеративного ИИ

Генеративный ИИ создает уникальные риски, которые не покрываются традиционными политиками безопасности программного обеспечения. Интерактивный характер больших языковых моделей (LLM) порождает новые векторы атак. Специализированная политика безопасности генеративного ИИ должна учитывать эти конкретные угрозы. Недостаточно обеспечить безопасность доступа; необходимо обеспечить безопасность самого взаимодействия.

Одна из главных проблем — внедрение вредоносных инструкций. Это происходит, когда вредоносные инструкции скрыты внутри блока текста. Если сотрудник вставит этот текст в LLM, модель может быть обманута и проигнорировать свои защитные механизмы. Ваша политика должна предупреждать пользователей о недопустимости вставки ненадежного контента из интернета непосредственно во внутренние инструменты ИИ. К внешнему тексту следует относиться с той же подозрительностью, что и к вложению в электронное письмо от неизвестного отправителя.

Управление галлюцинациями и целостностью выходных данных

Еще одним важнейшим аспектом политики безопасности генеративного ИИ является проверка результатов. Модели ИИ являются вероятностными, а не детерминированными. Они могут с уверенностью представлять ложную информацию как факт. Это явление известно как галлюцинация. Использование непроверенных результатов работы ИИ при принятии важных деловых решений может привести к финансовым потерям и ущербу репутации. Политика должна предусматривать участие человека в процессе обработки всех ценных результатов. Код, сгенерированный ИИ, должен быть проверен старшим инженером. Юридические документы, составленные ИИ, должны быть проверены юрисконсультом.

Распространенные нарушения политики безопасности ИИ в корпоративных средах

Рамки политики и управления безопасностью ИИ

Внеплановые правила — это хорошее начало, но для обеспечения долгосрочной устойчивости необходим структурированный подход. Приведение системы в соответствие с международными стандартами превращает вашу политику безопасности ИИ из набора правил в систему управления. Это демонстрирует должную осмотрительность перед регулирующими органами, клиентами и членами совета директоров. Акцент смещается с реактивного реагирования на устранение неполадок на проактивное управление рисками.

В настоящее время в отрасли доминируют две основные системы: ISO 42001 и структура управления рисками в области ИИ от NIST (RMF). Внедрение элементов этих стандартов гарантирует, что ваша политика безопасности и стратегия управления в области ИИ будут всеобъемлющими и обоснованными. Это обеспечивает общий язык для обсуждения рисков, связанных с ИИ, внутри организации.

Внедрение ISO 42001

ISO 42001 — это глобальный стандарт для систем управления ИИ. Он следует знакомому циклу «Планирование-Выполнение-Проверка-Действие», характерному для других стандартов ISO. Для политики безопасности и программы управления ИИ наиболее важными часто являются разделы «Лидерство» и «Операции».

- Лидерство: Этот пункт требует от высшего руководства взять на себя ответственность за эффективность системы управления ИИ. Он гарантирует наличие необходимых ресурсов и соответствие политики стратегическим целям бизнеса.

- Операция: Данный пункт посвящен оценке и управлению рисками, связанными с искусственным интеллектом. Он обязывает организации выявлять потенциальные непредвиденные последствия использования систем ИИ и внедрять меры контроля для их смягчения.

Применение модели NIST AI RMF

Рамочная концепция NIST AI RMF — это добровольная структура, пользующаяся высоким авторитетом в государственном и частном секторах США. Она построена вокруг четырех основных функций: управление, картирование, измерение и контроль.

- Управление: Эта функция способствует формированию культуры управления рисками. Она включает в себя разработку политик и процедур, регулирующих разработку и использование ИИ.

- Карта: Эта функция устанавливает контекст. Она определяет конкретные используемые системы искусственного интеллекта и потенциальные риски, связанные с ними.

- Измерение: Эта функция использует количественные и качественные методы для анализа рисков. Она отвечает на вопрос: «Каков реальный уровень риска, который мы несем?»

- Управление: Эта функция определяет приоритеты и устраняет риски. Она включает в себя внедрение конкретных мер контроля, таких как сама политика допустимого использования ИИ, для снижения риска до приемлемого уровня.

Роль безопасности браузера в обеспечении соблюдения законодательства.

Разработка корпоративной политики в отношении ИИ — это только половина дела. Вторая половина — это её обеспечение. Традиционные инструменты сетевой безопасности с трудом справляются с современным использованием ИИ. Они могут заблокировать домен, но не видят, что происходит внутри сессии. Они не могут отличить запрос пользователя к ChatGPT о рецепте печенья от запроса пользователя, вставляющего базу данных клиентов. Эта недостаточная детализация приводит к чрезмерной блокировке или опасным «слепым зонам».

Браузер — это новый периметр. Это интерфейс, через который осуществляется практически вся современная работа. Для эффективного обеспечения политики безопасности ИИ необходимы элементы управления, встроенные в сам браузер. Это позволяет проводить анализ действий пользователя в реальном времени. Это дает возможность принимать решения с учетом контекста, обеспечивая баланс между безопасностью и производительностью. Вместо бинарного «блокировать или разрешить» безопасность браузера может предложить более тонкие настройки, такие как «разрешить только для чтения» или «разрешить, но скрыть конфиденциальные данные».

Автоматизация политик с помощью LayerX

LayerX предоставляет технические возможности для воплощения вашей политики безопасности ИИ в жизнь. Он работает как корпоративное расширение для браузера. Это уникальное положение позволяет ему отслеживать и контролировать взаимодействие пользователей с любым веб-приложением, включая разрешенные и неразрешенные инструменты ИИ. LayerX выступает в качестве инструмента обеспечения соблюдения вашей стратегии управления.

Одна из ключевых возможностей LayerX — обнаружение «теневого ИИ». Он автоматически каталогизирует все сайты, использующие ИИ, к которым обращаются ваши сотрудники. Он предоставляет исчерпывающий перечень, позволяющий точно видеть, какие инструменты используются. Такая прозрачность необходима для обновления шаблона политики безопасности ИИ и поддержания его актуальности. Вы не можете управлять тем, о существовании чего не знаете. LayerX освещает темные уголки вашей SaaS-экосистемы.

DLP в реальном времени и образование

LayerX выходит за рамки простого обнаружения. Он предлагает активные возможности предотвращения потери данных (DLP), разработанные специально для GenAI. Когда пользователь пытается вставить данные, нарушающие политику допустимого использования ИИ, LayerX вмешивается. Он может полностью заблокировать операцию вставки. Он также может выборочно удалять конфиденциальные строки, такие как номера кредитных карт или персональные данные, позволяя при этом продолжить ввод данных. Это позволяет сотрудникам безопасно использовать инструмент, не подвергая организацию риску. Кроме того, LayerX может отображать всплывающее окно с объяснением нарушения. Это превращает каждое заблокированное действие в микро-тренинг, закрепляя политику безопасности ИИ в режиме реального времени.

Контрольный список для внедрения политики безопасности ИИ

Используйте следующий контрольный список, чтобы убедиться, что ваша политика охватывает все критически важные области. В этой таблице показано соответствие конкретных компонентов политики техническим средствам контроля, необходимым для их обеспечения.

| Компонент политики | Ключевое требование | Возможности принудительного применения LayerX |

| Инвентарь инструментов | Поддерживайте актуальный список разрешенных и заблокированных инструментов. | Обнаружение теневых SaaS-приложений и приложений искусственного интеллекта в режиме реального времени по всей организации. |

| Data DLP | Определите конкретные типы данных, запрещенные для использования в качестве входных данных для ИИ. | Запретить вставку или загрузку определенных типов конфиденциальных данных. |

| Управление идентификацией | Ввести обязательный корпоративный единый вход (SSO) для всех учетных записей AI. | Обнаружение и блокировка использования личных почтовых аккаунтов в корпоративных приложениях. |

| Управление расширением | Проверьте все плагины для браузеров, обращающиеся к данным ИИ. | Оценка рисков и блокировка вредоносных или рискованных расширений. |

| Аудит Трейл | Для обеспечения соответствия требованиям регистрируйте все запросы и взаимодействия с ИИ. | Детальные журналы взаимодействия пользователей с ИИ для целей аудита. |

| Ролевой доступ | Определите, кто и каким инструментом может пользоваться и как. | Внедрите политики доступа на основе групп пользователей и Active Directory. |

В преддверии внедрения ИИ в корпоративную безопасность

Внедрение генеративного ИИ — это не мимолетная тенденция. Это фундаментальный сдвиг в том, как ведется бизнес. Ваша корпоративная политика в отношении ИИ — это механизм, который позволяет вашей организации безопасно пройти через этот переход. Речь идет не о создании препятствий, а о построении защитных механизмов. Определив четкие правила допустимого использования ИИ и подкрепив их надежными техническими средствами контроля, вы даете своим сотрудникам возможность внедрять инновации.

Безопасность в эпоху ИИ требует сочетания четкого управления и активного обеспечения соблюдения правил. Статический шаблон политики безопасности ИИ — хорошая отправная точка, но его необходимо внедрить в практическую деятельность. LayerX обеспечивает необходимую видимость и контроль на уровне браузера для эффективной работы вашей политики. Он устраняет разрыв между документом и пользователем. Он гарантирует, что ваша политика безопасности ИИ и усилия по управлению приводят к реальному снижению рисков. Начните с обеспечения видимости, определите свои правила и обеспечьте их соблюдение на периферии сети. Это путь к безопасному внедрению ИИ.