Внедрение генеративного ИИ ускоряется, но защита устаревших данных не может обеспечить безопасность всех нюансов взаимодействия с LLM. В этом руководстве сравниваются лучшие инструменты безопасности генеративного ИИ, которые помогут руководителям предприятий внедрять инновации, сохраняя при этом строгий контроль над конфиденциальными данными.

Что представляют собой инструменты безопасности на основе генеративного ИИ и почему они важны?

Инструменты безопасности на основе генеративного ИИ — это специализированные платформы, предназначенные для защиты использования больших языковых моделей (LLM) и приложений ИИ. В отличие от традиционных межсетевых экранов, эти решения для обеспечения безопасности на основе генеративного ИИ анализируют контекст разговорных данных, что позволяет им обнаруживать и блокировать утечку персональных данных или интеллектуальной собственности в режиме реального времени. Они обеспечивают критически важную информацию о «теневом ИИ», гарантируя, что сотрудники непреднамеренно не подвергают корпоративные активы воздействию общедоступных моделей.

Для современных предприятий эти платформы отличаются от стандартных стеков безопасности тем, что предлагают детальный контроль над запросами и ответами. Они предотвращают атаки с внедрением запросов и обеспечивают соответствие нормативным требованиям в области конфиденциальности без необходимости полного запрета инструментов искусственного интеллекта, повышающих производительность. Внедряя эти средства защиты, организации могут безопасно интегрировать GenAI в свои рабочие процессы, одновременно снижая риски утечки данных и манипулирования моделями.

Ключевые тенденции в области безопасности генеративного ИИ, за которыми следует следить в 2026 году.

Переход от блокировки к «безопасному обеспечению» определяет облик 2026 года. Команды безопасности отказываются от полного запрета инструментов ИИ и вместо этого внедряют платформы, обеспечивающие безопасное использование за счет редактирования данных в режиме реального времени. Такой подход гарантирует, что сотрудники смогут использовать мощные ИИ-помощники для повышения производительности, не рискуя случайно передать конфиденциальные данные клиентов или собственный код.

Защита с помощью «агентного ИИ» — еще один набирающий популярность приоритет. Поскольку злоумышленники начинают использовать агентов ИИ для автоматизации сложных операций социальной инженерии и сканирования уязвимостей, предприятия противодействуют им с помощью защитных агентов ИИ. Эти автономные системы могут обнаруживать поведенческие аномалии и реагировать на угрозы быстрее, чем аналитики-люди, создавая динамический щит от автоматизированных атак.

Наконец, контекстно-ориентированное управление доступом становится стандартом. Уже недостаточно предоставлять бинарный доступ моделям ИИ; современные решения в области безопасности генеративного ИИ теперь динамически обеспечивают соблюдение политики «необходимости знать». Это гарантирует, что сотрудник отдела маркетинга не сможет заставить внутреннюю модель ИИ раскрыть финансовые данные, поддерживая строгие внутренние барьеры для доступа к данным.

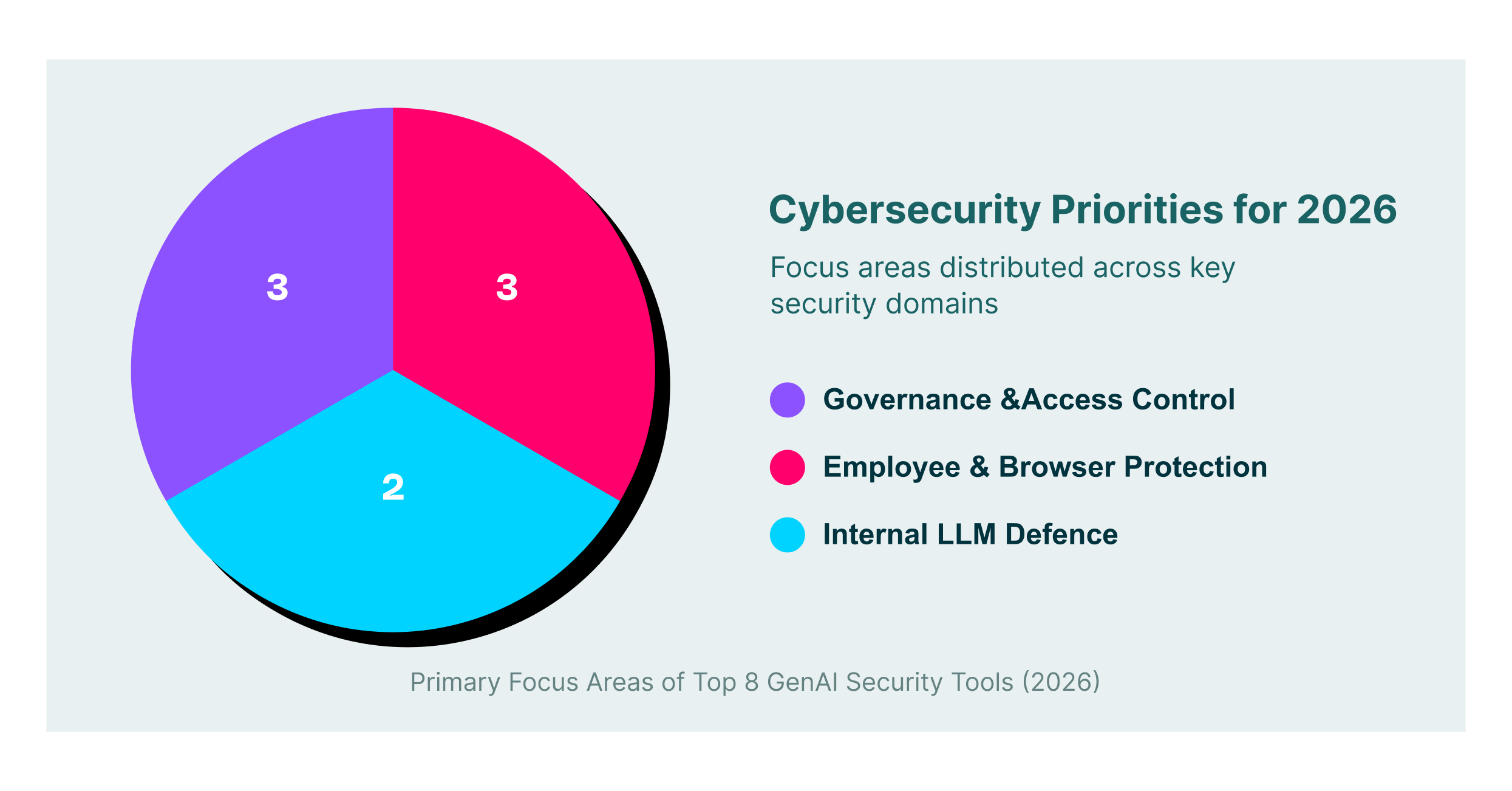

8 лучших инструментов безопасности на основе генеративного ИИ на 2026 год

Ниже приведено сравнение ведущих платформ, начиная с LayerX. Эти поставщики предлагают различные подходы к обеспечению безопасности быстро расширяющейся поверхности атаки ИИ.

| Платформа | Ключевые возможности | Лучше всего |

| Layerx | DLP на основе браузера, фильтрация подсказок в реальном времени и видимость с помощью теневого ИИ. | Безопасность браузеров в корпоративной среде и защита от утечки данных (DLP) |

| Быстрая безопасность | Обнаружение теневого ИИ, защита от мгновенного внедрения, редактирование данных. | Обеспечение безопасности использования GenAI сотрудниками. |

| AIM Security | GenAI: оценка рисков, управление соответствием требованиям, безопасное развертывание ИИ. | Безопасность Microsoft 365 Copilot |

| Лакера | Обнаружение угроз в режиме реального времени, безопасность приложений на основе ИИ, оперативная защита. | Защита внутренних приложений искусственного интеллекта |

| Гармоническая безопасность | Защита данных без участия пользователя, напоминания пользователю, оценка рисков | Автоматизированный мониторинг соответствия |

| Лассо Безопасность | Обнаружение теневых LLM-устройств, контекстно-ориентированное управление доступом и блокировка в реальном времени. | Управление и надзор в рамках программы LLM |

| Ночной AI | Защита от утечки данных на основе ИИ, редактирование данных, агенты для браузеров и конечных устройств. | Предотвращение утечки данных |

| Кностик | Управление доступом, обеспечение соблюдения политики "необходимости знать". | Управление правами доступа к ИИ |

1. СлойX

LayerX — это платформа безопасности браузера, работающая как легковесное расширение, превращающее любой коммерческий браузер в безопасное управляемое рабочее пространство. Она обеспечивает глубокий анализ всех взаимодействий GenAI, позволяя командам безопасности обнаруживать и блокировать вставку конфиденциального исходного кода или персональных данных в такие инструменты, как ChatGPT, до того, как данные покинут конечную точку.

Платформа выходит за рамки простой блокировки, обеспечивая детальное управление использованием «теневого ИИ». Она выявляет несанкционированные инструменты ИИ и применяет политики, основанные на личности пользователя и уровне риска, гарантируя, что решения по обеспечению безопасности генеративного ИИ применяются именно в точке взаимодействия. Это обеспечивает безопасность «последней мили» передачи данных, позволяя безопасно внедрять ИИ без нарушения производительности пользователей.

2. Быстрая безопасность

Prompt Security предоставляет комплексную платформу для обеспечения безопасности на каждом этапе внедрения GenAI, от случайного использования сотрудниками до глубокой интеграции LLM во внутренние продукты. Ее мощные возможности обнаружения предоставляют ИТ-командам полный перечень используемых инструментов Shadow AI, а также оценку рисков, которая помогает расставить приоритеты в области безопасности.

Платформа превосходно предотвращает атаки с внедрением всплывающих подсказок и обеспечивает конфиденциальность данных за счет редактирования в реальном времени. Проверяя подсказки и ответы, Prompt Security гарантирует, что конфиденциальные корпоративные данные будут очищены до того, как попадут к внешним поставщикам, что делает ее надежным выбором среди компаний, занимающихся безопасностью на основе генеративного ИИ, для более безопасного развертывания чат-ботов.

3. AIM Security

AIM Security专注于 создание безопасной среды для внедрения GenAI в корпоративной среде, предлагая мощные инструменты для оценки рисков и управления. Платформа помогает руководителям служб информационной безопасности выявлять и отображать все приложения GenAI в организации, предоставляя четкое представление об уровне риска, связанного с соблюдением нормативных требований и безопасностью.

Одним из главных преимуществ AIM Security является его способность обеспечивать безопасность крупномасштабных развертываний, таких как Microsoft 365 Copilot. Он предлагает функции, которые подтверждают безопасность агентов ИИ и предотвращают утечки данных за счет строгого соблюдения политик, гарантируя, что операционные преимущества ИИ не будут противоречить нормативным стандартам.

4. Лакера

Lakera выделяется благодаря «Lakera Guard» — уровню защиты в реальном времени, созданному для защиты приложений ИИ от враждебных атак. Он поддерживает обширную базу данных известных методов внедрения подсказок и взломов, что позволяет ему блокировать вредоносные входные данные, пытающиеся манипулировать поведением LLM.

Помимо обнаружения угроз, Lakera предлагает мощные возможности предотвращения потери данных, разработанные специально для взаимодействия с ИИ на основе API. Она особенно эффективна для инженерных групп, создающих собственные функции GenAI, поскольку интегрируется непосредственно в цикл разработки, предотвращая попадание уязвимостей в производственную среду.

5. Гармоническая безопасность

Harmonic Security придерживается философии «нулевого вмешательства» в защиту данных, стремясь минимизировать неудобства для пользователей, сохраняя при этом безопасность. Вместо жесткой блокировки, она использует предварительно обученные модели защиты данных для выявления конфиденциальной информации и «подталкивания» пользователей к более безопасному поведению, эффективно обучая их в процессе повседневной работы.

Эта платформа снижает операционную нагрузку на команды безопасности, автоматизируя классификацию рискованных сервисов ИИ. Harmonic обеспечивает четкое разграничение безопасных и опасных приложений, позволяя организациям уверенно одобрять инструменты с низким уровнем риска, автоматически ограничивая доступ к тем, которые представляют угрозу.

6. Lasso Security

Lasso Security обеспечивает комплексную защиту больших языковых моделей, сочетая обнаружение теневых ИТ-систем с расширенным контролем доступа. Ее технология «LLM Guardian» выступает посредником между пользователями и моделями, отслеживая потоки данных, проверяя контент на наличие аномалий и обеспечивая соблюдение политик, предотвращающих обмен конфиденциальными данными.

Платформа делает акцент на контекстно-зависимой безопасности, гарантируя, что пользователи получают доступ только к тем данным, к которым у них есть разрешение, даже при взаимодействии с ИИ, обладающим обширными организационными знаниями. Lasso также включает в себя специальные средства защиты от отравления данных и кражи моделей, что делает ее надежным решением для предприятий, создающих собственные модели.

7. Искусственный интеллект «Ночной закат»

Nightfall AI использует свою проверенную облачную технологию DLP для предоставления специализированного решения в области безопасности на основе генеративного ИИ. Она применяет детекторы на основе ИИ для сканирования запросов и загружаемых файлов на наличие персональных данных, ключей API и других секретов, автоматически удаляя эту информацию перед ее обработкой внешними поставщиками решений на основе ИИ.

Решение развертывается с помощью плагинов для браузеров и агентов на конечных устройствах для сбора данных в источнике, предотвращая утечку данных путем копирования и вставки. Ориентация Nightfall на высокоточное обнаружение минимизирует ложные срабатывания, обеспечивая бесперебойное выполнение легитимных рабочих процессов при строгом соблюдении требований к данным.

8. Кностик

Knostic решает важнейшую проблему контроля доступа в средах GenAI, в частности, риск обхода пользователями разрешений через диалоговые интерфейсы. Он обеспечивает соблюдение политики «необходимости знать», анализируя контекст запросов пользователей и базовые разрешения на доступ к данным, предотвращая случайное чрезмерное распространение конфиденциальной информации.

Платформа использует LLM для динамического создания и корректировки политик доступа, сокращая объем ручной административной работы, необходимой для управления доступом на основе ролей. Knostic предоставляет автоматизированную отчетность о соответствии требованиям, помогая организациям демонстрировать, что их внедрения ИИ соответствуют строгим внутренним и внешним стандартам конфиденциальности.

Как выбрать лучшего поставщика услуг безопасности для генеративного ИИ

- Определите, является ли вашей основной целью обеспечение безопасности использования браузера сотрудниками или защита внутренних приложений LLM.

- Оцените способность платформы обнаруживать «теневой ИИ» без ручного ввода, чтобы обеспечить полную прозрачность.

- Отдавайте приоритет решениям в области безопасности на основе генеративного ИИ, которые обеспечивают устранение проблем в режиме реального времени, например, редактирование информации, а не просто пассивное ведение журналов.

- Проверьте возможность бесшовной интеграции с существующими поставщиками идентификационных данных для обеспечения единообразных политик на основе пользователей.

- Выберите поставщика, который минимизирует сложности, предлагая обучающие подсказки, направляющие поведение пользователей.

Часто задаваемые вопросы (FAQ)

Каковы основные риски использования генеративного ИИ на предприятиях?

К основным рискам относятся утечка данных, когда сотрудники делятся персональными данными или интеллектуальной собственностью с общедоступными моделями, и «теневой ИИ», когда несанкционированные инструменты используются без контроля. Атаки с использованием мгновенного внедрения также представляют угрозу, поскольку они могут заставить LLM-модели обходить фильтры безопасности и раскрывать данные бэкэнда.

Чем инструменты безопасности GenAI отличаются от традиционных средств защиты от утечки данных (DLP)?

Традиционные средства защиты от утечки данных (DLP) используют жесткие шаблоны регулярных выражений, которые часто не понимают контекст разговора, что приводит к ложным срабатываниям. Инструменты безопасности GenAI используют семантический анализ для интерпретации намерений, стоящих за запросом, что позволяет им различать законную работу и попытки утечки данных.

Могу ли я просто заблокировать ChatGPT, чтобы обеспечить безопасность своей организации?

Блокировка ChatGPT часто приводит к «теневым ИТ», когда сотрудники переключаются на личные устройства или неконтролируемые инструменты для продолжения работы. Более эффективной стратегией является использование платформ безопасности, которые обеспечивают безопасное использование, скрывая конфиденциальные данные, но сохраняя при этом доступ к преимуществам повышения производительности.

Нужно ли мне расширение для браузера для обеспечения безопасности GenAI?

Расширение для браузера часто является наиболее эффективным методом обеспечения безопасности использования сотрудниками, поскольку оно отслеживает действия «последней мили», такие как копирование и вставка, а также загрузка файлов. Сетевые прокси могут пропускать зашифрованный трафик или не видеть контекст, видимый только в рамках сеанса браузера.

Что такое «теневой ИИ» и почему он опасен?

Теневой ИИ — это использование инструментов искусственного интеллекта сотрудниками без одобрения или ведома ИТ-отдела. Это опасно, поскольку такие инструменты не обладают корпоративными средствами защиты, а это значит, что любые данные, передаваемые через них, покидают защищенный периметр организации и могут быть использованы для обучения общедоступных моделей.