Интеграция генеративного ИИ в корпоративные рабочие процессы — это не отложенное на будущее дело; она происходит прямо сейчас, со скоростью, часто опережающей возможности безопасности и управления. На каждое задокументированное и санкционированное использование инструмента ИИ, повышающего производительность, приходится бесчисленное количество случаев «теневого» использования, подвергающего организации серьёзным угрозам. Задача для аналитиков безопасности, руководителей служб информационной безопасности и ИТ-руководителей очевидна: как реализовать инновации, которые обещает ИИ, не создавая неприемлемых рисков? Ответ кроется в дисциплинированном, проактивном подходе к управлению рисками, связанными с ИИ. Речь идёт не о блокировке прогресса, а о создании барьеров, которые позволят вашей организации безопасно ускориться.

Растущая необходимость в управлении с помощью ИИ

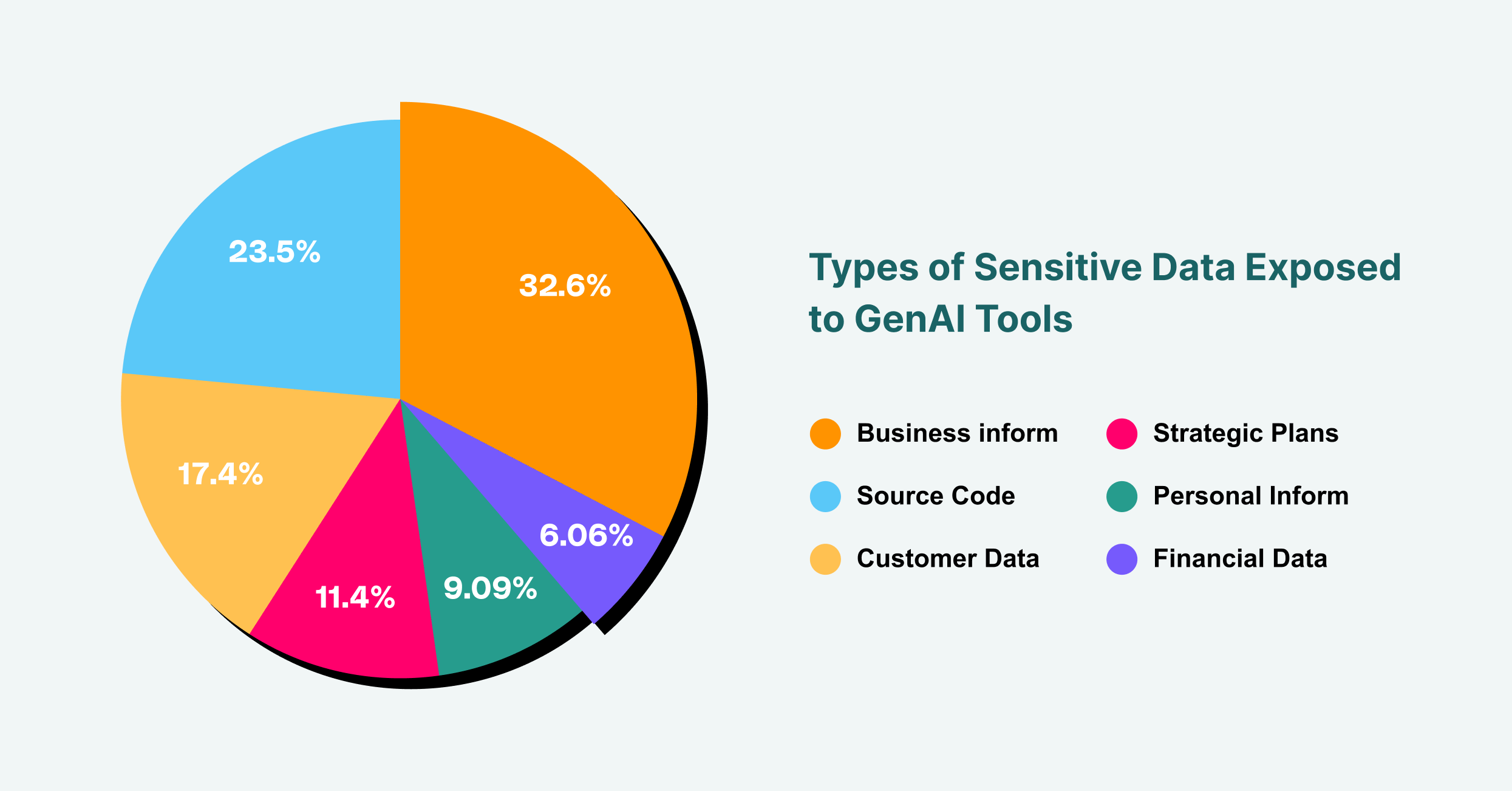

Прежде чем внедрять эффективную стратегию управления рисками, необходимо заложить основу для управления ИИ. Быстрое децентрализованное внедрение инструментов ИИ означает, что без формальной структуры управления организации действуют вслепую. Сотрудники, стремясь повысить свою эффективность, самостоятельно внедряют различные платформы и плагины ИИ, часто не задумываясь о последствиях для безопасности. Это создаёт сложную сеть несанкционированного использования SaaS-решений, где конфиденциальные корпоративные данные, от персональных данных и финансовой отчётности до интеллектуальной собственности, могут быть непреднамеренно переданы в сторонние большие языковые модели (LLM).

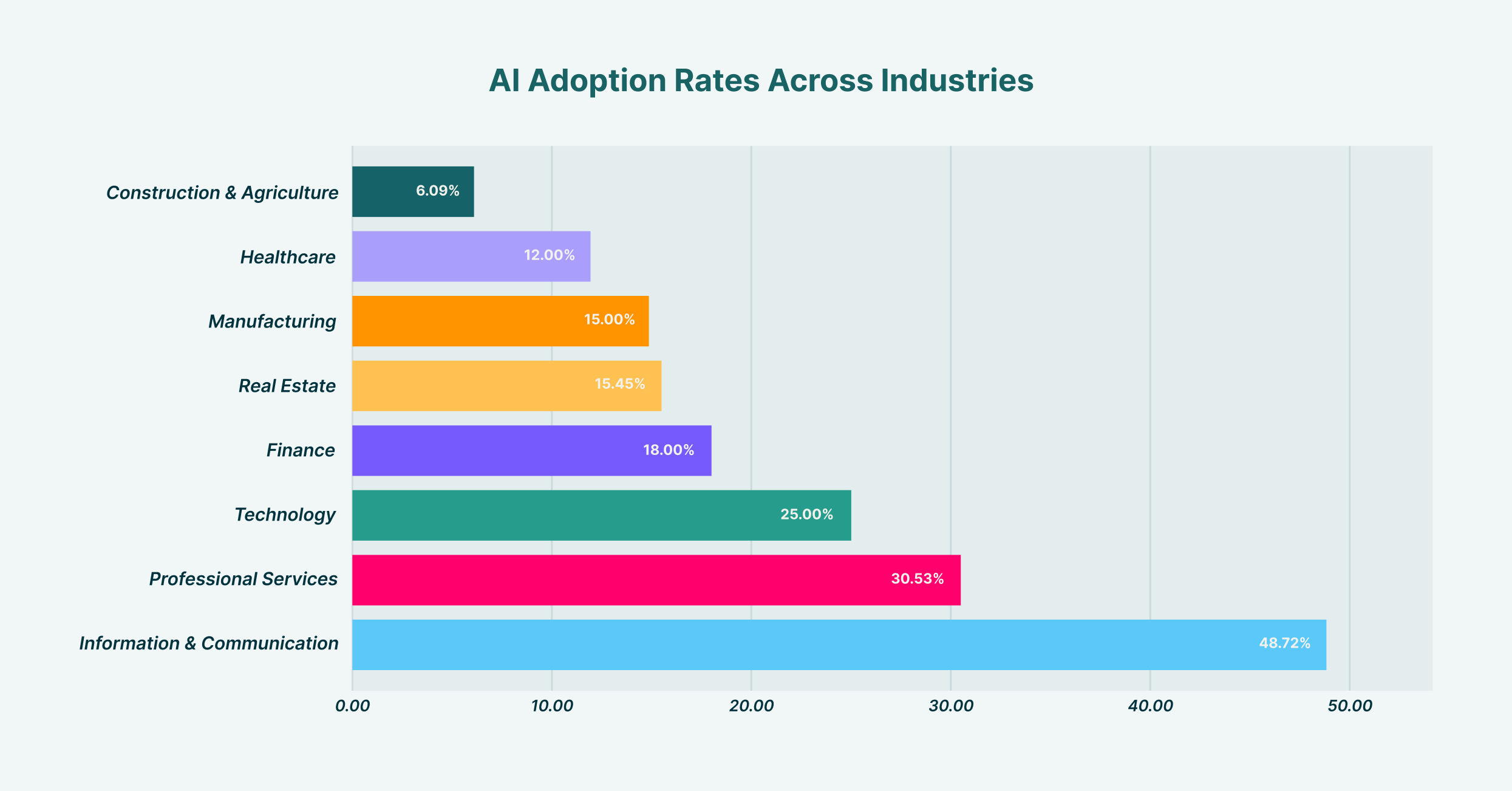

Внедрение ИИ значительно различается в разных отраслях: лидируют сектор информации и коммуникаций (48.7%), а самый низкий уровень — строительство и сельское хозяйство (6.1%).

Создание надежного управления ИИ предполагает создание кросс-функциональной команды, обычно включающей представителей ИТ-отделов, служб безопасности, юридического отдела и бизнес-подразделений. Этот комитет отвечает за определение позиции организации в отношении ИИ. Какова наша готовность к риску? Какие варианты использования приветствуются, а какие запрещены? Кто несет ответственность за инцидент, связанный с ИИ? Ответы на эти вопросы обеспечивают ясность, необходимую для разработки политик и механизмов контроля. Без такого стратегического руководства сверху вниз любая попытка управления рисками превращается в серию разрозненных ответных мер, а не в целостную систему защиты. Эта структура управления становится основой для всех последующих мер по обеспечению безопасности, обеспечивая согласованность технологий, политик и поведения пользователей.

Создание вашей системы управления рисками ИИ

После создания структуры управления следующим шагом станет создание формальной структуры управления рисками ИИ. Эта структура операционализирует ваши принципы управления, превращая стратегию высокого уровня в конкретные, воспроизводимые процессы. Она предоставляет структурированный метод выявления, оценки, снижения и мониторинга рисков, связанных с ИИ, в масштабах всей организации. Вместо того, чтобы изобретать велосипед, организации могут адаптировать существующие модели, такие как структура управления рисками ИИ NIST, к своему конкретному операционному контексту и ландшафту угроз.

Разработка эффективной системы управления рисками ИИ должна быть методичным процессом. Она начинается с создания полной инвентаризации всех используемых систем ИИ, как санкционированных, так и несанкционированных. Этот начальный этап обнаружения критически важен: нельзя защитить то, чего не видишь. После обнаружения система должна описывать процедуры оценки рисков, присваивая баллы на основе таких факторов, как тип обрабатываемых данных, возможности модели и ее интеграция с другими критически важными системами. Затем, на основе этой оценки, разрабатываются стратегии смягчения последствий, варьирующиеся от технических средств контроля и обучения пользователей до полного запрета высокорисковых приложений. Наконец, система должна включать в себя цикл непрерывного мониторинга и анализа, поскольку как экосистема ИИ, так и ее использование вашей организацией будут постоянно развиваться. Существуют различные системы управления рисками ИИ, но наиболее успешными являются те, которые представляют собой не статичные документы, а активные, дышащие компоненты программы безопасности организации.

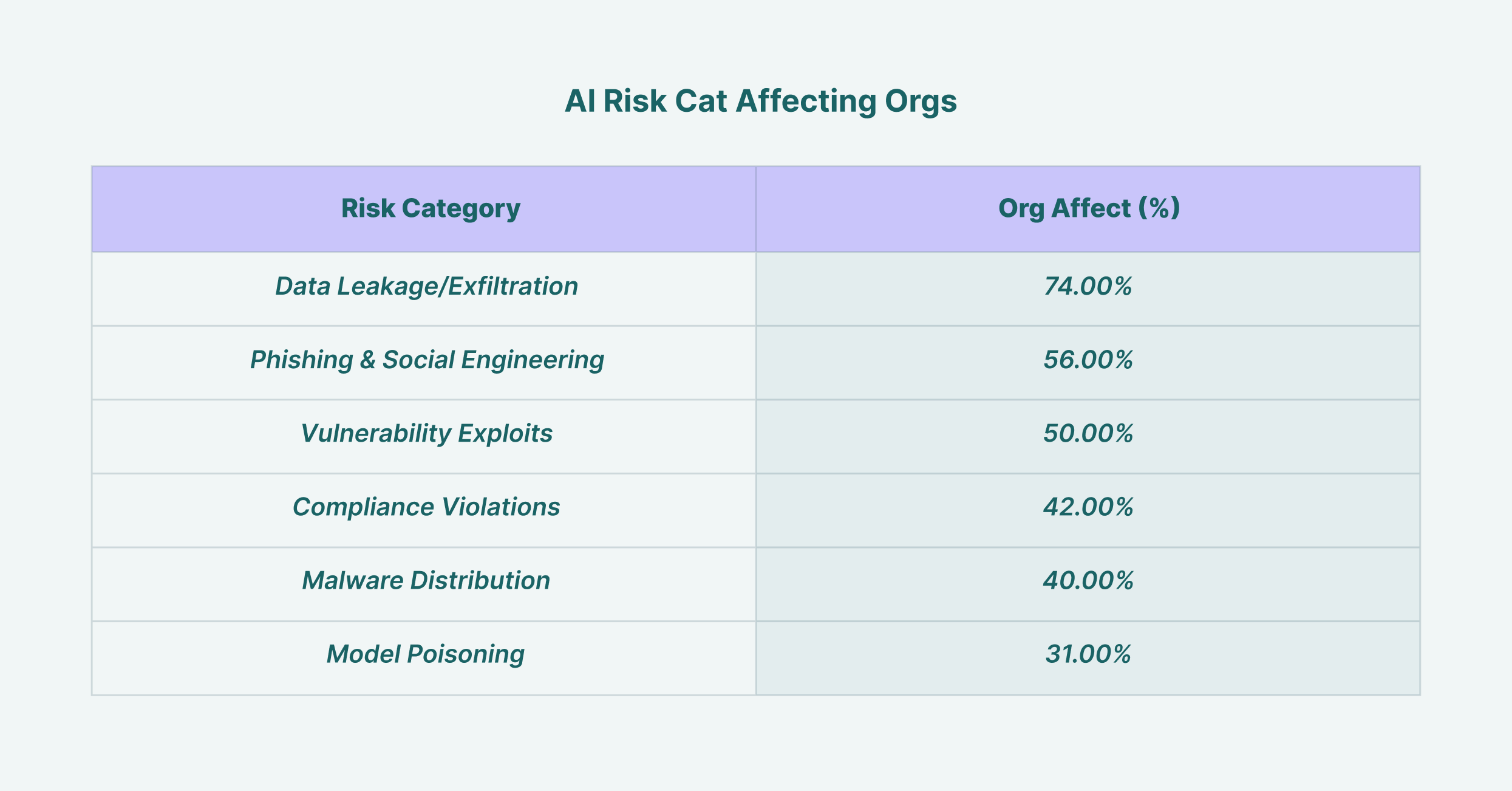

Категоризация рисков ИИ: от утечки данных до отравления моделей

Ключевым компонентом ИИ и управления рисками является понимание конкретных типов угроз, с которыми вы сталкиваетесь. Риски не монолитны: они охватывают широкий спектр: от нарушений конфиденциальности данных до изощрённых атак на сами модели ИИ. Одна из самых непосредственных и распространённых угроз — утечка данных. Представьте себе, как маркетолог вставляет список ценных лидов вместе с контактной информацией в общедоступный инструмент GenAI для составления персонализированных писем. В этот момент конфиденциальные данные клиентов были украдены и стали частью учебных данных LLM, находясь вне контроля вашей организации и потенциально нарушая такие правила защиты данных, как GDPR или CCPA.

Утечка данных затрагивает 74% организаций, что делает ее наиболее распространенной угрозой безопасности ИИ. За ней следуют фишинговые атаки с показателем 56%.

Помимо утечки данных, руководителям служб безопасности приходится бороться с более сложными угрозами. Отравление модели происходит, когда злоумышленник намеренно передает модели вредоносные данные на этапе ее обучения, что приводит к получению необъективных, неверных или вредоносных результатов. Атаки с уклонением от защиты включают в себя создание входных данных, специально разработанных для обхода фильтров безопасности системы ИИ. Для руководителей служб информационной безопасности эффективное использование ИИ в управлении рисками также означает использование инструментов безопасности на базе ИИ для обнаружения этих самых угроз. Системы обнаружения продвинутых угроз могут анализировать поведение пользователей и потоки данных для выявления аномальной активности, указывающей на инцидент безопасности, связанный с ИИ, превращая технологию из источника риска в компонент решения.

Критическая роль политики безопасности ИИ

Чтобы превратить вашу структуру в чёткие директивы для ваших сотрудников, необходима специальная политика безопасности ИИ, которая не подлежит обсуждению. Этот документ служит авторитетным источником информации о приемлемом использовании ИИ в организации. Он должен быть понятным, лаконичным и легкодоступным для всех сотрудников, исключая двусмысленность. Грамотно разработанная политика безопасности ИИ выходит за рамки простых «что можно и чего нельзя» и предоставляет контекст, объясняя почему определенные ограничения вводятся с целью формирования культуры осведомленности в вопросах безопасности, а не просто соблюдения правил.

Политика должна чётко определять несколько ключевых областей. Во-первых, она должна содержать список всех санкционированных и одобренных инструментов ИИ, а также процедуру запроса оценки нового инструмента. Это предотвращает распространение теневого ИИ. Во-вторых, она должна устанавливать чёткие правила обработки данных, определяя, какие типы корпоративной информации (например, общедоступная, внутренняя, конфиденциальная, ограниченного доступа) могут использоваться с той или иной категорией инструментов ИИ. Например, использование общедоступного инструмента GenAI для резюмирования общедоступных новостных статей может быть приемлемым, но его использование для анализа конфиденциальных финансовых прогнозов будет строго запрещено. Политика также должна определять обязанности пользователей, последствия несоблюдения требований и протокол реагирования на инциденты, связанные с предполагаемыми нарушениями, связанными с ИИ, обеспечивая понимание каждым своей роли в обеспечении безопасности организации.

Оценка моделей и плагинов: акцент на управлении рисками сторонних организаций с помощью ИИ

Современная экосистема искусственного интеллекта построена на сложной цепочке поставок моделей, платформ и плагинов, разработанных сторонними разработчиками. Это делает управление рисками, связанными со сторонними разработчиками ИИ, важнейшей опорой вашей общей стратегии безопасности. Каждый раз, когда сотрудник включает новый плагин для своего ИИ-помощника или ваша команда разработчиков интегрирует сторонний API, они расширяют поверхность атаки вашей организации. Каждый из этих внешних компонентов имеет свой собственный набор потенциальных уязвимостей, политик конфиденциальности данных и мер безопасности, которые теперь наследуются вашей организацией.

На долю деловой информации приходится 43% уязвимостей конфиденциальных данных GenAI, за ней следует исходный код (31%) и данные клиентов (23%).

Поэтому необходим строгий процесс оценки. Прежде чем любой сторонний инструмент или компонент ИИ будет одобрен для использования, он должен пройти тщательную проверку безопасности и конфиденциальности. Это включает в себя изучение сертификатов безопасности поставщика, методов обработки данных и возможностей реагирования на инциденты. Какие данные собирает инструмент? Где они хранятся и кто имеет к ним доступ? Есть ли у поставщика история нарушений безопасности? Для плагинов ИИ, которые становятся все более распространенным вектором атак через браузер, процесс проверки должен быть еще более строгим. Следует задать следующие вопросы: Какие разрешения требуются плагину? Кто разработчик? Прошел ли его код аудит? Относясь к каждому стороннему сервису ИИ с таким же уровнем проверки, как и к любому другому критически важному поставщику, вы можете снизить риск атаки на цепочку поставок, которая может поставить под угрозу вашу организацию.

Внедрение инструментов управления рисками на основе ИИ

Политика и процессы играют основополагающую роль, но их недостаточно без технического обеспечения. Именно здесь инструменты управления рисками ИИ становятся незаменимыми. Эти решения обеспечивают прозрачность и контроль, необходимые для обеспечения соблюдения вашей политики безопасности ИИ на практике, а не только в теории. Учитывая, что основным интерфейсом для большинства пользователей, взаимодействующих с GenAI, является веб-браузер, инструменты, работающие на этом уровне, обладают уникальными возможностями для обеспечения эффективного контроля.

Корпоративные браузерные расширения или платформы, такие как LayerX, предлагают мощный механизм управления рисками, связанными с ИИ. Они могут обнаруживать и отображать все случаи использования GenAI в организации, предоставляя информацию в режиме реального времени о том, какие пользователи обращаются к тем или иным платформам. Такая прозрачность — первый шаг к блокировке теневого ИИ. Далее эти инструменты могут применять детальные меры безопасности, основанные на оценке рисков. Например, можно настроить политику, которая запрещает пользователям вставлять текст, помеченный как «конфиденциальный», в общедоступный чат-бот на базе ИИ, или предупреждать пользователей перед загрузкой конфиденциального документа. Этот уровень защиты отслеживает и контролирует поток данных между браузером пользователя и веб-сайтом, фактически выступая в качестве решения для предотвращения потери данных (DLP), специально разработанного для эпохи ИИ. Правильные инструменты управления рисками, связанными с ИИ, устраняют разрыв между политикой и реальностью, предоставляя технические средства для обеспечения соблюдения ваших управленческих решений.

Обработка инцидентов и реагирование на них в эпоху искусственного интеллекта

Даже при самых эффективных превентивных мерах инциденты всё равно могут происходить. Реакция вашей организации — определяющий фактор минимизации последствий нарушения. Эффективный план реагирования на инциденты, связанные с ИИ, должен быть конкретным и хорошо отработанным. При срабатывании оповещения, будь то по отчёту пользователя или в результате автоматического обнаружения одним из ваших инструментов безопасности, команде реагирования необходим чёткий план действий.

Первый шаг — локализация. Если пользователь непреднамеренно раскрыл конфиденциальные данные в системе управления правами доступа (LLM), первоочередной задачей является отзыв доступа и предотвращение дальнейшего раскрытия информации. Это может включать временное отключение доступа пользователя к инструменту или даже изоляцию его компьютера от сети. Следующий этап — расследование. Какие данные были украдены? Кто несёт ответственность? Как наши средства контроля сработали? Этот криминалистический анализ критически важен для понимания первопричины и предотвращения повторного инцидента. Наконец, план должен предусматривать устранение и восстановление, что включает в себя уведомление пострадавших сторон в соответствии с требованиями закона, принятие мер по удалению данных поставщиком ИИ, если это возможно, и обновление политик безопасности и средств контроля на основе полученного опыта. Зрелая позиция в области ИИ и управления рисками означает готовность как к реагированию на инцидент, так и к его предотвращению.

Отслеживание и улучшение вашей позиции по рискам ИИ

Управление рисками ИИ — это не разовый проект, а непрерывный цикл оценки, снижения рисков и совершенствования. Ландшафт угроз динамичен, постоянно появляются новые инструменты ИИ и векторы атак. Поэтому отслеживание состояния рисков ИИ в вашей организации с течением времени крайне важно для обеспечения эффективности ваших мер защиты. Это требует постоянного мониторинга и использования метрик для количественной оценки уровня риска и эффективности ваших средств контроля.

Ключевые показатели эффективности (KPI) могут включать количество обнаруженных несанкционированных инструментов ИИ, объём предотвращенных случаев утечки данных и процент сотрудников, прошедших обучение по безопасности с использованием ИИ. Регулярные аудиты и тестирование на проникновение, специально ориентированные на системы ИИ, также могут дать ценную информацию о слабых местах вашей защиты. Постоянно оценивая и совершенствуя свой подход, вы создаёте устойчивую программу безопасности, адаптируемую к меняющимся вызовам мира, управляемого ИИ. Такая проактивная позиция гарантирует, что ваша организация сможет продолжать уверенно и безопасно использовать возможности ИИ, превращая потенциальный источник катастрофического риска в эффективно управляемое стратегическое преимущество.