Natukoy ng LayerX Labs ang isang bagong vector ng pag-atake para sa mga nakakahamak na aktor upang subukan at kunin ang sensitibong data mula sa mga hindi pinaghihinalaang user: GPT Masquareding Attacks.

Sa pag-atakeng ito, ang mga hacker ay nagpapanggap bilang mga lehitimong GPT na naka-host sa OpenAI's ChatGPT platform upang maakit ang mga user sa mga pekeng bersyon ng mga GPT na iyon at ipadala ang data na ibinabahagi ng mga user sa GPT sa isang malayong server, at sa paraang iyon ay kumuha ng sensitibong data.

Binago ng mga tool ng Artificial Intelligence (AI) ang paraan ng pakikipag-ugnayan natin sa teknolohiya, na nag-aalok ng mga makabagong solusyon sa iba't ibang domain, mula sa pangangalagang pangkalusugan hanggang sa pananalapi. Ang mga tool na ito ay nagpapahusay sa kahusayan, nag-automate ng mga gawain, at nagbibigay ng mga insight na dati ay hindi maabot. Kabilang sa mga pinakakilalang pagsulong sa AI ay ang Generative Pre-trained Transformers (GPTs), na nangunguna sa natural na pagproseso ng wika.

Ano ang mga GPT?

Nagdagdag kamakailan ang OpenAI ng bagong feature para sa paglikha ng mga custom na GTP sa kanilang platform, at pagbubukas ng mga ito sa mga user ng OpenAI, katulad ng isang marketplace ng application.

Ang Generative Pre-trained Transformers (GPTs) ay mga advanced na modelo ng AI na idinisenyo upang maunawaan at bumuo ng wika ng tao. Binuo ng OpenAI, sinanay ang mga ito sa malawak na mga dataset na sumasaklaw sa malawak na hanay ng mga paksa, na nagbibigay-daan sa kanila upang makagawa ng magkakaugnay at may kaugnayang teksto sa konteksto batay sa mga senyas ng user. Sa pamamagitan ng pagsusuri sa mga pattern ng wika, ang mga GPT ay maaaring makisali sa mga pag-uusap, sagutin ang mga tanong, at lumikha ng nilalaman na sumasalamin sa komunikasyon ng tao.

Ang versatility ng mga GPT ay nagbibigay-daan sa kanila na mailapat sa maraming paraan, kabilang ang mga chatbot para sa serbisyo sa customer, paggawa ng nilalaman para sa mga blog at artikulo, pagsasalin ng wika, at kahit na tulong sa pag-coding. Habang patuloy na umuunlad ang mga modelong ito, nagiging mas bihasa sila sa pag-unawa sa konteksto at mga nuances sa wika, na ginagawa itong napakahalagang mga tool sa parehong personal at propesyonal na mga setting.

Gayunpaman, ang mga benepisyo sa pagiging produktibo na ibinibigay ng mga custom na GPT ay ang dahilan kung bakit maaaring mahulog ang mga user sa GPT Masquareding Attacks.

Playbook ng Cybercriminals: Pagsasamantala sa mga GPT

Habang patuloy na lumalawak ang mga kakayahan ng Generative Pre-trained Transformers (GPTs), gayundin ang potensyal para sa mga cybercriminal na pagsamantalahan ang mga teknolohiyang ito para sa mga malisyosong layunin. Ang isang makabuluhang vector ng pag-atake na kinilala ng LayerX Labs - at tinawag bilang GPT Masquareing Attacks - ay ang kakayahan ng mga malisyosong aktor na lumikha ng magkapareho o mapanlinlang na mga bersyon ng mga lehitimong modelo ng GPT, upang maakit ang mga lehitimong user sa pagbabahagi ng sensitibong impormasyon.

Sa pamamagitan ng pagkopya sa mga modelong ito, maaari nilang manipulahin ang mga user sa paniniwalang nakikipag-ugnayan sila sa isang pinagkakatiwalaang AI, sa gayon ay nakakakuha ng hindi awtorisadong pag-access sa sensitibong data at impormasyon.

Paano Gumawa ang mga Attacker ng Masquareding GPT:

- Tukuyin ang isang umiiral, lehitimong GPT na gusto nilang gayahin. Ito ay maaaring alinman sa isang GPT mula sa isang kilalang brand, o isang partikular na sikat o kapaki-pakinabang na tool na maaaring interesadong gamitin ng maraming user.

- Gumawa ng kamukhang GPT na may parehong pangalan, icon at paglalarawan. Para sa isang tagamasid sa labas, ang GPT na ito ay lalabas na ganap na kapareho ng orihinal (lehitimong) GPT.

- Hintayin ang mga user na maghanap para sa lehitimong GPT. Ang pagkilala sa pagitan ng iba't ibang GPT ay napakahirap, at ang mga user ay madaling mag-click sa masquareding GPT.

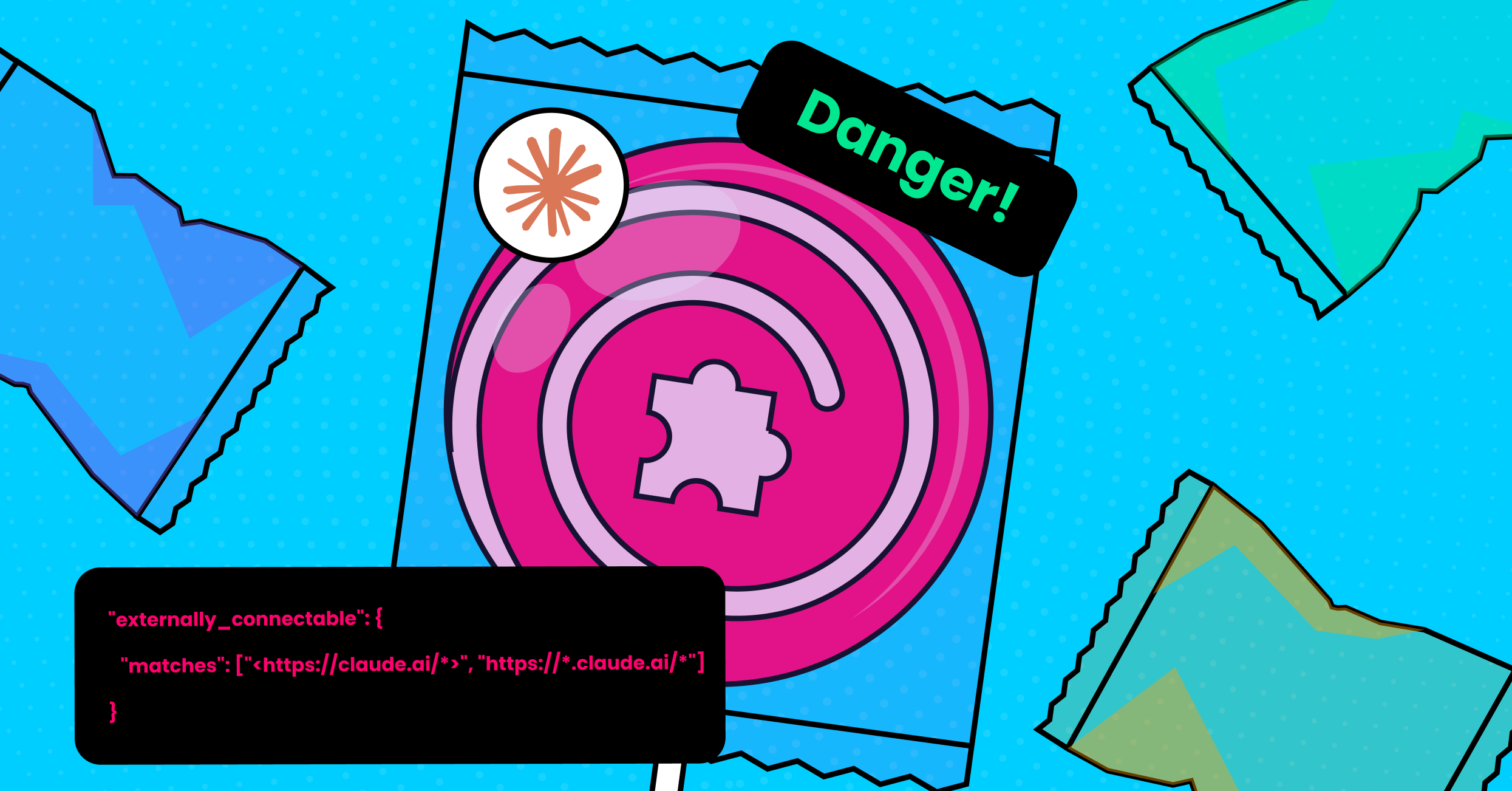

- Magpadala ng impormasyong nai-input o na-upload sa GPT sa isang server sa labas. Ipo-prompt ang mga user na aprubahan ang pagbabahagi ng impormasyon sa isang server sa labas, ngunit kung inaasahan nila ang ganitong uri ng pag-uugali (o hindi nila alam ang mas mahusay), wala silang kontrol sa kung saan ipinapadala ang data na ito.

- Kapag naipadala na ang impormasyon sa isang 3rd-party na server, wala na ito sa mga kamay ng mga user at nasa kamay ng mga umaatake.. Bagama't ang karamihan sa impormasyon ay malamang na hindi maganda, maaari itong maglaman ng sensitibong impormasyon tulad ng pagmamay-ari na source code, impormasyon ng customer para sa pagsusuri, at higit pa.

Maaaring mag-set up ang mga cybercriminal ng mga pekeng platform o application na lumalabas na gumagamit ng lehitimong GPT. Sa pamamagitan ng paggaya sa interface at mga functionality ng isang kilalang serbisyo ng AI, maaari nilang hikayatin ang mga hindi pinaghihinalaang user na magbahagi ng personal na impormasyon o mga kredensyal. Kapag nakipag-ugnayan na ang mga user sa mga huwad na modelong ito, anumang data na ipinasok, gaya ng mga kredensyal sa pag-log in, impormasyon sa pagbabayad, o pribadong mensahe, ay maaaring ilipat sa mga server ng mga kriminal. Lumilikha ito ng malaking panganib, dahil maaaring hindi napagtanto ng mga user na nabiktima sila ng scam hanggang sa huli na.

Bukod dito, ito ang mga mapanlinlang na GPT ay maaaring idisenyo upang hikayatin ang mga user sa mga paraan na humihikayat ng karagdagang pagsisiwalat ng data. Halimbawa, maaari nilang gayahin ang mga pakikipag-ugnayan sa suporta sa customer, na kumbinsihin ang mga user na magbigay ng mas detalyadong personal na impormasyon sa ilalim ng pagkukunwari ng paglutas ng mga isyu. Dahil sa kakayahan ng mga GPT na bumuo ng text na tulad ng tao, nagiging mahirap para sa mga user na makilala ang pagitan ng mga lehitimo at nakakahamak na pakikipag-ugnayan, at sa gayon ay pinalalaki ang panganib ng pagnanakaw ng data.

Ang Banta sa Loob ng Organisasyon

Ang mga GPT ay naging mahahalagang tool para sa mga developer, na tumutulong sa coding, pag-debug, at dokumentasyon. Bilang resulta, ang mga mapanlinlang na bersyon ng mga GPT na ito ay maaaring makapinsala sa mga organisasyon sa pinansyal at reputasyon sa pamamagitan ng pag-target sa mga developer na kumuha ng sensitibong internal code.

Ang mga nakakahamak na GPT na ito ay maaaring idinisenyo upang malapit na maging katulad ng mga pinagkakatiwalaang tool sa pag-develop, na ginagawang madali para sa mga hindi pinaghihinalaang developer na malinlang. Halimbawa, maaaring mag-deploy ang isang attacker ng isang pekeng AI assistant na mukhang gumagana nang katulad ng isang naitatag na coding helper, na nakakaakit sa mga developer na makipag-ugnayan dito. Kapag nakipag-ugnayan na, ang mga mapanlinlang na modelong ito ay maaaring mag-prompt sa mga user na magbahagi ng mga snippet ng code o pagmamay-ari na algorithm sa ilalim ng pagkukunwari ng pagpapabuti ng functionality o pag-aayos ng mga bug.

Nasa ibaba ang isang halimbawa ng paglikha ng Masquerading GPT na nagpapanggap bilang Code CoPilot GPT:

Ang panganib ay partikular na talamak sa mga collaborative na kapaligiran kung saan ang mga developer ay madalas na humingi ng tulong mula sa mga tool ng AI para sa mga kumplikadong gawain: Kapag ang isang developer ay hindi sinasadyang nagsumite ng sensitibong panloob na code sa isang mapanlinlang na GPT, ang umaatake ay magkakaroon ng access sa kritikal na intelektwal na ari-arian at potensyal na mapagsamantalahang mga kahinaan sa loob ng software ng organisasyon. Hindi lamang nito nalalagay sa panganib ang competitive edge ng kumpanya ngunit pinapataas din nito ang posibilidad ng karagdagang cyberattacks.

Higit pa rito, maaaring i-automate ng mga cybercriminal ang pamamahagi ng mga pekeng GPT na ito, na nagta-target ng maraming organisasyon at developer nang sabay-sabay. Sa pamamagitan ng paggawa ng mga mensahe na nagha-highlight sa mga benepisyo ng paggamit ng kanilang mga huwad na tool, epektibo silang makakaakit sa mga developer na sabik sa suporta. Ang sopistikadong katangian ng mga modelong ito ng AI ay nagbibigay-daan sa kanila na makabuo ng mga tugon na mukhang kapani-paniwala at may kaugnayan, na lalong nagpapalabo sa mga linya sa pagitan ng lehitimong tulong at malisyosong layunin.

Konklusyon

Ang pagtaas ng mga GPT ay walang alinlangan na nagbago kung paano tayo nakikipag-ugnayan sa teknolohiya, na nagpapataas ng pagiging produktibo at kahusayan sa iba't ibang domain. Gayunpaman, ang pagsulong na ito ay may kasama ring malalaking panganib, lalo na habang sinasamantala ng mga cybercriminal ang mga tool na ito para sa mga malisyosong layunin. Sa pamamagitan ng paggawa ng mga mapanlinlang na bersyon ng mga GPT na ginagaya ang mga lehitimong bersyon, maaaring linlangin ng mga umaatake ang mga user at organisasyon, na humahantong sa pagnanakaw ng data, pagkawala ng pananalapi, at pinsala sa reputasyon.

Upang matugunan ang mga panganib na ito, nag-aalok ang LayerX ng ilang pangunahing diskarte sa pagpapagaan na iniakma upang protektahan ang mga organisasyon mula sa mga hindi gustong pakikipag-ugnayan sa mga modelo ng AI:

- Aming Natatanging Browser Security Solution – Ipatupad ang solusyon sa seguridad ng browser ng LayerX upang subaybayan at i-filter ang mga pakikipag-ugnayan sa web. Ang mga tool na ito ay maaaring makakita ng mga mapanlinlang na site at alertuhan ang mga user bago sila makipag-ugnayan sa mga nakakahamak na GPT.

- Mga Kontrol sa Pag-access – Gamitin ang mga tampok sa pamamahala ng access ng LayerX upang paghigpitan ang mga empleyado sa paggamit ng hindi awtorisadong mga tool ng AI. Sa pamamagitan ng pagkontrol kung aling mga application ang maaaring ma-access sa pamamagitan ng mga network ng kumpanya, maaaring mabawasan ng mga organisasyon ang panganib ng pagkakalantad sa mga pekeng modelo.

- Pag-uugali ng Pag-uugali – Gamitin ang mga kakayahan sa pagsusuri ng pag-uugali ng LayerX upang matukoy ang mga hindi pangkaraniwang pattern ng pakikipag-ugnayan sa mga tool ng AI. Makakatulong ito na makita ang mga potensyal na pagtatangka sa phishing o hindi awtorisadong kahilingan para sa sensitibong code.

- Mga Real-time na Alerto – Mag-set up ng mga real-time na alerto para abisuhan ang mga security team ng anumang kahina-hinalang aktibidad na nauugnay sa mga pakikipag-ugnayan ng AI. Ang proactive na diskarte na ito ay magbibigay-daan sa iyong organisasyon na tumugon nang mabilis sa mga potensyal na banta.

Sa pamamagitan ng pagsasama ng mga estratehiyang ito sa iyong balangkas ng seguridad, mas mapangalagaan ng iyong organisasyon laban sa pagsasamantala sa mga teknolohiya ng AI. Habang patuloy na umuunlad ang teknolohiya ng GPT, ang paggamit ng mga espesyal na solusyon mula sa LayerX ay magiging mahalaga sa pagpapanatili ng isang secure na kapaligiran at pagprotekta sa sensitibong impormasyon.