Ang mabilis na pagsasama ng Generative AI sa pang-araw-araw na daloy ng trabaho ay lumikha ng malaking agwat sa kakayahang makita para sa mga pangkat ng seguridad ng negosyo. Hindi na naghihintay ang mga empleyado ng pag-apruba ng IT upang gumamit ng mga bagong tool. Aktibo silang naghahanap ng mga extension ng browser at mga web-based na chatbot upang mapataas ang kanilang produktibidad. Ang desentralisadong pag-aampon na ito ay naging dahilan upang maging hindi epektibo ang mga tradisyonal na perimeter defense. Hindi mo mase-secure ang hindi mo nakikita. Upang mabawi ang kontrol sa lumalawak na ecosystem na ito, dapat simulan ng mga organisasyon ang isang komprehensibong AI audit.

Ang prosesong ito ay hindi lamang isang pagsasanay sa pagsunod. Ito ay isang kritikal na kinakailangan sa operasyon para sa 2025. Ang layunin ay tuklasin ang mga partikular na aplikasyon at daloy ng data na kasalukuyang umiiral sa iyong kapaligiran. Sa pamamagitan ng pagtukoy sa hindi awtorisadong paggamit, na kadalasang tinutukoy bilang "Shadow AI," maaari mo nang simulan ang pagbilang ng iyong aktwal na pagkakalantad sa panganib. Ang isang epektibong audit ay naglilipat ng iyong postura sa seguridad mula sa reaktibong pag-apula ng sunog patungo sa proaktibong pamamahala. Pinapayagan ka nitong maunawaan hindi lamang kung aling mga tool ang naroroon, kundi pati na rin kung paano ang mga ito ginagamit at kung anong data ng korporasyon ang nagpapakain sa kanila.

Ang Nakatagong Saklaw ng Shadow AI

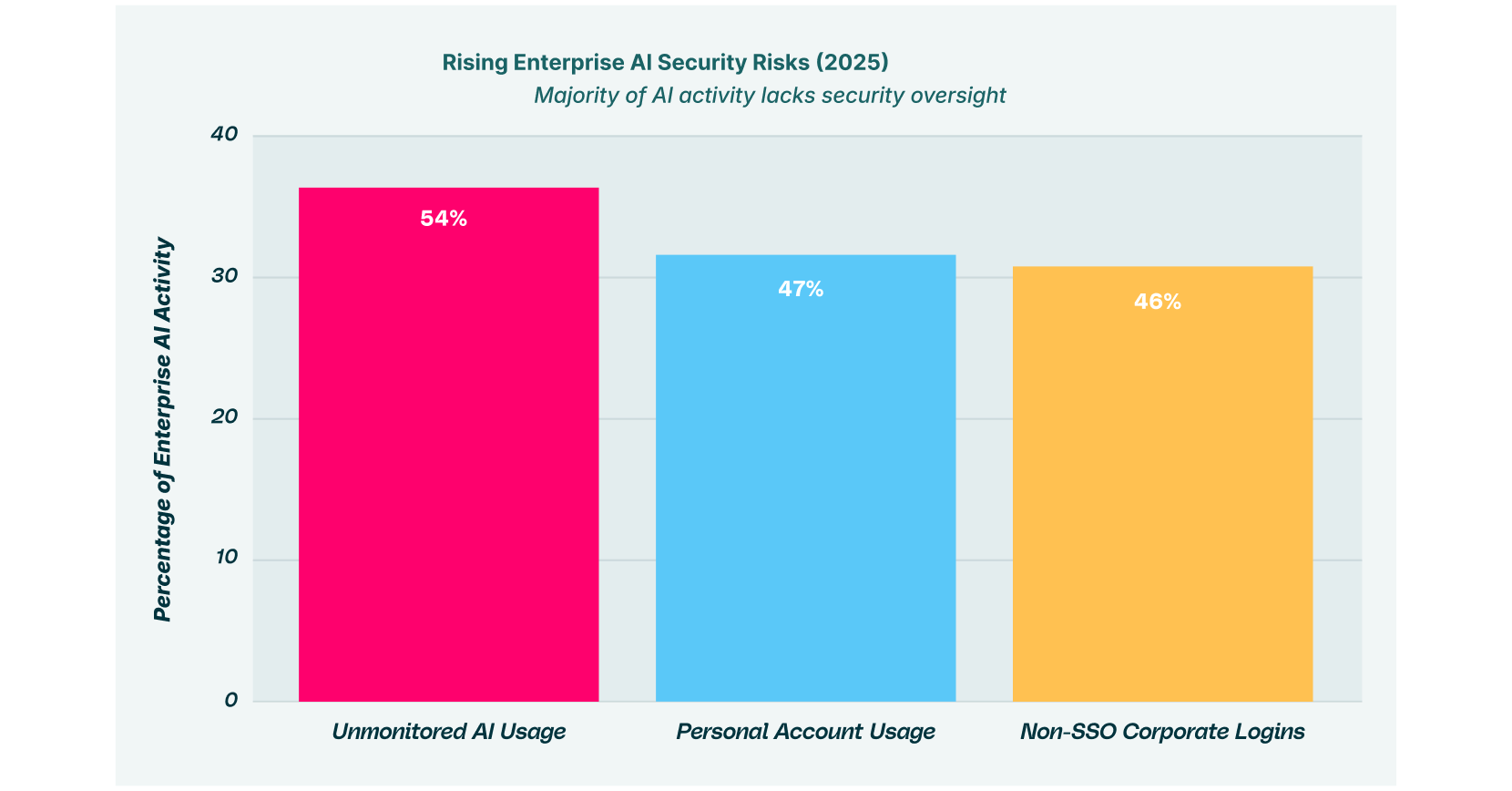

Gaya ng inilalarawan sa Figure 1 sa itaas, ang laki ng hindi minomonitor na aktibidad ay kadalasang nakakagulat sa mga lider ng seguridad. Kapag 89% ng paggamit ng AI ay nangyayari sa labas ng pangangasiwa ng korporasyon, ang mga karaniwang security log ay nabibigong magbigay ng tumpak na larawan ng panganib. Madalas na ginagamit ng mga empleyado ang mga personal na email account upang mag-log in sa mga serbisyong ito, na nilalampasan ang mga Single Sign-On (SSO) protocol na karaniwang magti-trigger ng audit trail. Lumilikha ito ng isang pira-piraso na identity landscape kung saan ang corporate data ay nananatili sa mga account na hindi ma-access o ma-deprovision ng IT.

Ang isang AI audit ay nagsisilbing pangunahing mekanismo upang maliwanagan ang hindi nakikitang aktibidad na ito. Mas malalim itong naghuhukay kaysa sa pagsusuri ng trapiko sa antas ng network, na kadalasang nahihirapang i-decrypt ang mga nilalaman ng mga modernong sesyon ng web. Sa halip, tinitingnan ng isang browser-centric audit ang aktwal na pag-render ng mga web page at ang pagpapatupad ng mga extension. Ang antas ng detalyeng ito ay kinakailangan upang makilala ang pagkakaiba sa pagitan ng isang hindi nakakapinsalang pagbisita sa isang tech blog at isang aktibong sesyon kung saan ang proprietary code ay ipini-paste sa isang chatbot para sa pag-optimize.

Mahalaga ang kakayahang makitang ito para sa pagmamapa ng iyong "attack surface." Ang bawat hindi minomonitor na browser extension ay isang potensyal na entry point para sa mga pag-atake sa supply chain. Ang bawat personal na GenAI account ay isang potensyal na silo para sa pagtagas ng data. Sa pamamagitan ng pagsisiwalat ng mga shadow asset na ito, ginagawa mo ang unang tiyak na hakbang tungo sa isang ligtas na enterprise browser environment.

Pagbuo ng Iyong Balangkas ng Pag-audit ng AI

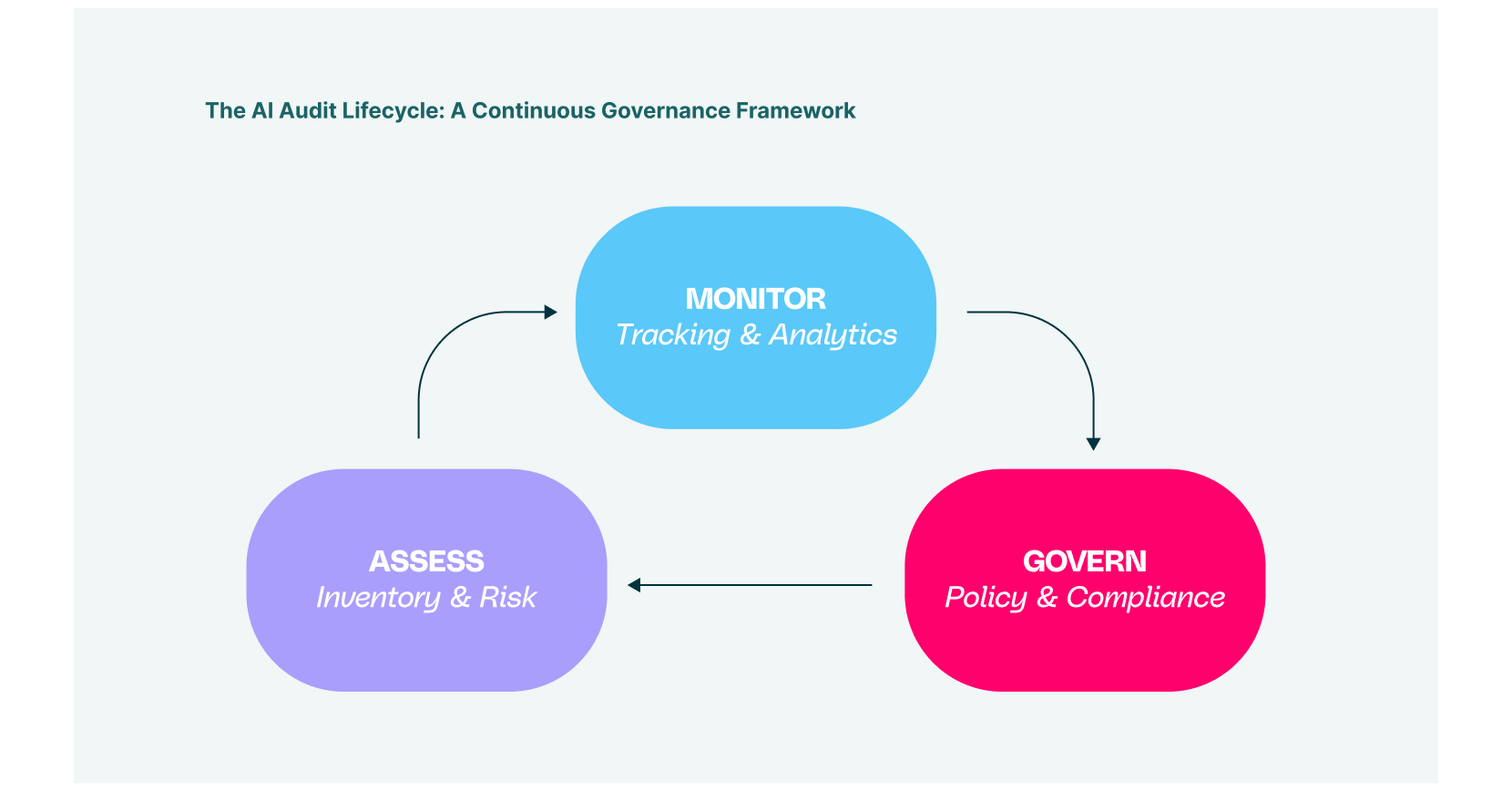

Mahalaga ang pagtatatag ng isang nakabalangkas na pamamaraan para sa tagumpay. Ang isang paminsan-minsan o ad-hoc na pagsusuri ay magbubunga lamang ng mga bahagyang resulta. Sa halip, dapat gamitin ng mga pinuno ng seguridad ang isang paikot na balangkas ng pag-audit ng AI na tinatrato ang seguridad bilang isang patuloy na proseso sa halip na isang minsanang pangyayari lamang. Dapat isaalang-alang ng balangkas na ito ang pabagu-bagong katangian ng merkado ng GenAI, kung saan ang mga bagong modelo na may mga nobelang kakayahan ay inilalabas linggu-linggo.

Ang balangkas ay nakabatay sa tatlong pangunahing haligi: Pagtatasa, Pagsubaybay, at Pamamahala. Ang mga yugtong ito ay magkakaugnay. Ang iyong pagtatasa ang nagbibigay-impormasyon sa iyong estratehiya sa pagsubaybay, na siya namang bubuo ng datos na kinakailangan para sa epektibong pamamahala. Hindi tulad ng mga static na asset ng software, ang mga modelo ng AI ay umuunlad batay sa kanilang mga input at datos ng pagsasanay. Samakatuwid, ang iyong balangkas ng pag-audit ng AI ay dapat na sapat na maliksi upang umangkop sa mga pagbabagong ito nang hindi nangangailangan ng kumpletong muling pagsulat ng iyong mga patakaran bawat quarter.

Yugto 1: Pagtatasa at Pagtuklas ng Ari-arian

Ang lifecycle ay nagsisimula sa isang mahigpit na proseso ng imbentaryo. Ang unang yugto ng iyong AI security audit ay dapat na nakatuon sa ganap na pagtuklas. Ito ay higit pa sa simpleng paglilista ng mga vendor na kasalukuyan mong binabayaran. Dapat mong tukuyin ang bawat digital touchpoint kung saan nakikipag-ugnayan ang corporate data sa isang algorithmic model. Sa modernong enterprise, ang interaksyon na ito ay pangunahing nangyayari sa loob ng web browser, na ginagawang ang browser ang pinakamahalagang sensor sa iyong security stack.

Kailangang mag-deploy ang mga security team ng mga tool na may kakayahang siyasatin ang trapiko ng browser upang matukoy ang mga API call sa mga serbisyo ng AI. Kabilang dito ang mga pangunahing platform tulad ng OpenAI at Anthropic, pati na rin ang "mahabang buntot" ng libu-libong niche AI productivity tool. Ang isang masusing AI security audit ay kadalasang magbubunyag ng daan-daang hindi naaprubahang application, mula sa mga grammar checker hanggang sa mga automated meeting notetaker, na tahimik na nai-install ang kanilang mga sarili sa corporate workflow.

Mahalaga ring ikategorya ang mga asset na ito ayon sa kanilang risk profile. Inaangkin ba ng tool ang pagmamay-ari ng input data? Ibinabahagi ba nito ang data sa mga ikatlong partido para sa mga layunin ng pagsasanay? Dapat na maiba ng iyong imbentaryo ang pagkakaiba sa pagitan ng mga "Enterprise" na instance na nag-aalok ng mga garantiya sa privacy ng data at mga bersyong "Consumer" na hindi nag-aalok. Ang pagkakaibang ito ay kadalasang siyang pagkakaiba sa pagitan ng isang secure na workflow at isang paglabag sa pagsunod.

Yugto 2: Malalim na Pagsusuri sa AI/ML Security Audit

Kapag nakapagtakda ka na ng malinaw na imbentaryo, ang pokus ay lilipat sa mga modelo mismo. Bagama't karamihan sa mga negosyo ay gumagamit ng AI sa pamamagitan ng SaaS, ang mga bumubuo ng mga internal na tool ay nahaharap sa isang natatanging hanay ng mga hamon. Kinakailangan dito ang isang AI/ML security audit upang suriin ang integridad ng modelo at ang training pipeline nito. Dito mo susuriin ang mga "sangkap" ng iyong mga internal na proyekto sa AI.

Sinusuri ng partikular na uri ng audit na ito ang pinagmulan ng iyong data at ang seguridad ng iyong mga library. Gumagamit ka ba ng mga open-source na component na may mga kilalang kahinaan? Ang training data ba na ginagamit sa iyong mga modelo ay ligtas sa mga poisoning attack? Sa isang AI/ML security audit, hinahanap mo ang mga kahinaan na maaaring samantalahin ng isang kalaban upang manipulahin ang output ng modelo o maghinuha ng sensitibong training data sa pamamagitan ng mga inversion attack.

Halimbawa, isipin ang isang senaryo kung saan ang isang panloob na modelo ng pananalapi ay sinanay sa hindi malinis na pampublikong datos. Kung ang datos na iyon ay naglalaman ng mga nakatagong malisyosong pattern, ang modelo ay maaaring malinlang sa paggawa ng mga maling hula. Sa pamamagitan ng stress-testing ng iyong mga proprietary na modelo laban sa mga adversarial na pamamaraan na ito, tinitiyak mo na ang iyong mga panloob na inobasyon ay hindi magiging mga pananagutan. Ang antas ng pagsisiyasat na ito ay mahalaga para sa mga organisasyong nagde-deploy ng mga customer-facing AI agent.

Pagtugon sa mga Panganib ng Pagtagas ng Datos

Marahil ang pinakamahalagang alalahanin ng mga CISO ngayon ay ang pag-exfiltrate ng datos. Napakadali para sa isang empleyado na walang-malay na i-paste ang isang sensitibong listahan ng customer sa isang chatbot upang "i-format ito nang maayos." Ang simpleng aksyon na ito ay maituturing na isang paglabag sa datos. Ang isang AI data security audit ay partikular na nakatuon sa mga daloy ng datos na ito upang maiwasan ang hindi na mababawi na pagkawala.

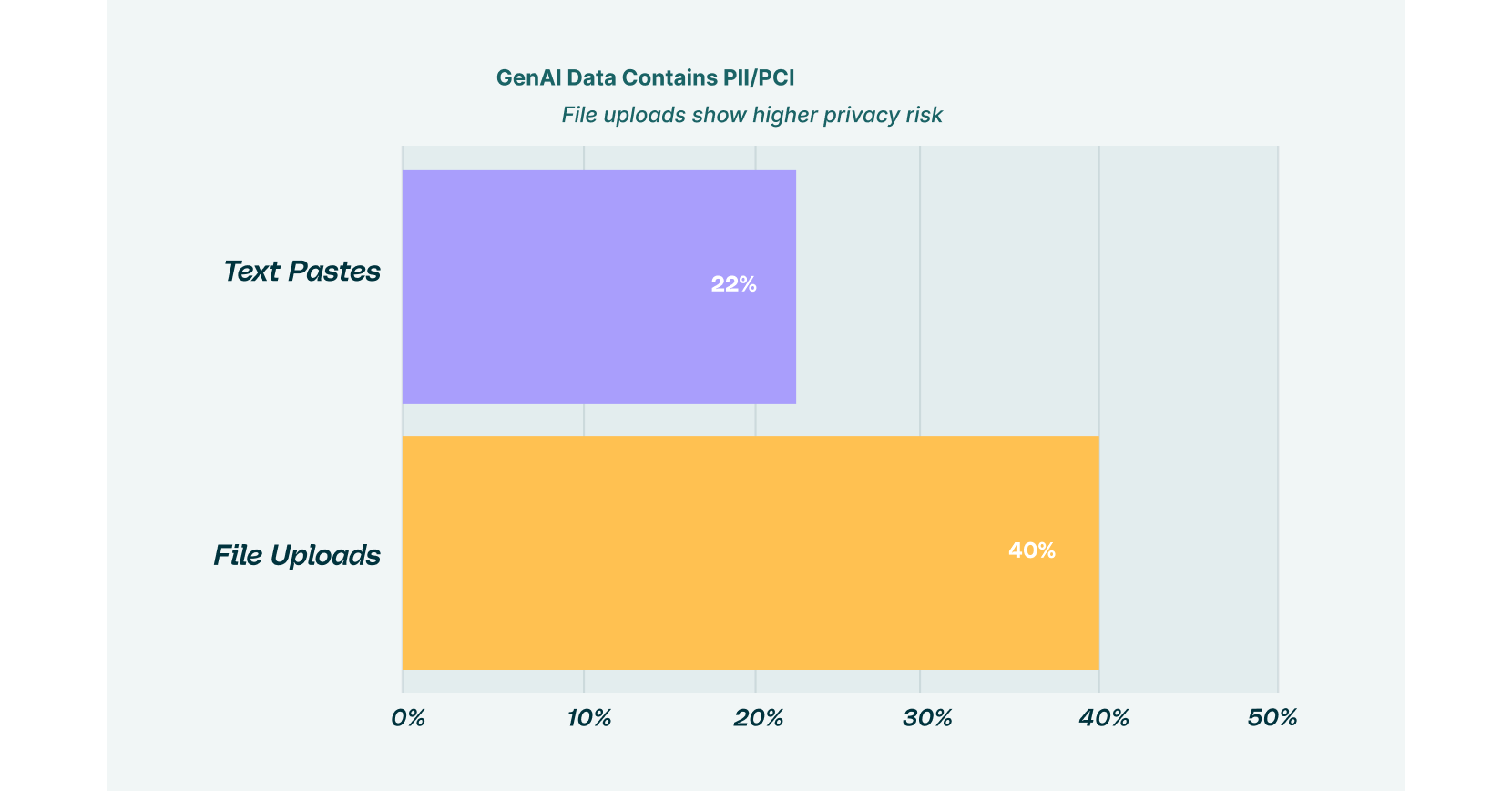

Ang browser ang nagsisilbing gateway para sa data na ito. Ang mga text paste, pag-upload ng file, at pagsusumite ng form ang mga pangunahing mekanismo ng exfiltration. Kailangang ikategorya ng iyong audit ang mga interaksyong ito nang may katumpakan. Hindi sapat ang malaman lamang na bumisita ang isang user sa isang GenAI site; dapat mong malaman kung ano ang ipinadala nila dito at kung bakit.

Pagsasagawa ng isang AI Data Security Audit

Gaya ng ipinapakita sa Figure 3, ang mga pag-upload ng file ay partikular na mapanganib. Ang mga dokumento ay kadalasang naglalaman ng hindi nakabalangkas na data, mga pinansyal na projection, legal na estratehiya, at PII, na mas mahirap i-filter kaysa sa mga simpleng text string. Ang isang mahigpit na AI data security audit ay magpapatupad ng mga panuntunan ng DLP (Data Loss Prevention) na mag-i-scan sa mga upload na ito nang real-time. Tinitiyak nito na ang mga file na tumutugma sa mga sensitibong pattern ay naharang bago pa man sila umalis sa browser.

Dapat mo ring isaalang-alang ang konteksto ng datos. Maaaring katanggap-tanggap ang pagpe-paste ng code ng isang developer sa isang ligtas at sanctioned na AI tool ng enterprise. Ang pagpe-paste ng parehong code ng developer sa isang pampubliko at free-tier na chatbot ay isang mapanganib na pangyayari. Ang iyong AI data security audit ay dapat makatulong sa iyo na tukuyin ang mga kontekstong hangganang ito. Pinapayagan ka nitong bumuo ng mga patakaran na sapat na detalyado upang mapigilan ang masamang pag-uugali nang hindi hinaharangan ang lehitimong trabaho.

Bukod pa rito, dapat suriin ng prosesong ito ng pag-audit ang panganib ng "prompt injection." Nangyayari ito kapag ang mga malisyosong tagubilin ay nakatago sa loob ng nilalamang pinoproseso ng isang AI. Kung gumagamit ang iyong mga empleyado ng AI upang ibuod ang mga web page o email, maaari silang maging mahina sa mga hindi direktang pag-atake na nagmamanipula sa AI upang maging mga exfiltrating data. Dapat patunayan ng iyong pag-audit na ang iyong mga tool sa seguridad ng browser ay makakakita at makakapaghiwalay sa mga potensyal na banta na ito.

Patuloy na Pagsubaybay gamit ang BDR

Ang isang audit na nagtatapos sa isang static na PDF report ay isang bigong audit. Ang mga natuklasan ay dapat na lumipat sa isang estado ng aktibo at patuloy na pagsubaybay. Dito nagiging mahalaga ang konsepto ng Browser Detection & Response (BDR) sa balangkas ng AI audit. Ang mga tool ng BDR ay nagbibigay ng telemetry na kinakailangan upang mapanatili ang yugto ng "Monitor" ng lifecycle, na ginagawang isang live na video feed ng iyong seguridad ang isang snapshot sa oras.

Nag-aalok ang BDR ng kakayahang makita ang aktwal na DOM (Document Object Model) ng web page. Nagbibigay-daan ito sa mga security team na makita nang eksakto kung paano nakikipag-ugnayan ang mga user sa mga AI tool sa real time. Masusubaybayan mo kung aling mga extension ang ini-install, kung aling mga form ang pinupunan, at kung saan naglalakbay ang data. Tinitiyak ng patuloy na daloy ng data na ito na mananatiling may kaugnayan ang iyong AI audit kahit na nagbabago ang pag-uugali ng user.

Ang kakayahang ito sa real-time ay mahalaga para sa pagtukoy ng "pag-anod." Sa paglipas ng panahon, maaaring magbago ang mga aprubadong tool sa kanilang mga tuntunin ng serbisyo, o maaaring bumalik ang mga empleyado sa paggamit ng mga hindi awtorisadong personal na account. Agad na natutukoy ng patuloy na pagsubaybay ang mga pagbabagong ito. Pinapayagan ka nitong makialam sa sandaling lumitaw ang isang bagong panganib, sa halip na maghintay para sa susunod na taunang siklo ng pagtatasa.

Pamamahala at Pagpapatupad ng Patakaran

Ang huling bahagi ng palaisipan ay ang pamamahala. Ang mga regulasyon tulad ng EU AI Act at iba't ibang batas sa privacy ng data ay humihingi ng mahigpit na pananagutan. Ang iyong balangkas ng AI audit ay dapat bumuo ng mga kinakailangang artifact upang patunayan ang pagsunod. Kabilang dito ang pagdodokumento hindi lamang kung anong mga tool ang ginagamit, kundi pati na rin kung paano ginagawa ang mga desisyon tungkol sa kanilang pag-apruba at paggamit.

Kung ang isang AI/ML security audit ay magpapakita ng isang high-risk na modelo, dapat ipakita ng governance log ang mga hakbang sa remediation na ginawa. Inalis mo na ba ang komisyon ng modelo? Nagpatupad ka ba ng mga karagdagang guardrail? Mahalaga rito ang awtomatikong pag-uulat. Hindi kayang gumugol ng ilang linggo nang manu-mano ang mga security team sa pag-compile ng mga spreadsheet para sa mga auditor. Tinitiyak ng dashboard-driven na pag-uulat na direktang kumukuha mula sa browser telemetry na ang iyong ebidensya ay laging handa at tumpak.

Nagbibigay-daan din ang governance layer na ito sa mga patakarang "coaching". Sa halip na isang binary na pamamaraang "allow" o "block", na kadalasang nagtutulak sa mga user patungo sa Shadow IT, maaari kang magpatupad ng real-time na edukasyon sa user. Kung ang isang user ay sumubok ng isang mapanganib na aksyon, maaaring makialam ang browser sa pamamagitan ng isang pop-up na nagpapaliwanag ng panganib at nagmumungkahi ng isang ligtas na alternatibo. Iginagalang nito ang layunin ng user na maging produktibo habang ipinapatupad ang mga kinakailangang hangganan sa seguridad.

Paano Isama ang AI sa Iyong Negosyo?

Hindi maiiwasan ang pagsasama ng AI sa negosyo. Ang mga organisasyong uunlad sa bagong panahong ito ay yaong mga ligtas na makakagamit ng kapangyarihan nito nang hindi isinasakripisyo ang kanilang data. Ang isang nakalaang AI audit ang pundasyonal na hakbang sa paglalakbay na ito. Nililinis nito ang ulap ng Shadow AI, tinutukoy ang mga bitak kung saan maaaring tumagas ang data, at nagtatatag ng ritmo ng patuloy na pagpapabuti.

Sa pamamagitan ng pag-aampon ng isang browser-first AI audit framework, inilalagay mo ang seguridad kung saan mismo nagaganap ang trabaho. Magkakaroon ka ng kakayahang masuri nang tumpak ang mga panganib, ang kakayahang subaybayan ang mga interaksyon sa real-time, at ang karunungang pamahalaan nang may mga nuances. Simulan ang iyong pagtatasa ngayon. Imbentaryo ang iyong mga asset, suriin ang iyong mga daloy ng data, at i-secure ang browser. Ang kinabukasan ng iyong enterprise intelligence ay nakasalalay dito.