Ang Generative AI (GenAI) ay mabilis na lumipat mula sa isang bagong teknolohiya patungo sa isang pangunahing bahagi ng mga pagpapatakbo ng enterprise. Mula sa pagpapabilis ng pagbuo ng code hanggang sa pagbabago ng pakikipag-ugnayan ng customer, ang mga application nito ay lumalawak sa hindi pa nagagawang rate. Gayunpaman, ang malakas na alon ng pagbabagong ito ay nagdadala ng isang makabuluhang undercurrent ng panganib. Ang mismong mga modelo na bumubuo ng insightful, tulad ng tao na text ay maaari ding gumawa ng mapaminsalang, bias, at nakakalason na nilalaman, na nagpapakilala ng malaking legal, etikal, at mga hamon sa negosyo. Ang isyu ng GenAI toxicity ay hindi isang palawit na alalahanin; isa itong pangunahing hadlang sa ligtas at nasusukat na pag-aampon ng AI.

Para sa mga security analyst, CISO, at IT leaders, ang pag-unawa at pagpapagaan sa panganib na ito ay pinakamahalaga. Hindi sapat na yakapin lamang ang mga benepisyo ng pagiging produktibo ng GenAI; ang mga organisasyon ay dapat ding magtayo ng matibay na mga depensa laban sa potensyal nitong makapinsala. Nangangailangan ito ng masusing pagsusuri sa mga pinagmulan ng toxicity na ito, ang mga nasasalat na panganib na dulot nito, at ang mga mahahalagang kontrol na kinakailangan para sa epektibong pamamahala.

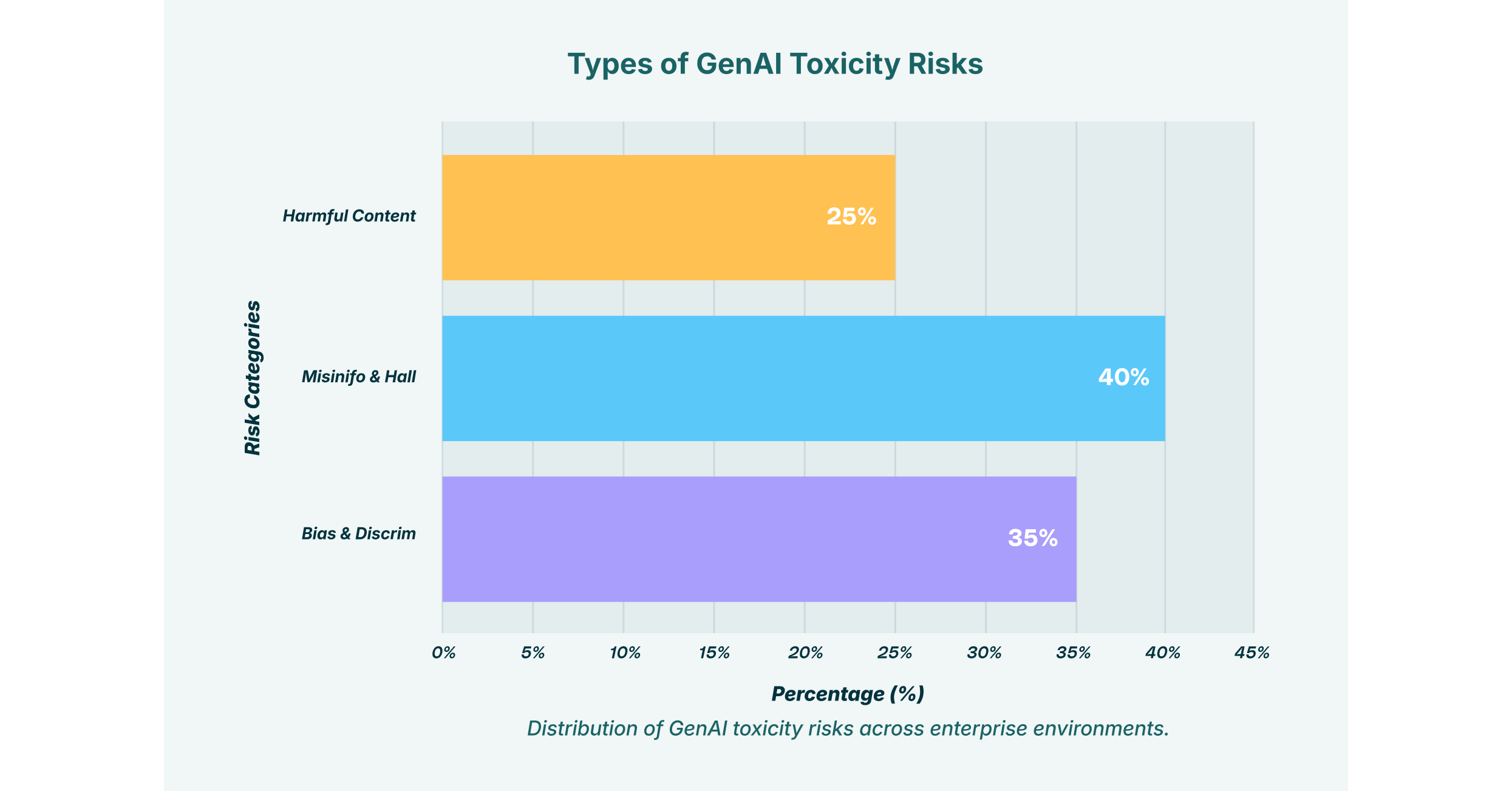

Ang terminong GenAI toxicity ay higit pa sa simpleng pagmumura o mapoot na salita. Sinasaklaw nito ang isang malawak na spectrum ng mapaminsalang nilalaman, kabilang ang banayad ngunit nakakapinsalang mga bias, ang pagpapalaganap ng maling impormasyon, at ang pagbuo ng hindi naaangkop na nilalaman na maaaring lumabag sa mga patakaran ng korporasyon at mga pamantayan ng lipunan. Ang mga pinagmulan ng toxicity na ito ay kasing kumplikado ng mga modelo mismo.

Sa kaibuturan nito, ang problema ay madalas na nagsisimula sa data ng pagsasanay. Ang Large Language Models (LLMs) ay sinanay sa napakalaking dataset na na-scrap mula sa internet, isang digital na pagmuni-muni ng sangkatauhan na kinabibilangan ng pinakamahuhusay nitong kaalaman at pinakamasamang pagkiling. Kung ang data ng pagsasanay ay baluktot, ang modelo ay hindi maiiwasang matutunan at gagayahin ang mga bias na iyon, na humahantong sa hindi patas o diskriminasyong mga output ng LLM. Ito ay maaaring magpakita bilang isang tool sa pagre-recruit na pinapaboran ang isang kasarian kaysa sa isa pa o isang bot ng payo sa pananalapi na nag-aalok ng iba't ibang mga termino ng pautang batay sa etnisidad.

Pinagsasama-sama ang isyung ito ay ang likas na "black box" ng maraming mga sistema ng GenAI. Ang masalimuot, multi-layered neural network na nagpapagana sa mga modelong ito ay nagpapahirap sa pagsubaybay sa isang partikular na output pabalik sa dahilan nito. Ang kawalan ng transparency na ito ay nagdudulot ng malaking hadlang para sa pamamahala ng GenAI, dahil ang pag-audit ng isang modelo para sa pagiging patas at kaligtasan ay nagpapakita ng isang malaking teknikal na hamon. Higit pa rito, maaaring samantalahin ng mga malisyosong aktor ang mga system na ito sa pamamagitan ng mga adversarial na pag-atake tulad ng "prompt injection" o "jailbreaking," kung saan ginagamit ang mga matalinong ginawang input upang i-bypass ang mga built-in na filter ng kaligtasan ng modelo at pilitin ito sa pagbuo ng mapaminsalang content.

Ang Mga Tangible na Panganib ng Mga Nakakalason na LLM Output

Kapag ang isang modelo ng GenAI ay gumagawa ng nakakalason na nilalaman, ang mga kahihinatnan ay malayo sa teoretikal. Para sa isang negosyo, ang pinsala ay maaaring agaran at malubha, na nakakaapekto sa lahat mula sa reputasyon ng tatak hanggang sa katatagan ng pagpapatakbo.

- Pinsala ng Brand at Reputasyon: Ang tiwala ng publiko ay marupok. Ang isang insidente na kinasasangkutan ng isang nakakalason na AI ay maaaring makabasag nito sa isang iglap. Halimbawa, nang ang GenAI tool ng Figma ay napag-alamang nangongopya sa mga naka-copyright na disenyo ng Apple, nagdulot ito ng malaking kahihiyan sa brand na nangangailangan ng pampublikong pagbawi. Sa isa pang kaso, legal na may pananagutan ang isang airline sa Canada para sa mapanlinlang na impormasyong ibinigay ng chatbot ng customer service nito, na nagpapakita na mananagot ang mga organisasyon sa mga pagkakamali ng kanilang AI.

- Mga Paglabag sa Legal at Pagsunod: Ang mga nakakalason o pinapanigang LLM na mga output ay maaaring humantong sa malubhang legal na problema. Ang mga discriminatory na output ay maaaring lumabag sa mga batas sa fairness-in-hiring, habang ang mga nag-leak o maling gumagamit ng personal na data ay maaaring sumama sa mga regulasyon tulad ng GDPR o HIPAA. Sa lubos na kinokontrol na mga industriya tulad ng pananalapi at pangangalagang pangkalusugan, ang mga stake sa pagsunod ay napakataas.

- Pagkagambala sa Negosyo at Operasyon: Ang epekto ng mga depektong output ng LLM ay hindi lamang panlabas. Sa panloob, ang pag-asa sa hindi tumpak o bias na impormasyong nabuo ng GenAI ay maaaring makagambala sa mga daloy ng trabaho, masira ang mga proseso ng paggawa ng desisyon, at magkalat ng maling impormasyon sa buong organisasyon. Isipin ang isang marketing team na kumikilos sa maling pagsusuri sa merkado mula sa isang GenAI tool o isang developer na nagpapatupad ng hindi secure na code na iminungkahi ng isang AI assistant. Maaaring napakalaki ng operational fallout.

- Pinataas na Banta sa Seguridad: Higit pa sa pagbuo ng nakakalason na nilalaman, ang GenAI ay maaaring maging sandata upang lumikha ng mga sopistikadong banta sa seguridad. Maaaring i-prompt ng mga attacker ang mga modelo na magsulat ng mga nakakakumbinsi na email ng phishing, bumuo ng polymorphic malware na umiiwas sa tradisyonal na pagtuklas, o gumawa ng mga script para sa mga pag-atake ng social engineering. Ito ay kumakatawan sa isang bagong hangganan ng GenAI-powered exfiltration at attack orchestration na dapat ihanda ng mga security team na harapin.

Detection: Pagkilala sa Bias at Toxicity

Upang makontrol ang toxicity ng GenAI, dapat mo muna itong makita. Ang pag-detect ng mapaminsalang content at mga pinagbabatayan na bias sa loob ng mga LLM ay isang kumplikado, multi-faceted na disiplina na pinagsasama ang statistical analysis, behavioral testing, at human oversight. Hindi kayang tratuhin ng mga organisasyon ang kanilang mga modelo bilang hindi nagkakamali; dapat silang magpatupad ng tuluy-tuloy at mahigpit na proseso para sa pagtuklas ng bias ng LLM.

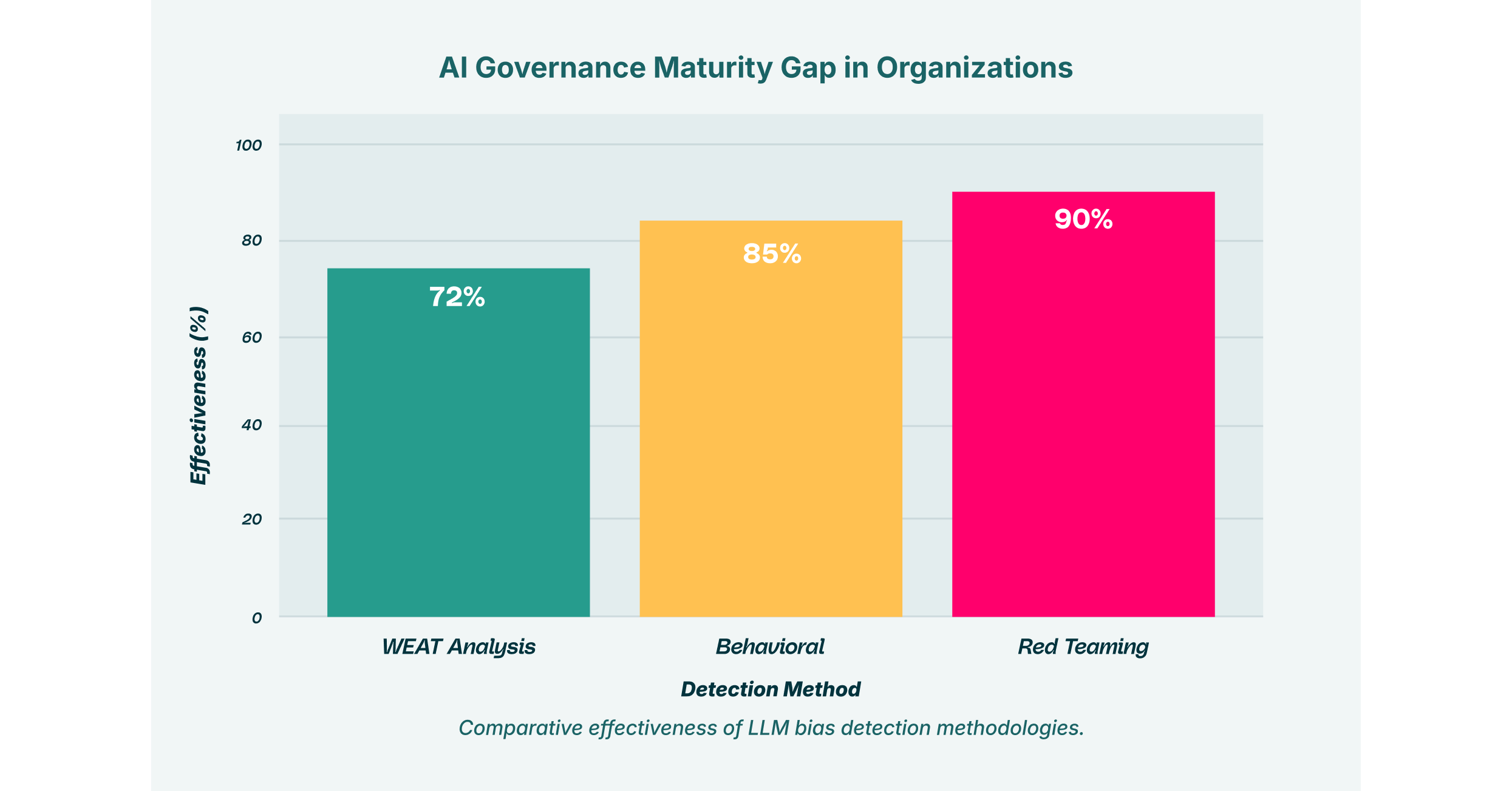

Ang isa sa mga mas teknikal na diskarte ay nagsasangkot ng mga pagsusulit na batay sa istatistika at pag-embed. Sinusuri ng mga diskarte tulad ng Word Embedding Association Test (WEAT) ang mga panloob na representasyon ng modelo upang masukat ang lakas ng pagkakaugnay sa pagitan ng iba't ibang konsepto, halimbawa, ang lapit ng mga salitang nauugnay sa ilang propesyon sa mga partikular na kasarian. Sa pamamagitan ng paggamit ng mga sukatan tulad ng pagkakatulad ng cosine, ang mga data scientist ay maaaring makalkula ayon sa istatistika ang mga bias na maaaring hindi nakikita sa ibabaw.

Ang isa pang kritikal na paraan ay ang pagsusuri sa pag-uugali, o "pagsusuri." Kabilang dito ang paggamit ng mga structured na benchmark at maingat na idinisenyong mga tanong upang sistematikong i-query ang modelo para sa mga may kinikilingan na tugon sa isang hanay ng mga sensitibong kategorya, kabilang ang edad, relihiyon, kapansanan, at nasyonalidad. Ang mga umuusbong na diskarte tulad ng Uncertainty Quantification (UQ) at Explainable AI (XAI) ay nagpapakita rin ng pangako sa pagtulong sa paghukay ng mga hindi inaasahang bias sa pamamagitan ng pagsusuri sa mga antas ng kumpiyansa at mga landas sa paggawa ng desisyon ng isang modelo.

Gayunpaman, ang mga awtomatikong tool lamang ay hindi sapat. Ang red teaming, isang proseso kung saan aktibong sinusubukan ng mga eksperto sa seguridad na linlangin ang isang modelo sa paggawa ng mapaminsalang content, ay mahalaga para sa pagtuklas ng mga kahinaan na maaaring makaligtaan ng mga automated na pagsubok. Ang adversarial approach na ito ay kinukumpleto sa pamamagitan ng pagtatatag ng matatag na feedback loop, kung saan ang mga human evaluator at end-user ay maaaring mag-ulat ng bias o hindi naaangkop na content, na nagbibigay ng data na kailangan para sa patuloy na pagpipino at muling pagsasanay ng modelo.

AI Content Moderation: Ang Unang Linya ng Depensa

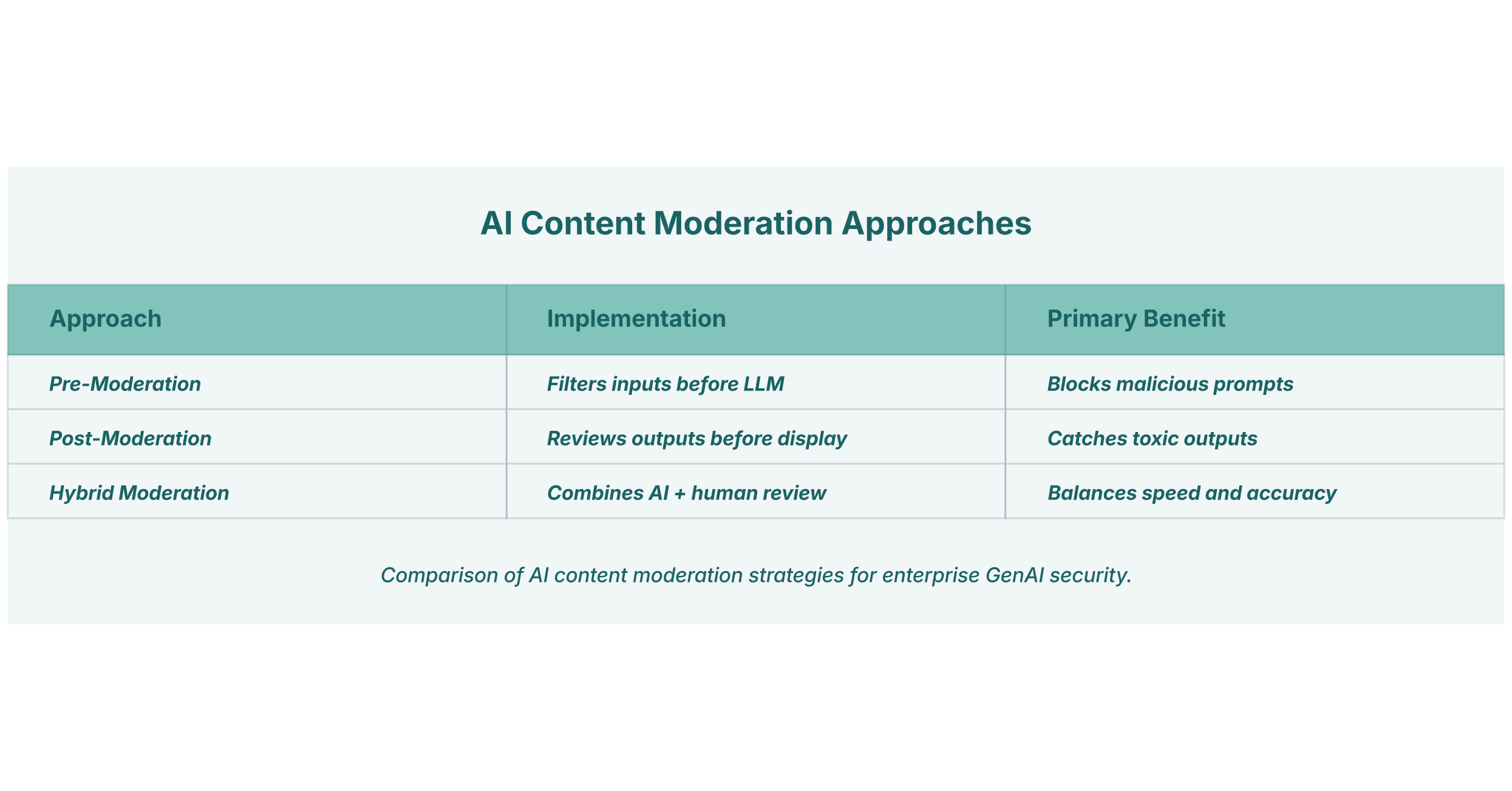

Habang ang LLM bias detection ay nakatuon sa pagsusuri sa mismong modelo, ang AI content moderation ay ang praktikal, real-time na aplikasyon ng mga insight na ito upang i-filter ang mga input at output. Ito ay nagsisilbing frontline defense, na pumipigil sa mapaminsalang content na makarating sa mga end-user o maproseso ng modelo sa unang lugar.

Ang mga epektibong diskarte sa pag-moderate ng nilalaman ng AI ay karaniwang may kasamang ilang layer:

- Pre-Moderation: Kasama sa diskarteng ito ang pag-scan ng mga input ng user bago ipinapadala sila sa LLM. Sa pamamagitan ng paggamit ng Natural Language Processing (NLP) upang suriin ang mga keyword, pananakot na pananalita, o mga pattern na nauugnay sa agarang pag-atake ng injection, maaaring i-block ng mga organisasyon ang mga nakakahamak o hindi naaangkop na query sa pinagmulan.

- Post-Moderation: Kasinghalaga ng pagsusuri sa mga output ng LLM pagkatapos sila ay nabuo ngunit bago ang mga ito ay ipinapakita sa gumagamit. Ang hakbang na ito ay nagsisilbing panghuling pagsusuri sa kaligtasan upang mahuli ang anumang nakakapinsala, may kinikilingan, o nakakalason na nilalaman na maaaring ginawa ng modelo, sa kabila ng iba pang mga pag-iingat.

- Hybrid Moderation: Ang pinakaepektibo at malawakang pinagtibay na diskarte ay hybrid moderation, na pinagsasama ang bilis at sukat ng mga automated AI filter na may nuance at contextual na pag-unawa ng mga human moderator. Pinangangasiwaan ng AI ang mataas na dami ng malinaw na mga kaso, habang ang hindi maliwanag o sensitibong nilalaman ay pinapataas para sa pagsusuri ng tao. Tinitiyak nito ang parehong kahusayan at mataas na katumpakan.

Ang ilang mga platform ay lumilipat din patungo sa proactive moderation, kung saan ang mga sopistikadong AI system ay idinisenyo upang tukuyin at maglaman ng pagkalat ng mapaminsalang nilalaman bago ito makakuha ng visibility, na lumilikha ng isang mas ligtas na digital na kapaligiran mula sa simula.

Ang pagtukoy sa toxicity at pagmo-moderate ng content ay mga mahahalagang reaktibong hakbang, ngunit ang isang tunay na epektibong diskarte ay maagap at nakaugat sa matatag na pamamahala. Para sa mga CISO at IT leader, ang layunin ay lumikha ng isang balangkas ng mga patakaran at teknikal na kontrol na nagbibigay-daan sa ligtas na paggamit ng GenAI sa buong enterprise.

Nagsisimula ang lahat sa isang komprehensibong plano sa pamamahala ng GenAI. Nangangailangan ito ng pagtatatag ng malinaw na patakaran sa paggamit ng AI na tumutukoy kung ano ang pinahihintulutan, kung ano ang pinaghihigpitan, at ang mga partikular na pamamaraan para sa paggamit ng AI na may sensitibo o pagmamay-ari na data. Ang patakarang ito ay dapat na binuo sa mga pangunahing pundasyon ng transparency, pananagutan, at etikal na paggamit, na tinitiyak na ang lahat ng aktibidad ng AI ay naaayon sa mga halaga at legal na obligasyon ng organisasyon.

Sa pagkakaroon ng isang patakaran, ang susunod na hakbang ay ang pagpapatupad ng mga guardrail ng GenAI, ang mga teknikal na kontrol na nagpapatupad ng mga panuntunang ito sa pagsasanay. Kasama sa mga guardrail na ito ang mga input at output filtering system na gumagamit ng AI content moderation para harangan ang nakakalason na content, pati na rin ang mga mahigpit na kontrol sa pag-access na naglilimita sa paggamit ng makapangyarihang GenAI tool sa mga awtorisadong tauhan.

Dito nagiging kailangan ang seguridad sa antas ng browser. Marami sa pinakamahalagang panganib sa GenAI ay nagmumula sa "Shadow SaaS" ecosystem, kung saan ang mga empleyado ay hiwalay na gumagamit ng mga pampublikong aplikasyon ng GenAI sa loob ng kanilang mga browser nang walang opisyal na pangangasiwa o pagbibigay ng sanction. Ang isang secure na extension ng browser ng enterprise ay nagbibigay ng kritikal na visibility at kontrol na kailangan para pamahalaan ang panganib na ito. Isipin ang isang senaryo kung saan sinusubukan ng isang empleyado na mag-paste ng sensitibong data ng kliyente sa isang pampublikong chatbot. Maaaring suriin ng isang solusyon sa seguridad sa antas ng browser, tulad ng inaalok ng LayerX, ang data at ang konteksto ng patutunguhang site, at maaaring harangan nang tahasan ang pagkilos o magpakita ng babala sa user. Ang kakayahang ito ay mahalaga para sa pagpigil sa pag-exfiltration ng sensitibong PII at intelektwal na ari-arian, ang pagpapatupad ng mga patakaran sa seguridad ng SaaS nang direkta sa punto ng pakikipag-ugnayan ng user.

Sa wakas, ang GenAI ay hindi isang "set and forget" na teknolohiya. Nag-evolve ang mga modelo, lumalabas ang mga bagong banta, at nagbabago ang mga pattern ng paggamit. Ang patuloy na pagsubaybay sa gawi ng modelo ay mahalaga upang matukoy ang pag-anod ng pagganap at matukoy ang mga bagong kahinaan. Dapat itong ipares sa mga malinaw na feedback loop na nagbibigay-kapangyarihan sa security team at mga end-user na mag-ulat ng hindi naaangkop na content o iba pang isyu, na tinitiyak na ang mga depensa ng organisasyon ay mabilis na umaangkop sa mismong teknolohiya.

Nag-aalok ang GenAI ng napakalawak na mga pagkakataon, ngunit nagpapakita rin ito ng kumplikado at pabago-bagong hanay ng mga panganib. Ang hamon ng toxicity ng GenAI, sa lahat ng anyo nito, ay hindi malulutas, ngunit hinihingi nito ang isang madiskarteng, multi-layered na depensa. Sa pamamagitan ng pagsasama-sama ng mga advanced na diskarte sa pagtukoy ng bias ng LLM, epektibong pag-moderate ng nilalaman ng AI, at isang malakas na balangkas ng pamamahala na ipinapatupad ng mga teknikal na kontrol, maaaring i-navigate ng mga organisasyon ang bagong ecosystem na ito. Ang layunin ay hindi upang harangan ang pagbabago ngunit upang paganahin ito nang ligtas. Ang mga solusyon na nagbibigay ng visibility at kontrol sa antas ng browser ay isang kritikal na bahagi ng puzzle na ito, na nag-aalok ng praktikal na paraan upang pamahalaan ang hindi mahuhulaan na katangian ng mga output ng LLM at i-secure ang susunod na wave ng produktibidad ng enterprise.