Nástroje pro kontrolu používání umělé inteligence (AI Usage Control) poskytují podnikům kritickou vrstvu správy a řízení, kterou potřebují k bezpečnému zavedení generativní umělé inteligence. Tato řešení monitorují interakce zaměstnanců, vynucují zásady pro data v reálném čase a zabraňují úniku citlivých informací do veřejných modelů, jako jsou ChatGPT a Gemini.

Co jsou nástroje pro kontrolu používání umělé inteligence a proč jsou důležité

Nástroje pro řízení používání AI (AIUC) jsou specializované bezpečnostní platformy, které řídí interakci mezi podnikovými uživateli a aplikacemi generativní AI. Na rozdíl od tradičních DLP nebo firewallů, které se zaměřují na přenos souborů a síťové perimetry, řešení AIUC kontrolují konverzační obsah výzev a odpovědí v reálném čase. Umožňují organizacím definovat zásady založené na záměru, například umožňují marketingovým týmům používat AI pro generování kopií a zároveň blokují inženýrské týmy ve vkládání proprietárního kódu do stejného nástroje.

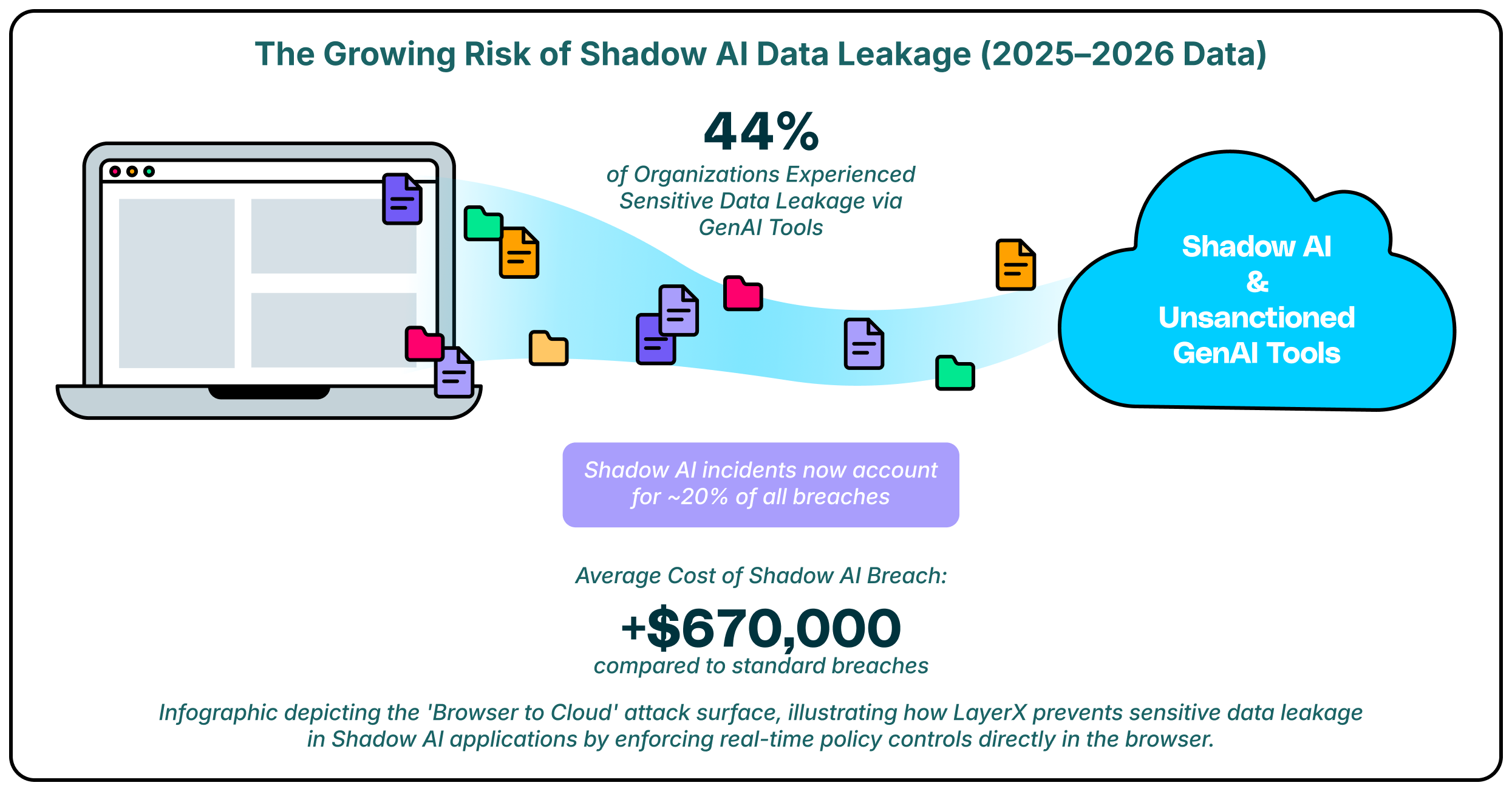

Tato kategorie se stala nezbytnou s rozšiřováním oblasti útoků „z prohlížeče do cloudu“. Zaměstnanci stále častěji obcházejí firemní sítě, aby k nástrojům umělé inteligence přistupovali přímo prostřednictvím webových prohlížečů, což vytváří slepá místa pro starší bezpečnostní balíčky. Vynucováním zabezpečení na úrovni prohlížeče a identity tyto nástroje zmírňují rizika spojená se stínovou umělou inteligencí, podněcováním k útokům a neoprávněným sdílením dat, aniž by vyžadovaly plošný zákaz, který brzdí inovace.

Klíčové trendy v oblasti kontroly používání umělé inteligence, které je třeba sledovat v roce 2026

Zásadním posunem v roce 2026 je přechod k řízení zaměřenému na identitu. Vedoucí představitelé v oblasti bezpečnosti si uvědomují, že blokování URL adres s využitím umělé inteligence je neefektivní a že kontext je důležitější než pouhá kontrola přístupu. Přední strategie se nyní zaměřují na pochopení toho, „kdo“ interaguje s „jakými“ daty, což organizacím umožňuje uplatňovat podrobné zásady, které se přizpůsobují na základě role uživatele. To zajišťuje, že finanční ředitel a vývojář softwaru čelí různým, vhodným ochranným opatřením při používání stejného nástroje umělé inteligence.

Dalším dominantním trendem je konsolidace kontrol v rámci podnikového prohlížeče. Vzhledem k tomu, že většina interakce s umělou inteligencí probíhá prostřednictvím webových rozhraní, stal se prohlížeč nejúčinnějším bodem pro vynucování „poslední míle“. Nástroje, které dokáží kontrolovat model objektů dokumentů (DOM) v reálném čase, nahrazují síťové proxy, protože nabízejí hlubší přehled o skutečném vkládaném nebo generovaném obsahu. To umožňuje detekci dynamických rizik, jako jsou útoky prompt injection, které síťoví inspektoři často přehlédnou kvůli šifrování nebo obfuskaci.

Tyto platformy nabízejí rozmanité přístupy k zajištění přijetí umělé inteligence, od rozšíření založených na prohlížeči až po vrstvy správy řízené API.

| Řešení | Klíčové schopnosti | Nejlepší pro |

| LayerX | Vynucování na bázi prohlížeče, zjišťování stínovou umělou inteligencí | DLP a zabezpečený přístup na poslední míli |

| Ostrov | Výměna podnikového prohlížeče, vlastní ochrana | Řízená a spravovaná prostředí |

| Palo Alto Networks | Integrace SASE, Precision AI | Stávající zákazníci z Palo Alto |

| Harmonická bezpečnost | Ochrana dat „bezdotykově“, stínová umělá inteligence | Týmy zaměřené na inovace |

| Okamžité zabezpečení | Okamžitá ochrana proti vniknutí, viditelnost stínové umělé inteligence | Zabezpečení vstupů/výstupů umělé inteligence |

| Zabezpečení AIM | Inventář GenAI, AI-SPM | CISO potřebují širokou viditelnost |

| Lasso Security | Řízení přístupu na základě kontextu, zabezpečení RAG | Rámce LLM a RAG |

| Soumrak AI | DLP s umělou inteligencí, náprava v reálném čase | Maskování a náprava dat |

| Svědek AI | Analýza regulačních rizik, hrozba z vnitřních zdrojů | Odvětví s vysokými požadavky na dodržování předpisů |

| Menlo Security | Bezpečný cloudový prohlížeč, ovládání kopírováním a vkládáním | Uživatelé vzdálené izolace prohlížeče (RBI) |

| Serafínská bezpečnost | Prevence zneužití, DLP v prohlížeči | Zastavení zneužití prohlížeče |

1. VrstvaX

LayerX nabízí přístup k řízení používání umělé inteligence zaměřený na prohlížeč a umisťuje hluboký přehled a funkce vynucování přímo tam, kde uživatelé interagují s nástroji umělé inteligence. Funguje jako podnikové rozšíření prohlížeče, které monitoruje každou událost v rámci relace a umožňuje rozlišovat mezi bezpečnými dotazy a rizikovými akcemi, jako je vkládání zdrojového kódu nebo nahrávání citlivých souborů. Tato podrobná kontrola umožňuje organizacím schvalovat nástroje zvyšující produktivitu a zároveň přísně zakazovat únik dat.

Kromě jednoduchého blokování poskytuje LayerX komplexní odhalování používání stínové umělé inteligence v rámci celé pracovní síly. Identifikuje každou aplikaci umělé inteligence, ke které je přistupováno, bez ohledu na to, zda se jedná o nástroj schválený firmou nebo osobní účet, a ve všech z nich vynucuje konzistentní bezpečnostní zásady. Tato funkce zajišťuje, že ochrana dat putuje s uživatelem, čímž efektivně uzavírá mezeru mezi přísnými interními standardy dodržování předpisů a fluktuující povahou zavádění webové umělé inteligence.

2. Ostrov

Island nově pojímá samotný prohlížeč jako primární kontrolní bod zabezpečení a nabízí specializovaný „podnikový prohlížeč“, který nahrazuje standardní spotřebitelské prohlížeče, jako je Chrome nebo Edge. Toto kontrolované prostředí umožňuje IT týmům integrovat bezpečnostní zásady přímo do prohlížení, včetně omezení kopírování a vkládání dat do chatbotů s umělou inteligencí. Poskytuje vysoce zabezpečený kontejner pro citlivou práci a zajišťuje, že žádná data nemohou opustit spravované prostředí bez autorizace.

Pro použití konkrétně v oblasti umělé inteligence nabízí Island vestavěné funkce prevence ztráty dat, které dokáží odstranit citlivé informace dříve, než se dostanou k externímu modelu. Architektura prohlížeče mu poskytuje úplný přehled o akcích uživatelů a umožňuje auditní záznamy, které podrobně popisují, co přesně bylo sdíleno s platformami umělé inteligence. Tato úroveň kontroly je ideální pro organizace, které mohou pro veškerou firemní práci nařídit specifický prohlížeč.

3. Palo Alto Networks (prohlížeč Prisma Access)

Prohlížeč Prisma Access od společnosti Palo Alto Networks integruje bezpečné prohlížení přímo do své širší architektury SASE. Využívá „přesnou umělou inteligenci“ k detekci a blokování hrozeb v reálném čase a využívá rozsáhlou datovou sadu informací o hrozbách společnosti. Pro použití umělé inteligence nabízí kontrolní mechanismy, které dokáží identifikovat a blokovat přenosy citlivých dat do aplikací GenAI a zajišťují tak, aby uživatelé nadále dodržovali firemní datové standardy.

Toto řešení je navrženo tak, aby bezproblémově fungovalo se stávající bezpečnostní infrastrukturou Palo Alto a poskytovalo jednotný pohled na hrozby v síti a prohlížeči. Zjednodušuje správu zásad pro týmy, které již používají Prisma Access, a umožňuje jim rozšířit stávající pravidla ochrany dat tak, aby pokrývala nová rizika, která přinášejí webové nástroje umělé inteligence. Prohlížeč funguje jako edge enforcement point, který drží krok s rychlými změnami v prostředí umělé inteligence.

4. Harmonická bezpečnost

Společnost Harmonic Security klade důraz na přístup „Zero Touch“ k ochraně dat s cílem zajistit zavedení umělé inteligence bez náročné konfigurace. Platforma se zaměřuje na klasifikaci aplikací umělé inteligence na základě rizika a hodnoty a pomáhá organizacím rozlišovat mezi neškodnými nástroji pro zvýšení produktivity a nebezpečnými úniky dat. Jejím cílem je umožnit bezpečné zavedení umělé inteligence, nikoli ji pouze blokovat.

Tento nástroj poskytuje hluboký přehled o datech proudících k poskytovatelům umělé inteligence, což týmům umožňuje odhalit trendy v zavádění „vysoce hodnotných“ nástrojů. Harmonic využívá předpřipravené modely rizik k automatizaci procesu schvalování nových nástrojů, čímž snižuje zátěž bezpečnostních analytiků. Tato strategie je atraktivní pro společnosti, které chtějí podporovat inovace a zároveň zachovat bezpečnostní síť pro kritická data.

5. Okamžité zabezpečení

Společnost Prompt Security se silně zaměřuje na zabezpečení vstupů a výstupů systémů generativní umělé inteligence, aby se zabránilo úniku a manipulaci s daty. Jejich platforma kontroluje výzvy v reálném čase, aby odhalila pokusy o jailbreaking nebo vkládání výzev, a zajišťuje tak, aby modely umělé inteligence fungovaly podle očekávání. Poskytuje klíčovou vrstvu ochrany pro zaměstnance, kteří používají nástroje jako ChatGPT, a odstraňuje citlivé osobní údaje z dotazů před jejich odesláním do cloudu.

Řešení také nabízí přehled o stínové umělé inteligenci (Shadow AI) monitorováním interakcí zaměstnanců s externími nástroji. Umožňuje organizacím vynucovat „dezinfikované“ používání, kdy zaměstnanci mohou těžit z pomoci umělé inteligence, aniž by bylo odhaleno duševní vlastnictví společnosti. Zabezpečení toku dat na úrovni okamžitého přístupu pomáhá organizacím zachovat soukromí, aniž by musely budovat složitou vlastní infrastrukturu.

6. Zabezpečení AIM

AIM Security poskytuje specializovanou platformu, která má pomoci CISO vytvořit komplexní inventář veškerého využití GenAI v rámci podniku. Zaměřuje se na „AI Security Posture Management“ (AI-SPM) a nabízí jasný přehled o tom, které nástroje se používají a jaké jsou s nimi spojená potenciální rizika. Tato transparentnost je nezbytná pro organizace, které se potýkají s kvantifikací rozsahu svého problému se stínovou umělou inteligencí.

Platforma využívá přístup „AI-Firewall“ k řízení interakcí s veřejnými i soukromými modely. Dokáže detekovat a blokovat útoky typu Prompt Injection a zabránit odesílání citlivých dat do neoprávněných modelů. Zaměření AIM na specifické zranitelnosti LLM z něj činí silnou volbu pro bezpečnostní týmy, které potřebují hluboký a specializovaný vhled do svého generativního AI stacku.

7. Lasso Security

Společnost Lasso Security zavádí do prostředí správy a řízení umělé inteligence řízení přístupu na základě kontextu (CBAC), které se konkrétně zaměřuje na potřeby nasazení LLM a RAG (Retrieval-Augmented Generation). Tato metoda dynamicky vyhodnocuje požadavky na přístup na základě identity uživatele, chování a datového typu a zajišťuje tak bezpečnost a shodu interakcí. Je obzvláště efektivní pro organizace, které si vytvářejí vlastní interní aplikace umělé inteligence a vyžadují přísné datové hranice.

Řešení se integruje s různými prostředími GenAI pro monitorování datových přenosů a odhalování anomálií v reálném čase. Lasso chrání před novými hrozbami, jako je manipulace s modely a otrava dat, které se stávají stále relevantnějšími s tím, jak podniky dolaďují své vlastní modely. Jeho důraz na kontext umožňuje flexibilnější a přesnější vymáhání zásad než pouhé blokování klíčových slov.

8. Soumrak AI

Nightfall AI využívá své silné stránky v oblasti prevence ztráty dat (DLP) k řešení kontroly používání AI. Její platforma využívá detektory strojového učení trénované na 125 milionech parametrů k identifikaci PII, PCI a tajných informací s vysokou přesností. Pro použití AI poskytuje Nightfall nápravu v reálném čase, kdy automaticky maskuje citlivá data v pokynech (jako je ChatGPT) předtím, než opustí prohlížeč nebo API.

Tento přístup „primární redakce“ umožňuje zaměstnancům nadále používat nástroje umělé inteligence bez přerušení, protože se odstraní pouze citlivá data, zatímco zbytek výzvy zůstává funkční. Zaměření Nightfallu na „kontextovou“ detekci pomáhá snižovat falešně pozitivní výsledky, což je častý problém v tradičních DLP systémech aplikovaných na konverzační umělou inteligenci.

9. Svědecká umělá inteligence

Platforma Witness AI se zaměřuje na aspekty používání umělé inteligence v oblasti dodržování předpisů a regulace, což ji činí vhodnou pro vysoce regulovaná odvětví, jako jsou finance a zdravotnictví. Platforma poskytuje analýzy behaviorálních rizik a regulační expozice a pomáhá organizacím mapovat používání umělé inteligence v porovnání s interními politikami. Je navržena tak, aby detekovala vnitřní hrozby analýzou konverzačních vzorců v průběhu času.

Řešení vytváří specializovanou auditní stopu pro interakce s umělou inteligencí, která je nezbytná pro prokázání souladu během auditů. Zaměřením se na umožnění „bezpečného používání“ pomáhá Witness AI organizacím orientovat se v komplexním průsečíku rychlého zavádění technologií a rigidních interních mandátů. Poskytuje nezbytný dohled, aby se zajistilo, že strategie umělé inteligence neporušují pravidla správy dat.

10. Menlo Security

Společnost Menlo Security využívá svou technologii Remote Browser Isolation (RBI) k vytvoření bezpečného bufferu mezi uživateli a aplikacemi GenAI. Jejich řešení „Menlo for GenAI“ nabízí podrobné ovládací prvky pro kopírování a vkládání, které zajišťují, že uživatelé nemohou do rozhraní chatbotů vkládat citlivý kód ani osobní údaje. Tento přístup v podstatě zachází s aplikací umělé inteligence jako s nedůvěryhodným cílem a izoluje interakci, aby se zabránilo ztrátě dat.

Kromě izolace poskytuje Menlo forenzní analýzy prohlížení, které přesně zaznamenávají, jaká data jsou sdílena s platformami umělé inteligence. Tato viditelnost pomáhá bezpečnostním týmům auditovat vzorce používání a vymáhat dodržování předpisů, aniž by bylo nutné nasazovat agenty na každý koncový bod. Je to ideální volba pro organizace, které se již spoléhají na izolaci pro webové zabezpečení.

11. Serafínská bezpečnost

Seraphic Security poskytuje podnikovou platformu pro zabezpečení prohlížečů, která funguje v jakémkoli standardním prohlížeči a zaměřuje se na prevenci zneužití a ochranu za běhu. Její funkce „In-Browser DLP“ monitorují interakce uživatelů s nástroji umělé inteligence a blokují sdílení citlivých dat v reálném čase. Technologie Seraphic vkládá do relace prohlížeče vrstvu zabezpečení, která řídí provádění JavaScriptu, což pomáhá předcházet pokročilým útokům zaměřeným na samotný prohlížeč.

Řešení nabízí hluboký přehled o tom, jak zaměstnanci používají umělou inteligenci, zaznamenává výzvy a odpovědi, aby byl zajištěn soulad se zásadami správy dat. Zastavením útoků na úrovni prohlížeče chrání Seraphic před sofistikovanými hrozbami, které by se mohly pokusit obejít tradiční metody detekce. Je navrženo tak, aby bylo nenáročné a kompatibilní se stávajícími podnikovými pracovními postupy.

Jak vybrat nejlepšího poskytovatele kontroly používání umělé inteligence

- Zhodnoťte, zda řešení nabízí viditelnost na úrovni prohlížeče, aby zachytilo využití stínové umělé inteligence, které by síťové proxy mohly přehlédnout kvůli šifrování.

- Hledejte zásady zohledňující identitu, které vám umožňují měnit pravidla přístupu na základě role uživatele a konkrétního kontextu dat.

- Vyhodnoťte model nasazení, abyste se ujistili, že odpovídá vaší infrastruktuře, ať už se jedná o lehké rozšíření prohlížeče nebo o plnohodnotnou náhradu prohlížeče.

- Ověřte, zda nástroj dokáže v reálném čase detekovat a blokovat nepřátelské hrozby, jako je prompt injection a jailbreaking.

- Ověřte si možnosti integrace s vašimi stávajícími systémy SIEM a IdP, abyste zajistili jednotný pracovní postup zabezpečení.

Nejčastější dotazy

Jaký je rozdíl mezi kontrolou využití AI a tradičním DLP?

Tradiční DLP je často navrženo pro ochranu založenou na souborech a postrádá kontext pro pochopení konverzačních pokynů umělé inteligence. Nástroje pro kontrolu používání umělé inteligence jsou speciálně navrženy tak, aby analyzovaly záměr a obsah interakcí s LLM, což jim umožňuje blokovat specifické rizikové akce, jako je vkládání kódu, aniž by blokovaly celou aplikaci.

Mohou tyto nástroje objevit aplikace „stínové umělé inteligence“?

Ano, většina platforem pro kontrolu používání umělé inteligence (AI Usage Control) zahrnuje funkce vyhledávání, které zaznamenávají všechny aplikace umělé inteligence, ke kterým zaměstnanci přistupují. Poskytují řídicí panely, které ukazují, které nástroje se používají, jak často a kým, což umožňuje bezpečnostním týmům identifikovat neoprávněné aplikace, které mohou představovat riziko.

Potřebuji k používání těchto nástrojů speciální prohlížeč?

Ne nutně. Zatímco některá řešení, jako například Island a Palo Alto Networks, vyžadují specializovaný podnikový prohlížeč, jiná, jako například LayerX a Reco, fungují jako rozšíření nebo integrace API, které spolupracují s vašimi stávajícími standardními prohlížeči (Chrome, Edge) a SaaS prostředími.

Jak tyto nástroje zpracovávají šifrovaný provoz?

Řešení založená na prohlížeči, jako jsou LayerX a Island, dokáží prohlížet data v prohlížeči před jejich zašifrováním a odesláním po síti. To jim umožňuje vidět celý obsah výzev a odpovědí, což poskytuje přehled, který síťovým nástrojům často chybí.

Jsou tato řešení nezbytná, pokud máme politiku „žádné umělé inteligence“?

Ano, protože zásadu „žádná umělá inteligence“ je obtížné vymáhat bez technických kontrol. Zaměstnanci často používají osobní zařízení nebo hledají alternativní řešení pro přístup k užitečným nástrojům umělé inteligence. Kontrola používání umělé inteligence poskytuje přehled o dodržování předpisů a technické prostředky k efektivnímu vymáhání zásad.