Τα μοντέλα μηχανικής μάθησης δεν είναι πλέον απλώς αναλυτικά εργαλεία. Είναι οι μηχανές που καθοδηγούν τη λήψη αποφάσεων σε ολόκληρη τη σύγχρονη επιχείρηση. Αυτή η εξάρτηση έχει δημιουργήσει ένα εξελιγμένο διάνυσμα απειλής γνωστό ως επιθέσεις αντιμαχόμενης τεχνητής νοημοσύνης. Αυτές δεν είναι παραδοσιακές εκμεταλλεύσεις λογισμικού που στοχεύουν σε ευπάθειες κώδικα, όπως υπερχειλίσεις buffer. Είναι οπτικές ψευδαισθήσεις για αλγόριθμους.

Ανατομία μιας επίθεσης: Πώς εξαπατώνται τα μοντέλα

Οι επιτιθέμενοι χρησιμοποιούν ανεπαίσθητες πληροφορίες για να εξαπατήσουν τα συστήματα Τεχνητής Νοημοσύνης, ώστε να κάνουν λανθασμένες ταξινομήσεις ή να αποκαλύψουν ευαίσθητα δεδομένα εκπαίδευσης. Για τους ηγέτες της ασφάλειας το 2025, τα διακυβεύματα έχουν μετατοπιστεί. Βλέπουμε μια μετάβαση από τη θεωρητική έρευνα στην ενεργή οπλοποίηση. Οι επιτιθέμενοι εφαρμόζουν αυτές τις τεχνικές σε λειτουργία για να παρακάμψουν την ανίχνευση απάτης και να χειραγωγήσουν τους οικονομικούς αλγόριθμους.

Επίσης, αποσπούν ιδιόκτητα δεδομένα μέσω των ίδιων εργαλείων που χρησιμοποιούν καθημερινά οι εργαζόμενοι. Το πρόγραμμα περιήγησης έχει γίνει το κύριο πεδίο δράσης για αυτές τις εισβολές. Είναι η διεπαφή όπου οι εργαζόμενοι επικολλούν ευαίσθητο κώδικα σε LLM και όπου οι κακόβουλες επεκτάσεις μπορούν να εισάγουν σιωπηλά τοξικά μηνύματα. Η κατανόηση των μηχανισμών των εχθρικών επιθέσεων στην Τεχνητή Νοημοσύνη είναι το πρώτο βήμα για την ασφάλεια της επιφάνειας επίθεσης από το πρόγραμμα περιήγησης στο cloud.

Τα αντίπαλα δεδομένα εισόδου συχνά μοιάζουν με θόρυβο σε έναν ανθρώπινο παρατηρητή, αλλά ερμηνεύονται ως ξεχωριστά σήματα από ένα νευρωνικό δίκτυο. Αυτή η ασυμφωνία επιτρέπει στους εισβολείς να χειραγωγούν τα αποτελέσματα χωρίς να ενεργοποιούν τις παραδοσιακές ειδοποιήσεις ασφαλείας. Οι μέθοδοι που χρησιμοποιούνται για την εκτέλεση αντίπαλων επιθέσεων μέσω τεχνητής νοημοσύνης εμπίπτουν γενικά σε τρεις ξεχωριστές κατηγορίες.

Δηλητηρίαση Δεδομένων: Διαφθείροντας το Πηγάδι

Οι επιθέσεις δηλητηρίασης συμβαίνουν κατά τη διάρκεια της φάσης εκπαίδευσης ή βελτιστοποίησης. Εισάγοντας κακόβουλα δείγματα στο σύνολο δεδομένων, ένας εισβολέας μπορεί να δημιουργήσει μια κρυφή κερκόπορτα στο μοντέλο. Ένας εισβολέας μπορεί να τροποποιήσει διακριτικά ένα σύνολο email ηλεκτρονικού "ψαρέματος" (phishing) σε ένα σώμα εκπαίδευσης. Το φίλτρο ανεπιθύμητης αλληλογραφίας που προκύπτει μαθαίνει να ταξινομεί συγκεκριμένα κακόβουλα μοτίβα ως καλοήθη.

Στο πλαίσιο της Γενετικής Τεχνητής Νοημοσύνης (GenAI), αυτό είναι ιδιαίτερα επικίνδυνο. Εάν μια επιχείρηση βελτιστοποιήσει έναν βοηθό κωδικοποίησης σε εσωτερικά αποθετήρια που έχουν παραβιαστεί ανεπαίσθητα, οι συνέπειες είναι σοβαρές. Το μοντέλο μπορεί να προτείνει μη ασφαλή αποσπάσματα κώδικα στους προγραμματιστές, αυτοματοποιώντας ουσιαστικά την εισαγωγή ευπαθειών.

Μοντελοποίηση: Το Ψηφιακό Ταχυδακτυλουργικό Χέρι

Οι επιθέσεις αποφυγής συμβαίνουν κατά τη στιγμή της εξαγωγής συμπερασμάτων. Ο εισβολέας τροποποιεί τα δεδομένα εισόδου για να προκαλέσει την εσφαλμένη ταξινόμηση του μοντέλου. Αυτή είναι η πιο κοινή μορφή επιθέσεων κατά της Τεχνητής Νοημοσύνης που παρατηρείται σήμερα. Ένα κλασικό παράδειγμα περιλαμβάνει την τροποποίηση μερικών pixel σε μια εικόνα ενός σήματος στοπ.

Το αυτόνομο όχημα δημιουργεί ένα επικίνδυνο σφάλμα ταξινόμησης και το αναγνωρίζει ως πινακίδα ορίου ταχύτητας. Στο εταιρικό περιβάλλον, χρησιμοποιούνται τεχνικές αποφυγής για την παράκαμψη ταξινομητών κακόβουλου λογισμικού. Αυτό επιτρέπει σε οπλισμένα αρχεία να ξεφεύγουν από τις λύσεις προστασίας από ιούς επόμενης γενιάς.

Εξόρυξη και Κλοπή Μοντέλου

Η κλοπή μοντέλου περιλαμβάνει την εξέταση ενός συστήματος τεχνητής νοημοσύνης «μαύρου κουτιού» από έναν εισβολέα με πολλά ερωτήματα. Στόχος τους είναι να ανακατασκευάσουν το υποκείμενο μοντέλο ή να εξαγάγουν τα ιδιωτικά δεδομένα στα οποία εκπαιδεύτηκε. Αναλύοντας τα αποτελέσματα, μπορούν να δημιουργήσουν ένα υποκατάστατο μοντέλο που μιμείται την ιδιόκτητη συμπεριφορά του στόχου.

Αυτό κλέβει πνευματική ιδιοκτησία. Παρέχει επίσης ένα sandbox για τον εισβολέα ώστε να δοκιμάζει μελλοντικές επιθέσεις αποφυγής εκτός σύνδεσης. Μπορούν να διασφαλίσουν ότι οι μέθοδοί τους θα λειτουργήσουν ενάντια στο σύστημα παραγωγής χωρίς να ειδοποιήσουν το θύμα.

Η αύξηση των αυτοματοποιημένων απειλών το 2025

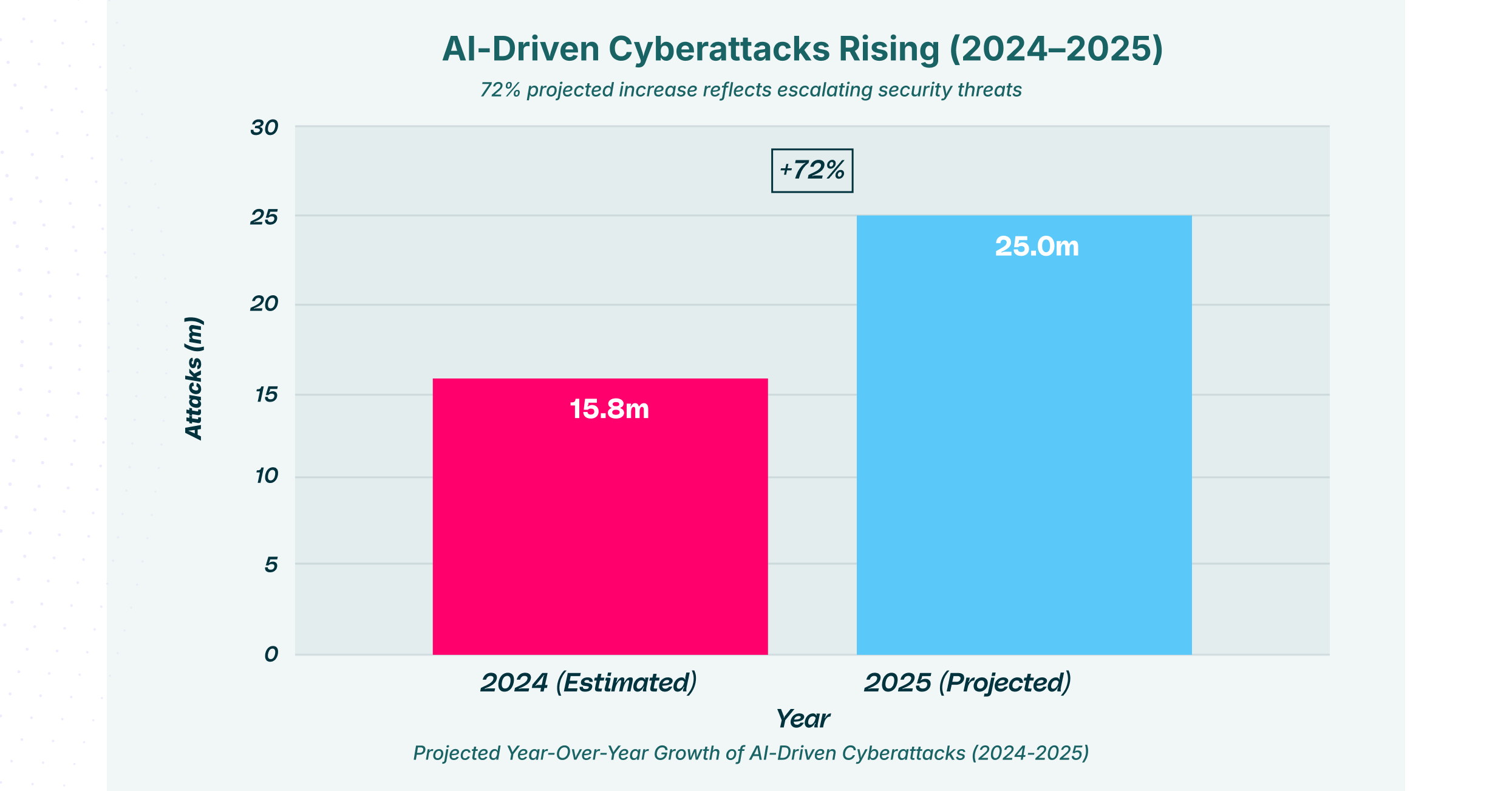

Το εμπόδιο εισόδου για την εκτέλεση αυτών των επιθέσεων έχει μειωθεί σημαντικά. Τα αυτοματοποιημένα εργαλεία επιτρέπουν πλέον ακόμη και σε φορείς με χαμηλές δεξιότητες να ξεκινούν εξελιγμένες εκστρατείες. Ο τεράστιος όγκος των περιστατικών αυξάνεται δυναμικά. Οι ομάδες ασφαλείας πρέπει να επανεξετάσουν την αμυντική τους στάση.

Αυτό το διάγραμμα απεικονίζει την προβλεπόμενη αύξηση 72% σε ετήσια βάση στα παγκόσμια περιστατικά στον κυβερνοχώρο. Καθώς οι οργανισμοί αναπτύσσουν περισσότερα μοντέλα, ο όγκος των επιθέσεων με τεχνητή νοημοσύνη αναμένεται να φτάσει σε πρωτοφανή επίπεδα, με 28 εκατομμύρια περιστατικά να προβλέπονται για το 2025. Αυτή η εκθετική αύξηση υπογραμμίζει πώς τα αυτοματοποιημένα εργαλεία μειώνουν το εμπόδιο εισόδου για τους απειλητικούς παράγοντες που εκτελούν επιθέσεις με τεχνητή νοημοσύνη σε μεγάλη κλίμακα.

Αυτή η αύξηση δεν είναι τυχαία. Οφείλεται στην ευρεία υιοθέτηση εργαλείων τεχνητής νοημοσύνης ανοιχτού κώδικα που μπορούν να επαναχρησιμοποιηθούν για επιθετικούς σκοπούς. Οι επιτιθέμενοι χρησιμοποιούν την GenAI για να αυτοματοποιήσουν την ανακάλυψη τρωτών σημείων σε άλλα συστήματα τεχνητής νοημοσύνης. Αυτό δημιουργεί έναν βρόχο βελτιστοποίησης αντιπάλων που κινείται πιο γρήγορα από ό,τι μπορούν να διορθώσουν οι ανθρώπινοι υπερασπιστές.

Οπλοποίηση GenAI: Η επιδημία ηλεκτρονικού "ψαρέματος"

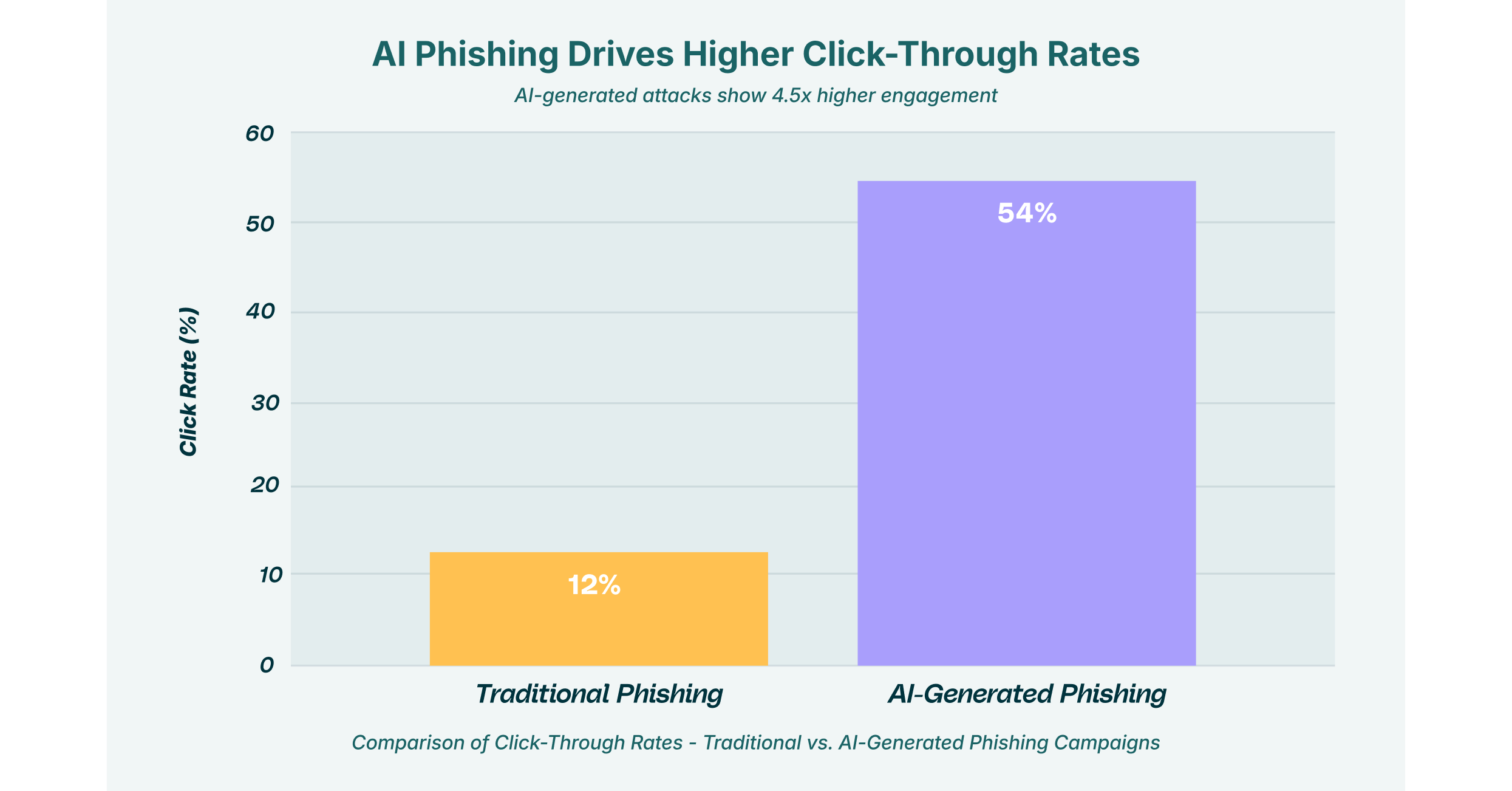

Η γενετική τεχνητή νοημοσύνη (generative AI) έχει αλλάξει ριζικά το παιχνίδι της κοινωνικής μηχανικής. Οι επιθέσεις αντιπάλων στην γενετική τεχνητή νοημοσύνη δεν αφορούν μόνο την εξαπάτηση ενός μοντέλου. Αφορούν τη χρήση του μοντέλου για την εξαπάτηση ανθρώπων. Οι επιτιθέμενοι πλέον αναπτύσσουν μοντέλα μεγάλης γλώσσας (LLM) για να δημιουργήσουν γραμματικά άψογα email ηλεκτρονικού "ψαρέματος" (phishing) με βάση τα συμφραζόμενα.

Αυτά τα email μιμούνται τον τόνο και το ύφος των εσωτερικών στελεχών. Η αποτελεσματικότητα αυτών των καμπανιών που βασίζονται στην τεχνητή νοημοσύνη είναι ανησυχητική σε σύγκριση με τις παραδοσιακές μεθόδους.

Μια σύγκριση των ποσοστών κλικ αποκαλύπτει την επικίνδυνη αποτελεσματικότητα των επιθέσεων αντιπάλων στην γενετική τεχνητή νοημοσύνη. Ενώ οι παραδοσιακές καμπάνιες ηλεκτρονικού "ψαρέματος" (phishing) δυσκολεύονται με ποσοστό επιτυχίας 12%, τα δολώματα που δημιουργούνται από την τεχνητή νοημοσύνη, κατασκευασμένα για να μιμούνται αξιόπιστες εσωτερικές επικοινωνίες, επιτυγχάνουν ένα εκπληκτικό ποσοστό κλικ 54%. Αυτά τα δεδομένα υπογραμμίζουν την κρίσιμη ανάγκη για εξειδικευμένη ασφάλεια των προγραμμάτων περιήγησης για την ανίχνευση των ανεπαίσθητων γλωσσικών και δομικών ανωμαλιών της κοινωνικής μηχανικής που υποστηρίζεται από την GenAI.

Οι λύσεις ασφάλειας προγραμμάτων περιήγησης πρέπει πλέον να εξελιχθούν πέρα από το απλό φιλτράρισμα URL. Πρέπει να αναλύουν την πρόθεση και το πλαίσιο του περιεχομένου που αποδίδεται. Όταν ένας εργαζόμενος αλληλεπιδρά με ένα GenAI chatbot ή λαμβάνει ένα ύποπτο email, η επέκταση του προγράμματος περιήγησης χρησιμεύει ως το κρίσιμο σημείο ελέγχου. Μπορεί να επισημάνει ανωμαλίες που υποδηλώνουν ότι το περιεχόμενο δημιουργήθηκε συνθετικά για εξαπάτηση.

Άμεση Έγχυση: Η «Έγχυση SQL» της Εποχής της Τεχνητής Νοημοσύνης

Μία από τις πιο διαδεδομένες μορφές επιθέσεων αντιπάλων στην γενετική τεχνητή νοημοσύνη είναι η άμεση έγχυση (prompt injection). Αυτή η τεχνική περιλαμβάνει τη δημιουργία ενός κειμένου που παρακάμπτει τις αρχικές οδηγίες του μοντέλου. Αναγκάζει το σύστημα να εκτελέσει μη εξουσιοδοτημένες ενέργειες.

Μηχανισμοί ένεσης

Ο κίνδυνος δεν περιορίζεται στους χρήστες που πληκτρολογούν κακόβουλα πράγματα σε ένα πλαίσιο συνομιλίας. Ο πραγματικός κίνδυνος έγκειται στην έμμεση εισαγωγή μηνυμάτων ή στις επιθέσεις "Man-in-the-Prompt". Σε αυτό το σενάριο, ένα LLM μπορεί να επεξεργαστεί μια ιστοσελίδα ή ένα έγγραφο που περιέχει κρυφές κακόβουλες οδηγίες.

Η LayerX Labs έχει εντοπίσει φορείς όπου κακόβουλες επεκτάσεις προγράμματος περιήγησης τροφοδοτούν αυτά τα τοξικά μηνύματα σε εταιρικά LLM. Αυτό συμβαίνει χωρίς τη συγκατάθεση του χρήστη. Αυτό επιτρέπει στους εισβολείς να χειραγωγούν την έξοδο αξιόπιστων εργαλείων τεχνητής νοημοσύνης. Μετατρέπει ουσιαστικά έναν χρήσιμο βοηθό σε μια εσωτερική απειλή.

Ταξινόμηση των Κινδύνων Άμεσης Ένεσης

| Τύπος επίθεσης | Μηχανισμός | Επίπεδο κινδύνου |

| Άμεση ένεση | Ο εισβολέας εισάγει χειροκίνητα κακόβουλα μηνύματα για να παρακάμψει τα φίλτρα ασφαλείας (Jailbreaking). | Ψηλά |

| Έμμεση Έγχυση | Κακόβουλες οδηγίες κρύβονται σε εξωτερικά δεδομένα (π.χ., ιστοσελίδες) που καταναλώνονται από την Τεχνητή Νοημοσύνη. | Κρίσιμος |

| Δηλητηρίαση πλαισίου | Χειραγώγηση του ιστορικού συνομιλιών για την επηρέαση των μελλοντικών απαντήσεων του μοντέλου. | Μέτριας Δυσκολίας |

Αυτός ο πίνακας κατηγοριοποιεί τους κύριους φορείς για την άμεση έγχυση (prompt injection), ένα συγκεκριμένο υποσύνολο επιθέσεων τεχνητής νοημοσύνης (AI). Η έμμεση έγχυση ενέχει κρίσιμο κίνδυνο επειδή συμβαίνει εν αγνοία του χρήστη. Συχνά συμβαίνει μέσω ενός σεναρίου "Man-in-the-Prompt" όπου μια επέκταση προγράμματος περιήγησης διαβάζει μια παραβιασμένη ιστοσελίδα και τροφοδοτεί την κακόβουλη οδηγία στο εταιρικό LLM.

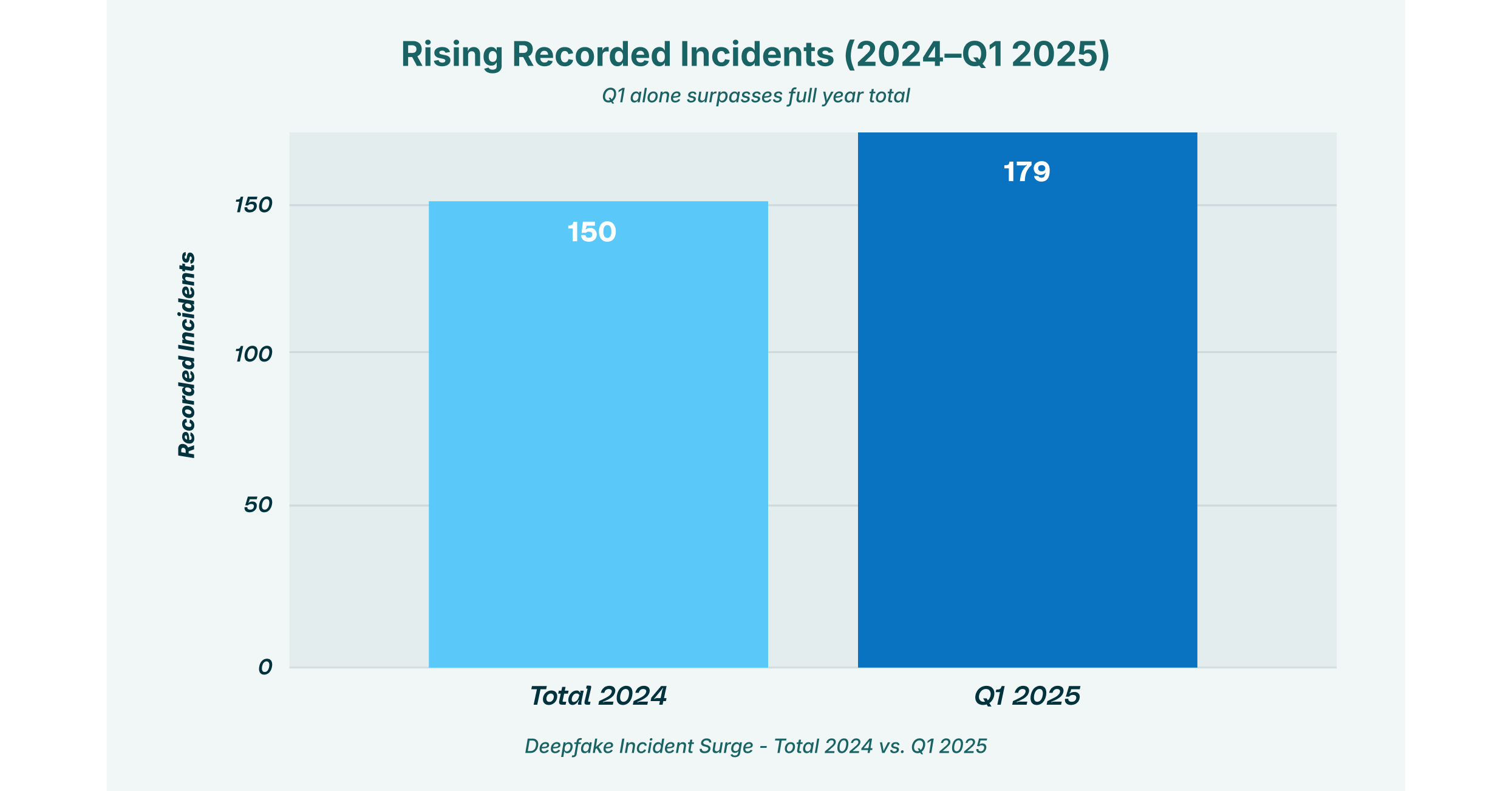

Το δίλημμα Deepfake και η διασφάλιση ταυτότητας

Η ίδια τεχνολογία που χρησιμοποιείται για τη δημιουργία χρήσιμων avatar χρησιμοποιείται πλέον ως όπλο για την παράκαμψη συστημάτων επαλήθευσης ταυτότητας. Τα deepfakes έχουν μετατραπεί από καινοτομίες στο διαδίκτυο σε απειλές ασφαλείας εταιρικού επιπέδου.

Αυτές οι επιθέσεις συχνά εκδηλώνονται σε πλατφόρμες τηλεδιάσκεψης ή κατά τη διάρκεια διαδικασιών απομακρυσμένης ενσωμάτωσης. Ένας εισβολέας χρησιμοποιεί μια επικάλυψη deepfake σε πραγματικό χρόνο για να μιμηθεί έναν Διευθύνοντα Σύμβουλο ή έναν οικονομικό διευθυντή. Εξουσιοδοτεί δόλιες μεταφορές ή ζητά ευαίσθητα διαπιστευτήρια. Οι οργανισμοί πρέπει να αναπτύξουν άμυνες που μπορούν να ανιχνεύσουν τα ψηφιακά αντικείμενα των συνθετικών μέσων.

Το Πρόγραμμα Περιήγησης: Η Κύρια Επιφάνεια Επίθεσης

Γιατί το πρόγραμμα περιήγησης κατέχει κεντρική θέση σε αυτήν τη συζήτηση; Επειδή είναι η διεπαφή μέσω της οποίας οι εργαζόμενοι έχουν πρόσβαση σε εργαλεία GenAI όπως το ChatGPT, το Gemini ή το Claude. Είναι η πύλη μέσω της οποίας οι επιθέσεις τεχνητής νοημοσύνης φτάνουν στο τελικό σημείο.

Τα παραδοσιακά εργαλεία ασφάλειας δικτύου δεν βλέπουν την κρυπτογραφημένη κίνηση μεταξύ του προγράμματος περιήγησης ενός χρήστη και μιας υπηρεσίας τεχνητής νοημοσύνης. Δεν μπορούν να δουν αν ένας υπάλληλος επικολλά προσωπικά δεδομένα σε ένα chatbot. Δεν μπορούν να δουν αν μια επέκταση "Shadow SaaS" συλλέγει σιωπηλά αυτά τα δεδομένα. Η έρευνα της LayerX για το "Shadow AI" αποκαλύπτει ότι ένα σημαντικό ποσοστό διαρροής εταιρικών δεδομένων συμβαίνει μέσω μη διαχειριζόμενων επεκτάσεων προγράμματος περιήγησης.

Όταν μιλάμε για την πρόληψη επιθέσεων κατά της Τεχνητής Νοημοσύνης (AI), πρέπει να εξετάζουμε το πρόγραμμα περιήγησης ως το σημείο επιβολής. Είναι το μόνο μέρος όπου μπορούμε να δούμε ταυτόχρονα την είσοδο του χρήστη, την έξοδο του μοντέλου και το περιβάλλον της διαδικτυακής συνεδρίας. Αυτή η ορατότητα επιτρέπει την επεξεργασία ευαίσθητων δεδομένων σε πραγματικό χρόνο.

Αμυντικές Στρατηγικές για την Εποχή της Γενικής Τεχνητής Νοημοσύνης

Η άμυνα ενάντια σε αυτές τις εξελιγμένες απειλές απαιτεί μια πολυεπίπεδη προσέγγιση. Δεν αρκεί να βασιζόμαστε στα φίλτρα ασφαλείας που είναι ενσωματωμένα στα μοντέλα από τους προμηθευτές. Οι επιχειρήσεις πρέπει να ενσωματώσουν αυτά τα μοντέλα στα δικά τους μέτρα ασφαλείας.

Κόκκινη Ομάδα και Χνούδι

Οι οργανισμοί θα πρέπει να ξεκινήσουν προληπτικά stress testing των εφαρμογών τεχνητής νοημοσύνης τους. Η Red teaming περιλαμβάνει ηθικούς χάκερ που προσπαθούν να κάνουν jailbreak σε μοντέλα. Εκτελούν επιθέσεις τεχνητής νοημοσύνης για να εντοπίσουν αδυναμίες.

Αυτό συχνά συνδυάζεται με fuzzing. Το fuzzing είναι μια αυτοματοποιημένη τεχνική όπου χιλιάδες τυχαίες ή ημι-τυχαίες εισόδους εισάγονται στο μοντέλο. Ο στόχος είναι να διαπιστωθεί εάν κάποια από αυτές προκαλούν σφάλματα ή αποκαλύψει δεδομένα εκπαίδευσης.

Ανίχνευση και απόκριση προγράμματος περιήγησης (BDR)

Μια ολοκληρωμένη λύση BDR λειτουργεί ως τείχος προστασίας για την διαδικτυακή συνεδρία του χρήστη. Μπορεί να αποτρέψει την εγκατάσταση κακόβουλων επεκτάσεων που διευκολύνουν την υποβάθμιση δεδομένων ή την κλοπή μοντέλων.

Επιπλέον, επιτρέπει στους οργανισμούς να επιβάλλουν ελέγχους πολιτικής σχετικά με τη χρήση της Γενετικής Τεχνητής Νοημοσύνης (GenAI). Αυτό διασφαλίζει ότι οι εργαζόμενοι δεν συμμετέχουν ακούσια σε μια επίθεση. Αποτρέπει την έκθεση του οργανισμού σε εχθρικές επιθέσεις στην γενετική τεχνητή νοημοσύνη μέσω επικίνδυνων συμπεριφορών.

Διασφάλιση του μέλλοντος της νοημοσύνης

Το παιχνίδι της γάτας με το ποντίκι μεταξύ επιτιθέμενων και αμυνόμενων έχει εισέλθει σε μια νέα φάση. Οι εχθρικές επιθέσεις αποτελούν μια θεμελιώδη πρόκληση για την ακεραιότητα των συστημάτων που χτίζουμε για το μέλλον μας.

Κατανοώντας τις λεπτές αποχρώσεις των εχθρικών επιθέσεων στην Τεχνητή Νοημοσύνη, οι ηγέτες στον τομέα της ασφάλειας μπορούν να δημιουργήσουν ανθεκτικές αρχιτεκτονικές. Η μελλοντική πορεία δεν απαιτεί την εγκατάλειψη της Τεχνητής Νοημοσύνης. Απαιτεί την προστασία του οικοσυστήματος στο οποίο λειτουργεί.

Αυτό σημαίνει ότι πρέπει να αναγνωριστεί ότι το πρόγραμμα περιήγησης δεν είναι πλέον απλώς ένα πρόγραμμα προβολής εγγράφων. Είναι η πρώτη γραμμή άμυνας ενάντια σε εχθρικές επιθέσεις στην παραγωγική τεχνητή νοημοσύνη. Μέσω αυστηρών δοκιμών και παρακολούθησης σε πραγματικό χρόνο, οι επιχειρήσεις μπορούν να πλοηγηθούν σε αυτό το πολύπλοκο τοπίο με σιγουριά.