Učinkovita sigurnost sada zahtijeva da kontroliramo način na koji zaposlenici komuniciraju s generativnim modelima, a ne samo sa samim modelima. 10 najboljih praksi upravljanja umjetnom inteligencijom za 2026. godinu usredotočuje se na osiguranje „zadnje milje“ korisničkog usvajanja, gdje podaci napuštaju poduzeće i ulaze u preglednik.

Što su prakse upravljanja umjetnom inteligencijom i zašto su važne

Upravljanje umjetnom inteligencijom više nije teorijski okvir; to je aktivni sigurnosni tijek rada osmišljen za upravljanje rizicima generativne potrošnje umjetne inteligencije. Ove prakse prebacuju fokus s validacije težina modela na kontrolu „točke korištenja“. Sigurnosni timovi sada moraju upravljati točnim trenutkom kada zaposlenik zalijepi podatke o kupcima u chatbota ili instalira proširenje preglednika pokretano umjetnom inteligencijom.

Najkritičnija praznina u modernom upravljanju je „zadnja milja“; sučelje preglednika gdje korisnici komuniciraju sa SaaS i GenAI alatima. Tradicionalne mrežne obrane ne mogu vidjeti šifrirani promet unutar sesije chata, a kontrole temeljene na API-ju često reagiraju prekasno. Učinkovito upravljanje zahtijeva vidljivost u stvarnom vremenu i provedbu izravno unutar radnog prostora zaposlenika kako bi se spriječilo curenje podataka i blokirali zlonamjerni unosi prije nego što se obrade.

Ključni trendovi upravljanja umjetnom inteligencijom koje treba pratiti u 2026. godini

Prelazak na sigurnosne kontrole izvorne u pregledniku dominantan je trend za 2026. godinu. Sigurnosni lideri udaljavaju se od nespretnih mrežnih proxyja koji narušavaju korisničko iskustvo i prelaze na lagana proširenja preglednika. Ovi alati nalaze se izravno u tijeku rada, omogućujući organizacijama praćenje konteksta upita, pregled dopuštenja proširenja i uklanjanje osjetljivih podataka bez preusmjeravanja prometa.

Još jedan važan razvoj događaja je porast upravljanja svjesnog identiteta za autonomne AI agente. Kako „agent AI“ počinje djelovati u ime korisnika, rezervirati sastanke, pisati kod ili ispitivati baze podataka, statičke liste dopuštenih osoba ne uspijevaju. Strategije upravljanja razvijaju se kako bi se provele kontrole pristupa temeljene na ulogama (RBAC) koje ograničavaju ono što AI agent može učiniti na temelju specifičnih privilegija korisnika i osjetljivosti podataka.

10 najboljih alata za upravljanje umjetnom inteligencijom za 2026. godinu

U nastavku su navedena najbolja rješenja koja omogućuju sigurno usvajanje umjetne inteligencije putem provedbe, vidljivosti i upravljanja rizicima.

| Praksa | Ključni fokus | Najbolje za |

| SlojX | Provedba temeljena na pregledniku | Zatvaranje sigurnosne praznine "zadnje milje" |

| Harmonijska sigurnost | Otkriće umjetne inteligencije u sjeni | Stjecanje potpunog uvida u primjenu umjetne inteligencije |

| Brza sigurnost | Obrana od brze injekcije | Zaštita GenAI interakcija od zlouporabe |

| Lasso sigurnost | Kontrola pristupa temeljena na ulogama | Provođenje politika s obzirom na kontekst |

| Umjetna inteligencija sumraka | Sprječavanje gubitka podataka (DLP) | Sprječavanje curenja PII/IP podataka u stvarnom vremenu |

| AIM sigurnost | Inventar AI imovine | Centralizirano praćenje svih AI alata |

| Svjedok umjetne inteligencije | Automatizirano bodovanje rizika | Pojednostavljenje odobravanja sigurnih alata umjetne inteligencije |

| knostički | Zapisivanje revizije i usklađenosti | Ispunjavanje regulatornih zahtjeva |

| Polimer | Obuka i osvješćivanje zaposlenika | Izgradnja kulture osviještene o sigurnosti |

| Lakera | Kontinuirano praćenje | Otkrivanje anomalija i odstupanja od politika |

1. SlojX

LayerX je sigurnosna platforma za preglednike koja funkcionira kao lagano proširenje, postavljajući kontrole upravljanja izravno tamo gdje korisnici komuniciraju s umjetnom inteligencijom. Rješava problem "zadnje milje" praćenjem svakog pritiska tipke, radnje lijepljenja i prijenosa datoteke u stvarnom vremenu. To omogućuje sigurnosnim timovima provođenje detaljnih pravila, poput blokiranja lijepljenja izvornog koda u ChatGPT ili sprječavanja instalacije visokorizičnih AI proširenja, bez ometanja tijeka rada korisnika ili potrebe za namjenskim poslovnim preglednikom.

Platforma se ističe u pružanju dubinskog uvida u korištenje sankcionirane i "Shadow AI" na upravljanim i BYOD uređajima. LayerX analizira kontekst interakcija preglednika kako bi razlikovao sigurne zadatke od rizičnih ponašanja, osiguravajući da osjetljivi korporativni podaci nikada ne ostavljaju okruženje preglednika nezaštićenim. Njegov pristup omogućuje organizacijama da sigurno usvoje GenAI alate ublažavanjem rizika poput krađe podataka i preuzimanja računa na izvoru.

2. Harmonijska sigurnost

Harmonic Security se fokusira na rješavanje problema Shadow AI identificiranjem i kategorizacijom svakog AI alata koji zaposlenici koriste, bez obzira na to je li formalno odobren. Umjesto oslanjanja na statičke liste blokiranih podataka, Harmonic koristi specijalizirane modele malih jezika za analizu namjere i sadržaja prijenosa podataka. To mu omogućuje razlikovanje između bezopasnog upita i rizičnog prijenosa reguliranih podataka, omogućujući stav „sigurnosti po zadanim postavkama“ koji omogućuje zaposlenicima korištenje novih alata bez izlaganja organizacije riziku.

Platforma izrađuje sveobuhvatnu mapu usvajanja umjetne inteligencije u cijelom poduzeću, dajući sigurnosnim liderima jasan uvid u to koji odjeli koriste koje alate. Razumijevajući poslovni kontekst korištenja umjetne inteligencije, Harmonic pomaže timovima u izradi politika koje podržavaju inovacije, a istovremeno automatski označava ili blokira visokorizične aplikacije koje ne zadovoljavaju sigurnosne standarde.

3. Brza zaštita

Prompt Security specijaliziran je za obranu od napada prompt injection, kritične ranjivosti gdje zlonamjerni unosi manipuliraju ponašanjem GenAI-a. Njihovo rješenje prati model objekta dokumenta (DOM) i korisničke unose kako bi otkrilo pokušaje jailbreaka modela ili krađe podataka putem skrivenih naredbi. Ovaj fokus čini ih ključnim slojem obrane za organizacije koje grade ili implementiraju javno dostupne GenAI aplikacije gdje se korisničkom unosu ne može u potpunosti vjerovati.

Osim obrane od ubrizgavanja, Prompt Security pruža alate za dezinfekciju ulaza i provjeru izlaza, osiguravajući da LLM-ovi nenamjerno ne generiraju štetan sadržaj ili ne otkrivaju sistemske upute. Njihova se tehnologija integrira u razvojni proces, pomažući inženjerskim timovima da osiguraju svoje AI značajke prije nego što dođu u produkciju.

4. Lasso Security

Lasso Security pruža kontekstualnu kontrolu pristupa temeljenu na ulogama (RBAC) za GenAI, osiguravajući da korisnici mogu pristupiti samo modelima i podacima koji su prikladni za njihovu specifičnu radnu funkciju. Njihova platforma ide dalje od jednostavnih zapisa pristupa kako bi provodila pravila na temelju identiteta korisnika, osjetljivosti podataka i namjeravanog slučaja upotrebe. Ova granularna kontrola sprječava „procjenu pristupa“, gdje zaposlenici zadržavaju pristup moćnim alatima umjetne inteligencije koji im više nisu potrebni.

Rješenje također prati anomalije u stvarnom vremenu, poput iznenadnog upita zaposlenika marketinga asistentu za kodiranje za vjerodajnice baze podataka. Korelacijom identiteta korisnika s obrascima ponašanja, Lasso pomaže organizacijama da otkriju i zaustave internu zlouporabu alata umjetne inteligencije prije nego što dovede do kršenja podataka.

5. Noćna umjetna inteligencija

Nightfall AI donosi naprednu prevenciju gubitka podataka (DLP) u eru umjetne inteligencije, koristeći detektore strojnog učenja obučene na milijunima uzoraka za identifikaciju osjetljivih podataka s visokom preciznošću. Njihovo rješenje skenira podatke u pokretu i u mirovanju, otkrivajući PII, zdravstvene zapise i tajne poput API ključeva prije nego što se prenesu na GenAI platforme. Nightfallovi detektori su podešeni za razumijevanje konteksta, značajno smanjujući lažno pozitivne rezultate u usporedbi s tradicionalnim DLP alatima temeljenim na regularnim izrazima.

Za upravljanje umjetnom inteligencijom, Nightfall se integrira s tijekovima rada preglednika i oblaka kako bi u stvarnom vremenu redigirao ili blokirao osjetljive informacije. Ova mogućnost omogućuje zaposlenicima korištenje alata za produktivnost poput chatbotova, a istovremeno osigurava strogo poštivanje propisa o usklađenosti poput GDPR-a i HIPAA-e, čak i u nestrukturiranim upitima.

6. Sigurnost AIM-a

AIM Security se fokusira na stvaranje cjelovitog inventara AI imovine, koji učinkovito služi kao „AI popis materijala“ za poduzeće. Njihova platforma skenira IT okruženje kako bi otkrila sve implementirane modele, skupove podataka za obuku i AI integrirane aplikacije. Ovaj centralizirani prikaz omogućuje sigurnosnim timovima praćenje životnog ciklusa svake AI imovine, od nabave do dekomisije, osiguravajući da nijedan „zombi“ model ne ostane u pogonu bez nadzora.

Održavanjem inventara u stvarnom vremenu, AIM Security pomaže organizacijama u identificiranju ovisnosti i potencijalnih rizika u lancu opskrbe. Ako se utvrdi da određeni model otvorenog koda ima ranjivost, administratori mogu odmah pronaći svaku instancu tog modela unutar svoje infrastrukture i primijeniti potrebne zakrpe ili ublažavanja.

7. Svjedok umjetne inteligencije

Witness AI pruža automatizirano bodovanje rizika kako bi pojednostavio evaluaciju i odobravanje novih AI alata. Njihova platforma dodjeljuje dinamički rezultat rizika aplikacijama na temelju njihovih uvjeta pružanja usluge, praksi rukovanja podacima i certifikata usklađenosti. To omogućuje sigurnosnim timovima da brzo provjere zahtjeve za novi softver, zamjenjujući dugotrajne ručne preglede odlukama temeljenim na podacima.

Platforma također kontinuirano prati rizik odobrenih alata, upozoravajući administratore ako dobavljač promijeni svoju politiku privatnosti ili pretrpi sigurnosni incident. Ova kontinuirana procjena osigurava da popis odobrenog softvera organizacije ostane točan i siguran tijekom vremena.

8. Knostic

Knostic se bavi izazovom revizije i autorizacije tako što točno bilježi tko pristupa kojem znanju unutar AI sustava organizacije. Njihovo rješenje odgovara na pitanje „potrebe za znanjem“, osiguravajući da GenAI alati ne zaobilaze postojeća dopuštenja datoteka kako bi prikazali povjerljive dokumente neovlaštenim korisnicima. Knostic generira detaljne revizijske tragove koji mapiraju upite na određene dokumente korištene za generiranje odgovora.

Ova razina transparentnosti ključna je za regulirane industrije koje moraju pokazati strogu kontrolu nad protokom informacija. Knosticove kontrole autorizacije sprječavaju „curenje znanja“, gdje LLM nenamjerno otkriva osjetljive strateške odluke ili HR podatke zaposlenicima koji ne bi trebali imati pristup tim informacijama.

9. Polimer

Polymer primjenjuje pristup upravljanja usmjeren na čovjeka koristeći "podsticaje" i obuku u stvarnom vremenu kako bi izgradio kulturu svjesnu sigurnosti. Umjesto jednostavnog blokiranja rizične radnje, Polymerov sustav intervenira skočnim prozorom s objašnjenjem zašto radnja je rizična i predlaže sigurniju alternativu. Ova edukacija „u trenutku“ pomaže smanjiti umor od opreza i potiče zaposlenike da postanu aktivni sudionici u sigurnosnom procesu.

Njihova platforma je posebno učinkovita za organizacije koje žele smanjiti opterećenje svojih SOC timova. Osnažujući korisnike da sami ispravljaju pogreške niskog rizika, Polymer omogućuje sigurnosnim analitičarima da se usredotoče na stvarne prijetnje, a istovremeno stalno poboljšavaju ukupne navike rukovanja podacima u organizaciji.

10. Lakera

Lakera se specijalizira za kontinuirano praćenje i "crveno timsko djelovanje" za AI aplikacije kako bi otkrila odstupanje od pravila i napade neprijatelja. Njihova platforma, Lakera Guard, djeluje kao vatrozid za LLM-ove, stojeći između korisnika i modela kako bi filtrirala promptne injekcije, jailbreake i toksične unose. Ovo kontinuirano testiranje osigurava da AI modeli ostanu usklađeni sa sigurnosnim smjernicama čak i dok napadači razvijaju svoje tehnike.

Lakera također pruža bazu podataka poznatih uputa i vektora napada, omogućujući organizacijama da usporede svoju obranu s najnovijim prijetnjama. Ovaj proaktivni stav pomaže programerima da identificiraju slabosti u svojim AI aplikacijama prije nego što se implementiraju u produkciju, smanjujući rizik od propusta javne sigurnosti.

Kako odabrati najboljeg pružatelja usluga upravljanja umjetnom inteligencijom

- Dajte prioritet vidljivosti „Shadow AI“ kako biste razumjeli puni opseg neupravljanih alata koje vaši zaposlenici već koriste.

- Odaberite rješenje s provedbom u pregledniku kako biste osigurali podatke na mjestu unosa bez usmjeravanja prometa kroz složene proxyje.

- Osigurajte da alat nudi detaljne kontrole temeljene na identitetu kako biste mogli omogućiti različite razine pristupa za razvojne programere, HR i marketing.

- Potražite automatizirane mogućnosti sanacije koje mogu u stvarnom vremenu redigirati osjetljive podatke umjesto da samo blokiraju cijelu aplikaciju.

- Provjerite podržava li pružatelj usluge kontinuiranu reviziju usklađenosti kako bi zadovoljio regulatorne standarde poput ISO 42001 i Zakona EU o umjetnoj inteligenciji.

Pitanja i odgovori

Što je upravljanje umjetnom inteligencijom u praktičnom sigurnosnom smislu?

U praktičnom smislu, upravljanje umjetnom inteligencijom je skup tehničkih kontrola i politika koje diktiraju kako zaposlenici i aplikacije komuniciraju s generativnom umjetnom inteligencijom. Uključuje praćenje upita za osjetljive podatke, provjeru sigurnosnog stanja dobavljača umjetne inteligencije i osiguravanje da su rezultati generirani umjetnom inteligencijom točni i sigurni za korištenje.

Po čemu se upravljanje umjetnom inteligencijom razlikuje od sigurnosti modela umjetne inteligencije?

Sigurnost AI modela usredotočuje se na zaštitu težina, parametara i infrastrukture samog modela od krađe ili neovlaštenog mijenjanja. Upravljanje AI-om je šire i fokusira se na upotreba modela; osiguravanje da su podaci koji se u njega unose usklađeni, da su korisnici koji mu pristupaju ovlašteni i da se upravlja poslovnim rizicima implementacije.

Što bismo prvo trebali kontrolirati: upute, datoteke ili pristup alatima?

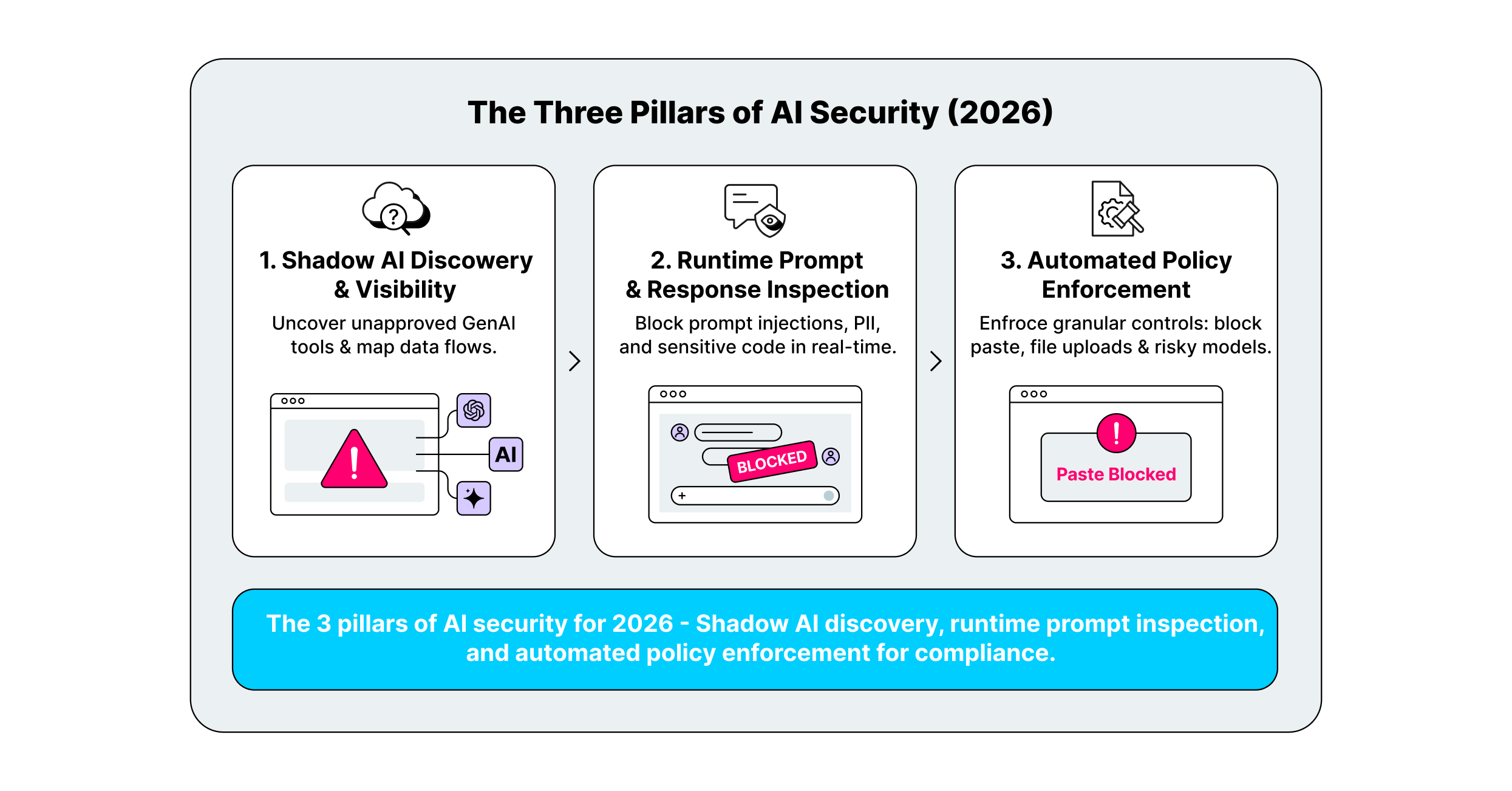

Prvo biste trebali kontrolirati vidljivost i pristup alatima. Ne možete upravljati onim što ne možete vidjeti, stoga je prepoznavanje alata koji se koriste (Shadow AI) temeljni korak. Nakon što se uspostavi vidljivost, možete implementirati kontrole za upite i prijenos datoteka kako biste spriječili curenje podataka.

Trebamo li nam poseban poslovni preglednik za upravljanje umjetnom inteligencijom?

Ne, ne trebate namjenski poslovni preglednik. Moderne sigurnosne platforme preglednika poput LayerX-a funkcioniraju kao proširenja koja se nalaze na standardnim preglednicima poput Chromea i Edgea. To vam omogućuje primjenu upravljanja i sigurnosnih kontrola na razini poduzeća bez prisiljavanja korisnika da pređu na novo, nepoznato sučelje preglednika.

Kako mjerite učinkovitost upravljanja umjetnom inteligencijom?

Učinkovitost se mjeri smanjenjem incidenata „Shadow AI“, brzinom odobravanja novih sigurnih alata i brojem spriječenih curenja podataka. Uspješno upravljanje treba pratiti i stopama prihvaćanja od strane korisnika; ako zaposlenici zaobilaze kontrole kako bi obavljali svoj posao, strategiju upravljanja treba prilagoditi.