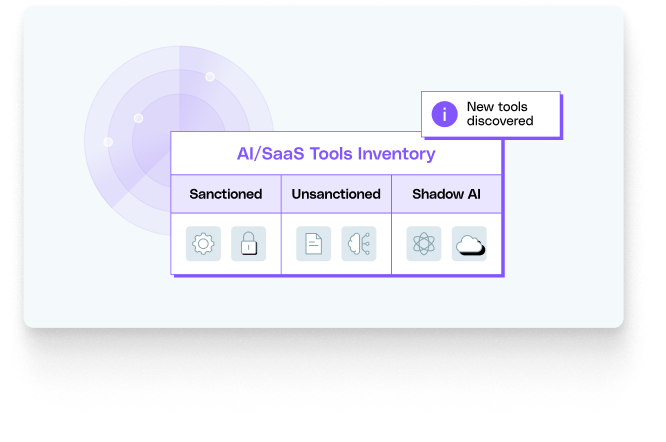

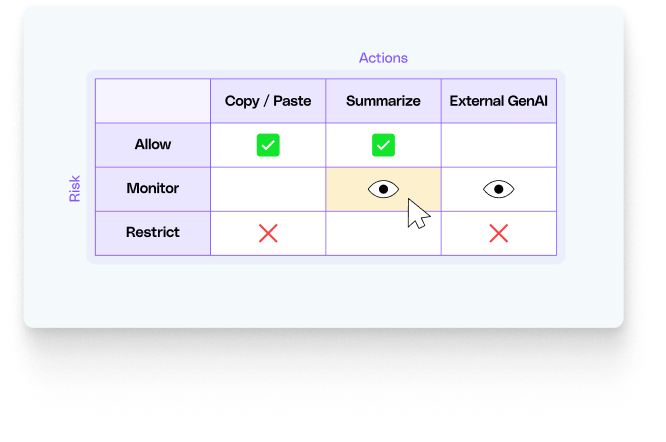

Per implementare questo tipo di sicurezza granulare e contestuale, le organizzazioni si affidano sempre più a soluzioni come LayerX. Operando direttamente all'interno del browser, LayerX offre la visibilità approfondita e il controllo in tempo reale necessari per gestire i rischi dell'intelligenza artificiale moderna.

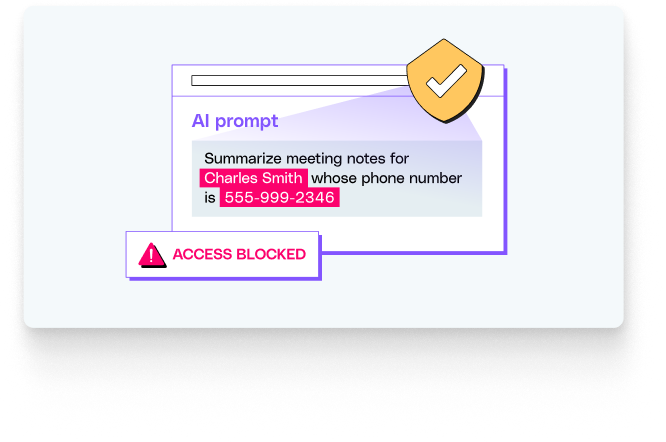

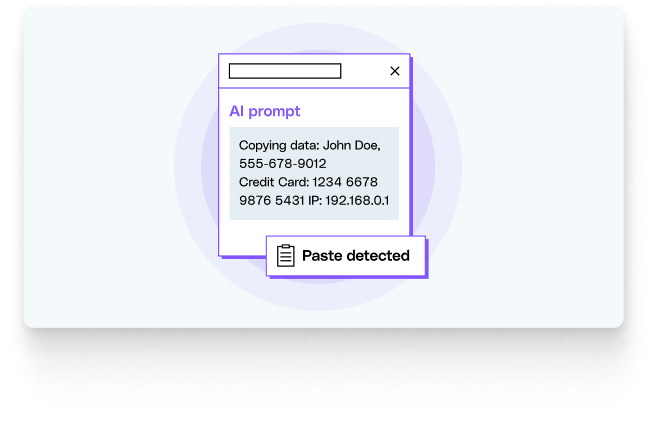

Immaginate uno scenario in cui un addetto al marketing utilizza uno strumento di intelligenza artificiale non autorizzato per redigere un comunicato stampa. Tenta di incollare un documento contenente dati finanziari non annunciati e nomi di clienti. Una soluzione di sicurezza tradizionale probabilmente non sarebbe in grado di rilevare questa azione. Tuttavia, una soluzione a livello di browser come LayerX può: