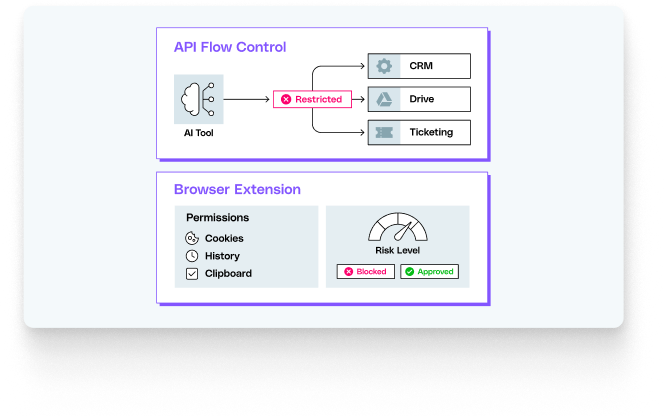

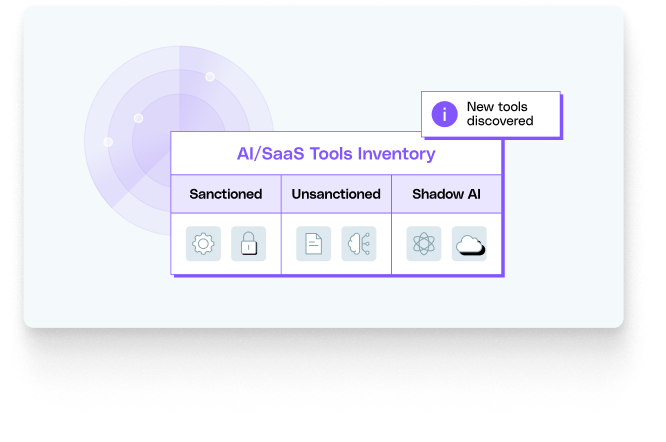

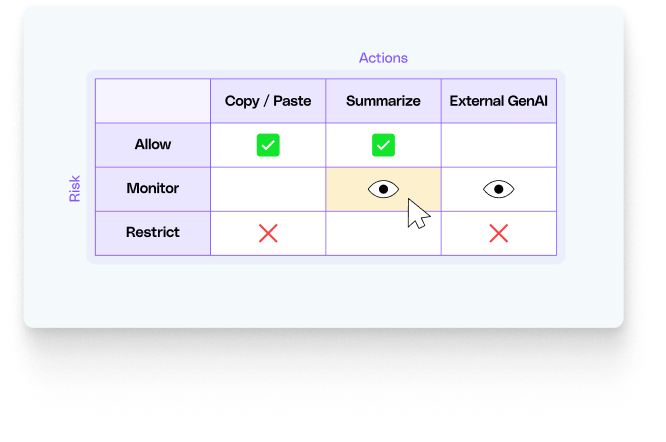

이처럼 세분화되고 상황 인식이 가능한 보안을 구현하기 위해 기업들은 LayerX와 같은 솔루션을 점점 더 많이 활용하고 있습니다. LayerX는 브라우저 내에서 직접 작동함으로써 최신 AI 관련 위험을 관리하는 데 필요한 심층적인 가시성과 실시간 제어 기능을 제공합니다.

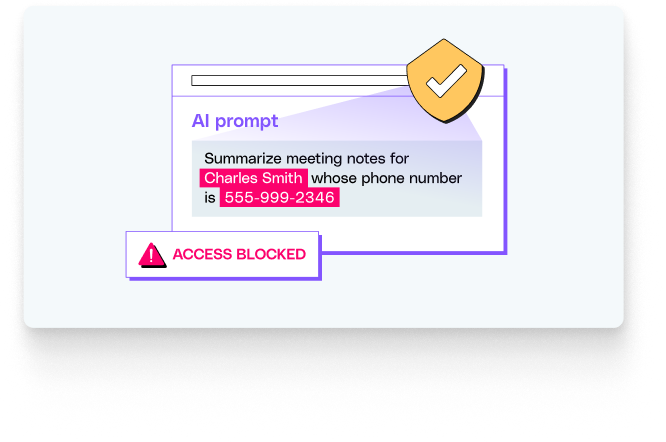

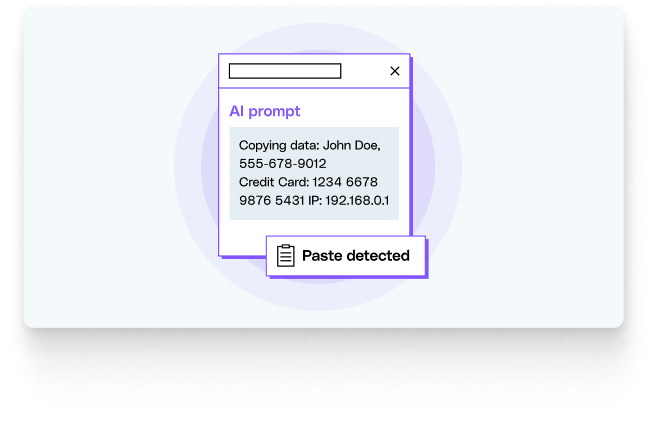

마케팅 담당자가 승인되지 않은 AI 도구를 사용하여 보도자료 작성을 돕는 상황을 상상해 보세요. 미공개 재무 수치와 고객 이름이 포함된 문서를 붙여넣으려고 시도합니다. 기존 보안 솔루션은 이러한 행위를 감지하지 못할 가능성이 높습니다. 하지만 LayerX와 같은 브라우저 수준 솔루션은 다음과 같은 작업을 수행할 수 있습니다.