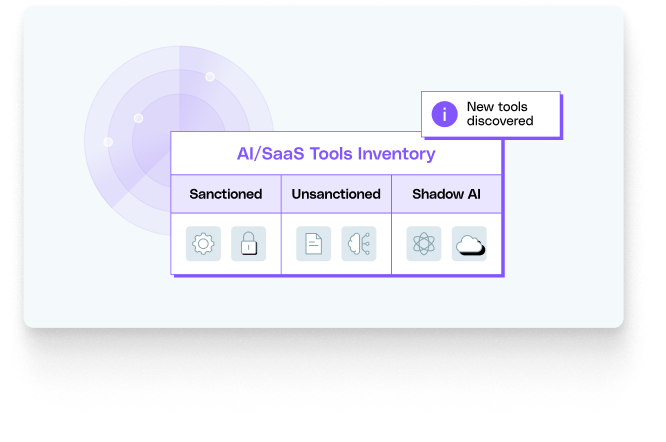

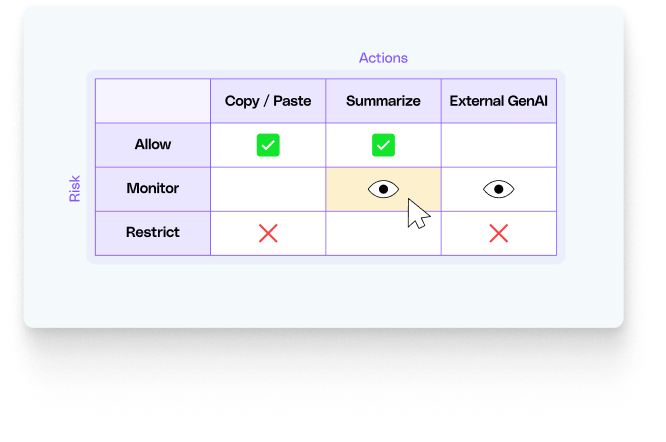

For å implementere denne typen detaljert, kontekstbevisst sikkerhet, vender organisasjoner seg i økende grad til løsninger som LayerX. Ved å operere direkte i nettleseren gir LayerX den dype innsikten og sanntidskontrollen som trengs for å håndtere moderne AI-risikoer.

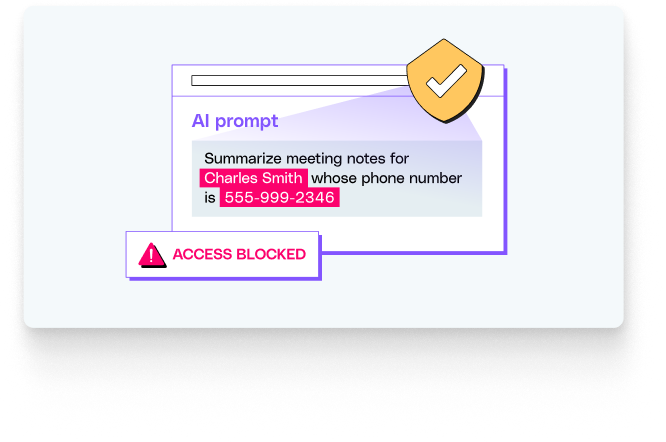

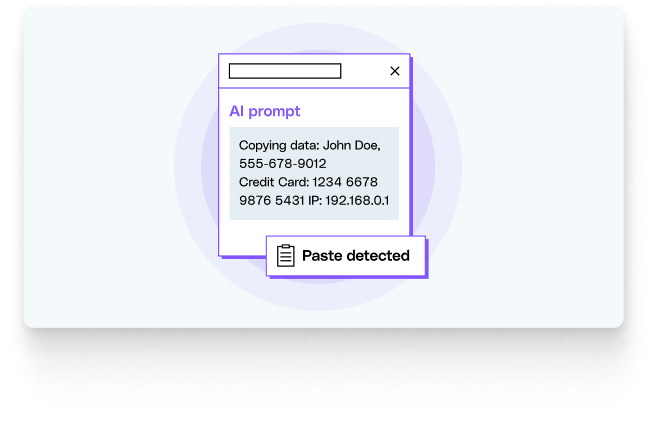

Tenk deg et scenario der en markedsføringsmedarbeider bruker et uautorisert AI-verktøy for å utarbeide en pressemelding. De prøver å lime inn et dokument som inneholder uanmeldte økonomiske tall og kundenavn. En tradisjonell sikkerhetsløsning ville sannsynligvis ikke være oppmerksom på denne handlingen. En nettlesernivåløsning som LayerX kan imidlertid: