Technologia sztucznej inteligencji przeszła od eksperymentalnej zabawki do podstawowego elementu w miejscu pracy w niecałe trzy lata. To wszyscy wiedzieliśmy. Nikt nie spodziewał się jednak, jak szybko przewyższy ona tradycyjne kategorie SaaS, nie tylko pod względem adopcji, ale także ryzyka.

Nasza nowa Raport dotyczący bezpieczeństwa danych w przedsiębiorstwach w zakresie sztucznej inteligencji i oprogramowania jako usługi (SaaS) z 2025 r., oparte na rzeczywistych danych telemetrycznych przeglądania Internetu przez klientów korporacyjnych LayerX, ujawniają coś zaskakującego: sztuczna inteligencja nie jest już technologią „nowoczesną”. Jest obecnie największym, pojedynczym, martwym punktem w nowoczesnych przedsiębiorstwach, jeśli chodzi o wyciek danych.

W przeciwieństwie do poczty e-mail czy udostępniania plików, nad którymi zespoły ds. bezpieczeństwa pracowały latami, większość zastosowań sztucznej inteligencji odbywa się w ukryciu: poza logowaniem jednokrotnym (SSO), poza widocznością i poza kontrolą przedsiębiorstwa.

Wdrażanie sztucznej inteligencji z zawrotną prędkością

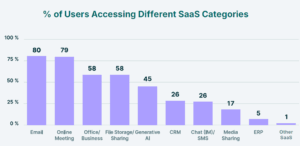

Zacznijmy od nagłówka: 45% pracowników przedsiębiorstw korzysta już z generatywnych narzędzi AI. To prawie połowa siły roboczej w niecałe trzy lata od pojawienia się tych narzędzi. Dla porównania, podobne rozpowszechnienie w kategoriach SaaS, takich jak udostępnianie plików czy wideokonferencje, zajęło ponad dekadę.

Co jeszcze bardziej uderzające: 92% całego wykorzystania sztucznej inteligencji w przedsiębiorstwach koncentruje się w jednym narzędziu – ChatGPT. To sprawia, że jest to nie tylko najszybciej rozwijająca się kategoria, ale także najbardziej skoncentrowana. Pojedyncza platforma skierowana do konsumentów stała się de facto standardem sztucznej inteligencji w przedsiębiorstwach.

Samo w sobie przyjęcie na taką skalę nie jest zaskoczeniem. Szok pojawia się, gdy spojrzymy na w jaki sposób pracownicy z niego korzystają.

Zaskakująca ścieżka danych: kopiuj/wklej, a nie przesyłanie

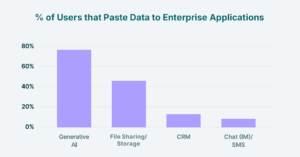

Większość dyrektorów ds. bezpieczeństwa informacji martwi się przesyłaniem plików. I nie bez powodu: 40% plików przesłanych do narzędzi GenAI zawiera poufne dane PII lub PCI. Stanowi to prawie połowę wszystkich przesłanych plików.

Ale prawdziwy szok kryje się gdzie indziej. Nasze dane pokazują, że większość wrażliwych danych w ogóle nie opuszcza przedsiębiorstwa poprzez przesyłanie. Opuszcza je poprzez kopiuj / wklej.

- 77% pracowników wkleja dane do komunikatów GenAI

- 82% tych past pochodzi z kont osobistych

- Pracownicy średnio dziennie wklejają 14 danych na konta niefirmowe, a co najmniej 3 z tych działań wklejania danych zawierają poufne dane

To sprawia, że skromny schowek, często pomijany kanał bezplikowy i niestrukturalny, staje się wektorem numer jeden w zakresie eksfiltracji poufnych danych. Same narzędzia GenAI odpowiadają za 32% wszystkich transferów danych między firmami a osobami prywatnymi.

Tradycyjne narzędzia DLP, oparte na monitorowaniu plików, nawet nie rejestrują tego zjawiska. Oznacza to, że przedsiębiorstwa nie tylko nie nadążają w zarządzaniu sztuczną inteligencją, ale wręcz ją ślepią.

Konta osobiste rządzą

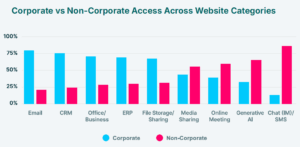

Przedsiębiorstwa zainwestowały miliony w bezpieczeństwo tożsamości, federację i logowanie jednokrotne (SSO). Jednak, według naszych danych, te mechanizmy kontroli ledwo dotykają kategorii sztucznej inteligencji.

- 67% wykorzystania sztucznej inteligencji odbywa się za pośrednictwem niezarządzanych kont osobistych

- 71% logowań do CRM i 83% logowań do ERP nie jest zrzeszonych

- Nawet konta „firmowe” są często zabezpieczone wyłącznie hasłem, co sprawia, że funkcjonalnie nie da się ich odróżnić od kont osobistych

Wnioski? Korporacja ≠ bezpieczeństwo. Do systemów przechowujących najwrażliwsze dane klientów i dane finansowe, takich jak CRM, ERP, a teraz także AI, dostęp odbywa się tak, jakby były to aplikacje konsumenckie. Kontrola tożsamości istnieje, ale pracownicy po prostu ją omijają.

Zarządzanie: nigdzie go nie ma

Najbardziej sprzecznym z intuicją wnioskiem z naszych badań jest to, że im bardziej sztuczna inteligencja jest wbudowana w procesy przedsiębiorstwa, tym słabsza jest kontrola nad nią.

Pracownicy wklejają poufne dane do monitów. Przesyłają pliki na konta konsumenckie. Logują się przy użyciu niezarządzanych tożsamości. A wszystko to dzieje się poza oficjalnym nadzorem.

Porównajmy to z pocztą elektroniczną, gdzie dekady DLP, archiwizacji i federacji zbudowały przynajmniej jakąś formę zabezpieczeń. W porównaniu z nią sztuczna inteligencja to Dziki Zachód.

A jednak sztuczna inteligencja już nie „powstaje”. Już teraz odpowiada za 11% całej działalności przedsiębiorstw, rywalizując ze sobą w kategoriach, które od dziesięcioleci definiują produktywność przedsiębiorstw. Przedsiębiorstwa działają na oślep w swojej najszybciej rozwijającej się kategorii.

Co powinni teraz zrobić CISO

Na podstawie tych danych wyróżniono trzy najpilniejsze priorytety:

- Traktuj sztuczną inteligencję jako kategorię przedsiębiorstw najwyższej klasy.

GenAI nie jest już eksperymentem. Sam ChatGPT osiąga 43% penetracji przedsiębiorstw, dorównując w ułamku czasu wdrożeniu Zooma. 45% pracowników aktywnie korzysta z narzędzi AI, a AI stanowi 11% całej aktywności przeglądania stron internetowych w przedsiębiorstwach. GenAI musi być teraz zarządzane z taką samą rygorystycznością, jak poczta e-mail i systemy udostępniania plików. Faza eksperymentalna dobiegła końca. Zasługuje na takie samo zarządzanie i kontrolę, jak poczta e-mail czy przechowywanie plików, z monitorowaniem zarówno przesyłania, jak i działań bezplikowych, takich jak kopiowanie/wklejanie. - Traktuj niefederacyjne logowania korporacyjne jako aktywną infrastrukturę IT w trybie cienia

Badania ujawniają, że nawet gdy pracownicy korzystają z korporacyjnych danych uwierzytelniających do kluczowych aplikacji, takich jak ERP (83% bez logowania jednokrotnego) i CRM (71% bez logowania jednokrotnego), brak federacji logowania jednokrotnego sprawia, że te logowania są funkcjonalnie identyczne z niezarządzanymi kontami osobistymi. Zamiast więc po prostu priorytetyzować logowanie jednokrotne w przypadku nowych aplikacji SaaS, natychmiast przeklasyfikować wszystkie konta niefederacyjne w systemach krytycznych jako niezarządzane zasoby IT w cieniuNatychmiastowym działaniem powinno być przeprowadzenie audytu skoncentrowanego na systemach ERP i CRM w celu zidentyfikowania wszystkich punktów dostępu niebędących punktami federacyjnymi. Należy traktować usuwanie tych luk z taką samą pilnością, jak usuwanie ich z publicznie dostępnego serwera, ponieważ stanowią one niewidzialną i niekontrolowaną ścieżkę dostępu do danych i ich eksfiltracji. - Wdrażaj zasady uwzględniające dane zamiast blokować dostęp do kont osobistych

Znaczna część przesyłania i wklejania danych do narzędzi GenAI (67% kont osobistych) i komunikatorów internetowych (87% kont osobistych) odbywa się za pośrednictwem kont niefirmowych. Samo blokowanie dostępu do tych usług jest często niepraktyczne i prowadzi do powstania tzw. shadow IT. Dlatego należy odejść od binarnej postawy „blokuj/zezwól” na rzecz… polityka uwzględniająca kontekst i skoncentrowana na danych. Zezwól pracownikom na dostęp do osobistych instancji ChatGPT, Google Drive lub WhatsApp Web, ale wdróż kontrole na poziomie przeglądarki, które zapobiegać wklejaniu lub przesyłaniu do nich poufnych danych korporacyjnych (zidentyfikowanych przez klasyfikatory)Podejście to uwzględnia rzeczywistość współczesnych przepływów pracy, jednocześnie tworząc istotną granicę bezpieczeństwa wokół samych danych, a nie aplikacji. - Przenieś budżety DLP z analizy sieci/plików na kontrolę wklejania na poziomie przeglądarki:Wyniki pokazują, że kopiowanie/wklejanie stało się głównym kanałem eksfiltracji danych, wyprzedzając przesyłanie plików, przy czym 77% pracowników wkleja dane do narzędzi GenAI, a 62% wkleja dane do komunikatorów internetowych zawierających dane osobowe/PCI. Tradycyjne sieciowe rozwiązania DLP nie uwzględniają tego bezplikowego przepływu danych. W rezultacie organizacje powinny zmienić strategię ochrony danych i alokację budżetu, odchodząc od monitorowania zorientowanego na pliki. Nadaj priorytet wdrażaniu rozwiązań zabezpieczających natywnych dla przeglądarek lub bezpiecznych przeglądarek korporacyjnych, które mogą sprawdzać, klasyfikować i blokować poufne dane podczas zdarzeń kopiowania/wklejania zanim jest przesyłany do formularza internetowego, komunikatora AI lub okna czatu. Kluczem jest kontrola danych w momencie działania – w przeglądarce – a nie tylko w trakcie przesyłania.

Dlaczego dane LayerX są inne

Podczas gdy inne raporty dotyczące wdrażania sztucznej inteligencji opierają się na ankietach lub danych zebranych od samych respondentów, nasz opiera się na bezpośrednie dane telemetryczne przeglądarek pochodzące od samych użytkowników korporacyjnych. Oznacza to brak zgadywania — tylko wgląd w aktywność w świecie rzeczywistym w aplikacjach zatwierdzonych, niezatwierdzonych i działających w tle.

Ta wyjątkowa perspektywa ujawnia to, czego nie potrafią zrobić ankiety: że kopiuj/wklej, a nie przesyłanie danych, jest głównym kanałem wycieku danych; że konta osobiste dominują nawet w krytycznych dla przedsiębiorstwa procesach pracy; i że sztuczna inteligencja nie jest jedynie ryzykiem na horyzoncie — to ryzyko, które dzieje się już teraz.

Bottom Line

Dyrektorzy ds. bezpieczeństwa informacji (CISO) poświęcili lata na budowanie systemu zarządzania pocztą e-mail, przechowywaniem plików i licencjonowanym oprogramowaniem SaaS. Tymczasem sztuczna inteligencja stała się najszybciej rozwijającą się kategorią przedsiębiorstw, z której korzysta codziennie prawie połowa pracowników. I prawie nic z niej nie jest bezpieczne.

To właśnie paradoks ujawniają nasze dane: im bardziej niezbędna staje się sztuczna inteligencja, tym mniejszy jest nadzór nad nią.

Schowek stał się nową granicą wycieków danych w przedsiębiorstwach. ChatGPT stał się de facto standardem AI w przedsiębiorstwach. A niezarządzane konta po cichu zmieniają zasady dotyczące tożsamości.

Wyzwaniem dla liderów bezpieczeństwa nie jest to, czy zarządzać sztuczną inteligencją. Chodzi o to, jak szybko uda im się ją opanować – zanim niewidzialny strumień wycieku danych zamieni się w powódź.

Pobierz pełny raport aby odkryć pełną skalę ryzyka związanego z danymi AI i SaaS.