Szybkie wdrażanie generatywnej sztucznej inteligencji (GenAI) wprowadziło złożoną warstwę ryzyka, której tradycyjne zabezpieczenia nie są w stanie odpowiednio zaradzić. Dla współczesnych przedsiębiorstw wyzwaniem nie jest już tylko zabezpieczenie sieci, ale także zabezpieczenie przeglądarki, głównego miejsca pracy, w którym pracownicy korzystają z narzędzi AI. W miarę jak organizacje ścigają się z czasem, by wdrożyć te zaawansowane technologie, zapotrzebowanie na kompleksowe monitorowanie bezpieczeństwa AI przesunęło się z poziomu „fajnego dodatku” do krytycznego wymogu operacyjnego.

Zespoły ds. bezpieczeństwa stoją dziś przed podwójnym wyzwaniem. Muszą umożliwić wzrost produktywności GenAI, jednocześnie neutralizując ryzyko wycieku danych i kradzieży tożsamości. Ta równowaga wymaga odejścia od tradycyjnych mechanizmów kontroli opartych na sieci. Wymaga strategii, która operacjonalizuje monitorowanie zarządzania AI bezpośrednio w punkcie interakcji: przeglądarce.

Martwy punkt: dlaczego tradycyjne zabezpieczenia sieci zawodzą w GenAI

Przez dekady sztuczna inteligencja (AI) w zakresie bezpieczeństwa i monitorowania sieci koncentrowała się na obwodzie. Zapory sieciowe, bezpieczne bramy sieciowe (SWG) i brokerzy zabezpieczeń dostępu do chmury (CASB) zostały zaprojektowane w celu inspekcji ruchu przychodzącego i wychodzącego z sieci korporacyjnej. Jednak interakcje GenAI są zniuansowane. Często obejmują one szyfrowane sesje (HTTPS), w których ładunek, czyli rzeczywista konwersacja między użytkownikiem a modelem AI, pozostaje nieprzejrzysty dla inspekcji na poziomie sieci.

Tradycyjne narzędzia mają problem z rozróżnieniem nieszkodliwego zapytania, takiego jak „Napisz e-mail marketingowy”, od wysokiego ryzyka, np. „Debuguj ten zastrzeżony fragment kodu”. Dla zapory sieciowej oba wyglądają jak ogólny ruch HTTPS. openai.com or anthropic.comTa luka w widoczności tworzy niebezpieczny, martwy punkt. Zespoły ds. bezpieczeństwa są pozostawione same sobie, nie mogąc dostrzec kontekstu danych opuszczających ich organizację.

LayerX rozwiązuje ten fundamentalny problem. Umieszczając czujnik i moduł wymuszający w samym rozszerzeniu przeglądarki, LayerX zyskuje przejrzysty wgląd w tekst każdej interakcji. Pozwala to na szczegółowe monitorowanie przez sztuczną inteligencję, która rejestruje intencje i treść działań użytkownika przed ich zaszyfrowaniem.

Wizualizacja luki widoczności

Aby zrozumieć skalę tego problemu, porównajmy możliwości wykrywania starszych rozwiązań z podejściem skoncentrowanym na przeglądarce. Chociaż narzędzia sieciowe skutecznie filtrują znane domeny złośliwego oprogramowania, nie sprawdzają one zawartości zatwierdzonych sesji.

Odkrywanie cienia: monitorowanie zarządzania sztuczną inteligencją w nowoczesnym przedsiębiorstwie

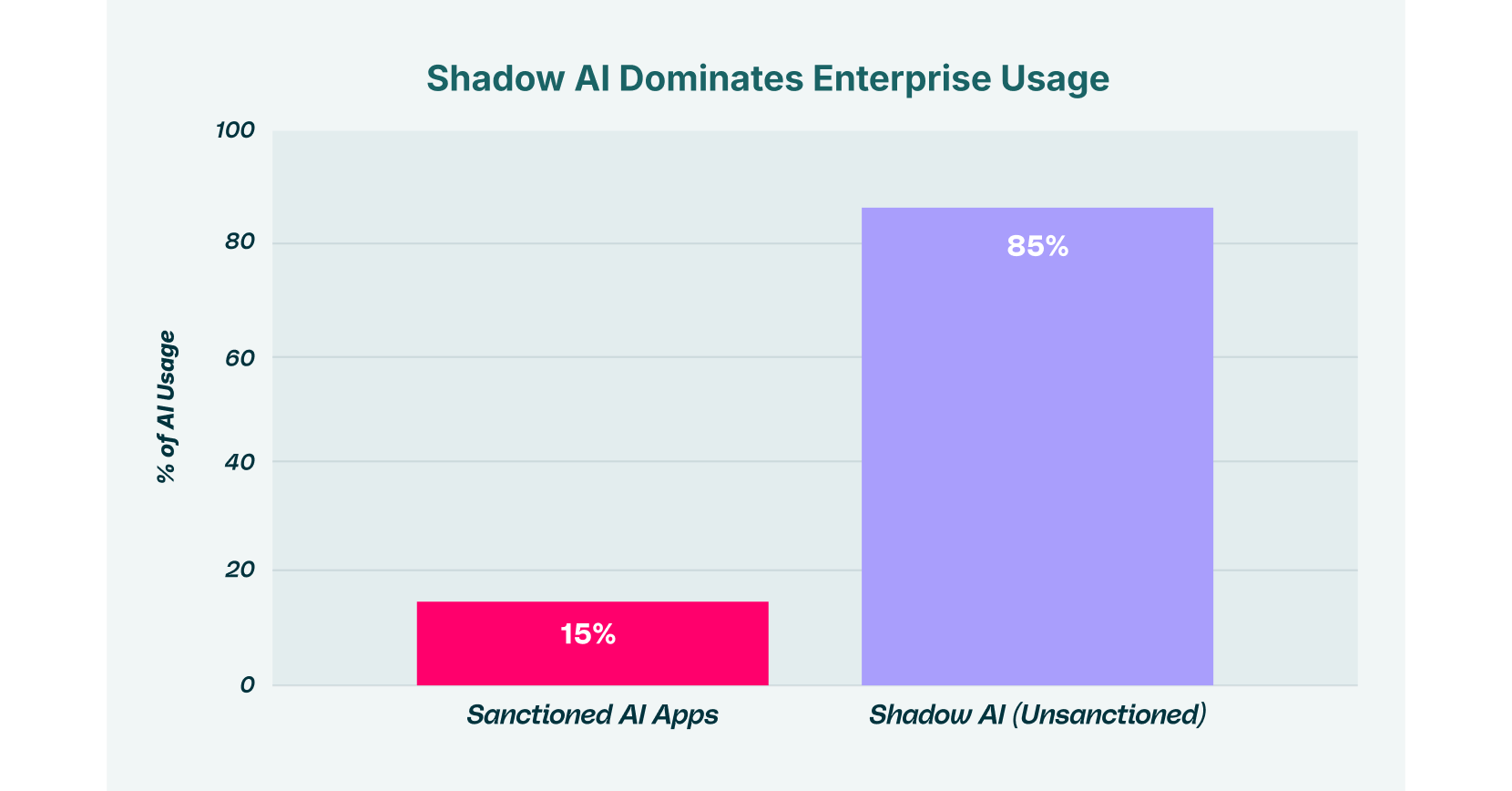

Ciemne IT zawsze było zmorą CISO. Ciemna sztuczna inteligencja to prawdziwa migrena. Pracownicy, chcąc poprawić wydajność, często rejestrują się w nieautoryzowanych narzędziach AI, korzystając z prywatnych kont e-mail. Te „ekosystemy Shadow SaaS” omijają korporacyjne systemy jednokrotnego logowania (SSO) i dostawców tożsamości, pozostawiając organizację bez śladu audytu i kontroli nad tym, gdzie znajdują się jej dane.

Skuteczne monitorowanie zarządzania sztuczną inteligencją musi zaczynać się od wykrywania. Nie da się zarządzać czymś, czego nie widać. Rozszerzenie przeglądarki LayerX automatycznie kataloguje każdą aplikację AI, do której pracownicy uzyskują dostęp. Rozróżnia konta firmowe od kont osobistych, sygnalizując przypadki, w których pracownik może korzystać z osobistego konta ChatGPT do przetwarzania danych firmowych.

Ten poziom wglądu jest kluczowy. Przekształca on narzędzia do monitorowania AI z pasywnych mechanizmów raportowania w aktywne mechanizmy zarządzania. Zamiast dowiadywać się o wycieku danych miesiące później, zespoły ds. bezpieczeństwa mogą obserwować rozwój ukrytej sztucznej inteligencji w czasie rzeczywistym i podejmować natychmiastowe działania w celu zablokowania lub nałożenia sankcji na konkretne narzędzia.

Narzędzia do monitorowania AI: od biernej obserwacji do aktywnej obrony

Rynek jest zalewany narzędziami do monitorowania AI, które obiecują widoczność, ale dostarczają jedynie szumu informacyjnego. Prawdziwe bezpieczeństwo wymaga kontekstu. Nie wystarczy wiedzieć, że użytkownik odwiedził stronę AI; trzeba wiedzieć, co tam robił.

LayerX wprowadza funkcję „Full Conversation Tracking”, która rejestruje pełny kontekst interakcji GenAI. Obejmuje to monit użytkownika, odpowiedź AI oraz wszelkie pliki przesłane do analizy. Dane te są niezbędne do dochodzeń kryminalistycznych i audytów zgodności. W przypadku incydentu zespół ds. bezpieczeństwa może zrekonstruować całą sesję, aby dokładnie określić, jakie informacje zostały ujawnione.

Rozważmy hipotetyczny scenariusz. Programista pracuje pod presją czasu. Aby przyspieszyć proces, kopiuje blok kodu źródłowego zawierający zakodowane na stałe klucze API i wkleja go do chatbota GenAI w celu optymalizacji.

- Bez LayerX: Ruch jest szyfrowany. Rozwiązanie DLP nic nie widzi. Kod wycieka.

- Z LayerX: Rozszerzenie przeglądarki analizuje zawartość schowka w czasie rzeczywistym. Rozpoznaje wzorzec klucza API i miejsce docelowe jako narzędzie AI. Akcja jest natychmiast blokowana, a użytkownik otrzymuje wyskakujące okienko z poradami wyjaśniającymi naruszenie zasad.

Na tym polega różnica między rejestrowaniem katastrofy a zapobieganiem jej.

Zapobieganie eksfiltracji danych w erze GenAI

Eksfiltracja wspomagana przez GenAI to wyrafinowane zagrożenie. Nie zawsze wygląda na złośliwy atak. Często jest to zagrożenie wewnętrzne, wynikające z zaniedbania. Pracownicy nie mają zamiaru ujawniać danych; po prostu chcą wykonać swoją pracę. Jednak rezultat jest ten sam: poufne dane osobowe, własność intelektualna i dane finansowe trafiają do modeli szkoleniowych publicznych dostawców sztucznej inteligencji.

Aby temu przeciwdziałać, organizacje muszą wdrożyć monitoring bezpieczeństwa AI, który koncentruje się na przepływie danych. LayerX wdraża zabezpieczenia przed „powierzchnią ataku przeglądarki do chmury”. Monitorując kluczowe zdarzenia, kopiowanie, wklejanie, pisanie i przesyłanie plików, rozszerzenie może interweniować dokładnie w momencie wystąpienia zagrożenia.

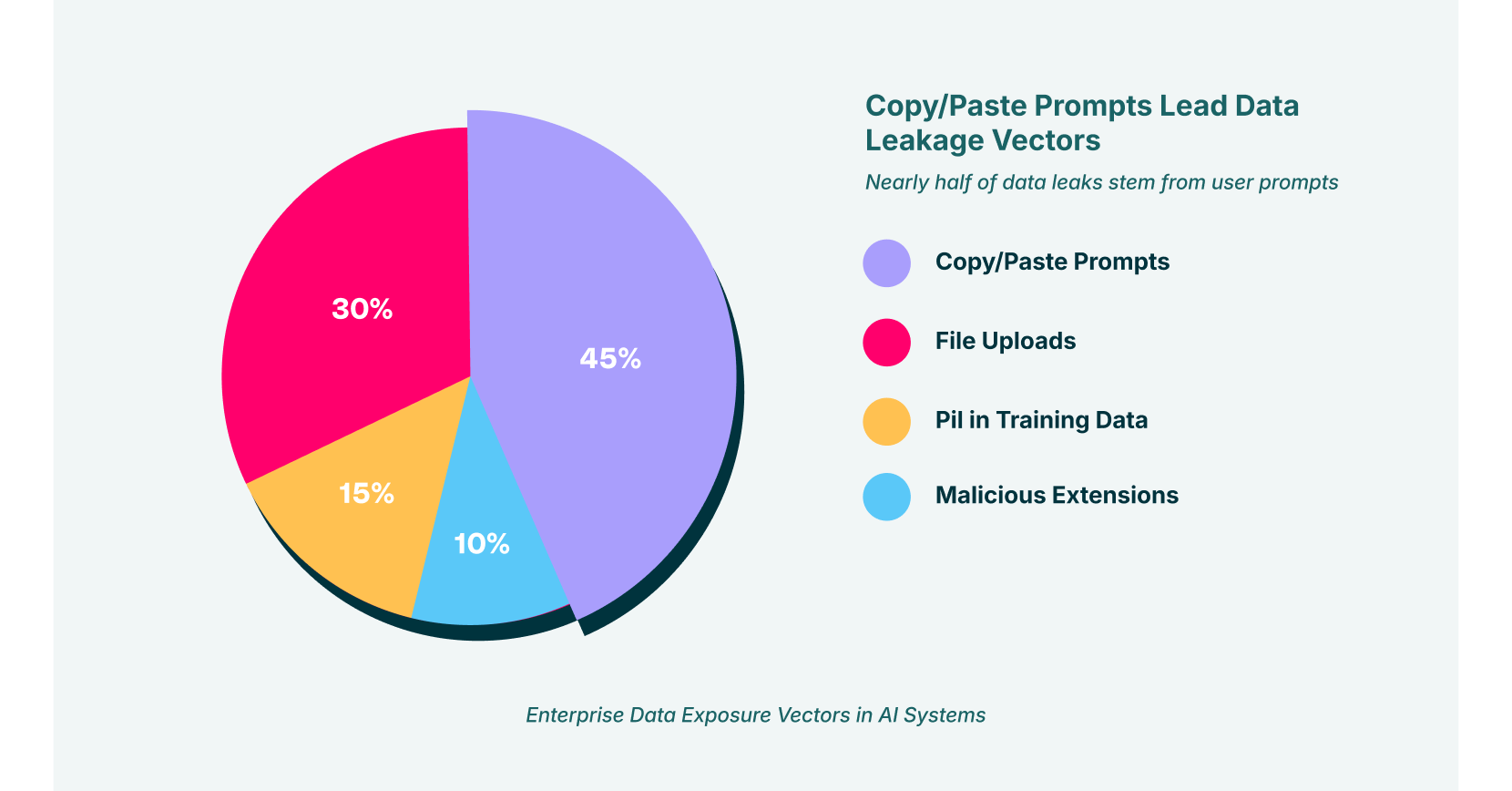

Analiza wektorów wycieku

Dane same w sobie nie wyciekają. Przepływają przez określone wektory. Zrozumienie tych wektorów to pierwszy krok do ich zamknięcia.

Wdrażanie polityk opartych na ryzyku

Podejście „blokuj wszystko” jest nie do utrzymania. Hamuje innowacyjność i zachęca pracowników do szukania niebezpiecznych obejść. Kompleksowa strategia monitorowania sztucznej inteligencji musi być adaptacyjna.

LayerX umożliwia tworzenie szczegółowych zasad. Możesz zezwolić zespołowi marketingowemu na korzystanie z GenAI do generowania treści, ale zablokować mu możliwość przesyłania list klientów. Możesz zezwolić zespołowi inżynierów na korzystanie z określonych, licencjonowanych dla przedsiębiorstw asystentów kodowania AI, ale zablokować im dostęp do publicznych, bezpłatnych modeli.

To adaptacyjne podejście gwarantuje, że bezpieczeństwo wspiera realizację celów biznesowych, a nie je utrudnia. Jest ono zgodne z filozofią „izolacji przeglądarki bez zaufania”: nie ufaj żadnej interakcji bezwarunkowo, weryfikuj każdy transfer danych i dynamicznie wymuszaj dostęp z minimalnymi uprawnieniami.

Integracja sztucznej inteligencji w celu zapewnienia bezpieczeństwa i monitorowania sieci

Choć przeglądarka stanowi nową granicę, musi współistnieć z istniejącą infrastrukturą. Sztuczna inteligencja do monitorowania i bezpieczeństwa sieci ewoluuje, aby pobierać dane telemetryczne z przeglądarki. LayerX integruje się z platformami SIEM i SOAR, dostarczając im dane o wysokiej dokładności, których nie dostrzegają czujniki sieciowe.

Ta integracja tworzy ujednoliconą postawę bezpieczeństwa. Rozszerzenie przeglądarki obsługuje „ostatnią milę” interakcji użytkownika, podczas gdy narzędzia sieciowe monitorują anomalie w natężeniu ruchu lub wzorcach połączeń. Razem tworzą wielowarstwową obronę, która jest znacznie skuteczniejsza niż każdy z tych komponentów osobno.

Na przykład, jeśli LayerX wykryje, że użytkownik wielokrotnie próbuje ominąć mechanizmy DLP, aby przesłać pliki do witryny Shadow AI, może to wywołać alert o wysokim stopniu zagrożenia w centrum operacyjnym (SOC). Alert ten jest bogaty w kontekst, zawiera tożsamość użytkownika, nazwę aplikacji, typ pliku i konkretną zawartość danych, co pozwala analitykom na precyzyjną reakcję.

Jakie są dalsze plany dotyczące wykrywania i reagowania przeglądarek?

Era bezgranicznego zaufania do przeglądarki dobiegła końca. Wraz z głębokim zakorzenieniem się GenAI w procesach pracy przedsiębiorstw, przeglądarka stała się najważniejszym punktem kontrolnym w architekturze bezpieczeństwa. Wdrożenie solidnego monitoringu bezpieczeństwa AI to jedyny sposób na bezpieczne poruszanie się w tym środowisku.

LayerX zapewnia narzędzia niezbędne do wdrożenia tej strategii. Łącząc dogłębną widoczność, zarządzanie w czasie rzeczywistym i adaptacyjne egzekwowanie, umożliwia organizacjom bezproblemowe wdrażanie GenAI. Przekształca przeglądarkę z obciążenia w bezpieczne, zarządzane miejsce pracy.

Ostatecznie skuteczne bezpieczeństwo opiera się na widoczności. Dzięki monitorowaniu zarządzania sztuczną inteligencją opartemu na technologii LayerX możesz dostrzec cień, zatrzymać wyciek i zabezpieczyć przyszłość pracy.