Generatywna sztuczna inteligencja fundamentalnie zmieniła sposób działania organizacji. Zespoły w każdym dziale wdrażają narzędzia, które obiecują przyspieszenie kodowania, tworzenia treści i analizy danych. To szybkie wdrażanie często odbywa się bez formalnego nadzoru. Pracownicy nie czekają na pozwolenie. Rejestrują się w usługach, używając danych osobowych i wklejają poufne dane firmowe do modeli publicznych. To tworzy ogromny, niemonitorowany ekosystem „ukrytej sztucznej inteligencji”, której tradycyjne zapory sieciowe nie widzą ani nie kontrolują.

Liderzy bezpieczeństwa stoją przed trudnym wyzwaniem. Całkowite blokowanie sztucznej inteligencji (AI) jest często niepraktyczne i hamuje innowacje. Zezwolenie na nieograniczony dostęp prowadzi do wycieku danych i naruszeń przepisów. Rozwiązaniem jest dobrze ustrukturyzowana polityka przedsiębiorstwa w zakresie AI. Niniejszy dokument stanowi fundament strategii zarządzania. Definiuje on zasady zaangażowania. Wyznacza jasne granice dotyczące udostępniania danych i dozwolonych narzędzi. Bez tych ram Twoja organizacja pozostaje narażona na wyciek danych, kary regulacyjne i kradzież własności intelektualnej.

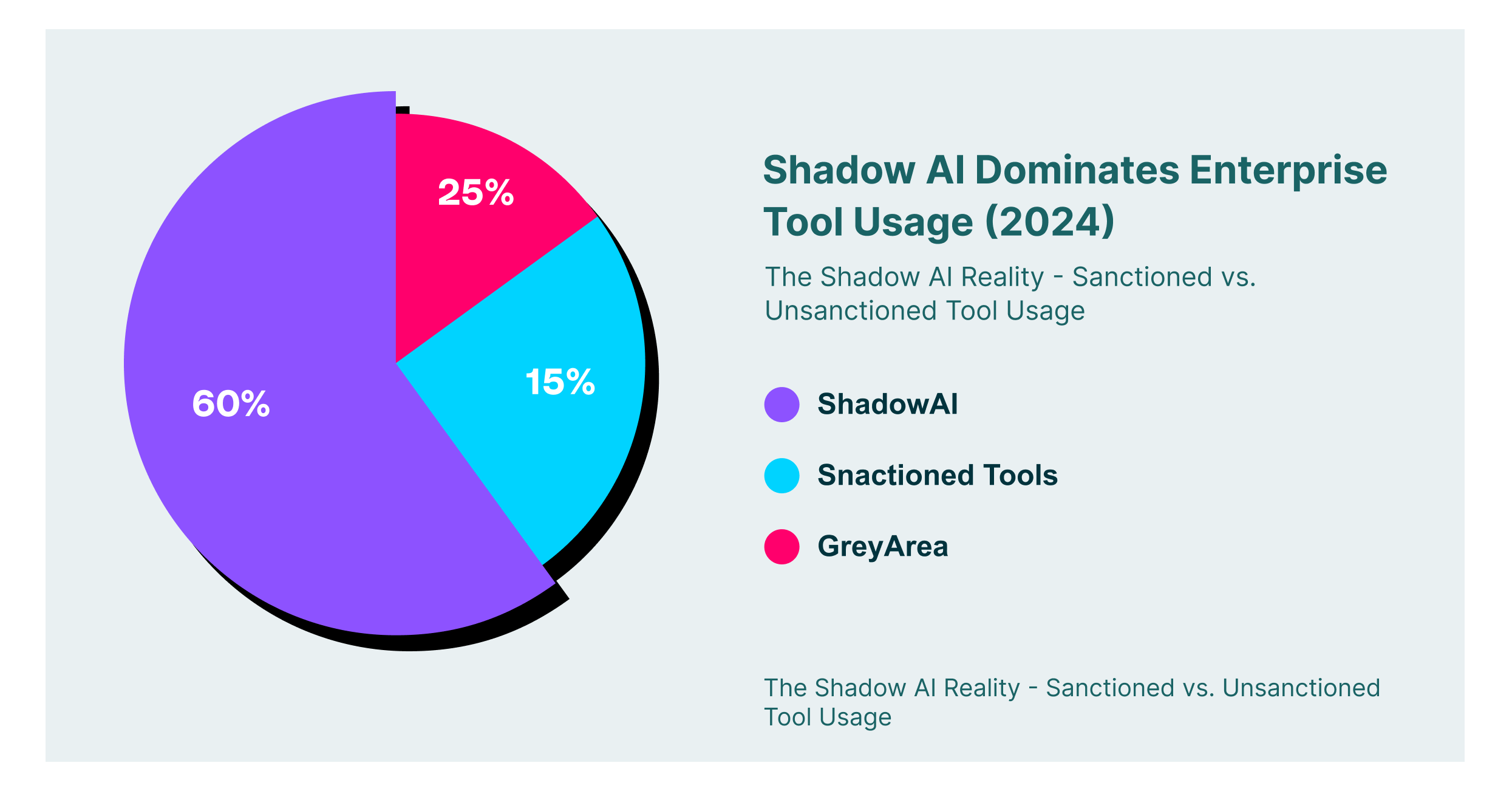

Skala problemu sztucznej inteligencji w cieniu

Rozbieżność między tym, co zatwierdzają zespoły IT, a tym, z czego faktycznie korzystają pracownicy, rośnie. Większość organizacji uważa, że ma kontrolę nad swoim zasobem oprogramowania. Rzeczywistość jest często zupełnie inna. Rozszerzenia przeglądarkowe i aplikacje internetowe omijają kontrolę granic sieci. Dzięki temu dane mogą przepływać bezpośrednio z ekranu użytkownika do serwerów zewnętrznych.

Rzeczywistość sztucznej inteligencji Shadow: sankcjonowane i niesankcjonowane użycie narzędzi

Zespoły ds. bezpieczeństwa muszą zdać sobie sprawę, że „Shadow AI” to nie tylko uciążliwość. To krytyczna luka w zabezpieczeniach. Niezatwierdzone narzędzia często nie posiadają zabezpieczeń klasy korporacyjnej. Mogą rościć sobie prawa do wykorzystywania danych do trenowania modeli. Kompleksowa polityka bezpieczeństwa AI to pierwszy krok do odzyskania widoczności i kontroli nad tym zdecentralizowanym środowiskiem.

Podstawowe filary szablonu polityki bezpieczeństwa AI

Tworzenie polityki od podstaw może być zniechęcające. Warto spojrzeć na dokument jako na zestaw modułowych komponentów. Każdy moduł dotyczy konkretnego aspektu interakcji użytkownika ze sztuczną inteligencją. Solidny szablon polityki bezpieczeństwa AI nie powinien być statyczną listą zakazów. Musi to być dynamiczna struktura, która dostosowuje się do nowych narzędzi i zagrożeń. Musi w równym stopniu obejmować bezpieczeństwo tożsamości, danych i aplikacji.

Pierwszym filarem jest klasyfikacja danych. Nie można chronić czegoś, czego się nie definiuje. Polityka musi wyraźnie określać, które kategorie danych są dozwolone do wykorzystania przez sztuczną inteligencję. Publiczne materiały marketingowe mogą być bezpieczne. Dane osobowe klientów i niepublikowany kod źródłowy zdecydowanie nie. Polityka nie może pozostawiać miejsca na niejasności w tym zakresie. Użytkownicy muszą dokładnie wiedzieć, gdzie przebiega granica, zanim otworzą okno dialogowe.

Zarządzanie tożsamością i dostępem

Drugi filar koncentruje się na tym, kto korzysta z narzędzi. Anonimowość jest wrogiem bezpieczeństwa. Szablon polityki bezpieczeństwa AI powinien nakazywać korzystanie z tożsamości korporacyjnych do wszystkich zadań związanych z AI w firmie. Korzystanie z prywatnych kont e-mail w celach służbowych powinno być surowo zabronione. Gwarantuje to, że po odejściu pracownika z firmy, jego dostęp do danych i historii interakcji pozostanie w organizacji. Umożliwia również integrację z funkcją jednokrotnego logowania (SSO). SSO zapewnia scentralizowany wyłącznik awaryjny w przypadku naruszenia bezpieczeństwa konta.

Weryfikacja i zatwierdzanie wniosków

Trzeci filar dotyczy samych narzędzi. Nie wszystkie aplikacje AI są sobie równe. Niektóre spełniają rygorystyczne standardy bezpieczeństwa korporacyjnego. Inne to nic więcej niż operacje zbierania danych opakowane w elegancki interfejs. Polityka musi ustanowić proces weryfikacji. Proces ten powinien oceniać praktyki dostawcy w zakresie przetwarzania danych. Powinien on sprawdzać, czy wykorzystuje on dane klientów do szkoleń. Powinien również weryfikować ich zgodność z normami takimi jak SOC 2 lub ISO 27001. Tylko narzędzia, które pomyślnie przejdą ten test, powinny otrzymać status „zatwierdzonych”.

Ustanawianie standardów akceptowalnego użytkowania sztucznej inteligencji

Sekcja dotycząca dopuszczalnego użytkowania sztucznej inteligencji (AI) przekłada zasady wysokiego poziomu na codzienne działania. To ta część polityki, z którą pracownicy będą się najczęściej zapoznawać. Musi być jasna, zwięzła i pozbawiona żargonu prawniczego. Powinna koncentrować się na zachowaniu. Powinna opisywać konkretne scenariusze, z którymi użytkownicy spotykają się w codziennych procesach pracy.

Na przykład programiści często używają sztucznej inteligencji do debugowania kodu. Polityka dopuszczalnego użytkowania sztucznej inteligencji może zezwalać na wklejanie fragmentów ogólnej logiki. Surowo zabrania wklejania zastrzeżonych algorytmów lub zakodowanych na stałe kluczy API. Zespoły marketingowe mogą wykorzystywać sztuczną inteligencję do tworzenia wiadomości e-mail. Polityka zezwala na to, ale wymaga ludzkiej weryfikacji ostatecznego wyniku w celu sprawdzenia poprawności i tonu. Te praktyczne przykłady pomagają pracownikom zrozumieć, jak stosować zasady w ich konkretnym kontekście.

Protokół „Sygnalizacji Świetlnej”

Aby uprościć proces podejmowania decyzji, wiele organizacji stosuje system sygnalizacji świetlnej w ramach wytycznych dotyczących dopuszczalnego użytkowania sztucznej inteligencji.

- Zielony (zatwierdzony): Te narzędzia posiadają licencje korporacyjne. Podpisane są umowy o ochronie danych. Pracownicy mogą z nich swobodnie korzystać w przypadku większości typów danych, z wyłączeniem informacji ściśle tajnych.

- Żółty (Tolerowany): Są to publiczne narzędzia, które są przydatne, ale nie posiadają mechanizmów kontroli korporacyjnej. Dozwolone jest ich używanie wyłącznie do zadań niebędących zadaniami wrażliwymi. Logowanie nie jest wymagane. Nie można wprowadzać danych wewnętrznych.

- Czerwony (zablokowany): Te narzędzia stwarzają niedopuszczalne ryzyko. Mogą mieć historię naruszeń bezpieczeństwa lub agresywnych zasad scrapowania danych. Dostęp jest technicznie blokowany na poziomie przeglądarki lub sieci.

Nawigowanie po zagrożeniach związanych z polityką bezpieczeństwa sztucznej inteligencji generatywnej

GenAI wprowadza unikalne zagrożenia, których nie obejmują tradycyjne polityki oprogramowania. Interaktywny charakter dużych modeli językowych (LLM) tworzy nowe wektory ataków. Specjalistyczna polityka bezpieczeństwa generatywnej sztucznej inteligencji musi uwzględniać te specyficzne zagrożenia. Nie wystarczy zabezpieczyć dostęp; należy zabezpieczyć samą interakcję.

Jednym z głównych problemów jest szybkie wstrzyknięcie kodu. Dzieje się tak, gdy złośliwe instrukcje są ukryte w bloku tekstu. Jeśli pracownik wklei ten tekst do modelu LLM, model może zostać oszukany i zignorować swoje zabezpieczenia. Polityka powinna ostrzegać użytkowników przed wklejaniem niezaufanych treści z internetu bezpośrednio do wewnętrznych narzędzi sztucznej inteligencji. Tekst zewnętrzny powinien być traktowany z taką samą podejrzliwością, jak załącznik do wiadomości e-mail od nieznanego nadawcy.

Zarządzanie halucynacjami i integralnością wyników

Kolejnym kluczowym aspektem generatywnej polityki bezpieczeństwa AI jest walidacja wyników. Modele AI są probabilistyczne, a nie deterministyczne. Mogą one z przekonaniem przedstawiać fałszywe informacje jako fakty. Zjawisko to znane jest jako halucynacja. Wykorzystywanie niezweryfikowanych wyników AI w kluczowych decyzjach biznesowych może prowadzić do strat finansowych i utraty reputacji. Polityka musi nakazywać „udział człowieka w pętli” dla wszystkich wyników o wysokiej wartości. Kod generowany przez AI musi zostać zweryfikowany przez starszego inżyniera. Dokumenty prawne sporządzone przez AI muszą zostać zweryfikowane przez radcę prawnego.

Typowe naruszenia zasad bezpieczeństwa sztucznej inteligencji w środowiskach korporacyjnych

Polityka bezpieczeństwa i ramy zarządzania sztuczną inteligencją

Doraźne zasady to dobry punkt wyjścia, ale długoterminowa odporność wymaga ustrukturyzowanego podejścia. Dostosowanie do międzynarodowych standardów przekształca politykę bezpieczeństwa sztucznej inteligencji z zestawu zasad w system zarządzania. Stanowi to dowód należytej staranności wobec organów regulacyjnych, klientów i członków zarządu. Przenosi to uwagę z reaktywnego gaszenia pożarów na proaktywne zarządzanie ryzykiem.

Obecnie w branży kształtują się dwa główne standardy: ISO 42001 oraz Ramy Zarządzania Ryzykiem AI (RMF) NIST. Zastosowanie elementów tych norm gwarantuje, że polityka bezpieczeństwa i strategia zarządzania AI są kompleksowe i możliwe do obrony. Zapewniają one wspólny język do dyskusji na temat ryzyka związanego z AI w całej organizacji.

Wdrażanie ISO 42001

ISO 42001 to globalny standard dla systemów zarządzania sztuczną inteligencją (AI). Jest on zgodny ze znanym cyklem Plan-Do-Check-Act, znanym z innych norm ISO. W przypadku polityki bezpieczeństwa AI i programu zarządzania nią, najbardziej istotne są często klauzule dotyczące przywództwa i eksploatacji.

- Przywództwo: Ta klauzula nakłada na kadrę zarządzającą obowiązek wzięcia odpowiedzialności za skuteczność systemu zarządzania sztuczną inteligencją. Zapewnia dostępność zasobów i zgodność polityki ze strategicznymi celami biznesowymi.

- Działanie: Ta klauzula koncentruje się na ocenie i postępowaniu z ryzykiem związanym ze sztuczną inteligencją. Nakazuje ona organizacjom identyfikację potencjalnych niezamierzonych konsekwencji systemów sztucznej inteligencji i wdrożenie mechanizmów kontroli w celu ich ograniczenia.

Zastosowanie NIST AI RMF

NIST AI RMF to dobrowolny system, który cieszy się dużym uznaniem w amerykańskim sektorze publicznym i prywatnym. Opiera się na czterech podstawowych funkcjach: zarządzaniu, mapowaniu, pomiarach i zarządzaniu.

- Zarządzanie: Ta funkcja promuje kulturę zarządzania ryzykiem. Obejmuje ona ustanawianie polityk i procedur, które kierują rozwojem i użytkowaniem sztucznej inteligencji.

- Mapa: Ta funkcja ustala kontekst. Identyfikuje konkretne używane systemy sztucznej inteligencji i potencjalne zagrożenia z nimi związane.

- Miara: Ta funkcja wykorzystuje metody ilościowe i jakościowe do analizy ryzyka. Odpowiada na pytanie: „Jak duże ryzyko faktycznie ponosimy?”

- Zarządzanie: Ta funkcja priorytetyzuje i eliminuje ryzyko. Obejmuje ona wdrożenie konkretnych mechanizmów kontroli, takich jak sama polityka akceptowalnego użytkowania sztucznej inteligencji (AI), w celu obniżenia ryzyka do akceptowalnego poziomu.

Rola zabezpieczeń przeglądarek w egzekwowaniu przepisów

Opracowanie polityki AI w przedsiębiorstwie to tylko połowa sukcesu. Jej egzekwowanie to druga połowa. Tradycyjne narzędzia bezpieczeństwa sieci mają problemy z wykorzystaniem nowoczesnej AI. Mogą zablokować domenę, ale nie widzą, co dzieje się w sesji. Nie potrafią odróżnić użytkownika proszącego ChatGPT o przepis na ciasteczka od użytkownika wklejającego bazę danych klientów. Ten brak szczegółowości prowadzi do nadmiernego blokowania lub niebezpiecznych martwych punktów.

Przeglądarka to nowa granica. To interfejs, za pośrednictwem którego odbywa się niemal cała współczesna praca. Aby skutecznie egzekwować politykę bezpieczeństwa AI, potrzebne są elementy sterujące zlokalizowane w samej przeglądarce. Umożliwia to analizę działań użytkownika w czasie rzeczywistym. Umożliwia to podejmowanie decyzji uwzględniających kontekst, które równoważą bezpieczeństwo z produktywnością. Zamiast binarnego „blokuj lub zezwól”, zabezpieczenia przeglądarki mogą oferować niuanse, takie jak „zezwól tylko na odczyt” lub „zezwól, ale usuń poufne dane”.

Automatyzacja zasad za pomocą LayerX

LayerX zapewnia możliwości techniczne, które pozwalają na urzeczywistnienie polityki bezpieczeństwa AI. Działa jako rozszerzenie przeglądarki korporacyjnej. Ta unikalna pozycja pozwala monitorować i kontrolować interakcje użytkowników z dowolną aplikacją internetową, w tym z zatwierdzonymi i niezatwierdzonymi narzędziami AI. LayerX pełni funkcję elementu egzekwowania strategii zarządzania.

Jedną z kluczowych możliwości LayerX jest odkrycie „Shadow AI”. Automatycznie kataloguje każdą witrynę AI, do której uzyskują dostęp Twoi pracownicy. Zapewnia kompleksowy inwentarz, który pozwala dokładnie zobaczyć, które narzędzia są używane. Ta widoczność jest niezbędna do aktualizacji szablonu polityki bezpieczeństwa AI i utrzymania go w odpowiednim stanie. Nie da się zarządzać czymś, o czym się nie wie. LayerX oświetla ciemne zakamarki ekosystemu SaaS.

DLP w czasie rzeczywistym i edukacja

LayerX wykracza poza proste wykrywanie. Oferuje aktywne funkcje zapobiegania utracie danych (DLP) dostosowane do potrzeb GenAI. Gdy użytkownik próbuje wkleić dane naruszające politykę dozwolonego użytku AI, LayerX interweniuje. Może całkowicie zablokować wklejanie. Może również selektywnie redagować poufne ciągi znaków, takie jak numery kart kredytowych lub dane osobowe, jednocześnie zezwalając na kontynuację monitu. Pozwala to pracownikom na bezpieczne korzystanie z narzędzia bez narażania organizacji na ryzyko. Co więcej, LayerX może wyświetlić niestandardowe okno dialogowe wyjaśniające naruszenie. Dzięki temu każda zablokowana czynność staje się mikro-momentem szkoleniowym, wzmacniając politykę bezpieczeństwa AI w czasie rzeczywistym.

Lista kontrolna wdrażania polityki bezpieczeństwa AI

Skorzystaj z poniższej listy kontrolnej, aby upewnić się, że Twoja polisa obejmuje wszystkie kluczowe obszary. Ta tabela przyporządkowuje poszczególne elementy polisy do technicznych mechanizmów kontroli wymaganych do ich egzekwowania.

| Komponent polityki | Kluczowe wymaganie | Możliwość egzekwowania LayerX |

| Inwentarz narzędzi | Prowadź aktualną listę narzędzi zatwierdzonych i zablokowanych. | Odkrywanie w czasie rzeczywistym aplikacji Shadow SaaS i AI w całym przedsiębiorstwie. |

| Ochrona danych DLP | Zdefiniuj konkretne typy danych, których nie wolno wprowadzać do systemu sztucznej inteligencji. | Zapobiegaj wklejaniu lub przesyłaniu zdefiniowanych poufnych typów danych |

| Zarządzanie tożsamością | Wprowadź obowiązkowe korporacyjne logowanie jednokrotne (SSO) dla wszystkich kont AI. | Wykrywaj i blokuj używanie prywatnych kont e-mail w aplikacjach biznesowych. |

| Kontrola rozszerzenia | Sprawdź wszystkie wtyczki przeglądarek uzyskujące dostęp do danych AI. | Ocena ryzyka i blokowanie złośliwych lub ryzykownych rozszerzeń. |

| Ścieżka audytu | Rejestruj wszystkie monity i interakcje ze sztuczną inteligencją w celu zapewnienia zgodności. | Szczegółowe rejestry kryminalistyczne interakcji użytkownika ze sztuczną inteligencją na potrzeby audytu |

| Dostęp oparty na rolach | Określ, kto może korzystać z poszczególnych narzędzi i w jaki sposób. | Egzekwuj zasady dostępu w oparciu o grupy użytkowników i usługę Active Directory. |

Z niecierpliwością czekamy na wdrożenie sztucznej inteligencji w zabezpieczeniach przedsiębiorstw

Wdrożenie generatywnej sztucznej inteligencji (AI) nie jest trendem, który przeminie. To fundamentalna zmiana w sposobie prowadzenia działalności. Polityka przedsiębiorstwa w zakresie AI to mechanizm, który pozwala organizacji bezpiecznie poruszać się po tej zmianie. Nie chodzi o tworzenie przeszkód. Chodzi o budowanie zabezpieczeń. Definiując jasne wytyczne dotyczące dopuszczalnego użytkowania AI i wspierając je silnymi mechanizmami kontroli technicznej, dajesz swoim pracownikom możliwość innowacji.

Bezpieczeństwo w erze sztucznej inteligencji (AI) wymaga połączenia jasnego zarządzania i aktywnego egzekwowania. Statyczny szablon polityki bezpieczeństwa AI to dobry punkt wyjścia, ale musi zostać wdrożony. LayerX zapewnia widoczność i kontrolę na poziomie przeglądarki, niezbędne do skuteczności polityki. Wypełnia lukę między dokumentem a użytkownikiem. Gwarantuje, że polityka bezpieczeństwa AI i działania w zakresie zarządzania nią przynoszą realne korzyści w postaci redukcji ryzyka. Zacznij od przejrzystości, zdefiniuj reguły i egzekwuj je na brzegu sieci. To droga do bezpiecznego wdrożenia AI.