Integracja generatywnej sztucznej inteligencji (ML) z procesami pracy w przedsiębiorstwach przyniosła niespotykany dotąd poziom produktywności. Od tworzenia wiadomości e-mail po analizę złożonych zestawów danych, narzędzia te zmieniają sposób działania firm. Jednak ta wydajność ma swoją cenę, wprowadzając nowe i złożone wyzwania w zakresie bezpieczeństwa. Dla dyrektorów ds. bezpieczeństwa informacji (CISO) i liderów IT kluczowy konflikt jest jasny: jak umożliwić pracownikom korzystanie z tych potężnych narzędzi bez narażania organizacji na katastrofalny wyciek danych? To rodzi poważne obawy dotyczące prywatności danych w sztucznej inteligencji, których nie można ignorować. Sama natura dużych modeli językowych (LLM), które przetwarzają i uczą się na podstawie danych wprowadzanych przez użytkowników, tworzy bezpośredni kanał do wycieku poufnych danych firmowych, często bez złych intencji ze strony pracownika.

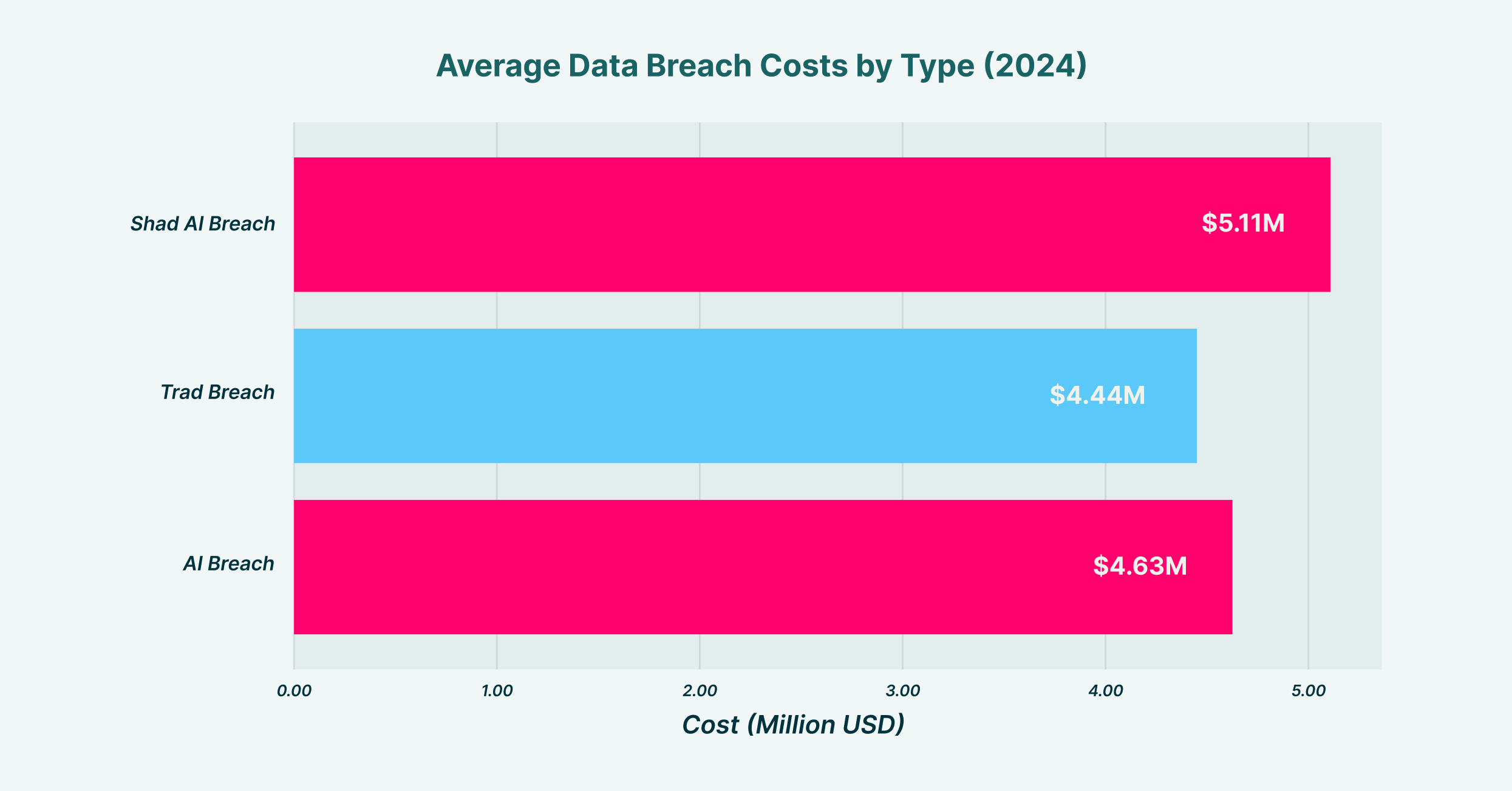

Średnie koszty naruszeń danych pokazują, że incydenty związane ze sztuczną inteligencją kosztują znacznie więcej niż tradycyjne naruszenia

Zrozumienie powiązań między sztuczną inteligencją a prywatnością danych nie jest już opcjonalne; stanowi kluczowy element nowoczesnej strategii cyberbezpieczeństwa. Łatwość, z jaką pracownicy mogą kopiować i wklejać zastrzeżony kod, dane osobowe klientów lub wewnętrzne dane finansowe na publiczną platformę GenAI, stanowi istotną lukę w zabezpieczeniach. W tym artykule omówiono konkretne zagrożenia związane z prywatnością danych generowane przez sztuczną inteligencję, przeanalizowano pilne luki w zgodności z przepisami takimi jak RODO, HIPAA i CCPA, a także przedstawiono praktyczne strategie zabezpieczenia organizacji w dobie sztucznej inteligencji.

Mechanika ujawniania danych w generatywnej sztucznej inteligencji

Aby w pełni zrozumieć zakres zagrożeń związanych z prywatnością danych w sztucznej inteligencji (AI), kluczowe jest zrozumienie, jak te modele przetwarzają informacje. Problem nie dotyczy jedynie jednorazowego wprowadzenia danych, ale cyklu życia tych danych po opuszczeniu kontrolowanego środowiska. Gdy pracownik wysyła monit zawierający poufne informacje, pojawiają się dwa podstawowe zagrożenia. Po pierwsze, dane te mogą zostać wykorzystane do trenowania przyszłych wersji modelu. Wiele publicznych narzędzi GenAI zawiera w swoich warunkach świadczenia usług klauzule, które przyznają im prawo do wykorzystywania danych wprowadzanych przez użytkownika do udoskonalania modelu. Oznacza to, że poufne strategie biznesowe lub dane klientów mogą zostać osadzone w samym modelu, potencjalnie dostępne dla innych użytkowników w przyszłych odpowiedziach.

Ten scenariusz uwypukla jedno z najpoważniejszych zagrożeń dla prywatności w kontekście gromadzenia danych AI: nieumyślne przekazanie zastrzeżonych danych do zewnętrznej puli danych wywiadowczych. Wyobraź sobie programistę wklejającego fragment zastrzeżonego kodu źródłowego do narzędzia GenAI w celu debugowania. Ten kod, po przetworzeniu, może zostać wchłonięty przez LLM. Później użytkownik z konkurencyjnej firmy, proszący o podobną funkcję, może otrzymać odpowiedź wygenerowaną z Twojego unikalnego kodu. Ta forma wycieku danych jest subtelna, trudna do śledzenia i stanowi bezpośrednie zagrożenie dla własności intelektualnej. Drugie poważne zagrożenie dotyczy samej historii zgłoszeń. Jeśli konto pracownika zostanie naruszone lub jeśli dostawca GenAI padnie ofiarą naruszenia bezpieczeństwa danych, każde wprowadzone zapytanie może zostać ujawnione. Tworzy to szczegółowy dziennik poufnych działań, od sporządzania poufnych dokumentów prawnych po analizę wewnętrznych danych o wydajności pracowników, dostępnych dla atakującego.

Głębsze spojrzenie na obawy dotyczące prywatności danych w generatywnej sztucznej inteligencji

Potencjalne ryzyko wycieku danych nie jest pojedynczym, monolitycznym zagrożeniem. Przejawia się ono na kilka sposobów, z których każdy stanowi unikalne wyzwanie dla zespołów ds. bezpieczeństwa. Najpilniejszym problemem związanym z prywatnością danych w kontekście sztucznej inteligencji jest nieumyślne udostępnianie danych przez pracowników z dobrymi intencjami. Nie mają oni na celu wyrządzenia szkody, a jedynie zwiększenia wydajności. Analityk może użyć narzędzia GenAI do podsumowania raportu zawierającego niepubliczne informacje finansowe, a menedżer ds. marketingu może przesłać listę adresów e-mail klientów w celu opracowania ukierunkowanej kampanii. Z ich punktu widzenia po prostu korzystają z narzędzia. W rzeczywistości dokonują transferu danych wysokiego ryzyka poza strefę bezpieczeństwa organizacji.

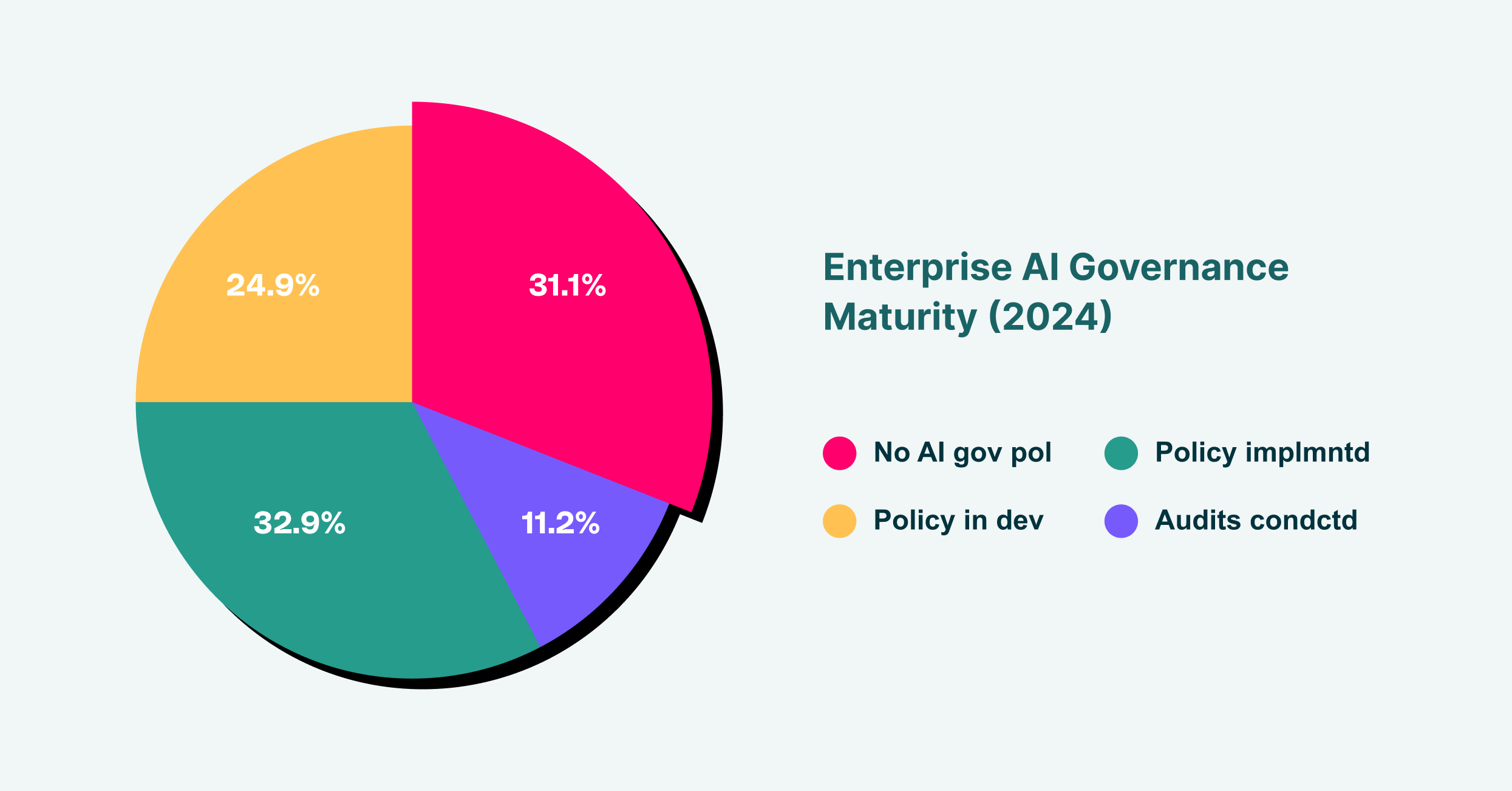

Dystrybucja dojrzałości zarządzania sztuczną inteligencją w przedsiębiorstwach, pokazująca, że większość organizacji nie ma kompleksowego nadzoru nad sztuczną inteligencją

Kolejnym istotnym problemem jest wzrost „Shadow AI” – nieautoryzowanego korzystania z aplikacji GenAI przez pracowników. Chociaż dział IT mógł zweryfikować i zatwierdzić konkretne narzędzie AI klasy korporacyjnej, pracownicy nieuchronnie zwrócą się ku innym, wygodniejszym platformom publicznym. To tworzy ogromne luki w widoczności. Zespoły ds. bezpieczeństwa nie są w stanie chronić tego, czego nie widzą, a bez kompleksowego audytu całego wykorzystania SaaS i AI w przedsiębiorstwie niemożliwe jest skuteczne egzekwowanie zasad bezpieczeństwa. Te niemonitorowane kanały stają się głównymi wektorami wycieku danych, całkowicie omijając istniejące mechanizmy zapobiegania utracie danych (DLP). Problemy z prywatnością danych AI pogłębia fakt, że tradycyjne rozwiązania bezpieczeństwa, takie jak zapory sieciowe lub CASB, często nie zapewniają wystarczającej szczegółowości, aby odróżnić legalne od nielegalnie używanych aplikacji AI w przeglądarce, gdzie te działania mają miejsce.

Splątana sieć zgodności GenAI

Poruszanie się w gąszczu przepisów jest jednym z najbardziej złożonych aspektów zarządzania wykorzystaniem GenAI. Podstawowe zasady najważniejszych przepisów o ochronie danych osobowych zostały ustanowione na długo przed powszechnym wdrożeniem studiów magisterskich (LLM), co stwarza poważne wyzwania w zakresie zgodności z przepisami GenAI. Ramy te opierają się na koncepcjach minimalizacji danych, ograniczenia celu i zgody użytkownika – zasadach, które często stoją w sprzeczności z działaniem modeli GenAI.

Rozważmy Ogólne Rozporządzenie o Ochronie Danych (RODO). Przyznaje ono obywatelom UE „prawo do bycia zapomnianym” (artykuł 17), umożliwiając im żądanie usunięcia swoich danych osobowych. W jaki sposób organizacja może spełnić to żądanie, jeśli pracownik wkleił już dane tego obywatela do zewnętrznego programu LLM? Często niemożliwe jest wyśledzenie i usunięcie konkretnego punktu danych po jego wchłonięciu do zestawu treningowego modelu. Pojedynczy komunikat może zatem narazić organizację na naruszenie RODO, ryzykując grzywny w wysokości do 4% jej globalnego rocznego obrotu. Brak przejrzystości w zakresie sposobu i miejsca przechowywania danych przez dostawców GenAI sprawia, że wykazanie zgodności jest praktycznie niemożliwe.

| Regulacja | Dane chronione | Maksymalna kara |

| RODO | Dane osobowe rezydentów UE | 20 mln euro lub 4% globalnych przychodów |

| HIPAA | Chronione informacje zdrowotne | 1.5 mln dolarów za naruszenie |

| CCPA | Dane osobowe mieszkańców Kalifornii | 2,500 dolarów na konsumenta |

Wymagania dotyczące zgodności z przepisami, pokazujące znaczące ryzyko finansowe wynikające z naruszeń prywatności danych

Podobnie, amerykańska ustawa o przenoszalności i odpowiedzialności w ubezpieczeniach zdrowotnych (HIPAA) nakłada surowe przepisy dotyczące przetwarzania chronionych informacji zdrowotnych (PHI). Jeśli pracownik służby zdrowia korzysta z publicznego narzędzia GenAI do podsumowania notatek pacjenta lub sporządzenia komunikatu, przekazuje PHI osobie trzeciej, która nie przestrzega przepisów HIPAA, co stanowi oczywiste naruszenie ustawy. Kalifornijska ustawa o ochronie prywatności konsumentów (CCPA) stwarza szereg wyzwań, wymagając od firm transparentności w zakresie gromadzonych danych i sposobu ich wykorzystywania. Nieprzejrzysty charakter wielu modeli sztucznej inteligencji utrudnia jasne ujawnianie informacji wymaganych przez prawo, co dodatkowo komplikuje sytuację w zakresie zgodności z przepisami.

Czy sztuczna inteligencja może być częścią rozwiązania?

Choć wyzwania są znaczące, warto również zwrócić uwagę na rosnącą rolę sztucznej inteligencji w ochronie prywatności danych. Może się to wydawać paradoksalne, ale narzędzia oparte na sztucznej inteligencji są również projektowane w celu identyfikacji i klasyfikacji danych wrażliwych, wykrywania nietypowych zachowań użytkowników i automatyzacji reakcji na zagrożenia. Na przykład, algorytmy uczenia maszynowego można wytrenować do rozpoznawania wzorców zgodnych z eksfiltracją danych, takich jak nagła próba przesłania przez użytkownika dużej ilości danych osobowych do usługi internetowej. Systemy te mogą generować alerty w czasie rzeczywistym, które pozwalają zespołom bezpieczeństwa interweniować, zanim dojdzie do poważnego naruszenia bezpieczeństwa.

Co więcej, sztuczna inteligencja może pomóc organizacjom w mapowaniu ich krajobrazu danych, identyfikując miejsca, w których znajdują się wrażliwe informacje w rozległych sieciach i aplikacjach chmurowych. To automatyczne wyszukiwanie i klasyfikowanie stanowi fundamentalny krok w każdej solidnej strategii ochrony danych. Wykorzystując sztuczną inteligencję do walki z zagrożeniami zaostrzanymi przez sztuczną inteligencję, organizacje mogą budować bardziej dynamiczną i responsywną politykę bezpieczeństwa. Jednak poleganie wyłącznie na tych rozwiązaniach jest niewystarczające. Ochrona musi być realizowana jak najbliżej źródła zagrożenia: przeglądarki użytkownika, gdzie faktycznie odbywa się interakcja z narzędziami GenAI.

Proaktywne podejście do bezpieczeństwa sztucznej inteligencji z LayerX

Sedno problemu leży na styku użytkownika, przeglądarki i aplikacji internetowej. To właśnie tam dochodzi do ujawnienia danych i to właśnie tam należy wdrożyć mechanizmy bezpieczeństwa. LayerX bezpośrednio odpowiada na najpilniejsze problemy związane z prywatnością danych w generatywnej sztucznej inteligencji, zapewniając szczegółowy wgląd i kontrolę nad całą aktywnością użytkownika w przeglądarce, bez konieczności instalowania dodatkowego agenta. Koncentrując się na przeglądarce jako krytycznym punkcie interakcji, LayerX potrafi skutecznie odróżniać zachowania bezpieczne od ryzykownych w dowolnej aplikacji internetowej lub SaaS, w tym na platformach GenAI.

LayerX umożliwia organizacjom mapowanie całego wykorzystania GenAI w całym przedsiębiorstwie, rzucając światło na Shadow AI i zapewniając kompleksowy wykaz narzędzi, z których korzystają użytkownicy. Na tej podstawie zespoły ds. bezpieczeństwa mogą wdrażać polityki zarządzania oparte na ryzyku. Na przykład, można skonfigurować politykę uniemożliwiającą użytkownikom wklejanie danych sklasyfikowanych jako PII lub „Poufne” do publicznego narzędzia GenAI, jednocześnie umożliwiając im korzystanie z tego narzędzia do zadań niebędących wrażliwymi. Ta szczegółowa kontrola gwarantuje, że produktywność nie jest ograniczana, a ryzyko jest aktywnie zarządzane. Jeśli użytkownik podejmie próbę wykonania czynności wysokiego ryzyka, LayerX może całkowicie zablokować tę czynność lub wyświetlić spersonalizowany komunikat ostrzegawczy, informując użytkownika o polityce korporacyjnej w czasie rzeczywistym. Takie podejście pomaga zapobiegać zarówno przypadkowemu, jak i złośliwemu wyciekowi danych u źródła, eliminując luki w zgodności pozostawione przez tradycyjne rozwiązania bezpieczeństwa i bezpośrednio łagodząc podstawowe zagrożenia dla prywatności danych AI, z którymi borykają się współczesne przedsiębiorstwa.