Integracja generatywnej sztucznej inteligencji (AI) z procesami pracy w przedsiębiorstwach nie jest propozycją odległą w czasie; dzieje się to już teraz, w tempie, które często przewyższa możliwości w zakresie bezpieczeństwa i zarządzania. Na każde udokumentowane, zatwierdzone użycie narzędzia AI zwiększającego produktywność przypadają niezliczone przypadki „ukrycia” (ang. shadow), narażające organizacje na poważne zagrożenia. Wyzwanie dla analityków bezpieczeństwa, dyrektorów ds. bezpieczeństwa informacji (CISO) i liderów IT jest jasne: jak umożliwić innowacje, jakie obiecuje AI, nie narażając się na niedopuszczalne ryzyko? Odpowiedź leży w zdyscyplinowanym, proaktywnym podejściu do zarządzania ryzykiem związanym z AI. Nie chodzi o blokowanie postępu, ale o budowanie zabezpieczeń, które pozwolą Twojej organizacji bezpiecznie przyspieszyć.

Rosnąca konieczność zarządzania sztuczną inteligencją

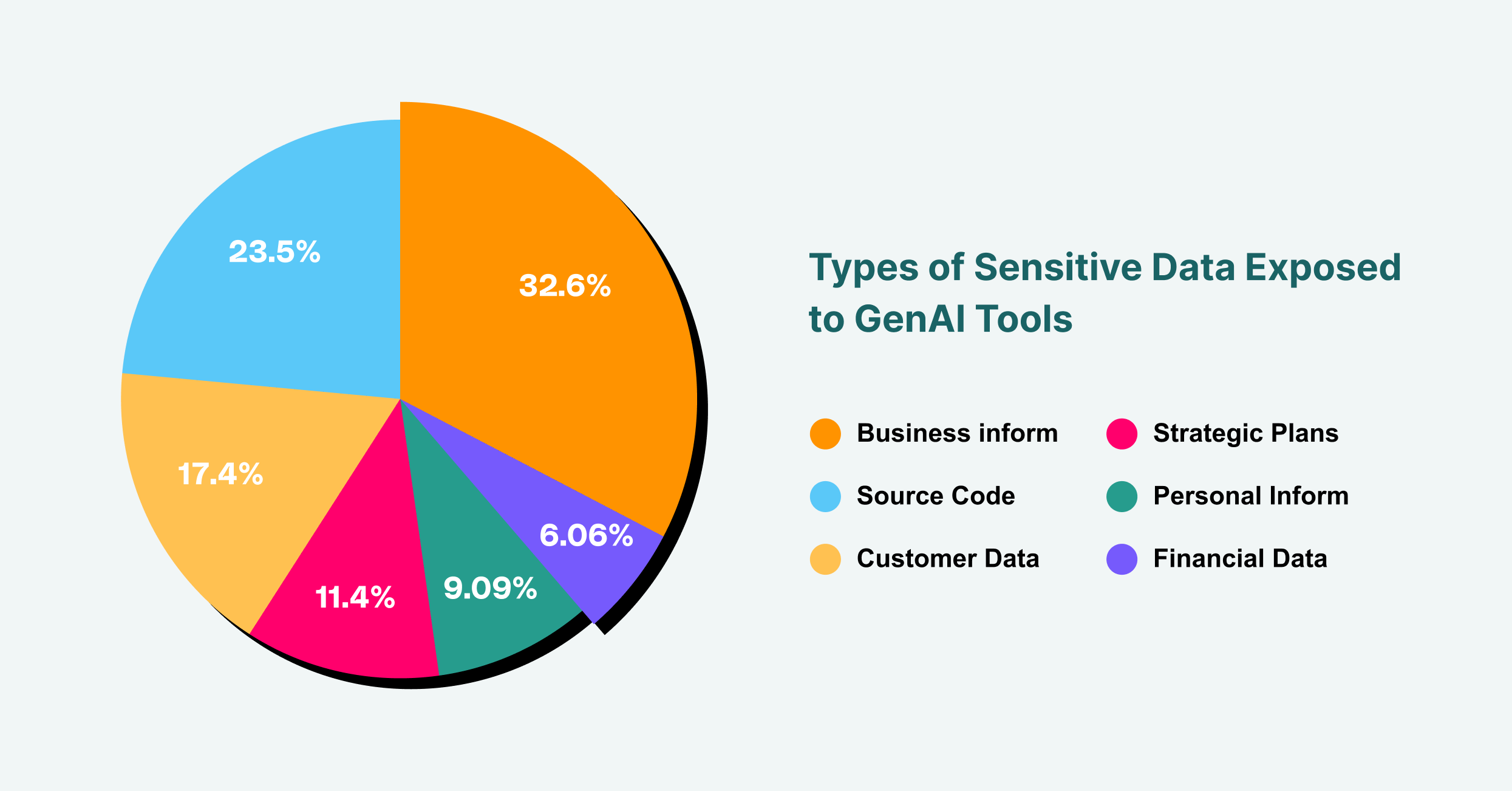

Przed wdrożeniem jakiejkolwiek skutecznej strategii zarządzania ryzykiem konieczne jest stworzenie fundamentów zarządzania sztuczną inteligencją (AI). Szybkie, zdecentralizowane wdrażanie narzędzi AI oznacza, że bez formalnej struktury zarządzania organizacje działają w ukryciu. Pracownicy, dążąc do poprawy swojej wydajności, będą samodzielnie wdrażać różne platformy i wtyczki AI, często nie zważając na konsekwencje dla bezpieczeństwa. Tworzy to złożoną sieć nieautoryzowanego korzystania z oprogramowania SaaS, w której wrażliwe dane korporacyjne – od danych osobowych i danych finansowych po własność intelektualną – mogą zostać nieumyślnie wykradzione do zewnętrznych systemów LLM (Large Language Models).

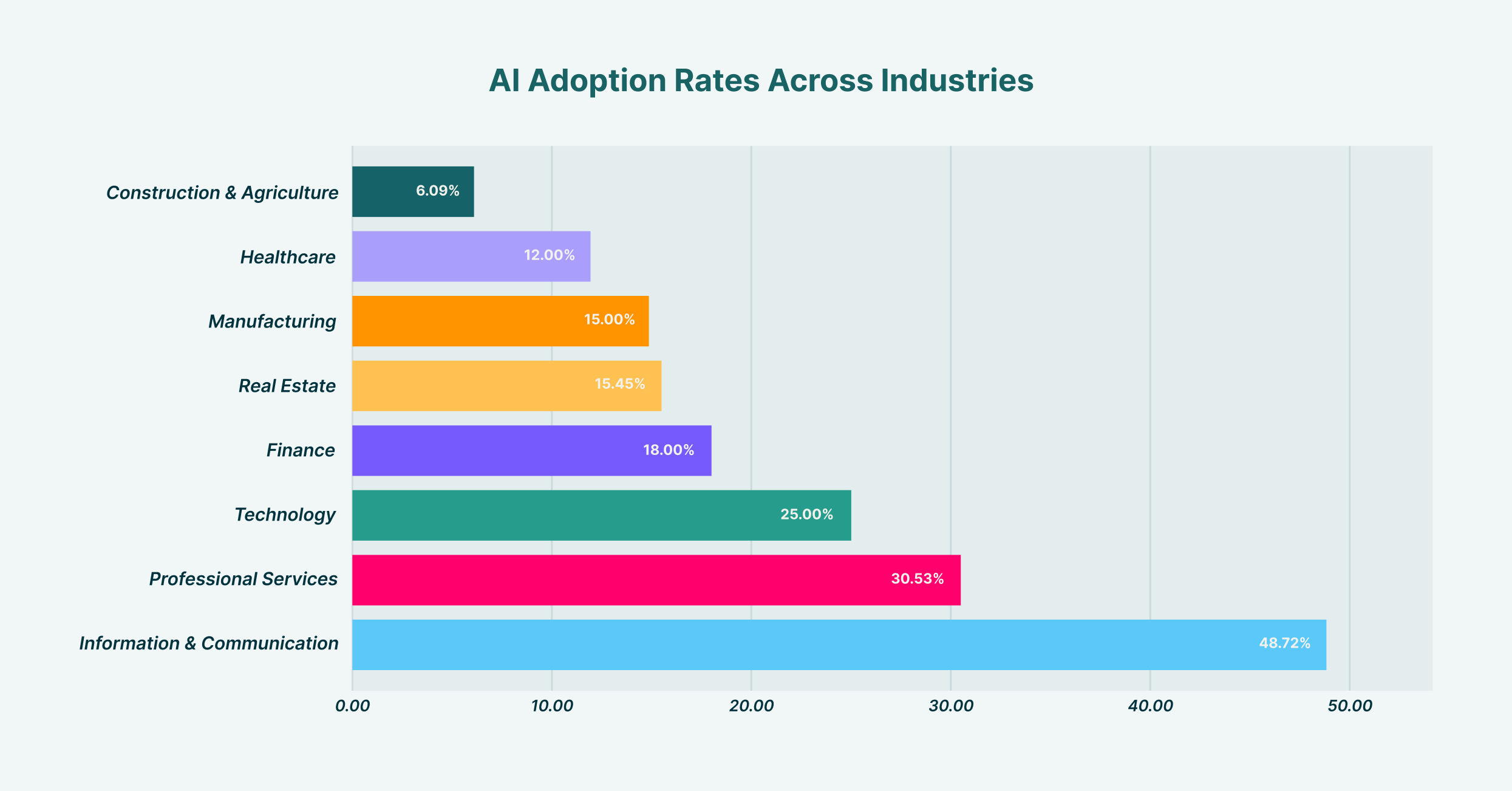

Wdrożenie sztucznej inteligencji znacznie różni się w poszczególnych branżach, przy czym na czele znajduje się branża informacyjno-komunikacyjna z wynikiem 48.7%, a na najniższym miejscu – budownictwo i rolnictwo z wynikiem 6.1%.

Ustanowienie solidnego zarządzania sztuczną inteligencją (AI) wymaga utworzenia międzyfunkcyjnego zespołu, zazwyczaj składającego się z przedstawicieli działów IT, bezpieczeństwa, prawnego i biznesowego. Zadaniem tego komitetu jest określenie stanowiska organizacji w sprawie AI. Jaka jest nasza tolerancja ryzyka? Które przypadki użycia są mile widziane, a które zabronione? Kto ponosi odpowiedzialność w przypadku wystąpienia incydentu związanego z AI? Odpowiedzi na te pytania zapewniają jasność niezbędną do tworzenia polityk i mechanizmów kontroli. Bez tego odgórnego strategicznego kierownictwa każda próba zarządzania ryzykiem staje się serią rozproszonych, reaktywnych działań, a nie spójną obroną. Te ramy zarządzania stają się podstawą wszystkich kolejnych działań w zakresie bezpieczeństwa, zapewniając spójność technologii, polityk i zachowań użytkowników.

Tworzenie ram zarządzania ryzykiem AI

Po wdrożeniu struktury zarządzania, kolejnym krokiem jest zbudowanie formalnych ram zarządzania ryzykiem związanym ze sztuczną inteligencją. Ramy te wdrażają zasady zarządzania, przekształcając strategię wysokiego szczebla w konkretne, powtarzalne procesy. Zapewniają ustrukturyzowaną metodę identyfikacji, oceny, ograniczania i monitorowania ryzyka związanego ze sztuczną inteligencją w całej organizacji. Zamiast wyważać otwarte drzwi, organizacje mogą dostosować ugruntowane modele, takie jak Ramy Zarządzania Ryzykiem Sztucznej Inteligencji NIST (NIST AI Risk Management Framework), do swojego specyficznego kontekstu operacyjnego i krajobrazu zagrożeń.

Opracowanie skutecznych ram zarządzania ryzykiem związanym ze sztuczną inteligencją (AI) powinno być procesem metodycznym. Zaczyna się od stworzenia kompleksowego spisu wszystkich używanych systemów AI – zarówno zatwierdzonych, jak i niezatwierdzonych. Ta wstępna faza odkrywania jest kluczowa – nie da się chronić czegoś, czego nie widać. Po odkryciu, ramy powinny określać procedury oceny ryzyka, przypisując punkty na podstawie takich czynników, jak rodzaj przetwarzanych danych, możliwości modelu i jego integracja z innymi systemami krytycznymi. Na podstawie tej oceny opracowywane są następnie strategie ograniczania ryzyka, od kontroli technicznych i szkoleń użytkowników po całkowity zakaz korzystania z aplikacji wysokiego ryzyka. Wreszcie, ramy muszą uwzględniać rytm ciągłego monitorowania i przeglądu, ponieważ zarówno ekosystem AI, jak i sposób jego wykorzystania w organizacji będą stale ewoluować. Istnieją różne ramy zarządzania ryzykiem związanym ze sztuczną inteligencją, ale najskuteczniejsze są te, które nie są statycznymi dokumentami, lecz żywymi, dynamicznymi elementami programu bezpieczeństwa organizacji.

Kategoryzacja zagrożeń związanych ze sztuczną inteligencją: od eksfiltracji danych do zatruwania modeli

Kluczowym elementem sztucznej inteligencji (AI) i zarządzania ryzykiem jest zrozumienie konkretnych rodzajów zagrożeń, z którymi się mierzysz. Zagrożenia nie są monolityczne; obejmują całe spektrum, od naruszeń prywatności danych po zaawansowane ataki na same modele AI. Jednym z najbardziej bezpośrednich i powszechnych zagrożeń jest wyciek danych. Wyobraź sobie analityka marketingowego wklejającego listę wartościowych leadów wraz z danymi kontaktowymi do publicznego narzędzia GenAI, aby tworzyć spersonalizowane e-maile. W tym momencie wrażliwe dane klientów zostały wykradzione i stały się częścią danych szkoleniowych LLM, pozostając poza kontrolą Twojej organizacji i potencjalnie naruszając przepisy o ochronie danych, takie jak RODO lub CCPA.

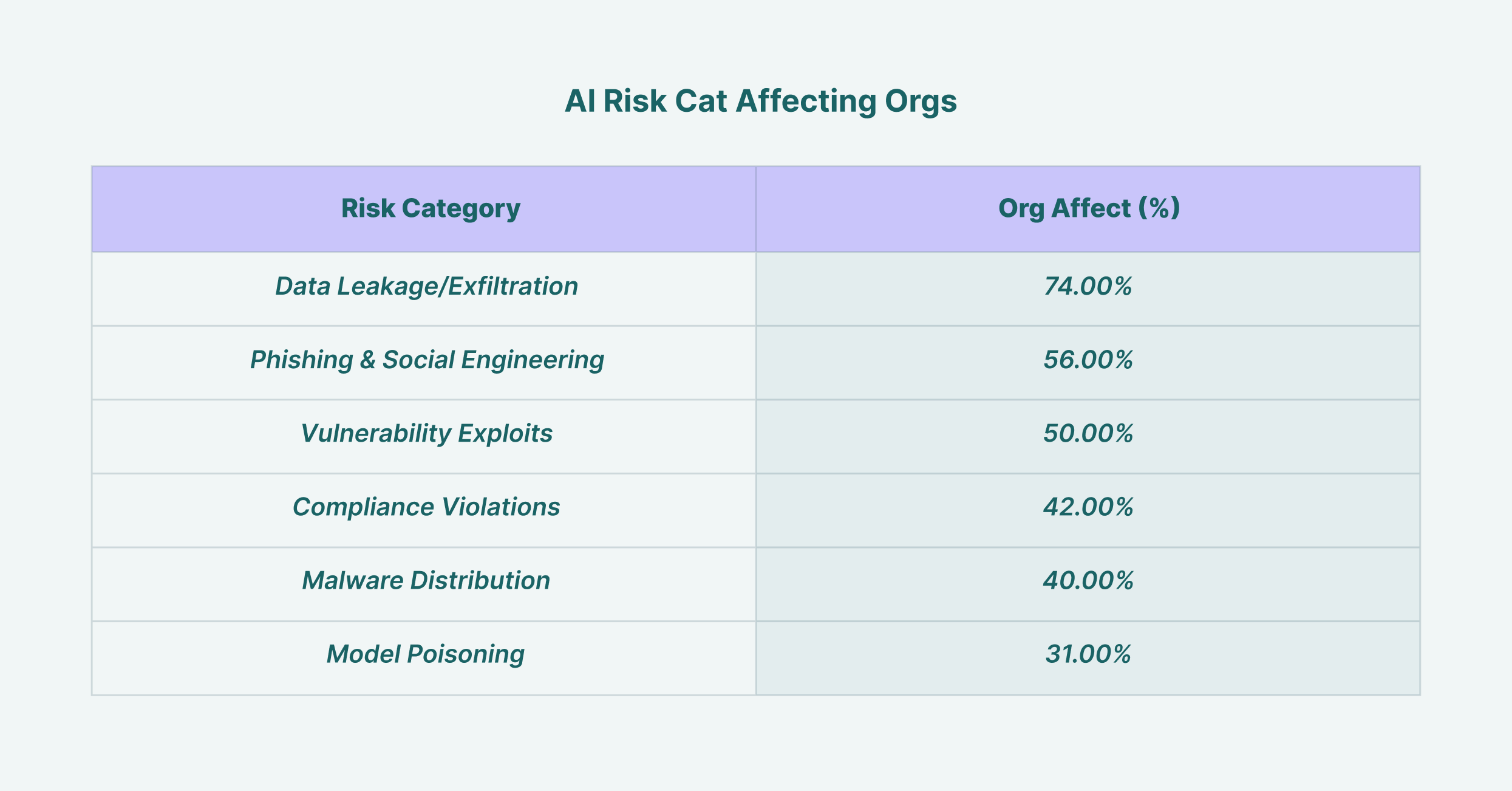

Wyciek danych dotyczy 74% organizacji, co czyni go najpowszechniejszym zagrożeniem bezpieczeństwa sztucznej inteligencji, a na drugim miejscu znajdują się ataki phishingowe (56%)

Oprócz wycieku danych, liderzy bezpieczeństwa muszą mierzyć się z bardziej zaawansowanymi zagrożeniami. Zatrucie modelu (ang. model poisoning) ma miejsce, gdy atakujący celowo wprowadza do modelu szkodliwe dane w fazie uczenia, powodując, że generuje on stronnicze, nieprawidłowe lub szkodliwe wyniki. Ataki polegające na omijaniu zabezpieczeń (ang. „unwinding”) polegają na tworzeniu danych wejściowych, które są specjalnie zaprojektowane w celu ominięcia filtrów bezpieczeństwa systemu AI. Dla CISO efektywne wykorzystanie AI w zarządzaniu ryzykiem oznacza również wykorzystanie narzędzi bezpieczeństwa opartych na AI do wykrywania tych właśnie zagrożeń. Zaawansowane systemy wykrywania zagrożeń mogą analizować zachowania użytkowników i przepływy danych w celu identyfikacji anomalii wskazujących na incydent bezpieczeństwa związany z AI, przekształcając technologię ze źródła ryzyka w element rozwiązania.

Krytyczna rola polityki bezpieczeństwa AI

Aby przełożyć ramy działania na jasne wytyczne dla pracowników, niezbędna jest dedykowana polityka bezpieczeństwa AI. Dokument ten stanowi wiarygodne źródło informacji na temat dopuszczalnego wykorzystania AI w organizacji. Powinien być jasny, zwięzły i łatwo dostępny dla wszystkich pracowników, nie pozostawiając miejsca na niejasności. Dobrze opracowana polityka bezpieczeństwa AI wykracza poza proste „co robić, a czego nie robić”, zapewniając kontekst i wyjaśniając dlaczego pewne ograniczenia wprowadzono po to, aby wykształcić kulturę świadomości bezpieczeństwa, a nie tylko jej przestrzegać.

Polityka musi wyraźnie określać kilka kluczowych obszarów. Po pierwsze, powinna zawierać listę wszystkich zatwierdzonych i licencjonowanych narzędzi AI, wraz z procedurą wnioskowania o ocenę nowego narzędzia. Zapobiega to rozprzestrzenianiu się tzw. „shadow AI”. Po drugie, musi ustanawiać jasne wytyczne dotyczące przetwarzania danych, określając, jakie rodzaje informacji korporacyjnych (np. publiczne, wewnętrzne, poufne, zastrzeżone) mogą być wykorzystywane w poszczególnych kategoriach narzędzi AI. Na przykład, korzystanie z publicznego narzędzia GenAI do podsumowywania publicznie dostępnych artykułów prasowych może być dopuszczalne, ale używanie go do analizy poufnych prognoz finansowych byłoby surowo zabronione. Polityka powinna również określać obowiązki użytkowników, konsekwencje nieprzestrzegania zasad oraz protokół reagowania na incydenty w przypadku podejrzenia naruszeń związanych z AI, zapewniając, że wszyscy rozumieją swoją rolę w ochronie organizacji.

Ocena modeli i wtyczek: skupienie się na zarządzaniu ryzykiem stron trzecich w zakresie sztucznej inteligencji

Nowoczesny ekosystem sztucznej inteligencji (AI) opiera się na złożonym łańcuchu dostaw modeli, platform i wtyczek opracowanych przez firmy zewnętrzne. Ta rzeczywistość sprawia, że zarządzanie ryzykiem związanym z AI jest kluczowym filarem ogólnej strategii bezpieczeństwa. Za każdym razem, gdy pracownik uruchamia nową wtyczkę dla swojego asystenta AI lub zespół programistów integruje interfejs API firmy zewnętrznej, rozszerza on powierzchnię ataku organizacji. Każdy z tych zewnętrznych komponentów niesie ze sobą własny zestaw potencjalnych luk w zabezpieczeniach, polityk prywatności danych i zabezpieczeń, które są teraz dziedziczone przez organizację.

Informacje biznesowe odpowiadają za 43% ujawnień wrażliwych danych w GenAI, następnie kod źródłowy (31%) i dane klientów (23%)

Dlatego niezbędny jest rygorystyczny proces oceny. Zanim jakiekolwiek narzędzie lub komponent AI innej firmy zostanie zatwierdzone do użytku, musi zostać poddane dokładnej kontroli bezpieczeństwa i prywatności. Obejmuje to kontrolę certyfikatów bezpieczeństwa dostawcy, praktyk przetwarzania danych i możliwości reagowania na incydenty. Jakie dane gromadzi narzędzie? Gdzie są przechowywane i kto ma do nich dostęp? Czy dostawca ma historię naruszeń bezpieczeństwa? W przypadku wtyczek AI, które są coraz częstszym wektorem ataków opartych na przeglądarkach, proces weryfikacji powinien być jeszcze bardziej rygorystyczny. Pytania, które należy zadać, to m.in.: Jakich uprawnień wymaga wtyczka? Kto jest jej deweloperem? Czy jej kod został zweryfikowany? Traktując każdą usługę AI innej firmy z takim samym poziomem kontroli, jak każdego innego kluczowego dostawcę, możesz zminimalizować ryzyko ataku na łańcuch dostaw, który narazi Twoją organizację na niebezpieczeństwo.

Wdrażanie narzędzi do zarządzania ryzykiem AI

Polityka i procedury są fundamentalne, ale bez technicznego egzekwowania są niewystarczające. Właśnie tutaj narzędzia do zarządzania ryzykiem AI stają się niezbędne. Rozwiązania te zapewniają widoczność i kontrolę niezbędną do zapewnienia przestrzegania polityki bezpieczeństwa AI w praktyce, a nie tylko w teorii. Biorąc pod uwagę, że głównym interfejsem dla większości użytkowników korzystających z GenAI jest przeglądarka internetowa, narzędzia działające na tym poziomie mają wyjątkową pozycję, umożliwiającą skuteczny nadzór.

Rozszerzenia przeglądarek lub platformy dla przedsiębiorstw, takie jak LayerX, oferują potężny mechanizm zarządzania ryzykiem związanym ze sztuczną inteligencją. Potrafią one wykrywać i mapować całe wykorzystanie GenAI w organizacji, zapewniając w czasie rzeczywistym inwentaryzację użytkowników uzyskujących dostęp do poszczególnych platform. Ta widoczność to pierwszy krok w kierunku wyeliminowania ukrytej sztucznej inteligencji (shadow AI). Następnie narzędzia te mogą egzekwować szczegółowe zabezpieczenia oparte na ryzyku. Na przykład, można skonfigurować politykę uniemożliwiającą użytkownikom wklejanie tekstu oznaczonego jako „poufny” do publicznego chatbota AI lub ostrzegającą użytkowników przed przesłaniem poufnego dokumentu. Ta warstwa ochrony monitoruje i kontroluje przepływ danych między przeglądarką użytkownika a siecią, skutecznie działając jako rozwiązanie zapobiegające utracie danych (DLP) dostosowane do ery sztucznej inteligencji. Odpowiednie narzędzia do zarządzania ryzykiem związanym ze sztuczną inteligencją łączą politykę z rzeczywistością, zapewniając techniczne środki do egzekwowania decyzji zarządczych.

Obsługa incydentów i reagowanie na nie w erze sztucznej inteligencji

Nawet przy najlepszych środkach zapobiegawczych incydenty wciąż mogą się zdarzać. Sposób reakcji organizacji jest czynnikiem decydującym o minimalizacji skutków naruszenia bezpieczeństwa. Skuteczny plan reagowania na incydenty związane ze sztuczną inteligencją musi być zarówno konkretny, jak i dobrze przećwiczony. W przypadku wygenerowania alertu, niezależnie od tego, czy jest to zgłoszenie użytkownika, czy automatyczne wykrycie przez jedno z narzędzi bezpieczeństwa, zespół reagowania musi stosować się do jasnego scenariusza.

Pierwszym krokiem jest ograniczenie wycieku. Jeśli użytkownik nieumyślnie ujawnił poufne dane do LLM, natychmiastowym priorytetem jest cofnięcie dostępu i zapobieżenie dalszemu narażeniu. Może to obejmować tymczasowe zablokowanie użytkownikowi dostępu do narzędzia, a nawet odizolowanie jego komputera od sieci. Kolejnym etapem jest dochodzenie. Jakie dane wyciekły? Kto był odpowiedzialny? W jaki sposób nasze mechanizmy kontroli zawiodły? Ta analiza kryminalistyczna ma kluczowe znaczenie dla zrozumienia pierwotnej przyczyny i zapobiegania ponownemu wystąpieniu problemu. Wreszcie, plan musi uwzględniać eliminację i odzyskiwanie, co obejmuje powiadomienie poszkodowanych stron zgodnie z wymogami prawa, podjęcie kroków w celu usunięcia danych przez dostawcę sztucznej inteligencji, jeśli to możliwe, oraz aktualizację polityk bezpieczeństwa i mechanizmów kontroli w oparciu o wyciągnięte wnioski. Dojrzała postawa w zakresie sztucznej inteligencji i zarządzania ryzykiem oznacza bycie przygotowanym do reagowania na incydenty tak samo, jak do ich zapobiegania.

Monitorowanie i poprawa postawy ryzyka związanego ze sztuczną inteligencją

Zarządzanie ryzykiem związanym ze sztuczną inteligencją nie jest jednorazowym projektem; to ciągły cykl oceny, ograniczania i doskonalenia. Krajobraz zagrożeń jest dynamiczny, a nowe narzędzia sztucznej inteligencji i wektory ataków stale się pojawiają. Dlatego monitorowanie poziomu ryzyka związanego ze sztuczną inteligencją w organizacji w czasie jest kluczowe dla zapewnienia skuteczności mechanizmów obronnych. Wymaga to zaangażowania w ciągły monitoring i wykorzystanie metryk do ilościowego określenia poziomu ryzyka i skuteczności kontroli.

Kluczowe wskaźniki efektywności (KPI) mogą obejmować liczbę wykrytych nieautoryzowanych narzędzi AI, liczbę zapobieżonych incydentów wycieku danych oraz odsetek pracowników, którzy ukończyli szkolenie z zakresu bezpieczeństwa AI. Regularne audyty i testy penetracyjne, ze szczególnym uwzględnieniem systemów AI, mogą również dostarczyć cennych informacji na temat słabości w zabezpieczeniach. Poprzez ciągłe pomiary i udoskonalanie podejścia, tworzysz odporny program bezpieczeństwa, który dostosowuje się do zmieniających się wyzwań świata napędzanego przez AI. To proaktywne podejście gwarantuje, że Twoja organizacja może nadal pewnie i bezpiecznie wykorzystywać potencjał AI, przekształcając potencjalne źródło katastrofalnego ryzyka w dobrze zarządzaną przewagę strategiczną.