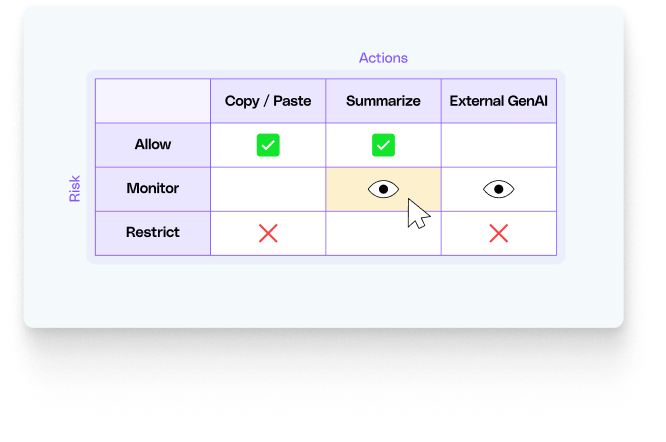

För att implementera den här typen av detaljerad, kontextmedveten säkerhet vänder sig organisationer i allt högre grad till lösningar som LayerX. Genom att fungera direkt i webbläsaren ger LayerX den djupa insyn och realtidskontroll som behövs för att hantera moderna AI-risker.

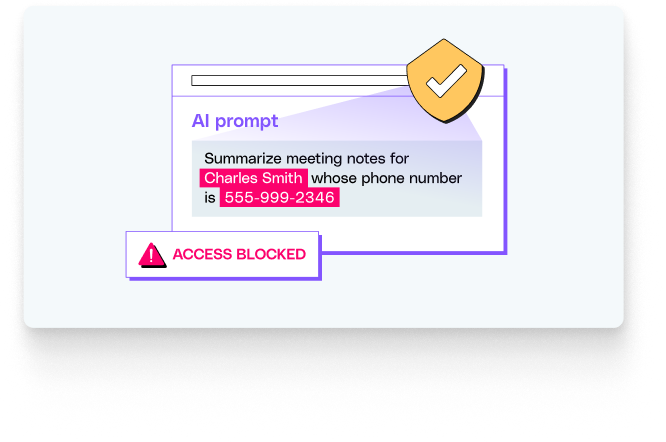

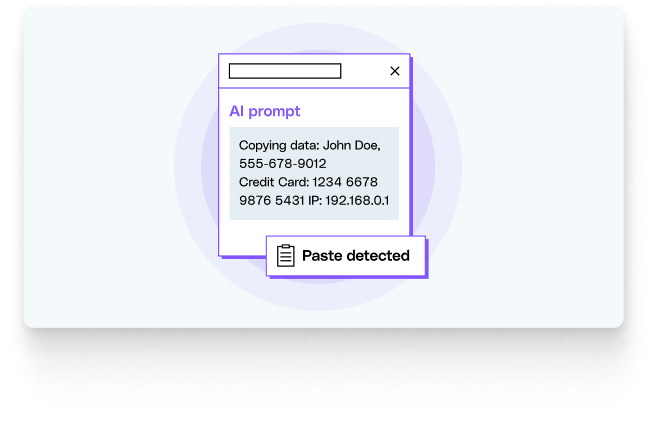

Tänk dig ett scenario där en marknadsförare använder ett obehörigt AI-verktyg för att utarbeta ett pressmeddelande. De försöker klistra in ett dokument som innehåller oanmälda finansiella siffror och kundnamn. En traditionell säkerhetslösning skulle sannolikt inte vara uppmärksam på denna åtgärd. En webbläsarlösning som LayerX kan dock: