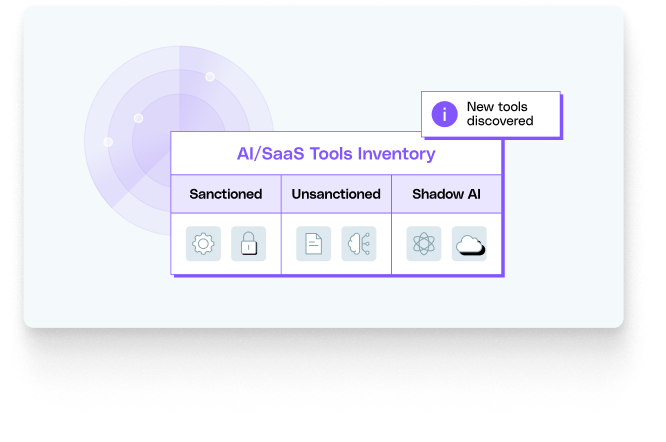

For at implementere denne form for detaljeret, kontekstbevidst sikkerhed, vender organisationer sig i stigende grad mod løsninger som LayerX. Ved at operere direkte i browseren giver LayerX den dybe synlighed og kontrol i realtid, der er nødvendig for at håndtere moderne AI-risici.

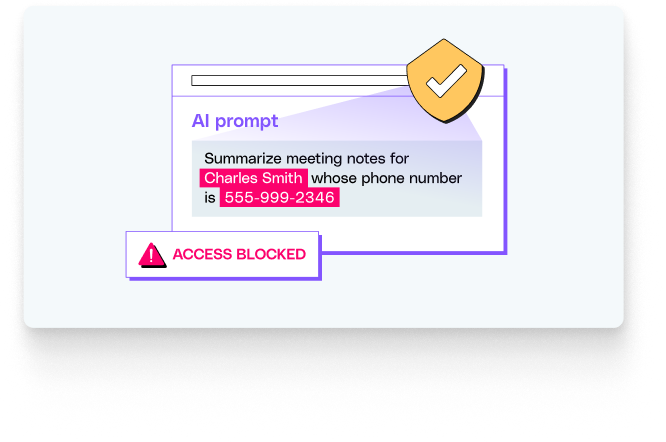

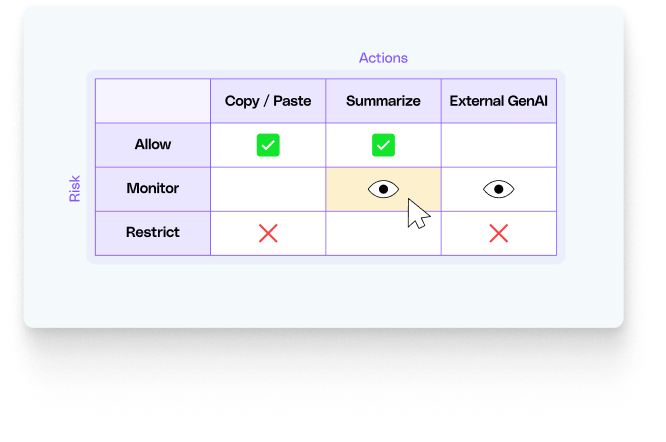

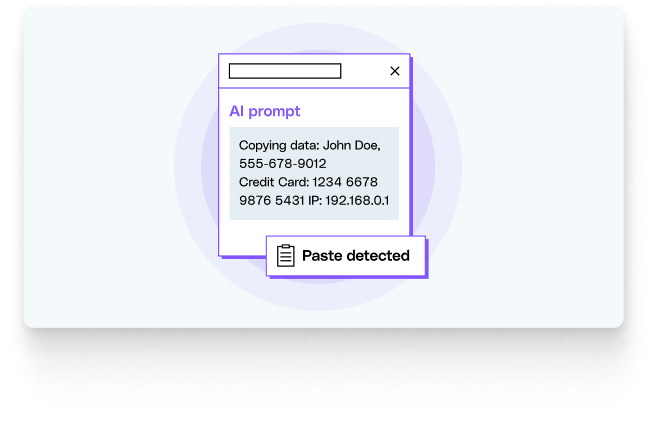

Forestil dig et scenarie, hvor en marketingmedarbejder bruger et uautoriseret AI-værktøj til at udarbejde en pressemeddelelse. De forsøger at indsætte et dokument, der indeholder uanmeldte økonomiske tal og kundenavne. En traditionel sikkerhedsløsning ville sandsynligvis ikke være opmærksom på denne handling. En browserløsning som LayerX kan dog: