Effektiv sikkerhed kræver nu, at vi kontrollerer, hvordan medarbejdere interagerer med generative modeller, ikke kun modellerne selv. De 10 bedste AI-styringspraksisser for 2026 fokuserer på at sikre den "sidste mil" af brugeradoption, hvor data forlader virksomheden og kommer ind i browseren.

Hvad er AI-styringspraksis, og hvorfor de er vigtige

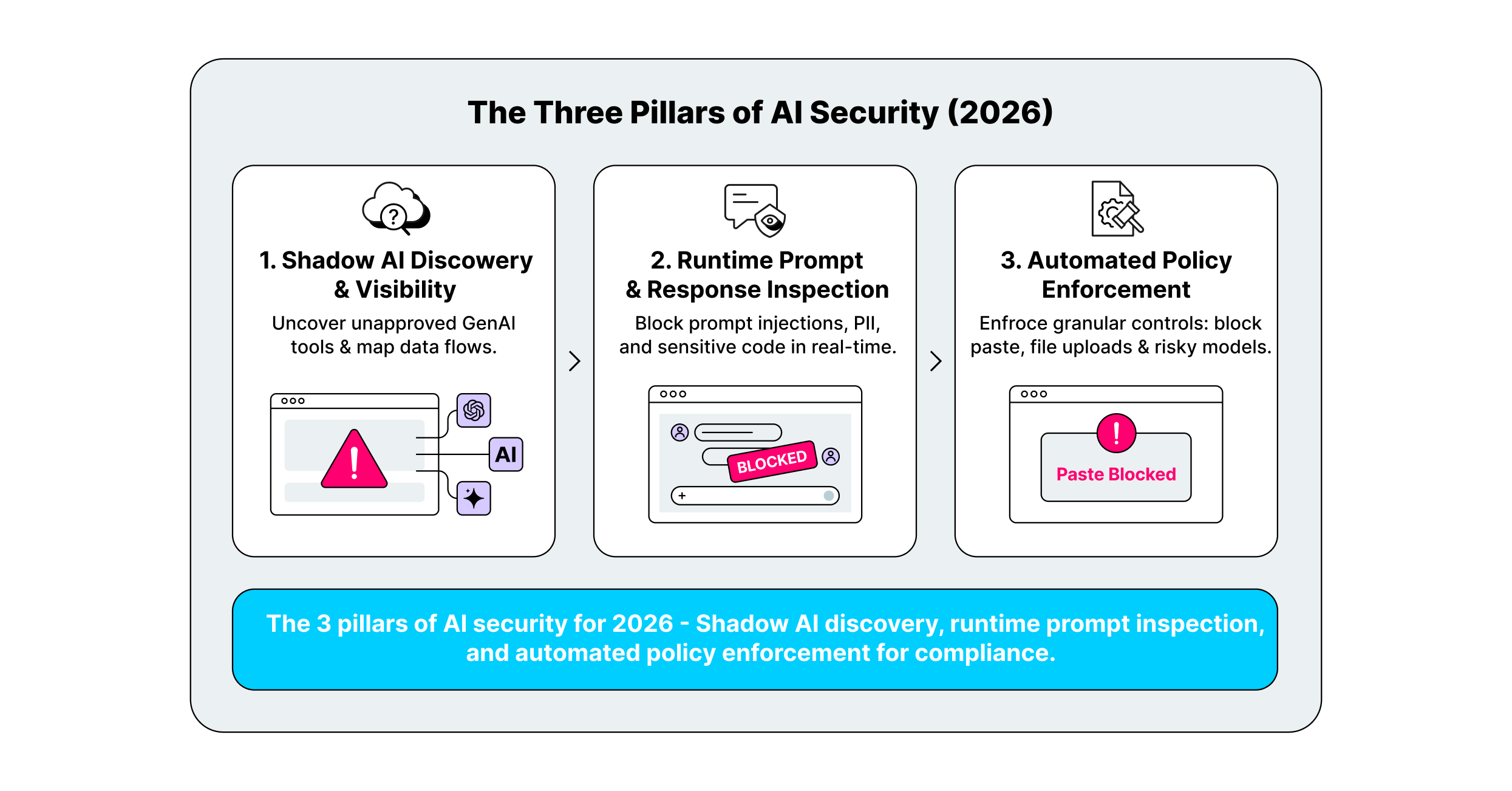

AI-styring er ikke længere en teoretisk ramme; det er en aktiv sikkerhedsarbejdsgang designet til at håndtere risiciene ved generativt AI-forbrug. Disse praksisser flytter fokus fra at validere modelvægte til at kontrollere "brugsstedet". Sikkerhedsteams skal nu styre det præcise øjeblik, hvor en medarbejder indsætter kundedata i en chatbot eller installerer en AI-drevet browserudvidelse.

Det mest kritiske hul i moderne styring er "den sidste mil"; browsergrænsefladen, hvor brugerne interagerer med SaaS- og GenAI-værktøjer. Traditionelle netværksforsvar kan ikke se krypteret trafik i en chatsession, og API-baserede kontroller reagerer ofte for sent. Effektiv styring kræver realtidssynlighed og håndhævelse direkte i medarbejderens arbejdsområde for at forhindre datalækage og blokere ondsindede input, før de behandles.

Vigtige tendenser inden for AI-styring at holde øje med i 2026

Skiftet mod browser-native sikkerhedskontroller er den dominerende tendens for 2026. Sikkerhedsledere bevæger sig væk fra klodsede netværksproxyer, der ødelægger brugeroplevelsen, og hen imod lette browserudvidelser. Disse værktøjer sidder direkte i arbejdsgangen og giver organisationer mulighed for at overvåge prompt kontekst, inspicere udvidelsestilladelser og redigere følsomme data uden at omdirigere trafik.

En anden væsentlig udvikling er fremkomsten af identitetsbevidst styring for autonome AI-agenter. Efterhånden som "agentisk AI" begynder at handle på vegne af brugere, booke møder, skrive kode eller forespørge databaser, fejler statiske tilladelseslister. Styringsstrategier udvikler sig for at håndhæve rollebaseret adgangskontrol (RBAC), der begrænser, hvad en AI-agent kan gøre baseret på brugerens specifikke privilegier og dataenes følsomhed.

10 bedste AI-styringsværktøjer i 2026

Nedenfor er de bedste løsninger, der muliggør sikker AI-adoption gennem håndhævelse, synlighed og risikostyring.

| Praksis | Nøglefokus | Bedst til |

| LayerX | Browserbaseret håndhævelse | Lukning af sikkerhedshullet "den sidste mil" |

| Harmonisk sikkerhed | Skygge-AI-opdagelse | Få fuldt indblik i AI-adoption |

| Hurtig sikkerhed | Hurtigt injektionsforsvar | Sikring af GenAI-interaktioner mod misbrug |

| Lasso Sikkerhed | Rollebaseret adgangskontrol | Kontekstbevidst politikhåndhævelse |

| Nightfall AI | Forebyggelse af datatab (DLP) | Forebyggelse af PII/IP-lækage i realtid |

| AIM-sikkerhed | AI Asset Inventory | Centraliseret sporing af alle AI-værktøjer |

| Vidne til AI | Automatiseret risikoscoring | Strømlining af godkendelse af sikre AI-værktøjer |

| Knostic | Revisions- og compliance-logning | Opfylder lovkrav |

| Polymer | Medarbejderuddannelse og -bevidsthed | Opbygning af en sikkerhedsbevidst kultur |

| Lakera | Kontinuerlig overvågning | Opdagelse af anomalier og politikforskydninger |

1. LayerX

LayerX er en browsersikkerhedsplatform, der fungerer som en letvægtsudvidelse, der placerer styringskontroller direkte der, hvor brugerne interagerer med AI. Den adresserer hullet i den "sidste mil" ved at overvåge hvert tastetryk, indsættelseshandling og filupload i realtid. Dette giver sikkerhedsteams mulighed for at håndhæve detaljerede politikker, såsom at blokere indsættelse af kildekode i ChatGPT eller forhindre installation af højrisiko-AI-udvidelser, uden at forstyrre brugerens arbejdsgang eller kræve en dedikeret virksomhedsbrowser.

Platformen udmærker sig ved at give dyb indsigt i både godkendt og "Shadow AI"-brug på tværs af administrerede og BYOD-enheder. LayerX analyserer konteksten af browserinteraktioner for at skelne mellem sikre opgaver og risikabel adfærd, hvilket sikrer, at følsomme virksomhedsdata aldrig forlader browsermiljøet ubeskyttet. Dens tilgang gør det muligt for organisationer at implementere GenAI-værktøjer sikkert ved at afbøde risici som dataeksfiltrering og kontoovertagelser ved kilden.

2. Harmonisk sikkerhed

Harmonic Security fokuserer på at løse Shadow AI-problemet ved at identificere og kategorisere alle AI-værktøjer, som medarbejdere bruger, uanset om de er formelt godkendt eller ej. I stedet for at stole på statiske bloklister bruger Harmonic specialiserede små sprogmodeller til at analysere hensigten og indholdet af dataoverførsler. Dette gør det muligt at skelne mellem en harmløs forespørgsel og en risikabel upload af regulerede data, hvilket muliggør en "sikker standard"-position, der giver medarbejdere mulighed for at bruge nye værktøjer uden at udsætte organisationen for risiko.

Platformen opbygger et omfattende kort over AI-adoption på tværs af virksomheden, hvilket giver sikkerhedsledere et klart indblik i, hvilke afdelinger der bruger hvilke værktøjer. Ved at forstå den forretningsmæssige kontekst for AI-brug hjælper Harmonic teams med at udarbejde politikker, der understøtter innovation, samtidig med at den automatisk markerer eller blokerer højrisikoapplikationer, der ikke opfylder sikkerhedsstandarder.

3. Hurtig sikkerhed

Prompt Security specialiserer sig i at forsvare mod prompt injection-angreb, en kritisk sårbarhed, hvor ondsindede input manipulerer GenAI-adfærd. Deres løsning overvåger Document Object Model (DOM) og brugerinput for at opdage forsøg på at jailbreake modeller eller exfiltrere data via skjulte kommandoer. Dette fokus gør dem til et essentielt forsvarslag for organisationer, der bygger eller implementerer offentligt tilgængelige GenAI-applikationer, hvor brugerinput ikke kan stoles fuldt ud.

Ud over forsvar mod injektioner leverer Prompt Security værktøjer til at rense input og verificere output, hvilket sikrer, at LLM'er ikke utilsigtet genererer skadeligt indhold eller afslører systeminstruktioner. Deres teknologi integreres i udviklingspipelinen og hjælper ingeniørteams med at sikre deres AI-funktioner, før de når produktion.

4. Lassosikkerhed

Lasso Security leverer kontekstuel rollebaseret adgangskontrol (RBAC) til GenAI, hvilket sikrer, at brugerne kun kan få adgang til de modeller og data, der er relevante for deres specifikke jobfunktion. Deres platform går ud over simple adgangslogfiler og håndhæver politikker baseret på brugerens identitet, dataenes følsomhed og den tilsigtede anvendelse. Denne granulære kontrol forhindrer "adgangskryp", hvor medarbejdere bevarer adgangen til kraftfulde AI-værktøjer, de ikke længere har brug for.

Løsningen overvåger også for uregelmæssigheder i realtid, såsom en marketingmedarbejder, der pludselig forespørger en kodeassistent om databaseoplysninger. Ved at korrelere brugeridentitet med adfærdsmønstre hjælper Lasso organisationer med at opdage og stoppe intern misbrug af AI-værktøjer, før det resulterer i et databrud.

5. Natfalds-AI

Nightfall AI bringer avanceret datatabsforebyggelse (DLP) til AI-æraen ved hjælp af maskinlæringsdetektorer, der er trænet på millioner af prøver, til at identificere følsomme data med høj præcision. Deres løsning scanner data i bevægelse og i hvile og registrerer PII, sundhedsjournaler og hemmeligheder som API-nøgler, før de uploades til GenAI-platforme. Nightfalls detektorer er indstillet til at forstå kontekst, hvilket reducerer falske positiver betydeligt sammenlignet med traditionelle regex-baserede DLP-værktøjer.

Til AI-styring integrerer Nightfall med browser- og cloud-workflows for at redigere eller blokere følsomme oplysninger i realtid. Denne funktion giver medarbejdere mulighed for at bruge produktivitetsværktøjer som chatbots, samtidig med at det sikres, at compliance-krav som GDPR og HIPAA overholdes nøje, selv i ustrukturerede prompts.

6. AIM-sikkerhed

AIM Security fokuserer på at oprette en komplet AI-aktiverfortegnelse, der effektivt fungerer som en "AI-materialeliste" for virksomheden. Deres platform scanner IT-miljøet for at finde alle implementerede modeller, træningsdatasæt og AI-integrerede applikationer. Denne centraliserede visning giver sikkerhedsteams mulighed for at spore livscyklussen for hvert AI-aktiv, fra indkøb til nedlukning, hvilket sikrer, at ingen "zombie"-modeller kører uden tilsyn.

Ved at opretholde en realtidsopgørelse hjælper AIM Security organisationer med at identificere afhængigheder og potentielle risici i forsyningskæden. Hvis en specifik open source-model viser sig at have en sårbarhed, kan administratorer øjeblikkeligt finde alle instanser af den pågældende model i deres infrastruktur og anvende nødvendige programrettelser eller afhjælpninger.

7. Oplev kunstig intelligens

Witness AI leverer automatiseret risikoscoring for at strømline evalueringen og godkendelsen af nye AI-værktøjer. Deres platform tildeler en dynamisk risikoscore til applikationer baseret på deres servicevilkår, datahåndteringspraksis og compliance-certificeringer. Dette giver sikkerhedsteams mulighed for hurtigt at godkende anmodninger om ny software og erstatte langvarige manuelle gennemgange med datadrevne beslutninger.

Platformen overvåger også løbende risikoprofilen for godkendte værktøjer og advarer administratorer, hvis en leverandør ændrer sin privatlivspolitik eller oplever en sikkerhedshændelse. Denne løbende vurdering sikrer, at organisationens liste over godkendte softwareprodukter forbliver nøjagtig og sikker over tid.

8. Knotisk

Knostic adresserer udfordringen med revision og autorisation ved at logge præcis, hvem der tilgår hvilken viden i en organisations AI-systemer. Deres løsning besvarer spørgsmålet om "need to know" og sikrer, at GenAI-værktøjer ikke omgår eksisterende filtilladelser for at afsløre fortrolige dokumenter for uautoriserede brugere. Knostic genererer detaljerede revisionsspor, der knytter prompts til de specifikke dokumenter, der bruges til at generere svaret.

Dette niveau af gennemsigtighed er afgørende for regulerede brancher, der skal demonstrere streng kontrol over informationsstrømmen. Knostics autorisationskontroller forhindrer "videnslækage", hvor en LLM utilsigtet afslører følsomme strategibeslutninger eller HR-data til medarbejdere, som ikke burde have adgang til disse oplysninger.

9. Polymer

Polymer anvender en menneskecentreret tilgang til styring ved at bruge "nudges" og træning i realtid til at opbygge en sikkerhedsbevidst kultur. I stedet for blot at blokere en risikabel handling, griber Polymers system ind med en pop op-meddelelse, der forklarer hvorfor Handlingen er risikabel og foreslår et sikrere alternativ. Denne "i øjeblikket"-uddannelse hjælper med at reducere træthed i alarmberedskabet og opfordrer medarbejdere til at blive aktive deltagere i sikkerhedsprocessen.

Deres platform er særligt effektiv for organisationer, der ønsker at reducere byrden på deres SOC-teams. Ved at give brugerne mulighed for selv at rette lavrisikofejl, giver Polymer sikkerhedsanalytikere mulighed for at fokusere på reelle trusler, samtidig med at organisationens samlede datahåndteringsvaner støt forbedres.

10. Lakera

Lakera specialiserer sig i kontinuerlig overvågning og "red teaming" for AI-applikationer for at detektere policy drift og fjendtlige angreb. Deres platform, Lakera Guard, fungerer som en firewall for LLM'er og sidder mellem brugeren og modellen for at filtrere umiddelbare injektioner, jailbreaks og giftige input fra. Denne kontinuerlige testning sikrer, at AI-modeller forbliver i overensstemmelse med sikkerhedsretningslinjerne, selvom angribere udvikler deres teknikker.

Lakera leverer også en database over kendte prompts og angrebsvektorer, der giver organisationer mulighed for at benchmarke deres forsvar mod de nyeste trusler. Denne proaktive holdning hjælper udviklere med at identificere svagheder i deres AI-applikationer, før de implementeres i produktion, hvilket reducerer risikoen for et offentligt sikkerhedssvigt.

Sådan vælger du den bedste udbyder af AI-styring

- Prioritér indsigt i "Shadow AI" for at forstå det fulde omfang af uadministrerede værktøjer, som dine medarbejdere allerede bruger.

- Vælg en løsning med browser-native håndhævelse for at sikre data på inputstedet uden at dirigere trafik gennem komplekse proxyer.

- Sørg for, at værktøjet tilbyder detaljerede, identitetsbaserede kontroller, så du kan aktivere forskellige adgangsniveauer for udviklere, HR og marketing.

- Kig efter automatiserede afhjælpningsfunktioner, der kan redigere følsomme data i realtid i stedet for blot at blokere hele applikationen.

- Bekræft, at udbyderen understøtter løbende compliance-revision for at opfylde lovgivningsmæssige standarder som ISO 42001 og EU's AI-lov.

Ofte Stillede Spørgsmål

Hvad er AI-styring i praktiske sikkerhedstermer?

I praksis er AI-styring det sæt af tekniske kontroller og politikker, der dikterer, hvordan medarbejdere og applikationer interagerer med generativ AI. Det involverer overvågning af prompts for følsomme data, verificering af AI-leverandørers sikkerhedsstatus og sikring af, at AI-genererede output er nøjagtige og sikre at bruge.

Hvordan adskiller AI-styring sig fra AI-modelsikkerhed?

AI-modelsikkerhed fokuserer på at beskytte modellens vægte, parametre og infrastruktur mod tyveri eller manipulation. AI-styring er bredere og fokuserer på forbrug af modellen; sikring af, at de data, der indføres i den, er kompatible, at brugerne, der tilgår den, er autoriserede, og at forretningsrisiciene ved implementeringen styres.

Hvad skal vi kontrollere først: prompter, filer eller værktøjsadgang?

Du bør først kontrollere synlighed og adgang til værktøjer. Du kan ikke styre det, du ikke kan se, så det grundlæggende trin er at identificere, hvilke værktøjer der er i brug (Shadow AI). Når synligheden er etableret, kan du implementere kontroller for prompts og filuploads for at forhindre datalækage.

Har vi brug for en dedikeret virksomhedsbrowser til AI-styring?

Nej, du behøver ikke en dedikeret virksomhedsbrowser. Moderne browsersikkerhedsplatforme som LayerX fungerer som udvidelser, der ligger oven på standardbrowsere som Chrome og Edge. Dette giver dig mulighed for at anvende styring og sikkerhedskontroller i virksomhedsklassen uden at tvinge brugerne til at skifte til en ny, ukendt browsergrænseflade.

Hvordan måler man effektiviteten af AI-styring?

Effektivitet måles ved reduktionen i "Shadow AI"-hændelser, hastigheden af godkendelse af nye sikre værktøjer og antallet af forhindrede datalækager. Succesfuld styring bør også spores ved hjælp af brugeradoptionsrater; hvis medarbejdere omgår kontroller for at udføre deres arbejde, skal styringsstrategien justeres.