Las herramientas de control de uso de IA proporcionan la capa de gobernanza esencial que las empresas necesitan para adoptar la IA generativa de forma segura. Estas soluciones monitorizan las interacciones de los empleados, aplican políticas de datos en tiempo real y evitan la filtración de información confidencial a modelos públicos como ChatGPT y Gemini.

¿Qué son las herramientas de control del uso de IA y por qué son importantes?

Las herramientas de Control de Uso de IA (AIUC) son plataformas de seguridad especializadas que gestionan la interacción entre los usuarios empresariales y las aplicaciones de IA Generativa. A diferencia de los firewalls o DLP tradicionales, que se centran en las transferencias de archivos y los perímetros de red, las soluciones AIUC inspeccionan el contenido conversacional de las indicaciones y respuestas en tiempo real. Permiten a las organizaciones definir políticas basadas en la intención, como permitir que los equipos de marketing utilicen IA para la generación de copias e impedir que los equipos de ingeniería incorporen código propietario en la misma herramienta.

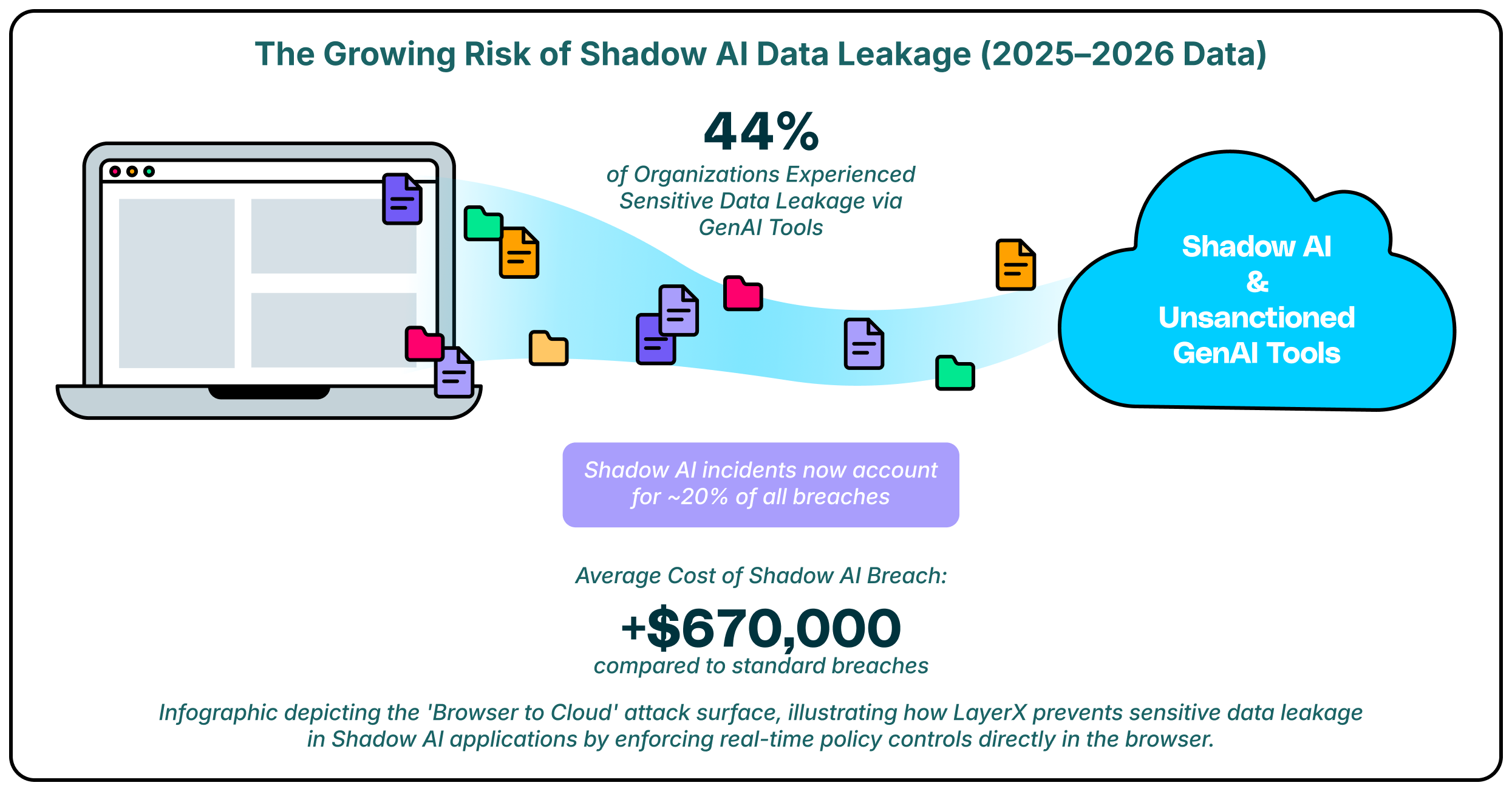

Esta categoría se ha vuelto esencial a medida que se expande la superficie de ataque del navegador a la nube. Cada vez más, los empleados eluden las redes corporativas para acceder a las herramientas de IA directamente a través de navegadores web, lo que crea puntos ciegos para las soluciones de seguridad tradicionales. Al reforzar la seguridad a nivel de navegador e identidad, estas herramientas mitigan los riesgos relacionados con la IA en la sombra, la incitación adversaria y el intercambio no autorizado de datos sin requerir una prohibición general que frene la innovación.

Tendencias clave en el control del uso de la IA que debemos tener en cuenta en 2026

Un cambio importante en 2026 es la transición hacia una gobernanza centrada en la identidad. Los líderes de seguridad se están dando cuenta de que bloquear las URL de IA es ineficaz y que el contexto importa más que el simple control de acceso. Las principales estrategias ahora se centran en comprender quién interactúa con qué datos, lo que permite a las organizaciones aplicar políticas granulares que se adaptan al rol del usuario. Esto garantiza que un director financiero y un desarrollador de software se enfrenten a medidas de seguridad diferentes y adecuadas al usar la misma herramienta de IA.

Otra tendencia dominante es la consolidación de controles dentro del navegador empresarial. Dado que la mayor parte de la interacción con la IA se realiza a través de interfaces web, el navegador se ha convertido en el punto más eficaz para la implementación de última milla. Las herramientas que pueden inspeccionar el Modelo de Objetos del Documento (DOM) en tiempo real están reemplazando a los proxies basados en red, ya que ofrecen una mayor visibilidad del contenido que se pega o genera. Esto permite detectar riesgos dinámicos, como los ataques de inyección rápida, que los inspectores de red suelen pasar por alto debido al cifrado o la ofuscación.

Estas plataformas ofrecen diversos enfoques para asegurar la adopción de IA, desde extensiones basadas en navegador hasta capas de gobernanza impulsadas por API.

| Solución: | Capacidades Clave | Ideal para |

| LayerX | Aplicación basada en navegador, descubrimiento de Shadow AI | DLP de última milla y acceso seguro |

| Islandia | Reemplazo del navegador empresarial, autoprotección | Entornos controlados y gestionados |

| Palo Alto Networks | Integración de SASE, inteligencia artificial de precisión | Clientes existentes de Palo Alto |

| Seguridad armónica | Protección de datos “Zero Touch”, IA en la sombra | Equipos centrados en la innovación |

| Seguridad inmediata | Defensa contra inyección rápida, visibilidad de Shadow AI | Asegurar las entradas y salidas de la IA |

| Seguridad AIM | Inventario GenAI, AI-SPM | Los CISO necesitan una amplia visibilidad |

| Seguridad Lasso | Control de acceso basado en contexto, seguridad RAG | Marcos LLM y RAG |

| IA de Nightfall | DLP con tecnología de IA, remediación en tiempo real | Enmascaramiento y remediación de datos |

| Testigo de IA | Análisis de riesgos regulatorios, amenazas internas | Sectores con un alto nivel de cumplimiento |

| Seguridad Menlo | Navegador seguro en la nube, control de copiar y pegar | Usuarios de aislamiento remoto del navegador (RBI) |

| Seguridad Seráfica | Prevención de exploits, DLP en el navegador | Cómo detener los exploits del navegador |

1. Capa X

LayerX ofrece un enfoque centrado en el navegador para el control del uso de IA, colocando amplias capacidades de visibilidad y cumplimiento directamente donde los usuarios interactúan con las herramientas de IA. Funciona como una extensión del navegador empresarial que supervisa cada evento de la sesión, lo que le permite distinguir entre consultas seguras y acciones de riesgo, como pegar código fuente o subir archivos confidenciales. Este control granular permite a las organizaciones autorizar herramientas que mejoran la productividad, a la vez que prohíbe estrictamente la exfiltración de datos.

Más allá del simple bloqueo, LayerX proporciona un descubrimiento exhaustivo del uso de IA en la sombra en la plantilla. Identifica cada aplicación de IA a la que se accede, independientemente de si se trata de una herramienta autorizada por la empresa o de una cuenta personal, y aplica políticas de seguridad uniformes en todas ellas. Esta capacidad garantiza que la protección de datos se transmita al usuario, acortando eficazmente la distancia entre los estrictos estándares de cumplimiento interno y la fluidez de la adopción de la IA web.

2. Islandia

Island reinventa el navegador como el principal punto de control de seguridad, ofreciendo un "Navegador Empresarial" dedicado que reemplaza los navegadores estándar para consumidores como Chrome o Edge. Este entorno controlado permite a los equipos de TI integrar políticas de seguridad directamente en la experiencia de navegación, incluyendo restricciones para copiar y pegar datos en chatbots de IA. Proporciona un contenedor de alta seguridad para trabajo confidencial, garantizando que ningún dato pueda salir del entorno administrado sin autorización.

Para el uso específico de IA, Island ofrece funciones integradas de prevención de pérdida de datos que pueden ocultar información confidencial antes de que llegue a un modelo externo. La arquitectura del navegador proporciona visibilidad completa de las acciones del usuario, lo que permite registros de auditoría que detallan con precisión qué se compartió con las plataformas de IA. Este nivel de control es ideal para organizaciones que pueden exigir el uso de un navegador específico para todo el trabajo corporativo.

3. Palo Alto Networks (Navegador de acceso Prisma)

El navegador Prisma Access de Palo Alto Networks integra la navegación segura directamente en su arquitectura SASE. Utiliza IA de precisión para detectar y bloquear amenazas en tiempo real, aprovechando el enorme conjunto de datos de inteligencia de amenazas de la compañía. Para el uso de IA, ofrece controles de políticas que pueden identificar y bloquear transferencias de datos confidenciales a aplicaciones GenAI, garantizando así que los usuarios cumplan con los estándares de datos corporativos.

Esta solución está diseñada para integrarse a la perfección con la infraestructura de seguridad existente de Palo Alto, proporcionando una visión unificada de las amenazas en la red y el navegador. Simplifica la gestión de políticas para los equipos que ya utilizan Prisma Access, permitiéndoles ampliar sus normas de protección de datos para cubrir los nuevos riesgos que presentan las herramientas de IA web. El navegador actúa como un punto de control perimetral que se adapta a los rápidos cambios en el panorama de la IA.

4. Seguridad armónica

Harmonic Security prioriza un enfoque de "cero intervención" para la protección de datos, con el objetivo de asegurar la adopción de la IA sin una configuración excesiva. La plataforma se centra en clasificar las aplicaciones de IA según su riesgo y valor, ayudando a las organizaciones a distinguir entre herramientas de productividad inofensivas y fugas de datos peligrosas. Su objetivo es facilitar la adopción segura de la IA, en lugar de simplemente bloquearla.

La herramienta proporciona una visibilidad profunda de los datos que llegan a los proveedores de IA, lo que permite a los equipos detectar tendencias de adopción de alto valor. Harmonic utiliza modelos de riesgo prediseñados para automatizar el proceso de aprobación de nuevas herramientas, reduciendo la carga de trabajo de los analistas de seguridad. Esta estrategia resulta atractiva para las empresas que desean fomentar la innovación y, al mismo tiempo, mantener una red de seguridad para los datos críticos.

5. Seguridad inmediata

Prompt Security se centra en proteger las entradas y salidas de los sistemas de IA generativa para evitar la fuga y manipulación de datos. Su plataforma inspecciona las indicaciones en tiempo real para detectar intentos de jailbreaking o inyección de indicaciones, garantizando así el correcto funcionamiento de los modelos de IA. Proporciona una capa de defensa crucial para los empleados que utilizan herramientas como ChatGPT, eliminando la información de identificación personal (PII) confidencial de las consultas antes de que se envíen a la nube.

La solución también ofrece visibilidad de la IA en la sombra al supervisar las interacciones de los empleados con herramientas externas. Permite a las organizaciones implementar un uso "saneado", donde los empleados pueden beneficiarse de la asistencia de la IA sin exponer la propiedad intelectual de la empresa. Proteger el flujo de datos desde el principio ayuda a las organizaciones a mantener la privacidad sin necesidad de construir una infraestructura compleja y personalizada.

6. Seguridad AIM

AIM Security ofrece una plataforma especializada diseñada para ayudar a los CISO a crear un inventario completo del uso de GenAI en la empresa. Se centra en la "Gestión de la Postura de Seguridad de la IA" (AI-SPM), ofreciendo una visión clara de las herramientas que se utilizan y los riesgos potenciales asociados. Esta visibilidad es esencial para las organizaciones que tienen dificultades para cuantificar el alcance de su problema de IA en la sombra.

La plataforma emplea un enfoque de "cortafuegos de IA" para gestionar las interacciones con modelos públicos y privados. Puede detectar y bloquear ataques de inyección rápida e impedir el envío de datos confidenciales a modelos no autorizados. El enfoque de AIM en las vulnerabilidades específicas de los LLM la convierte en una excelente opción para equipos de seguridad que necesitan información profunda y especializada sobre su pila de IA generativa.

7. Seguridad de Lasso

Lasso Security introduce el Control de Acceso Basado en el Contexto (CBAC) en el panorama de gobernanza de la IA, específicamente orientado a las necesidades de las implementaciones LLM y RAG (Recuperación-Generación Aumentada). Este método evalúa dinámicamente las solicitudes de acceso según la identidad, el comportamiento y el tipo de datos del usuario, garantizando interacciones seguras y conformes. Es especialmente eficaz para organizaciones que desarrollan sus propias aplicaciones internas de IA que requieren límites de datos estrictos.

La solución se integra con diversos entornos GenAI para supervisar las transferencias de datos y detectar anomalías en tiempo real. Lasso protege contra nuevas amenazas, como la manipulación de modelos y el envenenamiento de datos, que cobran mayor relevancia a medida que las empresas perfeccionan sus propios modelos. Su énfasis en el contexto permite una aplicación de políticas más flexible y precisa que el simple bloqueo de palabras clave.

8. IA de Nightfall

Nightfall AI aprovecha su consolidada experiencia en prevención de pérdida de datos (DLP) para abordar el control del uso de la IA. Su plataforma utiliza detectores de aprendizaje automático entrenados con 125 millones de parámetros para identificar información de identificación personal (PII), PCI y secretos con gran precisión. Para el uso de la IA, Nightfall proporciona remediación en tiempo real, enmascarando automáticamente los datos confidenciales en las indicaciones (como ChatGPT) antes de que salgan del navegador o la API.

Este enfoque de "redacción prioritaria" permite a los empleados seguir usando las herramientas de IA sin interrupciones, ya que solo se eliminan los datos confidenciales, mientras que el resto del mensaje permanece funcional. El enfoque de Nightfall en la detección contextual ayuda a reducir los falsos positivos, un problema común en los sistemas DLP tradicionales aplicados a la IA conversacional.

9. Testigo de la IA

Witness AI se centra en el cumplimiento normativo y los aspectos regulatorios del uso de la IA, lo que la hace ideal para sectores altamente regulados como el financiero y el sanitario. La plataforma proporciona análisis sobre el riesgo conductual y la exposición regulatoria, lo que ayuda a las organizaciones a comparar su uso de la IA con las políticas internas. Está diseñada para detectar amenazas internas mediante el análisis de patrones de conversación a lo largo del tiempo.

La solución crea un registro de auditoría especializado para las interacciones de IA, esencial para demostrar el cumplimiento normativo durante las auditorías. Al centrarse en el uso seguro, Witness AI ayuda a las organizaciones a gestionar la compleja intersección entre la rápida adopción tecnológica y los estrictos mandatos internos. Proporciona la supervisión necesaria para garantizar que las estrategias de IA no infrinjan las normas de gobernanza de datos.

10. Seguridad de Menlo

Menlo Security aprovecha su tecnología de Aislamiento Remoto del Navegador (RBI) para crear una barrera segura entre los usuarios y las aplicaciones GenAI. Su solución "Menlo para GenAI" ofrece controles granulares de copia y pegado, lo que garantiza que los usuarios no puedan introducir código confidencial ni información personal identificable (PII) en las interfaces del chatbot. Este enfoque trata la aplicación de IA como un destino no confiable, aislando la interacción para evitar la pérdida de datos.

Además del aislamiento, Menlo ofrece análisis forense de navegación para registrar con precisión qué datos se comparten con las plataformas de IA. Esta visibilidad ayuda a los equipos de seguridad a auditar los patrones de uso y a garantizar el cumplimiento normativo sin necesidad de implementar agentes en cada endpoint. Es ideal para organizaciones que ya dependen del aislamiento para la seguridad web.

11. Seguridad Seráfica

Seraphic Security ofrece una plataforma de seguridad empresarial para navegadores compatible con cualquier navegador estándar, centrándose en la prevención de exploits y la protección en tiempo de ejecución. Sus funciones de "DLP en el navegador" monitorizan las interacciones del usuario con herramientas de IA, bloqueando el intercambio de datos confidenciales en tiempo real. La tecnología de Seraphic inyecta una capa de seguridad en la sesión del navegador para controlar la ejecución de JavaScript, lo que ayuda a prevenir ataques avanzados dirigidos al propio navegador.

La solución ofrece una visibilidad completa del uso de la IA por parte de los empleados, registrando avisos y respuestas para garantizar el cumplimiento de las políticas de gobernanza de datos. Al detener los ataques a nivel del motor del navegador, Seraphic protege contra amenazas sofisticadas que podrían intentar eludir los métodos de detección tradicionales. Está diseñada para ser ligera y compatible con los flujos de trabajo empresariales existentes.

Cómo elegir el mejor proveedor de control de uso de IA

- Evalúe si la solución ofrece visibilidad a nivel de navegador para detectar el uso de Shadow AI que los servidores proxy de red podrían pasar por alto debido al cifrado.

- Busque políticas que tengan en cuenta la identidad y que le permitan variar las reglas de acceso según el rol del usuario y el contexto de datos específico.

- Evalúe el modelo de implementación para asegurarse de que se ajuste a su infraestructura, ya sea una extensión de navegador liviana o un reemplazo completo del navegador.

- Verifique que la herramienta pueda detectar y bloquear amenazas adversas como inyección rápida y jailbreak en tiempo real.

- Verifique las capacidades de integración con sus sistemas SIEM e IdP existentes para garantizar un flujo de trabajo de seguridad unificado.

Preguntas Frecuentes

¿Cuál es la diferencia entre el control de uso de IA y el DLP tradicional?

El DLP tradicional suele estar diseñado para la protección basada en archivos y carece del contexto necesario para comprender las indicaciones conversacionales de la IA. Las herramientas de control de uso de IA están diseñadas específicamente para analizar la intención y el contenido de las interacciones con los LLM, lo que les permite bloquear acciones de riesgo específicas, como pegar código, sin bloquear toda la aplicación.

¿Pueden estas herramientas descubrir aplicaciones de “IA en la sombra”?

Sí, la mayoría de las plataformas de control de uso de IA incluyen funciones de descubrimiento que registran todas las aplicaciones de IA a las que acceden los empleados. Ofrecen paneles que muestran qué herramientas se utilizan, con qué frecuencia y quién las utiliza, lo que permite a los equipos de seguridad identificar aplicaciones no autorizadas que puedan suponer un riesgo.

¿Necesito un navegador especial para utilizar estas herramientas?

No necesariamente. Mientras que algunas soluciones como Island y Palo Alto Networks requieren un navegador empresarial dedicado, otras como LayerX y Reco funcionan como extensiones o integraciones de API compatibles con sus navegadores estándar (Chrome, Edge) y entornos SaaS.

¿Cómo manejan estas herramientas el tráfico cifrado?

Las soluciones basadas en navegador, como LayerX e Island, pueden inspeccionar los datos dentro del navegador antes de cifrarlos y enviarlos por la red. Esto les permite ver el contenido completo de las indicaciones y respuestas, proporcionando una visibilidad que las herramientas basadas en red suelen carecer.

¿Son necesarias estas soluciones si tenemos una política de “no IA”?

Sí, porque una política de "no IA" es difícil de implementar sin controles técnicos. Los empleados suelen usar dispositivos personales o buscan soluciones alternativas para acceder a herramientas de IA útiles. El Control de Uso de IA proporciona la visibilidad necesaria para verificar el cumplimiento y los medios técnicos para aplicar la política eficazmente.