La tecnologia dell'intelligenza artificiale è passata dall'essere un giocattolo sperimentale a un elemento fondamentale del mondo del lavoro in meno di tre anni. Questo lo sapevamo tutti. Ciò che nessuno si aspettava era la rapidità con cui avrebbe superato le categorie SaaS tradizionali, non solo in termini di adozione, ma anche di rischio.

Il nostro nuovo Rapporto sulla sicurezza dei dati SaaS e AI aziendale 2025, basato sulla telemetria di navigazione reale dei clienti aziendali di LayerX, mostra qualcosa di sorprendente: l'intelligenza artificiale non è più una tecnologia "emergente". È ormai il principale punto cieco per l'esfiltrazione dei dati nelle aziende moderne.

A differenza della posta elettronica o della condivisione di file, dove i team di sicurezza hanno costruito anni di governance, la maggior parte dell'utilizzo dell'intelligenza artificiale avviene nell'ombra, al di fuori dell'SSO, della visibilità e del controllo aziendale.

L'adozione dell'intelligenza artificiale a una velocità vertiginosa

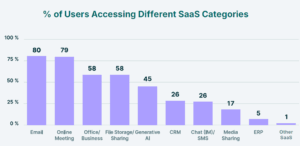

Partiamo dal titolo: il 45% dei dipendenti aziendali utilizza già strumenti di intelligenza artificiale generativa. Si tratta di quasi la metà della forza lavoro, in meno di tre anni dalla comparsa di questi strumenti. A titolo di confronto, categorie SaaS come la condivisione di file o le videoconferenze hanno impiegato oltre un decennio per raggiungere una penetrazione simile.

Ancora più sorprendente: il 92% dell'utilizzo dell'intelligenza artificiale in ambito aziendale è concentrato in un unico strumento: ChatGPT. Questo la rende non solo la categoria in più rapida crescita, ma anche quella con la maggiore concentrazione. Un'unica piattaforma rivolta al consumatore è diventata di fatto lo standard di intelligenza artificiale aziendale.

Di per sé, l'adozione su questa scala non è una sorpresa. Lo shock arriva quando si guarda come i dipendenti lo stanno utilizzando.

Il sorprendente percorso dei dati: copia/incolla, non caricamenti

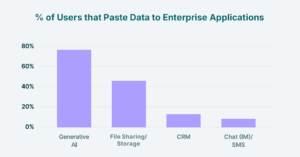

La maggior parte dei CISO si preoccupa del caricamento dei file. E per una buona ragione: Il 40% dei file caricati sugli strumenti GenAI contiene dati PII o PCI sensibili. Si tratta di quasi la metà di tutti i caricamenti.

Ma il vero shock è altrove. I nostri dati mostrano che la maggior parte dei dati sensibili non esce dall'azienda tramite upload. Esce tramite copia / incolla.

- Il 77% dei dipendenti incolla i dati nei prompt GenAI

- L'82% di queste paste provengono da resoconti personali

- In media, i dipendenti effettuano 14 incollaggi al giorno su account non aziendali e almeno 3 di queste attività di incollaggio contengono dati sensibili

Questo trasforma la semplice clipboard, un canale spesso trascurato, privo di file e non strutturato, nel vettore numero uno per l'esfiltrazione di dati sensibili. Gli strumenti di GenAI da soli rappresentano il 32% di tutti i trasferimenti di dati da azienda a persona.

Gli strumenti DLP tradizionali, basati sul monitoraggio incentrato sui file, non registrano nemmeno questa attività. Il che significa che le aziende non solo sono indietro nella governance dell'IA, ma sono anche cieche.

Gli account personali sono quelli che comandano

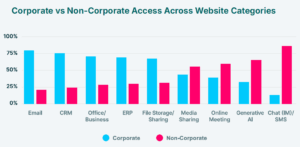

Le aziende hanno investito milioni in sicurezza delle identità, federazione e SSO. Eppure, secondo i nostri dati, questi controlli sfiorano appena la categoria dell'intelligenza artificiale.

- Il 67% dell'utilizzo dell'intelligenza artificiale avviene tramite account personali non gestiti

- Il 71% degli accessi CRM e l'83% degli accessi ERP non sono federati

- Anche gli account “aziendali” sono spesso protetti solo da password, il che li rende funzionalmente indistinguibili dagli accessi personali

La morale della favola? Aziendale ≠ sicuro. I sistemi che ospitano i dati finanziari e dei clienti più sensibili, come CRM, ERP e ora l'intelligenza artificiale, vengono utilizzati come se fossero app consumer. I controlli di identità esistono, ma i dipendenti semplicemente li aggirano.

Governance: introvabile

La scoperta più controintuitiva della nostra ricerca è questa: più l'intelligenza artificiale è integrata nei flussi di lavoro aziendali, minore è la governance che la circonda.

I dipendenti incollano dati sensibili nei prompt. Caricano file in account di tipo consumer. Accedono con identità non gestite. E tutto questo avviene al di fuori di ogni controllo autorizzato.

A differenza della posta elettronica, dove decenni di DLP, archiviazione e federazione hanno creato almeno una qualche forma di barriera, l'intelligenza artificiale, al confronto, è il Far West.

Eppure, l’intelligenza artificiale non è più “emergente”. Essa rappresenta già 11% di tutta l'attività aziendale, in competizione con categorie che hanno definito la produttività aziendale per decenni. Le aziende stanno procedendo alla cieca nella loro categoria in più rapida crescita.

Cosa dovrebbero fare i CISO in futuro

Sulla base di questi dati, ecco le tre priorità più urgenti:

- Considerare l'intelligenza artificiale come una categoria aziendale di prima classe.

GenAI non è più un esperimento. ChatGPT da solo raggiunge il 43% di penetrazione aziendale, eguagliando l'adozione di Zoom in una frazione del tempo. Con il 45% dei dipendenti che utilizza attivamente strumenti di intelligenza artificiale e l'intelligenza artificiale che rappresenta l'11% di tutta l'attività di navigazione aziendale, GenAI deve ora essere gestita con lo stesso rigore dei sistemi di posta elettronica e di condivisione file. La fase sperimentale è terminata. Merita la stessa governance e gli stessi controlli della posta elettronica o dell'archiviazione file, con monitoraggio sia per i caricamenti che per le azioni senza file come il copia/incolla. - Tratta gli accessi aziendali non federati come Active Shadow IT

La ricerca rivela che anche quando i dipendenti utilizzano credenziali aziendali per app critiche come ERP (83% non SSO) e CRM (71% non SSO), la mancanza di federazione SSO rende questi accessi funzionalmente identici agli account personali non gestiti. Quindi, invece di dare priorità all'SSO solo per le nuove app SaaS, riclassificare immediatamente tutti gli account non federati nei sistemi critici come IT ombra non gestitoL'azione immediata dovrebbe essere quella di eseguire un audit incentrato specificamente sui sistemi ERP e CRM per identificare tutti i punti di accesso non federati. Trattate la correzione di queste lacune con la stessa urgenza di un server esposto al pubblico, poiché rappresentano un percorso invisibile e incontrollato per l'accesso e l'esfiltrazione dei dati. - Implementare politiche basate sui dati invece di bloccare l'accesso agli account personali

Una parte significativa dei caricamenti e degli incollamenti su strumenti GenAI (67% account personali) e IM (87% account personali) avviene tramite account non aziendali. Bloccare semplicemente l'accesso a questi servizi è spesso poco pratico e porta a un'intrusione informatica (shadow IT). Pertanto, è necessario passare da una posizione binaria "blocca/consenti" a una politica incentrata sui dati e consapevole del contestoConsenti ai dipendenti di accedere a istanze personali di ChatGPT, Google Drive o WhatsApp Web, ma distribuisci controlli a livello di browser che specificatamente impedire che dati aziendali sensibili (identificati dai classificatori) vengano incollati o caricati al loro internoQuesto approccio riconosce la realtà dei flussi di lavoro moderni, creando al contempo un confine di sicurezza cruciale attorno ai dati stessi, non all'applicazione. - Spostare i budget DLP dall'analisi di rete/file al controllo Incolla a livello di browser:I risultati mostrano che la funzione copia/incolla ha superato il caricamento dei file come canale primario di esfiltrazione dei dati, con il 77% dei dipendenti che incolla i dati negli strumenti GenAI e il 62% degli incollamenti in app di messaggistica istantanea contenenti PII/PCI. Le tradizionali soluzioni DLP basate sulla rete non sono in grado di rilevare questo spostamento di dati senza file. Di conseguenza, le organizzazioni dovrebbero modificare la propria strategia di protezione dei dati e l'allocazione del budget, allontanandosi dal monitoraggio incentrato sui file. Dare priorità all'implementazione di soluzioni di sicurezza native del browser o browser aziendali sicuri in grado di ispezionare, classificare e bloccare dati sensibili all'interno di eventi di copia/incolla prima viene inviato a un modulo web, a un prompt di intelligenza artificiale o a una finestra di chat. La chiave è controllare i dati nel punto di azione, ovvero il browser, non solo i dati in transito.

Perché i dati LayerX sono diversi

Mentre altri rapporti sull'adozione dell'IA si basano su sondaggi o dati auto-riportati, il nostro si basa su telemetria diretta del browser dagli stessi utenti aziendali. Ciò significa niente supposizioni, solo visibilità sulle attività del mondo reale attraverso app autorizzate, non autorizzate e shadow.

Questo punto di osservazione unico rivela ciò che i sondaggi non possono rivelare: che il copia/incolla, non il caricamento, è il canale di esfiltrazione principale; che gli account personali dominano anche i flussi di lavoro aziendali critici; e che l'intelligenza artificiale non è solo un rischio all'orizzonte, ma è il rischio che si sta verificando proprio ora.

Conclusione

I CISO hanno dedicato anni a sviluppare la governance di e-mail, archiviazione file e SaaS sanzionato. Nel frattempo, l'intelligenza artificiale è diventata la categoria aziendale in più rapida crescita, con quasi la metà dei dipendenti che la utilizza quotidianamente. E quasi nessuna di queste soluzioni è sicura.

Questo è il paradosso che i nostri dati svelano: più l'intelligenza artificiale diventa indispensabile, meno controllo ha.

Gli appunti sono ormai la nuova frontiera delle fughe di dati aziendali. ChatGPT è diventato di fatto lo standard aziendale per l'intelligenza artificiale. E gli account non gestiti stanno silenziosamente riscrivendo le regole dell'identità.

La sfida per i responsabili della sicurezza non è se governare o meno l'IA, ma quanto velocemente riusciranno a tenerla sotto controllo, prima che il flusso invisibile di dati si trasformi in un'inondazione.

Scarica il rapporto completo per scoprire l'intera portata dei rischi legati ai dati dell'IA e del SaaS.