Nell'economia digitale, i dati sono il nuovo petrolio. Ma cosa succede quando questo petrolio viene sottratto a tua insaputa? Esplora la crescente minaccia del data scraping basato sull'intelligenza artificiale, in cui agenti automatizzati estraggono informazioni sensibili o proprietarie da siti web, API o piattaforme senza consenso. Delinea i rischi per la privacy, la proprietà intellettuale e il vantaggio competitivo, insieme alle strategie per il rilevamento e la prevenzione. Il furto silenzioso e sofisticato orchestrato da tecniche avanzate di scraping basate sull'intelligenza artificiale rappresenta una minaccia significativa e crescente per le aziende di tutto il mondo. Non si tratta dell'attività goffa e facilmente bloccabile dei bot del passato. La minaccia odierna è un agente automatizzato intelligente, in grado di imitare il comportamento umano con una precisione agghiacciante per rubare le tue risorse digitali più preziose.

Questi attacchi vanno oltre la semplice raccolta di dati. Mirano al nucleo stesso del vantaggio competitivo di un'azienda, dai modelli di prezzo e dagli elenchi clienti al codice proprietario e ai piani strategici. Poiché le organizzazioni dipendono sempre più da applicazioni web e piattaforme SaaS, il browser è diventato il palcoscenico principale per queste operazioni segrete. Comprendere i meccanismi dello scraping basato sull'intelligenza artificiale è il primo passo verso la costruzione di una difesa resiliente.

Dalla forza bruta alla finezza: l'evoluzione dello scraping dei dati

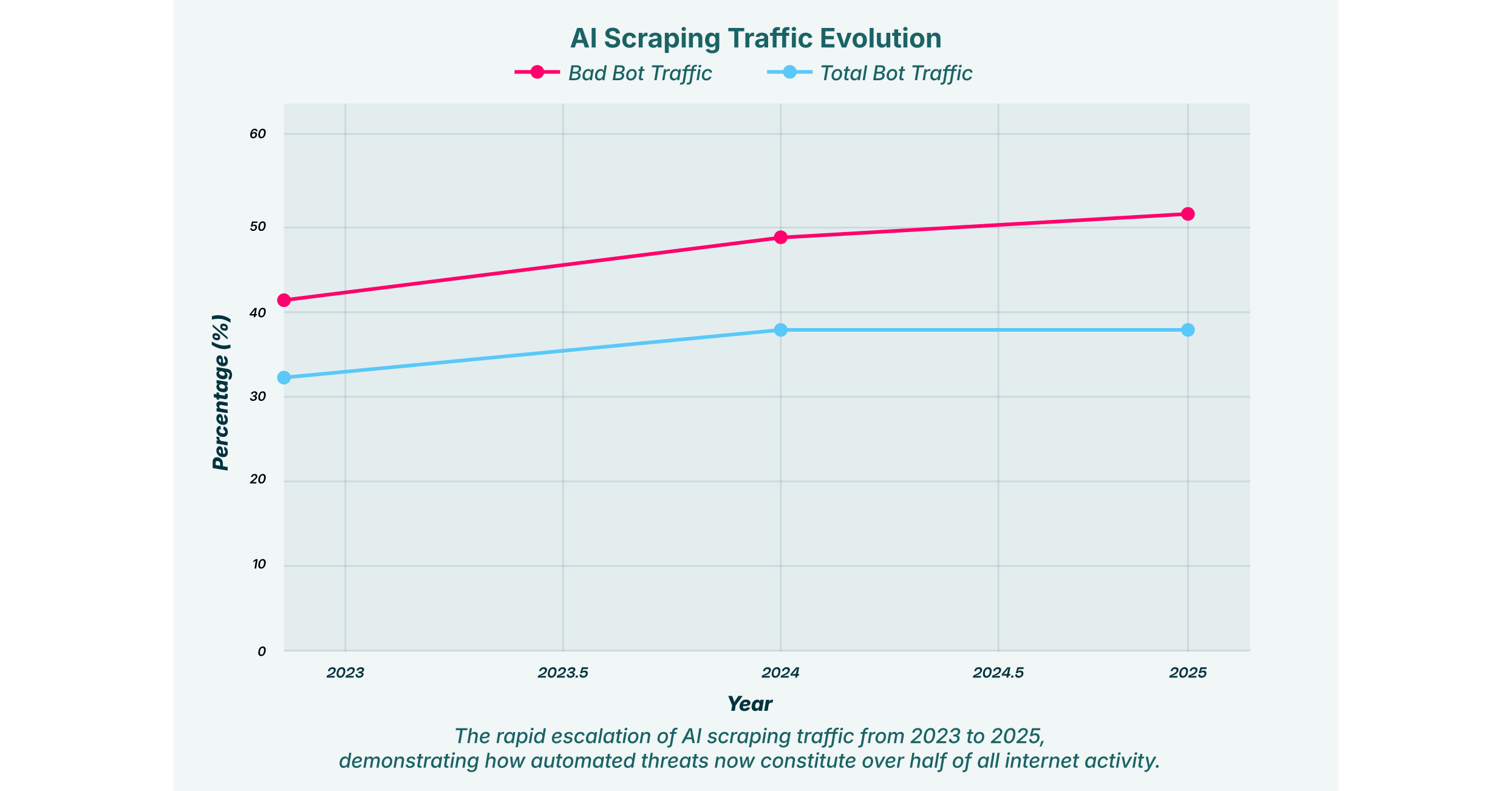

Il web scraping tradizionale era spesso un gioco di numeri. Gli aggressori utilizzavano semplici script da un singolo indirizzo IP per bombardare un sito web di richieste, impossessandosi di tutti i dati pubblici che riuscivano a trovare. Questi bot erano rumorosi e seguivano schemi prevedibili, il che li rendeva relativamente facili da identificare e bloccare tramite limiti di velocità o blacklist di IP. I team di sicurezza potevano resistere con le difese perimetrali convenzionali.

Ora quel limite è stato superato.

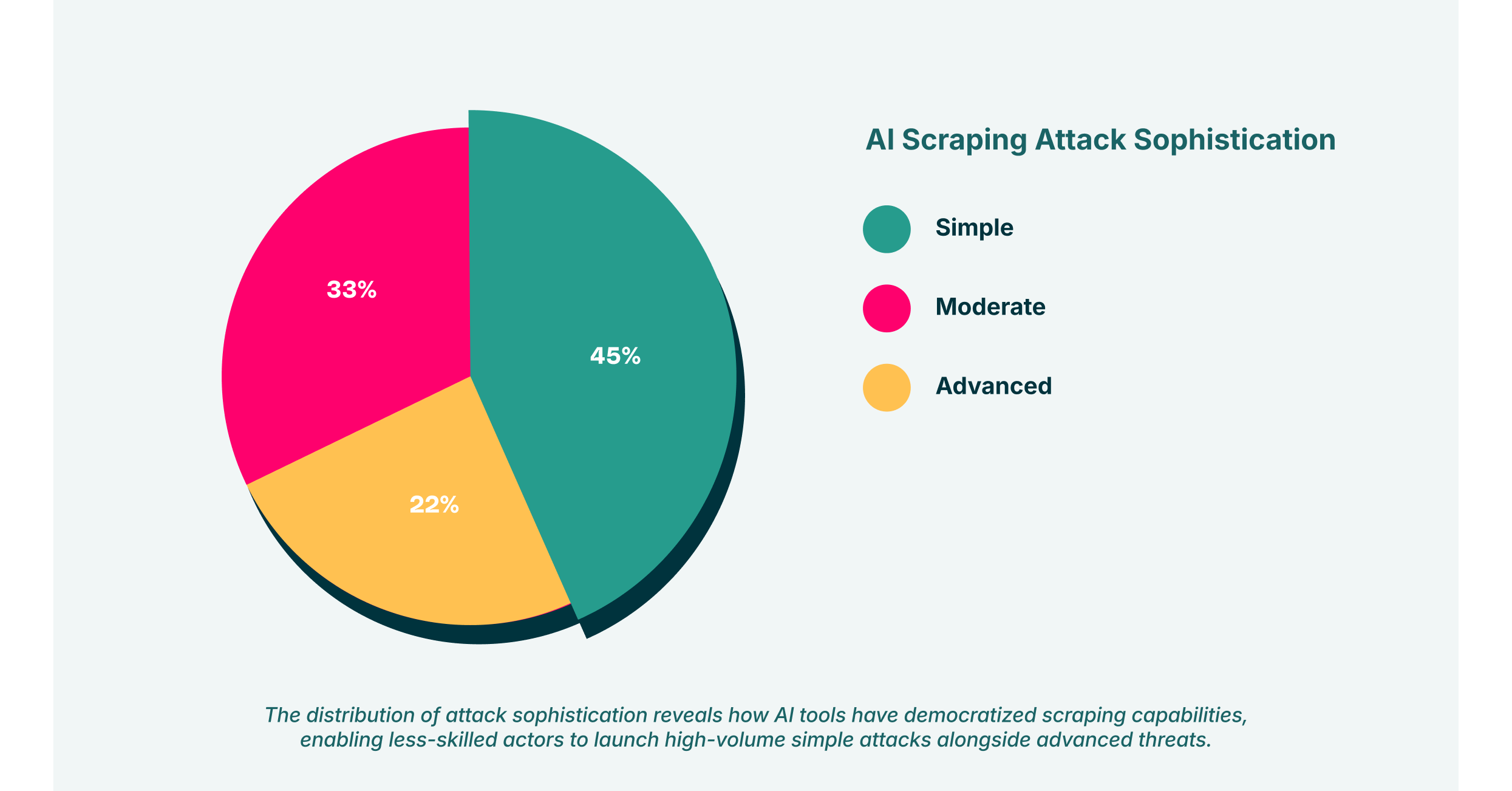

Lo scraping basato sull'intelligenza artificiale moderno opera a un diverso livello di sofisticazione. Questi scraper avanzati sono progettati per essere invisibili e persistenti, utilizzando l'apprendimento automatico per navigare in ambienti web complessi proprio come farebbe un essere umano. Possono:

- Adattamento dinamico: quando la struttura di un sito web cambia, uno scraper basato sull'intelligenza artificiale può adattarsi in tempo reale senza intervento umano, garantendo un flusso di dati ininterrotto.

- Imitazione del comportamento umano: questi agenti randomizzano i loro schemi di navigazione, simulano i movimenti del mouse e risolvono complessi CAPTCHA che un tempo rappresentavano lo standard di riferimento per il rilevamento dei bot. Si presentano come traffico utente legittimo, eludendo tutti i filtri di sicurezza tranne quelli più avanzati.

- Attacchi distribuiti: anziché provenire da un singolo IP, gli attacchi vengono distribuiti su vaste reti proxy residenziali, rendendo il blocco basato su IP completamente inefficace. Ogni richiesta sembra provenire da un utente diverso e autentico.

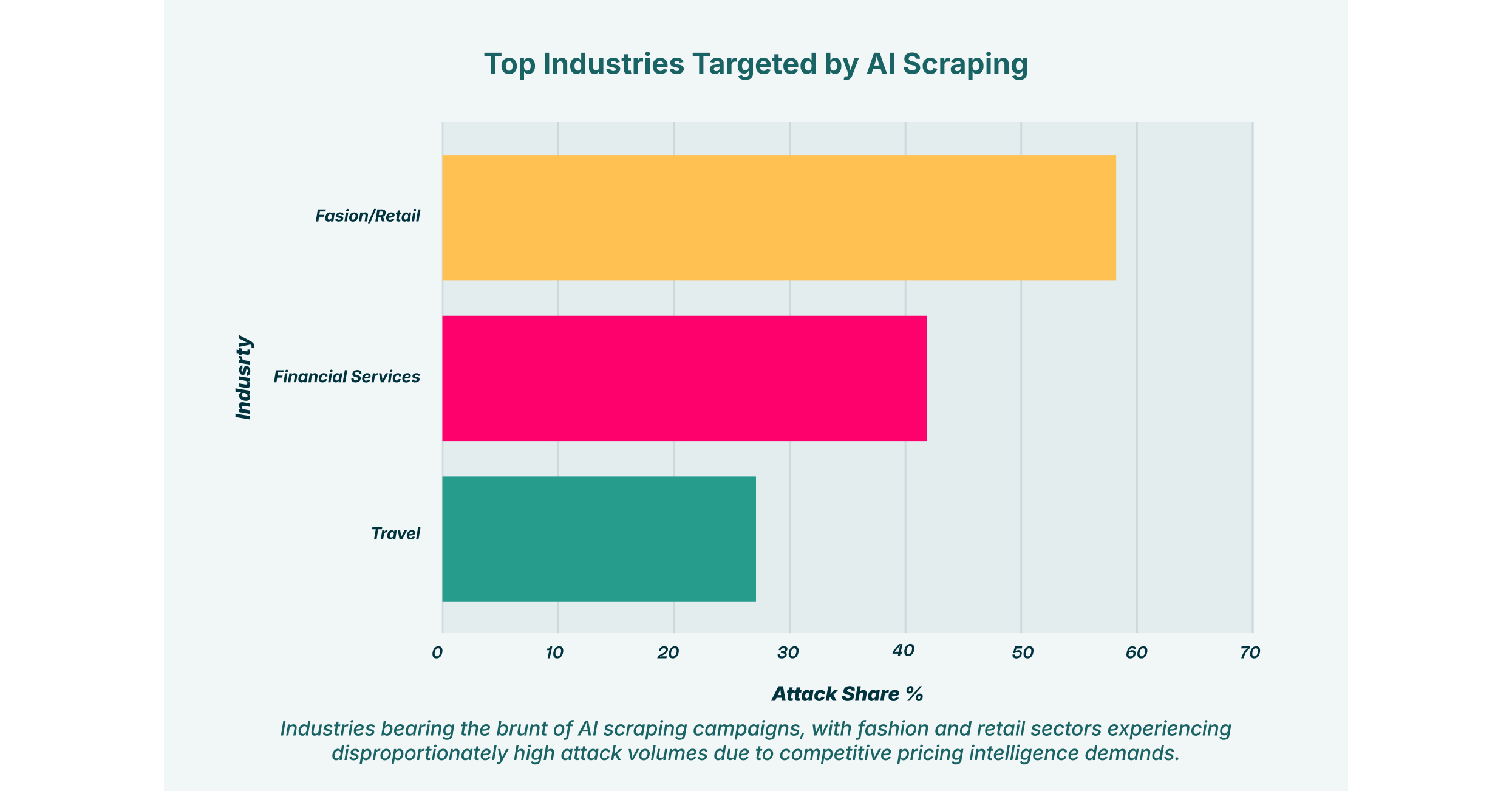

Immagina un concorrente che implementa un agente automatizzato per monitorare costantemente la tua piattaforma di e-commerce. Non si limita a rilevare i prezzi una volta al giorno. Impara i tuoi algoritmi di prezzo dinamico, identifica i tuoi prodotti più popolari monitorando le metriche di coinvolgimento degli utenti e persino estrae le recensioni dei clienti per analizzarne il sentiment. La proprietà intellettuale alla base della tua strategia di mercato viene sottoposta a reverse engineering e utilizzata contro di te, il tutto senza che il minimo campanello d'allarme suoni.

Le conseguenze di una campagna di scraping dell'IA di successo vanno ben oltre la perdita di un vantaggio competitivo. I danni operativi, finanziari e reputazionali possono essere catastrofici e interessare ogni aspetto dell'azienda. I rischi principali si concentrano sul furto di due tipologie di asset critici: proprietà intellettuale e dati sensibili.

L'erosione della proprietà intellettuale

Per molte aziende, la proprietà intellettuale è il bene più prezioso. Questo include tutto, dal codice sorgente e dalla progettazione dei prodotti alle strategie di marketing e alle basi di conoscenza interne. L'AI scraping rappresenta una minaccia diretta a questo patrimonio. Consideriamo questi scenari:

- Replica della piattaforma SaaS: un'azienda concorrente può utilizzare un agente automatizzato per mappare sistematicamente l'intera applicazione SaaS. Analizzando set di funzionalità, elementi dell'interfaccia utente e logica del flusso di lavoro, l'azienda può sviluppare rapidamente un prodotto concorrente, annullando il vantaggio di essere il primo a entrare sul mercato e la differenziazione sul mercato.

- Sabotaggio di contenuti e SEO: i media digitali e le aziende basate sui contenuti sono particolarmente vulnerabili. Gli scraper possono rubare intere librerie di articoli, immagini e video, ripubblicandoli su siti di spam. Questo non solo costituisce un furto, ma può anche danneggiare gravemente il posizionamento sui motori di ricerca creando problemi di contenuti duplicati.

- Furto di algoritmi proprietari: le aziende che si affidano ad algoritmi esclusivi, come le società di trading finanziario, le aziende di logistica o i motori di raccomandazione, sono obiettivi primari. Un agente automatizzato può immettere migliaia di punti dati e analizzarne gli output per effettuare il reverse engineering del modello sottostante, rubando di fatto la "salsa segreta" dell'azienda.

Questa incessante erosione della proprietà intellettuale è un killer silenzioso che prosciuga lentamente la capacità innovativa e la posizione di mercato di un'azienda.

L'esfiltrazione di dati sensibili

Mentre alcuni scraper prendono di mira la logica aziendale proprietaria, altri puntano a un obiettivo più direttamente monetizzabile: i dati sensibili. Interagendo con innumerevoli app web e servizi cloud tramite i loro browser, i dipendenti creano un'ampia superficie di attacco per l'esfiltrazione di dati. Un agente automatizzato, spesso distribuito tramite un'estensione del browser apparentemente innocua, può rimanere nascosto all'interno del browser di un utente, in attesa del momento perfetto per colpire.

È qui che la superficie di attacco dal browser al cloud diventa un punto cieco critico per la sicurezza. Un dipendente potrebbe accedere a un CRM aziendale, a un portale sanitario o a un sistema finanziario. L'agente, utilizzando le credenziali autenticate dell'utente, può quindi effettuare scraping ed esfiltrare sistematicamente:

- Informazioni di identificazione personale (PII): nomi, indirizzi, recapiti e numeri di identificazione governativi dei clienti.

- Dati finanziari: numeri di carte di credito, dettagli di conti bancari e registri finanziari aziendali.

- Informazioni sanitarie protette (PHI): cartelle cliniche dei pazienti e altri dati protetti da normative come l'HIPAA.

Una singola violazione di dati sensibili può comportare pesanti sanzioni normative, responsabilità legali e la completa perdita di fiducia dei clienti. Quando l'esfiltrazione viene eseguita da un agente automatizzato e furtivo, la violazione potrebbe non essere scoperta per mesi, aggravando il danno.

La nuova frontiera: lo scraping delle API GenAI

La recente esplosione dell'IA generativa ha aperto la strada a un nuovo e altamente specializzato vettore per l'estrazione di dati dannosi: lo scraping delle API GenAI. Le organizzazioni stanno integrando sempre più modelli linguistici di grandi dimensioni (LLM) nei loro flussi di lavoro e prodotti tramite API. Queste API, pur essendo potenti, rappresentano un nuovo e attraente bersaglio per gli aggressori più sofisticati.

Lo scraping delle API di GenAI non consiste nel rubare contenuti superficiali di un sito web. Si tratta di attaccare il modello di intelligenza artificiale stesso. Attraverso chiamate API accuratamente progettate, un agente automatizzato può:

- Furto di modelli proprietari: interrogando sistematicamente un modello GenAI addestrato su misura, gli aggressori possono dedurne l'architettura e i parametri, il che consente loro di replicare il modello per i propri scopi. Si tratta di un furto diretto di ingenti investimenti in ricerca e sviluppo.

- Estrazione dei dati di training: alcune tecniche di iniezione rapida possono indurre un modello a rivelare parti dei dati di training sottostanti. Se questi dati contengono dati sensibili o informazioni proprietarie, le conseguenze possono essere gravi.

- Output del modello di avvelenamento: agenti dannosi possono inondare un'API GenAI con dati distorti o dannosi, tentando di "avvelenare" il modello e degradare la qualità delle sue risposte per gli utenti legittimi.

Immaginate un'azienda sanitaria che ha addestrato un modello GenAI sui dati sensibili dei pazienti per assistere i medici nelle diagnosi. Un attacco di scraping dell'API GenAI riuscito potrebbe non solo esporre tali dati sensibili, ma anche compromettere l'integrità dello strumento diagnostico, mettendo a rischio la sicurezza dei pazienti.

Perché le difese tradizionali stanno fallendo

Come riescono a vincere questi attacchi sofisticati? La realtà è che gli strumenti di sicurezza tradizionali non sono stati concepiti per questa lotta. Le difese perimetrali come i Web Application Firewall (WAF) e i gateway API si basano principalmente sul rilevamento basato sulle firme e sull'analisi del traffico. Cercano pattern dannosi noti, richieste ad alto volume o indirizzi IP sospetti.

Un agente automatizzato avanzato elude facilmente questi controlli.

- Utilizza credenziali utente legittime, spesso dirottate tramite un'estensione del browser dannosa.

- Funziona a un ritmo "lento e lento", rendendo la sua attività indistinguibile dal normale comportamento dell'utente.

- Instrada il traffico attraverso proxy residenziali, quindi ogni richiesta sembra provenire da una fonte diversa e valida.

Questi agenti non attivano i classici allarmi perché operano da entro L'ambiente affidabile della sessione browser di un utente autenticato. Il perimetro di sicurezza si è di fatto spostato dal perimetro della rete al singolo browser e la maggior parte delle organizzazioni non ha alcuna visibilità o controllo significativi su questo livello critico.

La soluzione: rilevamento e risposta del browser

Per contrastare una minaccia che ha origine nel browser, anche la difesa deve risiedere nel browser. Questo è il principio alla base dell'estensione Enterprise Browser di LayerX. Invece di cercare di bloccare il traffico dannoso al gate di rete, LayerX offre una visibilità approfondita sulla sessione del browser stesso, analizzando il comportamento degli script e i flussi di dati in tempo reale per rilevare e neutralizzare le minacce che i WAF e altri strumenti di rete non riescono a rilevare.

Ecco come questo approccio contrasta direttamente la minaccia dello scraping dell'IA:

- Analisi comportamentale: LayerX non si basa su firme obsolete. Analizza il comportamento di ogni script in esecuzione nel browser. Quando un agente automatizzato inizia ad attraversare sistematicamente il DOM di un'applicazione web o tenta di esfiltrare dati, il suo comportamento si discosta dai normali schemi umani. LayerX rileva immediatamente questa attività anomala e può terminare lo script prima che eventuali dati sensibili vengano persi.

- Protezione per Shadow SaaS: i dipendenti utilizzano costantemente applicazioni SaaS non autorizzate (Shadow IT), creando un enorme punto cieco in termini di sicurezza. Poiché LayerX opera a livello di browser, protegge l'utente indipendentemente dal sito web visitato o dall'applicazione utilizzata. Può impedire a un agente di estrarre dati da un'istanza Salesforce aziendale con la stessa efficacia con cui lo fa da un account ChatGPT personale a cui si accede da un dispositivo aziendale. Ciò fornisce una protezione critica contro lo shadow IT.

- Prevenzione dell'esfiltrazione basata su GenAI: monitorando tutti i trasferimenti di dati provenienti dal browser, LayerX può identificare e bloccare i tentativi di inviare grandi volumi di dati sensibili a destinazioni non autorizzate, incluse le API delle piattaforme GenAI pubbliche. Ciò previene sia le fughe di dati accidentali che quelle dolose, proteggendo la proprietà intellettuale aziendale nell'era dell'intelligenza artificiale.

La battaglia contro lo scraping basato sull'intelligenza artificiale non si vincerà a livello di perimetro di rete. Si vincerà proteggendo il principale punto di interazione tra utenti e applicazioni: il browser. Spostando la sicurezza su questo endpoint critico, le organizzazioni potranno finalmente avere la meglio sulla nuova generazione di minacce intelligenti e automatizzate.