L'intelligenza artificiale generativa ha radicalmente rimodellato il modo in cui operano le organizzazioni. I team di ogni reparto stanno adottando strumenti che promettono di accelerare la codifica, la creazione di contenuti e l'analisi dei dati. Questa rapida adozione avviene spesso senza una supervisione formale. I dipendenti non aspettano l'autorizzazione. Si iscrivono ai servizi utilizzando credenziali personali e incollando dati aziendali sensibili in modelli pubblici. Questo crea un enorme ecosistema non monitorato di "intelligenza artificiale ombra" che i firewall tradizionali non possono vedere né controllare.

I responsabili della sicurezza si trovano ad affrontare una sfida difficile. Bloccare completamente l'IA è spesso impraticabile e soffoca l'innovazione. Consentire l'accesso illimitato favorisce la fuga di dati e le violazioni della conformità. La soluzione risiede in una policy aziendale per l'IA ben strutturata. Questo documento costituisce il fondamento della vostra strategia di governance. Definisce le regole di ingaggio. Stabilisce limiti chiari per i dati che possono essere condivisi e gli strumenti consentiti. Senza questo framework, la vostra organizzazione rimane vulnerabile all'esfiltrazione di dati, alle sanzioni normative e al furto di proprietà intellettuale.

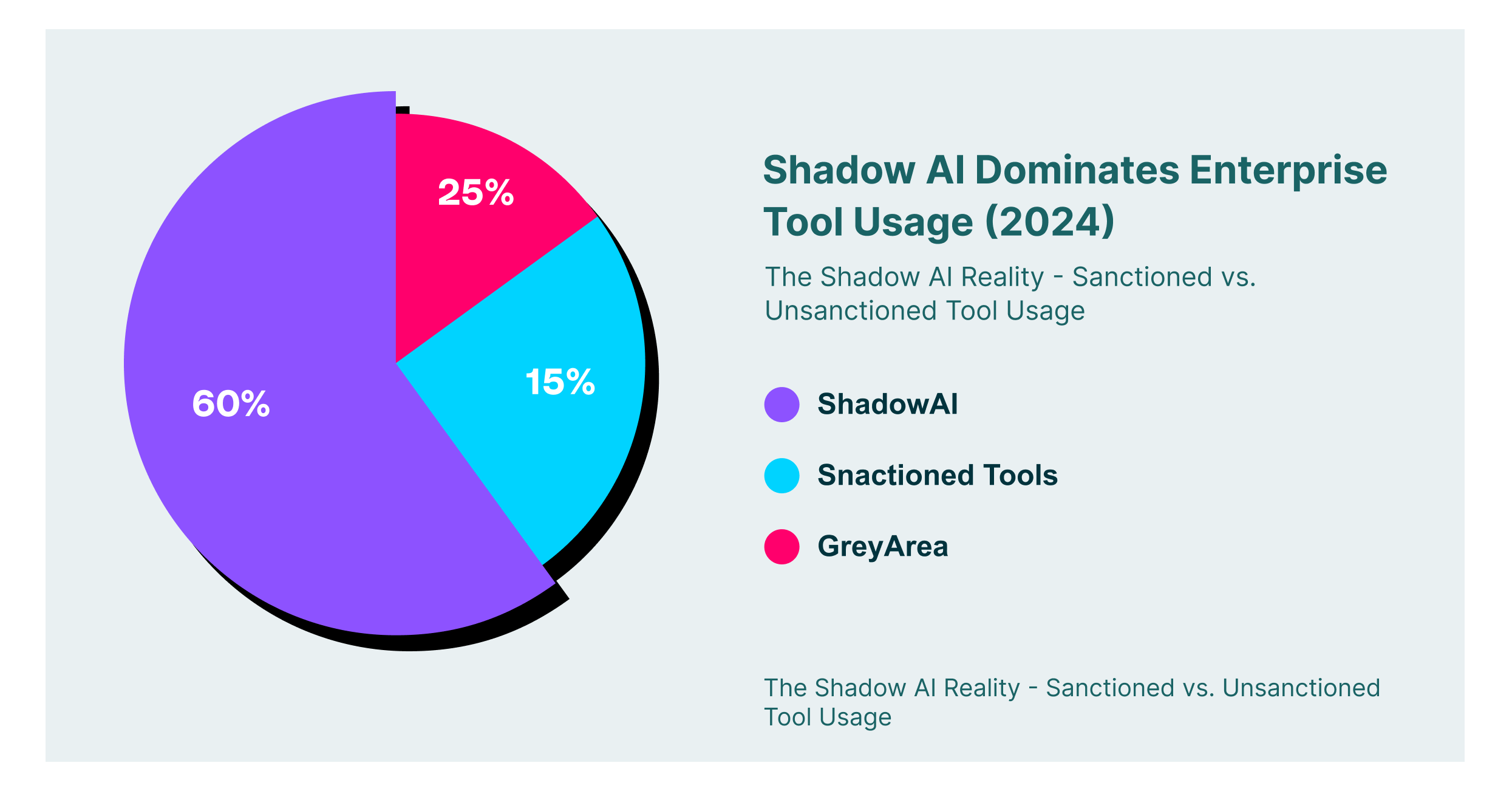

La portata del problema dell'intelligenza artificiale ombra

La disparità tra ciò che i team IT approvano e ciò che i dipendenti effettivamente utilizzano è in aumento. La maggior parte delle organizzazioni ritiene di avere il controllo del proprio inventario software. La realtà è spesso ben diversa. Le estensioni basate su browser e le applicazioni web aggirano i controlli perimetrali della rete. Questo consente ai dati di fluire direttamente dallo schermo dell'utente a server di terze parti.

La realtà dell'intelligenza artificiale ombra: utilizzo di strumenti autorizzati e non autorizzati

I team di sicurezza devono riconoscere che la "Shadow AI" non è solo un problema. È una vulnerabilità critica. Gli strumenti non autorizzati spesso non dispongono di controlli di sicurezza di livello aziendale. Potrebbero rivendicare il diritto di utilizzare i dati per l'addestramento dei modelli. Una policy di sicurezza completa per l'IA è il primo passo per recuperare visibilità e controllo su questo ambiente decentralizzato.

Pilastri fondamentali di un modello di politica di sicurezza dell'intelligenza artificiale

Creare una policy da zero può essere scoraggiante. È utile considerare il documento come un insieme di componenti modulari. Ogni modulo affronta un aspetto specifico dell'interazione utente-IA. Un modello di policy di sicurezza per l'IA solido non dovrebbe essere un elenco statico di "non fare". Deve essere un framework dinamico che si adatta a nuovi strumenti e minacce. Deve coprire in egual misura la sicurezza dell'identità, dei dati e delle applicazioni.

Il primo pilastro è la classificazione dei dati. Non è possibile proteggere ciò che non si definisce. La policy deve indicare esplicitamente quali categorie di dati sono ammesse per l'input tramite intelligenza artificiale. I testi di marketing pubblici potrebbero essere sicuri. Le informazioni personali identificabili (PII) dei clienti e il codice sorgente non ancora rilasciato non lo sono affatto. La policy non deve lasciare spazio ad ambiguità in questo caso. Gli utenti devono sapere esattamente dove viene tracciata la linea prima di aprire una finestra di richiesta.

Identity and Access Management

Il secondo pilastro si concentra su chi utilizza gli strumenti. L'anonimato è il nemico della sicurezza. Il modello di policy di sicurezza dell'IA dovrebbe imporre l'uso delle identità aziendali per tutte le attività di IA correlate al business. Gli account di posta elettronica personali dovrebbero essere severamente vietati per le attività aziendali. Questo garantisce che, quando un dipendente lascia l'azienda, il suo accesso ai dati e la cronologia delle sue interazioni rimangano all'interno dell'organizzazione. Consente inoltre l'integrazione con il Single Sign-On (SSO). Il SSO fornisce un kill switch centralizzato in caso di compromissione di un account.

Verifica e approvazione delle domande

Il terzo pilastro riguarda gli strumenti stessi. Non tutte le applicazioni di intelligenza artificiale sono uguali. Alcune aderiscono a rigorosi standard di sicurezza aziendale. Altre sono poco più che operazioni di raccolta dati racchiuse in un'interfaccia intuitiva. La vostra policy deve stabilire un processo di verifica. Questo processo dovrebbe valutare le pratiche di gestione dei dati del fornitore. Dovrebbe verificare se utilizza i dati dei clienti per la formazione. Dovrebbe verificare la conformità a standard come SOC 2 o ISO 27001. Solo gli strumenti che superano questa sfida dovrebbero ottenere lo status di "sanzionato".

Stabilire standard di utilizzo accettabile dell'IA

Una sezione sull'uso accettabile dell'IA traduce i principi di alto livello in azioni quotidiane. Questa è la parte della policy che i dipendenti leggeranno più spesso. Deve essere chiara, concisa e priva di termini legali. Dovrebbe concentrarsi sul comportamento. Dovrebbe descrivere scenari specifici che gli utenti incontrano nei loro flussi di lavoro quotidiani.

Ad esempio, gli sviluppatori utilizzano spesso l'intelligenza artificiale per il debug del codice. Una policy di utilizzo accettabile dell'intelligenza artificiale potrebbe consentire di incollare frammenti di logica generica. Vieterebbe severamente l'incollaggio di algoritmi proprietari o chiavi API hard-coded. I team di marketing potrebbero utilizzare l'intelligenza artificiale per la stesura delle email. La policy lo consentirebbe, ma richiederebbe una revisione umana dell'output finale per verificarne l'accuratezza e il tono. Questi esempi pratici aiutano i dipendenti a comprendere come applicare le regole nel loro contesto specifico.

Il protocollo “semaforico”

Per semplificare il processo decisionale, molte organizzazioni adottano un sistema a semaforo nelle loro linee guida sull'uso accettabile dell'IA.

- Verde (Sanzionato): questi strumenti dispongono di licenze aziendali. Sono stati firmati accordi di protezione dei dati. I dipendenti possono utilizzarli liberamente per la maggior parte dei tipi di dati, escluse le informazioni top secret.

- Giallo (Tollerato): si tratta di strumenti pubblici utili ma privi di controlli aziendali. L'utilizzo è consentito solo per attività non sensibili. Non è richiesto alcun login. Non è possibile immettere dati interni.

- Rosso (Bloccato): Questi strumenti presentano rischi inaccettabili. Potrebbero avere precedenti violazioni della sicurezza o politiche aggressive di data scraping. L'accesso è tecnicamente bloccato a livello di browser o di rete.

Gestire i rischi delle politiche di sicurezza dell'intelligenza artificiale generativa

GenAI introduce rischi unici che le policy software tradizionali non coprono. La natura interattiva dei Large Language Model (LLM) crea nuovi vettori di attacco. Una policy di sicurezza specializzata per l'IA generativa deve affrontare queste minacce specifiche. Non è sufficiente proteggere l'accesso: è necessario proteggere l'interazione stessa.

Una delle principali preoccupazioni è l'iniezione immediata. Questo si verifica quando istruzioni dannose sono nascoste all'interno di un blocco di testo. Se un dipendente incolla questo testo in un LLM, il modello potrebbe essere indotto a ignorare le sue misure di sicurezza. La policy deve mettere in guardia gli utenti dal copiare contenuti non attendibili dal web direttamente negli strumenti di intelligenza artificiale interni. Dovrebbe trattare il testo esterno con lo stesso sospetto di un allegato email proveniente da un mittente sconosciuto.

Gestione delle allucinazioni e integrità dell'output

Un altro aspetto critico di una policy di sicurezza basata sull'intelligenza artificiale generativa è la convalida degli output. I modelli di intelligenza artificiale sono probabilistici, non deterministici. Possono presentare con sicurezza informazioni false come se fossero fatti. Questo fenomeno è noto come allucinazione. L'utilizzo di output di intelligenza artificiale non verificati in decisioni aziendali critiche può portare a perdite finanziarie e danni alla reputazione. La policy deve prevedere un "human-in-the-loop" per tutti gli output di alto valore. Il codice generato dall'intelligenza artificiale deve essere revisionato da un ingegnere senior. I documenti legali redatti dall'intelligenza artificiale devono essere verificati da un avvocato.

Violazioni comuni delle policy di sicurezza dell'intelligenza artificiale negli ambienti aziendali

Quadri normativi e di governance per la sicurezza dell'intelligenza artificiale

Le regole ad hoc sono un buon punto di partenza, ma la resilienza a lungo termine richiede un approccio strutturato. L'allineamento agli standard internazionali trasforma la vostra policy di sicurezza dell'IA da un insieme di regole a un sistema di gestione. Questo dimostra la due diligence nei confronti di enti regolatori, clienti e membri del consiglio di amministrazione. Sposta l'attenzione dalla lotta reattiva alla gestione proattiva del rischio.

Due framework principali stanno attualmente plasmando il dibattito nel settore: ISO 42001 e il NIST AI Risk Management Framework (RMF). L'adozione di elementi di questi standard garantisce che la politica di sicurezza e la strategia di governance dell'IA siano complete e difendibili. Questo fornisce un linguaggio comune per discutere del rischio dell'IA in tutta l'organizzazione.

Attuazione della ISO 42001

La norma ISO 42001 è lo standard globale per i Sistemi di Gestione dell'IA. Segue il consueto ciclo Plan-Do-Check-Act presente in altri standard ISO. Per una politica di sicurezza e un programma di governance dell'IA, le clausole più rilevanti sono spesso Leadership e Operation.

- Leadership: questa clausola richiede al top management di assumersi la responsabilità dell'efficacia del sistema di gestione dell'IA. Garantisce la disponibilità delle risorse e l'allineamento della politica aziendale con gli obiettivi strategici aziendali.

- Operatività: questa clausola si concentra sulla valutazione e sul trattamento dei rischi legati all'IA. Impone alle organizzazioni di identificare le potenziali conseguenze indesiderate dei sistemi di IA e di implementare controlli per mitigarle.

Applicazione del NIST AI RMF

Il NIST AI RMF è un framework volontario molto apprezzato nel settore pubblico e privato statunitense. È strutturato attorno a quattro funzioni principali: Governare, Mappare, Misurare e Gestire.

- Governare: questa funzione promuove una cultura di gestione del rischio. Implica la definizione di politiche e procedure che guidino lo sviluppo e l'utilizzo dell'IA.

- Mappa: questa funzione definisce il contesto. Identifica gli specifici sistemi di intelligenza artificiale in uso e i potenziali rischi ad essi associati.

- Misura: questa funzione utilizza metodi quantitativi e qualitativi per analizzare i rischi. Risponde alla domanda: "Quanto rischio stiamo effettivamente correndo?"

- Gestione: questa funzione assegna priorità e gestisce i rischi. Implica l'implementazione di controlli specifici, come la stessa politica di utilizzo accettabile dell'IA, per ridurre il rischio a un livello accettabile.

Il ruolo della sicurezza del browser nell'applicazione della legge

Scrivere una policy di intelligenza artificiale aziendale è solo metà del lavoro. Applicarla è l'altra metà. Gli strumenti tradizionali di sicurezza di rete hanno difficoltà a gestire l'uso moderno dell'intelligenza artificiale. Possono bloccare un dominio, ma non possono vedere cosa succede all'interno della sessione. Non riescono a distinguere tra un utente che chiede a ChatGPT la ricetta di un cookie e un utente che copia un database clienti. Questa mancanza di granularità porta a blocchi eccessivi o a pericolosi punti ciechi.

Il browser è il nuovo perimetro. È l'interfaccia attraverso cui si svolge quasi tutto il lavoro moderno. Per applicare efficacemente una policy di sicurezza basata sull'intelligenza artificiale, sono necessari controlli integrati nel browser stesso. Ciò consente un'analisi in tempo reale delle azioni dell'utente e consente decisioni contestuali che bilanciano sicurezza e produttività. Invece di un binario "blocca o consenti", la sicurezza del browser può offrire controlli più dettagliati come "consenti sola lettura" o "consenti ma oscura i dati sensibili".

Automazione delle policy con LayerX

LayerX fornisce le capacità tecniche per trasformare in realtà la vostra policy di sicurezza basata sull'intelligenza artificiale. Funziona come un'estensione del browser aziendale. Questa posizione unica gli consente di monitorare e controllare le interazioni degli utenti con qualsiasi applicazione web, inclusi gli strumenti di intelligenza artificiale approvati e non approvati. LayerX funge da braccio esecutivo della vostra strategia di governance.

Una delle funzionalità chiave di LayerX è la scoperta della "Shadow AI". Cataloga automaticamente ogni sito di intelligenza artificiale a cui accedono i tuoi dipendenti. Fornisce un inventario completo che ti consente di vedere esattamente quali strumenti sono in uso. Questa visibilità è essenziale per aggiornare il modello di policy di sicurezza dell'intelligenza artificiale e mantenerlo pertinente. Non puoi governare ciò di cui non sai l'esistenza. LayerX illumina gli angoli oscuri del tuo ecosistema SaaS.

DLP in tempo reale e formazione

LayerX va oltre la semplice individuazione. Offre funzionalità attive di Data Loss Prevention (DLP) su misura per GenAI. Quando un utente tenta di incollare dati che violano la politica di utilizzo accettabile dell'IA, LayerX interviene. Può bloccare completamente l'azione di incollaggio. Può anche oscurare selettivamente stringhe sensibili, come numeri di carta di credito o dati personali identificativi, consentendo al contempo il proseguimento del prompt. Ciò consente ai dipendenti di utilizzare lo strumento in modo sicuro senza esporre l'organizzazione a rischi. Inoltre, LayerX può visualizzare un pop-up personalizzato che spiega la violazione. Questo trasforma ogni azione bloccata in un momento di micro-formazione, rafforzando la politica di sicurezza dell'IA in tempo reale.

Lista di controllo per l'implementazione della politica di sicurezza dell'IA

Utilizza la seguente checklist per assicurarti che la tua policy copra tutte le aree critiche. Questa tabella associa i componenti specifici della policy ai controlli tecnici necessari per applicarli.

| Componente politica | Requisito chiave | Capacità di applicazione di LayerX |

| Inventario degli strumenti | Mantenere un elenco aggiornato degli strumenti sanzionati e bloccati. | Rilevamento in tempo reale delle app Shadow SaaS e AI in tutta l'azienda. |

| DLP dei dati | Definisci tipi di dati specifici vietati dall'input dell'IA. | Impedisci l'incollaggio o il caricamento di tipi di dati sensibili definiti |

| Gestione dell'identità | Rendere obbligatorio l'SSO aziendale per tutti gli account AI. | Rileva e blocca l'utilizzo di account di posta elettronica personali per le app aziendali. |

| Controllo dell'estensione | Controlla tutti i plugin del browser che accedono ai dati dell'IA. | Valutazione del rischio e blocco di estensioni dannose o rischiose. |

| Audit Trail | Registrare tutti i prompt e le interazioni con l'IA per la conformità. | Registri forensi granulari delle interazioni utente-IA a fini di audit |

| Accesso basato sui ruoli | Definisci chi può utilizzare quale strumento e come. | Applicare criteri di accesso basati su gruppi di utenti e Active Directory. |

Non vediamo l'ora che l'intelligenza artificiale venga adottata nella sicurezza aziendale

L'adozione dell'IA generativa non è una tendenza passeggera. Rappresenta un cambiamento fondamentale nel modo di fare business. La policy aziendale in materia di IA è il meccanismo che consente alla vostra organizzazione di affrontare questo cambiamento in sicurezza. Non si tratta di creare ostacoli. Si tratta di costruire barriere di protezione. Definendo chiare linee guida per l'uso accettabile dell'IA e supportandole con solidi controlli tecnici, consentite alla vostra forza lavoro di innovare.

La sicurezza nell'era dell'IA richiede una combinazione di governance chiara e applicazione attiva. Un modello statico di policy di sicurezza per l'IA è un buon punto di partenza, ma deve essere reso operativo. LayerX fornisce la visibilità e il controllo a livello di browser necessari per rendere efficace la policy. Colma il divario tra il documento e l'utente. Garantisce che le policy di sicurezza e gli sforzi di governance dell'IA si traducano in un'effettiva riduzione del rischio. Iniziate con la visibilità, definite le regole e applicatele ai margini. Questa è la strada per un'adozione sicura dell'IA.