L'adozione dell'intelligenza artificiale generativa sta accelerando, ma la protezione dei dati legacy non è in grado di garantire le sfumature delle interazioni LLM. Questa guida confronta i migliori strumenti di sicurezza basati sull'intelligenza artificiale generativa per aiutare i leader aziendali a promuovere l'innovazione mantenendo al contempo una governance rigorosa sui dati sensibili.

Cosa sono gli strumenti di sicurezza dell'intelligenza artificiale generativa e perché sono importanti

Gli strumenti di sicurezza basati sull'intelligenza artificiale generativa sono piattaforme specializzate progettate per proteggere l'utilizzo di modelli linguistici di grandi dimensioni (LLM) e applicazioni di intelligenza artificiale. A differenza dei firewall tradizionali, queste soluzioni di sicurezza basate sull'intelligenza artificiale generativa analizzano il contesto dei dati conversazionali, consentendo loro di rilevare e bloccare la fuga di dati personali (PII) o di proprietà intellettuale in tempo reale. Offrono una visibilità critica sulla "Shadow AI", garantendo che i dipendenti non espongano inconsapevolmente le risorse aziendali a modelli pubblici.

Per le aziende moderne, queste piattaforme si differenziano dagli stack di sicurezza standard offrendo un controllo granulare su prompt e risposte. Prevengono gli attacchi di iniezione rapida e garantiscono la conformità alle normative sulla privacy senza richiedere il divieto assoluto di utilizzare strumenti di intelligenza artificiale che migliorano la produttività. Implementando queste difese, le organizzazioni possono integrare in modo sicuro GenAI nei propri flussi di lavoro, mitigando al contempo i rischi di esfiltrazione dei dati e manipolazione dei modelli.

Principali tendenze di sicurezza dell'intelligenza artificiale generativa da tenere d'occhio nel 2026

Il passaggio dal blocco all'"abilitazione sicura" definisce lo scenario del 2026. I team di sicurezza stanno abbandonando il divieto assoluto di utilizzare gli strumenti di intelligenza artificiale e stanno invece adottando piattaforme che ne consentono un utilizzo sicuro attraverso la redazione dei dati in tempo reale. Questo approccio garantisce che i dipendenti possano utilizzare potenti assistenti di intelligenza artificiale per la produttività senza condividere accidentalmente dati sensibili dei clienti o codice proprietario.

Un'altra priorità emergente è la difesa basata sull'"intelligenza artificiale agente". Mentre gli aggressori iniziano a utilizzare agenti di intelligenza artificiale per automatizzare complesse analisi di ingegneria sociale e vulnerabilità, le aziende stanno contrastando con agenti di intelligenza artificiale difensivi. Questi sistemi autonomi possono rilevare anomalie comportamentali e rispondere alle minacce più rapidamente degli analisti umani, creando uno scudo dinamico contro gli attacchi automatizzati.

Infine, il controllo degli accessi contestuale sta diventando uno standard. Non è più sufficiente concedere l'accesso binario ai modelli di intelligenza artificiale; le moderne soluzioni di sicurezza basate sull'intelligenza artificiale generativa ora applicano dinamicamente le policy "need-to-know". Ciò garantisce che un addetto al marketing non possa costringere un modello di intelligenza artificiale interno a rivelare dati finanziari, mantenendo rigide barriere interne ai dati.

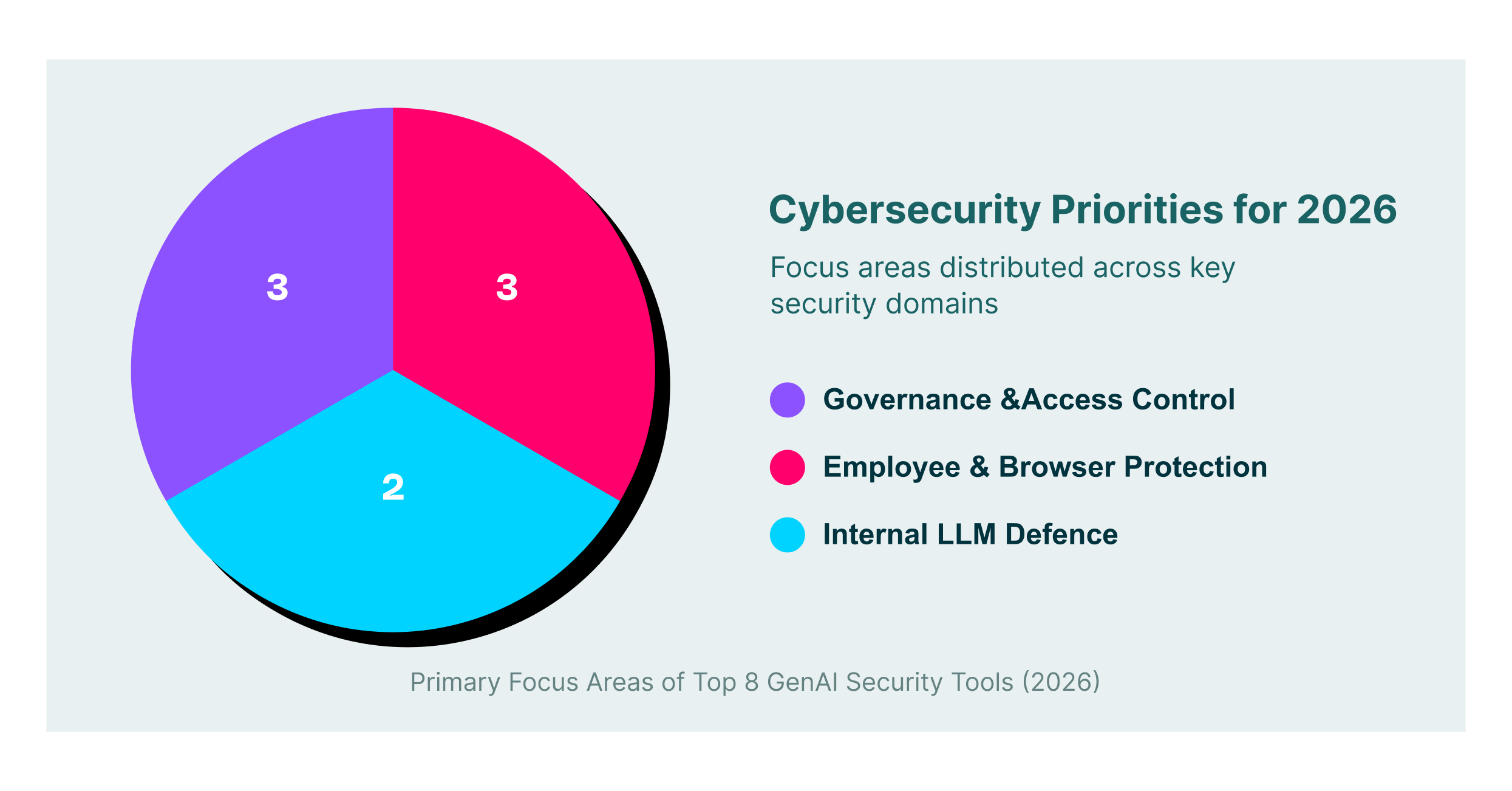

Gli 8 migliori strumenti di sicurezza basati sull'intelligenza artificiale generativa per il 2026

Di seguito è riportato un confronto tra le principali piattaforme, a partire da LayerX. Questi fornitori offrono approcci distinti per proteggere la superficie di attacco dell'IA in rapida espansione.

| Piattaforma | Funzionalità chiave | Ideale per |

| layerX | DLP basato su browser, filtraggio dei prompt in tempo reale e visibilità dell'intelligenza artificiale ombra | Sicurezza del browser aziendale e DLP |

| Sicurezza immediata | Scoperta dell'intelligenza artificiale ombra, protezione da iniezione rapida, redazione dei dati | Protezione dell'utilizzo di GenAI da parte dei dipendenti |

| Sicurezza AIM | Valutazione del rischio GenAI, gestione della conformità, implementazione sicura dell'IA | Sicurezza di Microsoft 365 Copilot |

| Lakera | Rilevamento delle minacce in tempo reale, sicurezza delle applicazioni AI, difesa rapida | Protezione delle applicazioni di intelligenza artificiale interne |

| Sicurezza Armonica | Protezione dei dati zero-touch, suggerimenti degli utenti, valutazione del rischio | Monitoraggio automatico della conformità |

| Sicurezza del lazo | Rilevamento Shadow LLM, controllo degli accessi basato sul contesto e blocco in tempo reale | Governance e supervisione LLM |

| IA del tramonto | Agenti DLP, redazione dati, browser ed endpoint basati sull'intelligenza artificiale | Prevenire l'esfiltrazione dei dati |

| Knostico | Governance del controllo degli accessi, applicazione delle policy need-to-know | Gestione dei permessi di accesso dell'IA |

1. LayerX

LayerX è una piattaforma di sicurezza per browser che funziona come un'estensione leggera, trasformando qualsiasi browser commerciale in uno spazio di lavoro sicuro e gestito. Offre una visibilità approfondita su tutte le interazioni GenAI, consentendo ai team di sicurezza di rilevare e bloccare l'inserimento di codice sorgente sensibile o informazioni personali identificabili (PII) in strumenti come ChatGPT prima che i dati lascino l'endpoint.

La piattaforma va oltre il semplice blocco consentendo una governance granulare dell'utilizzo della "Shadow AI". Identifica gli strumenti di intelligenza artificiale non autorizzati e applica policy basate sull'identità dell'utente e sul livello di rischio, garantendo che le soluzioni di sicurezza basate sull'intelligenza artificiale generativa vengano applicate esattamente nel punto di interazione. Questo protegge l'"ultimo miglio" del trasferimento dati, consentendo un'adozione sicura dell'intelligenza artificiale senza compromettere la produttività degli utenti.

2. Sicurezza immediata

Prompt Security offre una piattaforma completa per proteggere ogni fase dell'adozione di GenAI, dall'utilizzo occasionale da parte dei dipendenti alla profonda integrazione degli LLM nei prodotti interni. Le sue solide capacità di discovery forniscono ai team IT un inventario completo degli strumenti Shadow AI in uso, corredato da un punteggio di rischio che aiuta a stabilire le priorità degli interventi di sicurezza.

La piattaforma eccelle nella prevenzione degli attacchi di tipo "prompt injection" e nel rispetto della privacy dei dati attraverso la redazione in tempo reale. Ispezionando prompt e risposte, Prompt Security garantisce che i dati aziendali riservati vengano sanificati prima di raggiungere i provider esterni, rendendola una scelta affidabile tra le aziende di sicurezza basate sull'intelligenza artificiale generativa per un'implementazione più sicura dei chatbot.

3. Sicurezza AIM

AIM Security si concentra sulla creazione di un ambiente sicuro per l'adozione di GenAI a livello aziendale, con strumenti efficaci per la valutazione e la governance dei rischi. La piattaforma aiuta i CISO a individuare e mappare tutte le applicazioni GenAI all'interno dell'organizzazione, fornendo un quadro chiaro dell'esposizione ai rischi di conformità e sicurezza.

Uno dei principali vantaggi di AIM Security è la sua capacità di proteggere distribuzioni su larga scala come Microsoft 365 Copilot. Offre funzionalità che convalidano la sicurezza degli agenti di intelligenza artificiale e prevengono le fughe di dati attraverso una rigorosa applicazione delle policy, garantendo che i vantaggi operativi dell'intelligenza artificiale non compromettano gli standard normativi.

4. Lakera

Lakera si distingue per "Lakera Guard", un livello di protezione in tempo reale progettato per difendere le applicazioni di intelligenza artificiale dagli attacchi avversari. Mantiene un ampio database di tecniche di prompt injection e jailbreak note, consentendo di bloccare input dannosi che tentano di manipolare il comportamento di LLM.

Oltre al rilevamento delle minacce, Lakera offre potenti funzionalità di prevenzione della perdita di dati, pensate appositamente per le interazioni con l'intelligenza artificiale basate su API. È particolarmente efficace per i team di progettazione che sviluppano funzionalità GenAI proprietarie, poiché si integra direttamente nel ciclo di vita dello sviluppo per impedire che le vulnerabilità raggiungano gli ambienti di produzione.

5. Sicurezza armonica

Harmonic Security adotta una filosofia "zero-touch" per la protezione dei dati, con l'obiettivo di ridurre al minimo l'attrito per l'utente, garantendo al contempo la sicurezza. Invece di blocchi rigidi, utilizza modelli di protezione dei dati pre-addestrati per identificare le informazioni sensibili e "spingere" gli utenti verso comportamenti più sicuri, formandoli efficacemente durante i loro flussi di lavoro quotidiani.

Questa piattaforma riduce il carico operativo dei team di sicurezza automatizzando la classificazione dei servizi di intelligenza artificiale rischiosi. Harmonic offre una chiara visibilità sulle app sicure e su quelle pericolose, consentendo alle organizzazioni di approvare con sicurezza gli strumenti a basso rischio, limitando automaticamente l'accesso a quelli che rappresentano una minaccia.

6. Sicurezza del lazo

Lasso Security offre una difesa end-to-end per i modelli linguistici di grandi dimensioni, combinando il rilevamento dello shadow IT con un controllo avanzato degli accessi. La sua tecnologia "LLM Guardian" si interpone tra utenti e modelli per monitorare il flusso di dati, ispezionare i contenuti alla ricerca di anomalie e applicare policy che impediscono la condivisione di dati sensibili.

La piattaforma enfatizza la sicurezza contestuale, garantendo che gli utenti accedano solo ai dati a cui sono autorizzati, anche quando interagiscono con un'IA dotata di una vasta conoscenza organizzativa. Lasso include anche difese specifiche contro l'avvelenamento dei dati e il furto di modelli, posizionandosi come una soluzione solida per le aziende che sviluppano i propri modelli.

7. IA del tramonto

Nightfall AI sfrutta la sua consolidata tecnologia cloud DLP per offrire una soluzione specializzata per la sicurezza basata sull'intelligenza artificiale generativa. Utilizza rilevatori basati sull'intelligenza artificiale per analizzare prompt e caricamenti di file alla ricerca di informazioni personali identificabili (PII), chiavi API e altri segreti, oscurando automaticamente queste informazioni prima che vengano elaborate da fornitori di intelligenza artificiale esterni.

La soluzione viene implementata tramite plugin del browser e agenti endpoint per acquisire i dati alla fonte, impedendo l'esfiltrazione tramite azioni di copia-incolla. L'attenzione di Nightfall al rilevamento ad alta precisione riduce al minimo i falsi positivi, garantendo il corretto svolgimento dei flussi di lavoro legittimi e garantendo al contempo la rigorosa conformità dei dati.

8. Knostic

Knostic affronta la sfida critica del controllo degli accessi negli ambienti GenAI, in particolare il rischio che gli utenti aggirino i permessi tramite interfacce conversazionali. Applica policy "need-to-know" analizzando il contesto delle query degli utenti e i permessi dei dati sottostanti, impedendo la condivisione eccessiva accidentale di informazioni sensibili.

La piattaforma utilizza LLM per generare e adattare dinamicamente le policy di accesso, riducendo il lavoro amministrativo manuale richiesto per i controlli di accesso basati sui ruoli. Knostic fornisce report di conformità automatizzati, aiutando le organizzazioni a dimostrare che le loro implementazioni di intelligenza artificiale rispettano rigorosi standard di privacy interni ed esterni.

Come scegliere il miglior fornitore di sicurezza basata sull'intelligenza artificiale generativa

- Determina se il tuo obiettivo principale è proteggere l'utilizzo del browser da parte dei dipendenti o le applicazioni LLM interne.

- Valutare la capacità della piattaforma di individuare "Shadow AI" senza input manuale per garantire la piena visibilità.

- Dare priorità alle soluzioni di sicurezza basate sull'intelligenza artificiale generativa che offrono soluzioni di correzione in tempo reale, come la redazione, anziché la semplice registrazione passiva.

- Verificare l'integrazione perfetta con i provider di identità esistenti per applicare policy coerenti basate sull'utente.

- Scegli un fornitore che riduca al minimo gli attriti offrendo suggerimenti educativi per guidare il comportamento degli utenti.

Domande Frequenti

Quali sono i principali rischi dell'utilizzo dell'intelligenza artificiale generativa in azienda?

I rischi principali includono la fuga di dati, in cui i dipendenti condividono informazioni personali (PII) o IP con modelli pubblici, e la cosiddetta "Shadow AI", in cui strumenti non autorizzati vengono utilizzati senza supervisione. Anche gli attacchi di iniezione rapida rappresentano una minaccia, in quanto possono manipolare gli LLM inducendoli a bypassare i filtri di sicurezza ed esporre i dati di back-end.

In che modo gli strumenti di sicurezza GenAI differiscono dai tradizionali DLP?

La DLP tradizionale utilizza rigidi modelli di espressioni regolari che spesso non riescono a comprendere il contesto conversazionale, generando falsi positivi. Gli strumenti di sicurezza GenAI utilizzano l'analisi semantica per interpretare l'intento di un prompt, distinguendo così tra attività legittime e tentativi di esfiltrazione di dati.

Posso semplicemente bloccare ChatGPT per proteggere la mia organizzazione?

Il blocco di ChatGPT spesso si traduce in un fenomeno di "Shadow IT", in cui i dipendenti passano a dispositivi personali o strumenti non monitorati per continuare a lavorare. Una strategia più efficace consiste nell'utilizzare piattaforme di sicurezza che consentano un utilizzo sicuro, oscurando i dati sensibili e mantenendo accessibili i vantaggi in termini di produttività.

Ho bisogno di un'estensione del browser per la sicurezza GenAI?

Un'estensione del browser è spesso il metodo più efficace per proteggere l'utilizzo da parte dei dipendenti, perché rileva le azioni "dell'ultimo miglio" come il copia-incolla e il caricamento di file. I proxy di rete potrebbero non rilevare il traffico crittografato o non riuscire a visualizzare il contesto visibile solo all'interno della sessione del browser.

Cos'è la "Shadow AI" e perché è pericolosa?

Con "Shadow AI" si intende l'utilizzo di strumenti di intelligenza artificiale da parte di dipendenti senza l'approvazione o la conoscenza del reparto IT. È pericoloso perché questi strumenti sono privi di controlli di sicurezza aziendali, il che significa che qualsiasi dato condiviso con essi esce dal perimetro di protezione dell'organizzazione e potrebbe essere utilizzato per addestrare modelli pubblici.