L'intelligenza artificiale generativa (GenAI) ha sbloccato livelli di produttività e innovazione senza precedenti, ma ha anche introdotto nuove opportunità di rischio per la sicurezza. Una delle minacce più significative è l'attacco jailbreak, una tecnica utilizzata per aggirare i controlli di sicurezza ed etici integrati nei modelli linguistici di grandi dimensioni (LLM). Questo articolo esamina gli attacchi jailbreak su GenAI, i metodi impiegati dagli aggressori e come le organizzazioni possono proteggersi da queste minacce emergenti.

Cosa sono gli attacchi Jailbreak?

Un attacco di jailbreak prevede la creazione di input speciali, noti come prompt di jailbreak, per indurre un LLM a generare risposte che violano le sue stesse policy di sicurezza. Queste policy sono progettate per impedire al modello di produrre contenuti dannosi, non etici o malevoli. Eseguendo con successo un jailbreak, un aggressore può manipolare l'IA per generare disinformazione, incitamento all'odio o persino codice per malware.

La sfida per le organizzazioni è che questi attacchi sfruttano la natura stessa del modo in cui i LLM elaborano il linguaggio. Gli aggressori trovano costantemente modi creativi per strutturare le loro richieste e aggirare i guardrail integrati. Questo crea un continuo gioco del gatto e del topo tra gli sviluppatori che cercano di proteggere i propri modelli e gli autori di attacchi alla ricerca di nuove vulnerabilità.

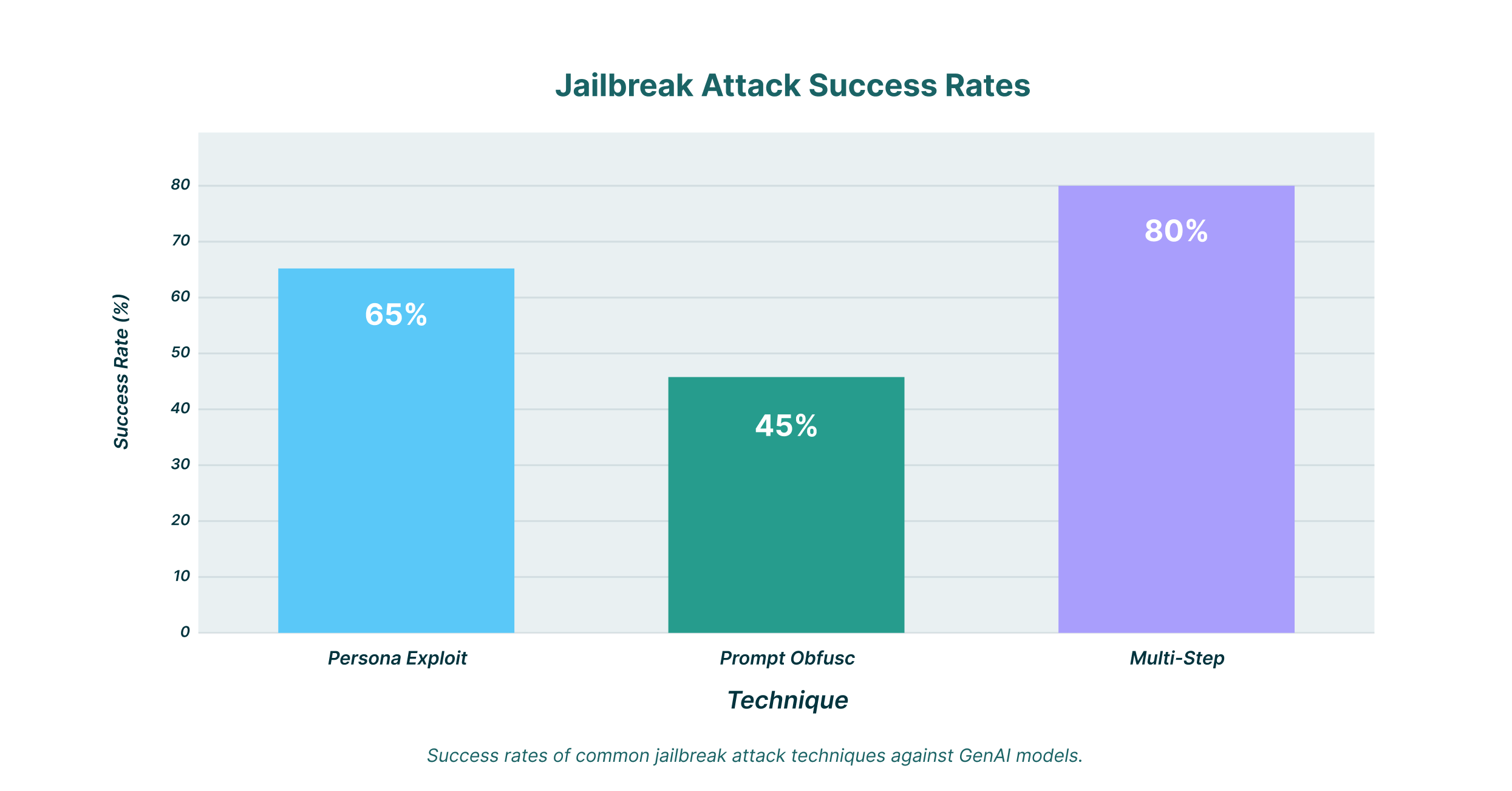

Gli aggressori hanno sviluppato una varietà di tecniche sofisticate per effettuare il jailbreak dei modelli di intelligenza artificiale. Comprendere questi metodi è il primo passo verso la costruzione di una difesa solida.

Sfruttamento della persona

Uno dei metodi più comuni è lo sfruttamento della persona. In questo scenario, l'attaccante istruisce l'LLM ad adottare una persona specifica, non vincolata dai consueti vincoli etici. Ad esempio, un utente potrebbe chiedere al modello di rispondere come un personaggio immaginario di un film noto per il suo comportamento amorale. Inquadrando la richiesta in questo contesto fittizio, l'attaccante può spesso indurre il modello a generare contenuti che altrimenti rifiuterebbe.

Questa è una tecnica particolarmente efficace per il jailbreak di un personaggio tramite IA. Questi modelli sono progettati per essere colloquiali e coinvolgenti, il che può renderli più vulnerabili a questo tipo di manipolazione. Un prompt di jailbreak di un personaggio tramite IA, accuratamente progettato, può portare alla generazione di contenuti inappropriati o dannosi.

Offuscamento rapido

Un'altra tecnica popolare è l'offuscamento dei prompt. Questa tecnica consiste nel mascherare la richiesta dannosa all'interno di un prompt apparentemente innocuo. Ad esempio, un aggressore potrebbe incorporare un'istruzione dannosa in un problema di codifica lungo e complesso o in un testo creativo. L'obiettivo è confondere i filtri di sicurezza del modello, che potrebbero non essere in grado di rilevare l'intento dannoso nascosto nel rumore.

Questo metodo viene spesso utilizzato per eseguire un prompt di jailbreak basato sull'intelligenza artificiale. Rendendo il prompt difficile da analizzare, gli aggressori possono aggirare il livello di sicurezza iniziale e far sì che il modello si concentri sull'istruzione mascherata.

Concatenamento di prompt multi-step

Gli attacchi più sofisticati spesso prevedono una serie di prompt che si basano l'uno sull'altro. Questo è noto come concatenamento di prompt multi-step. L'attaccante inizia con una serie di domande innocue per stabilire un rapporto con il modello e introduce gradualmente un linguaggio più manipolativo. Nel momento in cui viene inoltrata la richiesta malevola, il modello è già stato "preparato" a essere più conforme.

Questa tecnica è particolarmente pericolosa perché può essere difficile da individuare. Ogni richiesta può sembrare innocua da sola, ma se combinata, può portare a un jailbreak riuscito.

Come prevenire gli attacchi di jailbreak

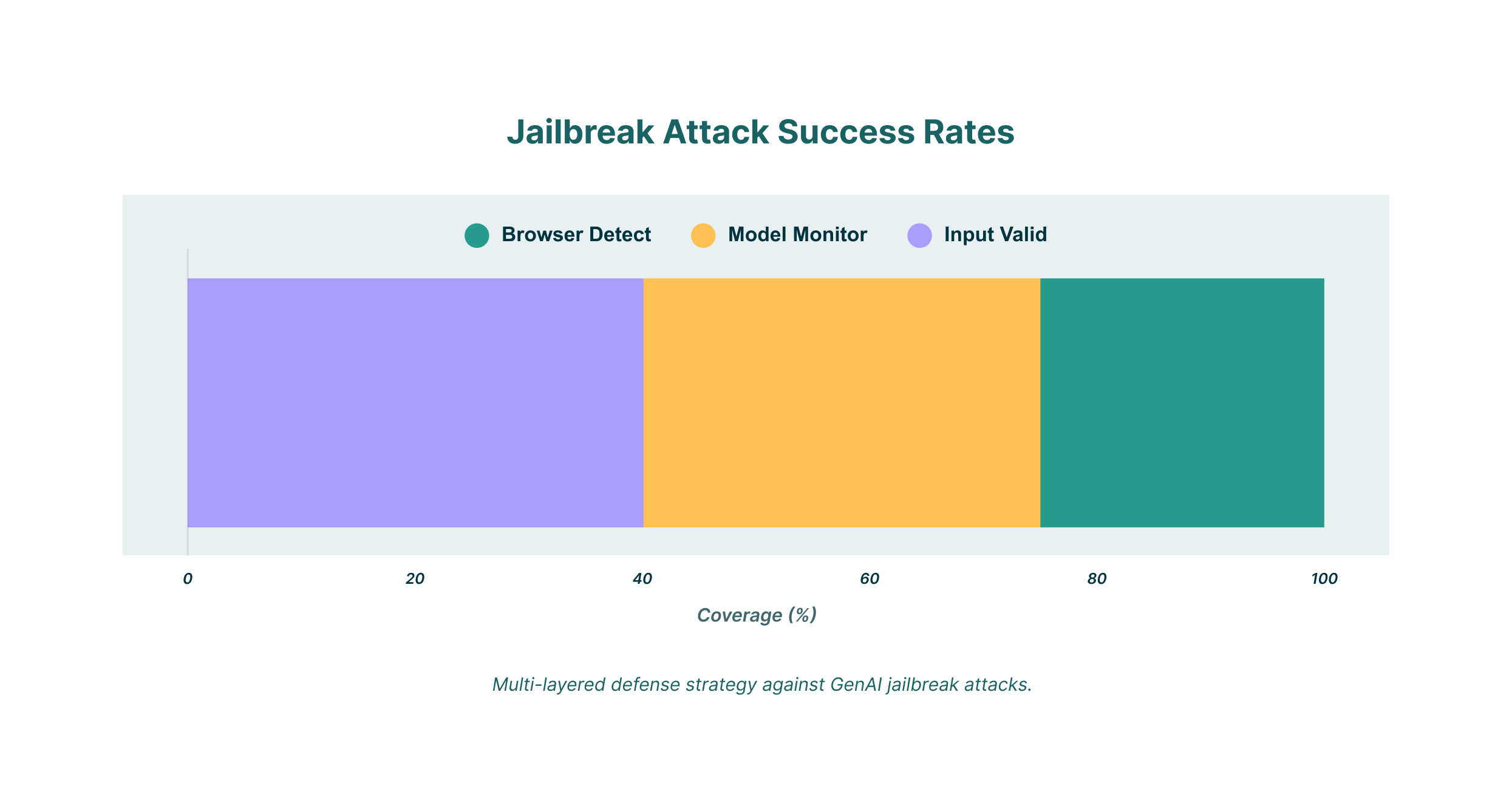

Sebbene gli attacchi jailbreak rappresentino una seria minaccia, le organizzazioni possono adottare alcune misure per mitigare i rischi.

Implementare una convalida degli input robusta

Una delle difese più efficaci è l'implementazione di un robusto sistema di convalida degli input. Questo comporta l'utilizzo di una combinazione di tecniche per analizzare i prompt in arrivo alla ricerca di eventuali segnali di intenti malevoli. Questo può includere:

- Filtraggio delle parole chiave: blocco dei prompt che contengono parole chiave o frasi note come dannose.

- Analisi del sentiment: identificazione di messaggi con un tono negativo o ostile.

- Analisi della complessità: segnalare i prompt eccessivamente complessi o contorti, poiché potrebbero essere tentativi di offuscamento.

Monitorare e aggiornare continuamente i modelli

Il panorama degli attacchi jailbreak è in continua evoluzione, quindi è fondamentale monitorare costantemente le nuove tecniche e aggiornare i modelli di conseguenza. Ciò include il riaddestramento regolare dei modelli con nuovi dati per aiutarli a identificare e respingere meglio i prompt dannosi.

È inoltre importante rimanere aggiornati sulle ultime ricerche sui prompt di jailbreak LLM. Conoscendo i più recenti vettori di attacco, è possibile rafforzare proattivamente le proprie difese.

Per le organizzazioni che utilizzano strumenti GenAI, una soluzione di rilevamento e risposta del browser (BDR) può fornire un ulteriore livello di sicurezza. Una soluzione BDR può monitorare tutte le attività degli utenti all'interno del browser, comprese le interazioni con i modelli GenAI. Ciò consente di:

- Verifica l'utilizzo di GenAI: ottieni un quadro completo di come i dipendenti utilizzano gli strumenti GenAI in tutta l'organizzazione.

- Applica la governance della sicurezza: imposta policy granulari per limitare i tipi di informazioni che possono essere condivise con gli LLM.

- Previeni la fuga di dati: blocca i tentativi di condividere dati aziendali sensibili con i modelli GenAI.

LayerX offre una soluzione BDR completa che può aiutarti a proteggere l'utilizzo degli strumenti GenAI. Analizzando tutte le attività del browser, LayerX è in grado di rilevare e bloccare anche i tentativi di jailbreak più sofisticati, garantendo che la tua organizzazione possa sfruttare i vantaggi di GenAI senza esporsi a rischi inutili.

Richieste di jailbreak per modelli specifici

Sebbene le tecniche descritte sopra siano generalmente applicabili alla maggior parte degli LLM, alcuni modelli presentano vulnerabilità specifiche.

Jailbreak dell'IA del personaggio

Come accennato in precedenza, l'IA dei personaggi è particolarmente suscettibile allo sfruttamento della personalità. Se state cercando come effettuare il jailbreak dell'IA dei personaggi, scoprirete che molti dei tentativi riusciti prevedono la creazione di una personalità molto specifica e dettagliata da adottare per il modello.

Jailbreak di Claude AI

Claude AI, sviluppato da Anthropic, è noto per le sue solide funzionalità di sicurezza. Tuttavia, non è immune agli attacchi di jailbreak. Un jailbreak di successo di Claude AI spesso richiede l'utilizzo di una combinazione di offuscamento rapido e concatenamento rapido multi-step per aggirare le sue difese.

Jailbreak dell'intelligenza artificiale DeepSeek

DeepSeek AI è un altro potente LLM che è stato preso di mira dagli aggressori. Un jailbreak di DeepSeek AI richiede spesso un approccio più tecnico, come lo sfruttamento di vulnerabilità specifiche nell'architettura del modello.

La soluzione di LayerX agli attacchi Jailbreak

Gli attacchi jailbreak su GenAI rappresentano una seria minaccia che può avere conseguenze significative per le organizzazioni. Comprendendo le tecniche utilizzate dagli aggressori e implementando una strategia di difesa multilivello, è possibile proteggere la propria organizzazione da queste minacce emergenti. Ciò include una validazione affidabile degli input, un monitoraggio continuo dei modelli e l'utilizzo di una soluzione BDR come LayerX per proteggere tutte le interazioni degli utenti con gli strumenti GenAI.

Il mondo del jailbreak basato sull'intelligenza artificiale è una battaglia costante tra innovazione e sicurezza. Rimanendo informati e proattivi, puoi garantire che la tua organizzazione rimanga dalla parte giusta in questa battaglia.