Modeli strojnega učenja niso več le analitična orodja. So motorji, ki poganjajo odločanje v sodobnem podjetju. Ta odvisnost je rodila sofisticiran vektor groženj, znan kot adversarni napadi umetne inteligence. To niso tradicionalne programske izkoriščanja, ki ciljajo na ranljivosti kode, kot so prelivanja medpomnilnika. To so optične iluzije za algoritme.

Anatomija napada: Kako so modeli prevarani

Napadalci uporabljajo subtilne vnose, da bi sisteme umetne inteligence zavedli do napačnih klasifikacij ali razkrili občutljive podatke o usposabljanju. Za varnostne vodje so se leta 2025 vložki premaknili. Priča smo prehodu od teoretičnih raziskav k aktivni uporabi orožja. Napadalci operacionalizirajo te tehnike, da bi zaobšli odkrivanje goljufij in manipulirali s finančnimi algoritmi.

Prav tako izkoriščajo lastniške podatke prek orodij, ki jih zaposleni uporabljajo vsakodnevno. Brskalnik je postal glavno oder za te vdore. To je vmesnik, kjer zaposleni vstavljajo občutljivo kodo v LLM-je in kjer lahko zlonamerne razširitve tiho vbrizgajo strupene pozive. Razumevanje mehanizma sovražnih napadov na umetno inteligenco je prvi korak k zaščiti površine za napade iz brskalnika v oblak.

Vhodni signali nasprotnikov so človeškemu opazovalcu pogosto videti kot šum, vendar jih nevronska mreža interpretira kot različne signale. To neskladje napadalcem omogoča manipuliranje z rezultati, ne da bi sprožili tradicionalna varnostna opozorila. Metode, ki se uporabljajo za izvajanje napadov nasprotnikov z umetno inteligenco, običajno spadajo v tri različne kategorije.

Zastrupljanje podatkov: Pokvariti vodnjak

Do napadov z zastrupitvijo pride med fazo učenja ali natančnega uglaševanja. Z vbrizgavanjem zlonamernih vzorcev v nabor podatkov lahko napadalec ustvari skrita zadnja vrata v modelu. Napadalec lahko subtilno spremeni nabor lažnih e-poštnih sporočil v učnem korpusu. Nastali filter neželene pošte se nauči razvrstiti določene zlonamerne vzorce kot neškodljive.

V kontekstu GenAI je to še posebej nevarno. Če podjetje natančno prilagodi kodirnega pomočnika v internih repozitorijih, ki so bili subtilno spremenjeni, so posledice hude. Model lahko razvijalcem predlaga nezaščitene delčke kode, kar učinkovito avtomatizira uvedbo ranljivosti.

Izogibanje modelu: Digitalna spretnost roke

Napadi izogibanja se zgodijo v času sklepanja. Napadalec spremeni vhodne podatke, da jih model napačno klasificira. To je najpogostejša oblika kontradiktornih napadov na umetno inteligenco, ki jo danes vidimo v praksi. Klasični primer vključuje spreminjanje nekaj slikovnih pik na sliki znaka stop.

Avtonomno vozilo ustvari nevarno napako pri klasifikaciji in jo prepozna kot znak za omejitev hitrosti. V poslovnem okolju se za zaobijanje klasifikatorjev zlonamerne programske opreme uporabljajo tehnike izogibanja. To omogoča, da se orožne datoteke izmuznejo protivirusnim rešitvam naslednje generacije.

Ekstrakcija in kraja modela

Kraja modela vključuje napadalca, ki s številnimi poizvedbami preiskuje sistem umetne inteligence, ki je »črna skrinjica«. Njihov cilj je rekonstruirati osnovni model ali izvleči zasebne podatke, na katerih je bil učen. Z analizo rezultatov lahko zgradijo nadomestni model, ki posnema lastniško vedenje tarče.

S tem se krade intelektualna lastnina. Napadalcu se prav tako ponuja peskovnik, kjer lahko preizkusi prihodnje napade izogibanja brez povezave. Tako lahko zagotovi, da bodo njihove metode delovale proti produkcijskemu sistemu, ne da bi pri tem opozorili žrtev.

Povečanje avtomatiziranih groženj v letu 2025

Ovira za vstop pri izvajanju teh napadov se je znatno znižala. Avtomatizirani kompleti orodij zdaj omogočajo tudi nizko usposobljenim akterjem, da sprožijo sofisticirane kampanje. Število incidentov se agresivno povečuje. Varnostne ekipe morajo ponovno premisliti o svoji obrambni drži.

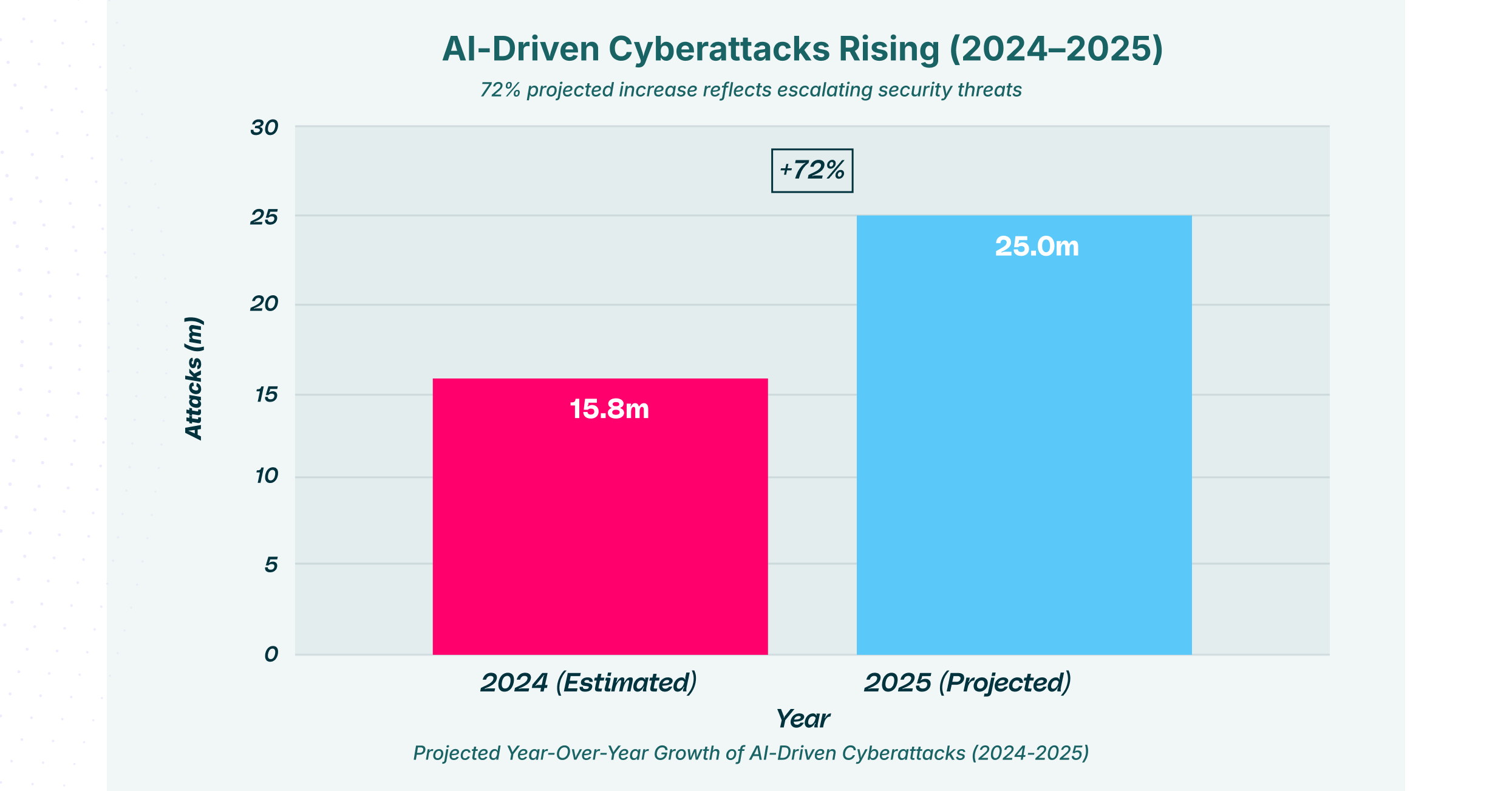

Ta grafikon prikazuje predvideni 72-odstotni medletni porast svetovnih kibernetskih incidentov. Ker organizacije uvajajo več modelov, naj bi obseg napadov z umetno inteligenco dosegel rekordne ravni, saj je za leto 2025 predvidenih 28 milijonov incidentov. Ta eksponentna rast poudarja, kako avtomatizirana orodja znižujejo vstopne ovire za akterje, ki izvajajo napade z umetno inteligenco v velikem obsegu.

Ta porast ni naključen. Poganja ga široko sprejetje odprtokodnih orodij umetne inteligence, ki jih je mogoče ponovno uporabiti za napad. Napadalci uporabljajo GenAI za avtomatizacijo odkrivanja ranljivosti v drugih sistemih umetne inteligence. To ustvarja zanko nasprotnikove optimizacije, ki se premika hitreje, kot jo lahko popravijo človeški branilci.

Orožje GenAI: Epidemija lažnega predstavljanja

Generativna umetna inteligenca je temeljito spremenila igro socialnega inženiringa. Napadi nasprotnikov v generativni umetni inteligenci ne pomenijo le prevare modela. Gre za uporabo modela za prevaro ljudi. Napadalci zdaj uporabljajo velike jezikovne modele (LLM) za ustvarjanje kontekstualnih, slovnično popolnih phishing e-poštnih sporočil.

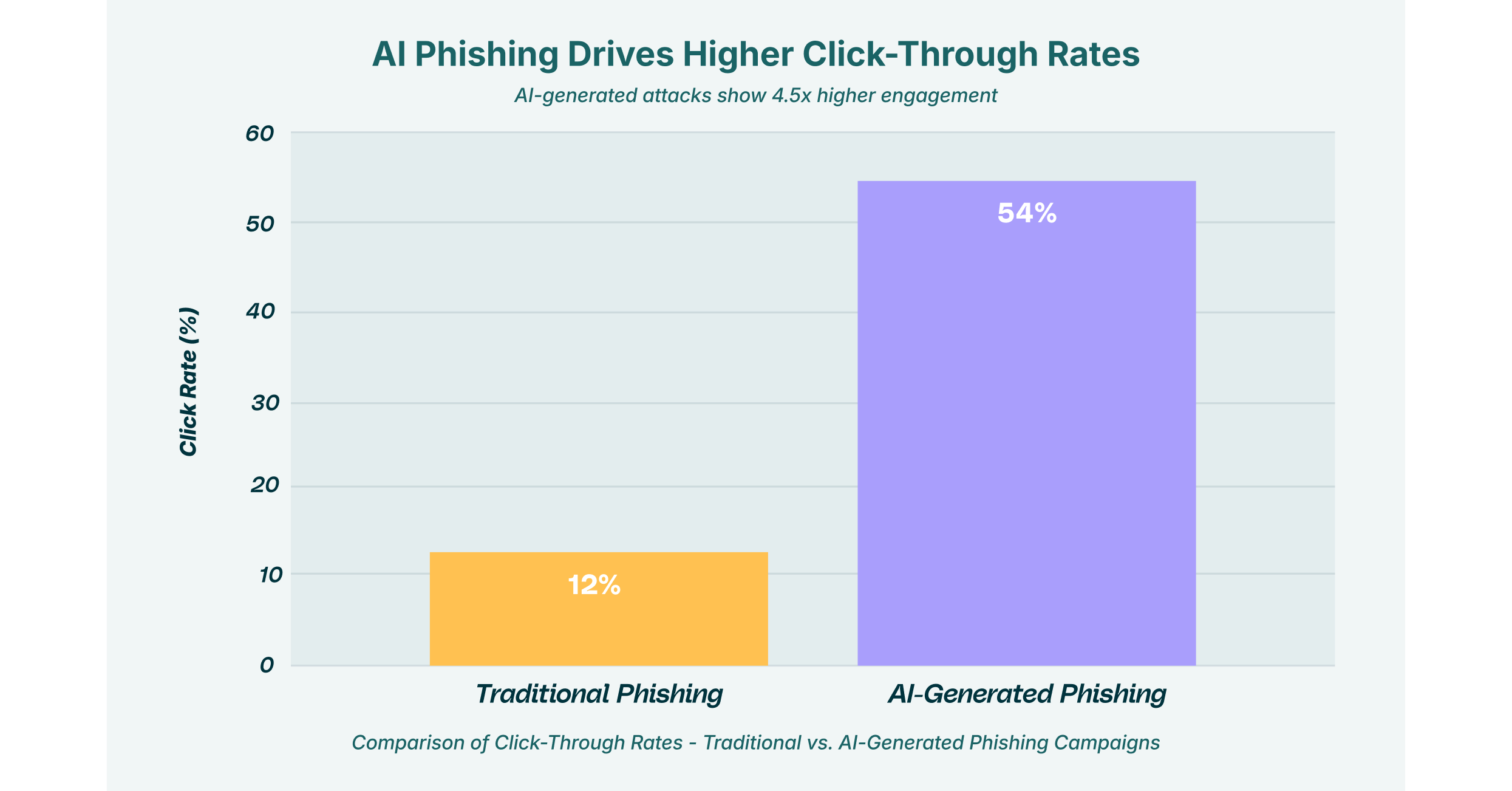

Ta e-poštna sporočila posnemajo ton in slog notranjih direktorjev. Učinkovitost teh kampanj, ki jih poganja umetna inteligenca, je v primerjavi s tradicionalnimi metodami zaskrbljujoča.

Primerjava stopenj klikov razkriva nevarno učinkovitost sovražnikovih napadov v generativni umetni inteligenci. Medtem ko tradicionalne phishing kampanje dosegajo le 12-odstotno stopnjo uspešnosti, vabe, ki jih ustvari umetna inteligenca in posnemajo zaupanja vredno interno komunikacijo, dosegajo osupljivih 54 % stopnjo klikov. Ti podatki poudarjajo kritično potrebo po specializirani varnosti brskalnikov za odkrivanje subtilnih jezikovnih in strukturnih anomalij socialnega inženiringa, ki ga poganja GenAI.

Rešitve za varnost brskalnikov se morajo zdaj razvijati dlje od preprostega filtriranja URL-jev. Analizirati morajo namen in kontekst prikazane vsebine. Ko zaposleni komunicira s klepetalnim robotom GenAI ali prejme sumljivo e-pošto, razširitev brskalnika služi kot kritična kontrolna točka. Označi lahko anomalije, ki kažejo, da je bila vsebina sintetično ustvarjena za zavajanje.

Prompt Injection: »SQL Injection« v dobi umetne inteligence

Ena najbolj razširjenih oblik sovražnikovih napadov v generativni umetni inteligenci je promptno vbrizgavanje. Ta tehnika vključuje ustvarjanje besedilnega vnosa, ki preglasi prvotna navodila modela. Sistem prisili k izvajanju nepooblaščenih dejanj.

Mehanizmi injiciranja

Tveganje ni omejeno le na uporabnike, ki v klepetalnico vnašajo neprimerne stvari. Resnična nevarnost je v posrednem vbrizgavanju v poziv ali napadih »človek v pozivu«. V tem primeru lahko LLM obdela spletno stran ali dokument, ki vsebuje skrita zlonamerna navodila.

LayerX Labs je odkril vektorje, kjer zlonamerne razširitve brskalnikov vnašajo te strupene pozive v poslovne LLM-je. To se dogaja brez uporabnikovega soglasja. To napadalcem omogoča manipulacijo z izhodnimi podatki zaupanja vrednih orodij umetne inteligence. Učinkovito spremeni koristnega pomočnika v notranjo grožnjo.

Taksonomija tveganj takojšnjega injiciranja

| Vrsta napada | Mehanizem | Raven tveganja |

| Neposredno vbrizgavanje | Napadalec ročno vnese zlonamerne pozive, da zaobide varnostne filtre (jailbreaking). | visoka |

| Indirektno vbrizgavanje | Zlonamerna navodila so skrita v zunanjih podatkih (npr. spletnih straneh), ki jih uporablja umetna inteligenca. | Kritično |

| Zastrupitev konteksta | Manipuliranje zgodovine pogovorov za vplivanje na prihodnje odzive modela. | srednje |

Ta tabela kategorizira primarne vektorje za promptno vbrizgavanje, specifično podmnožico sovražnih napadov z umetno inteligenco. Posredno vbrizgavanje predstavlja kritično tveganje, ker se zgodi brez uporabnikove vednosti. Pogosto se zgodi v scenariju »človek v pozivu«, kjer razširitev brskalnika prebere ogroženo spletno stran in zlonamerno navodilo vnese v LLM podjetja.

Dilema Deepfake in zagotavljanje identitete

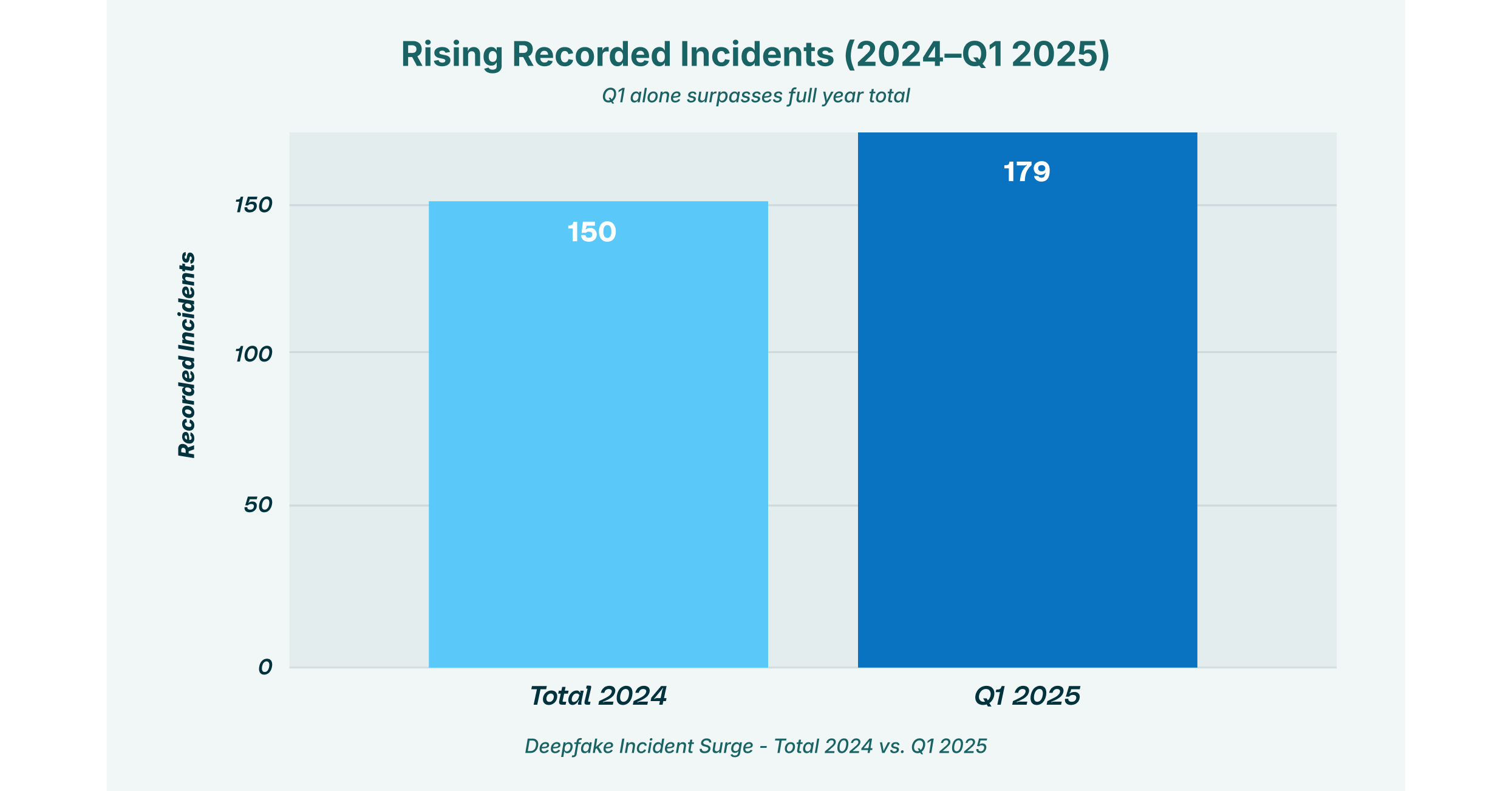

Ista tehnologija, ki se uporablja za ustvarjanje uporabnih avatarjev, se uporablja za orožje, s katerim se zaobidejo sistemi za preverjanje identitete. Globoki ponaredki so se iz internetnih novosti razvili v varnostne grožnje poslovnega razreda.

Ti napadi se pogosto pojavljajo na platformah za videokonference ali med procesi uvajanja na daljavo. Napadalec uporabi prekrivni sloj globokih ponaredkov v realnem času, da se izdaja za generalnega direktorja ali finančnega direktorja. Odobrijo goljufive prenose ali zahtevajo občutljive poverilnice. Organizacije morajo uvesti obrambo, ki lahko zazna digitalne artefakte sintetičnih medijev.

Brskalnik: Primarna površina napada

Zakaj je brskalnik osrednjega pomena v tej razpravi? Ker je vmesnik, prek katerega zaposleni dostopajo do orodij GenAI, kot so ChatGPT, Gemini ali Claude. Je prehod, skozi katerega napadi nasprotnikov umetne inteligence dosežejo končno točko.

Tradicionalna orodja za omrežno varnost so slepa za šifriran promet med uporabnikovim brskalnikom in storitvijo umetne inteligence. Ne morejo videti, ali zaposleni v klepetalni robot prilepi osebne podatke. Ne morejo videti, ali razširitev »Shadow SaaS« tiho strga te podatke. Raziskava »Shadow AI« podjetja LayerX razkriva, da do znatnega odstotka uhajanja podatkov v podjetjih pride prek neupravljanih razširitev brskalnika.

Ko govorimo o preprečevanju napadov nasprotnikov na umetno inteligenco, moramo brskalnik obravnavati kot točko izvrševanja. To je edino mesto, kjer lahko hkrati vidimo uporabnikov vnos, izhod modela in kontekst spletne seje. Ta vidnost omogoča brisanje občutljivih podatkov v realnem času.

Obrambne strategije za dobo GenAI

Zaščita pred temi sofisticiranimi grožnjami zahteva večplasten pristop. Ni dovolj, da se zanašamo na varnostne filtre, ki jih v modele vgradijo prodajalci. Podjetja morajo te modele zaviti v lastne varnostne kontrole.

Rdeče združevanje in puhanje

Organizacije bi morale začeti proaktivno testiranje stresnih situacij pri uvajanju umetne inteligence. Rdeče timiranje vključuje etične hekerje, ki poskušajo vdreti v modele. Izvajajo sovražne napade umetne inteligence, da bi odkrili slabosti.

To se pogosto uporablja v kombinaciji z metodo fuzzing. Fuzzing je avtomatizirana tehnika, pri kateri se modelu vnese na tisoče naključnih ali polnaključnih vhodnih podatkov. Cilj je ugotoviti, ali kateri od njih povzroči sesutje ali razkritje učnih podatkov.

Zaznavanje in odziv brskalnika (BDR)

Celovita rešitev BDR deluje kot požarni zid za uporabnikovo spletno sejo. Prepreči lahko namestitev zlonamernih razširitev, ki omogočajo zastrupitev podatkov ali krajo modelov.

Poleg tega organizacijam omogoča uveljavljanje pravilnikov za nadzor uporabe generativne umetne inteligence. To zagotavlja, da zaposleni nenamerno ne sodelujejo v napadu. Preprečuje izpostavljanje organizacije sovražnim napadom v generativni umetni inteligenci zaradi tveganega vedenja.

Zagotavljanje prihodnosti obveščevalnih služb

Igra mačke z mišjo med napadalci in branilci je vstopila v novo fazo. Napadi nasprotnikov predstavljajo temeljni izziv za integriteto sistemov, ki jih gradimo za našo prihodnost.

Z razumevanjem nians sovražnikovih napadov na umetno inteligenco lahko varnostni vodje zgradijo odporne arhitekture. Pot naprej ne zahteva opustitve umetne inteligence. Zahteva zavarovanje ekosistema, v katerem deluje.

To pomeni, da je treba prepoznati, da brskalnik ni več le pregledovalnik dokumentov. Je prva obrambna linija pred napadi nasprotnikov v generativni umetni inteligenci. Z natančnim testiranjem in spremljanjem v realnem času lahko podjetja samozavestno krmarijo po tej kompleksni krajini.