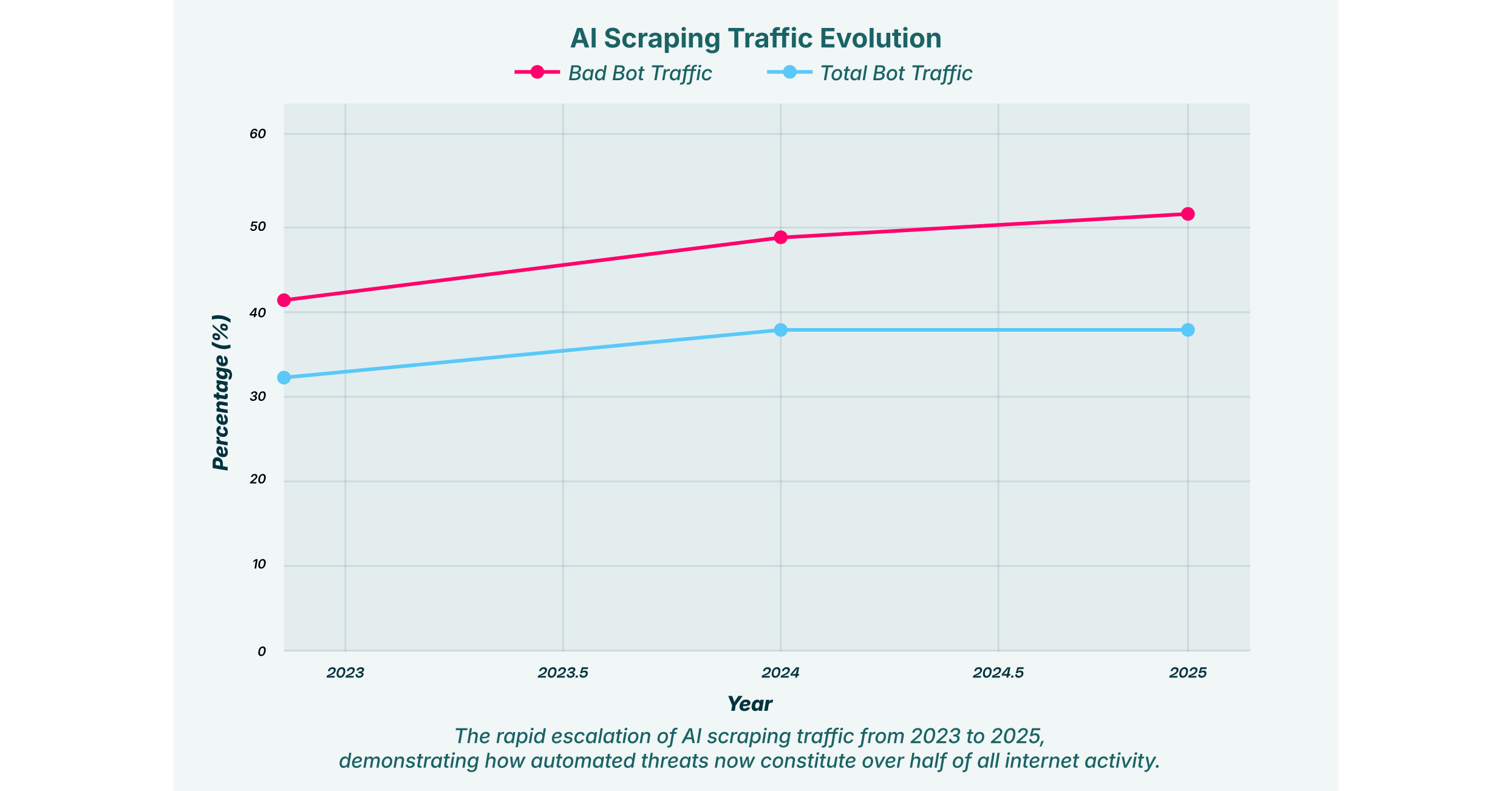

I den digitale økonomi er data den nye olie. Men hvad sker der, når olien suges væk uden din viden? Udforsk den voksende trussel fra AI-drevet data scraping, hvor automatiserede agenter udtrækker følsomme eller fortrolige oplysninger fra websteder, API'er eller platforme uden samtykke. Den beskriver risiciene for privatlivets fred, intellektuel ejendomsret og konkurrencefordele, sammen med strategier til detektion og forebyggelse. Det stille, sofistikerede tyveri, der orkestreres af avancerede AI-scrapingteknikker, repræsenterer en betydelig og eskalerende trussel mod virksomheder verden over. Dette er ikke den klodsede, let blokerede botaktivitet fra fortiden. Dagens trussel er en intelligent automatiseret agent, der er i stand til at efterligne menneskelig adfærd med uhyggelig præcision for at stjæle dine mest værdifulde digitale aktiver.

Disse angreb rækker ud over simpel dataindsamling. De er rettet mod selve kernen af en virksomheds konkurrencefordel, lige fra prismodeller og kundelister til proprietær kode og strategiske planer. Efterhånden som organisationer i stigende grad er afhængige af webapplikationer og SaaS-platforme, er browseren blevet den primære platform for disse hemmelige operationer. At forstå mekanikken bag AI-scraping er det første skridt mod at opbygge et robust forsvar.

Fra brute force til finesse: Udviklingen af datascraping

Traditionel webscraping var ofte et spil med tal. Angribere anvendte simple scripts fra en enkelt IP-adresse for at bombardere et websted med anmodninger og greb alle de offentligt tilgængelige data, de kunne. Disse bots var støjende og fulgte forudsigelige mønstre, hvilket gjorde dem relativt nemme at identificere og blokere gennem hastighedsbegrænsning eller IP-sortlistning. Sikkerhedsteams kunne holde linjen med konventionelle perimeterforsvar.

Den linje er nu brudt.

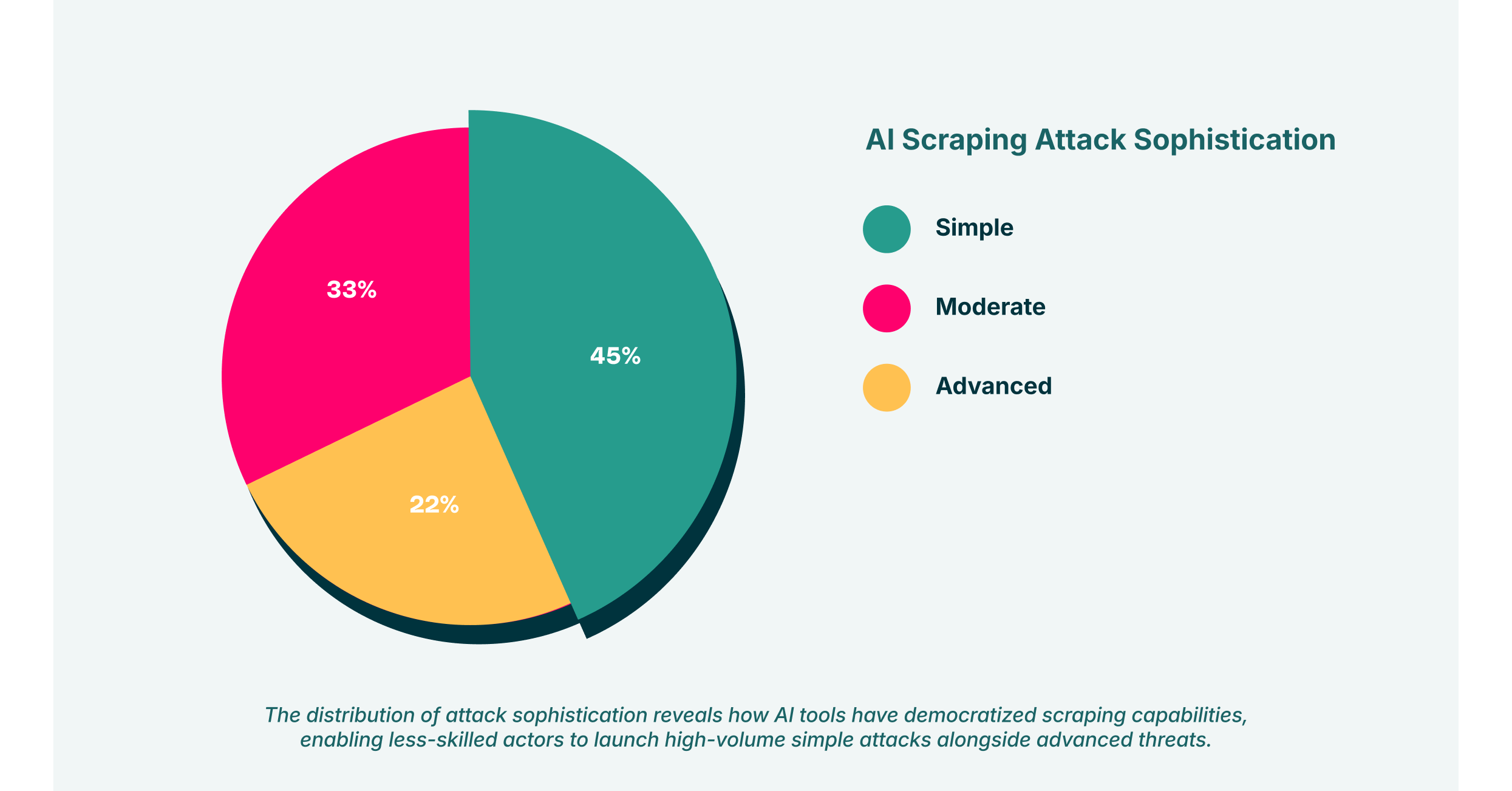

Moderne AI-scraping fungerer på et andet niveau af sofistikering. Disse avancerede scrapers er designet til at være stealth og vedholdende, og bruger maskinlæring til at navigere i komplekse webmiljøer, ligesom et menneske ville gøre. De kan:

- Dynamisk tilpasning: Når en hjemmesides struktur ændres, kan en AI-drevet scraper tilpasse sig i realtid uden menneskelig indgriben, hvilket sikrer, at datastrømmen er uafbrudt.

- Efterligner menneskelig adfærd: Disse agenter randomiserer deres browsermønstre, simulerer musebevægelser og løser komplekse CAPTCHA'er, der engang var guldstandarden for botdetektion. De fremstår som legitim brugertrafik og slipper forbi alle undtagen de mest avancerede sikkerhedsfiltre.

- Distribuer angreb: I stedet for at komme fra en enkelt IP-adresse, distribueres angrebene på tværs af store proxy-netværk i private hjem, hvilket gør IP-baseret blokering fuldstændig ineffektiv. Hver anmodning ser ud som om, den kommer fra en anden, ægte bruger.

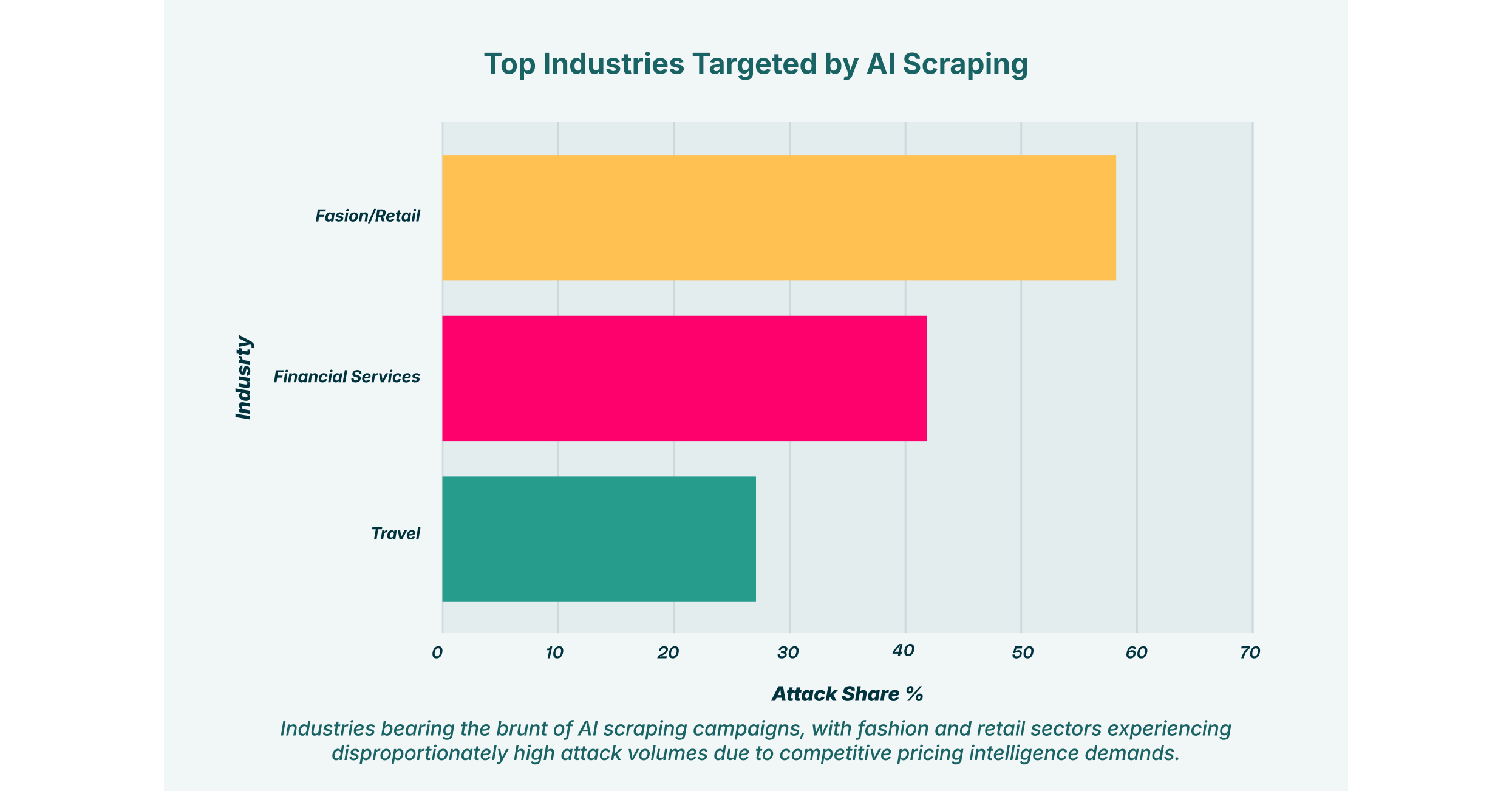

Forestil dig en konkurrent, der implementerer en automatiseret agent til konstant at overvåge din e-handelsplatform. Den scanner ikke bare priser én gang om dagen. Den lærer dine dynamiske prisalgoritmer at kende, identificerer dine mest populære produkter ved at spore brugerengagementsmålinger og indhenter endda kundeanmeldelser for at analysere sentiment. Den intellektuelle ejendom bag din markedsstrategi reverse engineeres og bruges imod dig, alt sammen uden at en eneste alarmklokke ringer.

Konsekvenserne af en vellykket AI-scrapingkampagne rækker langt ud over tabet af en konkurrencefordel. De operationelle, økonomiske og omdømmemæssige skader kan være katastrofale og berøre alle dele af virksomheden. Kernerisiciene grupperes omkring tyveri af to kritiske aktivtyper: intellektuel ejendom og følsomme data.

Erosionen af intellektuel ejendomsret

For mange virksomheder er deres intellektuelle ejendom deres mest værdifulde aktiv. Dette omfatter alt fra kildekode og produktdesign til marketingstrategier og interne vidensbaser. AI-scraping udgør en direkte trussel mod dette fundament. Overvej disse scenarier:

- SaaS-platformreplikering: En konkurrerende virksomhed kan bruge en automatiseret agent til systematisk at kortlægge hele din SaaS-applikation. Den indsamler funktionssæt, brugergrænsefladeelementer og workflowlogik. Med denne plan kan de hurtigt udvikle et konkurrerende produkt, hvilket eliminerer din fordel som førstefordel og markedsdifferentiering.

- Indholds- og SEO-sabotage: Digitale medier og indholdsdrevne virksomheder er særligt sårbare. Scrapere kan stjæle hele biblioteker af artikler, billeder og videoer og genudgive dem på spam-sider. Dette udgør ikke kun tyveri, men kan også alvorligt skade dine søgemaskineplaceringer ved at skabe problemer med duplikeret indhold.

- Tyveri af proprietære algoritmer: Virksomheder, der er afhængige af unikke algoritmer, såsom finansielle handelsfirmaer, logistikvirksomheder eller anbefalingsmotorer, er primære mål. En automatiseret agent kan indtaste tusindvis af datapunkter og analysere outputtet for at reverse engineere den underliggende model og dermed effektivt stjæle virksomhedens "hemmelige ingrediens".

Denne ubarmhjertige udhuling af intellektuel ejendomsret er en stille dræber, der langsomt dræner en virksomheds innovationskapacitet og markedsposition.

Udlejning af følsomme data

Mens nogle scrapere går efter proprietær forretningslogik, er andre ude efter en mere direkte monetariserbar gevinst: følsomme data. Når medarbejdere interagerer med utallige webapps og cloud-tjenester via deres browsere, skaber de en enorm angrebsflade til dataudvinding. En automatiseret agent, ofte leveret via en tilsyneladende godartet browserudvidelse, kan sidde uopdaget i en brugers browser og vente på det perfekte øjeblik til at slå til.

Det er her, at browser-til-cloud-angrebsfladen bliver en kritisk sikkerhedsblind plet. En medarbejder kan få adgang til et virksomheds-CRM, en sundhedsportal eller et finansielt system. Agenten, der kører med brugerens egne godkendte legitimationsoplysninger, kan derefter systematisk scrape og exfiltrere:

- Personligt identificerbare oplysninger (PII): Kundenavne, adresser, kontaktoplysninger og offentlige ID-numre.

- Finansielle data: Kreditkortnumre, bankkontooplysninger og virksomhedens økonomiske optegnelser.

- Beskyttede sundhedsoplysninger (PHI): Patientjournaler og andre data, der er beskyttet i henhold til regler som HIPAA.

Et enkelt brud på følsomme data kan føre til lammende bøder, juridisk ansvar og et fuldstændigt tab af kundernes tillid. Når datatab udføres af en skjult automatiseret agent, kan det gå flere måneder, før bruddet opdages, hvilket forværrer skaden.

Den nye grænse: GenAI API-scraping

Den seneste eksplosion af generativ kunstig intelligens har åbnet op for en ny og højt specialiseret vektor til ondsindet dataudtrækning: GenAI API-scraping. Organisationer integrerer i stigende grad store sprogmodeller (LLM'er) i deres arbejdsgange og produkter via API'er. Disse API'er, selvom de er kraftfulde, repræsenterer et nyt og attraktivt mål for sofistikerede angribere.

GenAI API-scraping handler ikke om at stjæle hjemmesideindhold på overfladen. Det handler om at angribe selve AI-modellen. Gennem omhyggeligt udformede API-kald kan en automatiseret agent:

- Stjæl proprietære modeller: Ved systematisk at forespørge en specialtrænet GenAI-model kan angribere udlede dens arkitektur og parametre, hvilket giver dem mulighed for at replikere modellen til deres egne formål. Dette er et direkte tyveri af betydelige investeringer i forskning og udvikling.

- Udtræk træningsdata: Visse prompt injection-teknikker kan narre en model til at afsløre dele af dens underliggende træningsdata. Hvis disse data indeholder følsomme data eller fortrolige oplysninger, kan konsekvenserne være alvorlige.

- Forgiftningsmodellens output: Ondsindede agenter kan oversvømme en GenAI API med forudindtaget eller skadelig data og forsøge at "forgifte" modellen og forringe kvaliteten af dens svar for legitime brugere.

Forestil dig en sundhedsvirksomhed, der har trænet en GenAI-model på følsomme patientdata for at hjælpe læger med diagnoser. Et vellykket GenAI API-scraping-angreb kan ikke blot afsløre disse følsomme data, men også kompromittere integriteten af det diagnostiske værktøj og dermed bringe patientsikkerheden i fare.

Hvorfor traditionelle forsvarsværker fejler

Hvordan lykkes disse sofistikerede angreb? Realiteten er, at traditionelle sikkerhedsværktøjer ikke blev bygget til denne kamp. Perimeterbaserede forsvar som webapplikationsfirewalls (WAF'er) og API-gateways er primært afhængige af signaturbaseret detektion og trafikanalyse. De leder efter kendte skadelige mønstre, store forespørgsler eller mistænkelige IP-adresser.

En avanceret automatiseret agent omgår disse kontroller med lethed.

- Den bruger legitime brugeroplysninger, ofte kapret via en ondsindet browserudvidelse.

- Den opererer i et "lavt og langsomt" tempo, hvilket gør dens aktivitet umulig at skelne fra normal brugeradfærd.

- Den dirigerer trafik gennem private proxyer, så hver anmodning ser ud til at komme fra en anden, gyldig kilde.

Disse agenter udløser ikke de klassiske alarmer, fordi de opererer fra inden for det betroede miljø i en godkendt brugers browsersession. Sikkerhedsperimeteren er effektivt flyttet fra netværkskanten til den individuelle browser, og de fleste organisationer mangler enhver meningsfuld indsigt eller kontrol på dette kritiske lag.

Løsningen: Browserdetektion og -respons

For at bekæmpe en trussel, der stammer fra browseren, skal forsvaret også være placeret i browseren. Dette er princippet bag LayerX's Enterprise Browser Extension. I stedet for at forsøge at blokere ondsindet trafik ved netværksportalen, giver LayerX dyb indsigt i selve browsersessionen og analyserer scriptadfærd og datastrømme i realtid for at opdage og neutralisere trusler, som WAF'er og andre netværksværktøjer ikke kan se.

Sådan modvirker denne tilgang direkte truslen fra AI-scraping:

- Adfærdsanalyse: LayerX er ikke afhængig af forældede signaturer. Det analyserer adfærden af hvert script, der udføres i browseren. Når en automatiseret agent systematisk begynder at gennemgå en webapplikations DOM eller forsøger at exfiltrere data, afviger dens adfærd fra normale menneskelige mønstre. LayerX registrerer denne anomale aktivitet øjeblikkeligt og kan afslutte scriptet, før følsomme data går tabt.

- Beskyttelse mod skygge-SaaS: Medarbejdere bruger konstant ikke-godkendte SaaS-applikationer (Shadow IT), hvilket skaber en massiv sikkerhedsblindvinkel. Da LayerX opererer på browserniveau, beskytter det brugeren uanset hvilket websted de besøger, eller hvilken applikation de bruger. Det kan forhindre en agent i at skrabe data fra en virksomheds Salesforce-instans lige så effektivt, som det kan fra en personlig ChatGPT-konto, der tilgås på en virksomhedsenhed. Dette giver kritisk skygge-IT-beskyttelse.

- Forebyggelse af GenAI-drevet eksfiltrering: Ved at overvåge alle dataoverførsler, der stammer fra browseren, kan LayerX identificere og blokere forsøg på at sende store mængder følsomme data til uautoriserede destinationer, herunder API'er på offentlige GenAI-platforme. Dette forhindrer både utilsigtede og ondsindede datalækager og sikrer virksomheders intellektuelle ejendom i AI'ens tidsalder.

Kampen mod AI-scraping vindes ikke ved netværkets perimeter. Den vindes ved at sikre det primære interaktionspunkt mellem brugere og applikationer: browseren. Ved at flytte sikkerheden til dette kritiske slutpunkt kan organisationer endelig få overtaget over for den nye generation af intelligente, automatiserede trusler.