A medida que la IA se integra en navegadores, plataformas SaaS, extensiones, copilotos y flujos de trabajo de agentes emergentes, las organizaciones requieren una nueva capa de gobernanza que opere en el momento de la interacción.

Este requisito cambia la definición de "bueno" en la gobernanza de la IA. La evaluación de proveedores debe ir más allá de las promesas generales y centrarse en criterios concretos y comparables en cuanto a descubrimiento, evaluación contextual de riesgos, gobernanza basada en políticas, cumplimiento en tiempo real, auditabilidad, adecuación operativa y preparación para el futuro.

Nuestro Guía de RFP para evaluar soluciones de control de uso de IA está diseñado para ayudar a los líderes de seguridad, cumplimiento y TI a evaluar sistemáticamente las soluciones de control de uso de IA (AUC) de manera consistente y en paralelo.

¿Por qué utilizar una plantilla RFP para la evaluación de proveedores de control de uso de IA?

El control del uso de la IA no es una sola función. Es un conjunto de capacidades que deben funcionar según cómo se acceda y utilice la IA, y luego mantenerse en condiciones operativas reales.

Esta guía ayuda a acelerar la investigación, fortalecer las decisiones y permitir la adopción segura de IA en toda la organización al estandarizar lo que los proveedores deben responder y cómo deben responderlo.

¿En qué se debe evaluar una plataforma de control de uso de IA?

La guía está organizada en ocho secciones, cada una de las cuales corresponde a un área de requisitos distinta en un programa de gobernanza de IA empresarial.

- Descubrimiento y cobertura de IA

Cómo se descubre y monitorea continuamente el uso de IA en todas las rutas de acceso y entornos. - Evaluación de riesgos de IA y conocimiento del contexto

Cómo la solución evalúa el riesgo de la IA en tiempo real mediante el análisis del contenido del mensaje, la sensibilidad de los datos, la identidad y el contexto de acceso. - Gobernanza del uso de la IA basada en políticas

Cómo se definen y aplican políticas granulares y sensibles al contexto para permitir, restringir o bloquear acciones de IA riesgosas. - Aplicación en tiempo real en el momento de la interacción

Cómo se aplican los controles en el momento de la interacción de la IA, antes de que se expongan datos confidenciales o se completen acciones riesgosas. - Monitoreo, alertas y auditoría

Cómo se registra, supervisa y audita la actividad de IA para respaldar las operaciones de seguridad, el cumplimiento y la respuesta a incidentes. - Ajuste arquitectónico y preparación operativa

Cómo se aplican los controles de IA en el punto de interacción sin carga arquitectónica ni operativa. - Implementación y gestión

Cómo se implementa, escala y administra la solución entre usuarios, navegadores, dispositivos y entornos con una sobrecarga operativa mínima. - Preparación de proveedores y preparación para el futuro

Evalúa el soporte del proveedor, la escalabilidad y la capacidad de adaptarse a los riesgos, herramientas y requisitos de gobernanza de la IA en constante evolución.

¿Qué significa en la práctica “Descubrimiento y cobertura de IA”?

El objetivo es simple: establecer una visibilidad completa y continua del uso de la IA en toda la organización.

En la práctica, la guía insta a los proveedores a demostrar la cobertura en todos los entornos, navegadores y rutas de acceso, no a ignorarlos. Pregunta si un proveedor puede descubrir el uso de la IA en navegadores, aplicaciones SaaS, extensiones, aplicaciones nativas, IDE y flujos de trabajo de agentes.

La guía pregunta si un proveedor admite la amplitud en la que ahora aparece la IA, incluyendo:

- Cobertura de múltiples navegadores, incluidos Chrome, Edge, Safari, Brave, Arc y otros

- Detección y cobertura de navegadores con IA, incluidos Atlas, Dia, Genspark, Comet y otros

- Control del panel lateral en navegadores con IA

- La capacidad de distinguir y controlar las acciones tanto del usuario como del agente.

- Detección de IA SaaS integrada en plataformas como CRM, correo electrónico y herramientas de colaboración

- Detección de IA basada en navegador para herramientas como ChatGPT, Claude y Gemini

- Detección de IA basada en escritorio para herramientas nativas como ChatGPT y Copilot

- Detección y control de complementos IDE

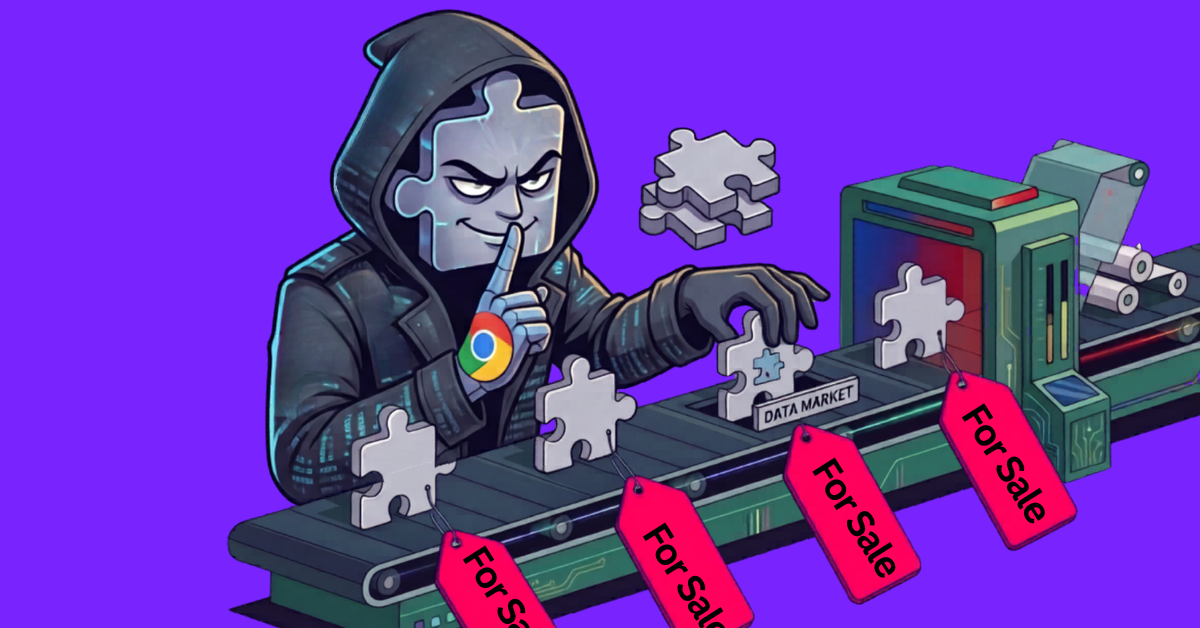

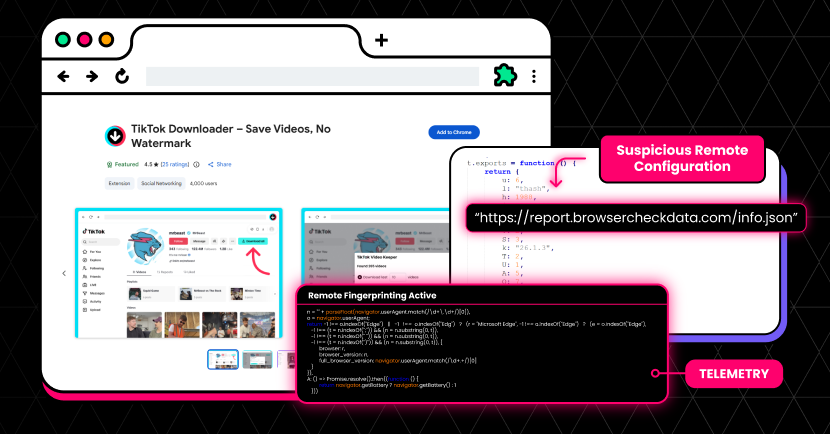

- Detección de extensiones, incluidas extensiones de navegador impulsadas por IA que actúan como intermediarias

Luego pasa a los aspectos básicos de gobernanza que a menudo se pasan por alto durante la evaluación, aunque cambian el perfil de riesgo:

- IA autorizada vs. IA en la sombra (BYOAI) y cómo se detectan las herramientas no autorizadas

- Atribución de usuarios para la actividad de IA

- Mapeo y diferenciación de identidades, incluidas identidades corporativas y personales, e identidades autenticadas y no autenticadas.

- Identificación del tipo de cuenta (comercial vs. personal) y si los datos están sujetos al entrenamiento del modelo

- Compatibilidad con modo incógnito y privado

- Visibilidad de conversaciones, incluidas conversaciones, indicaciones y respuestas de IA pasadas y activas

¿Cómo evaluar el riesgo y las políticas sin adivinar?

La guía separa la evaluación de riesgos de la aplicación de políticas y luego pide a los proveedores que expliquen ambas.

Para la evaluación de riesgos, el objetivo es claro.

Priorizar la gobernanza de la IA en función del riesgo dinámico en lugar de suposiciones estáticas.

Esto significa evaluar si la solución puede tener en cuenta cómo se accede a la IA (navegador, extensión, SaaS integrado, API, agente), detectar patrones de uso de IA riesgosos o anómalos según el comportamiento y el contexto, y tener en cuenta el rol del usuario, el tipo de identidad, la postura del dispositivo y el contexto de la sesión.

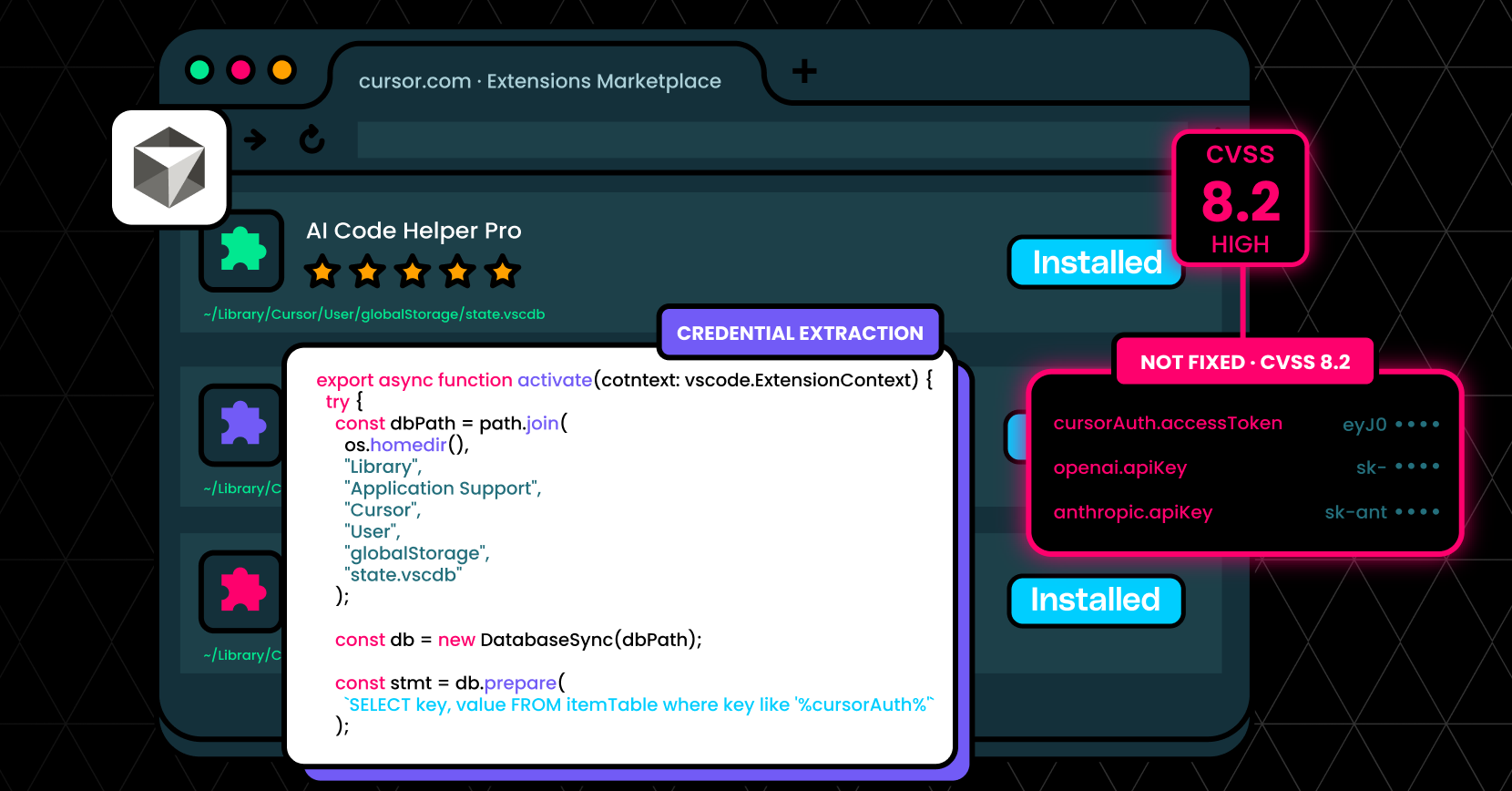

También incluye la evaluación del riesgo de extensión como un requisito definido.

¿Puedes analizar todas las extensiones de navegador impulsadas por IA instaladas por los usuarios y bloquear las riesgosas?

En materia de políticas, el objetivo también es explícito.

Traducir la intención de gobernanza en controles aplicables en el mundo real.

Esta sección comprueba si las políticas alcanzan las acciones donde se produce la exposición, como las solicitudes, las cargas, copiar y pegar, y las respuestas. También prueba el bloqueo de datos confidenciales para información personal identificable (PII), información médica protegida (PHI) e IP, además de la capacidad de detectar y bloquear la inyección de solicitudes en navegadores con IA.

No se limita a una sola medida de cumplimiento. Se pregunta si los proveedores admiten múltiples modos de cumplimiento, como Permitir, Monitorear, Advertir, Omitir con Justificación, Bloquear y Redactar, y si las políticas se pueden aplicar de forma coherente en todos los navegadores, SaaS, extensiones y agentes.

¿Cómo se prueba la aplicación en tiempo real en el momento de la interacción?

La guía aborda el control del tiempo de interacción como un área de evaluación independiente, con un objetivo específico: controlar el riesgo de la IA en el momento en que ocurre.

Pregunta si una solución puede inspeccionar indicaciones, entradas, cargas y respuestas en tiempo real, y si la aplicación puede tener en cuenta la intención, la identidad y el contexto de la sesión.

También pone a prueba las realidades operativas que determinan si los controles funcionan en la práctica:

- Detección de anomalías y aplicación de la ley por uso indebido, violaciones de políticas o comportamiento anómalo

- Controles no disruptivos que no interrumpen los flujos de trabajo ni degradan el rendimiento

- Controles a prueba de omisiones que minimizan los intentos de los usuarios de eludir políticas o adoptar soluciones alternativas no administradas

- Orientación al usuario mediante advertencias, explicaciones o consejos en tiempo real cuando las acciones infringen la política

¿Cómo convertir las respuestas del proveedor en una decisión defendible?

La guía incluye un proceso de evaluación simple diseñado para realizar comparaciones lado a lado.

- Revise cada sección para comprender los requisitos.

- Distribuya la RFP a los proveedores de control de uso de IA preseleccionados.

- Solicitar que cada proveedor complete la columna Respuesta para cada requisito con:

Respuesta de sí o no

Descripción detallada de la capacidad y proporcionar referencias, cuando corresponda. - Califique y compare las respuestas para identificar al proveedor que mejor se adapta a sus necesidades de gobernanza, seguridad, operaciones y productividad.

El valor práctico reside en la coherencia. Todos los proveedores responden a los mismos requisitos, en el mismo formato, en los mismos dominios y con referencias.

Así es como pasamos de las impresiones a la evidencia.

¿Que deberías hacer después?

Si la IA está integrada en navegadores, plataformas SaaS, extensiones, copilotos y flujos de trabajo de agentes emergentes, entonces la gobernanza tiene que operar en el momento de la interacción.

Esta guía estandariza los criterios de evaluación para que los proveedores puedan ser evaluados de manera consistente, lado a lado, en relación con los requisitos reales de la gobernanza de la IA empresarial, con descubrimiento, evaluación de riesgos contextuales, gobernanza basada en políticas, aplicación en tiempo real, auditabilidad, ajuste operativo y preparación futura.

Descargue la Guía RFP para evaluar soluciones de control de uso de IA