La rápida integración de la IA Generativa en los flujos de trabajo diarios ha generado una importante brecha de visibilidad para los equipos de seguridad empresarial. Los empleados ya no esperan la aprobación del departamento de TI para adoptar nuevas herramientas. Buscan activamente extensiones de navegador y chatbots web para aumentar su productividad. Esta adopción descentralizada ha vuelto prácticamente ineficaces las defensas perimetrales tradicionales. No se puede proteger lo que no se ve. Para recuperar el control de este ecosistema en expansión, las organizaciones deben iniciar una auditoría integral de IA.

Este proceso no es simplemente un ejercicio de cumplimiento normativo. Es un requisito operativo fundamental para 2025. El objetivo es descubrir las aplicaciones y los flujos de datos específicos que existen actualmente en su entorno. Al identificar el uso no autorizado, a menudo denominado "IA en la sombra", puede comenzar a cuantificar su exposición real al riesgo. Una auditoría eficaz transforma su estrategia de seguridad de la extinción reactiva a la gobernanza proactiva. Le permite comprender no solo qué herramientas están presentes, sino también cómo se utilizan y qué datos corporativos las alimentan.

El alcance oculto de la IA de las sombras

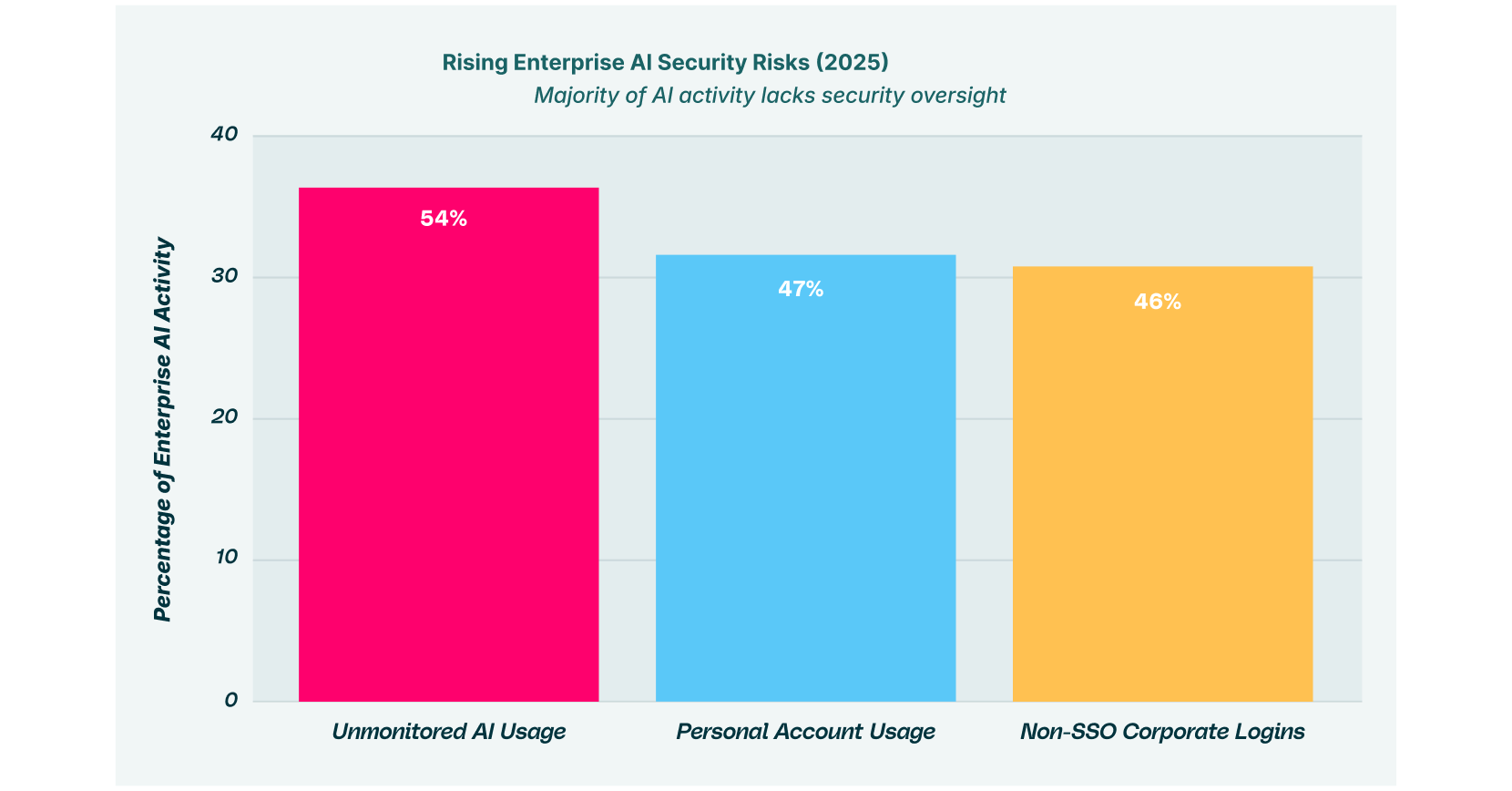

Como se ilustra en la Figura 1, la magnitud de la actividad no supervisada suele ser impactante para los responsables de seguridad. Cuando el 89 % del uso de la IA se produce fuera de la supervisión corporativa, los registros de seguridad estándar no ofrecen una imagen precisa del riesgo. Los empleados utilizan con frecuencia cuentas de correo electrónico personales para iniciar sesión en estos servicios, omitiendo los protocolos de inicio de sesión único (SSO) que normalmente generarían un registro de auditoría. Esto crea un panorama de identidades fragmentado, donde los datos corporativos residen en cuentas a las que el departamento de TI no puede acceder ni desaprovisionar.

Una auditoría de IA es el mecanismo principal para revelar esta actividad invisible. Profundiza más que el análisis de tráfico a nivel de red, que a menudo tiene dificultades para descifrar el contenido de las sesiones web modernas. En cambio, una auditoría centrada en el navegador examina la representación real de las páginas web y la ejecución de extensiones. Este nivel de detalle es necesario para distinguir entre una visita inofensiva a un blog tecnológico y una sesión activa donde se copia código propietario en un chatbot para su optimización.

Esta visibilidad es crucial para mapear su superficie de ataque. Cada extensión de navegador sin monitorizar es un punto de entrada potencial para ataques a la cadena de suministro. Cada cuenta personal de GenAI es un silo potencial para la fuga de datos. Al revelar estos activos ocultos, da el primer paso definitivo hacia un entorno de navegador empresarial seguro.

Construyendo su marco de auditoría de IA

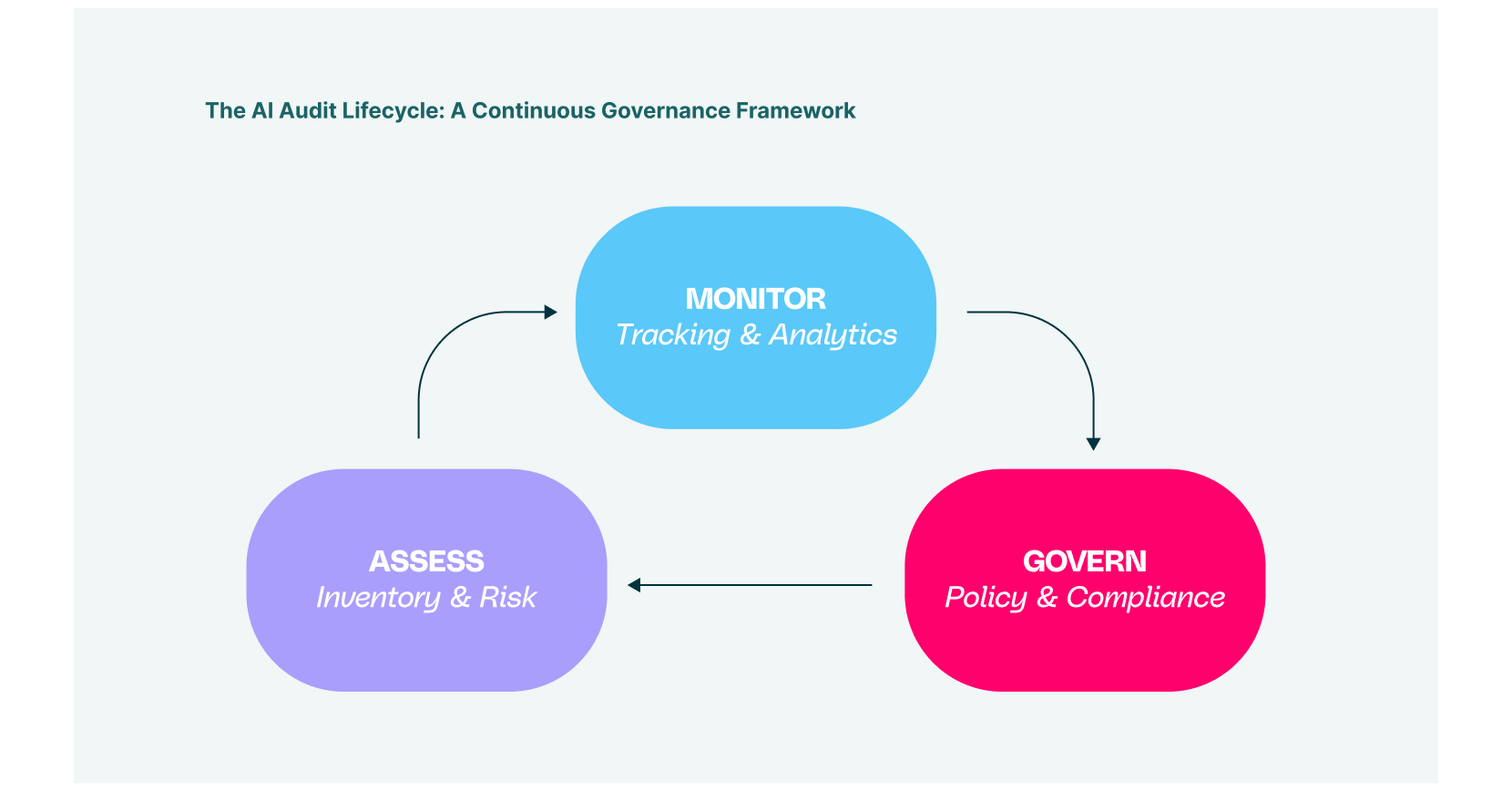

Establecer un enfoque estructurado es esencial para el éxito. Una revisión esporádica o ad hoc solo arrojará resultados parciales. Los líderes de seguridad deberían, en cambio, adoptar un marco cíclico de auditoría de IA que considere la seguridad como un proceso continuo, no como un evento puntual. Este marco debe tener en cuenta la naturaleza cambiante del mercado de GenAI, donde se lanzan nuevos modelos con capacidades novedosas cada semana.

El marco se basa en tres pilares fundamentales: Evaluación, Monitoreo y Gobernanza. Estas fases están interconectadas. Su evaluación fundamenta su estrategia de monitoreo, que a su vez genera los datos necesarios para una gobernanza eficaz. A diferencia de los activos de software estáticos, los modelos de IA evolucionan en función de sus entradas y datos de entrenamiento. Por lo tanto, su marco de auditoría de IA debe ser lo suficientemente ágil como para adaptarse a estos cambios sin necesidad de reescribir completamente sus políticas trimestralmente.

Fase 1: Evaluación y descubrimiento de activos

El ciclo de vida comienza con un riguroso proceso de inventario. La fase inicial de su auditoría de seguridad de IA debe centrarse en el descubrimiento total. Esto va mucho más allá de simplemente enumerar los proveedores a los que paga actualmente. Debe identificar cada punto de contacto digital donde los datos corporativos interactúan con un modelo algorítmico. En la empresa moderna, esta interacción ocurre predominantemente dentro del navegador web, lo que lo convierte en el sensor más crítico de su pila de seguridad.

Los equipos de seguridad necesitan implementar herramientas capaces de inspeccionar el tráfico del navegador para identificar llamadas API a servicios de IA. Esto incluye plataformas importantes como OpenAI y Anthropic, pero también la "cola larga" de miles de herramientas de productividad de IA especializadas. Una auditoría exhaustiva de seguridad de IA suele revelar cientos de aplicaciones no aprobadas, desde correctores gramaticales hasta tomadores de notas automatizados de reuniones, que se han instalado silenciosamente en el flujo de trabajo corporativo.

También es fundamental categorizar estos activos según su perfil de riesgo. ¿La herramienta reclama la propiedad de los datos de entrada? ¿Comparte datos con terceros para fines de capacitación? Su inventario debe diferenciar entre las instancias "Enterprise" que ofrecen garantías de privacidad de datos y las versiones "Consumer" que no las ofrecen. Esta distinción suele ser la diferencia entre un flujo de trabajo seguro y una infracción de cumplimiento.

Fase 2: Análisis profundo de la auditoría de seguridad de IA/ML

Una vez establecido un inventario claro, la atención se centra en los propios modelos. Si bien la mayoría de las empresas consumen IA mediante SaaS, quienes desarrollan herramientas internas se enfrentan a desafíos únicos. En este caso, se requiere una auditoría de seguridad de IA/ML para evaluar la integridad del modelo y su flujo de entrenamiento. Aquí es donde se examinan los componentes de los proyectos internos de IA.

Este tipo específico de auditoría examina la procedencia de sus datos y la seguridad de sus bibliotecas. ¿Utiliza componentes de código abierto con vulnerabilidades conocidas? ¿Están los datos de entrenamiento utilizados en sus modelos libres de ataques de envenenamiento? En una auditoría de seguridad de IA/ML, busca debilidades que un adversario podría explotar para manipular los resultados del modelo o inferir datos de entrenamiento confidenciales mediante ataques de inversión.

Por ejemplo, imagine un escenario en el que un modelo financiero interno se entrena con datos públicos no desinfectados. Si esos datos contienen patrones maliciosos ocultos, el modelo podría ser engañado para que realice predicciones erróneas. Al someter a pruebas de estrés sus modelos propietarios a estas técnicas adversarias, se asegura de que sus innovaciones internas no se conviertan en pasivos. Este nivel de escrutinio es esencial para las organizaciones que implementan agentes de IA de cara al cliente.

Abordar los riesgos de fuga de datos

Quizás la preocupación más urgente para los CISO hoy en día sea la exfiltración de datos. Es increíblemente fácil para un empleado pegar, sin darse cuenta, una lista confidencial de clientes en un chatbot para "formatearla correctamente". Esta simple acción constituye una filtración de datos. Una auditoría de seguridad de datos con IA se centra específicamente en estos flujos de datos para evitar pérdidas irreversibles.

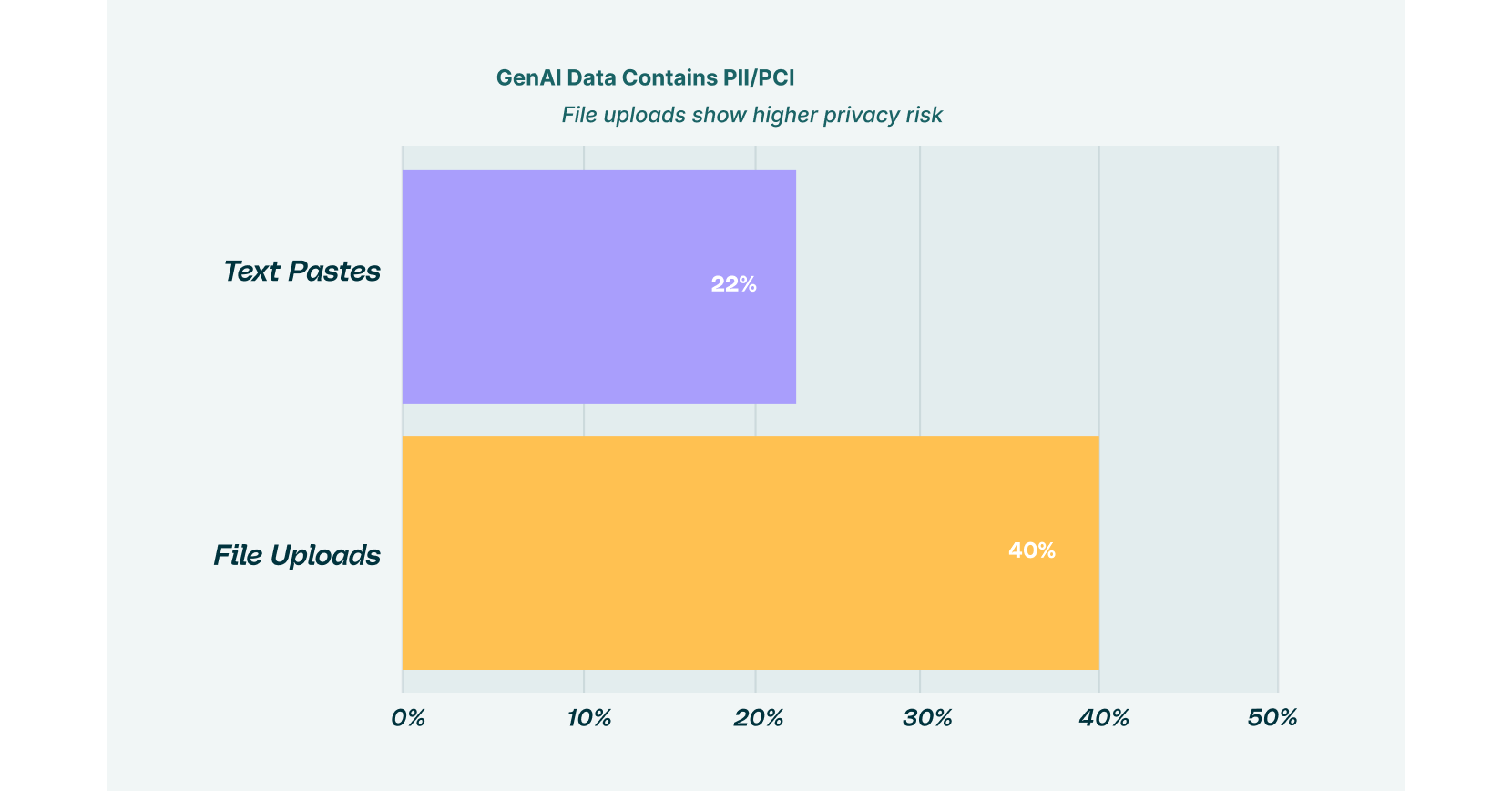

El navegador actúa como puerta de entrada para estos datos. La copia de texto, la carga de archivos y el envío de formularios son los principales mecanismos de exfiltración. Su auditoría debe categorizar estas interacciones con precisión. No basta con saber que un usuario visitó un sitio GenAI; es necesario saber qué envió y por qué.

Realización de una auditoría de seguridad de datos de IA

Como se muestra en la Figura 3, la carga de archivos es particularmente peligrosa. Los documentos suelen contener datos no estructurados, proyecciones financieras, estrategias legales e información personal identificable (PII), que es más difícil de filtrar que simples cadenas de texto. Una rigurosa auditoría de seguridad de datos con IA implementará reglas de DLP (Prevención de Pérdida de Datos) que analizan estas cargas en tiempo real. Esto garantiza que los archivos que coincidan con patrones sensibles se bloqueen incluso antes de que salgan del navegador.

También debe considerar el contexto de los datos. Que un desarrollador inserte código en una herramienta de IA segura y aprobada por la empresa podría ser aceptable. Sin embargo, que ese mismo desarrollador inserte el mismo código en un chatbot público y gratuito es un evento de alto riesgo. Su auditoría de seguridad de datos de IA debería ayudarle a definir estos límites contextuales. Le permite crear políticas con la suficiente precisión para detener el mal comportamiento sin bloquear el trabajo legítimo.

Además, este proceso de auditoría debe evaluar el riesgo de "inyección rápida". Esto ocurre cuando se ocultan instrucciones maliciosas en el contenido que procesa una IA. Si sus empleados utilizan la IA para resumir páginas web o correos electrónicos, podrían ser vulnerables a ataques indirectos que manipulan la IA para exfiltrar datos. Su auditoría debe verificar que las herramientas de seguridad de su navegador puedan detectar y aislar estas posibles amenazas.

Monitoreo continuo con BDR

Una auditoría que finaliza con un informe PDF estático es una auditoría fallida. Los hallazgos deben pasar a un estado de monitoreo activo y continuo. Aquí es donde el concepto de Detección y Respuesta del Navegador (BDR) se vuelve fundamental para el marco de auditoría de IA. Las herramientas de BDR proporcionan la telemetría necesaria para mantener la fase de "Monitoreo" del ciclo de vida, convirtiendo una instantánea en una transmisión de video en vivo de su postura de seguridad.

BDR ofrece visibilidad del DOM (Modelo de Objetos del Documento) de la página web. Esto permite a los equipos de seguridad ver exactamente cómo interactúan los usuarios con las herramientas de IA en tiempo real. Puede rastrear qué extensiones se están instalando, qué formularios se están completando y adónde se transfieren los datos. Este flujo continuo de datos garantiza que su auditoría de IA siga siendo relevante incluso cuando el comportamiento del usuario cambia.

Esta capacidad en tiempo real es crucial para identificar desviaciones. Con el tiempo, las herramientas aprobadas pueden cambiar sus condiciones de servicio o los empleados pueden volver a usar cuentas personales no autorizadas. La monitorización continua detecta estos cambios de inmediato. Esto le permite intervenir en cuanto surge un nuevo riesgo, en lugar de esperar al siguiente ciclo de evaluación anual.

Gobernanza y aplicación de políticas

La última pieza del rompecabezas es la gobernanza. Regulaciones como la Ley de IA de la UE y diversas leyes de privacidad de datos exigen una estricta rendición de cuentas. Su marco de auditoría de IA debe generar los artefactos necesarios para demostrar el cumplimiento. Esto implica documentar no solo qué herramientas se utilizan, sino también cómo se toman las decisiones sobre su aprobación y uso.

Si una auditoría de seguridad de IA/ML revela un modelo de alto riesgo, el registro de gobernanza debe mostrar las medidas de remediación adoptadas. ¿Desmanteló el modelo? ¿Implementó medidas de seguridad adicionales? La generación de informes automatizados es vital en este caso. Los equipos de seguridad no pueden permitirse pasar semanas compilando manualmente hojas de cálculo para los auditores. Los informes basados en paneles de control que extraen directamente la telemetría del navegador garantizan que la evidencia esté siempre lista y sea precisa.

Esta capa de gobernanza también permite políticas de "coaching". En lugar de un enfoque binario de "permitir" o "bloquear", que a menudo lleva a los usuarios a la TI en la sombra, se puede implementar la formación del usuario en tiempo real. Si un usuario intenta una acción arriesgada, el navegador puede intervenir con una ventana emergente que explica el riesgo y sugiere una alternativa segura. Esto respeta la intención del usuario de ser productivo, a la vez que se aplican los límites de seguridad necesarios.

¿Cómo integrar IA en su empresa?

La integración de la IA en la empresa es inevitable. Las organizaciones que prosperen en esta nueva era serán aquellas que puedan aprovechar su potencial de forma segura sin comprometer sus datos. Una auditoría de IA especializada es el paso fundamental en este proceso. Despeja la niebla de la IA en la sombra, identifica las posibles filtraciones de datos y establece un ritmo de mejora continua.

Al adoptar un marco de auditoría de IA centrado en el navegador, la seguridad se centra exactamente en el trabajo. Obtiene la visibilidad para evaluar los riesgos con precisión, la capacidad de supervisar las interacciones en tiempo real y la sabiduría para gestionar con precisión. Comience su evaluación hoy mismo. Inventaria sus activos, analiza sus flujos de datos y protege el navegador. El futuro de su inteligencia empresarial depende de ello.