Los centros de operaciones de seguridad se enfrentan a una realidad diferente en 2026 que hace tan solo unos años. La imagen de un hacker humano escribiendo código manualmente está prácticamente obsoleta. Hoy en día, agentes de software autónomos ejecutan campañas complejas sin supervisión humana directa. Un ciberataque impulsado por IA no es una predicción del futuro. Es el estándar operativo dominante para los equipos de defensa empresarial.

La economía de los ataques ha cambiado radicalmente. La IA generativa redujo la barrera de entrada tan drásticamente que la ingeniería social sofisticada y la inyección de código ahora están disponibles para cualquiera con una suscripción a LLM en la dark web. Esta accesibilidad inundó el perímetro corporativo. Ahora vemos ataques de gran volumen y alta fidelidad que las pasarelas web seguras (SWG) tradicionales no pueden analizar.

La escalada de las amenazas de la IA en 2026

Los ataques se construyen de forma diferente ahora. El malware tradicional se basaba en firmas estáticas que los defensores podían catalogar y bloquear. En cambio, un ciberataque moderno de IA es polimórfico. Reescribe su propio código para evadir la detección. Adapta scripts de ingeniería social en tiempo real basándose en el perfil de LinkedIn del objetivo o en conversaciones de correo electrónico recientes.

Esta adaptabilidad crea un punto ciego significativo para las defensas estándar. Cuando un agente inteligente genera un ataque, no deja una huella reconocible hasta su ejecución. Los datos de principios de 2025 pintaron un panorama desolador de esta escalada. Las cifras de medios sintéticos y robo de identidad son particularmente alarmantes.

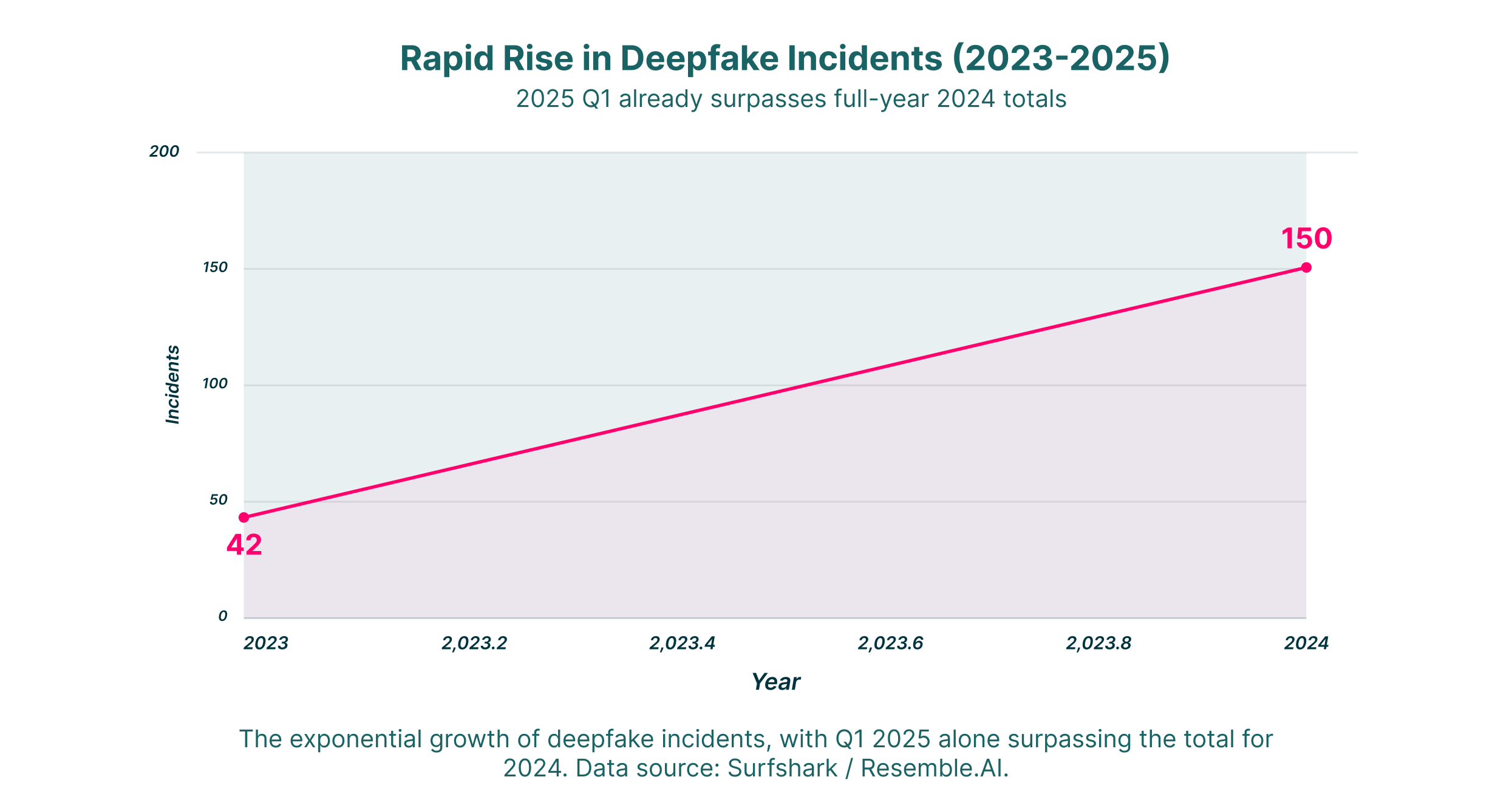

Visualizando la oleada

Estos incidentes no crecieron de forma lineal. Las herramientas accesibles para la clonación de voz y la síntesis de vídeo se generalizaron. En consecuencia, la frecuencia de los ataques que utilizaban estas tecnologías se disparó.

La trayectoria de los incidentes de deepfake revela una tendencia preocupante en el entorno de amenazas moderno. Como ilustra el gráfico, los incidentes reportados se dispararon. Tan solo en el primer trimestre de 2025 se registraron 179 incidentes, superando el total del año anterior. Este ascenso vertical pone de manifiesto la accesibilidad que han adquirido las herramientas de IA generativa para los actores maliciosos. Un ciberataque impulsado por IA ya no requiere recursos estatales. Solo necesita una suscripción a una herramienta de medios sintéticos. Estos datos confirman que los ciberataques de IA que involucran clonación de voz y fabricación de video están pasando de ser riesgos teóricos a realidades operativas diarias para los equipos de seguridad.

La era del ciberataque de la IA agente

El desarrollo más peligroso en el entorno de seguridad actual es el ciberataque de la IA agentic. A diferencia de las herramientas pasivas que esperan a un operador humano, la IA agentic opera con objetivos específicos y la autonomía para alcanzarlos.

Imagine un escenario en el que un agente malicioso recibe una tarea: "Obtener credenciales administrativas para el entorno de Salesforce". Este agente de IA escanea repositorios públicos en busca de patrones de correo electrónico. Identifica al personal clave. Redacta correos electrónicos de phishing contextualmente perfectos. Incluso mantiene conversaciones de chat en tiempo real con el servicio de asistencia para restablecer contraseñas. Funciona 24/7. Prueba miles de vectores simultáneamente hasta que uno funciona correctamente.

Esta automatización permite la caza mayor a gran escala. Anteriormente, los atacantes humanos optaban por elegir entre ataques masivos de tipo "spray" o el phishing selectivo de alto impacto. Los sistemas de IA para ciberataques permiten a los delincuentes lanzar millones de ataques hiperpersonalizados simultáneamente.

Ejemplos comunes de ciberataques de IA

Los defensores deben analizar estas amenazas para detenerlas. Los vectores más frecuentes que rastreamos en 2026 incluyen:

- Suplantación de identidad de ejecutivos mediante deepfake: Los atacantes utilizan GenAI para clonar la voz o la imagen en vídeo de un ejecutivo de alto nivel. Estas falsificaciones autorizan transferencias bancarias urgentes en videollamadas. La fidelidad es lo suficientemente alta como para engañar a empleados que han trabajado con el ejecutivo durante años.

- Inyección de malware polimórfico: Código que cambia constantemente de estructura para eludir las firmas antivirus. La IA genera hashes de archivo únicos para cada descarga. Esto invalida la detección basada en hashes.

- Descubrimiento automatizado de vulnerabilidades: Los escáneres de IA procesan miles de líneas de código abierto utilizado por una empresa en lugar de buscar errores manualmente. Identifican vulnerabilidades de día cero y escriben scripts de explotación antes de que los desarrolladores puedan aplicar parches.

- Jailbreaking y envenenamiento de LLM: Los atacantes envían mensajes maliciosos a los chatbots internos de la empresa. Engañan a los bots para que revelen datos confidenciales o información personal identificable (PII). Esta técnica se conoce como "inyección de mensajes".

Ingeniería social y la precisión de la IA

El factor humano sigue siendo el objetivo principal de la superficie de ataque. Sin embargo, identificar un correo electrónico de phishing por una gramática deficiente ya no es una estrategia válida. Un sofisticado ataque de ciberseguridad con IA crea comunicaciones que son indistinguibles de la correspondencia comercial legítima.

Estos sistemas analizan el tono, el vocabulario y la estructura de las oraciones de una cuenta de correo electrónico comprometida. Lo imitan a la perfección. Si un empleado suele empezar sus correos electrónicos con "Hola equipo" y terminarlos con "Saludos", la IA replica ese patrón. Este nivel de imitación contradice el consejo habitual de "confiar en tu intuición" que se suele dar en los cursos de seguridad.

La brecha de eficacia

El impacto de esta mayor fidelidad es medible. Comparamos los intentos de phishing generados por humanos con los generados por sistemas autónomos. La diferencia en la susceptibilidad de los empleados es alarmante.

La formación tradicional en concienciación sobre seguridad suele basarse en la identificación de errores gramaticales o expresiones inapropiadas. Estos datos demuestran por qué estos métodos están obsoletos. En estudios controlados, un ciberataque con IA agentic logró una asombrosa tasa de clics del 54 %. La IA elaboró y adaptó el mensaje de forma autónoma. Esto es casi cinco veces superior a los intentos escritos por humanos. La precisión que generan los sistemas de IA para ciberataques permite una hiperpersonalización a gran escala. Estos correos electrónicos son prácticamente indistinguibles de la correspondencia legítima. Esta brecha de eficiencia sugiere que los atacantes que utilizan herramientas de ciberseguridad con IA pueden comprometer a las organizaciones con una fracción del esfuerzo que antes requería.

Por qué los navegadores tradicionales no pueden detener un ciberataque de IA

El navegador es la interfaz principal del trabajo moderno. Sin embargo, sigue siendo el componente más descuidado de la seguridad. Los navegadores tradicionales como Chrome y Edge se diseñaron para una web que ya no existe. Se crearon para páginas estáticas y amenazas predecibles.

Ante un ciberataque impulsado por IA, el navegador suele convertirse en el punto de fallo. Los sitios de phishing generados por IA pueden generarse, recopilar credenciales y desaparecer en milisegundos. Esto ocurre más rápido de lo que una base de datos de filtrado de URL puede actualizarse. Además, el auge del «Shadow SaaS» implica que los empleados introducen constantemente datos confidenciales en herramientas GenAI no autorizadas. Esto crea un riesgo de exfiltración masivo que los firewalls estándar no pueden detectar ni detener.

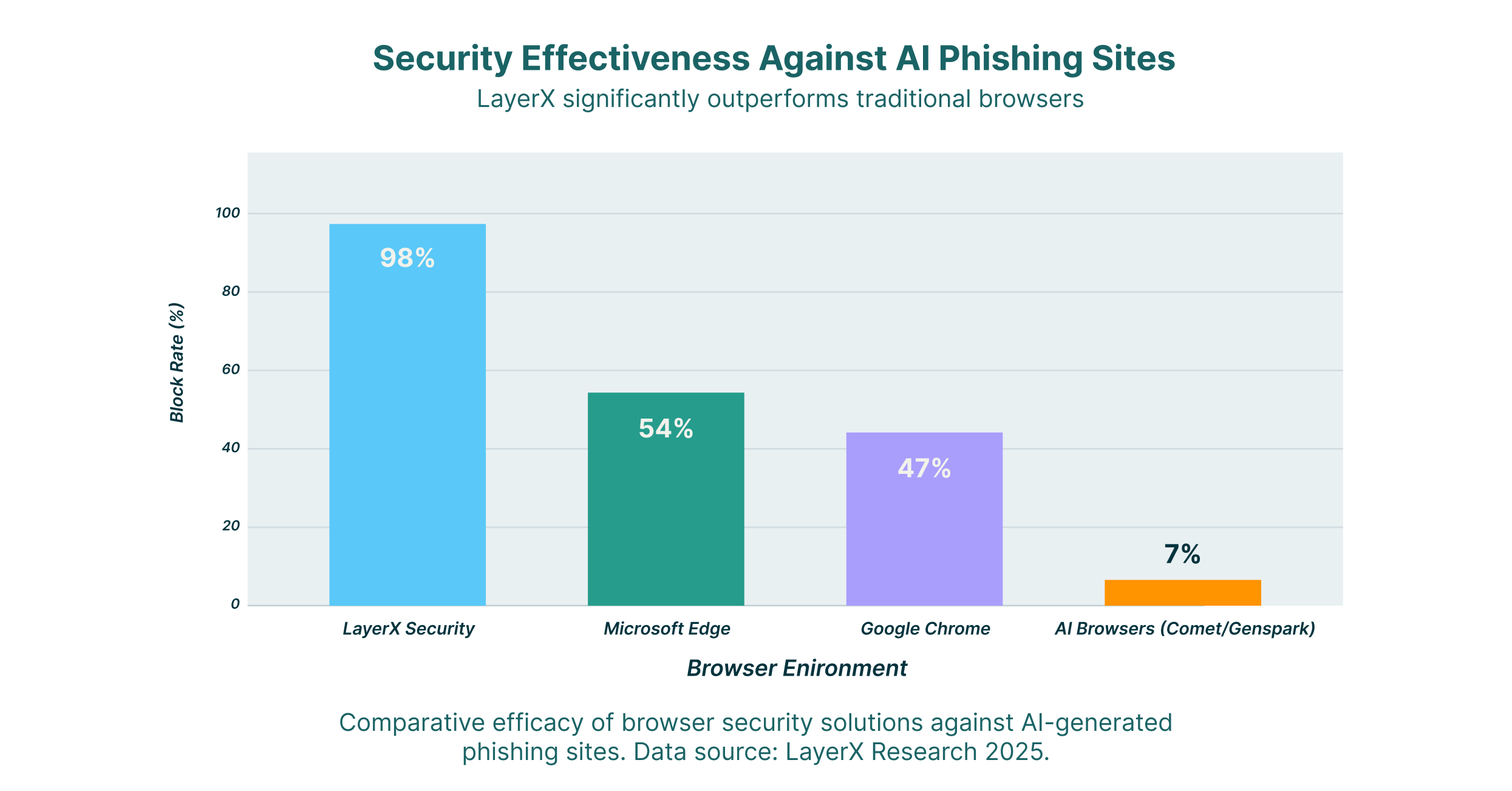

Un fracaso comparativo

Los navegadores estándar no detectan amenazas basadas en la intención. Esto supone una vulnerabilidad crítica. Comparamos la eficacia de diferentes entornos de navegador con la última ola de sitios de phishing generados por IA.

Esta comparación expone una vulnerabilidad crítica en el ecosistema de navegadores empresariales. Navegadores estándar como Edge y Chrome detienen aproximadamente la mitad de los intentos de phishing. Sin embargo, tienen dificultades para detectar las sofisticadas técnicas de ofuscación utilizadas en un ciberataque moderno de IA. Lo más alarmante es que los navegadores con IA que priorizan las funciones de agente sobre la seguridad bloquearon menos del 10 % de las amenazas. En contraste, los navegadores de LayerX... Navegador empresarial seguro Las capacidades demostraron una tasa de bloqueo del 98 %. Esta disparidad subraya que la defensa contra un ciberataque lanzado por la IA requiere una capa de seguridad dedicada. Esta capa debe analizar la intención en tiempo real en lugar de depender de listas de bloqueo estáticas que GenAI elude fácilmente.

La mecánica de un ataque cibernético de IA

Comprender las fases operativas de estos ataques revela por qué son difíciles de interceptar. Un ataque estándar de ciberseguridad con IA sigue un ciclo de vida que avanza más rápido de lo que los equipos de respuesta humanos pueden gestionar.

1. Reconocimiento y elaboración de perfiles

La IA analiza redes sociales, directorios corporativos y comunicados de prensa. Crea un gráfico de conocimiento de la organización objetivo. Identifica relaciones, como las líneas jerárquicas, y proveedores, como las plataformas SaaS que utiliza la empresa.

2. Armamentización y entrega

La IA del ciberataque utiliza los datos recopilados para crear señuelos muy específicos. Si el objetivo usa Salesforce, la IA genera un clon de la página de inicio de sesión de Salesforce alojada en un dominio aparentemente legítimo. A continuación, envía un correo electrónico que hace referencia a un proyecto real y reciente mencionado en la cuenta de LinkedIn del objetivo.

3. Ejecución y exfiltración

El ataque se ejecuta una vez que el usuario interactúa. El robo de credenciales ocurre instantáneamente. En el caso del malware, la IA podría usar técnicas de "descarga automática". Estas técnicas ejecutan código en la memoria del navegador sin tocar el disco. Esto evita los agentes de detección de endpoints (EDR).

Vectores tradicionales vs. vectores con IA

Podemos observar las diferencias en la metodología para comprender mejor el cambio:

| Característica | Ciberataque tradicional | Ciberataque impulsado por IA |

| SCALE | Lineal (Un atacante, un objetivo) | Exponencial (Un agente, millones de objetivos) |

| Personalización | Bajo (Plantillas genéricas) | Alto (contenido sensible al contexto) |

| Adaptabilidad | Estático (código preescrito) | Dinámico (reescritura de código polimórfico) |

| Speed (Rapidez) | Horas a días | Milisegundos a Segundos |

| Barrera de entrada | Alta habilidad técnica | Bajo (Ingeniería rápida) |

Defensa de la superficie de ataque del navegador a la nube

La única manera de contrarrestar eficazmente un ciberataque de IA agentic es implementar defensas igualmente inteligentes. Estas defensas deben integrarse directamente en el espacio de trabajo. Aquí es donde la Detección y Respuesta del Navegador (BDR) se convierte en el control esencial.

LayerX ofrece esta capacidad colocando un sensor directamente en la sesión del navegador. A diferencia de un proxy de red que solo ve tráfico cifrado, LayerX analiza el comportamiento de la página web durante su renderización. Puede detectar anomalías sutiles en un sitio web generado por IA que el ojo humano y las herramientas de red pasan por alto. Algunos ejemplos incluyen estructuras de código inconsistentes o elementos superpuestos invisibles.

Neutralización del SaaS en la sombra

Un componente importante de la amenaza de la IA implica que los empleados expongan datos sin saberlo. Cuando un usuario inserta código propietario en ChatGPT o una herramienta similar para depurarlo, filtra su propiedad intelectual. LayerX aplica políticas granulares. Estas impiden la inserción de datos confidenciales en aplicaciones GenAI no autorizadas, a la vez que permiten que la herramienta se utilice para tareas inofensivas. Esta capacidad neutraliza el riesgo de ciberataques internos de IA, donde la amenaza reside en la negligencia y no en la malicia.

Respuesta estratégica para líderes de seguridad

Los CISO y arquitectos de seguridad que operen en 2026 deben cambiar de estrategia. El enfoque debe pasar de la «prevención en el perímetro» a la «protección en el punto de interacción».

- Implemente visibilidad a nivel de navegador: No se puede detener lo que no se puede ver. Obtener telemetría de los eventos del navegador es fundamental para identificar las primeras señales de un ciberataque impulsado por IA.

- Adopte la detección basada en intención: Elimine el bloqueo basado en reputación. Un dominio comprado hace cinco minutos no tiene reputación. Sin embargo, su comportamiento revela su intención. Solicitar credenciales o analizar los movimientos del ratón son indicadores claros.

- Aislar sesiones de alto riesgo: uso Aislamiento de navegador de confianza cero Para garantizar la seguridad. Incluso si un usuario hace clic en un enlace malicioso, el código se ejecuta en un contenedor desechable en lugar de en el endpoint.

- Verificación continua: La identidad es el nuevo perímetro. Las comprobaciones de autenticación continua analizan el comportamiento del usuario. Pueden detectar cuándo un bot ha pirateado una sesión o cuándo un usuario está siendo manipulado por un deepfake.

Los ataques de ciberseguridad con IA representan un cambio permanente en el entorno de amenazas. Las herramientas disponibles para los atacantes son potentes, accesibles y evolucionan a diario. Sin embargo, las empresas pueden retomar el control protegiendo el navegador. Esta es la principal vía de acceso para estos ataques. La plataforma BDR de LayerX convierte el navegador, la mayor vulnerabilidad de la organización, en su línea de defensa más eficaz. Esto garantiza la continuidad del negocio, independientemente de la complejidad de la amenaza.