Una seguridad eficaz ahora exige que controlemos cómo interactúan los empleados con los modelos generativos, no solo los modelos en sí. Las 10 principales prácticas de gobernanza de la IA para 2026 se centran en asegurar la "última milla" de la adopción por parte del usuario, donde los datos salen de la empresa y entran en el navegador.

¿Qué son las prácticas de gobernanza de la IA y por qué son importantes?

La gobernanza de la IA ya no es un marco teórico; es un flujo de trabajo de seguridad activo diseñado para gestionar los riesgos del consumo de IA generativa. Estas prácticas cambian el enfoque de la validación de las ponderaciones del modelo al control del punto de uso. Los equipos de seguridad ahora deben controlar el momento exacto en que un empleado introduce los datos de un cliente en un chatbot o instala una extensión de navegador basada en IA.

La brecha más crítica en la gobernanza moderna es la "última milla"; la interfaz del navegador donde los usuarios interactúan con las herramientas SaaS y GenAI. Las defensas de red tradicionales no pueden detectar el tráfico cifrado dentro de una sesión de chat, y los controles basados en API suelen reaccionar demasiado tarde. Una gobernanza eficaz requiere visibilidad y cumplimiento en tiempo real directamente en el espacio de trabajo del empleado para evitar la fuga de datos y bloquear las entradas maliciosas antes de que se procesen.

Tendencias clave en gobernanza de la IA que habrá que tener en cuenta en 2026

La transición hacia controles de seguridad nativos del navegador es la tendencia dominante para 2026. Los líderes de seguridad están abandonando los proxies de red engorrosos que perjudican la experiencia del usuario y optando por extensiones de navegador ligeras. Estas herramientas se integran directamente en el flujo de trabajo, lo que permite a las organizaciones supervisar el contexto de los avisos, inspeccionar los permisos de las extensiones y redactar datos confidenciales sin redirigir el tráfico.

Otro avance importante es el auge de la gobernanza basada en la identidad para agentes de IA autónomos. A medida que la IA agente empieza a actuar en nombre de los usuarios, programando reuniones, escribiendo código o consultando bases de datos, las listas de permitidos estáticas están fallando. Las estrategias de gobernanza están evolucionando para implementar controles de acceso basados en roles (RBAC) que limitan las acciones de un agente de IA en función de los privilegios específicos del usuario y la confidencialidad de los datos.

Las 10 mejores herramientas de gobernanza de IA para 2026

A continuación se presentan las principales soluciones que permiten la adopción segura de IA a través de la aplicación, la visibilidad y la gestión de riesgos.

| Práctica | Enfoque clave | Ideal para |

| LayerX | Aplicación basada en navegador | Cerrando la brecha de seguridad de la “última milla” |

| Seguridad armónica | Descubrimiento de IA de sombras | Obtener visibilidad completa sobre la adopción de IA |

| Seguridad inmediata | Defensa contra la inyección rápida | Cómo proteger las interacciones de GenAI del uso indebido |

| Seguridad Lasso | Control de acceso basado en roles | Aplicación de políticas en función del contexto |

| IA de Nightfall | Prevención de pérdida de datos (DLP) | Prevención de fugas de información personal identificable (PII)/IP en tiempo real |

| Seguridad AIM | Inventario de activos de IA | Seguimiento centralizado de todas las herramientas de IA |

| Testigo de IA | Puntuación de riesgo automatizada | Agilizar la aprobación de herramientas de IA seguras |

| Knóstico | Registro de auditoría y cumplimiento | Cumplir con los requisitos reglamentarios |

| Polímero | Capacitación y concientización de los empleados | Construyendo una cultura consciente de la seguridad |

| lagora | Monitoreo continuo | Detección de anomalías y desviaciones de políticas |

1. Capa X

LayerX es una plataforma de seguridad para navegadores que funciona como una extensión ligera, colocando controles de gobernanza directamente donde los usuarios interactúan con la IA. Aborda la brecha de la "última milla" al monitorear cada pulsación de tecla, acción de pegar y carga de archivos en tiempo real. Esto permite a los equipos de seguridad implementar políticas granulares, como bloquear el pegado de código fuente en ChatGPT o impedir la instalación de extensiones de IA de alto riesgo, sin interrumpir el flujo de trabajo del usuario ni requerir un navegador empresarial dedicado.

La plataforma destaca por ofrecer una visibilidad exhaustiva del uso de la IA autorizada y de la IA en la sombra en dispositivos administrados y BYOD. LayerX analiza el contexto de las interacciones del navegador para distinguir entre tareas seguras y comportamientos de riesgo, garantizando así que los datos corporativos confidenciales siempre estén protegidos. Su enfoque permite a las organizaciones adoptar herramientas GenAI de forma segura, mitigando riesgos como la exfiltración de datos y el robo de cuentas desde el origen.

2. Seguridad armónica

Harmonic Security se centra en resolver el problema de la IA en la sombra identificando y categorizando todas las herramientas de IA que utilizan los empleados, independientemente de si han sido aprobadas formalmente. En lugar de depender de listas de bloqueo estáticas, Harmonic utiliza pequeños modelos de lenguaje especializados para analizar la intención y el contenido de las transferencias de datos. Esto le permite distinguir entre una consulta inofensiva y una carga riesgosa de datos regulados, lo que habilita una postura de "seguridad por defecto" que permite a los empleados usar nuevas herramientas sin exponer a la organización a riesgos.

La plataforma crea un mapa completo de la adopción de IA en toda la empresa, lo que proporciona a los responsables de seguridad una visión clara de qué departamentos utilizan qué herramientas. Al comprender el contexto empresarial del uso de la IA, Harmonic ayuda a los equipos a elaborar políticas que impulsan la innovación, a la vez que identifica o bloquea automáticamente las aplicaciones de alto riesgo que no cumplen con los estándares de seguridad.

3. Seguridad inmediata

Prompt Security se especializa en la defensa contra ataques de inyección rápida, una vulnerabilidad crítica en la que entradas maliciosas manipulan el comportamiento de GenAI. Su solución monitoriza el Modelo de Objetos de Documento (DOM) y las entradas del usuario para detectar intentos de jailbreaking de modelos o exfiltración de datos mediante comandos ocultos. Este enfoque los convierte en una capa de defensa esencial para las organizaciones que desarrollan o implementan aplicaciones GenAI públicas donde la entrada del usuario no es totalmente fiable.

Además de la protección contra inyecciones, Prompt Security proporciona herramientas para depurar las entradas y verificar las salidas, garantizando que los LLM no generen contenido dañino inadvertidamente ni revelen instrucciones del sistema. Su tecnología se integra en el proceso de desarrollo, lo que ayuda a los equipos de ingeniería a proteger sus funciones de IA antes de que lleguen a producción.

4. Seguridad de Lasso

Lasso Security ofrece Control de Acceso Basado en Roles (RBAC) contextual para GenAI, lo que garantiza que los usuarios solo puedan acceder a los modelos y datos adecuados para su función laboral. Su plataforma va más allá de los simples registros de acceso para implementar políticas basadas en la identidad del usuario, la confidencialidad de los datos y el caso de uso previsto. Este control granular evita la infiltración de accesos, donde los empleados conservan el acceso a potentes herramientas de IA que ya no necesitan.

La solución también monitorea anomalías en tiempo real, como cuando un empleado de marketing consulta repentinamente a un asistente de programación las credenciales de la base de datos. Al correlacionar la identidad del usuario con patrones de comportamiento, Lasso ayuda a las organizaciones a detectar y detener el uso indebido interno de las herramientas de IA antes de que provoque una filtración de datos.

5. IA de Nightfall

Nightfall AI incorpora la Prevención de Pérdida de Datos (DLP) avanzada a la era de la IA, utilizando detectores de aprendizaje automático entrenados con millones de muestras para identificar datos confidenciales con alta precisión. Su solución escanea datos en movimiento y en reposo, detectando información personal identificable (PII), historiales médicos y secretos como claves API antes de que se carguen a las plataformas GenAI. Los detectores de Nightfall están optimizados para comprender el contexto, lo que reduce significativamente los falsos positivos en comparación con las herramientas DLP tradicionales basadas en expresiones regulares.

Para la gobernanza de la IA, Nightfall se integra con los flujos de trabajo del navegador y la nube para redactar o bloquear información confidencial en tiempo real. Esta capacidad permite a los empleados usar herramientas de productividad como chatbots, a la vez que garantiza el estricto cumplimiento de las normativas como el RGPD y la HIPAA, incluso en solicitudes no estructuradas.

6. Seguridad AIM

AIM Security se centra en la creación de un inventario completo de activos de IA, que funciona como una "lista de materiales de IA" para la empresa. Su plataforma analiza el entorno de TI para descubrir todos los modelos implementados, los conjuntos de datos de entrenamiento y las aplicaciones integradas con IA. Esta vista centralizada permite a los equipos de seguridad supervisar el ciclo de vida de cada activo de IA, desde la adquisición hasta el desmantelamiento, garantizando así que ningún modelo "zombi" quede en funcionamiento sin supervisión.

Al mantener un inventario en tiempo real, AIM Security ayuda a las organizaciones a identificar dependencias y posibles riesgos para la cadena de suministro. Si se detecta una vulnerabilidad en un modelo de código abierto específico, los administradores pueden localizar instantáneamente cada instancia de ese modelo dentro de su infraestructura y aplicar los parches o mitigaciones necesarios.

7. Testigo de la IA

Witness AI ofrece una puntuación de riesgo automatizada para agilizar la evaluación y aprobación de nuevas herramientas de IA. Su plataforma asigna una puntuación de riesgo dinámica a las aplicaciones según sus términos de servicio, prácticas de gestión de datos y certificaciones de cumplimiento. Esto permite a los equipos de seguridad evaluar rápidamente las solicitudes de nuevo software, reemplazando las largas revisiones manuales con decisiones basadas en datos.

La plataforma también monitorea continuamente el nivel de riesgo de las herramientas aprobadas, alertando a los administradores si un proveedor cambia su política de privacidad o sufre un incidente de seguridad. Esta evaluación continua garantiza que la lista de software aprobado de la organización se mantenga precisa y segura a lo largo del tiempo.

8. Cnóstico

Knostic aborda el desafío de la auditoría y la autorización registrando con exactitud quién accede a qué información dentro de los sistemas de IA de una organización. Su solución responde a la pregunta de "necesidad de saber", garantizando que las herramientas GenAI no omitan los permisos de archivo existentes para revelar documentos confidenciales a usuarios no autorizados. Knostic genera registros de auditoría detallados que asignan las solicitudes a los documentos específicos utilizados para generar la respuesta.

Este nivel de transparencia es vital para las industrias reguladas que deben demostrar un control estricto sobre el flujo de información. Los controles de autorización de Knostic previenen la "fuga de conocimiento", donde un LLM revela inadvertidamente decisiones estratégicas sensibles o datos de RR. HH. a empleados que no deberían tener acceso a esa información.

9. Polímero

Polymer adopta un enfoque de gobernanza centrado en el ser humano mediante el uso de "empujoncitos" y capacitación en tiempo real para construir una cultura de seguridad. En lugar de simplemente bloquear una acción arriesgada, el sistema de Polymer interviene con una ventana emergente que explica por qué La acción es arriesgada y sugiere una alternativa más segura. Esta capacitación inmediata ayuda a reducir la fatiga por alerta y anima a los empleados a participar activamente en el proceso de seguridad.

Su plataforma es especialmente eficaz para organizaciones que buscan reducir la carga de sus equipos de SOC. Al permitir a los usuarios autocorregir errores de bajo riesgo, Polymer permite a los analistas de seguridad centrarse en las amenazas reales a la vez que mejora constantemente los hábitos generales de gestión de datos de la organización.

10. Lakera

Lakera se especializa en la monitorización continua y el trabajo en equipo para aplicaciones de IA, con el fin de detectar desviaciones de políticas y ataques adversarios. Su plataforma, Lakera Guard, actúa como un cortafuegos para los LLM, interponiéndose entre el usuario y el modelo para filtrar inyecciones rápidas, fugas de seguridad y entradas tóxicas. Estas pruebas continuas garantizan que los modelos de IA se mantengan alineados con las directrices de seguridad, incluso cuando los atacantes evolucionan sus técnicas.

Lakera también proporciona una base de datos de indicaciones y vectores de ataque conocidos, lo que permite a las organizaciones comparar sus defensas contra las amenazas más recientes. Esta postura proactiva ayuda a los desarrolladores a identificar las debilidades de sus aplicaciones de IA antes de implementarlas en producción, lo que reduce el riesgo de una falla de seguridad pública.

Cómo elegir el mejor proveedor de gobernanza de IA

- Priorice la visibilidad de la “IA en la sombra” para comprender el alcance completo de las herramientas no administradas que sus empleados ya están usando.

- Seleccione una solución con aplicación nativa del navegador para proteger los datos en el punto de entrada sin enrutar el tráfico a través de servidores proxy complejos.

- Asegúrese de que la herramienta ofrezca controles granulares basados en identidad para que pueda habilitar diferentes niveles de acceso para desarrolladores, RR. HH. y marketing.

- Busque capacidades de remediación automatizadas que puedan redactar datos confidenciales en tiempo real en lugar de simplemente bloquear toda la aplicación.

- Verifique que el proveedor admita auditorías de cumplimiento continuo para satisfacer estándares regulatorios como ISO 42001 y la Ley de IA de la UE.

Preguntas Frecuentes

¿Qué es la gobernanza de la IA en términos prácticos de seguridad?

En la práctica, la gobernanza de la IA es el conjunto de controles técnicos y políticas que determinan cómo interactúan los empleados y las aplicaciones con la IA generativa. Implica supervisar las solicitudes de datos confidenciales, verificar la postura de seguridad de los proveedores de IA y garantizar que los resultados generados por la IA sean precisos y seguros.

¿En qué se diferencia la gobernanza de la IA de la seguridad del modelo de IA?

La seguridad del modelo de IA se centra en proteger los pesos, los parámetros y la infraestructura del propio modelo contra robos o manipulaciones. La gobernanza de la IA es más amplia y se centra en... personal del modelo; garantizando que los datos que lo alimentan sean compatibles, que los usuarios que acceden a él estén autorizados y que los riesgos comerciales de la implementación estén gestionados.

¿Qué deberíamos controlar primero: las indicaciones, los archivos o el acceso a las herramientas?

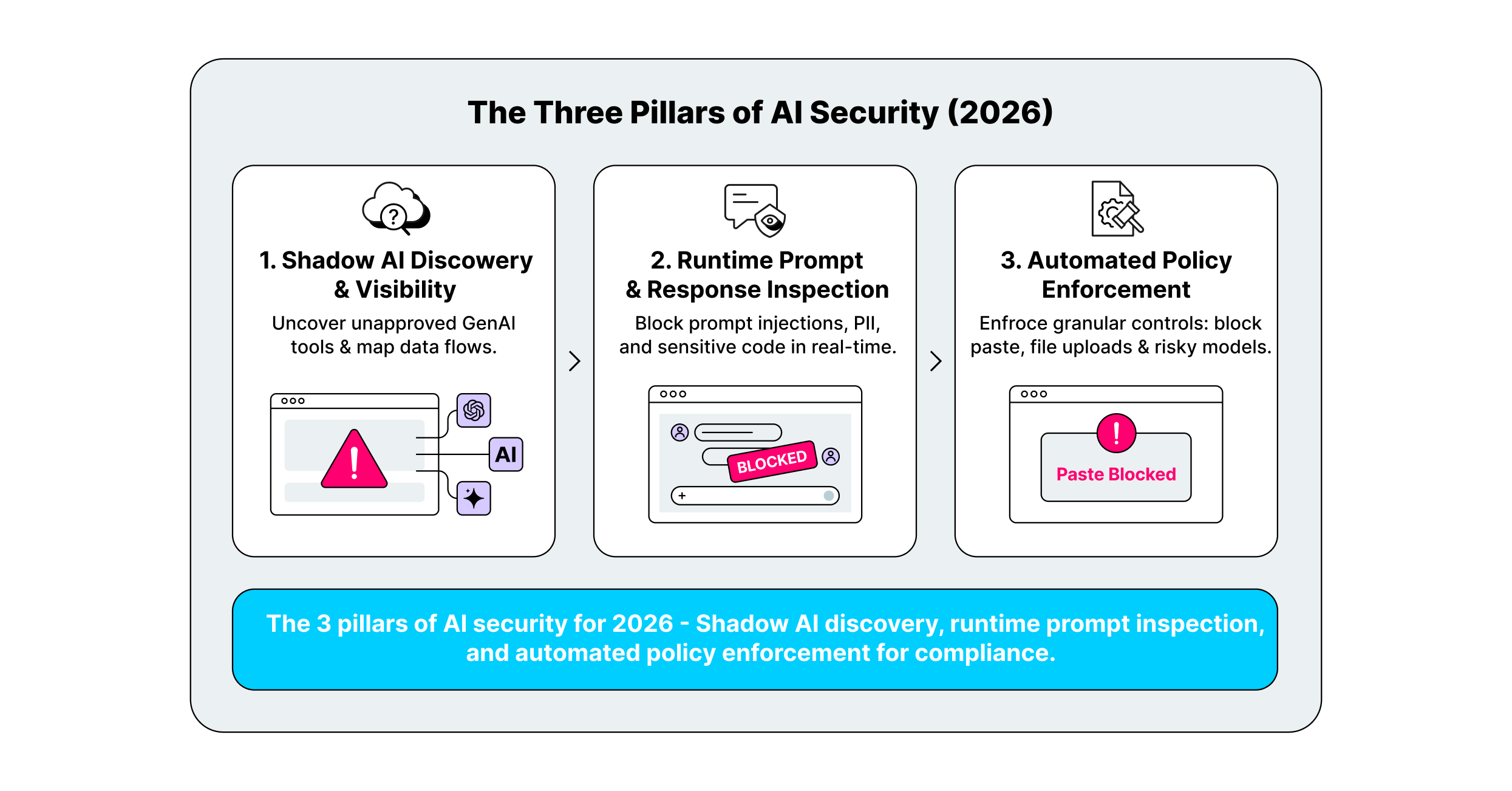

Primero debe controlar la visibilidad y el acceso a las herramientas. No puede controlar lo que no puede ver, por lo que identificar qué herramientas se utilizan (IA en la sombra) es fundamental. Una vez establecida la visibilidad, puede implementar controles para las solicitudes y la carga de archivos para evitar la fuga de datos.

¿Necesitamos un navegador empresarial dedicado a la gobernanza de la IA?

No, no necesita un navegador empresarial dedicado. Las plataformas de seguridad de navegador modernas, como LayerX, funcionan como extensiones que se integran con navegadores estándar como Chrome y Edge. Esto le permite aplicar controles de gobernanza y seguridad de nivel empresarial sin obligar a los usuarios a cambiar a una interfaz de navegador nueva y desconocida.

¿Cómo se mide la efectividad de la gobernanza de la IA?

La eficacia se mide por la reducción de incidentes de IA en la sombra, la velocidad de aprobación de nuevas herramientas seguras y el número de fugas de datos evitadas. Una gobernanza exitosa también debe medirse mediante las tasas de adopción por parte de los usuarios; si los empleados eluden los controles para realizar su trabajo, es necesario ajustar la estrategia de gobernanza.