A medida que las organizaciones se apresuran a adoptar GenAI, implementar una seguridad ChatGPT eficaz se ha convertido en la principal prioridad para los CISO en 2026. Esta guía analiza las soluciones líderes que previenen la fuga de datos, bloquean las inyecciones rápidas y controlan el uso de IA en la sombra sin reducir la productividad de la fuerza laboral.

¿Qué son las herramientas de seguridad de ChatGPT y por qué son importantes?

Las herramientas de seguridad de ChatGPT son soluciones especializadas diseñadas para supervisar, gestionar y proteger la interacción entre usuarios empresariales y plataformas de IA generativa. A diferencia de los firewalls tradicionales o los sistemas DLP heredados, estas herramientas se integran directamente en el flujo de trabajo del usuario, a menudo dentro del navegador, para inspeccionar las solicitudes y respuestas en tiempo real. Evitan que los empleados peguen accidentalmente información personal identificable (PII) o IP confidencial en modelos públicos, a la vez que bloquean extensiones maliciosas que intentan secuestrar sesiones.

Para los responsables de seguridad empresarial, estas herramientas son la única línea de defensa contra la superficie de ataque "del navegador a la nube". Con ChatGPT convirtiéndose en el sistema operativo de facto para muchos puestos, el riesgo del SaaS en la sombra se ha disparado. Las herramientas de seguridad dedicadas proporcionan la visibilidad necesaria para ver qué aplicaciones de IA se están ejecutando realmente, garantizando que los datos corporativos permanezcan aislados de los modelos de entrenamiento públicos y que todo uso cumpla con los marcos regulatorios emergentes de 2026.

Tendencias clave de seguridad de ChatGPT a tener en cuenta en 2026

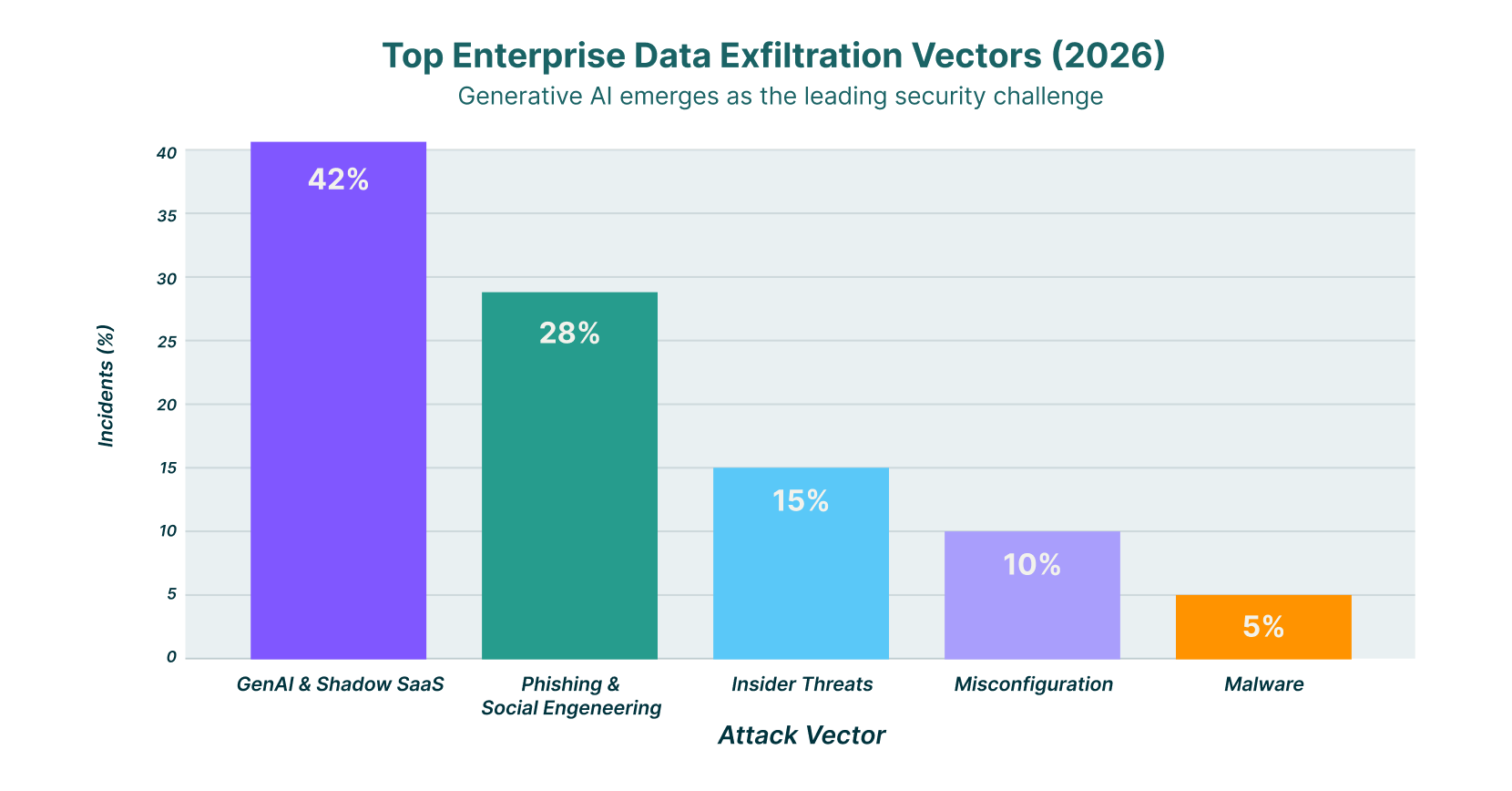

En 2026, la IA superó oficialmente al phishing como principal vector de exfiltración de datos en las empresas. Los atacantes ya no solo intentan robar credenciales, sino que manipulan los propios modelos de IA. Una nueva investigación ha descubierto vulnerabilidades como "ZombieAgent" y "HackedGPT", donde los atacantes utilizan la inyección indirecta de mensajes para convertir el asistente de IA de un empleado en una herramienta para exfiltrar la memoria privada y el historial de chat.

El auge de la "IA Agentic", donde los sistemas de IA pueden ejecutar acciones de forma autónoma, ha introducido nuevos riesgos significativos. Se ha descubierto que los navegadores que integran estos agentes, como ChatGPT Atlas, contienen vulnerabilidades que permiten que extensiones maliciosas eludan los límites de seguridad estándar. Este cambio significa que los equipos de seguridad ya no pueden simplemente bloquear URL; deben monitorear la intención real y la lógica de ejecución de los agentes de IA que se ejecutan en la sesión del navegador.

La ciberdelincuencia comercializada con IA también está transformando el panorama de amenazas. Las plataformas de "jailbreak como servicio" se venden ahora en la dark web, lo que permite incluso a atacantes poco cualificados eludir las barreras de seguridad de las LLM empresariales. En respuesta, la presión regulatoria obliga a las organizaciones a demostrar que cuentan con supervisión humana y gobernanza de datos granular para cada interacción con IA, convirtiendo el cumplimiento normativo de un simple requisito a un requisito operativo continuo.

Las 8 mejores herramientas de seguridad de ChatGPT para 2026

La siguiente lista destaca las principales soluciones para proteger el uso de GenAI, desde plataformas nativas del navegador hasta firewalls GenAI dedicados.

| Solución: | Capacidades Clave | Ideal para |

| LayerX | DLP del navegador en tiempo real, seguimiento completo de conversaciones y bloqueo de IA en las sombras | Protección universal en cualquier navegador |

| Islandia | Entorno de navegador empresarial completo, DLP integrado, sesiones aisladas | Equipos que reemplazan los navegadores estándar |

| Seguridad armónica | Protección de datos “sin intervención”, visibilidad del cumplimiento y monitoreo de IA en la sombra | Gobernanza de datos sin fricciones |

| CuadradoX | Detección de extensiones maliciosas, aislamiento de archivos, protección nativa del navegador | Detener los ataques del lado del cliente |

| Seguridad Menlo | Aislamiento remoto del navegador (RBI), protección contra pegado y controles de carga de archivos | Aislar a los usuarios de alto riesgo |

| Seguridad Koi | Descubrimiento de TI en la sombra, puntuación de riesgo de extensión y prevención de la venta de datos | Gestión de riesgos de las extensiones del navegador |

| Seguridad inmediata | Protección contra inyecciones rápidas, detección de TI en la sombra y moderación de contenido | Prevención de ataques basados en indicaciones |

| Seguridad Seráfica | Prevención de exploits, antiphishing, controles de datos detallados | Cómo prevenir exploits del navegador |

1. Capa X

LayerX es una plataforma de seguridad nativa para navegadores que ofrece protección en tiempo real contra la fuga de datos de ChatGPT y las amenazas web. Disponible como una extensión ligera, convierte cualquier navegador comercial en un espacio de trabajo seguro sin necesidad de una nueva infraestructura. LayerX ofrece una visibilidad completa de las interacciones del usuario, capturando el contexto completo de la conversación, tanto las indicaciones como las respuestas, para detectar cuándo se comparten datos confidenciales, como información de identificación personal (PII) o código fuente.

Además de la monitorización, LayerX aplica activamente políticas granulares para bloquear acciones de riesgo antes de que ocurran. Puede deshabilitar la función "pegar" para tipos de datos específicos, bloquear extensiones de navegador no autorizadas que intentan leer sesiones de ChatGPT y eliminar la IA oculta restringiendo el acceso a herramientas no autorizadas. Su capacidad para actuar a nivel de sesión garantiza que la seguridad siga al usuario, ya sea que esté en un dispositivo administrado o en un endpoint BYOD.

2. Islandia

Island adopta un enfoque diferente al reemplazar el navegador estándar para consumidores por un "Navegador Empresarial" dedicado. Esto brinda a los equipos de TI control total sobre todo el entorno de navegación, incluyendo la posibilidad de integrar controles de seguridad directamente en la interfaz de usuario. El motor DLP integrado de Island puede evitar que se peguen datos confidenciales en ChatGPT, restringir la carga de archivos e incluso bloquear las capturas de pantalla de sesiones confidenciales.

Para 2026, Island ha integrado funciones como el "Asistente de IA de Island", que permite a los usuarios acceder a las funciones de ChatGPT desde una barra lateral controlada y totalmente supervisada por las políticas corporativas. Esto garantiza que los empleados tengan acceso a herramientas de productividad mientras la organización mantiene límites estrictos en la transferencia de datos. Es una solución eficaz para las organizaciones que desean migrar su fuerza laboral a una nueva interfaz de navegador.

3. Seguridad armónica

Harmonic Security adopta una filosofía de protección de datos de "toque cero", con el objetivo de prevenir las fugas de datos sin obstaculizar la innovación ni frustrar a los empleados. La plataforma se centra en la visibilidad, identificando el uso de la "IA oculta" para que los equipos de seguridad puedan ver exactamente a qué herramientas se está accediendo y qué datos se les están transmitiendo. Utiliza modelos de protección de datos prediseñados para identificar información sensible sin necesidad de una configuración manual compleja.

La solución está diseñada para ayudar a las organizaciones a aprobar la adopción de IA, proporcionando las garantías de cumplimiento necesarias. Harmonic monitoriza los datos en reposo y en tránsito, garantizando que el uso de herramientas como ChatGPT por parte de los empleados se ajuste a las políticas de privacidad. Su enfoque de baja fricción es ideal para culturas que priorizan la agilidad y desean evitar políticas de bloqueo excesivas.

4. SquareX

SquareX se centra en neutralizar las amenazas del lado del cliente que afectan al navegador, incluyendo extensiones maliciosas y ataques basados en archivos. Su plataforma es especialmente eficaz para detectar extensiones de "TI en la sombra" que los usuarios podrían instalar para mejorar su experiencia en ChatGPT, pero que en realidad recopilan registros de chat confidenciales. SquareX aísla estos riesgos en tiempo real, impidiendo la ejecución de código no autorizado durante la sesión del navegador.

En 2026, SquareX amplió sus capacidades para protegerse contra la suplantación de la barra lateral de IA, una técnica en la que los atacantes imitan a los asistentes de IA para engañar a los usuarios y conseguir que revelen sus credenciales. Al monitorear el DOM en busca de modificaciones sospechosas, SquareX garantiza que la interfaz ChatGPT con la que interactúan los usuarios sea auténtica y segura. Esto la convierte en una herramienta crucial para las organizaciones preocupadas por la ingeniería social sofisticada basada en navegadores.

5. Seguridad de Menlo

Menlo Security aprovecha su tecnología principal de Aislamiento Remoto del Navegador (RBI) para crear una barrera segura entre el usuario y las plataformas GenAI. Al ejecutar la sesión del navegador en un contenedor remoto, Menlo garantiza que ningún código malicioso de una herramienta de IA comprometida pueda llegar al endpoint. Para la protección de datos, aplica estrictos controles de copia y pegado, lo que impide que los usuarios transfieran datos confidenciales de su portapapeles local a la sesión remota de ChatGPT.

La plataforma también inspecciona las subidas de archivos a las herramientas GenAI, eliminando metadatos y analizando en busca de amenazas ocultas antes de procesarlos. Este enfoque de aislamiento es muy eficaz para usuarios o departamentos de alto riesgo que interactúan frecuentemente con contenido externo no confiable. Permite a las organizaciones aprovechar las ventajas de productividad de ChatGPT a la vez que mantienen una postura de "Confianza Cero" respecto al contenido web.

6. Seguridad Koi

Koi Security se especializa en la gestión de riesgos asociados con las extensiones de navegador, un importante vector de fugas de datos en entornos GenAI. Su plataforma realiza un inventario de todas las extensiones instaladas y las puntúa según sus prácticas de recopilación de datos, marcando aquellas que se sabe que venden datos de usuarios o leen el historial de navegación. Esta visibilidad ayuda a los equipos de TI a identificar asistentes de escritura de IA "gratuitos" que, en realidad, monetizan la propiedad intelectual corporativa.

Al bloquear las extensiones de alto riesgo, Koi impide que herramientas de terceros extraigan el texto dentro de las ventanas de ChatGPT. Esto garantiza que las conversaciones confidenciales se mantengan privadas y no sean exfiltradas silenciosamente por un proceso en segundo plano. Para organizaciones con una plantilla numerosa y descentralizada que utilizan Chrome o Edge, Koi proporciona una capa de gobernanza necesaria sobre el ecosistema de extensiones del navegador.

7. Seguridad inmediata

Prompt Security se centra en proteger todo el ciclo de vida de la adopción de IA Generativa, desde el uso de herramientas públicas por parte de los empleados hasta el desarrollo de aplicaciones LLM internas. Su plataforma inspecciona cada respuesta de aviso y modelo para prevenir la exposición de datos y bloquear ataques de inyección de avisos. Incluye módulos específicos para la detección de IA en la sombra, lo que ayuda a los equipos de TI a identificar y categorizar cada herramienta de IA Generativa en uso en la red.

La herramienta destaca por su moderación y desinfección de contenido. Puede redactar automáticamente información confidencial de las solicitudes en tiempo real, garantizando que la información de identificación personal (PII) nunca salga del perímetro de la organización. Para las empresas que desarrollan sus propios agentes de IA, Prompt Security ofrece protección contra intentos de jailbreaking y resultados tóxicos, lo que la convierte en una excelente opción para los equipos de ingeniería que implementan IA de cara al cliente.

8. Seguridad Seráfica

Seraphic Security transforma cualquier navegador estándar en un navegador empresarial seguro mediante un agente ligero, que ofrece protección contra exploits y pérdida de datos. Su motor de "Prevención de Exploits" utiliza principios de ingeniería del caos para hacer que el entorno del navegador sea impredecible para los atacantes, deteniendo los exploits de día cero que podrían explotar vulnerabilidades en el motor del navegador subyacente o en las interfaces GenAI.

Para la seguridad de ChatGPT, Seraphic aplica políticas detalladas que controlan qué datos se pueden compartir. Puede deshabilitar funciones específicas del navegador, como la captura de pantalla o las herramientas para desarrolladores, mientras un usuario está en el dominio de OpenAI, lo que reduce el riesgo de robo de datos. Este enfoque proporciona controles de seguridad exhaustivos sin la necesidad de una infraestructura compleja como la VDI o la sustitución completa del navegador.

Cómo elegir la mejor herramienta de seguridad ChatGPT

- Evalúa si necesitas una extensión independiente del navegador como LayerX o si estás dispuesto a reemplazar todo tu navegador con una solución como Island.

- Priorice las herramientas que ofrecen “bloqueo de pegado” y redacción de datos en tiempo real para detener las fugas antes de que salgan del punto final.

- Busque capacidades de descubrimiento de “Shadow AI” que puedan identificar aplicaciones GenAI no autorizadas que se ejecutan fuera de su entorno SSO.

- Asegúrese de que la solución pueda inspeccionar el tráfico cifrado y comprender el contexto de la conversación, no solo el simple filtrado de URL.

- Seleccione un proveedor que ofrezca registros de auditoría detallados de las indicaciones y respuestas para satisfacer los requisitos de cumplimiento emergentes de 2026.

Preguntas Frecuentes

1. ¿Es ChatGPT seguro para uso empresarial en 2026?

ChatGPT Enterprise ofrece un cifrado robusto y cumple con SOC 2, pero el principal riesgo reside en el comportamiento del usuario y la configuración de la cuenta. Si bien OpenAI protege la infraestructura, no puede impedir que un empleado inserte voluntariamente la base de datos de un cliente en un mensaje. El uso seguro requiere una capa adicional de gobernanza del navegador para controlar los datos que entran en el modelo.

2. ¿Cómo puedo evitar que los empleados peguen datos confidenciales en ChatGPT?

El método más eficaz es usar una plataforma o extensión de seguridad del navegador que inspeccione los campos de entrada de texto en tiempo real. Herramientas como LayerX y Nightfall AI pueden detectar cuándo un usuario intenta pegar información personal identificable (PII) o IP en la ventana de ChatGPT y bloquear la acción inmediatamente, mostrando una advertencia al usuario explicando la infracción de la política.

3. ¿Cuál es la diferencia entre un navegador empresarial seguro y una extensión de navegador?

Un navegador empresarial seguro, como Island, es una aplicación independiente que reemplaza por completo a Chrome o Edge. Ofrece control total sobre el entorno, pero requiere un cambio en el comportamiento del usuario. Una extensión de navegador, como LayerX, se instala sobre los navegadores existentes, añadiendo funciones de seguridad y monitorización sin obligar a los usuarios a cambiar a una nueva interfaz ni a perder su configuración personalizada.

4. ¿Pueden las herramientas DLP heredadas proteger contra fugas de datos de GenAI?

Las herramientas DLP tradicionales suelen tener problemas con GenAI porque suelen operar a nivel de red o de archivo, sin tener en cuenta el contexto de los datos pegados en un formulario web. Pueden bloquear un sitio web completo, pero no pueden filtrar con precisión cadenas de texto específicas dentro de una sesión de chat. Las herramientas de seguridad modernas, nativas del navegador, están diseñadas específicamente para comprender las interacciones a nivel de DOM y proporcionar la granularidad necesaria.

5. ¿Cuáles son los riesgos de la “IA agente”?

La IA agéntica se refiere a sistemas de IA que pueden ejecutar tareas de forma autónoma, como navegar por la web o enviar correos electrónicos en nombre del usuario. El riesgo radica en que, si estos agentes se ven comprometidos (por ejemplo, mediante una inyección de prompt), pueden ser manipulados para realizar acciones maliciosas, como la exfiltración de datos o la instalación de malware sin el consentimiento explícito del usuario. Las herramientas de seguridad ahora deben monitorear las acciones de estos agentes, no solo el texto que generan.