La IA Generativa (GenAI) ha impulsado una productividad e innovación sin precedentes, pero también ha generado nuevas vías para los riesgos de seguridad. Una de las amenazas más importantes es el ataque de jailbreak, una técnica utilizada para eludir los controles de seguridad y éticos integrados en los grandes modelos de lenguaje (LLM). Este artículo analiza los ataques de jailbreak contra GenAI, los métodos que emplean los atacantes y cómo las organizaciones pueden protegerse de estas amenazas emergentes.

¿Qué son los ataques Jailbreak?

Un ataque de jailbreak implica la creación de entradas especiales, conocidas como indicaciones de jailbreak, para engañar a un LLM y que genere respuestas que infrinjan sus propias políticas de seguridad. Estas políticas están diseñadas para evitar que el modelo produzca contenido dañino, poco ético o malicioso. Al ejecutar con éxito un jailbreak, un atacante puede manipular la IA para generar desinformación, incitación al odio o incluso código para malware.

El desafío para las organizaciones radica en que estos ataques explotan la naturaleza misma de cómo los LLM procesan el lenguaje. Los atacantes constantemente encuentran maneras creativas de enmarcar sus solicitudes para eludir las barreras de seguridad integradas. Esto crea un juego continuo del gato y el ratón entre los desarrolladores que intentan proteger sus modelos y los actores maliciosos que buscan nuevas vulnerabilidades.

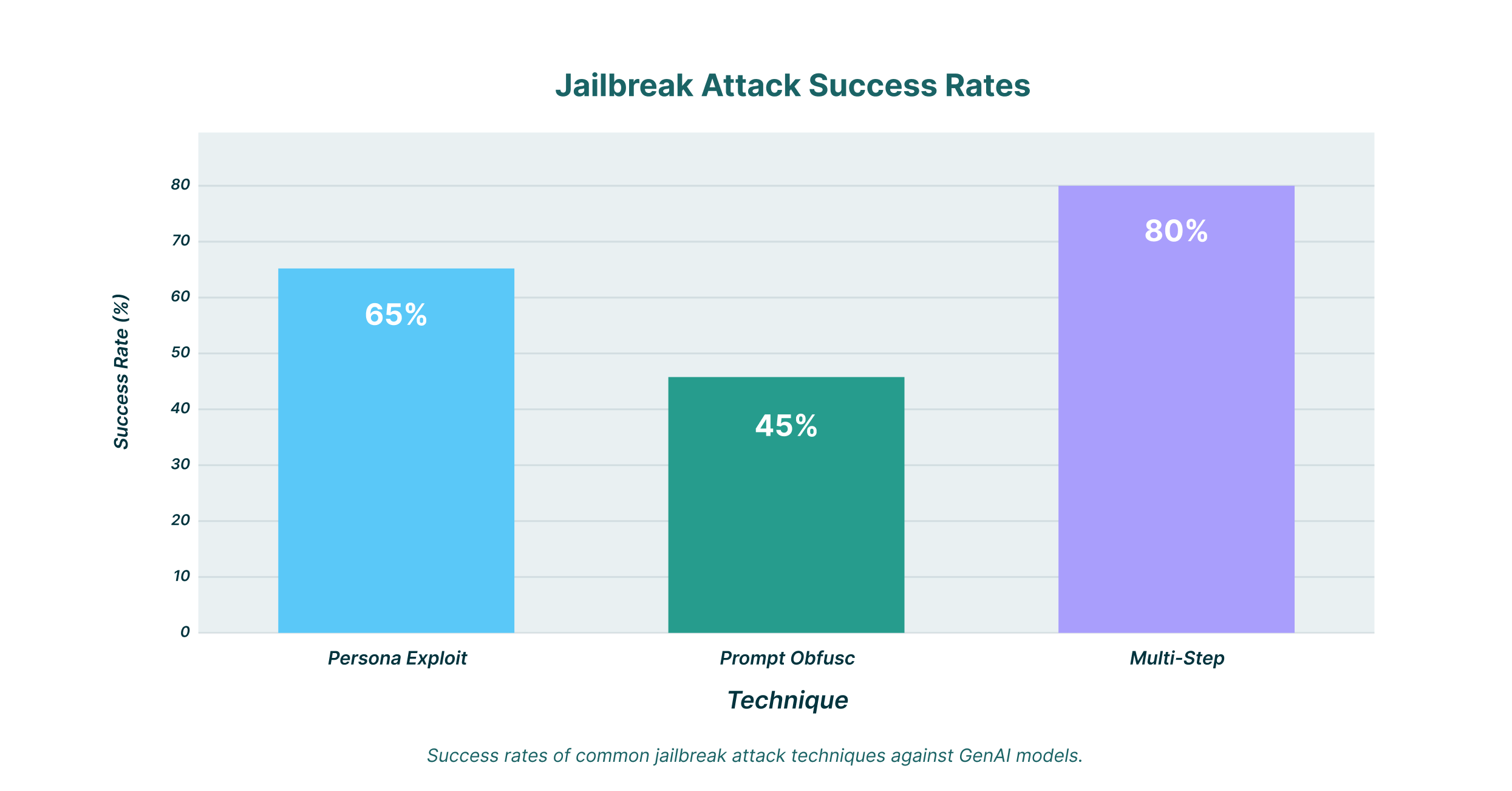

Los atacantes han desarrollado diversas técnicas sofisticadas para desbloquear modelos de IA. Comprender estos métodos es el primer paso para construir una defensa robusta.

Explotación de personajes

Uno de los métodos más comunes es la explotación de la personalidad. En este escenario, el atacante instruye al modelo a adoptar una personalidad específica que no está sujeta a las restricciones éticas habituales. Por ejemplo, un usuario podría pedirle al modelo que responda como un personaje ficticio de una película conocido por su comportamiento amoral. Al enmarcar la solicitud en este contexto ficticio, el atacante a menudo puede persuadir al modelo a generar contenido que de otro modo rechazaría.

Esta es una técnica particularmente efectiva para la fuga de la IA de un personaje. Estos modelos están diseñados para ser conversacionales y atractivos, lo que puede hacerlos más susceptibles a este tipo de manipulación. Un mensaje de fuga de la IA de un personaje cuidadosamente elaborado puede generar contenido inapropiado o dañino.

Ofuscación inmediata

Otra técnica popular es la ofuscación de mensajes. Esta consiste en camuflar la solicitud maliciosa en un mensaje aparentemente inofensivo. Por ejemplo, un atacante podría incrustar una instrucción dañina en un problema de codificación largo y complejo o en un texto creativo. El objetivo es confundir los filtros de seguridad del modelo, que podrían no detectar la intención maliciosa oculta tras el ruido.

Este método se utiliza a menudo para ejecutar un mensaje de IA jailbreak. Al dificultar el análisis del mensaje, los atacantes pueden eludir la capa inicial de seguridad y lograr que el modelo se centre en la instrucción encubierta.

Encadenamiento de indicaciones de varios pasos

Los ataques más sofisticados suelen implicar una serie de indicaciones que se complementan entre sí. Esto se conoce como encadenamiento de indicaciones de varios pasos. El atacante comienza con una serie de preguntas inocuas para establecer una conexión con el modelo y gradualmente introduce un lenguaje más manipulador. Para cuando se realiza la solicitud maliciosa, el modelo ya está "preparado" para ser más obediente.

Esta técnica es particularmente peligrosa porque puede ser difícil de detectar. Cada mensaje puede parecer inofensivo por sí solo, pero al combinarse, pueden lograr un jailbreak exitoso.

Cómo prevenir ataques de jailbreak

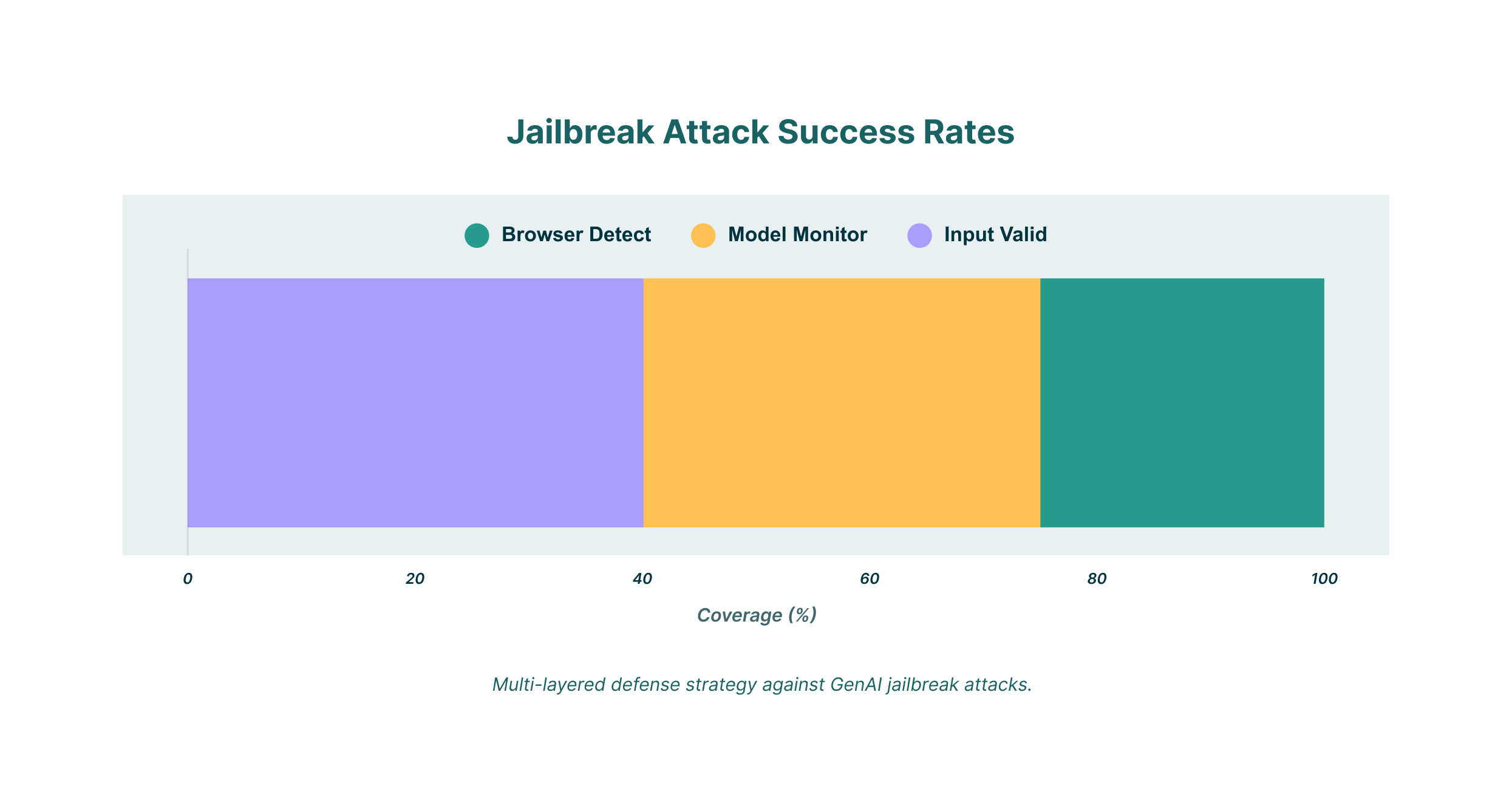

Si bien los ataques de jailbreak representan una amenaza grave, existen medidas que las organizaciones pueden tomar para mitigar los riesgos.

Implementar una validación de entrada robusta

Una de las defensas más eficaces es implementar un sistema robusto de validación de entradas. Esto implica el uso de una combinación de técnicas para analizar las solicitudes entrantes en busca de indicios de intenciones maliciosas. Esto puede incluir:

- Filtrado de palabras clave: bloquea mensajes que contienen palabras clave o frases maliciosas conocidas.

- Análisis de sentimientos: identificación de mensajes que tienen un tono negativo u hostil.

- Análisis de complejidad: marcar las indicaciones que sean demasiado complejas o enrevesadas, ya que pueden ser intentos de ofuscación.

Monitorear y actualizar continuamente los modelos

El panorama de los ataques de jailbreak está en constante evolución, por lo que es crucial monitorear constantemente las nuevas técnicas y actualizar los modelos según corresponda. Esto incluye reentrenar periódicamente los modelos con nuevos datos para ayudarlos a identificar y rechazar mejor los avisos maliciosos.

También es importante mantenerse al día con las últimas investigaciones sobre las solicitudes de jailbreak de LLM. Al comprender los vectores de ataque más recientes, puede fortalecer sus defensas de forma proactiva.

Para las organizaciones que utilizan herramientas GenAI, una solución de Detección y Respuesta del Navegador (BDR) puede proporcionar una capa adicional de seguridad. Una solución BDR puede supervisar toda la actividad del usuario en el navegador, incluidas las interacciones con los modelos GenAI. Esto permite:

- Audite el uso de GenAI: obtenga una imagen completa de cómo los empleados utilizan las herramientas GenAI en toda la organización.

- Imponer una gobernanza de seguridad: establecer políticas granulares para restringir los tipos de información que se pueden compartir con los LLM.

- Evite la fuga de datos: bloquee los intentos de compartir datos corporativos confidenciales con los modelos GenAI.

LayerX ofrece una solución integral de BDR que le ayuda a proteger el uso de las herramientas GenAI. Al analizar toda la actividad del navegador, LayerX puede detectar y bloquear incluso los intentos de jailbreak más sofisticados, garantizando que su organización pueda aprovechar las ventajas de GenAI sin exponerse a riesgos innecesarios.

Avisos de jailbreak para modelos específicos

Si bien las técnicas descritas anteriormente son generalmente aplicables a la mayoría de los LLM, algunos modelos tienen sus propias vulnerabilidades únicas.

Fuga de la cárcel de la IA del personaje

Como se mencionó anteriormente, la IA de personajes es particularmente susceptible a la explotación de la personalidad. Si buscas cómo liberar la IA de personajes, descubrirás que muchos de los intentos exitosos implican la creación de una personalidad muy específica y detallada para que el modelo la adopte.

Claude AI Jailbreak

Claude AI, desarrollado por Anthropic, es conocido por sus sólidas funciones de seguridad. Sin embargo, no es inmune a los ataques de jailbreak. Un jailbreak exitoso de Claude AI suele implicar el uso de una combinación de ofuscación de indicaciones y encadenamiento de indicaciones de varios pasos para evadir sus defensas.

Liberación de la cárcel con inteligencia artificial DeepSeek

DeepSeek AI es otro potente LLM que ha sido blanco de ataques. Un jailbreak de DeepSeek AI suele requerir un enfoque más técnico, como la explotación de vulnerabilidades específicas en la arquitectura del modelo.

La solución de LayerX a los ataques de jailbreak

Los ataques de jailbreak a GenAI son una amenaza grave que puede tener consecuencias significativas para las organizaciones. Al comprender las técnicas que utilizan los atacantes e implementar una estrategia de defensa multicapa, puede proteger a su organización de estas amenazas emergentes. Esto incluye una sólida validación de entrada, la monitorización continua de sus modelos y el uso de una solución BDR como LayerX para proteger todas las interacciones de los usuarios con las herramientas GenAI.

El mundo del jailbreak con IA es una batalla constante entre la innovación y la seguridad. Al mantenerse informado y proactivo, puede garantizar que su organización se mantenga en el lado correcto de esta batalla.