La integración de la IA Generativa en los flujos de trabajo empresariales no es una propuesta a largo plazo; está ocurriendo ahora mismo, a un ritmo que a menudo supera las capacidades de seguridad y gobernanza. Por cada uso documentado y autorizado de una herramienta de IA que impulsa la productividad, existen innumerables casos de uso "en la sombra", lo que expone a las organizaciones a amenazas significativas. El reto para los analistas de seguridad, los CISO y los líderes de TI es claro: ¿cómo posibilitamos la innovación que promete la IA sin exponernos a riesgos inaceptables? La respuesta reside en un enfoque disciplinado y proactivo para la gestión de riesgos de la IA. No se trata de bloquear el progreso, sino de construir barreras que permitan a su organización acelerar de forma segura.

La creciente necesidad de gobernanza de la IA

Antes de implementar una estrategia de riesgo eficaz, es necesario establecer las bases de la gobernanza de la IA. La rápida adopción descentralizada de herramientas de IA implica que, sin una estructura de gobernanza formal, las organizaciones operan a ciegas. Los empleados, deseosos de mejorar su eficiencia, adoptarán de forma independiente diversas plataformas y complementos de IA, a menudo sin considerar las implicaciones de seguridad. Esto crea una compleja red de uso no autorizado de SaaS, donde datos corporativos confidenciales, desde información personal identificable (PII) y registros financieros hasta propiedad intelectual, pueden filtrarse involuntariamente a Modelos de Lenguaje Largo (LLM) de terceros.

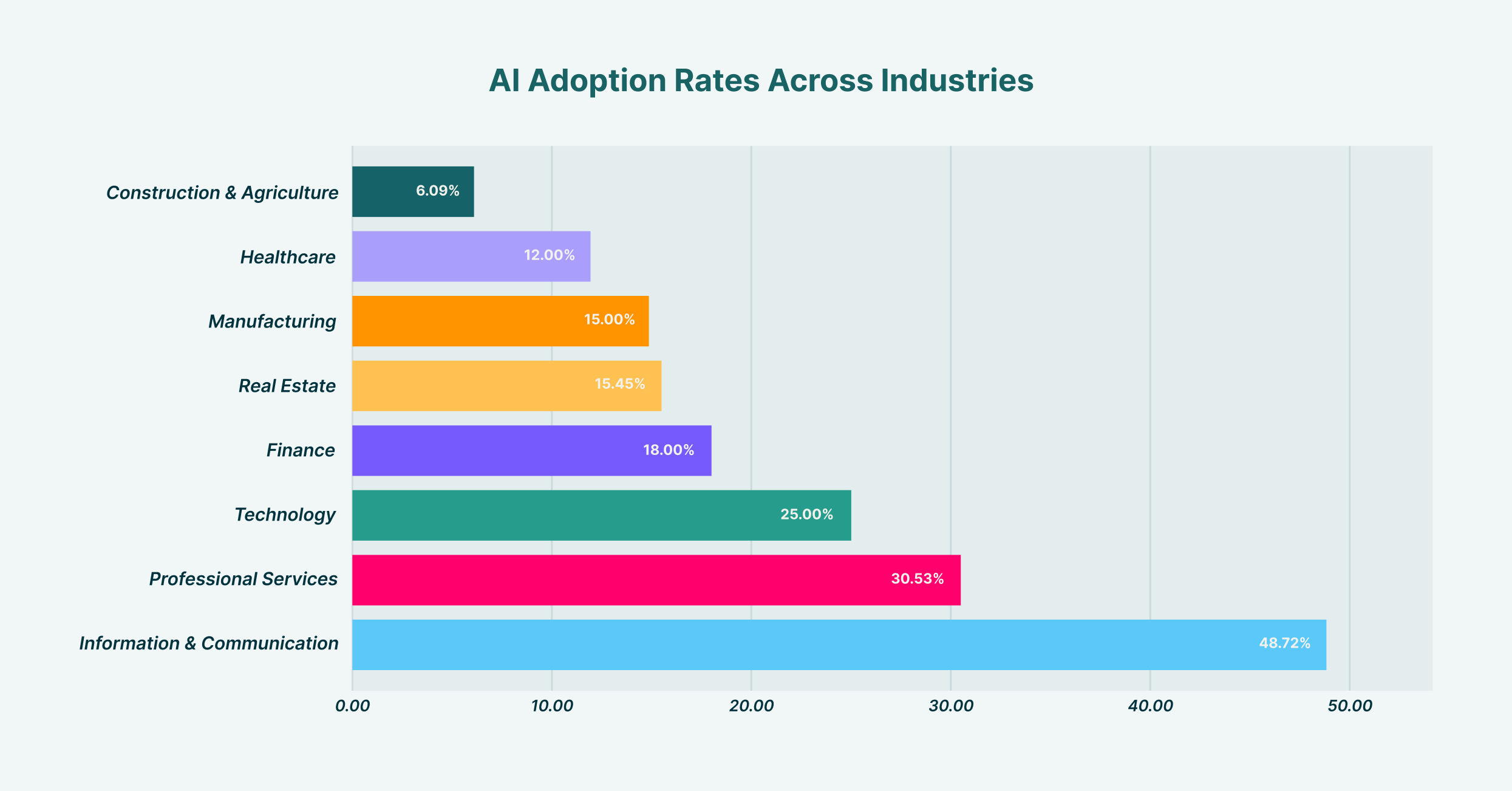

La adopción de IA varía significativamente entre las industrias, siendo Información y Comunicación las que lideran con un 48.7% y Construcción y Agricultura las que tienen el porcentaje más bajo, con un 6.1%.

Establecer una gobernanza sólida de la IA implica la creación de un equipo interdisciplinario, que suele incluir representantes de los departamentos de TI, seguridad, legal y comercial. Este comité se encarga de definir la postura de la organización respecto a la IA. ¿Cuál es nuestro nivel de tolerancia al riesgo? ¿Qué casos de uso se fomentan y cuáles se prohíben? ¿Quién es responsable cuando ocurre un incidente relacionado con la IA? Responder a estas preguntas proporciona la claridad necesaria para desarrollar políticas y controles. Sin esta dirección estratégica descendente, cualquier intento de gestionar el riesgo se convierte en una serie de medidas inconexas y reactivas en lugar de una defensa cohesiva. Este marco de gobernanza se convierte en la guía para todas las iniciativas de seguridad posteriores, garantizando la alineación de la tecnología, las políticas y el comportamiento del usuario.

Construyendo su marco de gestión de riesgos de IA

Con una estructura de gobernanza establecida, el siguiente paso es construir un marco formal de gestión de riesgos de IA. Este marco operacionaliza los principios de gobernanza, convirtiendo la estrategia general en procesos concretos y repetibles. Proporciona un método estructurado para identificar, evaluar, mitigar y supervisar los riesgos relacionados con la IA en toda la organización. En lugar de reinventar la rueda, las organizaciones pueden adaptar modelos establecidos, como el Marco de Gestión de Riesgos de IA del NIST, para que se ajusten a su contexto operativo y panorama de amenazas específicos.

El desarrollo de un marco eficaz para la gestión de riesgos de IA debe ser un proceso metódico. Comienza con la creación de un inventario exhaustivo de todos los sistemas de IA en uso, tanto autorizados como no autorizados. Esta fase inicial de descubrimiento es crucial; no se puede proteger lo que no se ve. Tras el descubrimiento, el marco debe describir los procedimientos para la evaluación de riesgos, asignando puntuaciones en función de factores como el tipo de datos que se procesan, las capacidades del modelo y su integración con otros sistemas críticos. A partir de esta evaluación, se diseñan estrategias de mitigación que abarcan desde controles técnicos y formación de usuarios hasta la prohibición total de aplicaciones de alto riesgo. Finalmente, el marco debe incluir un ritmo de supervisión y revisión continuas, ya que tanto el ecosistema de IA como el uso que la organización hace de él evolucionan constantemente. Existen diversos marcos de gestión de riesgos de IA, pero los más eficaces son aquellos que no son documentos estáticos, sino componentes activos del programa de seguridad de la organización.

Categorización de los riesgos de la IA: desde la exfiltración de datos hasta el envenenamiento de modelos

Un componente fundamental de la IA y la gestión de riesgos es comprender los tipos específicos de amenazas a las que se enfrenta. Los riesgos no son monolíticos; abarcan un espectro que va desde violaciones de la privacidad de datos hasta ataques sofisticados contra los propios modelos de IA. Una de las amenazas más inmediatas y comunes es la fuga de datos. Imagine a un analista de marketing copiando una lista de clientes potenciales de alto valor, con su información de contacto, en una herramienta pública de GenAI para redactar correos electrónicos de contacto personalizados. En ese momento, se han exfiltrado datos confidenciales de los clientes y ahora forman parte de los datos de formación del LLM, fuera del control de su organización y en posible infracción de normativas de protección de datos como el RGPD o la CCPA.

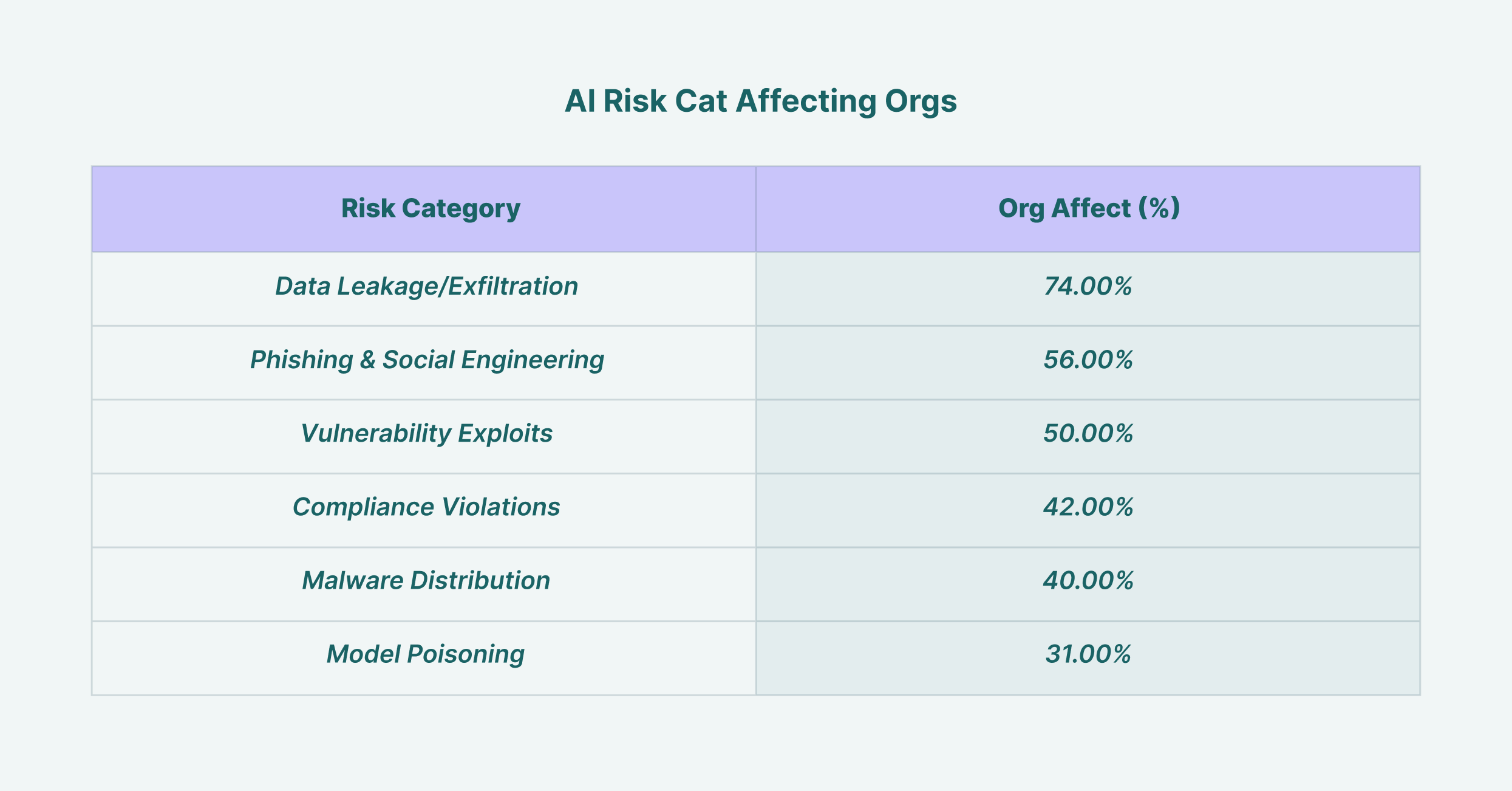

La fuga de datos afecta al 74% de las organizaciones, lo que la convierte en el riesgo de seguridad de la IA más frecuente, seguido de los ataques de phishing con un 56%.

Más allá de la fuga de datos, los líderes de seguridad deben enfrentarse a amenazas más avanzadas. El envenenamiento de modelos ocurre cuando un atacante introduce intencionalmente datos maliciosos en un modelo durante su fase de entrenamiento, lo que provoca que produzca resultados sesgados, incorrectos o dañinos. Los ataques de evasión implican la creación de entradas diseñadas específicamente para eludir los filtros de seguridad de un sistema de IA. Para los CISO, el uso eficaz de la IA en la gestión de riesgos también implica aprovechar las herramientas de seguridad basadas en IA para detectar estas mismas amenazas. Los sistemas avanzados de detección de amenazas pueden analizar el comportamiento del usuario y los flujos de datos para identificar actividades anómalas que indiquen un incidente de seguridad relacionado con la IA, convirtiendo la tecnología de una fuente de riesgo en un componente de la solución.

El papel fundamental de una política de seguridad de la IA

Para traducir su marco de trabajo en directrices claras para sus empleados, una política de seguridad de IA específica es innegociable. Este documento sirve como fuente fidedigna sobre el uso aceptable de la IA dentro de la organización. Debe ser claro, conciso y de fácil acceso para todos los empleados, sin dejar lugar a ambigüedades. Una política de seguridad de IA bien elaborada va más allá de los simples "qué hacer y qué no hacer" y proporciona contexto, explicando... por qué Se han establecido ciertas restricciones para fomentar una cultura de concienciación sobre la seguridad en lugar del mero cumplimiento.

La política debe definir explícitamente varias áreas clave. En primer lugar, debe enumerar todas las herramientas de IA autorizadas y aprobadas, junto con el proceso para solicitar la evaluación de una nueva herramienta. Esto previene la proliferación de la IA en la sombra. En segundo lugar, debe establecer directrices claras para el manejo de datos, especificando qué tipos de información corporativa (p. ej., pública, interna, confidencial, restringida) se pueden usar con cada categoría de herramientas de IA. Por ejemplo, usar una herramienta pública GenAI para resumir artículos de noticias disponibles públicamente podría ser aceptable, pero usarla para analizar proyecciones financieras confidenciales estaría estrictamente prohibido. La política también debe describir las responsabilidades de los usuarios, las consecuencias del incumplimiento y el protocolo de respuesta a incidentes ante sospechas de infracciones relacionadas con la IA, garantizando que todos comprendan su rol en la protección de la organización.

Evaluación de modelos y complementos: un enfoque en la gestión de riesgos de terceros de IA

El ecosistema moderno de IA se basa en una compleja cadena de suministro de modelos, plataformas y complementos desarrollados por terceros. Esta realidad convierte la gestión de riesgos de terceros en IA en un pilar fundamental de su estrategia de seguridad global. Cada vez que un empleado habilita un nuevo complemento para su asistente de IA o su equipo de desarrollo integra una API de terceros, amplía la superficie de ataque de su organización. Cada uno de estos componentes externos conlleva su propio conjunto de posibles vulnerabilidades, políticas de privacidad de datos y medidas de seguridad, que ahora su organización hereda.

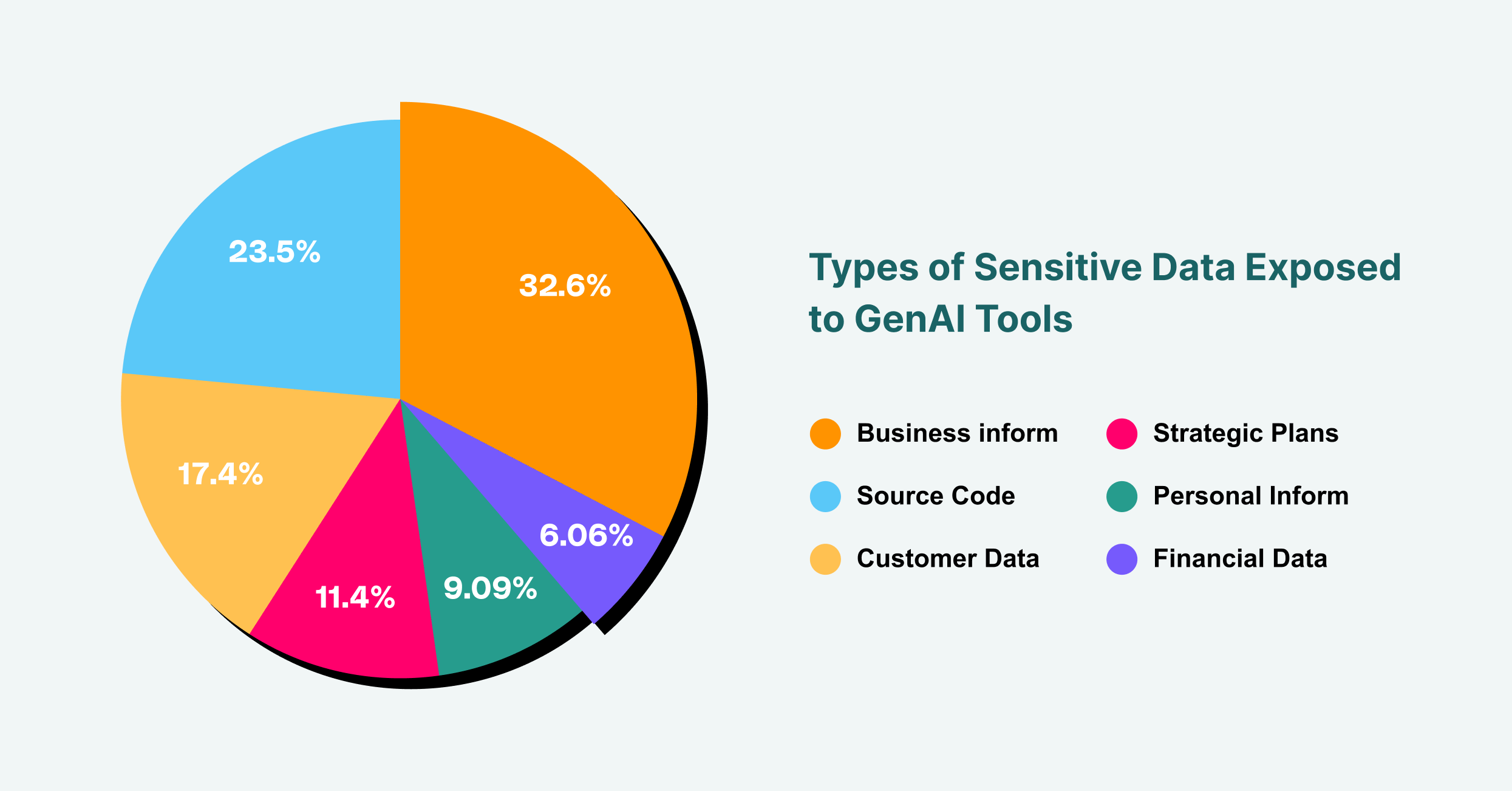

La información empresarial representa el 43% de las exposiciones de datos confidenciales a GenAI, seguida del código fuente con el 31% y los datos de los clientes con el 23%.

Por lo tanto, es esencial un proceso de evaluación riguroso. Antes de aprobar el uso de cualquier herramienta o componente de IA de terceros, debe someterse a una revisión exhaustiva de seguridad y privacidad. Esto implica examinar las certificaciones de seguridad, las prácticas de gestión de datos y las capacidades de respuesta a incidentes del proveedor. ¿Qué datos recopila la herramienta? ¿Dónde se almacenan y quién tiene acceso a ellos? ¿Tiene el proveedor un historial de brechas de seguridad? En el caso de los complementos de IA, que son un vector creciente de ataques basados en navegador, el proceso de verificación debe ser aún más estricto. Algunas preguntas que debe hacerse son: ¿Qué permisos requiere el complemento? ¿Quién es el desarrollador? ¿Se ha auditado su código? Al tratar cada servicio de IA de terceros con el mismo nivel de escrutinio que cualquier otro proveedor crítico, puede mitigar el riesgo de que un ataque a la cadena de suministro comprometa a su organización.

Implementación de herramientas de gestión de riesgos de IA

Las políticas y los procesos son fundamentales, pero son insuficientes sin una aplicación técnica. Aquí es donde las herramientas de gestión de riesgos de IA se vuelven esenciales. Estas soluciones proporcionan la visibilidad y el control necesarios para garantizar que su política de seguridad de IA se cumpla en la práctica, no solo en teoría. Dado que la interfaz principal para la mayoría de los usuarios que interactúan con GenAI es el navegador web, las herramientas que pueden operar en esta capa están en una posición privilegiada para proporcionar una supervisión eficaz.

Las extensiones o plataformas de navegador empresariales, como LayerX, ofrecen un potente mecanismo para la gestión de riesgos de IA. Permiten descubrir y mapear todo el uso de GenAI en la organización, lo que proporciona un inventario en tiempo real de qué usuarios acceden a qué plataformas. Esta visibilidad es el primer paso para frenar la IA oculta. A partir de ahí, estas herramientas pueden implementar medidas de seguridad granulares basadas en el riesgo. Por ejemplo, se podría configurar una política que impida a los usuarios pegar texto identificado como "confidencial" en un chatbot de IA público, o que advierta a los usuarios antes de subir un documento confidencial. Esta capa de protección supervisa y controla el flujo de datos entre el navegador del usuario y la web, actuando eficazmente como una solución de prevención de pérdida de datos (DLP) diseñada específicamente para la era de la IA. Las herramientas adecuadas de gestión de riesgos de IA acortan la distancia entre las políticas y la realidad, proporcionando los medios técnicos para aplicar las decisiones de gobernanza.

Manejo y respuesta ante incidentes en la era de la IA

Incluso con las mejores medidas preventivas, pueden ocurrir incidentes. La respuesta de su organización es un factor determinante para minimizar el impacto de una brecha de seguridad. Un plan de respuesta a incidentes eficaz para la IA debe ser específico y estar bien ensayado. Cuando se activa una alerta, ya sea por un informe de un usuario o por una detección automatizada de una de sus herramientas de seguridad, el equipo de respuesta necesita un manual de estrategias claro.

El primer paso es la contención. Si un usuario ha filtrado inadvertidamente datos confidenciales a un LLM, la prioridad inmediata es revocar el acceso y evitar una mayor exposición. Esto podría implicar desactivar temporalmente el acceso del usuario a la herramienta o incluso aislar su equipo de la red. La siguiente fase es la investigación. ¿Qué datos se filtraron? ¿Quién fue el responsable? ¿Cómo fallaron nuestros controles? Este análisis forense es crucial para comprender la causa raíz y prevenir que se repita. Finalmente, el plan debe abordar la erradicación y la recuperación, lo que incluye notificar a las partes afectadas según lo exija la ley, tomar medidas para que el proveedor de IA elimine los datos si es posible y actualizar las políticas y controles de seguridad según las lecciones aprendidas. Una estrategia madura de IA y gestión de riesgos implica estar tan preparado para responder a un incidente como para prevenirlo.

Seguimiento y mejora de su postura frente al riesgo de la IA

La gestión de riesgos de IA no es un proyecto puntual; es un ciclo continuo de evaluación, mitigación y mejora. El panorama de amenazas es dinámico, con la constante aparición de nuevas herramientas de IA y vectores de ataque. Por lo tanto, el seguimiento de la postura de riesgo de IA de su organización a lo largo del tiempo es esencial para garantizar la eficacia de sus defensas. Esto requiere un compromiso con la monitorización continua y el uso de métricas para cuantificar su nivel de riesgo y el rendimiento de sus controles.

Los Indicadores Clave de Rendimiento (KPI) pueden incluir la cantidad de herramientas de IA no autorizadas detectadas, el volumen de incidentes de fuga de datos prevenidos y el porcentaje de empleados que han completado la capacitación en seguridad de IA. Las auditorías y pruebas de penetración periódicas, centradas específicamente en los sistemas de IA, también pueden proporcionar información valiosa sobre las debilidades de sus defensas. Al medir y perfeccionar continuamente su enfoque, crea un programa de seguridad resiliente que se adapta a los desafíos cambiantes del mundo impulsado por la IA. Esta postura proactiva garantiza que su organización pueda seguir aprovechando el poder de la IA con confianza y seguridad, transformando una posible fuente de riesgo catastrófico en una ventaja estratégica bien gestionada.